一、基于局域网的多GPU上并行训练

TensorFlow 的 MirroredStrategy 和 PyTorch 的 DistributedDataParallel 它们可以帮助您在多个 GPU 或多个计算节点上训练大型模型。这些策略的核心目标是提高训练速度,同时保持模型的准确性和稳定性。

TensorFlow 的 MirroredStrategy

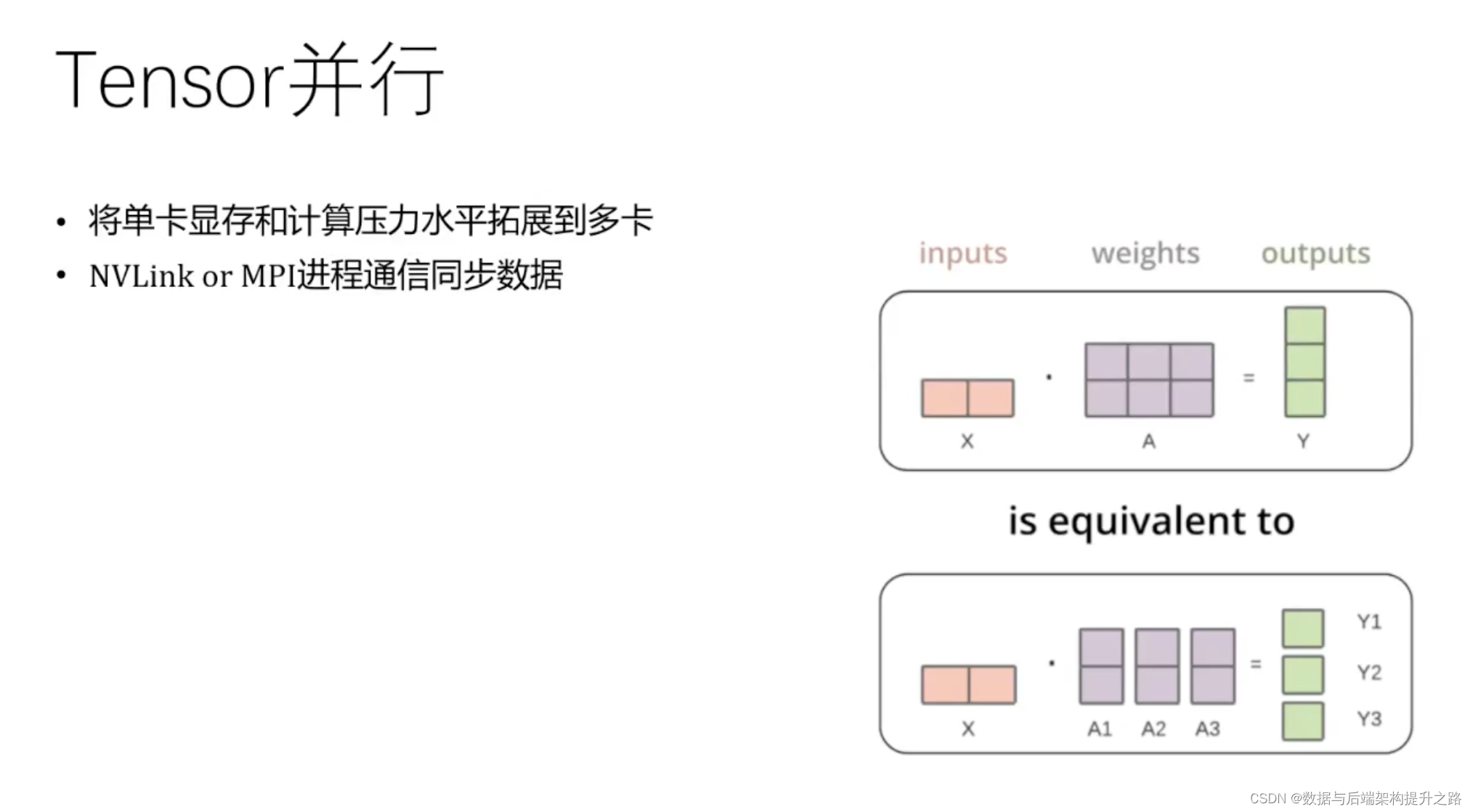

MirroredStrategy 是 TensorFlow 中的一种分布式策略,用于在多个 GPU(在同一节点上)上进行同步训练。它将模型权重复制到所有可用的 GPU 上,然后在每个 GPU 上执行模型的前向和后向传播。权重更新是在所有 GPU 上计算的平均值,以确保模型在所有设备上保持一致。MirroredStrategy 主要用于模型并行训练,通过在多个 GPU 上执行计算来加速训练过程。

要使用 MirroredStrategy,首先需要创建一个 对象,然后使用该对象创建一个分布式训练的上下文。接下来,您可以像在普通 TensorFlow 程序中一样定义和训练模型。MirroredStrategy 会自处理分布式训练的细节。

PyTorch 的 DistributedDataParallel

DistributedDataParallel 是 PyTorch 中的一种分布式训练策略,可以在多个 GPU 或多个计算节点上进行同步训练。与 TensorFlow 的 M

订阅专栏 解锁全文

订阅专栏 解锁全文

890

890

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?