无需担心复杂的实现细节,只需简单调用 API,就可以为文本和图像创建 SOTA 表征向量。

从 BERT 到 BERT-as-service

2018 年 9 月,Google 一篇 BERT 模型相关论文引爆全网:该自然语言模型,在机器阅读理解顶级水平测试 SQuAD1.1 中,连破 11 项 NLP 测试记录,两个衡量指标全面超越人类。

BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding

这不仅开启了 NLP 的全新时代,也标志着迁移学习和预训练+微调的模式,开始进入人们的视野。

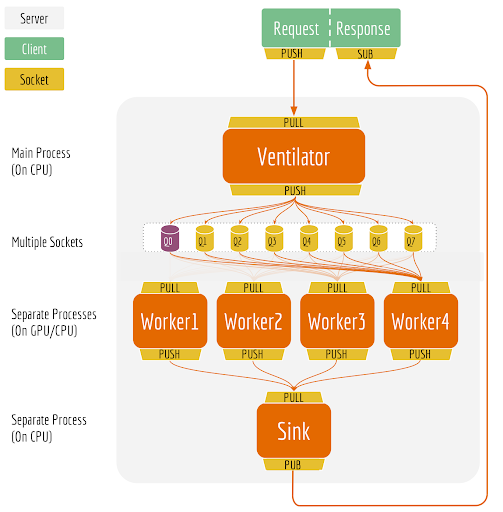

2018 年 10 月,BERT 发布仅一个月后,BERT-as-service 横空出世。用户可以使用一行代码,通过 C/S 架构的方式,连接到服务端,快速获得句向量。

作为基于 BERT 的第一个微服务框架,BERT-as-service 通过对 BERT 的高度封装和深度优化,以方便易用的网络微服务 API 接口,赢得了 NLP 及机器学习技术社区的广泛关注。

它简洁的 API 交互方式、文档写作风格,甚至连 README 排版,都成为之后众多开源项目的模板。

如果说 BERT 是迁移学习的里程碑,那么 BERT-as-service 的出现,可以称得上是迁移学习,在工程服务化的里程碑。

GitH

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1313

1313

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?