目录

文章目录

EAL 环境抽象层

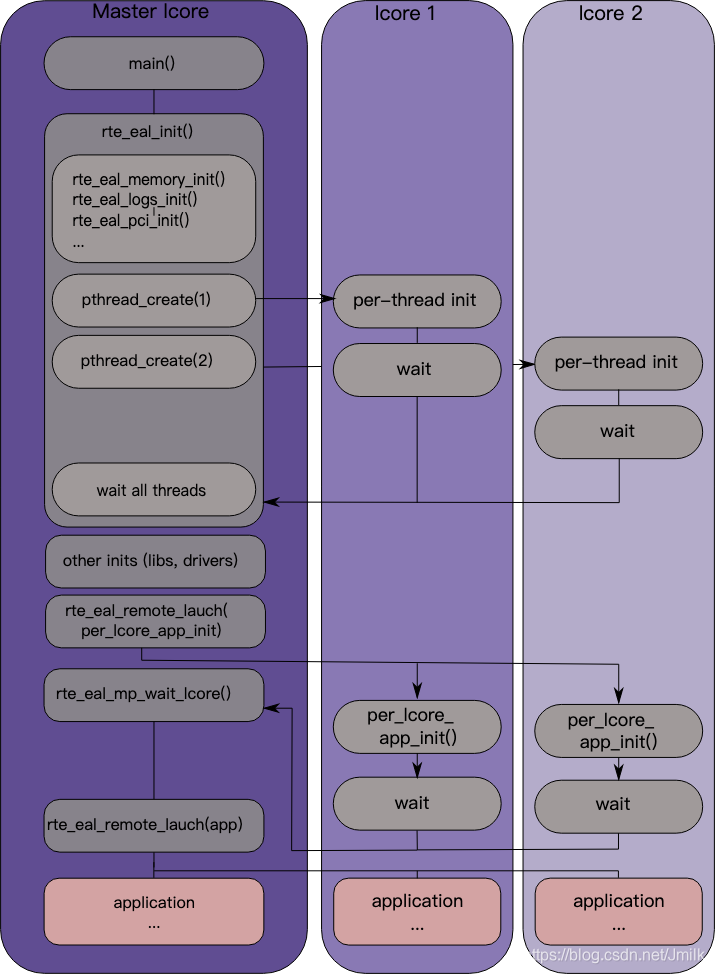

EAL(Environment Abstraction Layer,环境抽象层)库,提供了一组屏蔽操作系统底层细节的 API 封装,用于对 DPDK Application 的 RTE(Runtime Environment,运行时环境)进行初始化,以及启动相应的 Master lcore 和 Slave lcore。

helloworld 示例程序

DPDK 提供的 helloworld 示例程序是一个最简单的 DPDK Application,非常适用于解析 EAL 的运行原理。

编译运行

helloworld 实现的功能很简单,主要集中在 EAL 库的使用上:

- 完成 EAL 初始化流程;

- 在每个 Slave lcore 上打印语句 hello from core X;

- 等所有 Slave 打印完成后,在 Master lcore 也打印一句后退出。</

本文详细介绍了DPDK的环境抽象层(EAL)如何初始化运行时环境,包括CPU特性识别、lcore(逻辑核心)初始化、内存管理、PCIe设备初始化和中断事件处理等关键步骤。通过EAL的接口如rte_eal_init()和rte_eal_remote_launch(),DPDK应用能够在Linux用户空间中高效地管理和利用硬件资源。

本文详细介绍了DPDK的环境抽象层(EAL)如何初始化运行时环境,包括CPU特性识别、lcore(逻辑核心)初始化、内存管理、PCIe设备初始化和中断事件处理等关键步骤。通过EAL的接口如rte_eal_init()和rte_eal_remote_launch(),DPDK应用能够在Linux用户空间中高效地管理和利用硬件资源。

订阅专栏 解锁全文

订阅专栏 解锁全文

2553

2553

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?