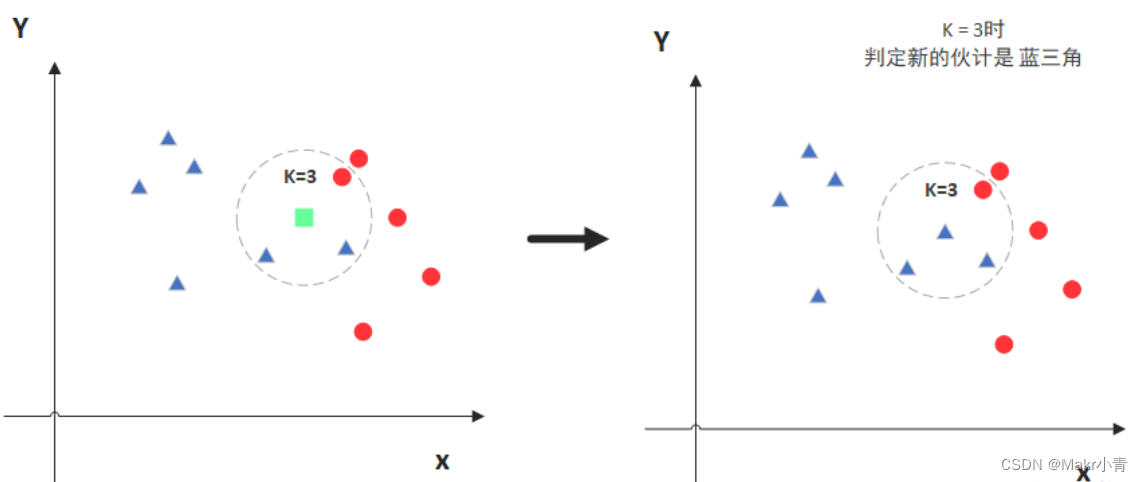

KNN(K-Nearest Neighbor)算法,意思是K个最近的邻居,从这个名字我们就能看 出一些KNN算法的蛛丝马迹了。K个最近邻居,毫无疑问,K的取值肯定是至关重要的。那么最近的邻居又是怎么回事呢?其实啊,KNN的原理就是当预测一个新的 值x的时候,根据它距离最近的K个点是什么类别来判断x属于哪个类别。KNN算法可以用于分类和回归,是一种监督学习算法。

思路:如果一个样本在特征空间中的K个最相似(即特征空间中最邻近)的样本中的大多数属于某一个类别,则该样本也属于这个类别。也就是说,该方法在定类决策上只依据最邻近的一个或者几个样本的类别来决定待分样本所属的类别。

KNN的优缺点

优点:

1)算法简单,理论成熟,既可以用来做分类也可以用来做回归。

2)可用于非线性分类。

3)没有明显的训练过程,而是在程序开始运行时,把数据集加载到内存后,不需要进行训练,直接进行预测,所以训练时间复杂度为0。

4)由于KNN方法主要靠周围有限的邻近的样本,而不是靠判别类域的方法来确定所属的类别,因此对于类域的交叉或重叠较多的待分类样本集来说,KNN方法较其他方法更为适合。

缺点:

1)需要算每个测试点与训练集的距离,当训练集较大时,计算量相当大,时间复杂度高,特别是特征数量比较大的时候。

2)需要大量的内存,空间复杂度高。

3)样本不平衡问题(即有些类别的样本数量很多,而其它样本的数量很少),对稀有类别的预测准确度低。

4)是lazy learning方法,基本上不学习,导致预测时速度比起逻辑回归之类的算法慢。

KNN的应用和它的场景

我们用sklearn库来看看如何使用KNN,并会简单介绍一下KNN的场景。

1. 将数据集分割成测试数据集和训练数据集

from sklearn.model_selection import train_test_split

X_train,X_test,y_train,y_test =train_test_split(X,y)

2. 创建一个KNeighborsClassifier 对象

from sklearn.neighbors import KNeighborsClassifier

knn= KNeighborsClassifier()

3 使用KNeighborsClassifier 对象进行fit创建出模型,得出分类准确度

knn.fit(X_train,y_train)

knn.score(X_test,y_test)

4 使用我们的模型预测测试集

y_predict = knn.predict(X_test)

KNN的初始函数(构造函数)的参数和默认参数是:

(n_neighbors=5,weights=’uniform’, algorithm=’auto’, leaf_size=30, p=2,

metric=’minkowski’,metric_params=None, n_jobs=1, **kwargs)

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?