搭建前准备:

1.环境搭建资源:

链接:https://pan.baidu.com/s/1m0OIGidfr7if42NPHcnRjg

提取码:b8ru

根据自己需要下载对应得资源即可

2.打开虚拟机,登录你的Linux系统。

3..使用SSH(或者Xftp)工具远程登陆服务器。

4.用文件传输工具远程登录系统。

5.在/home目录下新建 Hadoop java 文件夹。

6.将之前下载好的jdk上传到/home/java目录下。

7.在/home/java目录下 执行命令 rpm -ivh jdk-7u67-linux-x64.rpm 安装

java环境.

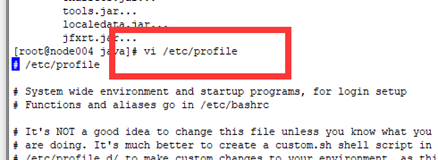

8.配置java环境变量. 执行命令 vi /etc/profile 编辑配置文件。

9.将以下配置文件输入到 /etc/profile中:

export JAVA_HOME=/usr/java/jdk1.7.0_67 //根据自己的jdk位置填写

export HADOOP_HOME=/home/hadoop/hadoop-2.5.1

export PATH=$PATH:$JAVA_HOME/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

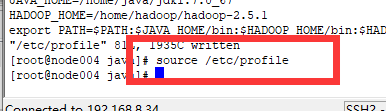

10.配置好文件后保存并退出,重新加载配置文件。执行命令:

source /etc/profile

11.使用Secure File Transfer Client(Xftp) 在/home/hadoop目录下 上传下载好的 Hadoop 解压包。

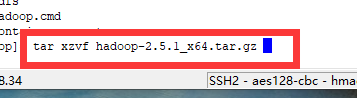

12.切换到/home/hadoop目录下,执行命令:

tar xzvf hadoop-2.5.1_x64.tar.gz

13.等待解压完成,会生成一个文件夹 hadoop-2.5.1

14.执行命令: cd /home/hadoop/hadoop-2.5.1/etc/hadoop,切换目录。

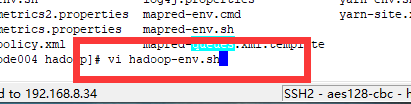

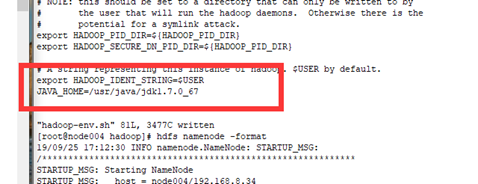

15.执行命令: vi hadoop-env.sh ,配置hadoop-env.sh文件

16.配置JAVA_HOME, 输入: JAVA_HOME=/usr/java/jdk1.7.0_67

17.执行命令:cd /home/hadoop/hadoop-2.5.1/etc/hadoop 切换目录。

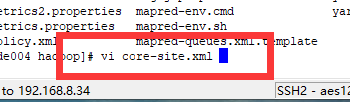

18.执行命令: vi core-site.xml ,配置core-site.xml。

19.配置以下文件:

<property>

<name>fs.defaultFS</name>

<value>hdfs://192.168.8.34:8020</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/data/tmp</value>

</property>

20.执行命令:cd /home/hadoop/hadoop-2.5.1/etc/hadoop ,切换目录。

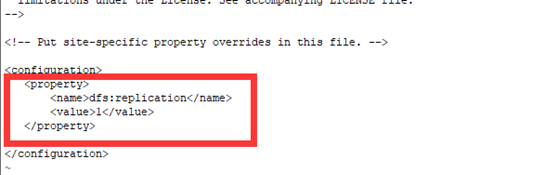

21.执行命令:vi hdfs-site.xml ,配置hdfs-site.xml文件:

<property>

<name>dfs:replication</name>

<value>1</value>

</property>

22.ssh-keygen -t dsa -P '' -f ~/.ssh/id_dsa --生成公钥和秘钥

cat ~/.ssh/id_dsa.pub >> ~/.ssh/authorized_keys --将公钥放入文件中

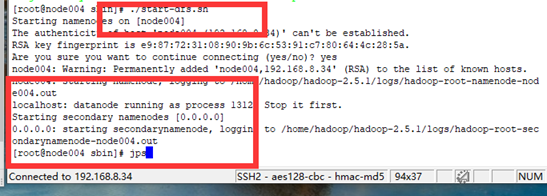

23.格式化NameNode,执行命令:hdfs namenode -format

24.执行命令:cd ../../sbin 切换到sbin 目录下

25.执行命令: start-dfs.sh 启动namennode。

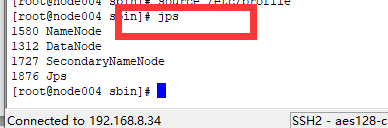

26.执行命令:jps 查看启动成功信息(会出现下面4个进程)

27.执行命令:service iptables stop ,关闭防火墙。

28.执行命令:cd /home/hadoop/hadoop-2.5.1/bin 切换到指定目录。

29.

执行命令:./hdfs dfs -mkdir -p /usr/file

./hdfs dfs -put /root/jdk-7u67-linux-x64.rpm /usr/file

测试上传文件是否成功。

30.打开浏览器,访问:http://192.168.8.34:50070 测试是否配置成功。注意换成自己的IP地址。

至此 Hadoop 搭建完成。

Hbase搭建:

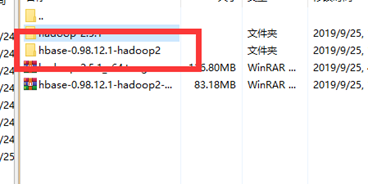

1.使用Secure File Transfer Client(或者Xftp) 上传下载好的hbase压缩包。

2.执行命令 tar zxvf hbase-0.98.12.1-hadoop2-bin.tar.gz 解压hbase.

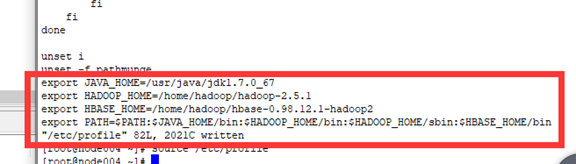

3.执行命令:vi /etc/profile 配置profile文件:

export JAVA_HOME=/usr/java/jdk1.7.0_67

export HADOOP_HOME=/home/hadoop/hadoop-2.5.1

export HBASE_HOME=/home/hbase/ hbase-0.98.12.1-hadoop2

export PATH=$PATH:$JAVA_HOME/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$HBASE_HOME/bin

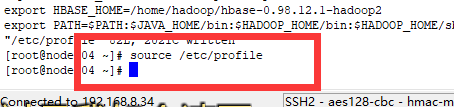

4.执行命令:source /etc/profile 重新加载 profile。

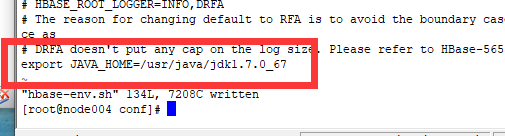

5.执行命令:cd /home/hadoop/ hbase-0.98.12.1-hadoop2 /conf 切换目录,vi hbase-env.sh配置hbase-env.sh文件:

export JAVA_HOME=/usr/java/jdk1.7.0_67

6.执行命令: vi hbase-site.xml 配置hbase-site.xml文件:

<configuration>

<property>

<name>hbase.rootdir</name>

<value>hdfs://192.168.8.34:8020/hbase</value>

</property>

<property>

<name>hbase.zookeeper.property.dataDir</name>

<value>/home/data/zookeeper</value>

</property>

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

</configuration>

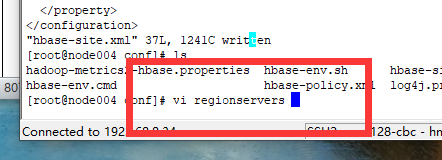

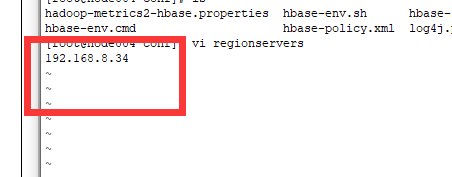

7.执行命令:vi regionservers 配置regionservers文件。

8.修改里面内容为:192.168.8.34(虚拟机ip地址)

9.执行命令:start-hbase.sh 启动hbase

10.执行命令: jps 查看启动信息

11.在浏览器地址栏访问http://192.168.8.34:60010 (ip改为自己的)。

至此,Hadoop+Hbase搭建完成。

由于本文是之前写的,后来加以修改。图片中有的文件版本可能找不到了,用资源中得文件也可以搭建。

最后,本文搭建环境仅用于学习使用,和企业使用场景有很大出入。

.

892

892

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?