一,负载均衡群集的原理

1,企业群集应用概述

群集的含义

- cluster, 集群,群集

- 由多台主机构成,但对外只表现为一个整体

问题

- 互联网应用中,随着站点对硬件性能,响应速度,服务稳定性,数据可靠性等要求越来越高,单台服务器力不从心

解决方法

- 使用价格昂贵的小型机,大型机

- 使用普通服务器构建服务群集

2,企业群集分类

(1)根据群集所针对的目标差异,可分为三种

- 负载均衡群集

- 高可用群集

- 高性能运算群集

2.1负载均衡群集

- 提高应用系统的响应能力,尽可能处理更多的访问请求,减少延迟为目标,获得高并发,高负载(LB)的整体性能

- LB的负载分配依赖于主节点的分流算法

2.2高可用群集

- 提高应用系统的可靠性,尽可能地减少中断时间为目标,确保服务的连续性,达到高可用(HA)的容错效果

- HA的工作方式包括双工和主从两种模式

2.3高性能运算群集

- 提高应用系统的cpu运算速度,扩展硬件资源和分析能力为目标,获得相当于大型,超级计算机的高性能原酸(HPC)能力

- 高性能依赖于”分布式运算“。”并行计算“,通过专用硬件和软件将多个服务器的cpu,内存等资源整合再一起,实现只有大型,超级计算机草具备的计算能力

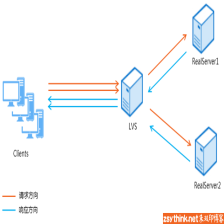

(2)负载均衡群集架构

负载均衡的结构

- 第一层,负载调度器 (LB或ld)

- 第二层,服务器池 (SP)

- 第三层,共享存储 (SS))

(3)负载均衡群集工作模式分析

- 负载均衡是目前企业用的最多的群集类型

- 群集的负载调度技术有三种工作模式

- 地址转换

- ip隧道

- 直接路由

二,lvs-nat的部署

1,NAT模式

地址转换

- network address translation。简称nat模式

- 类似于防火墙的私有网络结构,负载调度器作为所有服务器节点的网关,即作为客户机的访问入口,也是各节点回应客户机的访问出口

- 服务器节点使用私有ip地址,与负载调度器位于同一个物理网络,安全性要优于其他两种方式

2,TUN模式

IP隧道

- IP TUNNEL, 简称TUN模式

- 采用开放式的网络结构,与TUN模式的结构类似,但各节点并不是分散在各地,而是与调度器位于同一个物理网络

- 负载调度器与各节点服务器通过本地网络连接,不需要建立专用的ip隧道

,3,DR模式

直接路由

- direct routing 简称dr模式

- 采用半开放式的网络结构,与TUN模式的结构类似,但各节点并不是分散在各个地,而是与调度器位于同一个物理网络

- 负载调度器与各节点服务器通过本地网络连接,不需要建立专用的ip隧道

三,关于lvs虚拟服务器

1, LINUX VIrtual Server

- 针对linux内核的负载均衡解决方案

- 19981年5月,由我国的章文嵩博士创建

- 官方网站:http://www.linuxvirtualserver.org/

[root@server1 ~]# modprobe ip_vs //确认内核对lvs的支持

[root@server1 ~]# cat /proc/net/ip_vs

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

[root@server1 ~]#

2,lvs的负载调度算法

-

最少连接

- 根据真实服务器已建立的连接数进行分配,将收到的访问请求优先分配给连接数最少的节点

-

加权最少连接

- 在服务器节点的性能差异较大时,可以为真实服务器自动调整权重

- 性能较高的节点将承担更大比例的活动连接负载

-

轮询

- 将收到的访问请求按照顺序轮流分配给群集中的个节点(真实服务器),均等地对待每一台服务器,而不管服务器实际连接数和系统负载

-

加权轮询

- 根据调度器设置的权重值来分发请求,权重值高的节点优先获得任务,分配的请求数越多

- 保证性能强的服务器承担更多的访问流量

四,使用ipvsadm工具

1,lvs群集创建与管理步骤

- 1,创建虚拟服务器

- 2,添加,删除服务器节点

- 3,查看群集及节点情况

- 4,保存负载分配策略

五,nfs共享存储服务(服务器运行过程中网页文件的来源)

1,Network File System 网络文件系统

- 依赖于RPC(远端过程调用)

- 需要安装nfs-utils,rpcbind软件包

- 系统服务:nfs,rpcbind

- 共享配置文件:/etc/exports

2,使用nfs发布共享资源过程

- 1,安装nfs-utils,rpcbind软件包

- 2,设置共享目录

- 3,启动nfs服务程序

- 4,查看本机发布的nfs共享目录

3,在客户机中访问nfs共享资源

- 1安装rpcbind软件包,并启用rpcbind服务

- 2,手动挂载nfs共享目录

- fstab自动挂载设置

六,案例

1,环境

- LVS调度器作为web服务器池的网关,LVS两块网卡,分别连接内外网,使用轮询(rr)调度算法

2,部署过程

- 1,加载ip_vs模块,安装ipvsadm工具

- 2,开启路由准发

- 3,新建lvs虚拟服务器并添加节点服务器

- 4,配置节点服务器

- 建立测试网站

- 挂载nfs共享存储

- 建立测试网页

- 5,保存规则并测试

设备:

- 调度服务器一台:

- ip地址:

- 192.168.100.14(内网) 仅主机模式

- 192.168.1.84(外网) 桥接模式

- ip地址:

- web服务器两台:

- ip地址:192.168.100.12(A)仅主机模式

- ip地址:192.168.100.13 (B) 仅主机模式

- NFS共享服务器

- ip地址:192.168.100.10 仅主机模式

- 客户端一台:

- 地址192.168.100.10 内网 仅主机模式

- 192.168.1.27 外网 桥接模式

步骤:

调度服务器:

1,添加两块网卡,一张内网,一张外网,内网vmnet1仅主机模式,外网桥接模式

2,开启路由模式

[root@server1 ~]# vi /etc/sysctl.conf

[root@server1 ~]# sysctl -p

net.ipv4.ip_forward = 1

[root@server1 ~]#

[root@server1 ~]# route -n

Kernel IP routing table

Destination Gateway Genmask Flags Metric Ref Use Iface

0.0.0.0 192.168.1.1 0.0.0.0 UG 0 0 0 ens37

0.0.0.0 192.168.100.1 0.0.0.0 UG 100 0 0 ens33

169.254.0.0 0.0.0.0 255.255.0.0 U 1003 0 0 ens37

192.168.1.0 0.0.0.0 255.255.255.0 U 0 0 0 ens37

192.168.100.0 0.0.0.0 255.255.255.0 U 100 0 0 ens33

192.168.122.0 0.0.0.0 255.255.255.0 U 0 0 0 virbr0

[root@server1 ~]# hostnamectl set-hostname lvs

[root@server1 ~]# bash

[root@lvs ~]# modprobe ip_vs

[root@lvs ~]# cat /proc/net/ip_vs

[root@lvs ~]# rpm -ivh /mnt/Packages/ipvsadm-1.27-7.el7.x86_64.rpm

[root@lvs ~]# vi nat.sh

#!/bin/bash

echo "1" > /proc/sys/net/ipv4/ip_forward

ipvsadm -C

ipvsadm -A -t 192.168.1.84:80 -s rr

ipvsadm -a -t 192.168.1.84:80 -r 192.168.100.12:80 -m

ipvsadm -a -t 192.168.1.84:80 -r 192.168.100.13:80 -m

ipvsadm -Ln

~

[root@lvs ~]# sh nat.sh

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

TCP 192.168.1.84:80 rr

-> 192.168.100.12:80 Masq 1 0 0

-> 192.168.100.13:80 Masq 1 0 0

选项注释:

“-A”表示添加虚拟服务器

“-a”表示添加真实服务器

“-t”用来指定VIP地址及TCP端口

“-r”用来指定RIP地址及TCP端口

“-s”用来指定负载均衡调度算法--rr(轮询)、wrr(加权轮询)、lc(最少连接)、wlc(加权最少连接)

“-m”表示使用NAT群集模式(“-g”是DR模式,“-i”是TUN模式)

配置web服务器两台:

web1:自定义vmnet1(仅主机模式)

[root@web1 ~]# yum -y install httpd

[root@web1 ~]# vi /etc/httpd/conf/httpd.conf

ServerName localhost // 将#号去掉,修改主机名

[root@web1 ~]# cd /var/www/html/

[root@web1 html]# echo "<h1>server1</h1>" > index.html

[root@web1 html]# systemctl restart httpd

# vi /etc/sysconfig/network-scripts/ifcfg-ens33 //配置服务器网关,指向lvs地址

重启网络验证

[root@web1 ~]# curl http://192.168.100.13

<h1>server2</h1>

web2配置同理

两个web网页时在本地,可以通过nfs进行挂载作为两个服务器的主页

nfs存储器配置

[root@nfs-server ~]# yum -y install nfs-utils rpcbind

[root@nfs-server ~]# systemctl restart nfs-utils

[root@nfs-server ~]# systemctl restart rpcbind

[root@nfs-server ~]# mkdir /opt/web1 /opt/web2

[root@nfs-server ~]# echo "server1" > /opt/web1/index.html

[root@nfs-server ~]# echo "server2" > /opt/web2/index.html

[root@nfs-server ~]# vi /etc/exports

/opt/web1 192.168.100.12(ro)

/opt/web2 192.168.100.13(ro)

[root@nfs-server ~]# systemctl restart nfs

[root@nfs-server ~]# systemctl restart rpcbind

[root@nfs-server ~]# systemctl enable rpcbind

[root@nfs-server ~]# systemctl enable nfs

web1web2上面挂载

web1:

[root@web1 ~]# showmount -e 192.168.100.11

Export list for 192.168.100.11:

/opt/web2 192.168.100.13

/opt/web1 192.168.100.12

[root@web1 ~]# mount 192.168.100.11:/opt/web1 /var/www/html

vi /etc/fstab #开机自动挂载

192.168.100.15:/opt/web1 /var/www/html nfs defaults,_netdev 0 0

web2:

[root@web2 ~]# showmount -e 192.168.100.11

Export list for 192.168.100.11:

/opt/web2 192.168.100.13

/opt/web1 192.168.100.12

[root@web2 ~]# mount 192.168.100.11:/opt/web2 /var/www/html

验证:

此时在客户机上进行验证,利用Lvs群集地址就可以实现轮询,并且web1与web2访问成功。

1051

1051

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?