每当学习一种编程语言,总是从HelloWord开始,TensorFlow的HelloWord就是经典的MNIST项目。

###项目准备

- 下载训练数据和测试数据

THE MNIST DATABASE of handwritten digits 这个官网上面给出了训练数据和测试数据集,请分别把下面的四个文件下载到本地。

train-images-idx3-ubyte.gz: training set images (9912422 bytes)

train-labels-idx1-ubyte.gz: training set labels (28881 bytes)

t10k-images-idx3-ubyte.gz: test set images (1648877 bytes)

t10k-labels-idx1-ubyte.gz: test set labels (4542 bytes)

- 下载GitHub源代码

tensorflow/mnist 下载源代码,并直接用Pycharm打开该项目

###调试项目

项目本身包含自动下载训练数据和测试数据,但是可能因为网络原因有可能导致无法加载,所以为了方便起见,我们直接使用上面已经下载好的本地数据即可。

- 配置训练数据和测试数据

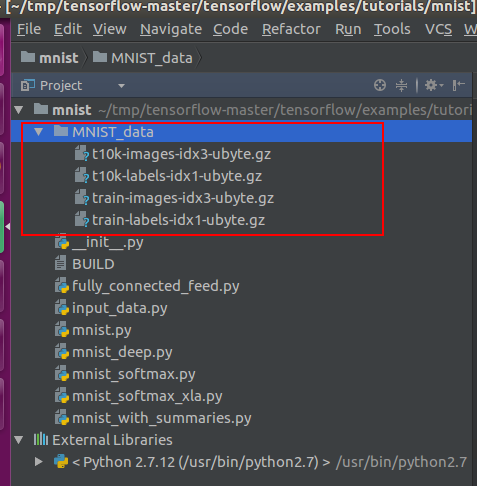

将上面下载的文件放入下图所示的目录中

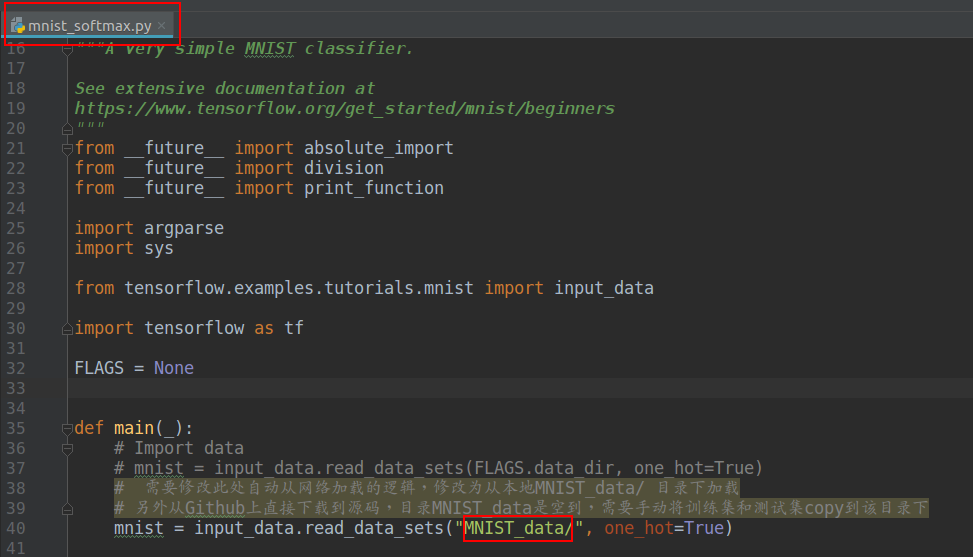

修改如下所示python文件

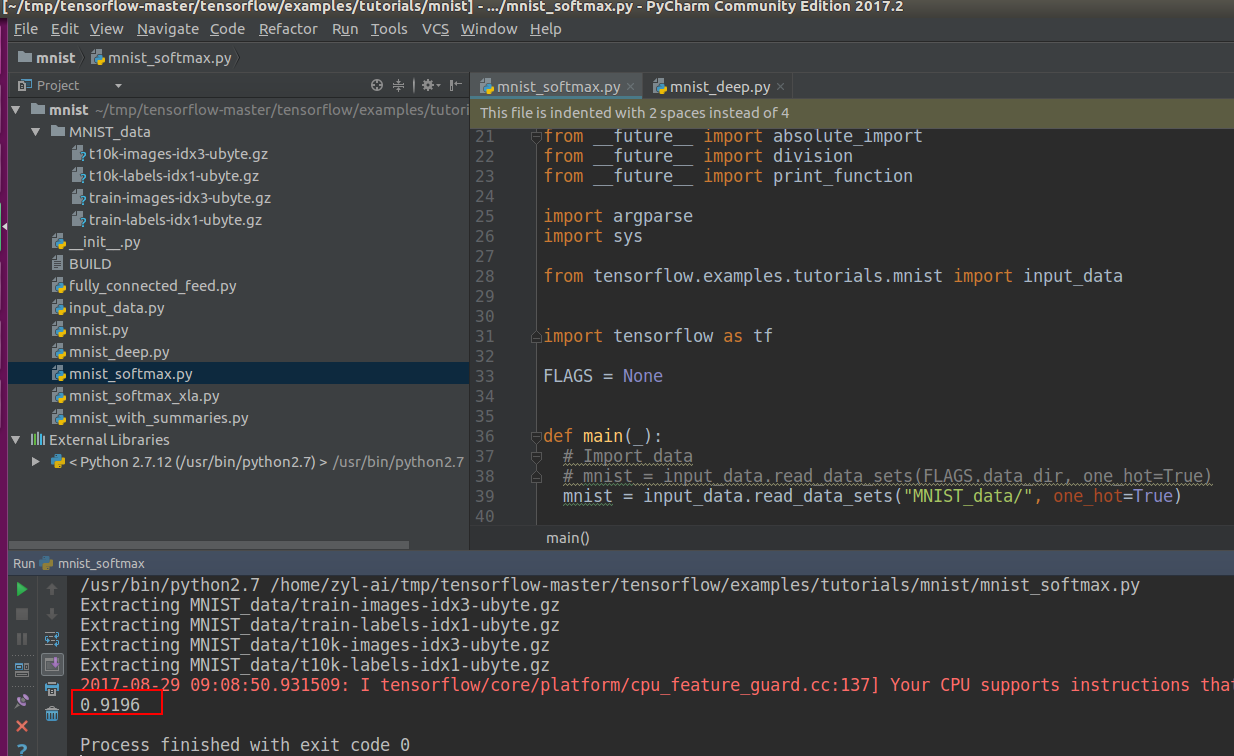

- 选择softmax回归,运行即可

###运行结果

###deep-learning的训练对比

我们可以选择深度学习,来对比一下训练出来的可信度。

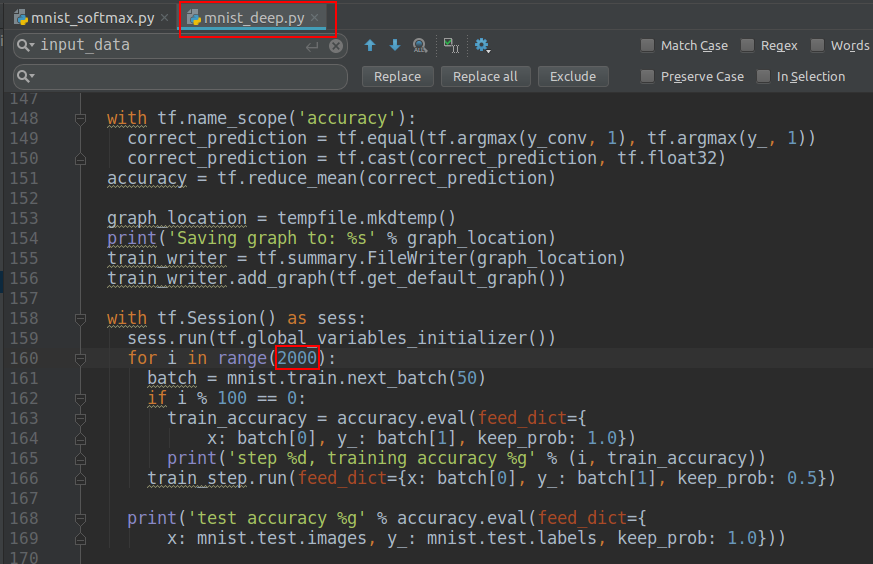

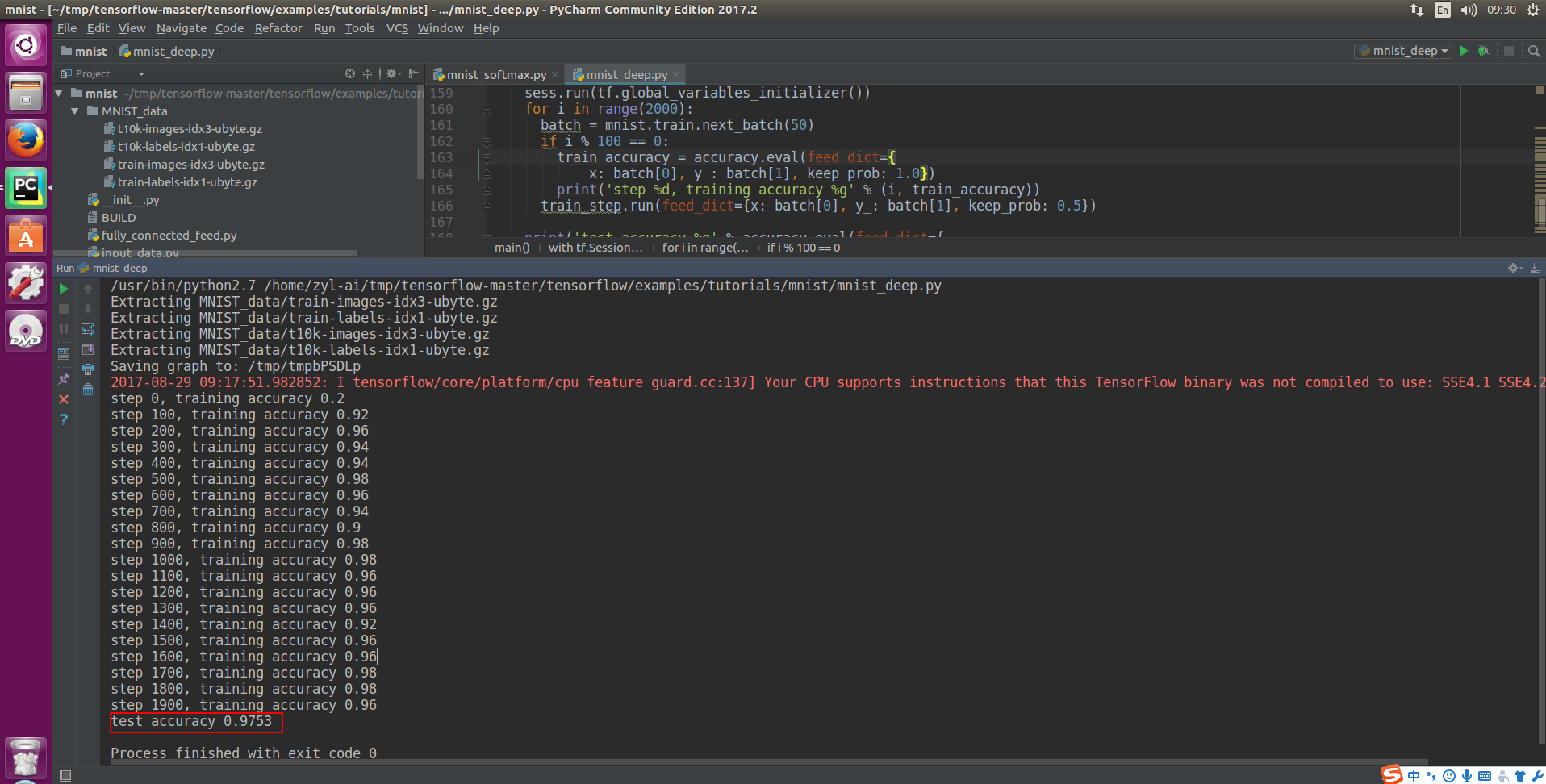

修改mnist-deep.py文件,将载入数据部分修改为上图的本地加载。为了节省时间,我们将迭代训练次数由原先的2w次降低为2k次(实际工作中切不可这么粗鲁),学习率还是100,然后运行mnist-deep.py。

一段时间以后,观察一下运行结果。

对比softmax回归的0.91,现在的0.97效果要好很多。

###附softmax源码

"""A very simple MNIST classifier.

See extensive documentation at

https://www.tensorflow.org/get_started/mnist/beginners

"""

from __future__ import absolute_import

from __future__ import division

from __future__ import print_function

import argparse

import sys

from tensorflow.examples.tutorials.mnist import input_data

import tensorflow as tf

FLAGS = None

def main(_):

# Import data

# mnist = input_data.read_data_sets(FLAGS.data_dir, one_hot=True)

mnist = input_data.read_data_sets("MNIST_data/", one_hot=True)

# Create the model

x = tf.placeholder(tf.float32, [None, 784])

W = tf.Variable(tf.zeros([784, 10]))

b = tf.Variable(tf.zeros([10]))

y = tf.matmul(x, W) + b

# Define loss and optimizer

y_ = tf.placeholder(tf.float32, [None, 10])

# The raw formulation of cross-entropy,

#

# tf.reduce_mean(-tf.reduce_sum(y_ * tf.log(tf.nn.softmax(y)),

# reduction_indices=[1]))

#

# can be numerically unstable.

#

# So here we use tf.nn.softmax_cross_entropy_with_logits on the raw

# outputs of 'y', and then average across the batch.

cross_entropy = tf.reduce_mean(

tf.nn.softmax_cross_entropy_with_logits(labels=y_, logits=y))

train_step = tf.train.GradientDescentOptimizer(0.5).minimize(cross_entropy)

sess = tf.InteractiveSession()

tf.global_variables_initializer().run()

# Train

for _ in range(1000):

batch_xs, batch_ys = mnist.train.next_batch(100)

sess.run(train_step, feed_dict={x: batch_xs, y_: batch_ys})

# Test trained model

correct_prediction = tf.equal(tf.argmax(y, 1), tf.argmax(y_, 1))

accuracy = tf.reduce_mean(tf.cast(correct_prediction, tf.float32))

print(sess.run(accuracy, feed_dict={x: mnist.test.images,

y_: mnist.test.labels}))

if __name__ == '__main__':

parser = argparse.ArgumentParser()

parser.add_argument('--data_dir', type=str, default='/tmp/tensorflow/mnist/input_data',

help='Directory for storing input data')

FLAGS, unparsed = parser.parse_known_args()

tf.app.run(main=main, argv=[sys.argv[0]] + unparsed)

407

407

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?