一、一元线性回归

最小二乘法

基于均方差最小化来进行模型求解

极大似然估计

使得观测样本出现概率最大的分布就是带球待求分布,也即使得联合概率(似然函数)渠道最大值的

即为

的估计值。

可证明目标函数为凸函数,整个问题为凸优化问题,根据一元函数的模型,结合最小二乘法或者极大似然估计的方法得出评价标准最为策略,使用牛顿法,梯度下降法等作为策略得到最终的结果。

根据结果发现,极大似然估计和最小二乘法殊途同归。

二、多元线性回归

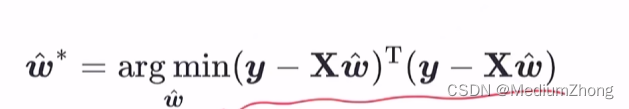

使用最小二乘法得到损失函数:

并且可以证明其为凸函数(假定为正定矩阵),从而使用凸函数求解思路求解问题。

得到结果:

三、对数几率回归

原理:在线性模型的基础上到一个映射函数来实现分类功能。

极大似然估计

通过sigmod函数来确定概率密度函数。

从而计算出总体概率,通过最大化此函数,也就是最小化其相反数,得到最终结果。

信息论

![]()

![]()

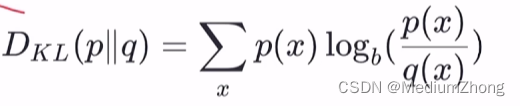

KL散度:度量两个分布的差异。

通过最小化每个样本理想分布与估计分布之间的KL散度得到最终结果。

通过最终结果发现,上述两种方法殊途同归。

四、二分类线性判别分析

算法原理:希望全体训练样本经过投影后,异类样本的中心尽可能远,同类样本的方差尽可能小。

通过算法原理得到损失函数后,将其和约束转化为拉格朗日形式,使其约束项为0,一阶偏导数为0,从而得出最终结果。同时可分析出得到的极值点就是最小值点。

257

257

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?