-

查找hadoop的依赖jar包

在{hadoop_home/share}目录下查找<.jar>文件,复制后拷贝至{hadoop_home}/_jar/

在{hadoop_home}/_jar/目录下查找文件,剪切后拷贝至{hadoop_home}/_sources/{hadoop_home}/_jar/目录:hadoop java开发程序所依赖的jar包

{hadoop_home}/_sources/目录:hadoop java开发程序所依赖的源码包

-

集成eclipse环境

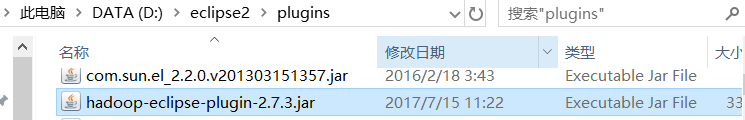

1)将hadoop-eclipse-plugin-2.7.3.jar复制到{eclipse_home}/plugins下;

2)配置windows Hadoop工具包

这两个文件是编译底层源代码,例如linux是左斜杠,windows里是右斜线,如果把这两个拷贝过去就解决了上面的问题

拷贝hadoop.dll和winutils.exe至{hadoop_home}\bin;

3) 新建工作空间hadoop -

重启eclise

Eclipse中配置JDK, 一般情况我们不使用eclipse自带的jdk,需要用我们自己的jdk

1)windows–>prefeneces–>Java–>Installed JREs–>Add(找到自己安装JDK路径)

–>选中JDK,将jre勾选去掉

2)Java --> Compiler 选中1.8

3)windows–>show View --> Java -->(javadoc,jUnit)

4)在linux下开启集群服务 start-all.sh

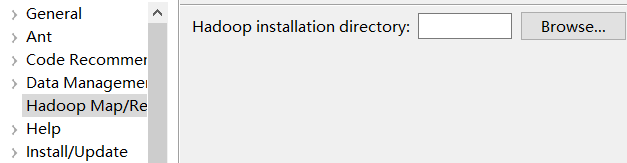

5) eclipse校验安装是否成功:查看windows–>perferences–>hadoop Mapreduce

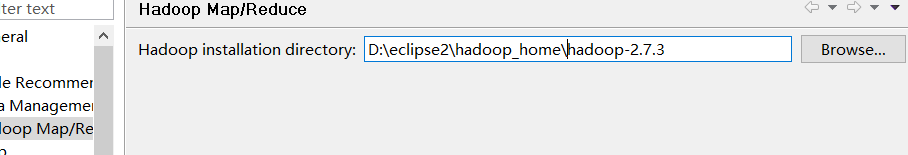

6)在【hadoop Mapreduce】视图下,添加hadoop的安装路径:D:\eclipse2\hadoop_home\hadoop-2.7.3(解压后并且把jar导入后的hadoop2.7.3)

-

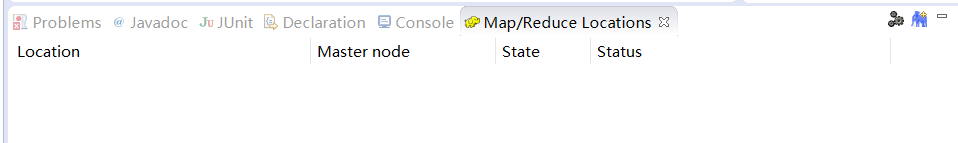

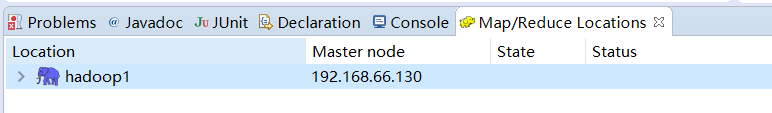

创建hadoop的链接:

a>.打开【MapReduce Locations】 视图-->右键【new hadoop Location...】-->弹出编辑窗口 b>.Location name: 随意起名 DFS Master RPC协议端口号为:9000 【注:默认为8020】 Map/Reduce(V2)Master RPC协议端口号为:9001 【注:默认为8021】 user name:crx 【注:集群用户名字】 host :master 【注:master在windows上映射对应的ip为192.168.66.130】 C:\Windows\System32\drivers\etc\hosts(注意:文件不让保存)

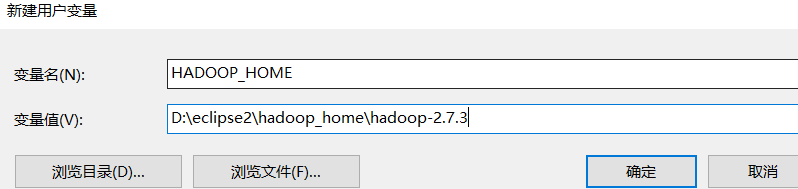

- 配置环境变量

HADOOP_HOME=D:\eclipse2\hadoop_home\hadoop-2.7.3;

PATH = %HADOOP_HOME%\bin;

-

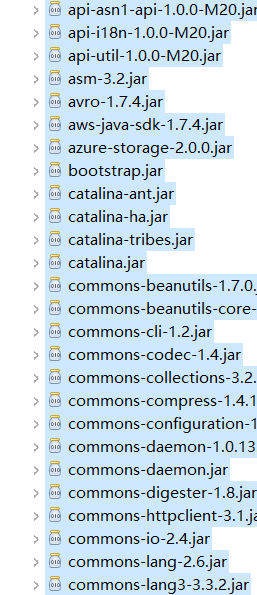

创建工程,编写API

1)创建javaProject

2)导入jar包 143个

-

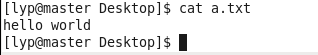

测试成功

818

818

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?