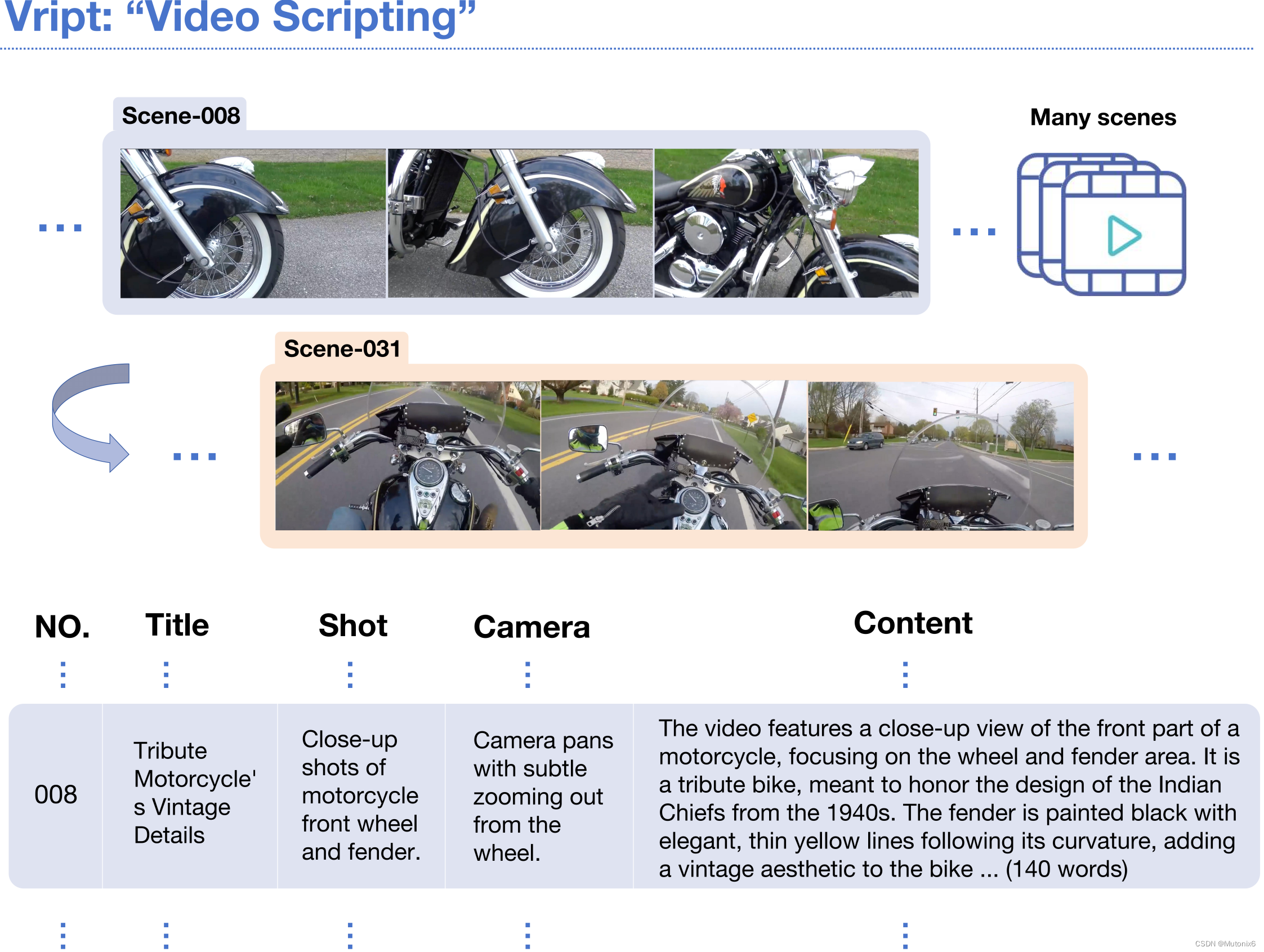

🎬 Vript: Refine Video Captioning into Video Scripting

将传统视频标注细化为视频脚本标注

Github地址:https://github.com/mutonix/Vript

Vript是一个带有12K个注释的高分辨率视频(超过400k片段)的细粒度YouTube视频文本数据集。该数据集的注释受到视频脚本的启发。如果我们想做一个视频,我们必须首先写一个脚本来组织如何拍摄视频中的场景。为了拍摄一个场景,我们需要决定内容,拍摄类型(中景,特写等),以及相机如何移动(平移,倾斜等)。因此,受到视频脚本格式的启发,我们以视频脚本的方式对视频进行注释。与之前的视频文本数据集不同,我们在不丢弃任何场景的情况下对整个视频来进行密集注释,每个场景都有一个约145个单词的标注。除了视觉模态,我们还将画外音转录成文字,并与视频标题放在一起,为视频注释提供更多的背景信息。

以下是Vript数据集的一些要点:

-

细粒度:Vript数据集为每个场景注释了大约145个单词的详细标题,其中包含镜头类型,摄像机移动,内容和场景标题。

-

密集注释:Vript数据集密集地注释了整个视频中所有场景的详细说明。每个视频有40个场景,平均时长6m(最长3小时,最短5分钟)。视频总时长约1.3Kh。

-

高质量:Vript数据集由GPT-4V/Claude 3 Sonnet注释。我们发现GPT-4V在为视频生成详细字幕方面表现最好,Claude 3 Sonnet对视频内容的约束更宽松,因此它可以为一些GPT-4V无法描述的场景添加字幕。

-

高分辨率&不同宽高比&开放域:Vript数据集包含来自YouTube的长视频和来自YouTube Shorts和TikTok的短视频。原始视频的分辨率从720p到2K不等。

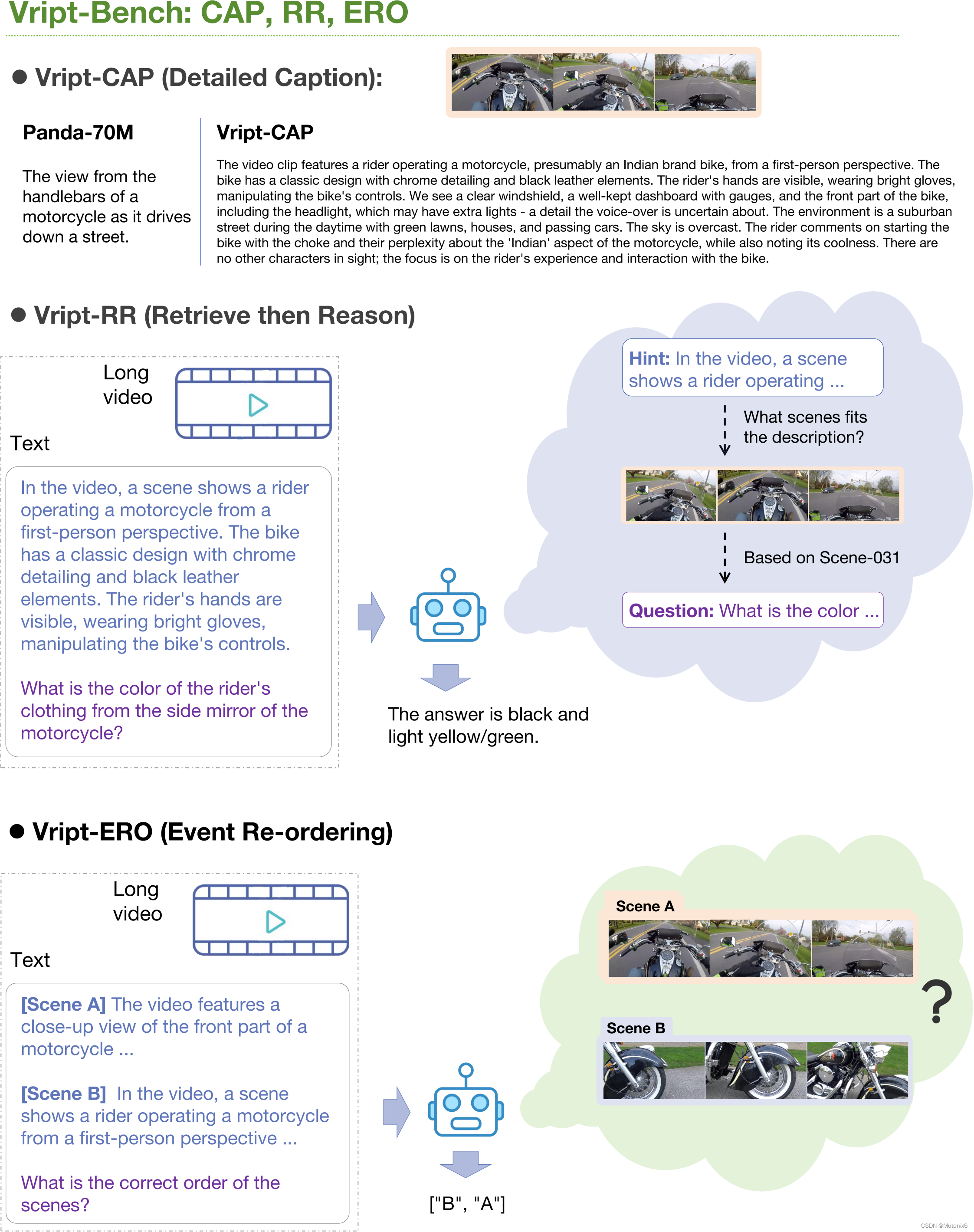

此外,我们提出了Vript-Bench,这个新的benchmark包括三个具有挑战性的视频理解任务:

- Vript-CAP (Caption): 一个测试模型描述视频能力的benchmark。相比之前的benchmark,如MSR-VTT 以及Panda-70M ,它们的标注都比较短,一般只有一到两句话,对于目前的视频多模态模型来说,已经过于简单。Vript-CAP数据集测试模型输出详细描述的能力。

- Vript-RR(Retrieve then Reason): 一个新的视频推理benchmark。相比直接短视频片段的QA,Vript-RR基于长视频,首先给出视频中的场景的详细描述作为提示,然后就场景中的细节提出问题。

- Vript-ERO(Event Re-ordering): 一个新的视频时序推理benchmark。Vript-ERO通过提供位于同一视频的两个/四个不同视频时间点的场景描述,并要求模型给出正确的场景时间顺序。

Vript是一个高分辨率视频数据集,提供12K个详细的视频脚本注释,用于评估模型的视频理解和描述能力。它包含长视频和短视频,涉及Vript-CAP,Vript-RR和Vript-ERO三个挑战性任务。

Vript是一个高分辨率视频数据集,提供12K个详细的视频脚本注释,用于评估模型的视频理解和描述能力。它包含长视频和短视频,涉及Vript-CAP,Vript-RR和Vript-ERO三个挑战性任务。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?