摘 要: 计算机图形学是一门重要的计算机科学分支,它研究如何在计算机硬件和软件的协同作用下创建图形和图像。本文介绍了其最近在渲染方面的发展与其与机器学习的结合。近年来,计算机图形学在虚拟现实、实时渲染、神经渲染以及计算机辅助设计等领域取得了显著的进展。图形硬件(GPU)的性能提升为实时渲染提供了强大支持,而基于生成对抗网络(GAN)的图像生成也为图形学领域带来新的机遇。文章接着介绍了图形渲染的不同方式,主要分为实时渲染和离线渲染。实时渲染应用广泛,如三维游戏、虚拟现实、交互设计等,要求高渲染速度和帧速率。而离线渲染则用于全局光照算法,以实现更高的真实感,尤其在电影和动画制作中得到广泛应用。随后,文章深入探讨了两种主要的渲染方式:光线追踪、光栅化。光线追踪通过追踪光线的路径来生成图像,具有高度真实感,但对计算资源要求较高。光栅化是一种快速的渲染方式,但通常无法实现高度真实感,因为它基于点、线和三角形作为基本处理单元,容易出现锯齿状边缘。然而,近年来,一些技术如超采样和随机采样已经改善了光栅化的质量。然后,文章介绍了计算机图形学与机器学习的结合,分别是神经渲染与生成式对抗网络的进展。最后,对计算机图形学的应用以及未来的发展进行探讨

关键词:计算机图形学,光栅化,光线追踪,机器学习

- 引 言

计算机图形学(computer graphics)是研究计算机在硬件和软件的帮助下创建计算机图形的科学学科,是计算机科学的一个分支领域,主要关注数位合成与操作视觉的图形内容。虽然这个词通常被认为是指三维图形,事实上同时包括了二维图形以及影像处理。

简单地说,计算机图形学的主要研究内容就是研究如何在计算机中表示图形、以及利用计算机进行图形的计算、处理和显示的相关原理与算法。图形通常由点、线、面、体等几何元素和灰度、色彩、线型、线宽等非几何属性组成。从处理技术上来看,图形主要分为两类,一类是基于线条信息表示的,如工程图、等高线地图、曲面的线框图等,另一类是明暗图,也就是通常所说的真实感图形。

计算机图形学一个主要的目的就是要利用计算机产生令人赏心悦目的真实感图形。为此,必须建立图形所描述的场景的几何表示,再用某种光照模型,计算在假想的光源、纹理、材质属性下的光照明效果。所以计算机图形学与另一门学科计算机辅助几何设计有着密切的关系。事实上,图形学也把可以表示几何场景的曲线曲面造型技术和实体造型技术作为其主要的研究内容。同时,真实感图形计算的结果是以数字图象的方式提供的,计算机图形学也就和图像处理有着密切的关系。

图形与图像两个概念间的区别越来越模糊,但还是有区别的:图像纯指计算机内以位图形式存在的灰度信息,而图形含有几何属性,或者说更强调场景的几何表示,是由场景的几何模型和景物的物理属性共同组成的。

计算机图形学的研究内容非常广泛,如图形硬件、图形标准、图形交互技术、光栅图形生成算法、曲线曲面造型、实体造型、真实感图形计算与显示算法、非真实感绘制,以及计算可视化、计算机动画、自然景物仿真、虚拟现实等。

近年来,计算机图形学伴随着图形硬件(GPU)性能的进步,在虚拟现实,实时渲染,神经渲染,计算机辅助设计等领域获得了长足的发展。同时最近爆火的AI绘图:基于生成对抗网络 (GAN)的图像生成,可能也会对图形学的发展起到帮助。

- 图形渲染

- 渲染方式介绍

由于渲染绘制技术耗费的时间长短不同,通常被分成实时与离线两种渲染技术[1]。实时渲染技术常常被广泛应用于三维游戏、视景仿真、虚拟现实和交互设计等应用中[2],这些应用对渲染速度和帧速率的要求很高。而离线渲染通常被应用于全局光照算法,目的是达到更好的实时性和真实感,这在动画和电影工业中得到了很好应用[3]。

目前图形渲染主流的实现技术有如下三种,包括光栅化、光线投射、光线追踪。这三种方式本质都需要大量的算力去模拟现实中光线反射和折射的仿真效果,从而渲染出图片上的每一个像素。这里我们主要讨论近年来消费者感知较为明显的实时渲染方式。

-

- 光线追踪

光线追踪是通过追踪来自摄影机的光线穿过像素的虚拟平面并仿真其与物体相遇的效果来生成影像的。

由于硬件设备和用户需求不同,光线跟踪算法在真实感和实时性上的平衡是现代社会应用研究的重点。然而,如何使具有较高真实感绘制的算法,具有更好实时性,这一直是研究学者们长期以来研究的热点,也是图形学中渲染研究的重要目标之一。

近年来,全局光照算法在计算机图形学领域得到了大范围研究。其中最为经典、研究最为广泛的算法就是光线跟踪算法[4],它是基于1968年Apple提出的光线投射算法建立的[5]。光线投射算法最早被应用在三维场景中,用于消除场景的隐藏曲面。传统的局部光照模型中最经典的是由Lambert提出的漫反射模型以及Phong提出的具有镜面反射效果的光照模型[6],Murat Kurt[7]由于传统的局部光照模型具有计算量较小的特点,在此基础上对算法的实时性进行研究。算法在计算上未考虑到模型表面的部分直接光照以及间接光照,无法真实模拟场景中的阴影以及光照效果。为了实现更好的光照效果,2012年,Burley[8]提出了一种可以广泛应用在不同材质表面的全局光照算法。但是该算法的求解成本较高,并且对于存储空间的需求量也很大。类似的问题并不会出现在经典的光线跟踪算法中。经典光线跟踪算法的优势在于其具有更低的时间和空间复杂度。光线跟踪算法的光学原理较为简单,并能真实的模拟绘制现实世界中各类场景的光照效果,所以在诸多工业产业中被广泛应用。然而,在模拟的过程中,如果光照光线过多,判断光线是否和场景中的物体相交,其涉及的求交计算量可能也会很大,没有办法实现实时渲染绘制,故而对于光线跟踪算法,为了使其更好的满足各种应用要求,主要利用加速结构算法以及GPU的并行结构在光线相交遍历上对光线跟踪进行速度提高[9],这也是近年来的研究热点之一。

以KD树为代表的基于空间分割的加速结构和以层次包围盒为代表的基于层次分割的加速结构[10]是光线跟踪中最为常见的两种加速结构。1987年,加速结构被Goldsmith[11]首次应用在光线跟踪算法中,用于降低判断光线是否与物体相交的计算量,提升算法速度和效率。Emslt[12]、Dammertz[13]分别在三角形预处理算法以及表面积启发式分割算法的基础上,提出优化的层次包围盒构建算法,算法使应用加速结构优化的光线跟踪算法性能得以提升。

2008年,Bruce Walter[14]将凝聚聚类算法首次应用于层次包围盒构建算法中,由于结合凝聚聚类加速结构算法构建方式的特性,其在GPU上得到优化研究。伴随通用GPU的迅猛发展,国内外基于GPU通用计算加速的光线跟踪研究持续涌现。这证明了GPU相较于CPU在光线跟踪领域的显著优势,也为实现实时光线跟踪提供了可能。基于层次包围盒加速结构的GPU并行处理算法和应用于GPU的光栅化的加速结构分别被Thra[15]、Christensenp[16]提出。

2010年,Lauterbach[17]提出了一种基于GPU的快速层次包围盒构造方法,即线性层次包围盒构建LBVH算法,该方法基于莫顿码将层次包围盒转化为线性问题,并且可以在GPU上并行实现。2013年,Yan Gu[18]等人在WalterPH的基础上提出了近似凝聚聚类AAC算法,其算法首先要对三维空间进行空间划分,在划分后的每一个空间内,单独进行自底向上的凝聚聚类算法,最后将划分的空间合并起来得到最终结果。这样可以减少一定的计算量,近似得到各个部分局部代价最低的子树,从而提高构建速度。

为了进一步提高层次包围盒的质量,Karras[19]等人提出了子树重构优化TrBVH算法,该算法利用LBVH算法构造基本的层次包围盒,然后对层次包围盒进行自下而上的多轮优化。然而,利用动态规划算法求最优子树的精确解,是一项较为耗时的工作。因此,Dwningues[20]等人在2015年提出了一种基于凝聚聚类优化子树,进行子树重建的层次包围盒算法ATRBVH,取代了子树优化阶段的动态规划算法。2019年王伟健[21]提出了基于局部密度聚类算法进行层次包围盒构建,该算法从横向与纵向两个维度出发,横向上通过计算局部密度,确定聚类中心,利用聚类迭代构造出层次包围盒中的每一层节点,纵向上利用凝聚聚类算法对子树进行并行构建。

国内外持续涌现的基于GPU通用计算加速的光线跟踪研宄,伴随GPU的发展(尤其是NVIDIA统一计算设备体系结构CUDA的出现)而发展。2016年,张泉[21]实现了动态场景的实时光线跟踪。美中不足的是,画面虽达到交互级别的帧速率,却丢失了大量细节。近年来的研究成果已经证明了实时光照模拟的可能性,但在图像性能和质量之间的平衡方面仍然存在一些不足,与实时全局光照的实现仍有一定距离。例如虽然近期很多的电脑游戏采用了光线追踪,但相比于传统的渲染方式,光线追踪的渲染模式会导致帧率大幅度降低,为此,NVIDIA采用了DLSS技术来降低部分画面的分辨率,通过训练模型来推断出游戏画面中的细节,并根据这些细节生成更高分辨率的图像来让玩家对画面质量的降低感知不明显,降低了一部分真实感但提高了帧率,提升了实时渲染的性能。

全景光线追踪对比图

同时,伴随着移动设备的CPU性能逐渐达到瓶颈,移动设备的Soc也开始提升GPU性能与提高硬件加速光线追踪的能力。例如最近苹果发布的A17Pro芯片光线追踪能力4倍于A16芯片,使得手机游戏也可以借助光线追踪提升实时渲染出的画面的真实感,同时相比于软件的光线追踪,硬件的支持能提升更多的性能,减少占用。伴随着虚拟现实设备的逐渐普及,光线追踪可能未来会在混合现实的场景内出现更多的应用,使得虚拟的图形能更好地融入进真实环境中。

-

- 光栅化

栅格化(rasterisation),又称光栅化,是将向量图形格式表示的图像转换成位图以用于显示器或者打印机输出的过程。

总体上来说,栅格化这个术语可以用于任何将向量图形转换成位图的过程。

在通常的应用中,这个术语用来表示在计算机上显示三维形状的流行渲染算法。栅格化目前是生成实时三维计算机图形最流行的算法。实时应用需要立即响应用户输入,并且通常需要至少每秒 24 帧的速率。

与辐射着色、光线跟踪等其它渲染技术不同,栅格化的速度非常快,但是由于它不是根据光传输的物理规律进行处理的,所以无法正确模拟许多复杂真实光照环境,只能达到足够欺骗人类眼睛的程度。

光栅化处理的图像真实度会下降。点、线、三角形作为基本的处理单元,其在光栅化处理之中,分辨率会扩大,其边缘会出现锯齿状的凸起,造成图像还原准确度的下降。[22]所以最近有很多研究在缓解光栅化的劣势,通常使用了以下方法:(1)增大显示设备的分辨率。增大显示系统中显示设备的分辨率,使得屏幕的对同一图形显示的像素点数增加,就可以减少图像边缘锯齿之间的距离。这样既可增大采样频率,使得每个像素的尺寸更小,图像边缘产生的锯齿就会更小,从而在视觉上对其敏感度降低。但是该方法受到硬件技术的约束比较大,经过硬件的不断发展,如今显示设备的分辨率一直都在提高。(2)超采样技术。超采样,是指将一个像素点划分为n个子像素点,在进行采样时,对每个子像素点均进行采样。在对图像进行扫描采样时,所经过的每一个像素点,都要计算图像中像素点所覆盖的子像素点的数量,然后根据子像素点的个数按照一定的算法规则计算当前像素点的灰度等级。这样,屏幕显示图像时,边缘部分就会比较平滑,有过度像素点。(3)随机采样技术。人类的视觉系统相对于噪声引起的失真来讲,对高频信号引起的走样现象更加敏感。在使用随机采样技术时,同样也是将一个像素点分为n个子像素点,但是子像素点的分布具有随机特性,从而可以很好的将高频信号引起的走样现象转化为噪声引起的失真。因此,对于减弱高频信号引起的失真现象,随机采样技术显然效果更加明显。[23]

同时,得益于光栅化图形渲染速度较快,性能占用较小的特点,合成和渲染大规模场景的图像,如城市街区,对于机器人仿真和虚拟现实(VR)等领域具有重要价值。在这些领域中,实现高度逼真性和速度至关重要。VR需要以交互式帧速率呈现逼真的图像,以实现沉浸式和无缝的用户体验。类似地,机器人仿真开发需要实际世界传输的高保真度图像质量,以及用于规模评估和培训的高帧速率,特别是用于封闭环传感器模拟。Jeffrey[24]等人因为现有的神经渲染方法能够生成逼真的结果,但主要适用于小规模场景(<50平方米),在大规模场景(>10000平方米)方面存在困难,从而提出了一种用于大场景的逼真实时小说视图合成(NVS)的新方法。传统的基于光栅化渲染的图形渲染对于大场景来说速度快,但缺乏真实度,并需要手动创建资源。他们的方法将两者结合起来,以中等质量的支架网格作为输入,并学习神经纹理场和着色器,以模拟视角相关效果,增强真实度,同时仍然使用标准的图形管道进行实时渲染。他们的方法胜过了现有的神经渲染方法,在大型自动驾驶和无人机场景中提供至少30倍更快的渲染速度,并具有相媲美或更好的真实度。第一个实现了大场景的实时渲染的方法。

- 机器学习与计算机图形学的融合

机器学习和深度学习在计算机图形学中扮演着重要的角色,为图形生成、处理、分析和渲染等各个方面提供了新的机会和方法。

-

- 神经渲染

神经渲染(Neural Rendering)技术基于统计学习方法,利用各种深度神经网络进行图像合成,通过自动化的流程,让机器理解照片中的物体在三维空间中的实际形状和物理状态(材质、光照),实现图形渲染中建模和渲染的全部或部分的功能,能够节省大量从业人员的时间和精力。

神经渲染已成为计算机图形学领域最为迅猛的发展方向。在多种计算理论、方法和技术的融合下,这个新领域出现了非常多的有趣应用:包括图像内容编辑、场景合成、视角变化、人物编辑等等。可以预见,神经渲染未来将会在电影工业、虚拟/增强现实和智慧城市等领域中发挥越来越重要的作用。

前几月苹果发布的VisionPro便使用了该项技术,使用摄像头扫描人脸,构造出人脸大致建模,并将其放在头显前方的屏幕之上,并且能实时捕捉头显内部的人物动作,将其展示在头显外部的屏幕之上。

Mildenhall[25]等提出了一种神经辐射场(neural radiance field)的方法,利用5D(表示空间点的坐标位置(x,y,z)和视角方向(θ, ∅))向量函数来表示连续场景。基于此,后续提出许多改进优化的方法。

不同于体素、网格、点云等形式表示三维场景,基于深度学习的神经渲染是一种隐式的三维场景表示,即辐射场(Radiance Fields),它其实一个映射函数F(θ), 输入是三维空间的坐标点X=(x,y,z)和观察角度d=(θ, ∅),输出是体素密度δ,和颜色值C=(r, g, b),体素密度只和空间位置有关,而颜色则与空间位置以及观察的视角都有关系。神经辐射场即通过神经网络(多层感知机)和数据拟合映射函数F(θ)。

NeRF训练过程需要输入从不同位置拍摄同一场景的图片,拍摄这些图片的相机位姿、相机内参,以及场景范围。若图像数据集缺少相机参数真值,作者便使用经典SfM重建解决方案COLMAP估计了需要的参数,当作真值使用。

在训练使用NeRF渲染新图片的过程中,先将这些位置输入MLP以产体素密度和RGB颜色值;取不同的位置,使用体积渲染技术将这些值合成为一张完整的图像;因为体积渲染函数是可微的,所以可以通过最小化上一步渲染合成的、真实图像之间的误差来训练优化NeRF场景表示。这样的一个NeRF训练完成后,就得到一个以多层感知机的权重表示的模型。一个模型只含有该场景的信息,不具有生成别的场景的图片的能力。

以下是其应用:

-

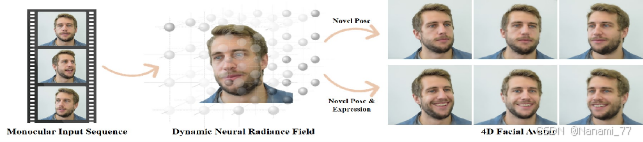

数字化人体「4D Facial Avatar」: 将3DMM和NeRF结合,实现了一个动态神经辐射场。输入一个单目视频,该方法能够实现人脸的位姿、表情编辑。 -

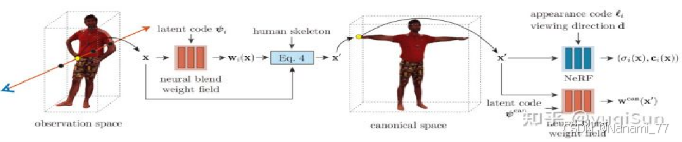

「Animatable」: 神经混合权重场来产生变形场,实现了人体建模。需要输入多视角视频。这个领域目前主要向SMPL靠近,就是给定一个规范空间,或者说template,然后从不同观测空间估计规范空间。 -

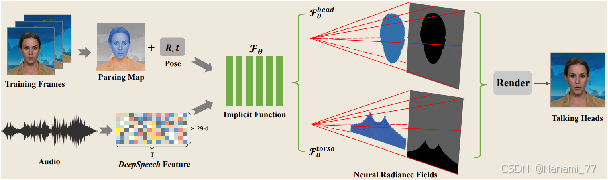

「AD-NeRF」:通过给定一段语音和源人脸,可以生成一段说话人视频。

NVIDIA公司CEO黄仁勋曾在发布会上使用生成的自己替换了自己一段时间,效果拔群。

-

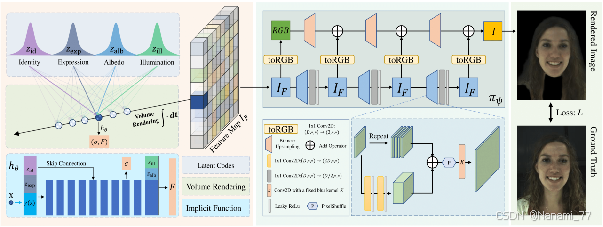

「HeadNeRF」:可实时渲染高保真的头部图像,能直接控制生成图像的渲染姿态和各种语义属性。

-

- 生成式对抗网络(GANs)与计算机图形学

生成式对抗网络(GAN)[26]的出现为计算机视觉应用提供了新的技术和手段,它以独特零和博弈与对抗训练的思想生成高质量的样本,具有比传统机器学习算法更强大的特征学习和特征表达能力。目前在机器视觉领域尤其是样本生成领域取得了显著的成功,是当前研究的热点方向之一。[27]

目前 GAN 应用有两种方法,一是完全从无到有的生成:输入随机产生的噪声变量,输出人、动物等各种图像,这类应用难度较高;另一个则是利用 GAN 来改进已有或传统的 AI应用,例如超分辨率、照片自动美化、机器翻译等,难度相对较低,效果也很实用。

发展三年多的 GAN,在已经发展了 60 年的人工智能领域中,虽然还是很新的技术,不过已经有各种变体或进阶版出现,而且在诸多研究人员及企业的投入下未来仍有许多的可能性。例如有机会从二维的图片进展到三维的视频等等。

例如,电影产业中想要生成一个名人图像,原始做法是针对明星的人脸进行三维建模,再加上材料、物理特性的设计,再通过计算机进行渲染,这是很长的一段流程;或是也有人尝试以三维建模打造逼真的自动驾驶的训练虚拟环境。未来都可能用GAN就能达到。目前GAN生成的图像与视频分辨率已经很高了,但视频仍能看出明显的瑕疵。未来几年若有新的结构、训练方式出现,就有机会做到以假乱真。如果GAN的研究无法保持高速的发展,就可能无法取代三维建模的流程。

在海外包括Google、OpenAI、纽约大学等都投入大量资源进行GAN的研究,目前中国的学术机构也有针对GAN的理论展开研究,例如香港中文大学、上海交通大学、清华大学研究机构等。企业则是以GAN的应用为主,比如,商汤以GAN做图像超分辨率已经产品化,客户包括了诸多手机厂商、图像处理APP厂商等。

- 结 语

在计算机图形学的领域中中,图形渲染技术的演进不断推动着虚拟现实、游戏开发、机器人仿真、动画CG、医疗模拟等领域的发展。随着GPU性能的进步与光线追踪等技术的迭代,渲染出的图形真实感越来越强。同时,光栅化技术的快速速度和低性能占用使其成为大规模场景渲染的首选,尤其在虚拟现实和机器人仿真中具有突出地位。

不断涌现的新技术,如超采样、随机采样和神经渲染方法,为解决渲染中的问题提供了新的可能性,不仅提高了图像性能,还在大规模场景下融合了真实感。未来,随着硬件性能的不断提升和新技术的涌现,图形渲染将进一步推动虚拟现实和仿真等领域的发展,为人类提供更加逼真和沉浸式的体验。

参考文献(References)

[1] Gabriyel W , Jianliang W .Real-Time Rendering: Computer Graphics with Control Engineering[M]. 2017.

[2] Haines E , Hoffman N , Pesce A ,et al.Real-Time Rendering, Fourth Edition[J]. 2018.

[3] Physically Based Rendering[J].Physically Based Rendering (Third Edition)[2023-10-18].

[4] Suffern K , Hu H H .Ray Tracing from the Ground Up, Second Edition[J]. 2014.

[5] Appel A .Some techniques for shading machine renderings of solids[C]//American Federation of Information Processing Societies: AFIPS Conference Proceedings: 1968 Spring Joint Computer Conference, Atlantic City, NJ, USA, 30 April - 2 May 1968.1968.DOI:10.1145/1468075.1468082.

[6] Whitted T , Whitton M C , Johnson C ,et al.Origins of Global Illumination[J].IEEE Computer Graphics and Applications, 2020, 40(1):20-27.DOI:10.1109/MCG.2019.2957688.

[7] Kurt M .Real-Time Shading with Phong BRDF Model[J]. 2019.DOI:10.21205/deufmd.2019216315.

[8] Burley B B , Studios W D A .Physically-Based Shading at Disney[J]. 2012.

[9] Fujimoto A , Tanaka T , Iwata K .ARTS: accelerated ray-tracing system[J].IEEE, 2007.DOI:10.1109/MCG.1986.276715.

[10] Wchter C , Keller A .Instant Ray Tracing: The Bounding Interval Hierarchy[C]//Eurographics Conference on Rendering Techniques.Eurographics Association, 2006.DOI:10.2312/EGWR/EGSR06/139-149.

[11] Goldsmith J , Salmon J .Automatic Creation of Object Hierarchies for Ray Tracing[J].IEEE Computer Graphics and Applications, 1987, 7(5):14-20.DOI:10.1109/MCG.1987.276983.

[12] Ernst M , Greiner G .Early Split Clipping for Bounding Volume Hierarchies[C]//Interactive Ray Tracing, 2007. RT '07. IEEE Symposium on.IEEE, 2007.DOI:10.1109/RT.2007.4342593.

[13] Dammertz H , Keller A .The edge volume heuristic - robust triangle subdivision for improved BVH performance[J].IEEE Symposium on Interactive Ray Tracing Rt, 2008:155 - 158.DOI:doi:10.1109/RT.2008.4634636.

[14] Walter B , Bala K , Kulkarni M ,et al.Fast agglomerative clustering for rendering[C]//IEEE Symposium on Interactive Ray Tracing.IEEE, 2008.DOI:10.1109/RT.2008.4634626.

[15] Thrane N , Simonsen L O .A comparison of acceleration structures for GPU assisted ray tracing[J].Masters Thesis, 2005.

[16] Christen M .Ray tracing on GPU[J].Diploma Thesis University of Applied Sciences, 2005.DOI:http://dx.doi.org/.

[17] Lauterbach C , Garland M , Sengupta S ,et al.Fast BVH Construction on GPUs[C]//Computer Graphics Forum.John Wiley & Sons, Ltd, 2009.DOI:10.1111/j.1467-8659.2009.01377.x.

[18] Gu Y , He Y , Fatahalian K ,et al.Efficient BVH Construction via Approximate Agglomerative Clustering[C]//High-performance Graphics Conference.2013.DOI:10.1145/2492045.2492054.

[19] Karras T , Aila T .Fast parallel construction of high-quality bounding volume hierarchies[C]//High-performance Graphics Conference.ACM, 2013:89.DOI:10.1145/2492045.2492055.

[20] Domingues L R , Pedrini H .Bounding volume hierarchy optimization through agglomerative treelet restructuring[C]//ACM.ACM, 2015:13-20.DOI:10.1145/2790060.2790065.

[21] 王伟健.基于局部密度聚类的包围体层次结构构建方法研究[D]. 2019.

[22] 刘华清.光栅化与光线追踪的技术优劣与发展趋势[J].轻工科技, 2020(4):3.DOI:CNKI:SUN:GXQG.0.2020-04-026.

[23] 王利祥.智能设备中直线抗锯齿的研究[J].电子制作, 2018(10):3.DOI:CNKI:SUN:DZZZ.0.2018-10-011.

[24] https://research-assets.waabi.ai/NeuRas/poster_real-time.pdf

[25] Kyle Gao, Yina Gao, Hongjie He, Dening Lu, Linlin Xu, Jonathan Li. NeRF: Neural Radiance Field in 3D Vision, A Comprehensive Review[J].2022. arXiv:2210.00379

[26] Ian J. Goodfellow, Jean Pouget-Abadie, Mehdi Mirza, Bing Xu, David Warde-Farley, Sherjil Ozair, Aaron Courville, Yoshua Bengio. Generative Adversarial Networks[J].2014. arXiv:1406.2661

[27]曹仰杰,贾丽丽,陈永霞,等.生成式对抗网络及其计算机视觉应用研究综述[J].中国图象图形学报, 2018, 23(10):17.DOI:CNKI:SUN:ZGTB.0.2018-10-001.

Recent Developments and Applications of Computer Graphics

Abstract: Computer graphics is an important branch of computer science that focuses on creating graphics and images through the collaborative efforts of computer hardware and software. This paper introduces the recent developments in rendering within the field of computer graphics, along with its integration with machine learning. In recent years, computer graphics has made significant advancements in various areas such as virtual reality, real-time rendering, neural rendering, and computer-aided design. The performance improvement of graphics hardware (GPU) has provided robust support for real-time rendering, while image generation based on Generative Adversarial Networks (GANs) has opened new opportunities in the field of computer graphics. The paper goes on to discuss different rendering techniques, primarily categorized into real-time rendering and offline rendering. Real-time rendering finds wide applications in 3D games, virtual reality, interactive design, and demands high rendering speed and frame rates. On the other hand, offline rendering is used for global illumination algorithms to achieve higher realism, especially in the context of film and animation production. The paper delves deeper into two main rendering techniques: ray tracing and rasterization. Ray tracing generates images by tracing the paths of light rays, offering a high degree of realism but with high computational resource requirements. Rasterization is a faster rendering technique but often falls short in achieving high realism, as it is based on points, lines, and triangles as fundamental processing units, leading to aliasing artifacts. However, in recent years, techniques like super-sampling and stochastic sampling have improved the quality of rasterization. Furthermore, the paper discusses the integration of computer graphics with machine learning, specifically focusing on the progress in neural rendering and Generative Adversarial Networks (GANs). In conclusion, the paper explores the applications of computer graphics and its future developments.

Keywords: Computer graphics, rasterization, ray tracing, machine learning

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?