from delta import * 报错 AttributeError: module 'pyspark.sql.utils' has no attribute 'convert_exception'的解决方案

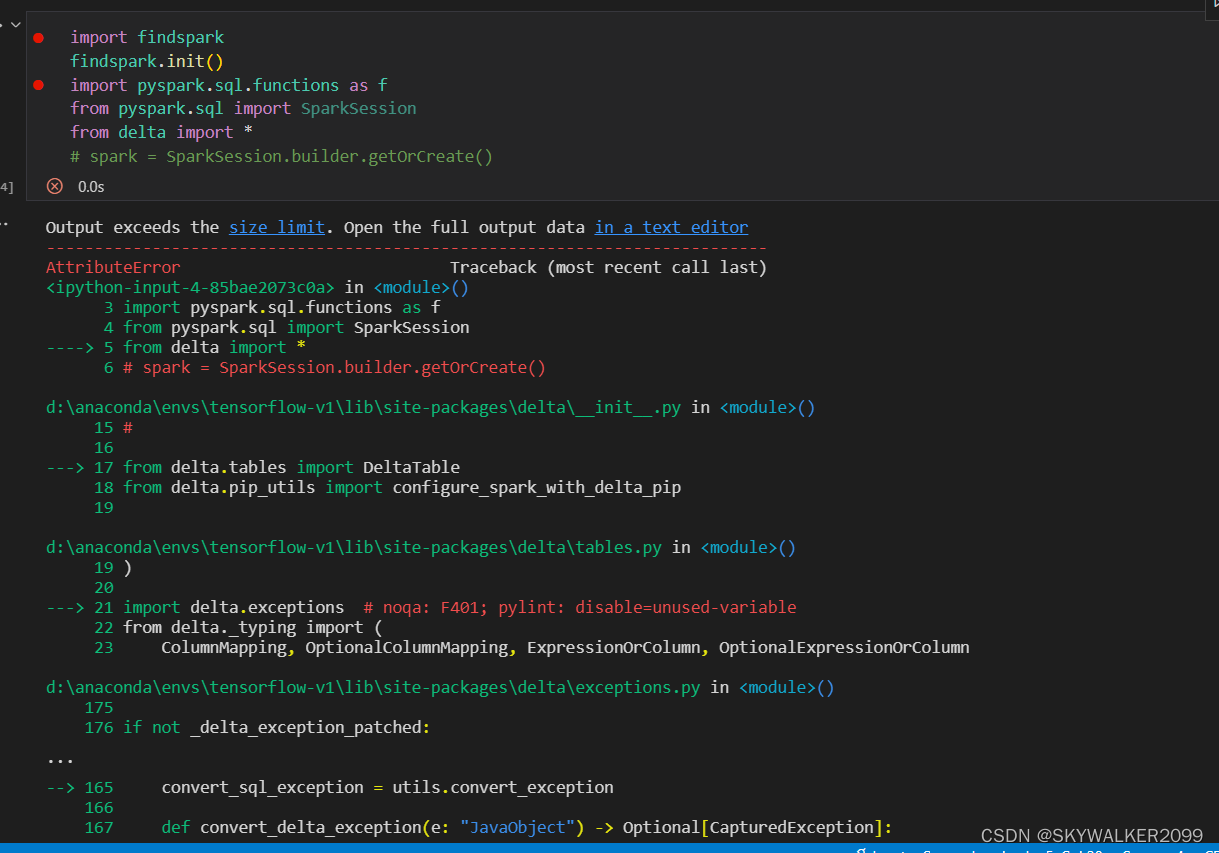

错误描述

根据delta-lake官网的python项目执行方案

但是在实际安装完成(这里使用delta-spark==2.0.0)会报下面这个错误

问题解决

由于网上对此错误解决方案较少,于是我么分析报错:

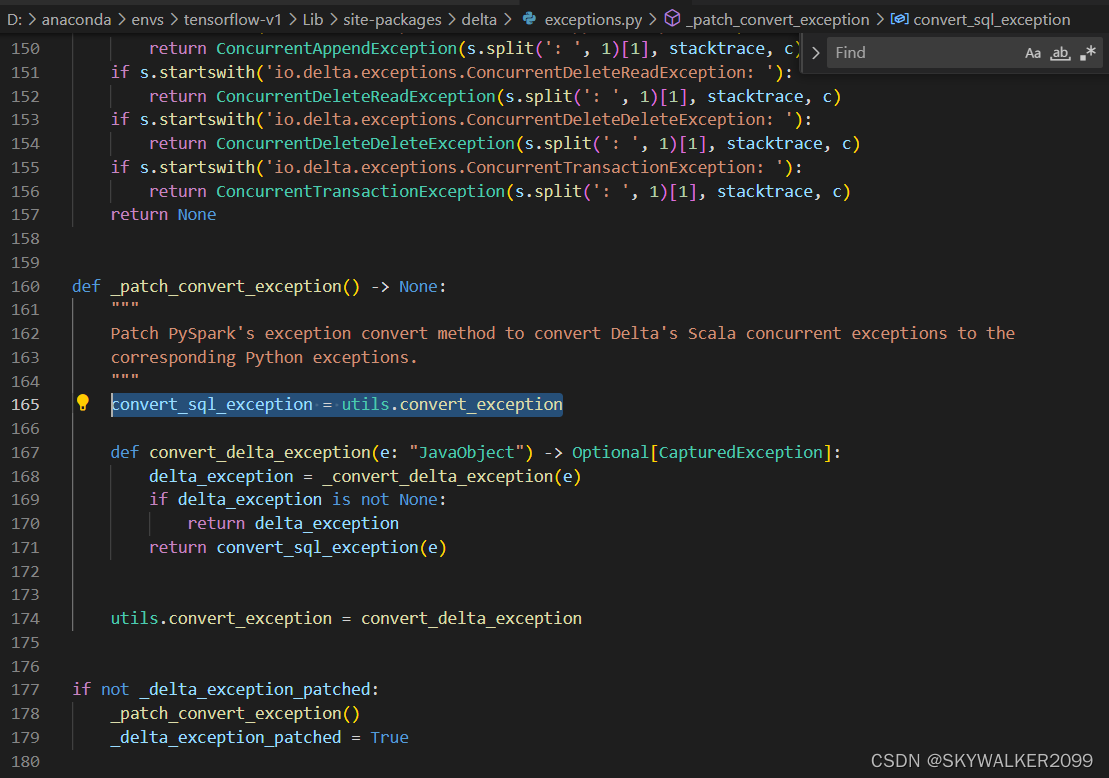

- 首先溯源到D:\anaconda\envs\tensorflow-v1\Lib\site-packages\delta\exceptions.py,打开后可以看到报错位置如下:

他这里调用了pyspark.sql.utls中的convert_exception

; - 打开utls这个源文件可以找到同名的函数

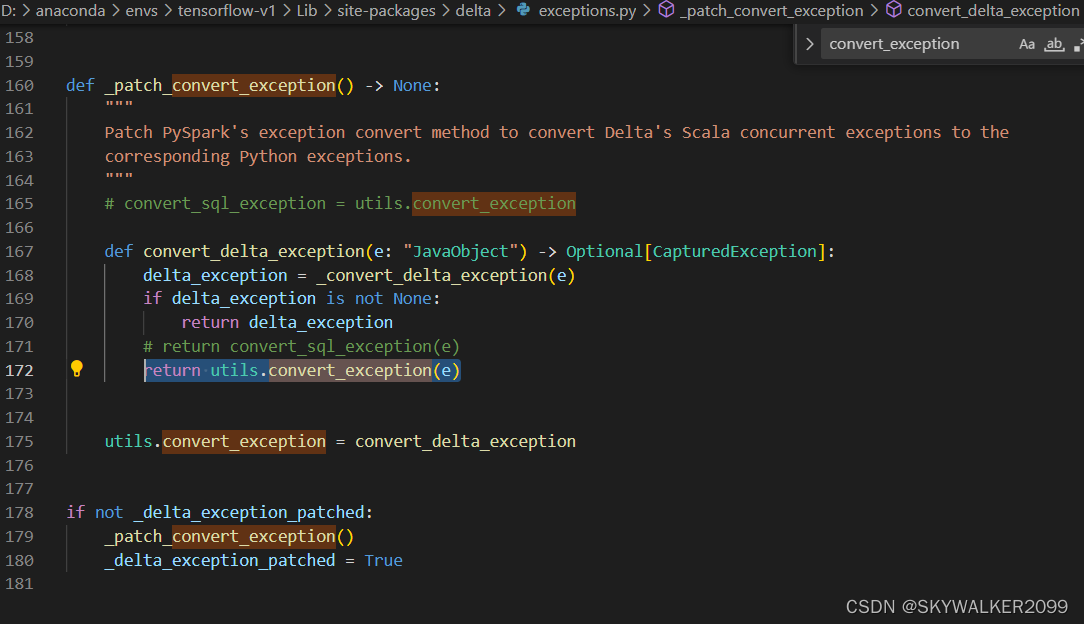

但是在上述delta\exceptions.py的源文件中他似乎将其作为一个句柄用,或者理解为convert_sql_exception空输入的返回【此处关于句柄或者具体报错的理解并不是很透彻,但似乎这么写会引起报错】; - 于是尝试更改如下:

;

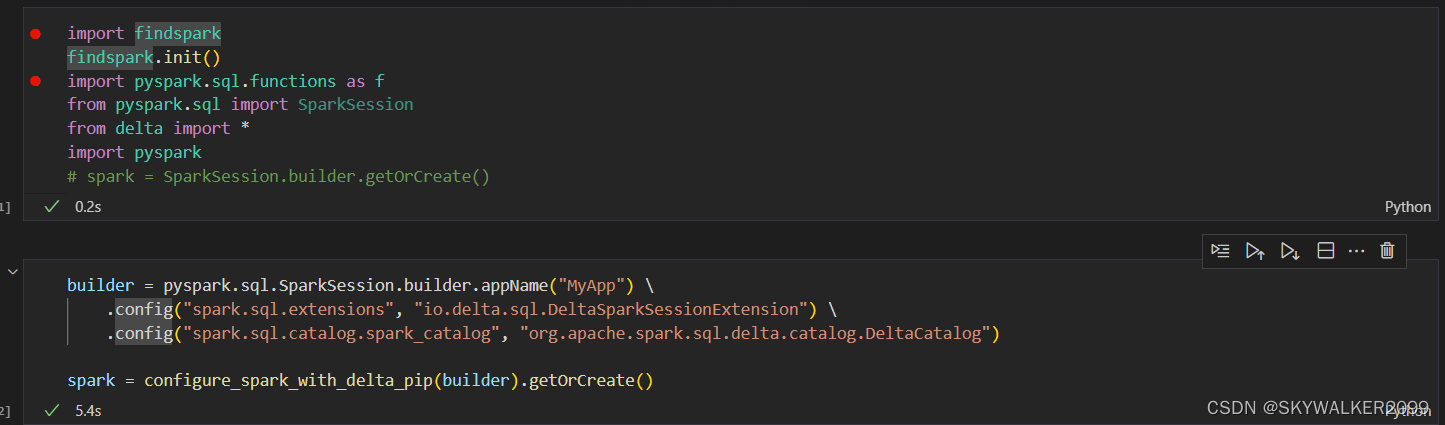

; - 保存源码并且运行原来报错的代码

成功了,问题解决;

Notice:关于上述修改的具体报错本质原因如有网友能本质解释可以评论区分享一下。tks

995

995

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?