金磊 发自 凹非寺

量子位 | 公众号 QbitAI

大模型理解、推理Excel,现在变得更加精准了。

这就是来自微软的一项最新研究——SPREADSHEETLLM,主打的就是让大模型有条不紊地处理各种电子表格任务。

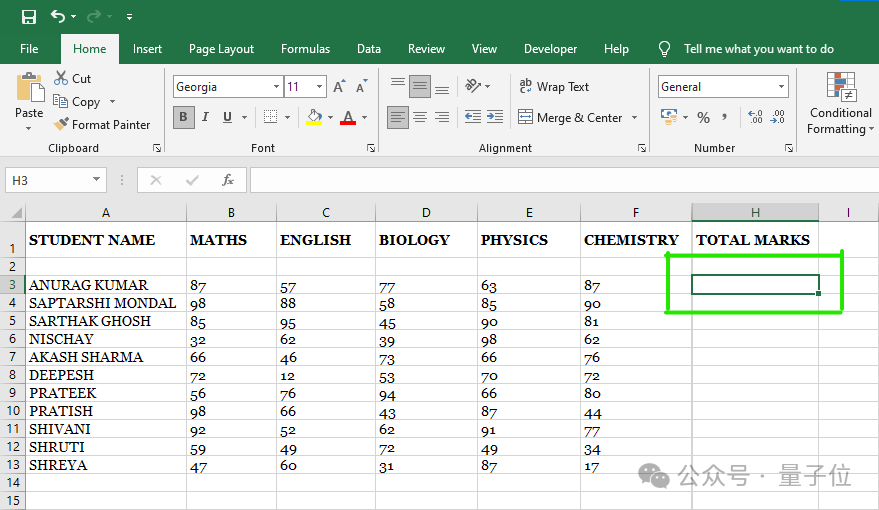

例如在下面这张图中,如果用传统的大模型方法,会直接忽略掉“R5:R14”这列数据。

然而,这一列数据其实是与左侧单元格有着较强的语义关系,表示这些值在左侧单元格中的百分比。

现在有了SPREADSHEETLLM,这种有难度的推理任务已经是可以轻松应对了。

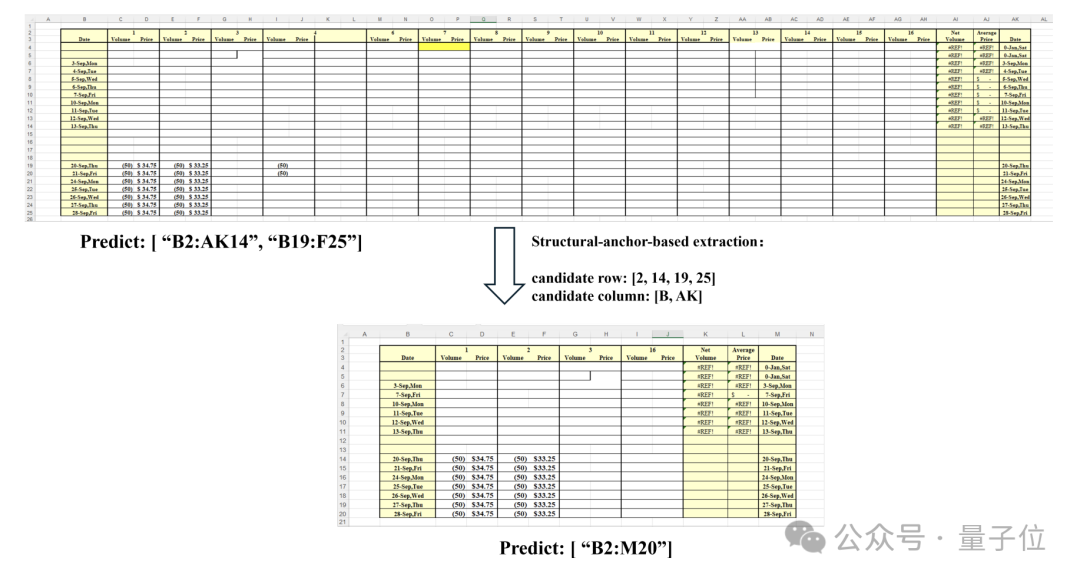

再如当Excel表格里存在结构稀疏或者有大量空格单元的时候,大模型在识别任务上也会出错,最终导致结果的错误。

而SPREADSHEETLLM就能让大模型更加精准地“看清”Excel——

可以识别并保留表格的关键结构信息,同时去除多余的空单元格和行。

这项研究目前已经引来了不少网友们的围观,有人认为它将对那些跟数据打交道的打工人造成不小的冲击。

不过也有网友认为微软用大模型新研究“整治”Excel……也挺合理。

那么这项研究是如何让大模型处理Excel的能力Pro Max的?

我们继续往下看。

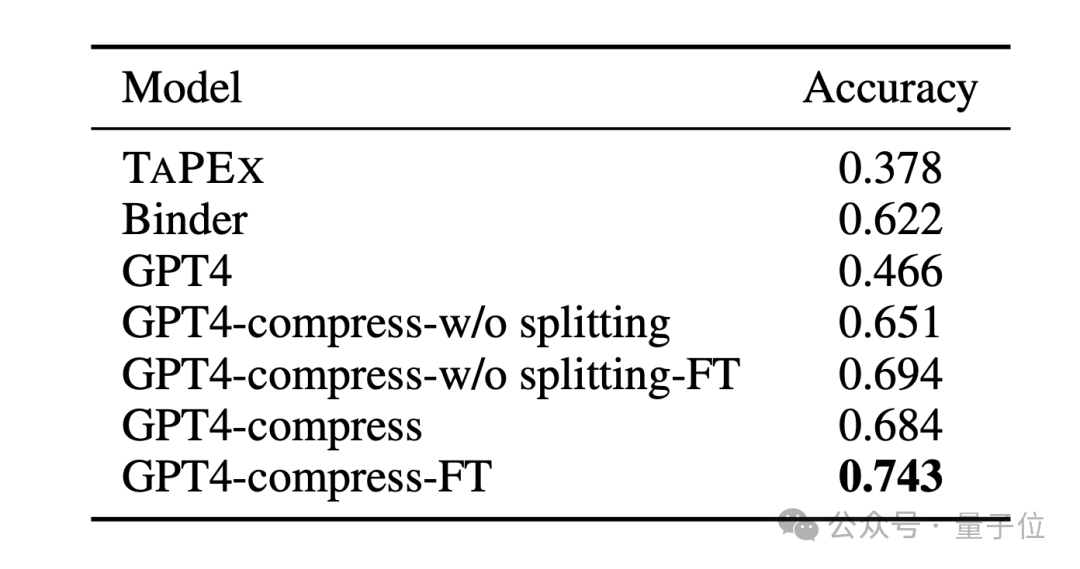

问答准确率提高了22%

在回答这个问题之前,我们先来了解一下传统大模型在处理Excel等电子表格任务时存在的问题。

首先就是tokens的限制。

众所周知,大部分的大模型在处理任务的时候都存在这方面的限制;而电子表格往往因为存在大量的二维网格和复杂的结构而超出了这个限制。

加之传统的电子表格编码方法,如HTML、XML由于需要重复使用标签来表示数据结构,也会导致tokens的消耗较高。

即使是Markdown的编码方法可以节省tokens,但它缺乏明确的单元格地址信息,导致在索引特定单元格位置时容易出错。

其次还存在像结构锚点识别的问题。

在没有有效方法来识别电子表格中的结构锚点(如表格边界的行和列)之前,即便是GPT-4也难以理解电子表格的布局和结构。

为了解决上述的问题,微软团队首先提出了一个叫做SheetCompressor的编码框架,主要包含三大模块:

结构锚点压缩(structural-anchor-based compression)

反向索引转换(inverse index translation)

数据格式感知聚合(data-format-aware aggregation)

结构锚点压缩的目的是识别电子表格中的结构锚点,即在表格边界处的非同质行和列。

这一步骤主要是通过识别和提取这些结构锚点,然后移除远离锚点的同质行和列,生成一个精简版的“骨架”电子表格。

这种方法有效地减少了需要处理的数据量,同时保留了对理解表格结构至关重要的信息。

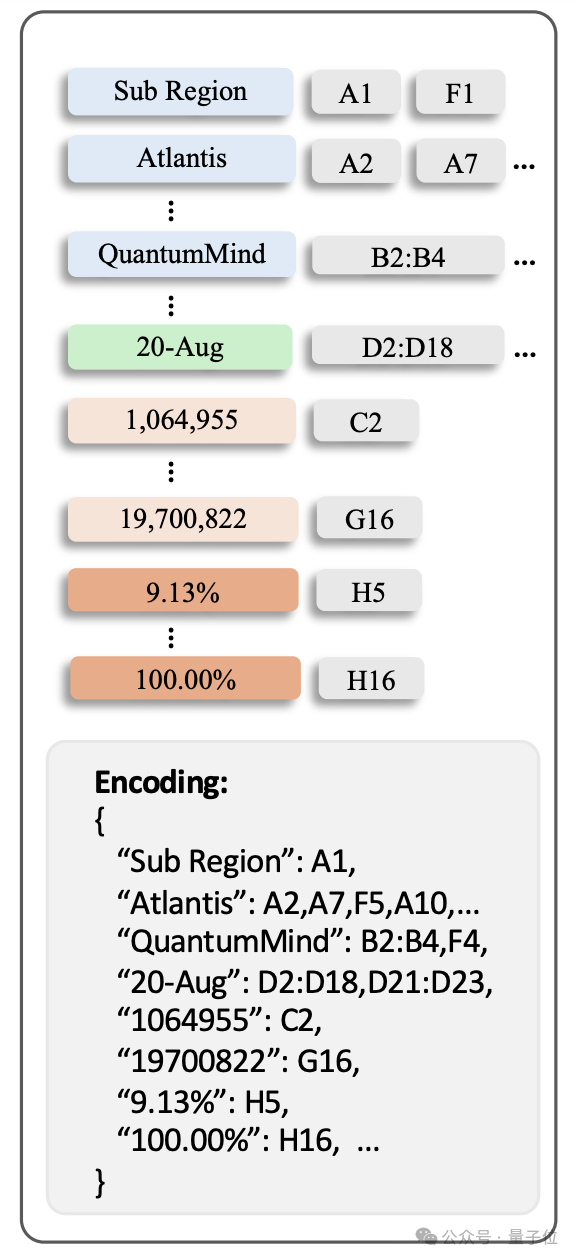

反向索引转换的目的是提高tokens的使用效率,特别是在处理包含大量空单元格和重复值的电子表格的时候。

与传统的逐行逐列的序列化方法不同,反向索引转换采用无损的JSON格式的反向索引翻译方法。

通过创建一个字典,将非空单元格文本作为键,将具有相同文本的地址合并,优化了tokens的使用,同时保持了数据的完整性。

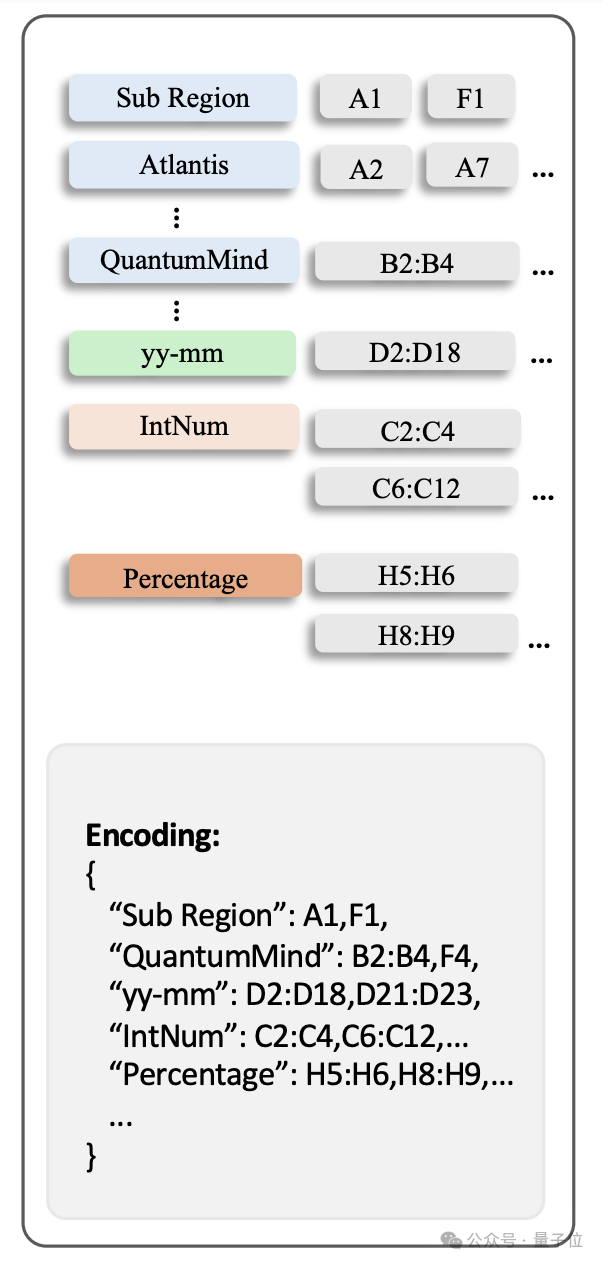

而数据格式感知聚合,则是为了简化对数值单元格的理解,因为相邻的数值单元格通常具有相似的数字格式。

它先是提取单元格的数字格式字符串和数据类型,然后将具有相同格式或类型的相邻单元格进行聚类。

通过这种方法,可以使用统一的格式字符串和数据类型来表示矩形区域,简化了对数值数据分布的理解,减少了大量的tokens支出。

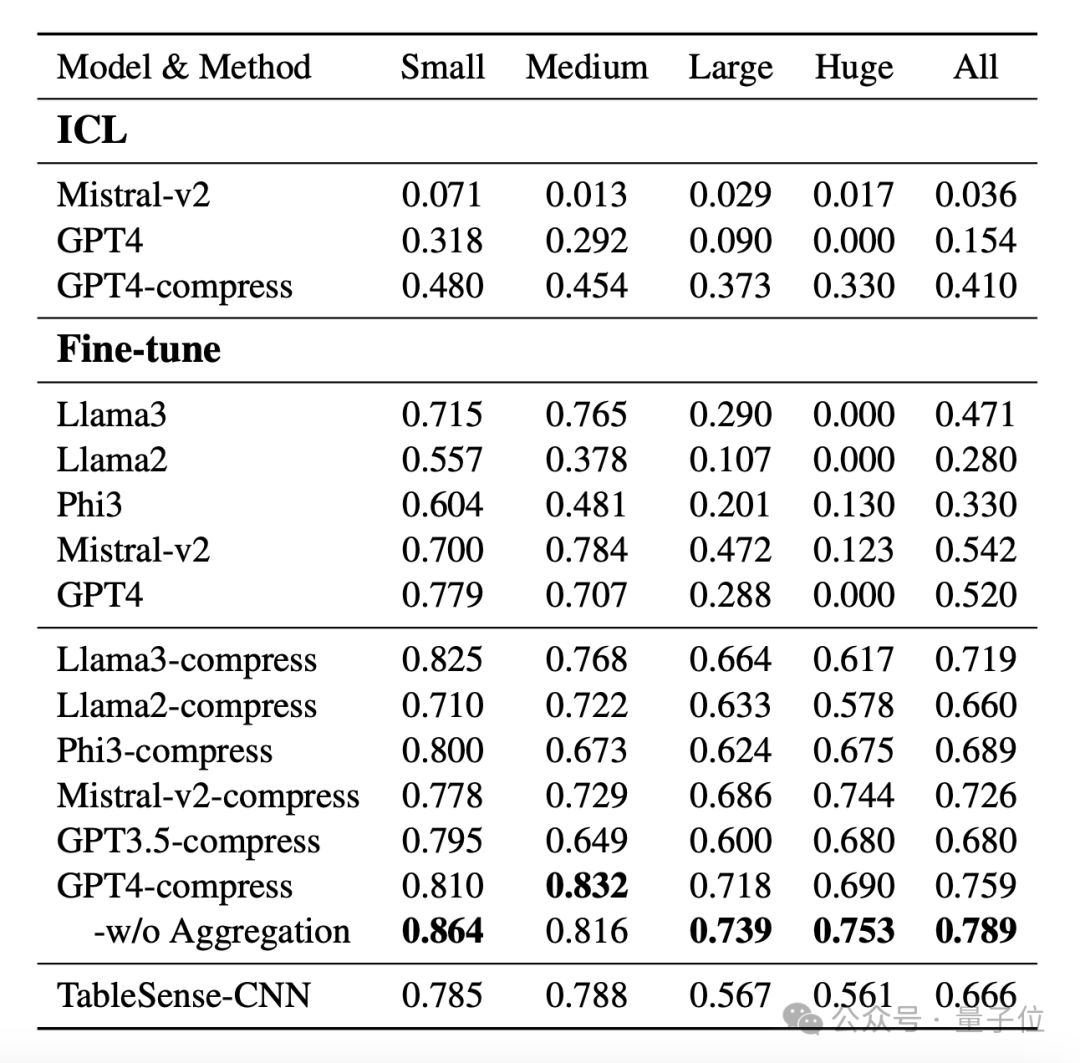

在实验结果来看,SheetCompressor将tokens使用量减少了96%,并且与原始数据上微调的相同模型相比,性能提高了27%,在表格检测任务上的F1分数达到了约79%。

除此之外,微软团队在这项研究中还提出了Chain of Spreadsheet(CoS)的框架。

它是用来扩展SPREADSHEETLLM的应用范围,特别是在处理电子表格的下游任务的时候。

首先,CoS需要确定与特定任务查询相关的表格,并确定相关内容的确切边界;这一步确保了只有相关数据在后续分析中被考虑,优化了处理效率和焦点。

在确定了相关表格后,下一步是生成对查询的准确响应。

CoS通过将处理过程分解为可管理的部分,有效地处理了复杂的电子表格,从而实现了精确且上下文感知的响应。

从结果上来看,CoS方法显著提高了大模型在问答方面的准确性。

例如,与基线GPT-4模型相比,CoS 方法的准确度提高了22%。

微调模型在电子表格表格检测任务上的表现也证明了CoS的泛化能力,微调后的模型在问答任务上的准确度提高了 6%。

总而言之,大模型现在处理Excel等电子表格这事儿,确实是变得更6了。

那么你觉得这项研究如何呢?欢迎在评论区留言讨论。

参考链接:

[1]https://arxiv.org/abs/2407.09025

[2]https://x.com/emollick/status/1812684733538541694

— 完 —

量子位年度AI主题策划正在征集中!

欢迎投稿专题 一千零一个AI应用,365行AI落地方案

或与我们分享你在寻找的AI产品,或发现的AI新动向

点这里👇关注我,记得标星哦~

108

108

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?