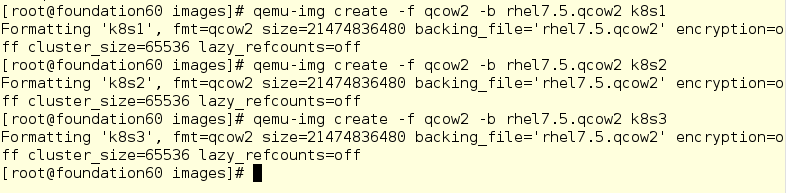

主机信息 主机功能

server1(172.25.15.1) k8s集群的master节点

server2(172.25.15.2) k8s集群的worker节点1

server3(172.25.15.3) k8s集群的worker节点2

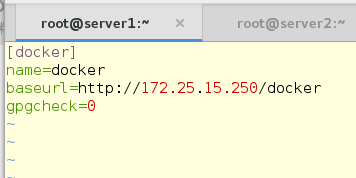

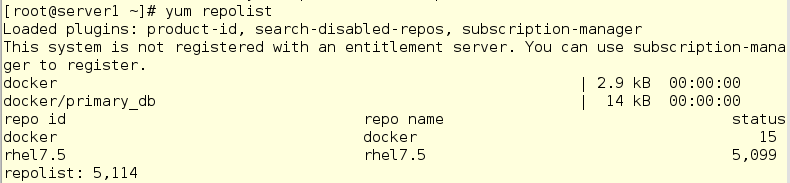

配置server1,2,3的yum源

server2,3略

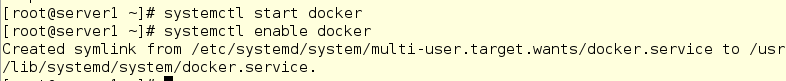

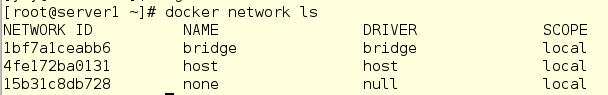

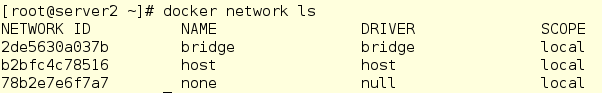

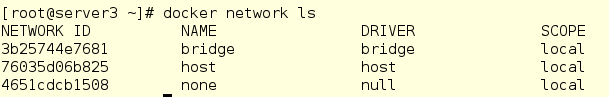

在server1、server2、server3上面安装docker服务,并且开启

server2,3略

基本的实验环境已经搭建完毕

2.部署一个基本的k8s集群

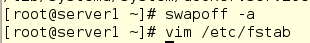

(1)在每个节点关闭系统的交换分区

server2,3略

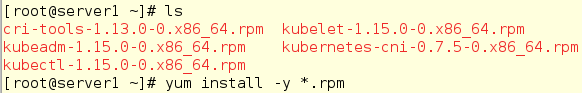

(2)在真机上给三个几点发送相应的rpm安装包

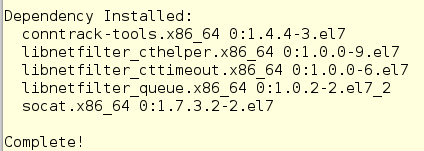

(3)在三个节点安装相应的软件

server2,3略

(4) 从真机给三个节点发送k8s集群会用到的镜像

(5)在三个节点导入相应的镜像并且查看

server2,3略

(6)在三个节点设置火墙规则

vim /etc/sysctl.d/k8s.conf

server2,3略

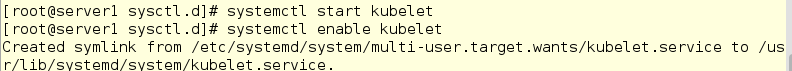

(7)在三个节点开启kubelet服务

server2,3略

(8)在server1(master节点)上面初始化集群

初始化成功

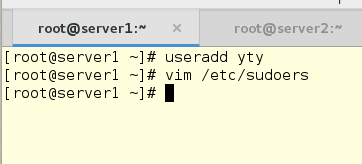

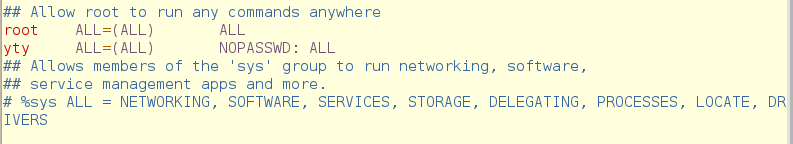

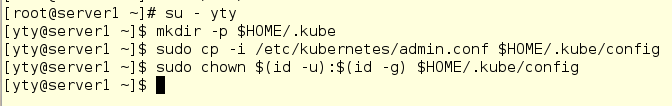

按照要求创建一个普通用户并且授权

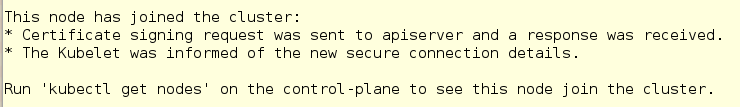

(9)将server2加入k8s集群

(10)将server3加入k8s集群

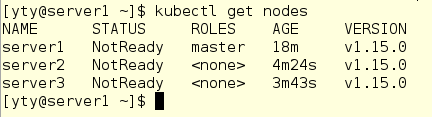

(11)在server1上查看服务是否开启

(12)在master节点查看集群的状态,发现有问题NotReady

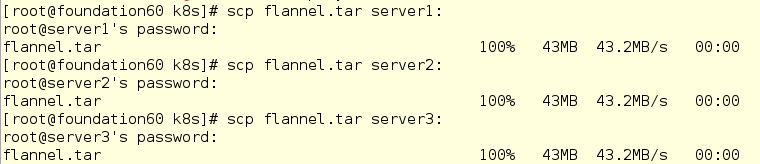

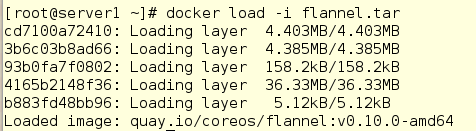

(13)从真机给三个节点发送网络的镜像,并且导入镜像

server2,3略

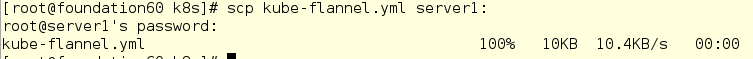

(14)从真机给server1发送网络的yaml文件

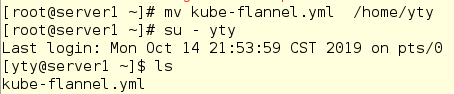

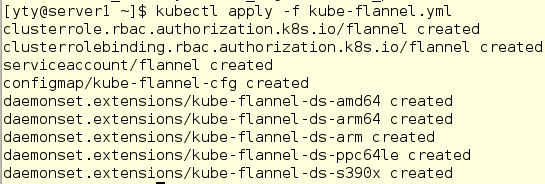

(15)在yty用户下创建集群网络

再次查看,发现三个节点都变为ready

网关一定要设置成真机网关172.25.15.250,不然镜像会有问题

基本的k8s集群已经搭建完毕

3.k8s集群的web界面,更加方便的管理集群

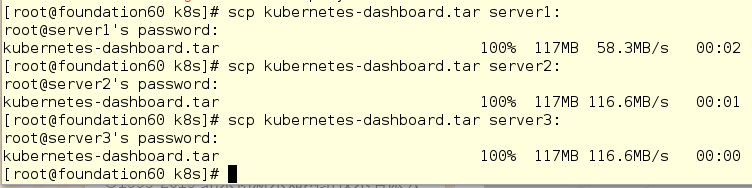

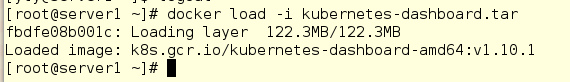

(1)从真机给三个节点发送图形化管理的镜像并且导入镜像

server2,3略

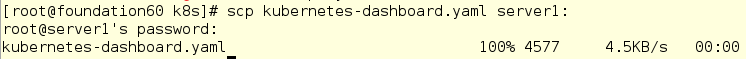

(2)在真机上面给server1发送图形化管理的yaml文件

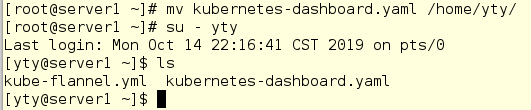

(3)将yaml文件放到普通用户的家目录下面

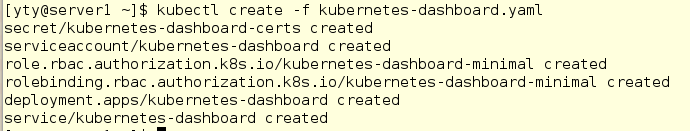

(4)创建

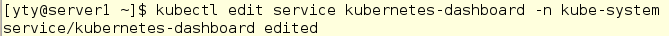

(5)修改端口

kubectl describe svc kubernetes-dashboard -n kube-system

(6)查看随机分配的端口

kubectl get pods -n kube-system

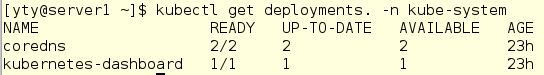

kubectl get deployments. -n kube-system

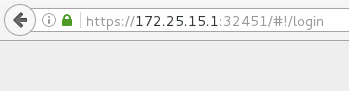

(7)浏览器访问

发现登陆需要令牌

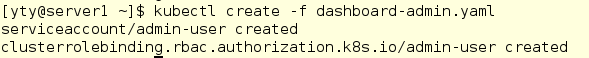

编写一个获得令牌的yaml文件

apiVersion: v1

kind: ServiceAccount

metadata:

name: admin-user

namespace: kube-system

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRoleBinding

metadata:

name: admin-user

roleRef:

apiGroup: rbac.authorization.k8s.io

kind: ClusterRole

name: cluster-admin

subjects:

- kind: ServiceAccount

name: admin-user

namespace: kube-system

查看令牌

5万+

5万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?