添加环境变量

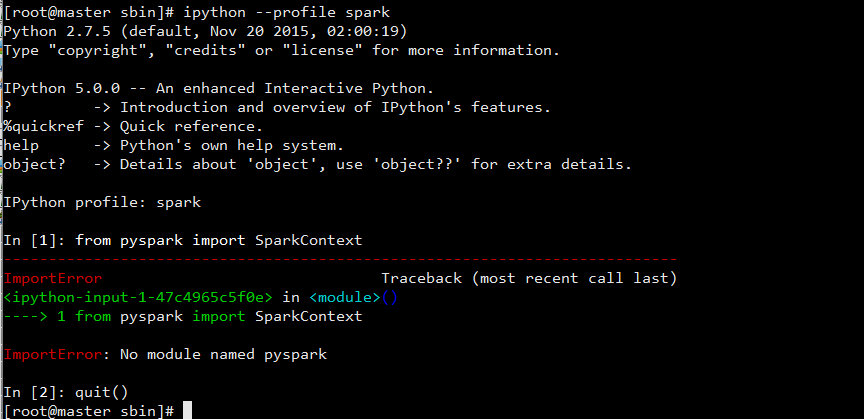

想使用python提交spark任务,第一步琚遇到错误

在 集群所有机器的/etc/profile上添加环境变量

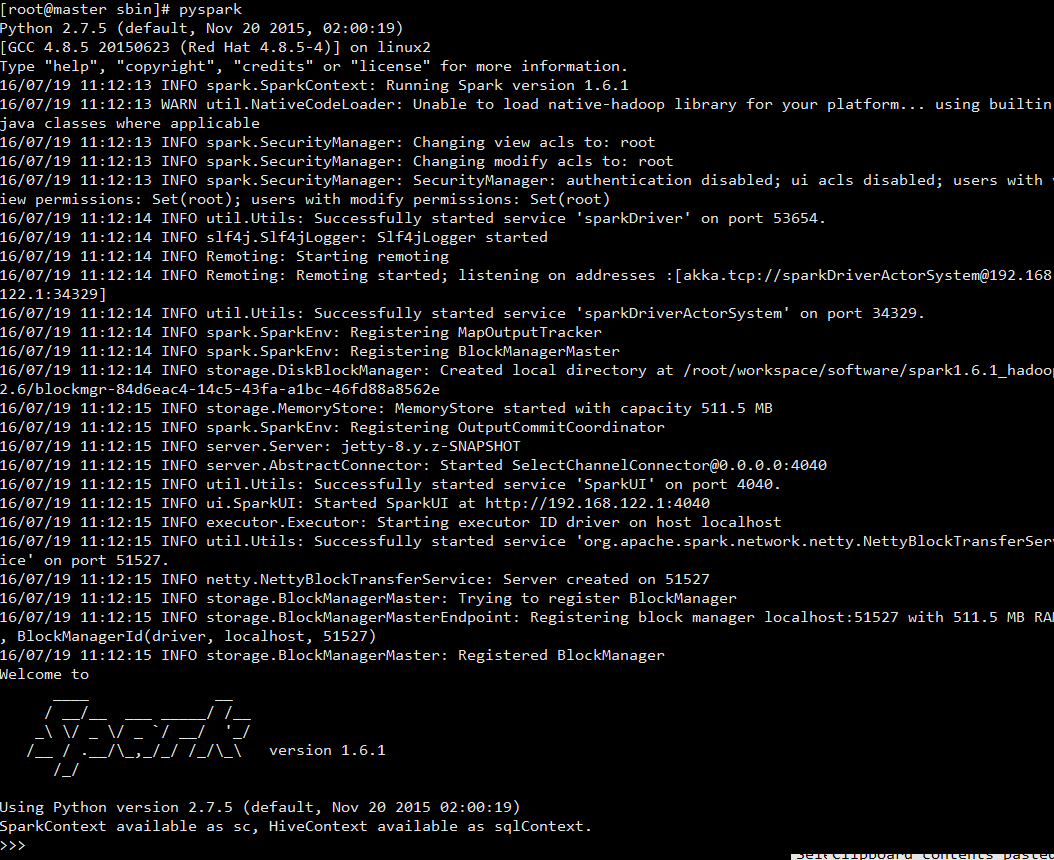

:$SPARK_HOME/python:$SPARK_HOME/python/lib/py4j-0.9-src.zip直接运行pyspark

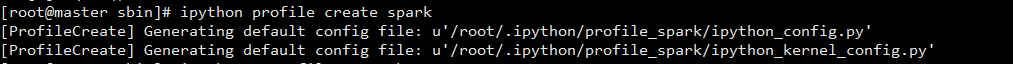

为Spark创建一个iPython配置

创建配置

在 /root/.ipython/profile_pyspark/startup 目录下编辑一个 00-pyspark-setup.py python 脚本

import os

import sys

spark_home=os.environ.get('SPARK_HOME',None)

if not spark_home:

raise ValueError('SPARK_HOME environment variable is not set')

sys.path.insert(0,os.path.join(spark_home,'python'))

sys.path.insert(0,os.path.join(spark_home,'python/lib/py4j-0.9-src.zip'))

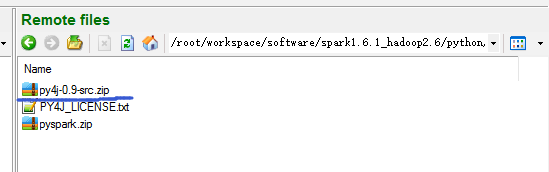

execfile(os.path.join(spark_home,'python/pyspark/shell.py'))py4j-0.9-src.zip 根据自己spark路径下,/root/workspace/software/spark1.6.1_hadoop2.6/python/lib里的文件确定

我这里是py4j-0.9-src.zip

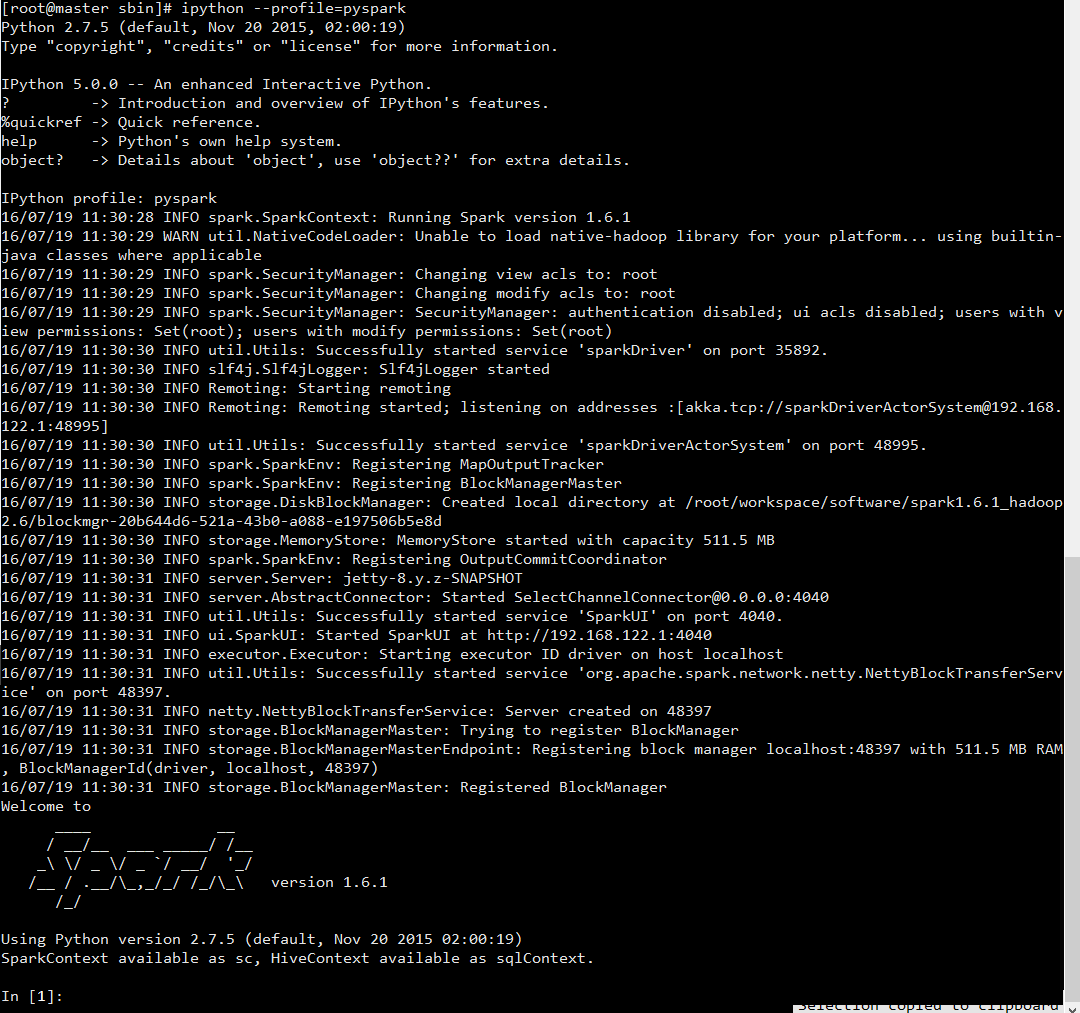

启动ipython

启动ipython 设置 –profile=pyspark 就会自动启动pysprak

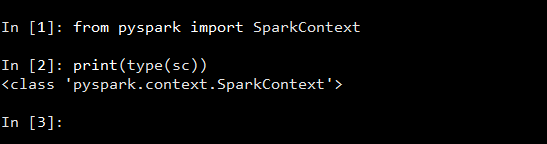

测试pysprak 是否能用

OK, 至此,pyspark 基本上正常工作了。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?