哈喽,上篇博文被某公司的大佬骂了一顿,其关注点在于博文的最后语气,而不是问题所在,行吧。这么大的人了,还抓不住重点,纠结计较于小事。

【声明:我的博文都是纯学术探讨,不涉及其他情绪。我有时候也是如此,但我尽量克制,不争辩】

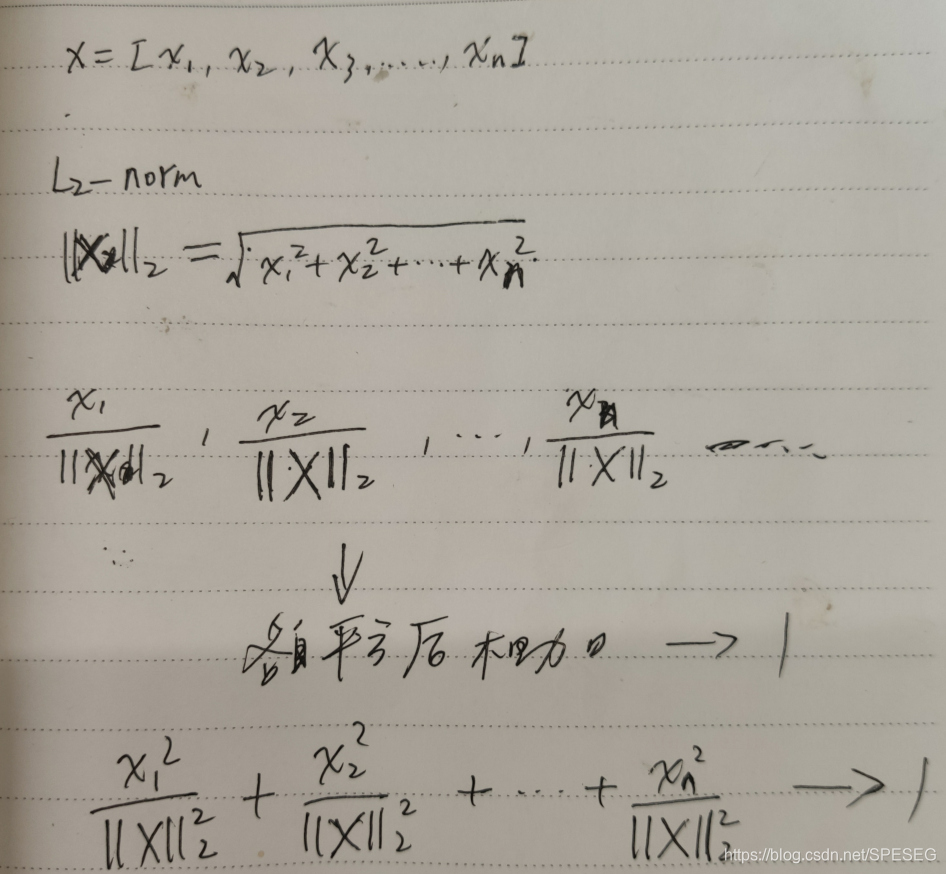

做推荐的一个大佬[不知道昵称叫啥了,因为我退群了,群主说不让相亲。。。]告诉我经过L2范数归一化后的数其平方和为1,是这么个道理,但这样的意义在于什么??我也不知道。

顺便将sklearn实现方法贴出来,上面提及的博文是用np实现的。

from sklearn.preprocessing import Normalizer

import numpy as np

L2norm=Normalizer(norm='l2')

>>> yy

array([ -3, -10, -6, 7, 7, 9])

>>> L2norm.fit_transform(yy.reshape(1, -1))

array([[-0.16666667,

订阅专栏 解锁全文

订阅专栏 解锁全文

826

826

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?