SVD(奇异值分解)

优点:简化数据,去除噪音,提高算法的结果

缺点:数据的转换可能难以理解

利用SVD,我们可以使用小得多的数据集来表示原始数据集,这样做实际上是去除了噪声和冗余信息,以此达到了优化数据、提高结果的目的。

SVD的应用

LSA(隐形语义分析)

在LSA中,矩阵是由文档和词语组成的,当我们应用SVD时,就会构建出多个奇异值,这些奇异值就代表了文档中的主题或概念,这一特点可以用于更高效的文档搜索

推荐系统

简单版本的推荐系统能够计算项或人之间的相似度,更先进的办法则先利用SVD从数据中构建一个空间,然后在该空间下计算其相似度。

矩阵分解

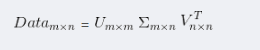

PCA是利用协方差矩阵的特征值,将较大的特征值与特征值提取出来,构建新的压缩矩阵。而SVD则是直接在原矩阵上进行矩阵的分解,这类似于数的因式分解,矩阵分解公式

上式分解中会构建一个矩阵![]() 该矩阵只有对角元素,其他元素均为0。这些元素被称为奇异值,它们对应了原始数据集的奇异值。在科学和工程中,一直存在一个这样的惯例:在某个奇异值的数目(r个)之后,其他奇异值都置为0.这就意味着数据集中仅有r个重要的特征,而其余的特征都是噪音或冗余特征。

该矩阵只有对角元素,其他元素均为0。这些元素被称为奇异值,它们对应了原始数据集的奇异值。在科学和工程中,一直存在一个这样的惯例:在某个奇异值的数目(r个)之后,其他奇异值都置为0.这就意味着数据集中仅有r个重要的特征,而其余的特征都是噪音或冗余特征。

实现SVD

def loadData():

return [[1,1,1,0,0],

[2,2,2,0,0],

[1,1,1,0,0],

[5,5,5,0,0],

[1,1,0,2,2],

[0,0,0,3,3],

SVD(奇异值分解)优点:简化数据,去除噪音,提高算法的结果缺点:数据的转换可能难以理解利用SVD,我们可以使用小得多的数据集来表示原始数据集,这样做实际上是去除了噪声和冗余信息,以此达到了优化数据、提高结果的目的。SVD的应用LSA(隐形语义分析)在LSA中,矩阵是由文档和词语组成的,当我们应用SVD时,就会构建出多个奇异值,这些奇异值就代表了文档中的主题或概念,这一特点...

SVD(奇异值分解)优点:简化数据,去除噪音,提高算法的结果缺点:数据的转换可能难以理解利用SVD,我们可以使用小得多的数据集来表示原始数据集,这样做实际上是去除了噪声和冗余信息,以此达到了优化数据、提高结果的目的。SVD的应用LSA(隐形语义分析)在LSA中,矩阵是由文档和词语组成的,当我们应用SVD时,就会构建出多个奇异值,这些奇异值就代表了文档中的主题或概念,这一特点...

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?