往期已经进行过ChatGLM3的部署了,感兴趣的可以搜索往期的博客,我们今天主要使用github项目工程提供的demo进行玩耍,ok开始。

环境配置

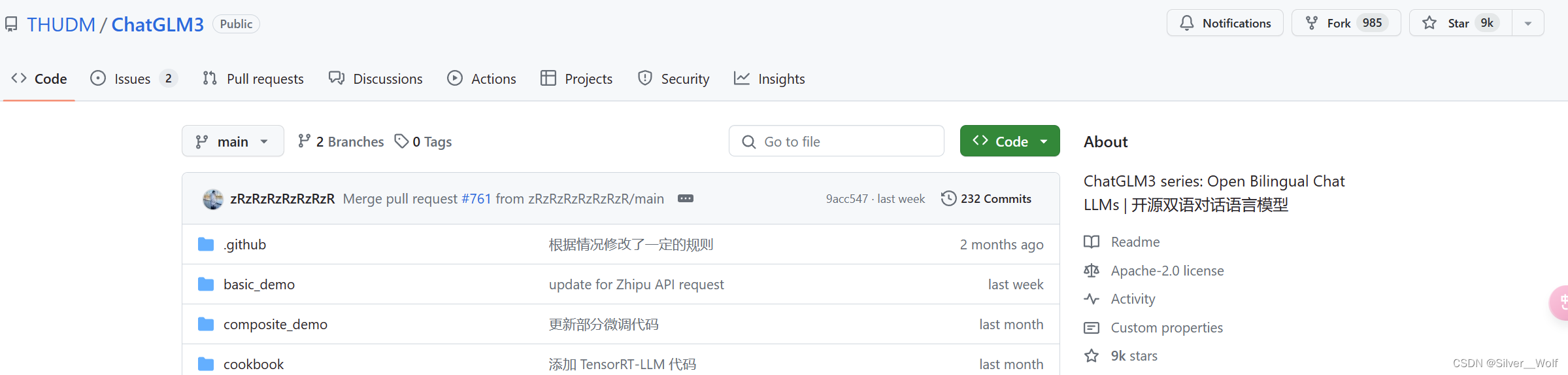

1. github网址,进入网址出现下图,下载代码压缩包

2. 本地解码代码压缩包,并安装依赖环境

pip install -r requirements.txt3. 下载模型文件,官方提供三种下载方式,下载巨慢、巨慢、巨慢(重要的事情说三遍)!

使用 Huggingface 下载模型

git lfs install

git clone https://huggingface.co/THUDM/chatglm3-6b.git

使用 Modelscope 下载模型

git lfs install

git clone https://www.modelscope.cn/ZhipuAI/chatglm3-6b.git

使用 SwanHub 下载模型

git lfs install

git clone https://swanhub.co/ZhipuAI/chatglm3-6b.git运行demo

如果一切安装下载正常,我们就可以开始玩耍了,首先玩的方式有三种,分别是:命令行模式、Gradio模式、Streamlit模式。

1. 命令行模式(cd 进入 basic_demo并打开命令行运行如下语句)

python cli_demo.py效果如下:

2. Gradio模式(cd 进入 basic_demo并打开命令行运行如下语句)

python web_demo_gradio.py效果如下(怎么还跑抽风了。。。):

3. Streamlit模式,比较推荐这个模式,运行起来比较流畅

streamlit run web_demo_streamlit.py效果如下:

结尾

有关于其他的部署细节可以进群问哦

如果觉得文章对你有用请点赞、关注 ->> 你的点赞对我太有用了

群内交流更多技术

130856474 <-- 在这里

307

307

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?