一,认识决策树

1,什么是决策树

决策树思想的来源非常朴素,程序设计中的条件分支结构就是if-then结构,最早的决策树就是利用这类结构分割数据的一种分类学习方法

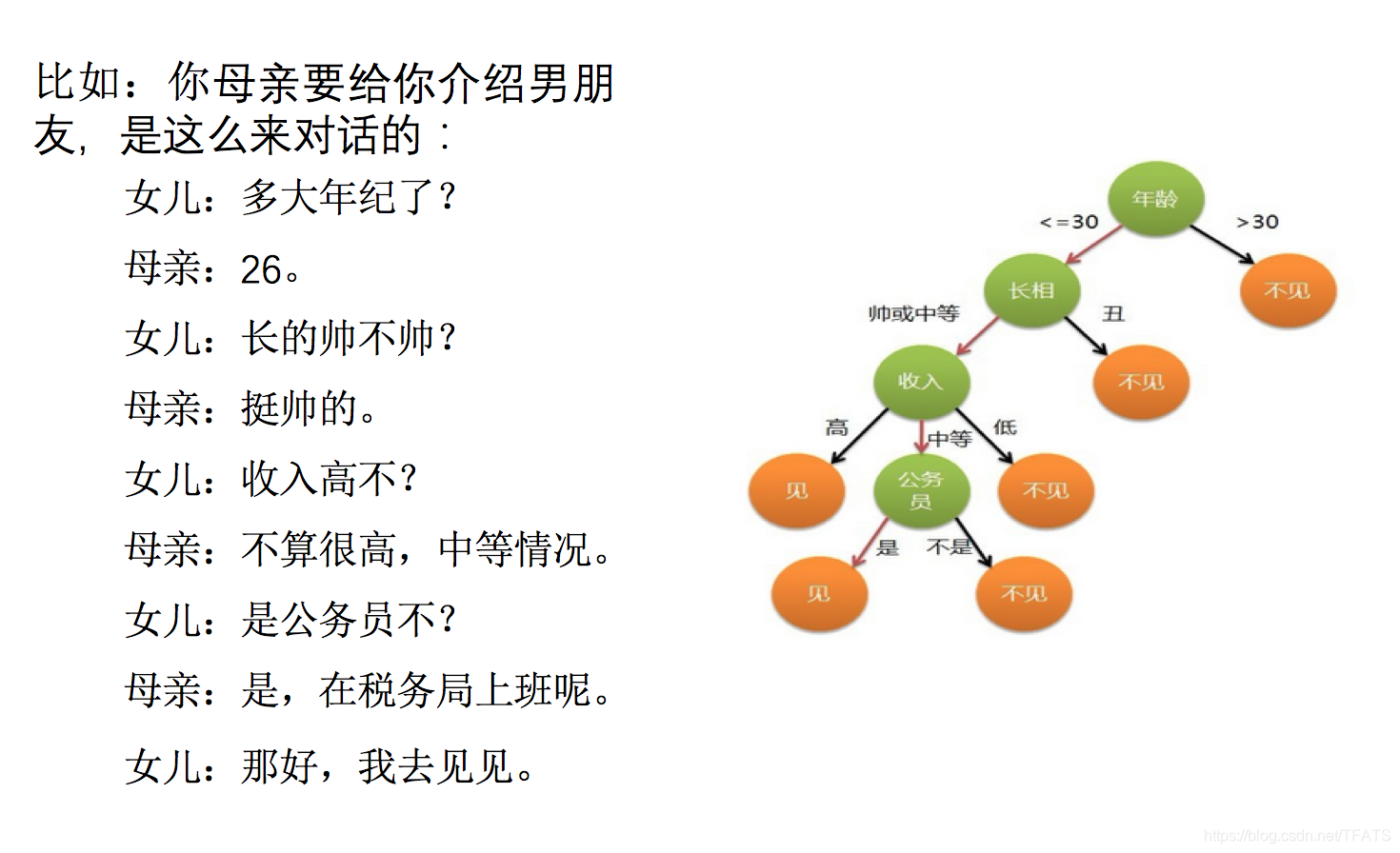

2,理解决策树例子

二,决策树分类原理详解

1,原理

- 信息熵、信息增益等

2,信息熵

1),理解信息熵例子

那来玩个猜测游戏,猜猜这32支球队那个是冠军。并且猜测错误付出代价。

为了使代价最小,可以使用二分法猜测:

我可以把球编上号,从1到32,然后提问:冠 军在1-16号吗?依次询问,只需要五次,就可以知道结果。

我们来看这个式子:

- 32支球队,log32=5比特

- 64支球队,log64=6比特

香农指出,它的准确信息量应该是,p为每个球队获胜的概率(假设概率相等,都为1/32),我们不用钱去衡量这个代价了,香浓指出用比特:

H = -(p1logp1 + p2logp2 + ... + p32log32) = - log32

2)信息熵的定义

- H的专业术语称之为信息熵,单位为比特。

“谁是世界杯冠军”的信息量应该比5比特少,特点(重要):

- 当这32支球队夺冠的几率相同时,对应的信息熵等于5比特

- 只要概率发生任意变化,信息熵都比5比特小

3)总结(重要)

- 信息和消除不确定性是相联系的

当我们得到的额外信息(球队历史比赛情况等等)越多的话,那么我们猜测的代价越小(猜测的不确定性减小)

3,决策树的划分依据之一------信息增益

1) 定义与公式

特征A对训练数据集D的信息增益g(D,A),定义为集合D的信息熵H(D)与特征A给定条件下D的信息条件熵H(D|A)之差,即公式为:

公式的详细解释:

注:信息增益表示得知特征X的信息而息的不确定性减少的程度使得类Y的信息熵减少的程度

2)贷款特征重要计算例子

- 我们以年龄特征来计算:

1、g(D, 年龄) = H(D) -H(D|年龄) = 0.971-[5/15H(青年)+5/15H(中年)+5/15H(老年]

2、H(D) = -(6/15log(6/15)+9/15log(9/15))=0.971

3、H(青年) = -(3/5log(3/5) +2/5log(2/5))

H(中年)=-(3/5log(3/5) +2/5log(2/5))

H(老年)=-(4/5og(4/5)+1/5log(1/5))

我们以A1、A2、A3、A4代表年龄、有工作、有自己的房子和贷款情况。最终计算的结果g(D, A1) = 0.313, g(D, A2) = 0.324, g(D, A3) = 0.420,g(D, A4) = 0.363。所以我们选择A3 作为划分的第一个特征。这样我们就可以一棵树慢慢建立。

4,决策树的三种算法实现

当然决策树的原理不止信息增益这一种,还有其他方法。但是原理都类似,我们就不去举例计算。

- ID3

- 信息增益 最大的准则

- C4.5

- 信息增益比 最大的准则

- CART

- 分类树: 基尼系数 最小的准则 在sklearn中可以选择划分的默认原则

- 优势:划分更加细致。

三,决策树API

- class sklearn.tree.DecisionTreeClassifier(criterion=’gini’, max_depth=None,random_state=None)

- 决策树分类器

- criterion:默认是’gini’系数,也可以选择信息增益的熵’entropy’

- max_depth:树的深度大小

- random_state:随机数种子

- 其中会有些超参数:max_depth:树的深度大小

- 其它超参数我们会结合随机森林讲解

四,案例:泰坦尼克号乘客生存预测

- 泰坦尼克号数据

在泰坦尼克号和titanic2数据帧描述泰坦尼克号上的个别乘客的生存状态。这里使用的数据集是由各种研究人员开始的。其中包括许多研究人员创建的旅客名单,由Michael A. Findlay编辑。我们提取的数据集中的特征是票的类别,存活,乘坐班,年龄,登陆,home.dest,房间,票,船和性别。 - 乘坐班是指乘客班(1,2,3),是社会经济阶层的代表。

- 其中age数据存在缺失。

数据:http://biostat.mc.vanderbilt.edu/wiki/pub/Main/DataSets/titanic.txt

1,分析

- 选择我们认为重要的几个特征 [‘pclass’, ‘age’, ‘sex’]

- 填充缺失值

- 特征中出现类别符号,需要进行one-hot编码处理(DictVectorizer)

- x.to_dict(orient=“records”) 需要将数组特征转换成字典数据

- 数据集划分

- 决策树分类预测

2,代码

import requests

import numpy as np

import pandas as pd

from sklearn.feature_extraction import DictVectorizer

from sklearn.model_selection import train_test_split

from sklearn.tree import DecisionTreeClassifier

from sklearn.tree import export_graphviz

def get_data():

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/74.0.3729.131 Safari/537.36'

}

proxies = {

'http': 'http://web-proxy.tencent.com:8080',

'https': 'http://web-proxy.tencent.com:8080'

}

url = 'http://biostat.mc.vanderbilt.edu/wiki/pub/Main/DataSets/titanic.txt'

res = requests.get(url, proxies=proxies, headers=headers)

with open('tanic.csv', 'wb') as file:

file.write(res.content)

def decision():

'''决策树对于泰坦尼克号进行预测生死'''

# 获取数据

titanic = pd.read_csv('./tanic.csv')

# 处理数据,找出特征值和目标值

x = titanic[['pclass','age','sex']]

y = titanic['survived']

# 缺失值需要处理,将特征当中有类别的这些特征进行字典特征抽取

x['age'].fillna(x['age'].mean(), inplace=True)

# 实例化特征抽取

dict = DictVectorizer(sparse=False)

# 对于x转换成字典数据x.to_dict(orient="records")

x = dict.fit_transform(x.to_dict(orient="records"))

# 分割训练集合测试集

x_train, x_test, y_train, y_test = train_test_split(x, y, test_size=0.3)

# 进行决策树的建立和预测

dc = DecisionTreeClassifier(max_depth=5)

dc.fit(x_train, y_train)

export_graphviz(dc, out_file="./tree.dot",feature_names=['age', 'pclass=1st', 'pclass=2nd', 'pclass=3rd', '女性', '男性'])

print("预测的准确率为:", dc.score(x_test, y_test))

return None

if __name__ == '__main__':

get_data()

decision()

3,保存树的结构到dot文件

- 1、sklearn.tree.export_graphviz() 该函数能够导出DOT格式

- tree.export_graphviz(estimator,out_file='tree.dot’,feature_names=[‘’,’’])

- 2、工具:(能够将dot文件转换为pdf、png)

- 安装graphviz

- ubuntu:sudo apt-get install graphviz Mac:brew install graphviz

- 3、运行命令

- 然后我们运行这个命令

- dot -Tpng tree.dot -o tree.png

export_graphviz(dc, out_file="./tree.dot", feature_names=['age', 'pclass=1st', 'pclass=2nd', 'pclass=3rd', '女性', '男性'])

五, 决策树总结

- 优点:

- 简单的理解和解释,树木可视化。

- 缺点:

- 决策树学习者可以创建不能很好地推广数据的过于复杂的树,这被称为过拟合。

- 改进:

- 减枝cart算法(决策树API当中已经实现,随机森林参数调优有相关介绍)

- 随机森林

注:企业重要决策,由于决策树很好的分析能力,在决策过程应用较多, 可以选择特征。

3217

3217

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?