1. (arxiv)Comparison-based Image Quality Assessment for Parameter Selection

这是一篇不太一样的IQA论文,实验部分没有拿出CC,说了一些一眼看不明白的话,以及统计图

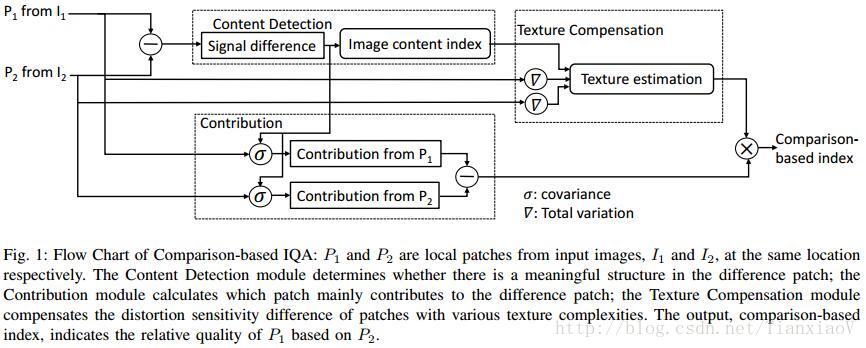

特点是它输入了两张图,I2从I1而来,比传统NR有更多信息量,但没用参考图又不算FR。然后还有就是通过调参数是的框架迭代速度快了80%。

2. (arxiv)Deep Neural Networks for No-Reference and Full-Reference Image Quality Assessment

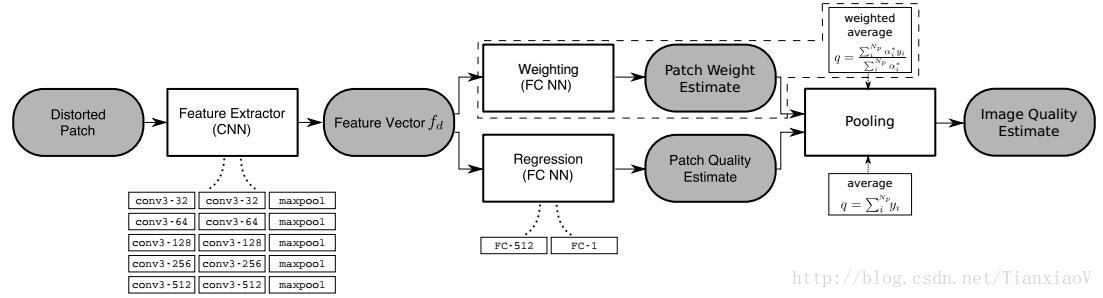

首先,在质评领域中它是一个很深的方法,包含了10个卷基层,5个池化层提取特征,2个全连接层回归;然后这个框架既可以做FR,也可以做NR;最后我们是纯数据计算暴力破解,不需要任何HVS和统计学先验知识,也不需要手动特征提取。

训练和评价过程中仍然是分块的,最后平均池化,这其中引入了空间注意力为失真图加权。

这篇文章里对LIVE、CSIQ和TID2013的纵向比较、交叉验证数据挺多的,以后写论文的时候可能用得上,唉暴力计算的效果真的是不错啊

3. (arxiv)Learning a No-Reference Quality Metric for Single-Image Super-Resolution

这里建立了一个SR人工视觉主观数据库,然后从视觉感知的角度(就是单纯当换了一个库的IQA了)建立了一种NR-SR质量评价方法

我有点想不清楚超分辨为什么需要NRIQA,直接FR找出最好的SR方法后运用就行了,真的有NR的需求吗?32页看不动。。

4. (arxiv)On the Use of Deep Learning for Blind Image Quality Assessment

这篇文章提出了一种DeepBIQ的方法,特点是用了两次CNN,开始用CNNs对图像进行预训练提取失真类型描述特征,再把图像块输入适合质评的CNN提取特征,根据输出特征用SVR回归MOS。

给我了一点启发,一是看看有人用深度学习计算过VA吗,二是它先用CNNS在预训练过程中按失真分类,我是不是也可以先按失真对VA的影响做个分类?还有可能结合语义识别,先把图像按主要内容分类

**要仔细重读 **

然后最后的结果是不是过于高了?如果不是真那么完美的话,我猜测可能是对每一类失真分别训练,或者100%训练过?回头再看看

本文汇总了2016年关于图像质量评估的多篇研究论文,涉及无参考(IQA)和全参考(FR-IQA)方法。论文中探讨了深度学习在IQA中的应用,如CNN模型用于特征提取和质量预测,以及通过结构信息、颜色分布、高阶导数等特征进行质量评估。研究还包括了新型的BIQA方法,如基于结构退化的评估和利用循环注意力模型。此外,一些论文提出了新数据库和比较方法,以改进现有IQA模型的性能和现实世界适用性。

本文汇总了2016年关于图像质量评估的多篇研究论文,涉及无参考(IQA)和全参考(FR-IQA)方法。论文中探讨了深度学习在IQA中的应用,如CNN模型用于特征提取和质量预测,以及通过结构信息、颜色分布、高阶导数等特征进行质量评估。研究还包括了新型的BIQA方法,如基于结构退化的评估和利用循环注意力模型。此外,一些论文提出了新数据库和比较方法,以改进现有IQA模型的性能和现实世界适用性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?