未来的战场将是动态的、混乱的、不可预测的和不确定的。在这种多战区、多领域、相互关联的战场上,指挥官和参谋人员将从大量数据中筛选信息、做出决策和反馈。在克劳塞维茨战争迷雾笼罩下的时间有限的作战环境中,领导者有效而公正的决策,以及由人类和机器/系统组成的团队协调一致的行动,将是取得简洁胜利的助推器。决策的速度和复杂程度预计将超越人类的认知水平。最新技术和新兴技术提供的能力将为各个领域的决策者和部队提供帮助,同时国家和非国家行为者也将在这些领域同时展开争夺战。著名的 OODA 循环在 "观察"、"定位"、"决策 "和 "行动 "的每个阶段都将有技术辅助投入。大数据和推理分析的更快处理能力以及算法驱动的机器对输入的无缝整合将简化与大数据的五个Vs(即数量、速度、真实性、价值和多样性)相关的复杂性。

人工智能(Artificial Intelligence 或 AI)是计算机科学的一个分支,它汇集了多个学科,旨在创造智能机器--能够执行复杂任务的设备和系统,如人类智能所执行的任务,但其方式等同于或超越人类的能力。从根本上说,其目的是制造能够在各种意义上复制人类行为和智能的智能机器。正如我们所知,在人工智能的三种类型(人工狭义智能、人工通用智能和人工超级智能)中,目前的能力是 "人工狭义智能 "或 "弱人工智能",即机器或系统(如 Alexa 或 Siri)可以重复执行一系列预先确定和定义的活动。在日常生活中,我们与大数据、机器学习等与人工智能相关的集合或子集合中的一个进行交互,尽管所有集合或子集合都被松散地称为人工智能。即使关于人工智能获得过多自由的伦理争论仍在继续,人工智能的奇点预计将在二十年后出现,但诸如 ChatGPT、蜂群无人机、钢铁侠、无人驾驶自动汽车等话题仍在人工智能文盲的阅读清单上。

美国、中国和俄罗斯等国已经在人工智能的各个领域,包括军事能力领域取得了飞速发展。与 1997 年 "深蓝 "击败卡斯帕罗夫或 2016 年 Deepmind 的 AlphaGo 击败李世石相比,2020 年 8 月王牌 F16 飞行员与人工智能系统 "猎鹰"(美国国防部高级研究计划局(DARPA)的空战进化(ACE)计划)的模拟空战等试验或事件受到了更多关注。印度已经采取了一系列措施来开发和利用人工智能的能力,其中包括建立一个国家级的机构,并在各研究所建立卓越中心。2018 年,NITI Aayog 发布了《国家人工智能战略 #AIForAll》,随后在 2020 年建立了国家人工智能门户网站,此外还有其他各种举措。国防人工智能委员会和国防人工智能项目机构已经成立,目前正在努力确定和开发各个领域的项目。印度国防与发展研究组织(DRDO)的十个卓越中心和两个专门实验室致力于确定和开发关键技术与应用,而印度陆军则在莫霍(Mhow)的MCTE建立了人工智能卓越中心,并在各培训机构增设了以人工智能为导向的课程。除了各种研讨会,印度陆军最近还宣布了采购喷气背包、机器人骡子、无人机系统和干扰器等武器的计划,以期提高其在战斗中的优势。

在武装部队中,人工智能和相关能力可用于成倍提高训练、监视、情报整理、后勤(包括供应链管理)、网络安全、武器弹药等领域的性能。Manekshaw 关于 "将人工智能用于军事 "的论文提到了人工智能可以重点关注的态势感知、杀伤力、人力资源(HR)、培训、生存能力、网络、信息和电子战(EW)以及机动性等领域。可以推测,纳入人工智能系统和子系统(包括无人驾驶系统、远程系统和机器人)的目的是:

加强信息优势(例如:提供对手位置的航拍照片;整合来自结构化和非结构化数据的输入)。

减少认知负荷(例如:在交火中识别新目标并提出目标选择建议)。

承担物理负荷(例如:携带沉重的作战装备或以外骨骼的形式协助人类)。

处理危险任务(例如:在危险区域运送物资或进行医疗后送)。

随着武装部队融入和利用人工智能的方方面面,一个明显的表现将是在战斗或作战效能领域。战斗力被定义为一支军事部队基于行为、行动和领导力等方面的考虑参与战斗的准备状态,是部队(人数)、装备可用性、士气、领导力、训练标准等有形和无形因素的综合。换言之,它是一支军队成功完成其使命或任务的能力。

然而,目前的想法对两个重要且相互关联的方面却只字未提,而这两个方面可能会影响战斗力,同时还包含人工智能的各个方面,即 "信任 "和 "偏见"。即使技术不断进步,智能水平从 "辅助 "到 "增强 "再到 "自主",不变的是 "人的因素 "或 "回路中的人"。组织文化、年龄、性别等因素将影响新技术进步在不同组织中被人类接受的方式。人、流程和技术这三大支柱必须与积极的反馈机制无缝结合,以确保任何形式的偏见,无论是被动的还是主动的,都不会表现出来,从而影响信任度和效率。

信任

人机协作是一种关系,至少由三个同等重要的要素组成:人、机器以及它们之间的互动和相互依存关系。建立透明、可解释、可靠并具有其他特征和能力的可信人工智能,是创建高效人机团队的重要组成部分。人机交互的复杂动态是未来的趋势,这将要求增强对机器的信任,就像同一团队中两名士兵之间的信任一样。在任何战斗单位或分队或可称为团队的单位中,每个队员在一起接受过训练,都知道对方的长处和短处。团队成员之间的友情和团队精神,最终使团队成为一个具有战斗力的凝聚单位。团队成员之间的 "信任 "远比其他任何因素都重要,这是在敌方火力下行动时必须具备的条件,因为在这种情况下,一个人的生命取决于另一个人的火力掩护或支援。

随着复杂程度和互动的增加,对人际(人-机和人-系统)信任的需求也会增加,而在人与人的关系中,这种信任取决于相关各方的品格和能力,以及他们对这一点的相互认识。尽管在开发系统时,"信任 "是一个难以考虑的因素,但我们可以做的是提高系统的透明度、可靠性和可解释性,从而在人机协作中建立信任。在这样一个有凝聚力的团队中引入一台机器,一个不露面、没有感情的成员,会影响信任因素。人类的传统习惯是拟人化,即把人类的情感赋予其他生物,这在饲养宠物的家庭中很常见。如果一台机器能表现出类似人类的特征、习惯和情感,那么它就更有可能赢得团队的信任。

一项关于人机协作的研究指出,协调、沟通和适应是成功团队成员的三大关键能力。双向沟通是一个重要方面,因此,可解释的人工智能或 xAI 正在解决使用深度神经网络的复杂系统透明度降低的问题。有效的沟通还能建立信任。协调则更多地涉及对团队成员知识、技能和行为的认可,以实现共同目标。目前,这一能力的一个主要弱点是隐式协调,即团队成员可以根据他人的行为模式预测他人可能会做什么,这超出了具有明确框架和规则的机器的范围。也许 "心智理论人工智能 "也能满足这一要求。在适应方面,人机团队的每个成员都必须根据已知的知识、队友的行为以及预期的模式进行适应。这是另一个方面,它将要求目前的第一代(基于知识)和第二代(统计)人工智能系统向第三代(因果和上下文)模型转变。大规模数据集的可用性以及具有共享态势感知和经验的关联系统将帮助系统更快地适应环境。

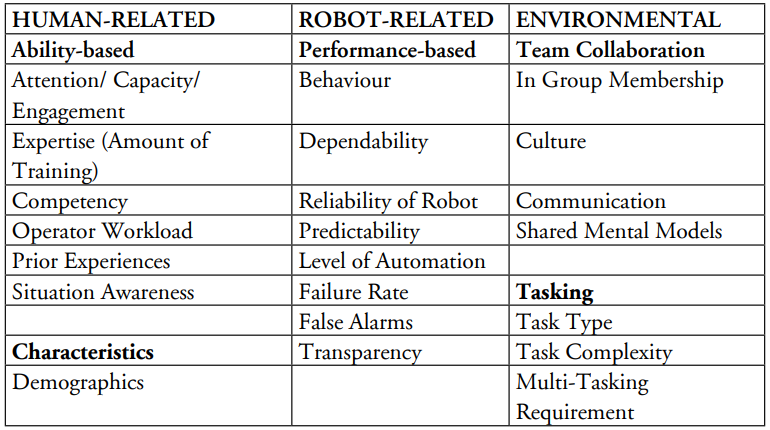

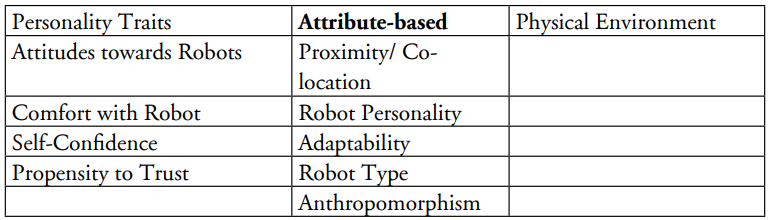

另一项关于人机交互中影响信任的因素的研究在人类、机器人和环境三个方面确定了 33 个因素(见表 1)。研究显示,在所有因素中,机器人的表现对建立信任的贡献最大,而环境也发挥了相当大的作用。正如信任是如何在纯人类团队中形成的一样,相信人工智能辅助机器人或系统将提供无偏见的高质量产出或性能,也将在人机团队中建立信任。

表 1 影响人机交互信任的因素

偏差

建议

结论

【完整内容请上专知查阅】

专知便捷查看

便捷下载,请关注专知智能防务公众号(点击上方关注)

点击“发消息” 回复 “AIHMT” 就可以获取《中文版《军事人工智能与人机协作》2023最新报告》专知下载链接

欢迎微信扫一扫加专知助手,咨询使用专知,定制服务合作!

专知,专业可信的人工智能知识分发,让认知协作更快更好!欢迎注册登录专知www.zhuanzhi.ai,获取70000+AI(AI与军事、医药、公安等)主题干货知识资料!

点击“阅读原文”,了解使用专知,查看获取100000+AI主题知识资料

621

621

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?