我们以一个实例来讲述scrapy框架的用法,利用scrapy爬取豆瓣电影Top250的电影名称,链接,评分

第一步

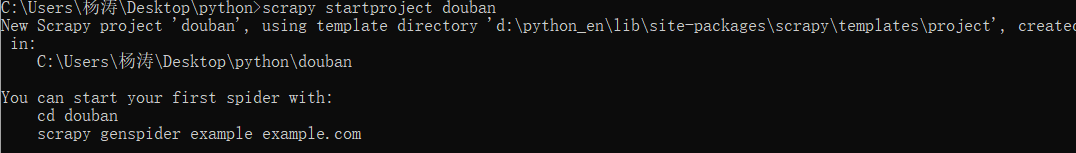

创建一个scrapy框架的项目,打开终端输入scrapy startproject douban

我是在桌面的python文件夹中创建的,创建好之后打开文件夹你会看到一个douban的文件夹,说明创建成功,然后我们在编译器中打开文件夹

spiders是放置爬虫的目录。即在spider目录下创建爬虫文件

items.py是用来定义数据类型

middlewares.py定义爬取时的中间件

pipelines.py定义数据管道

settings.py配置文件,也就是将爬取的信息保存

下面在spiders目录下创建爬虫文件

与平时写爬虫不同,使用框架时要先定义数据类型,即要爬取什么数据都要将它定义出来,然后再进行爬取,所以先在item.py定义数据类型,我们爬取三个数据,电影名称,评分,和链接。

所以在item.py文件里写入数据类型

接下来就可以在爬虫文件内编写爬虫代码了,爬虫代码如下,逐行有解释

import bs4,scrapy

本文介绍了如何使用Python的Scrapy框架爬取豆瓣电影Top250的电影名称、评分和链接。首先通过`scrapy startproject douban`创建项目,接着在`items.py`定义数据类型,然后在spiders目录下编写爬虫代码,并在`settings.py`中设置user-agent和忽略robots.txt协议。运行`scrapy crawl douban`启动爬虫,成功获取并输出电影信息。

本文介绍了如何使用Python的Scrapy框架爬取豆瓣电影Top250的电影名称、评分和链接。首先通过`scrapy startproject douban`创建项目,接着在`items.py`定义数据类型,然后在spiders目录下编写爬虫代码,并在`settings.py`中设置user-agent和忽略robots.txt协议。运行`scrapy crawl douban`启动爬虫,成功获取并输出电影信息。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

579

579

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?