雷锋网注:何凯明博士,2007年清华大学毕业之后开始在微软亚洲研究院(MSRA)实习,2011年香港中文大学博士毕业后正式加入MSRA,目前在Facebook AI Research (FAIR)实验室担任研究科学家。曾以第一作者身份拿过两次CVPR最佳论文奖(2009和2016)——其中2016年CVPR最佳论文为图像识别中的深度残差学习(Deep Residual Learning for Image Recognition),本文为何凯明博士在ICML2016上的tutorial演讲以及相关PPT整理。相比学术论文,他在演讲PPT中深入浅出地描述了深度残差学习框架,大幅降低了训练更深层次神经网络的难度,也使准确率得到显著提升。

深度残差网络——让深度学习变得超级深

ICML 2016 tutorial

何凯明——Facebook AI Research(8月加入)

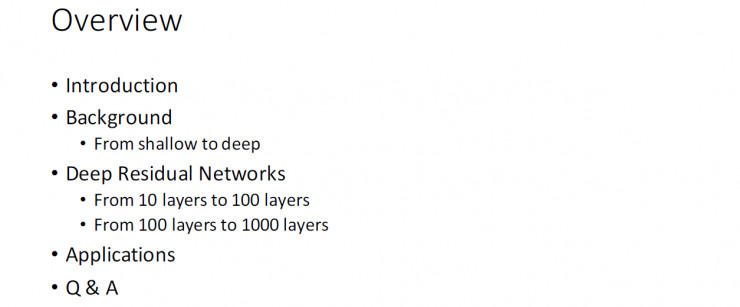

概览

-

介绍

-

背景

从浅到深

-

深度残差网络

从10层到100层

从100层到1000层

-

应用

-

Q & A

| 介绍部分

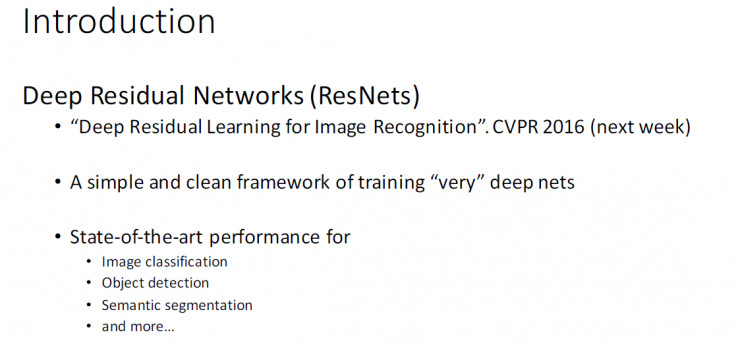

介绍——深度残差网络(Resnet)

-

“用于图像识别的深度残差学习” CVPR2016

-

一个能够用来训练“非常深”的深度网络又十分简洁的框架

-

在以下几个领域中都能实现当下最好的表现

图像分类

对象检测

语义分割

等等

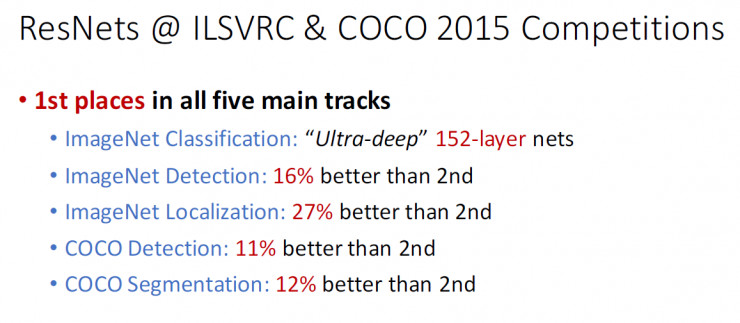

Resnet在ILSVRC 和COCO 2015上的表现

在五个主要任务轨迹中都获得了第一名的成绩

ImageNet分类任务:“超级深”的152层网络

ImageNet检测任务:超过第二名16%

ImageNet定位任务:超过第二名27%

COCO检测任务:超过第二名11%

COCO分割任务:超过第二名12%

何凯明博士的深度残差学习框架让训练深度神经网络变得简单,解决了深度网络层数增加导致的精度下降问题。Resnet在ILSVRC和COCO 2015比赛中表现出色,152层网络取得分类任务3.57%的错误率。Resnet通过残差块解决了优化难题,允许网络逐层深入学习。

何凯明博士的深度残差学习框架让训练深度神经网络变得简单,解决了深度网络层数增加导致的精度下降问题。Resnet在ILSVRC和COCO 2015比赛中表现出色,152层网络取得分类任务3.57%的错误率。Resnet通过残差块解决了优化难题,允许网络逐层深入学习。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?