我自己是在Linux下出现了这个问题

解决

加入local_files_only=True。参考官方:https://huggingface.co/docs/transformers/installation#offline-mode

另外要注意

原文:https://github.com/huggingface/transformers/issues/13674

The path for the AutoModel should be to a directory pointing to a pytorch_model.bin and to a config.json. Since you’re pointing to the .bin file directly, the configuration cannot be loaded.

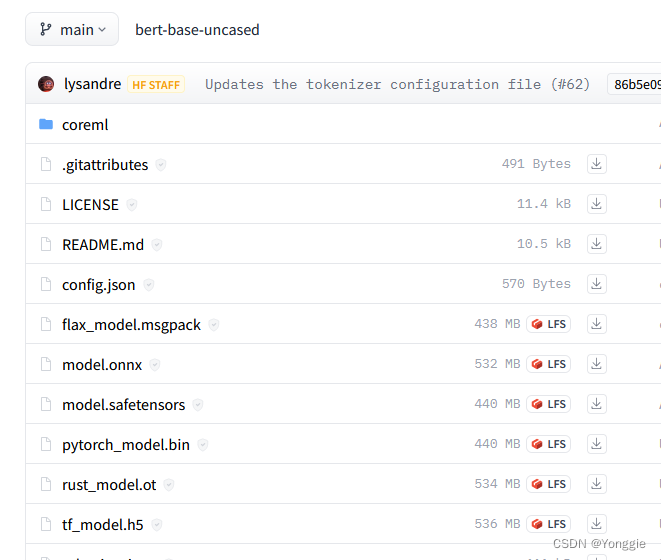

也就是除了model文件之外,还要有一个config.json文件在旁边,2个是要一起的。有一些不光要config.json,还有其他的文件,多下点,都放上。

下面的config.json和符合框架的model文件。

总结

把所有的文件下砸完之后,再在from pretrain里面加上··local_files_only=True:

model = xxx.from_pretrained("./path/to/local/directory", local_files_only=True)

29万+

29万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?