零、本节学习目标

- Spark开发环境准备工作

- 了解Spark的三种部署方式

- 搭建Spark单机版环境

- 搭建Spark Standalone集群

- 体验第一个Spark程序

- 在Spark Shell里基本操作

- 初识弹性分布式数据集RDD

一、Spark开发环境准备工作

- 由于Spark仅仅是一种计算框架,不负责数据的存储和管理,因此,通常都会将Spark和Hadoop进行统一部署,由Hadoop中的HDFS、HBase等组件负责数据的存储管理,Spark负责数据计算。

- 安装Spark集群前,需要安装Hadoop环境

二、了解Spark的部署模式

(一)Standalone模式

- Standalone模式被称为集群单机模式。该模式下,Spark集群架构为主从模式,即一台Master节点与多台Slave节点,Slave节点启动的进程名称为Worker,存在单点故障的问题。

(二)Mesos模式

- Mesos模式被称为Spark on Mesos模式。Mesos是一款资源调度管理系统,为Spark提供服务,由于Spark与Mesos存在密切的关系,因此在设计Spark框架时充分考虑到对Mesos的集成。

(三)Yarn模式

- Yarn模式被称为Spark on Yarn模式,即把Spark作为一个客户端,将作业提交给Yarn服务。由于在生产环境中,很多时候都要与Hadoop使用同一个集群,因此采用Yarn来管理资源调度,可以提高资源利用率。

三、搭建Spark单机版环境

(一)前提是安装配置好了JDK

- 查看JDK版本

(二)下载、安装与配置Spark

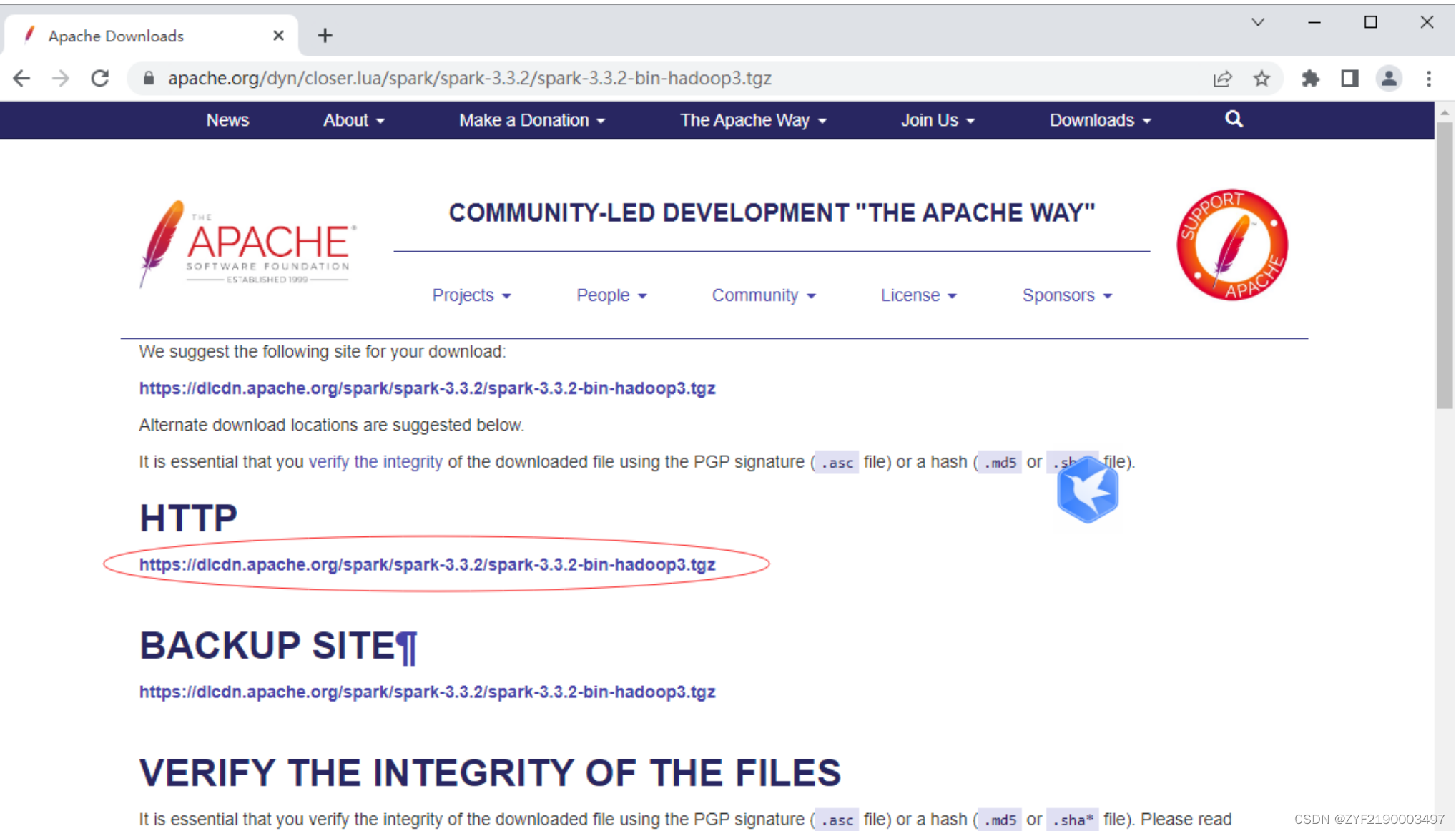

1、下载Spark安装包

- 官网下载页面:Downloads | Apache Spark

- 下载链接:Apache Downloads

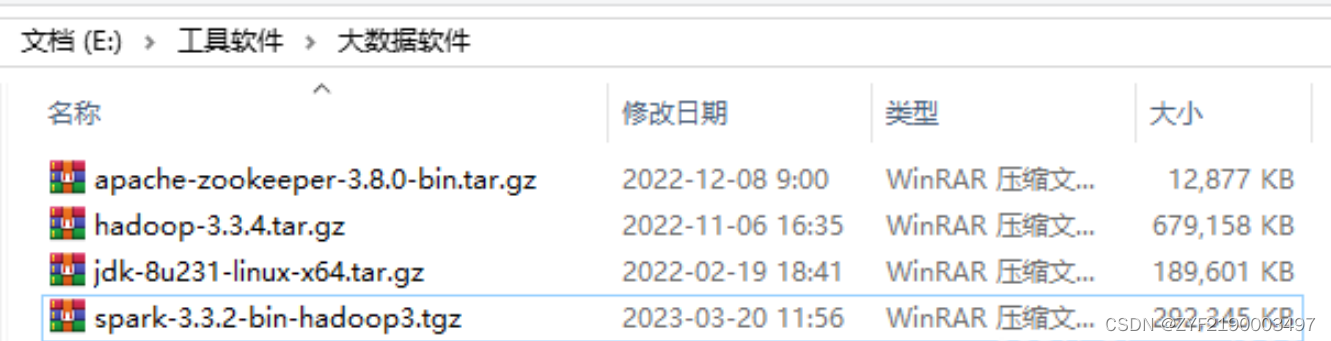

- 下载到本地

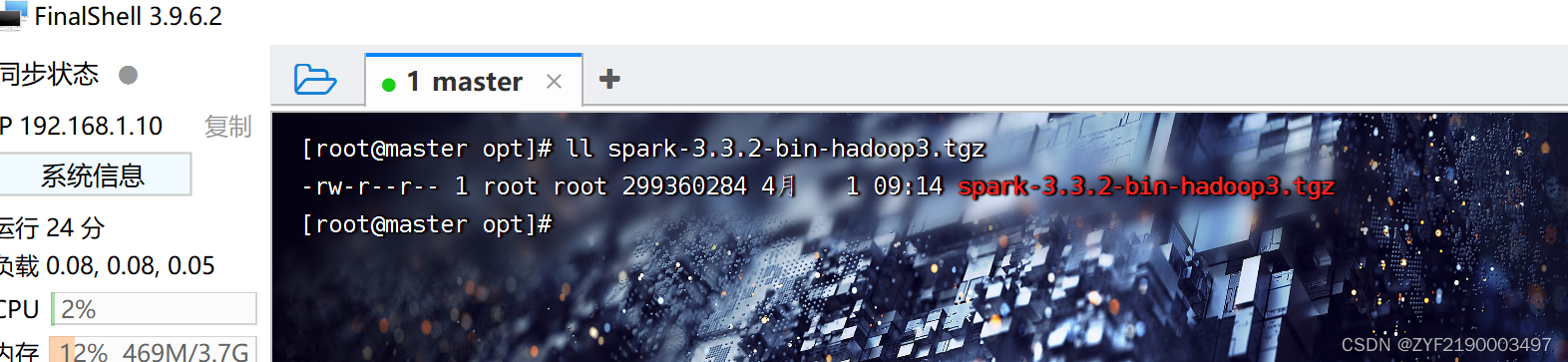

2、将Spark安装包上传到虚拟机

- 将Spark安装包上传到ied虚拟机

/opt目录

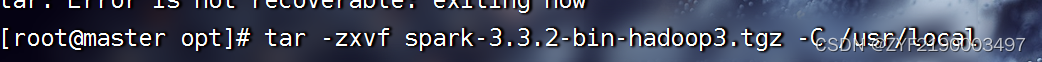

3、将Spark安装包解压到指定目录

-

执行命令:

tar -zxvf spark-3.3.2-bin-hadoop3.tgz -C /usr/local

- 查看解压之后的spark目录

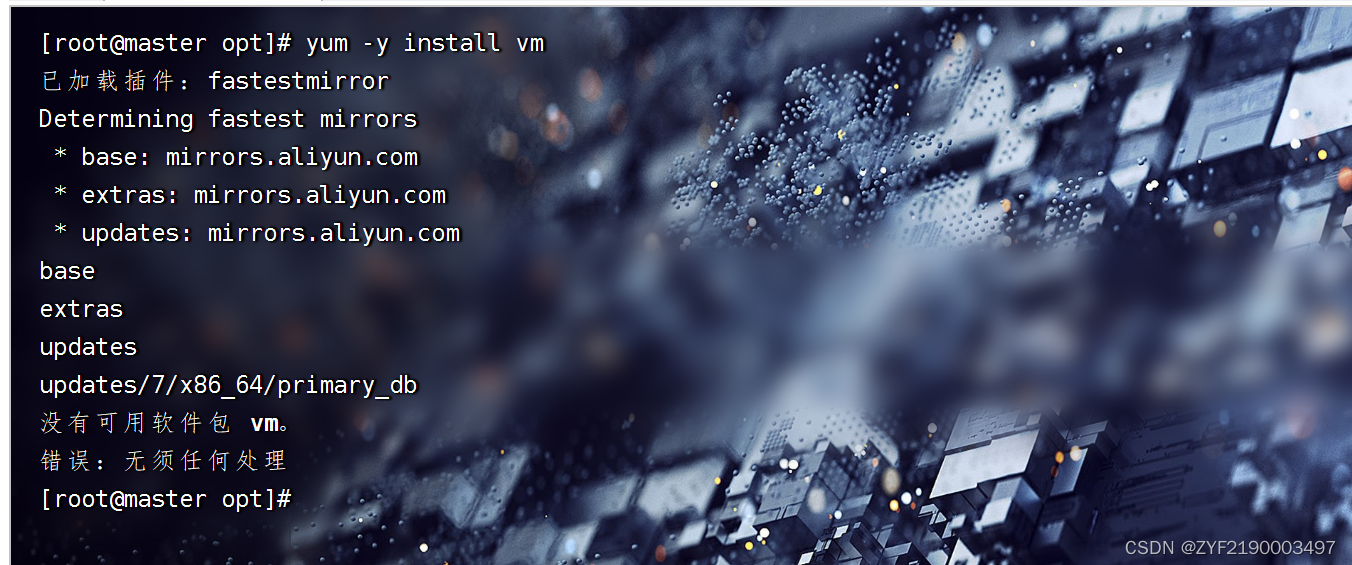

下载一个VM

4、配置Spark环境变量

- 执行

vim /etc/profile

export SPARK_HOME=/usr/local/spark-3.3.2-bin-hadoop3

export PATH=$SPARK_HOME/bin:$SPARK_HOME/sbin:$PATH

- 存盘退出,执行命令:

source /etc/profile,让环境配置生效

(三)使用Spark单机版环境

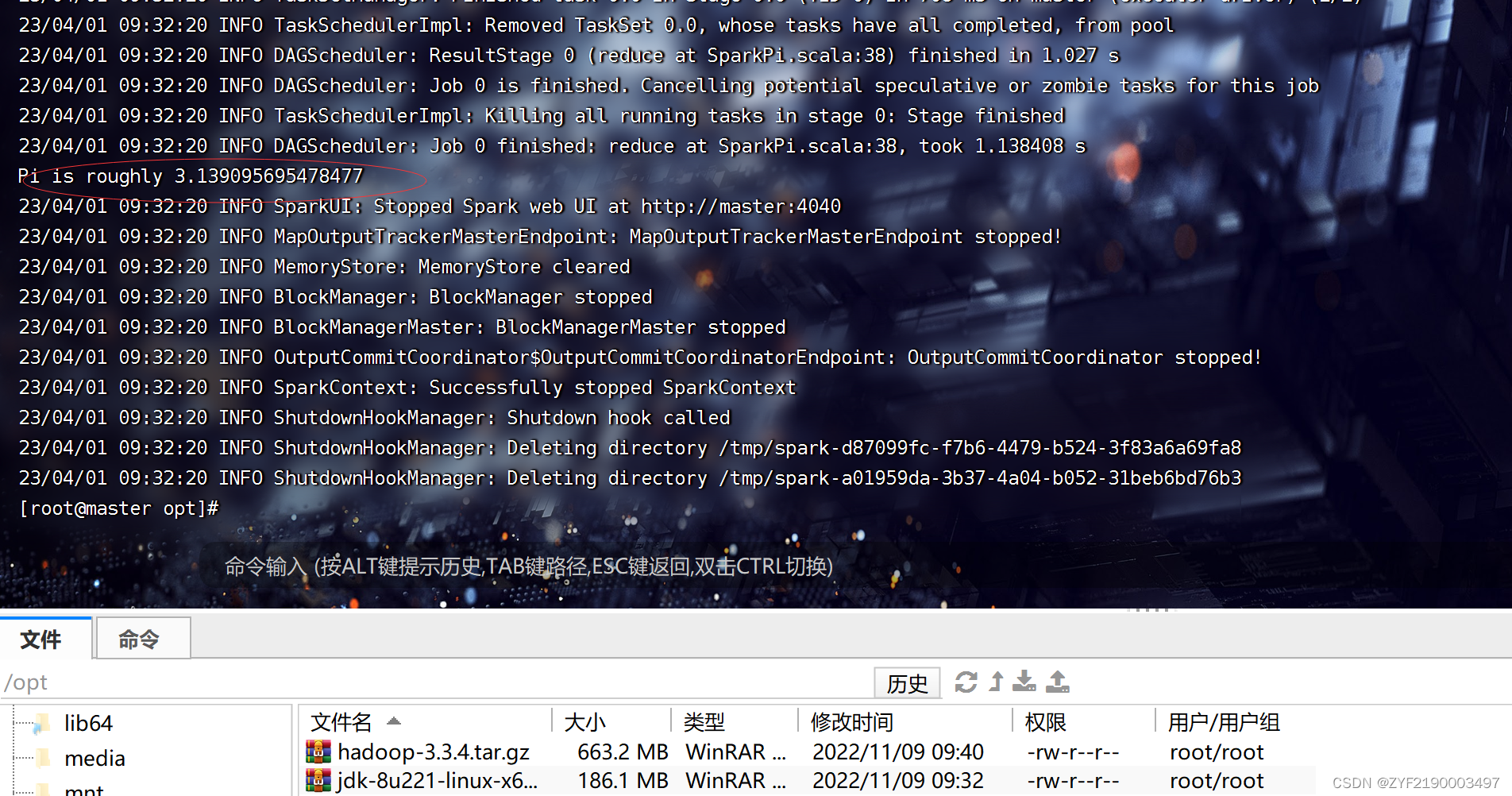

1、使用SparkPi来计算Pi的值

- 执行命令:

run-example SparkPi 2(其中参数2是指两个并行度)

查看运行结果:Pi is roughly 3.139095695478477

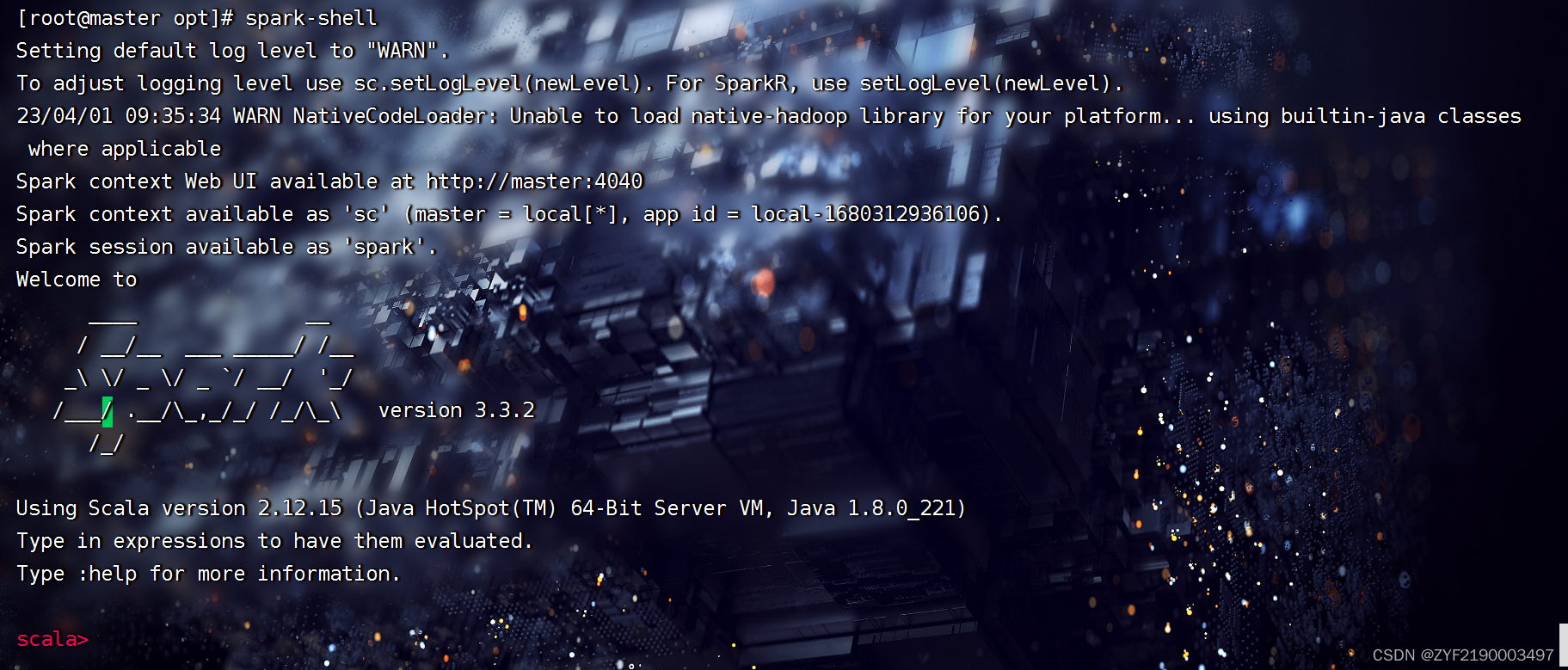

2、使用Scala版本Spark-Shell

- Spark-Shell是一个强大的交互式数据分析工具,初学者可以很好的使用它来学习相关API,用户可以在命令行下使用Scala编写Spark程序,并且每当输入一条语句,Spark-Shell就会立即执行语句并返回结果,这就是我们所说的REPL(Read-Eval-Print Loop,交互式解释器),Spark-Shell支持Scala和Python。

- 命令格式:spark-shell --master <master-url>

- --master表示指定当前连接的Master节点

- <master-url>用于指定Spark的运行模式

- 执行

spark-shell命令,相当于执行spark-shell --master local[*]命令,启动Scala版的Spark-Shell

- 访问Spark的Web UI界面 -

http://ied:4040

-

注意:Spark 3.3.2使用的Scala版本其实是2.12.15

-

利用print函数输出了一条信息

-

计算1 + 2 + 3 + …… + 100

-

输出字符直角三角形

- 打印九九表

- 执行

:quit命令,退出Spark Shell交互式环境

3、使用Python版本Spark-Shell

- 执行

pyspark命令启动Python版的Spark-Shell

- 执行命令:

yum -y install python3

- 执行命令:

pyspark

- 输出一条信息,进行加法运算,然后退出交互式环境

-

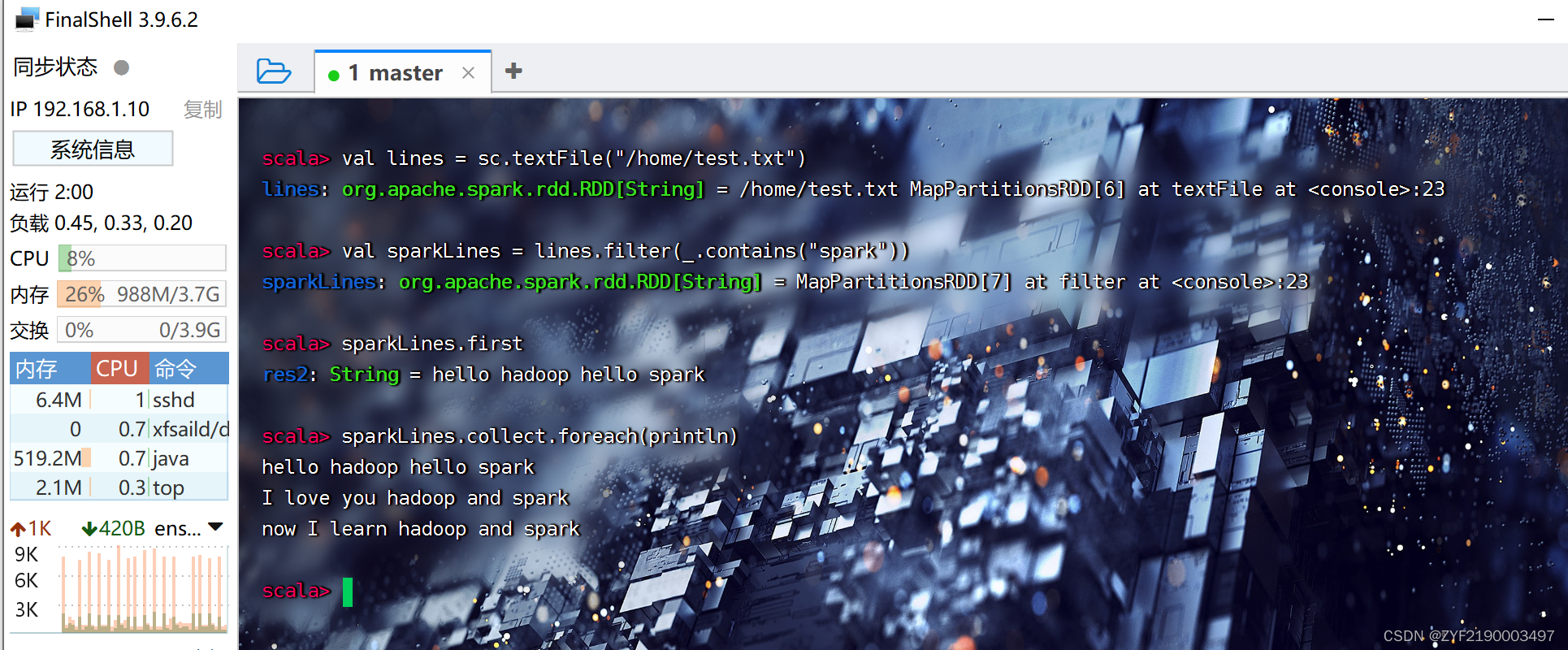

4、初识弹性分布式数据集RDD

- Spark 中的RDD (Resilient Distributed Dataset) 就是一个不可变的分布式对象集合。每个RDD 都被分为多个分区,这些分区运行在集群中的不同节点上。RDD 可以包含Python、Java、Scala 中任意类型的对象,甚至可以包含用户自定义的对象。用户可以使用两种方法创建RDD:读取一个外部数据集,或在驱动器程序里分发驱动器程序中的对象集合(比如list 和set)。

- 演示利用集合创建RDD

- 在

/home目录下创建test.txt文件

例1、创建一个RDD

-

在pyspark命令行,执行命令:

lines = sc.textFile('/home/test.txt') -

创建出来后,RDD 支持两种类型的操作: 转化操作(

transformation) 和行动操作(action)。转化操作会由一个RDD 生成一个新的RDD。另一方面,行动操作会对RDD 计算出一个结果,并把结果返回到驱动器程序中,或把结果存储到外部存储系统(如HDFS)中。

例2、调用转化操作filter()

- 执行命令:

sparkLines = lines.filter(lambda line: 'spark' in line)

例3、调用行动操作first()

- 执行命令:

sparkLines.first() - 转化操作和行动操作的区别在于Spark 计算RDD 的方式不同。虽然你可以在任何时候定义新的RDD,但Spark 只会惰性计算这些RDD。它们只有第一次在一个行动操作中用到时,才会真正计算。这种策略刚开始看起来可能会显得有些奇怪,不过在大数据领域是很有道理的。比如,看看例2 和例3,我们以一个文本文件定义了数据,然后把其中包含spark的行筛选出来。如果Spark 在我们运行lines = sc.textFile(...) 时就把文件中所有的行都读取并存储起来,就会消耗很多存储空间,而我们马上就要筛选掉其中的很多数据。相反, 一旦Spark 了解了完整的转化操作链之后,它就可以只计算求结果时真正需要的数据。事实上,在行动操作first() 中,Spark 只需要扫描文件直到找到第一个匹配的行为止,而不需要读取整个文件。

- 如果要显示全部包含spark的行,执行命令:sparkLines.collect()

- 同样的任务,在Scala的Spark Shell里完成

- 补充练习:利用Spark RDD实现词频统计

- 在spark-shell里完成

在pyspark里完成

但是执行wc1.collect()就会报错,目前没有解决问题。

四、搭建Spark Standalone集群

(一)Spark Standalone架构

- Spark Standalone模式为经典的Master/Slave(主/从)架构,资源调度是Spark自己实现的。在Standalone模式中,根据应用程序提交的方式不同,Driver(主控进程)在集群中的位置也有所不同。应用程序的提交方式主要有两种:client和cluster,默认是client。可以在向Spark集群提交应用程序时使用--deploy-mode参数指定提交方式。

(二)Spark集群拓扑

1、集群拓扑

- 一个主节点,两个从节点

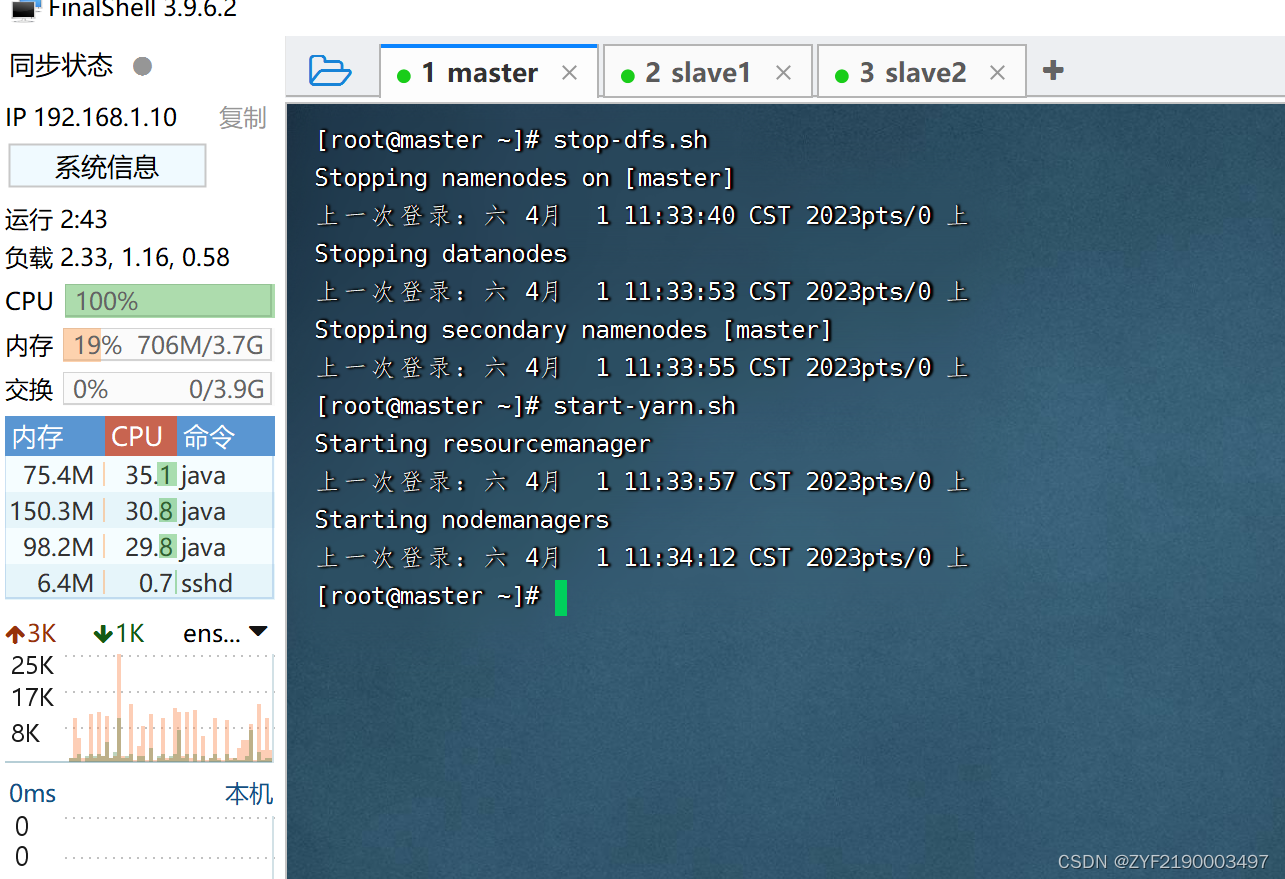

(三)前提条件:安装配置了分布式Hadoop环境

- 启动hadoop集群

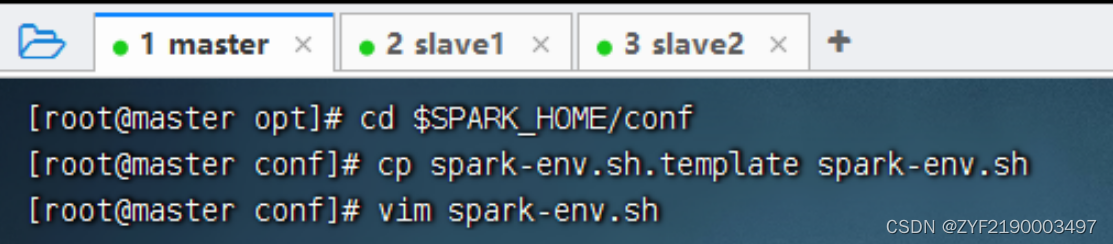

4、编辑spark环境配置文件

- 进入spark配置目录后,执行命令:

cp spark-env.sh.template spark-env.sh与vim spark-env.sh

添加三行语句

export JAVA_HOME=/usr/local/jdk1.8.0_221

export SPARK_MASTER_HOST=master

export SPARK_MASTER_PORT=7077

- JAVA_HOME:指定JAVA_HOME的路径。若集群中每个节点在/etc/profile文件中都配置了JAVA_HOME,则该选项可以省略,Spark集群启动时会自动读取。为了防止出错,建议此处将该选项配置上。

- SPARK_MASTER_HOST:指定集群主节点(master)的主机名,此处为master。

- SPARK_MASTER_PORT:指定Master节点的访问端口,默认为7077。

- 存盘退出,执行命令:source spark-env.sh,让配置生效

(五)在slave1虚拟机上安装配置Spark

1、把master虚拟机上安装的spark分发给slave1虚拟机

- 执行命令:

scp -r $SPARK_HOME root@slave1:$SPARK_HOME

分发到slave2

(七)启动Spark Standalone集群

-

Spark Standalone集群使用Spark自带的资源调度框架,但一般我们把数据保存在HDFS上,用HDFS做数据持久化,所以Hadoop还是需要配置,但是可以只配置HDFS相关的,而Hadoop YARN不需要配置。启动Spark Standalone集群,不需要启动YARN服务,因为Spark会使用自带的资源调度框架。

1、启动hadoop的dfs服务

- 在master虚拟机上执行命令:

start-dfs.sh

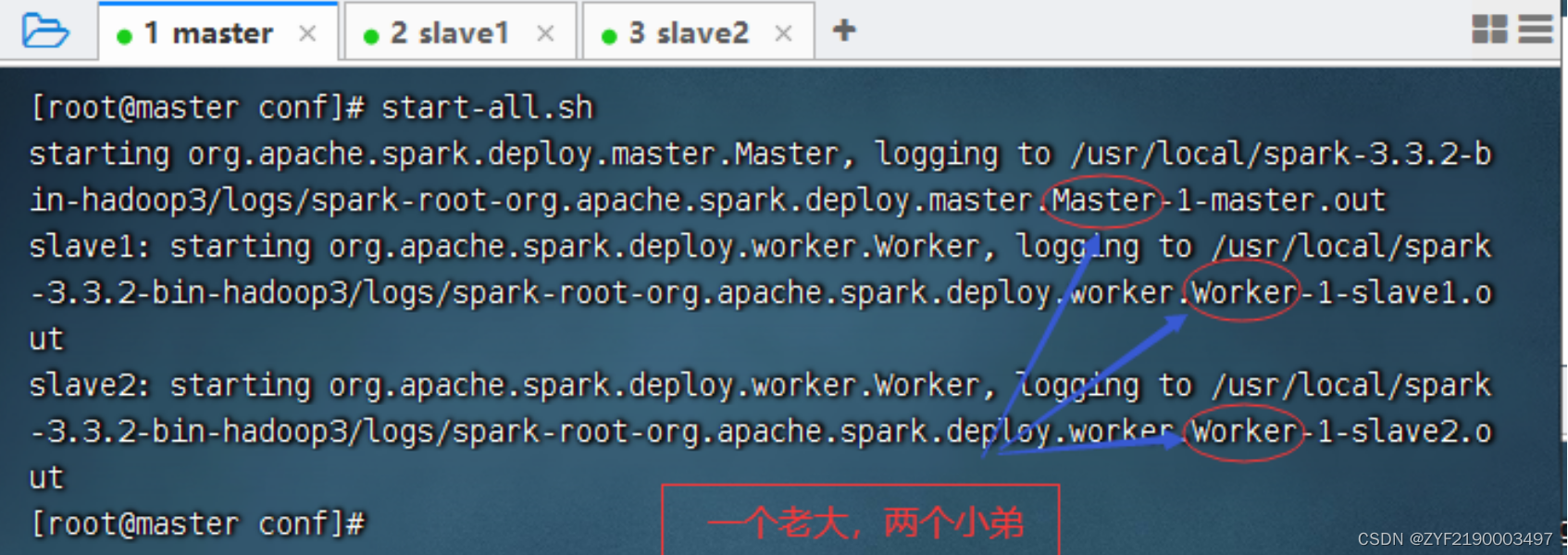

2、启动Spark集群

-

执行命令:

start-all.sh

-

查看

start-all.sh的源码启动Master与Worker的命令 - 可以看到,当执行start-all.sh命令时,会分别执行start-master.sh命令启动Master,执行start-slaves.sh命令启动Worker。

- 注意,若spark-evn.sh中配置了SPARK_MASTER_HOST属性,则必须在该属性指定的主机上启动Spark集群,否则会启动不成功;若没有配置SPARK_MASTER_HOST属性,则可以在任意节点上启动Spark集群,当前执行启动命令的节点即为Master节点。

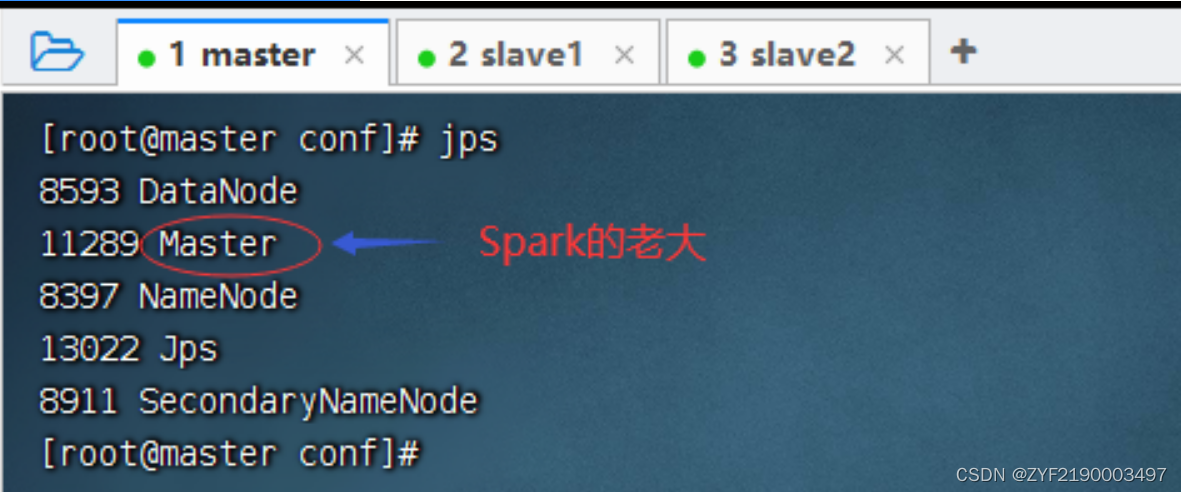

- 启动完毕后,分别在各节点执行jps命令,查看启动的进程。若在master节点存在Master进程,slave1节点存在Worker进程,slave2节点存在Worker进程,则说明集群启动成功。

- 查看master节点进程

(八)访问Spark的WebUI

-

在浏览器里访问

http://master:8080

(九)启动Scala版Spark Shell

-

执行命令:

spark-shell --master spark://master:7077(注意--master,两个-不能少)

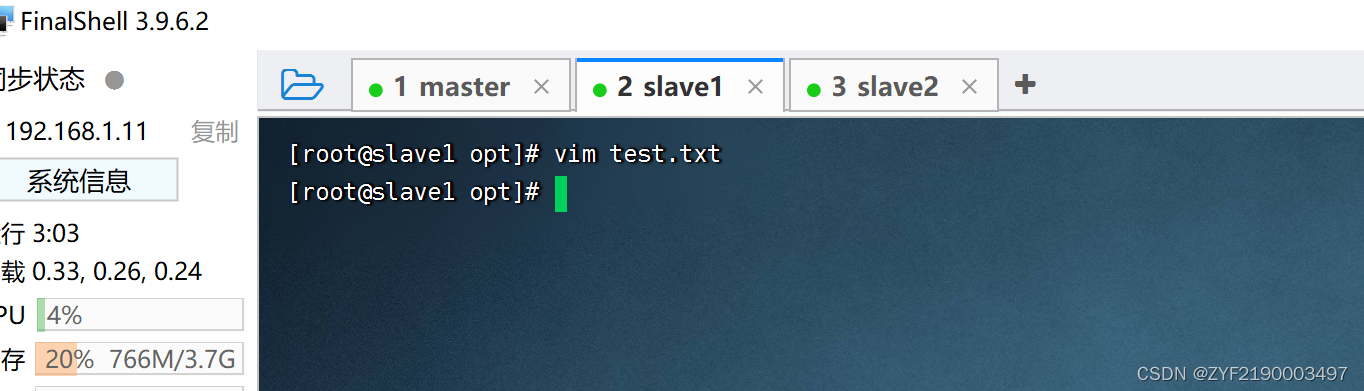

- 在

/opt目录里执行命令:vim test.txt

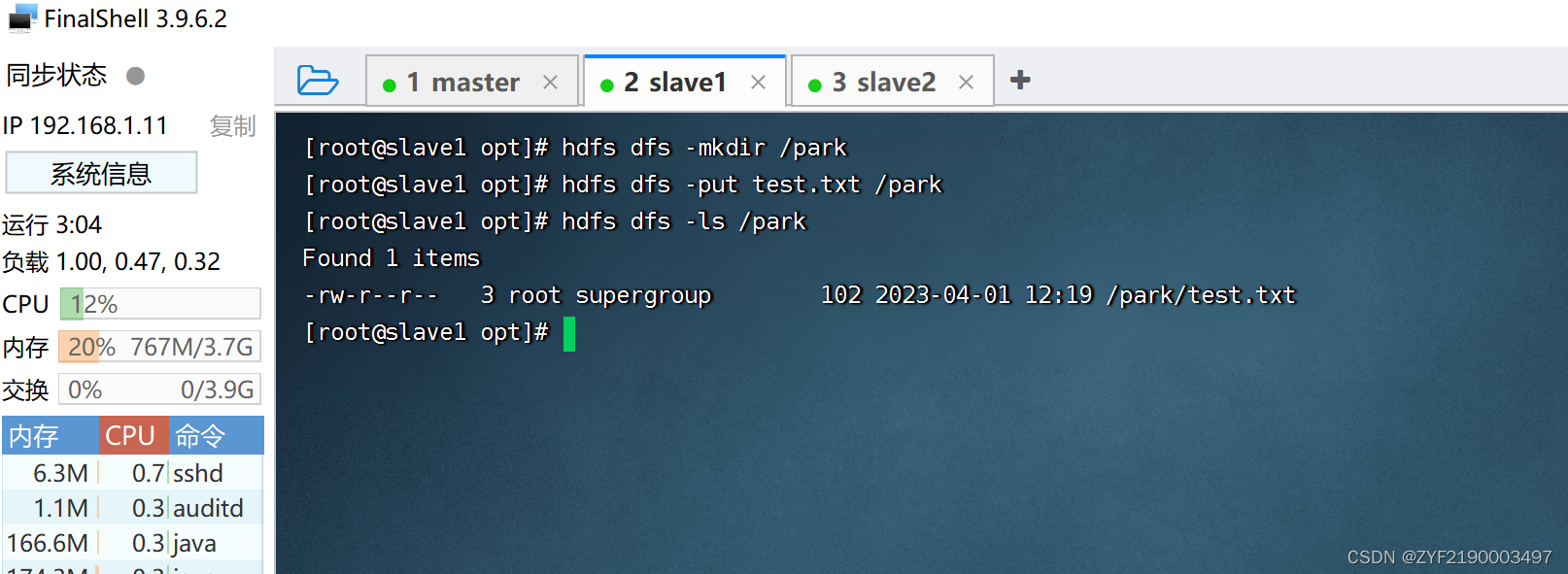

- 在HDFS上创建

park目录,将test.txt上传到HDFS的/park目录

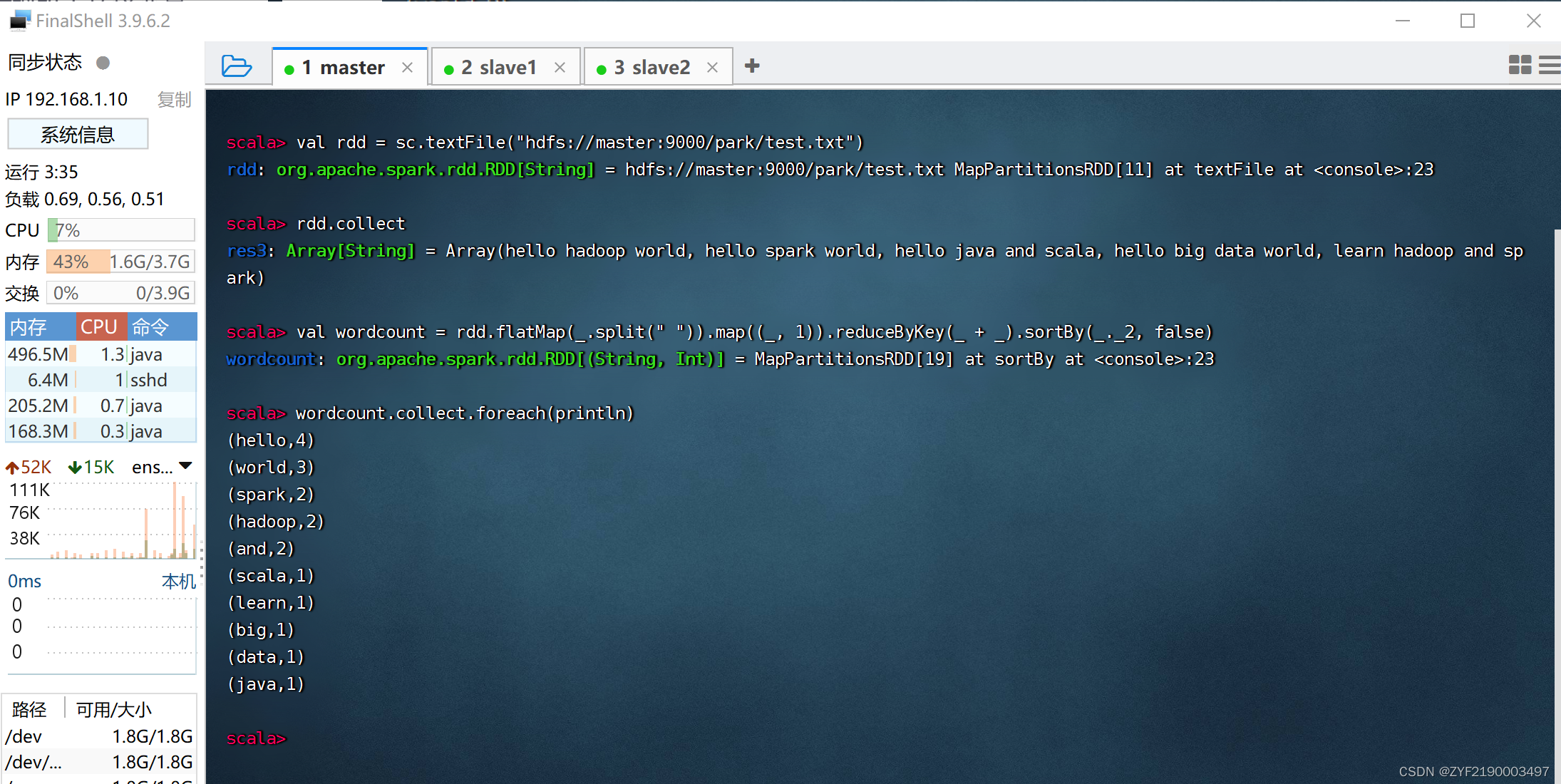

- 读取HDFS上的文件,创建RDD,执行命令:val rdd = sc.textFile("hdfs://master:9000/park/test.txt")(说明:val rdd = sc.textFile("/park/test.txt")读取的依然是HDFS上的文件,绝对不是本地文件)

- 收集rdd的数据,执行命令:

rdd.collect - 进行词频统计,按单词个数降序排列,执行命令:val wordcount = rdd.flatMap(_.split(" ")).map((_, 1)).reduceByKey(_ + _).sortBy(_._2, false)与`wordcount.collect.foreach(println)

(十)提交Spark应用程序

1、提交语法格式

- Spark提供了一个客户端应用程序提交工具spark-submit,使用该工具可以将编写好的Spark应用程序提交到Spark集群。

- spark-submit的使用格式如下:$ bin/spark-submit [options] <app jar> [app options]

- options表示传递给spark-submit的控制参数;

- app jar表示提交的程序JAR包(或Python脚本文件)所在位置;

- app options表示jar程序需要传递的参数,例如main()方法中需要传递的参数。

2、spark-submit常用参数

- 除了

--master参数外,spark-submit还提供了一些控制资源使用和运行时环境的参数。

3、案例演示 - 提交Spark自带的圆周率计算程序

- 进入Spark安装目录

(1)Standalone模式,采用client提交方式

- 执行下述命令,将Spark自带的求圆周率的程序提交到集群

- 提交Spark作业后,观察Spark集群管理界面,其中“Running Applications”列表表示当前Spark集群正在计算的作业,执行几秒后,刷新界面,在Completed Applications表单下,可以看到当前应用执行完毕,返回控制台查看输出信息,出现了“Pi is roughly 3.1424157120785603”,说明Pi值已经被计算完毕。

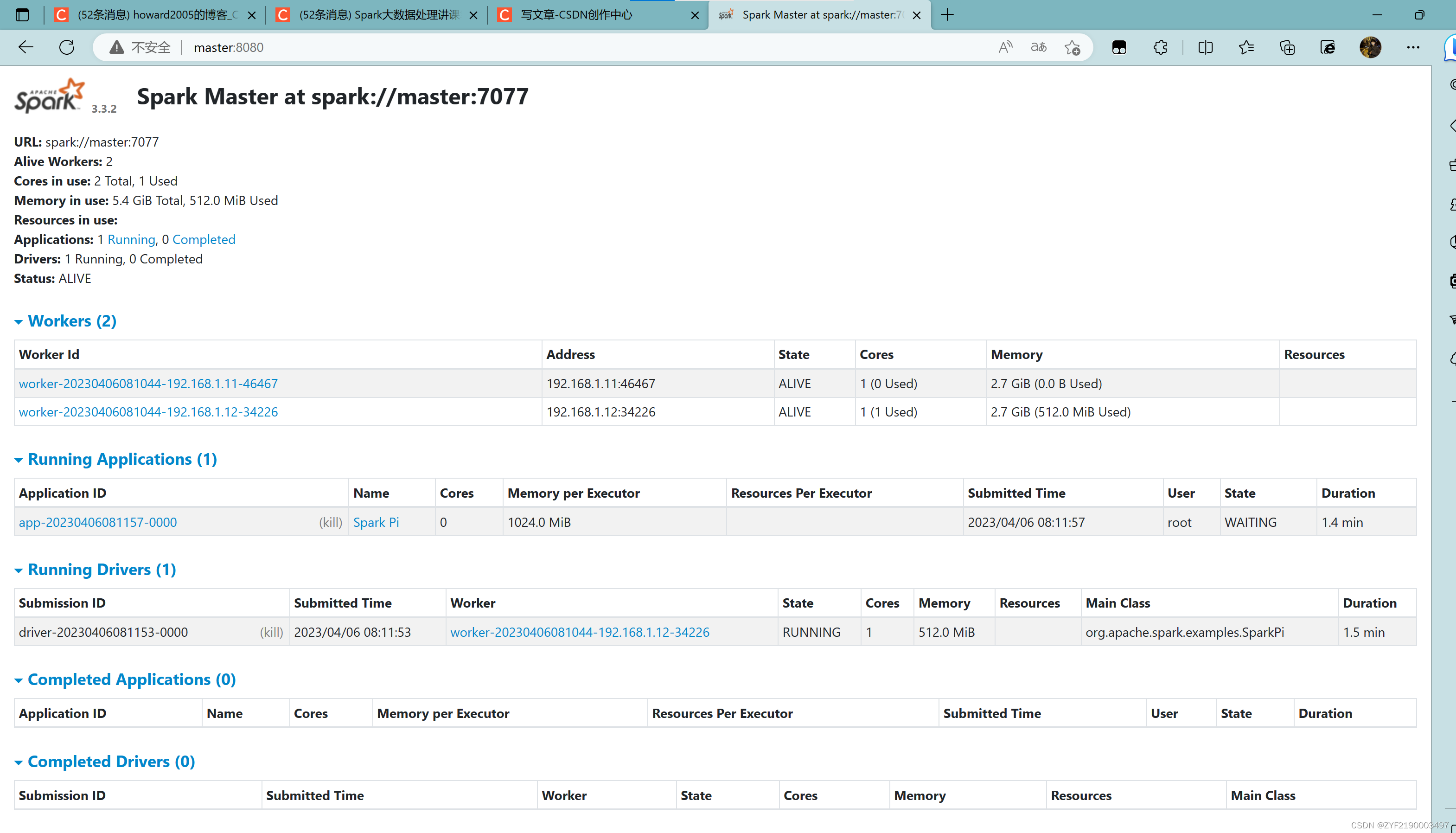

(2)Standalone模式,采用cluster提交方式

- 在Standalone模式下,将Spark自带的圆周率计算程序提交到集群,并且设置Driver进程使用内存为512MB,每个Executor进程使用内存为1GB,每个Executor进程所使用的CPU核心数为2,提交方式为cluster(Driver进程运行在集群的工作节点中),执行命令如下。

bin/spark-submit \

--master spark://master:7077 \

--deploy-mode cluster \

--class org.apache.spark.examples.SparkPi \

--driver-memory 512m \

--executor-memory 1g \

--executor-cores 2 \

./examples/jars/spark-examples_2.12-3.3.2.jar

- 运行成功信息:

Successfully created connection to master/192.168.1.101:7077 after 35 ms (0 ms spent in bootstraps)

- 在Spark WebUI界面上查看运行结果,访问

http://master:8080

- 单击圈红的

Worker超链接

- 单击

stdout超链接

(十一)停止Spark集群服务

- 在master节点执行命令:

stop-all.sh

5629

5629

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?