- 搭建hive之前先搭建MySQL,hadoop 可以参考进行部署MySQL

https://blog.csdn.net/a778203081/article/details/124470867?spm=1001.2014.3001.5502

- 上传hive压缩包到home文件夹下,并解压改名解压用 tar -zxvf 命令。

- 配置hive的环境变量

export HIVE_HOME=/home/hive-2.3.4

export PATH=$PATH:$HIVE_HOME/bin

- 为了解决hadoop 与 hive的之间的guava.xxx.tar版本冲突,删除hive下lib里面的guava.xxx.tar包。到Hadoop的 /share/hadoop/common/lib/ 把guava.xxx.tar(xxx代表版本号),拷贝到hive目录下的lib里面。

- 上传mysql的驱动jar包,Mysql-connector-java-xxxx.ja,尽量上传版本高的,高版本兼容低版本。

- 修改couf目录下的`

cd /etcport/server/conf/

mv hive-env.sh.template hive-env.sh

vi hive-env.sh

# 添加内容如下

export HADOOP_HOME=/home/hadoop-3.1.4

export HIVE_CONF_DIR=/home/hive/conf

export HIVE_AUX_JARS_PATH=/home/hive/lib

- 新增hive-site.xml 配置MySQL的相关信息

vi hive-site.xml

# 添加内容如下

# 这里没有配置让hive自动在MySQL创建hive数据库,需要我们手动创建hive数据库。

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://安装MySQL节点的ip:3306/hive?createDatabaseIfNotExist=true&characterEncoding=latin1&useSSL=false</value>

</property>

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.jdbc.Driver</value>

</property>

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>root</value>

</property>

<property>

<name>hive.metastore.uris</name>

<value>thrift://安装MySQL节点的ip:9083</value>

</property>

<!-- 关闭元数据存储授权 -->

<property>

<name>hive.metastore.event.db.notification.api.auth</name>

<value>false</value>

</property>

<!-- 关闭元数据存储版本的验证 -->

<property>

<name>hive.metastore.schema.verification</name>

<value>false</value>

</property>

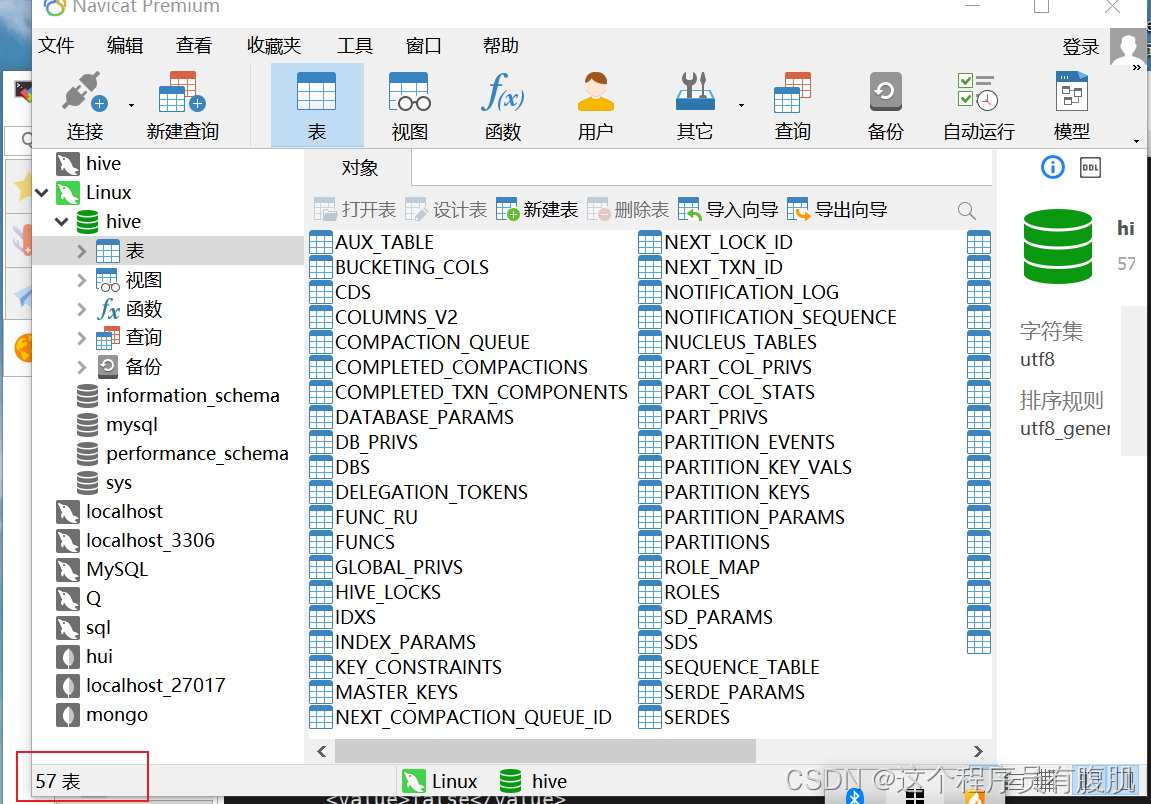

- 初始化hive

cd /export/server/hive

bin/schematool -initSchema -dbType mysql -verbos

- 创建成功了!!!

2065

2065

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?