1 模块需求分析

1.1 模块介绍

媒资管理系统是每个在线教育平台所必须具备的,查阅百度百科对它的定义如下:

媒体资源管理(Media Asset Management,MAM)系统是建立在多媒体、网络、数据库和数字存储等先进技术基础上的一个对各种媒体及内容(如视/音频资料、文本文件、图表等)进行数字化存储、管理以及应用的总体解决方案,包括数字媒体的采集、编目、管理、传输和编码转换等所有环节。其主要是满足媒体资源拥有者收集、保存、查找、编辑、发布各种信息的要求,为媒体资源的使用者提供访问内容的便捷方法,实现对媒体资源的高效管理,大幅度提高媒体资源的价值。

每个教学机构都可以在媒资系统管理自己的教学资源,包括:视频、教案等文件。

目前媒资管理的主要管理对象是视频、图片、文档等,包括:媒资文件的查询、文件上传、视频处理等。

- 媒资查询:教学机构查询自己所拥有的媒资信息。

- 文件上传:包括上传图片、上传文档、上传视频。

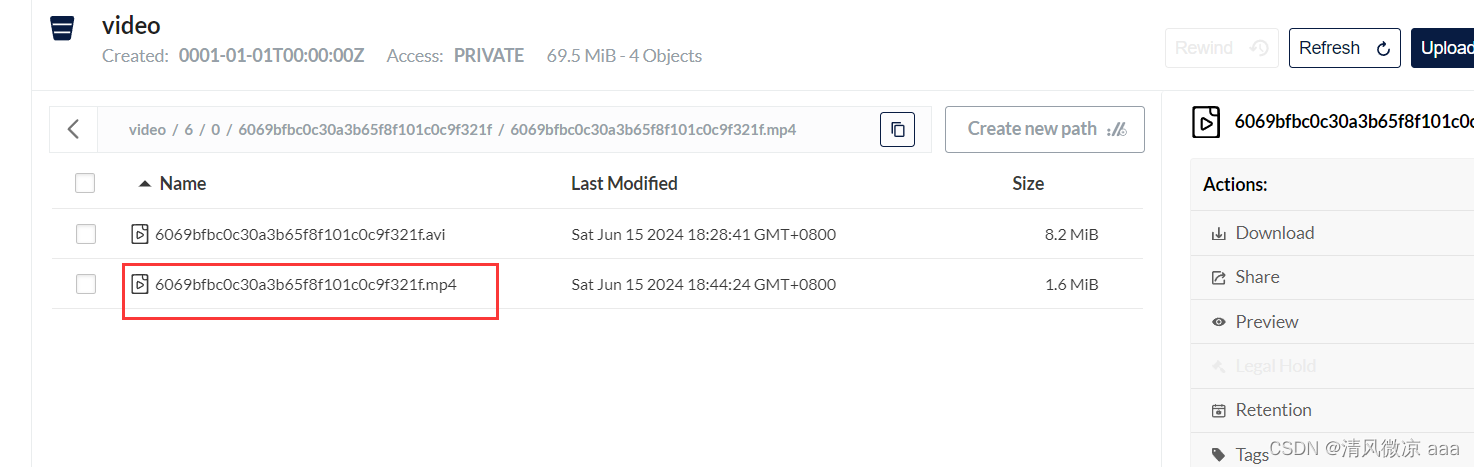

- 视频处理:视频上传成功,系统自动对视频进行编码处理。

- 文件删除:教学机构删除自己上传的媒资文件。

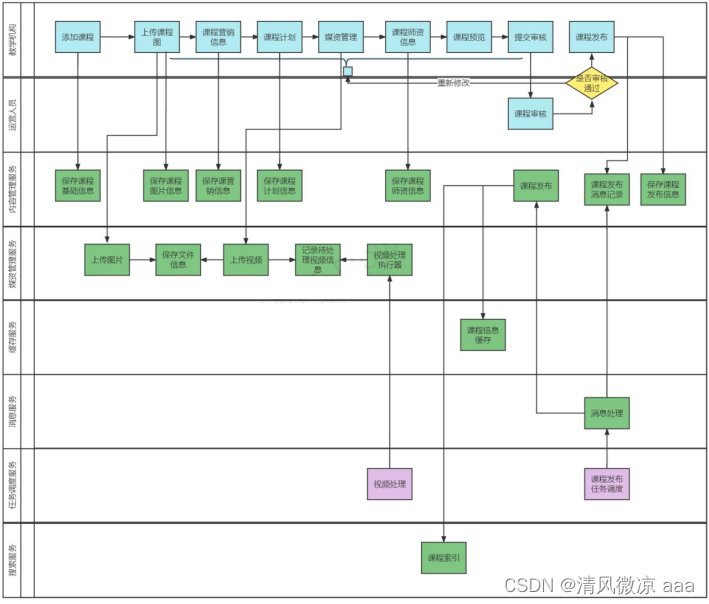

下图是课程编辑与发布的整体流程,通过下图可以看到媒资管理在整体流程的位置:

1.2 业务流程

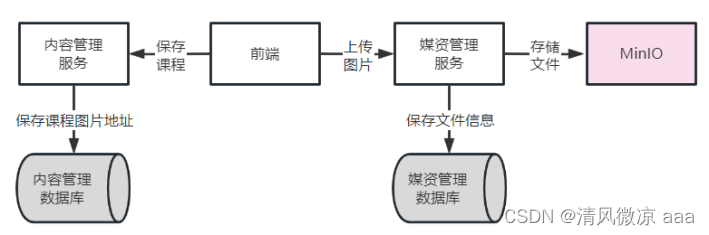

1.2.1 上传图片

教学机构人员在课程信息编辑页面上传课程图片,课程图片统一记录在媒资管理系统。

下图是上传图片的界面:

1.2.2 上传视频

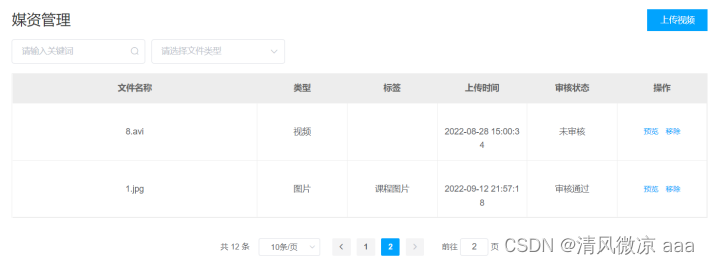

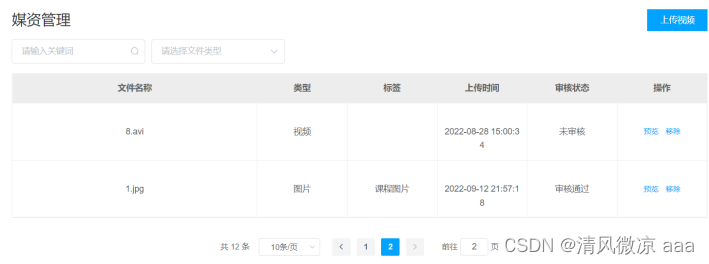

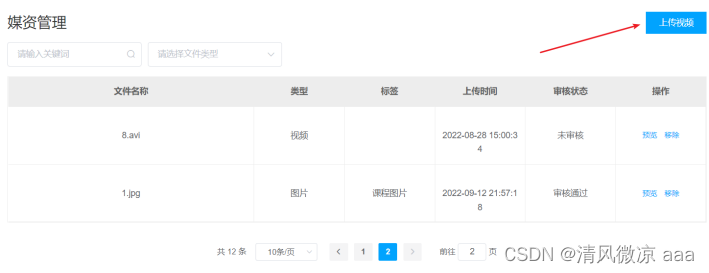

1、教学机构人员进入媒资管理列表查询自己上传的媒资文件。

点击“媒资管理”

进入媒资管理列表页面查询本机构上传的媒资文件。

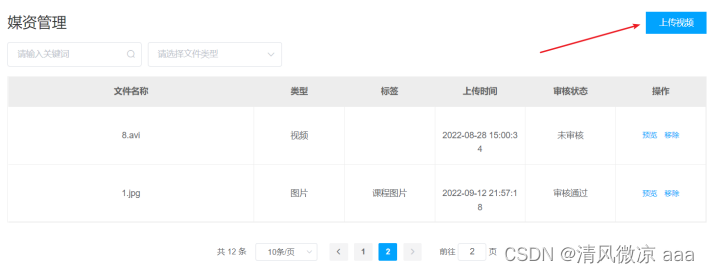

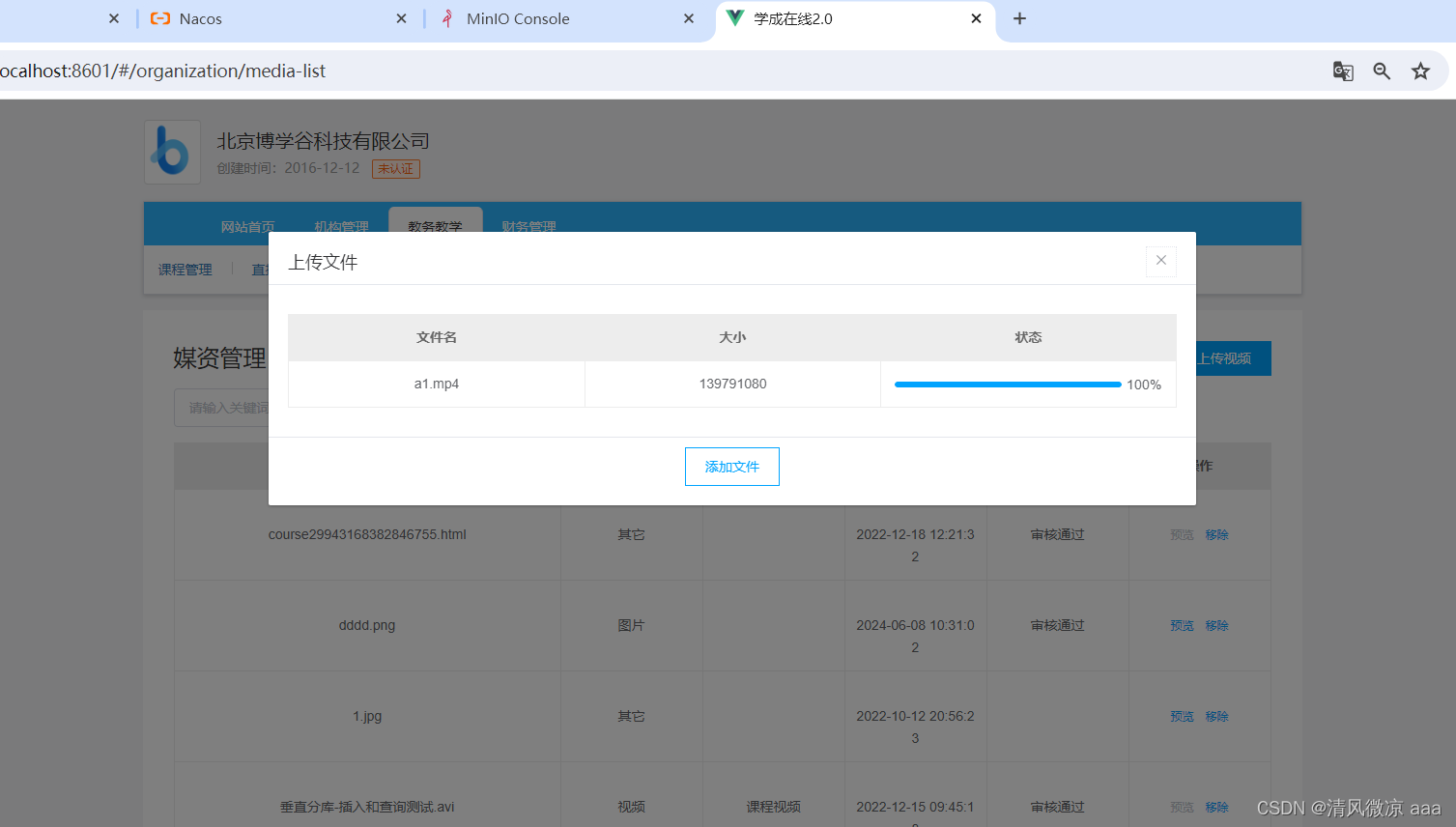

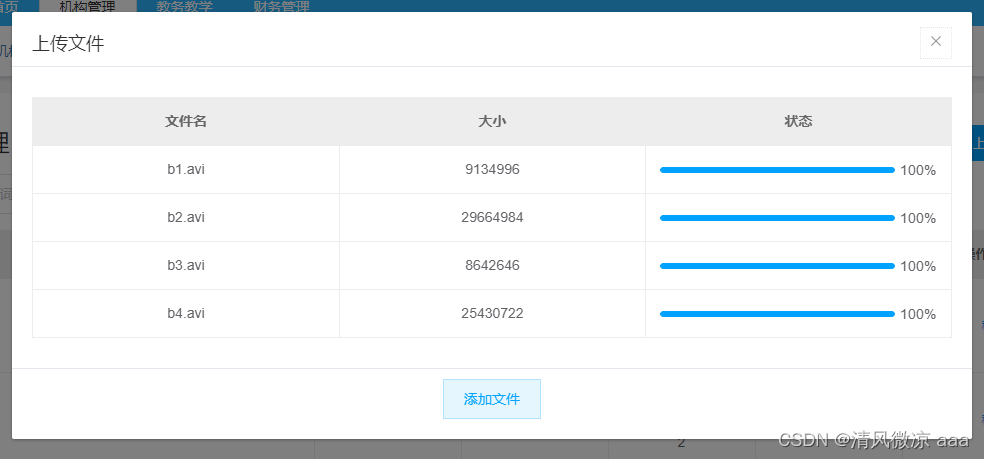

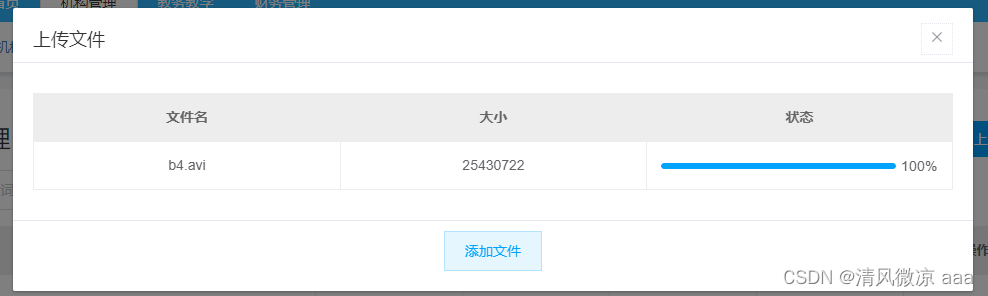

2、教育机构用户在"媒资管理"页面中点击 “上传视频” 按钮。

点击“上传视频”打开上传页面

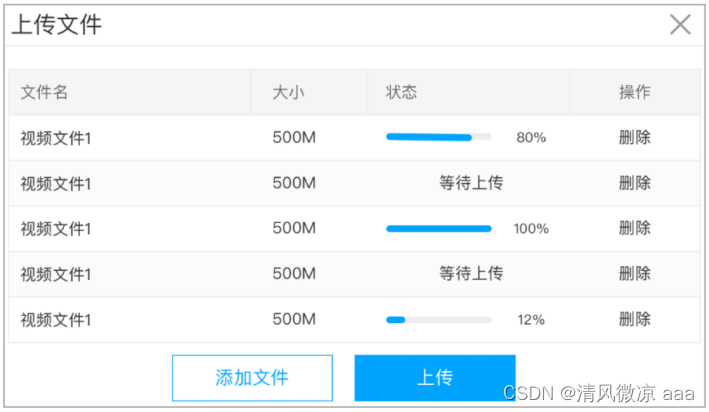

3、选择要上传的文件,自动执行文件上传,视频上传成功会自动处理。

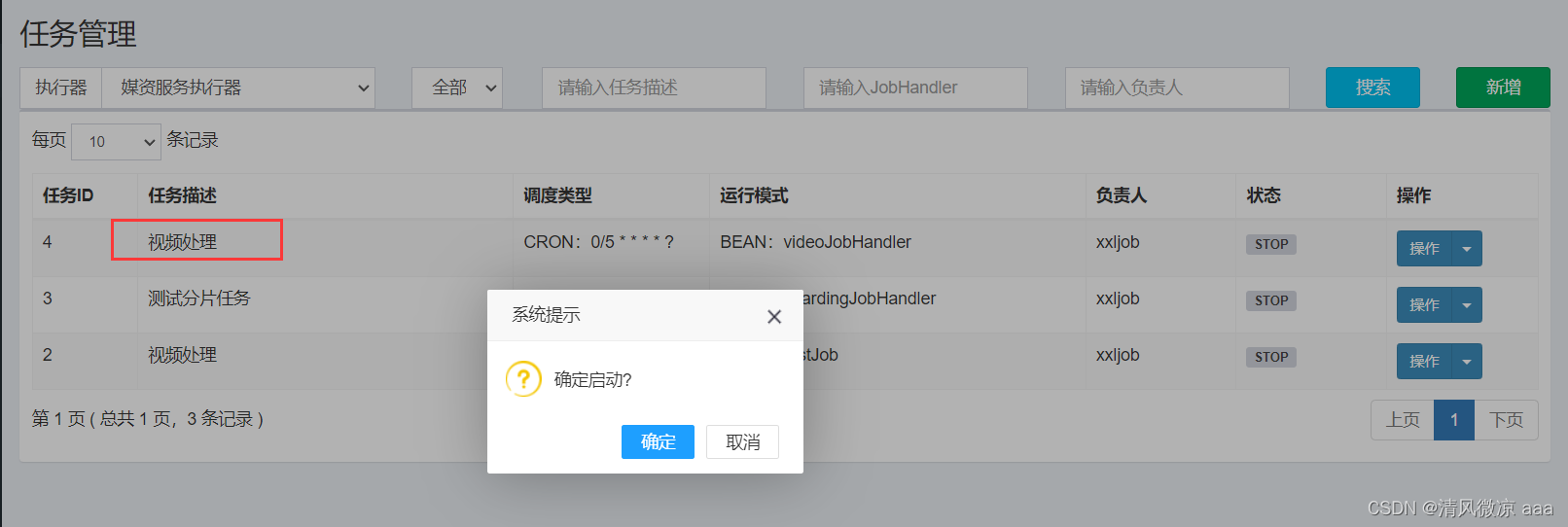

1.2.3 处理视频

对需要转码处理的视频系统会自动对其处理,处理后生成视频的URL。

处理视频没有用户界面,完全是后台自动执行。

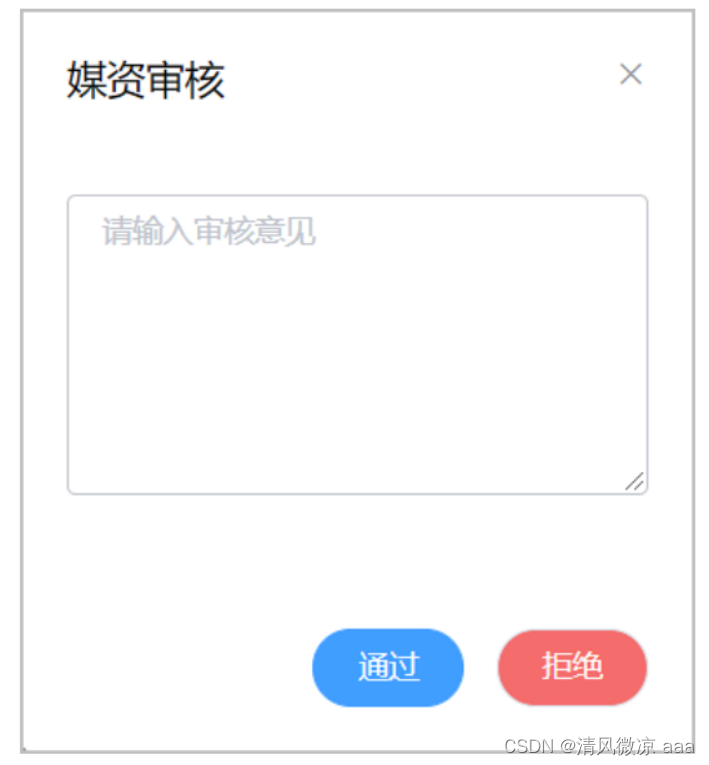

1.2.4 审核媒资

审核媒资包括程序自动审核和人工审核,程序可以通过鉴黄接口(https://www.aliyun.com/product/lvwang?spm=5176.19720258.J_3207526240.51.e93976f4rSq796)审核视频,对有异议的视频由人工进行审核。

1.运营用户登入运营平台并进入媒资管理页面,查找待审核媒资

2.点击列表中媒资名称链接,可预览该媒资,若是视频,则播放视频。

3.点击列表中某媒资后的"审核" 按钮,既完成媒资的审批过程。

点击“审核”,选择审核结果,输入审核意见。

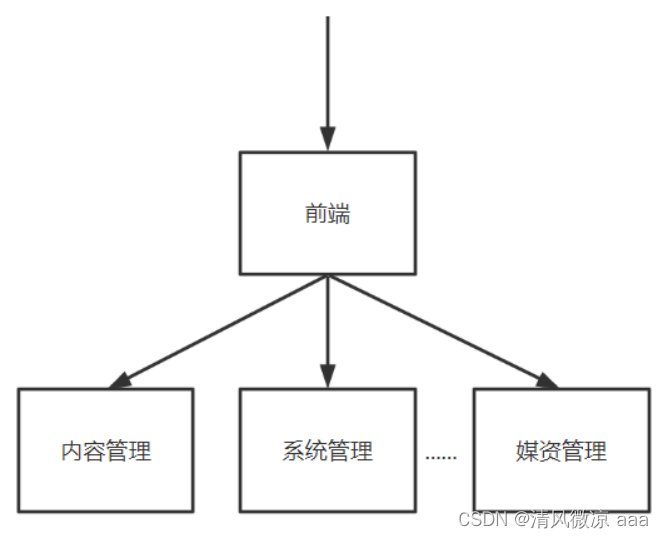

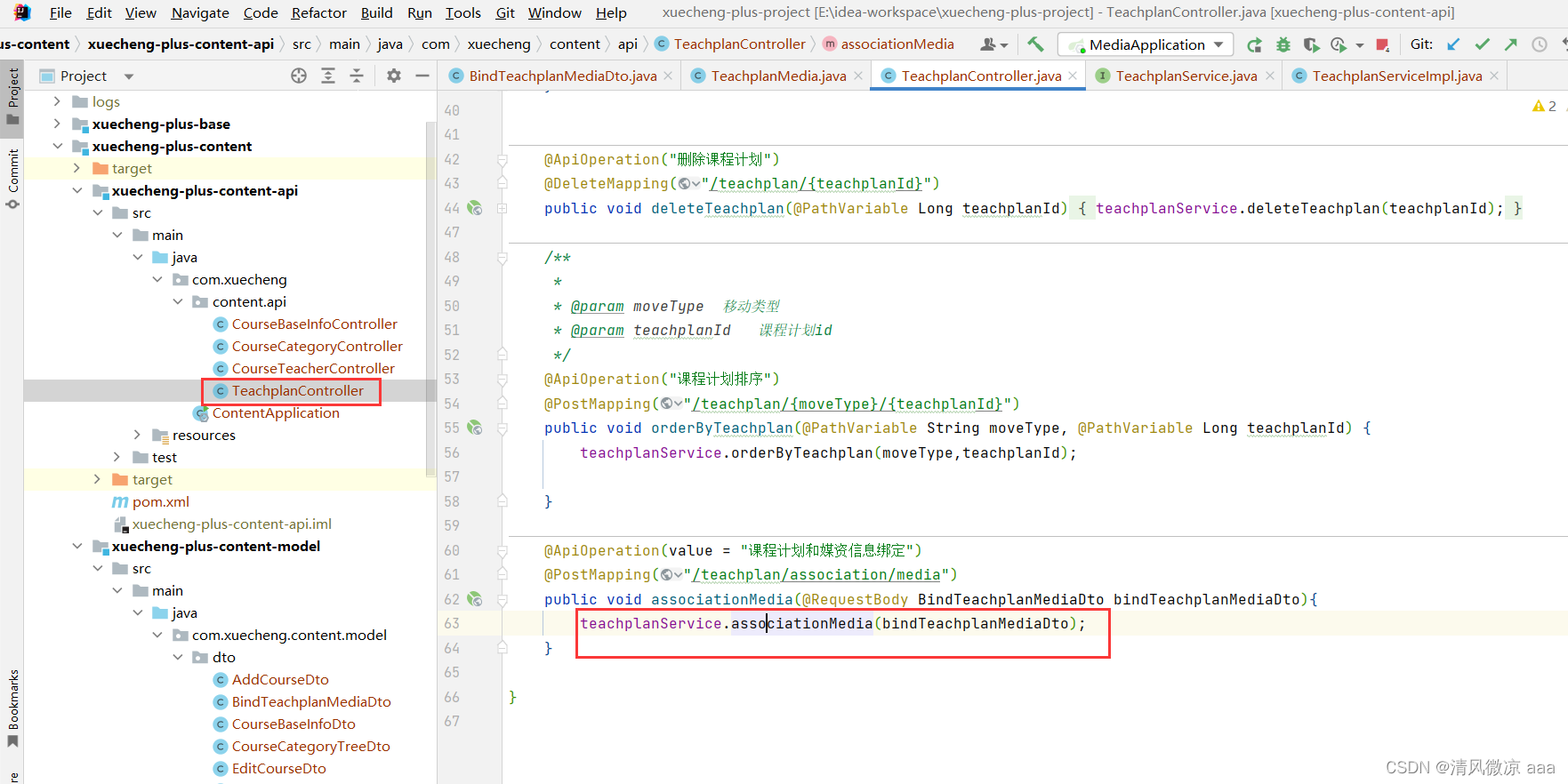

1.2.5 绑定媒资

课程计划创建好后需要绑定媒资文件,比如:如果课程计划绑定了视频文件,进入课程在线学习界面后点课程计划名称则在线播放视频。如下图:

如何将课程计划绑定媒资呢?

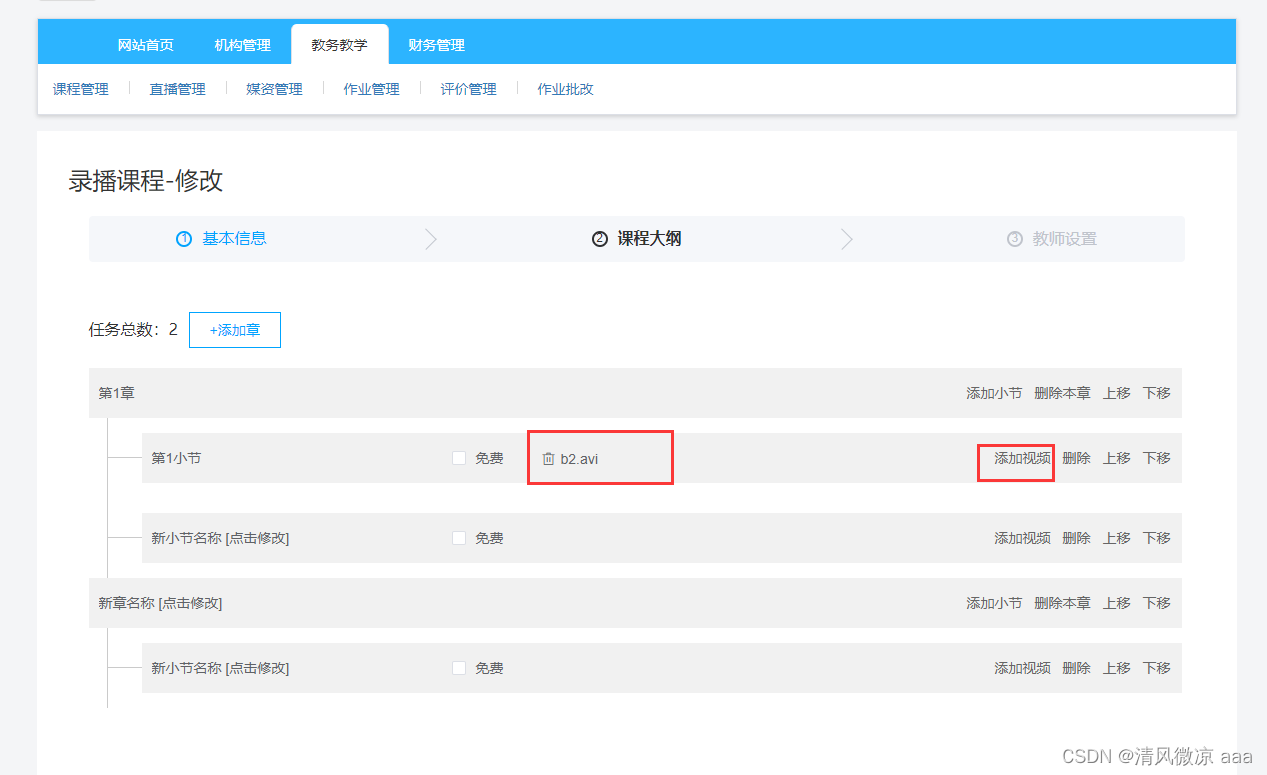

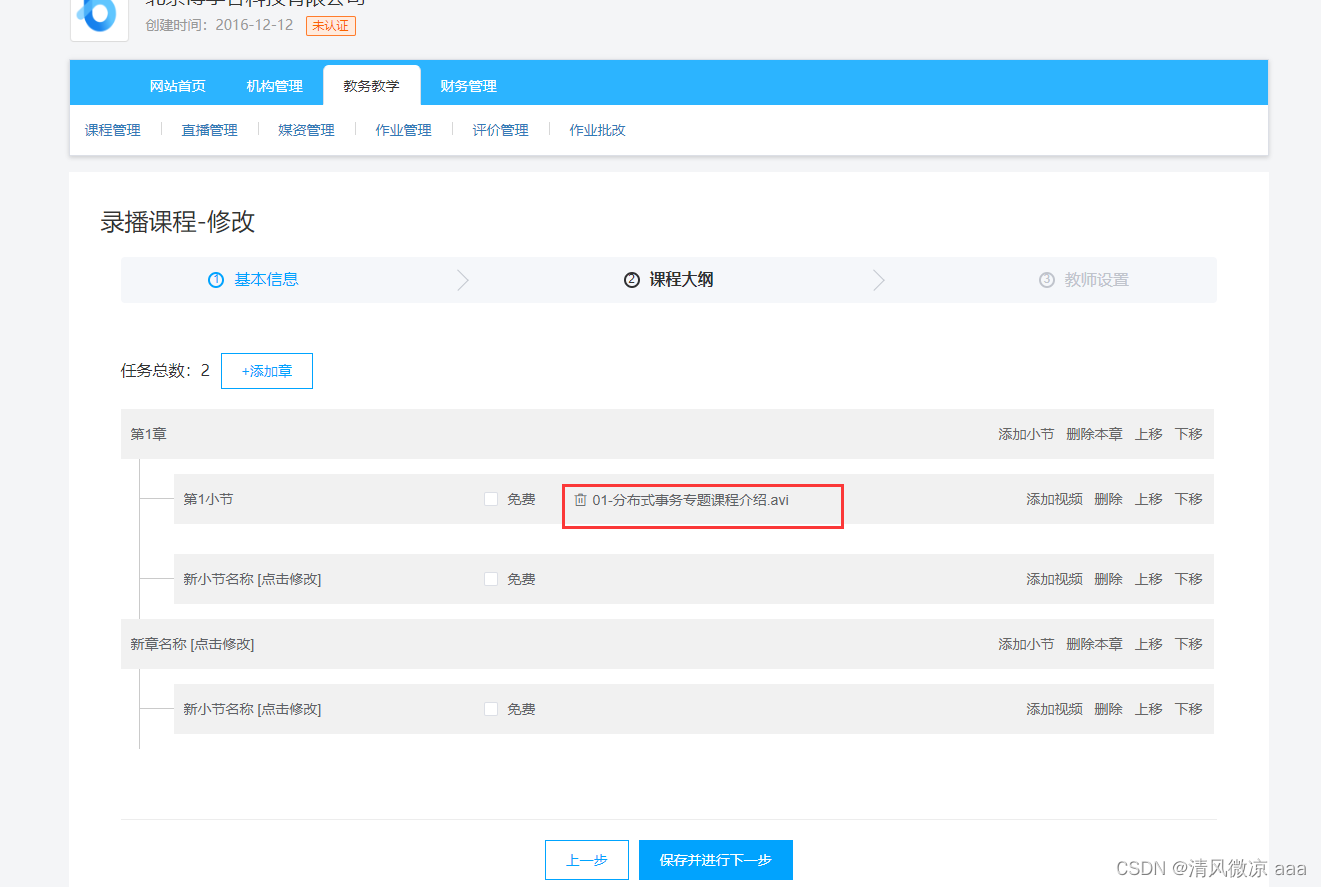

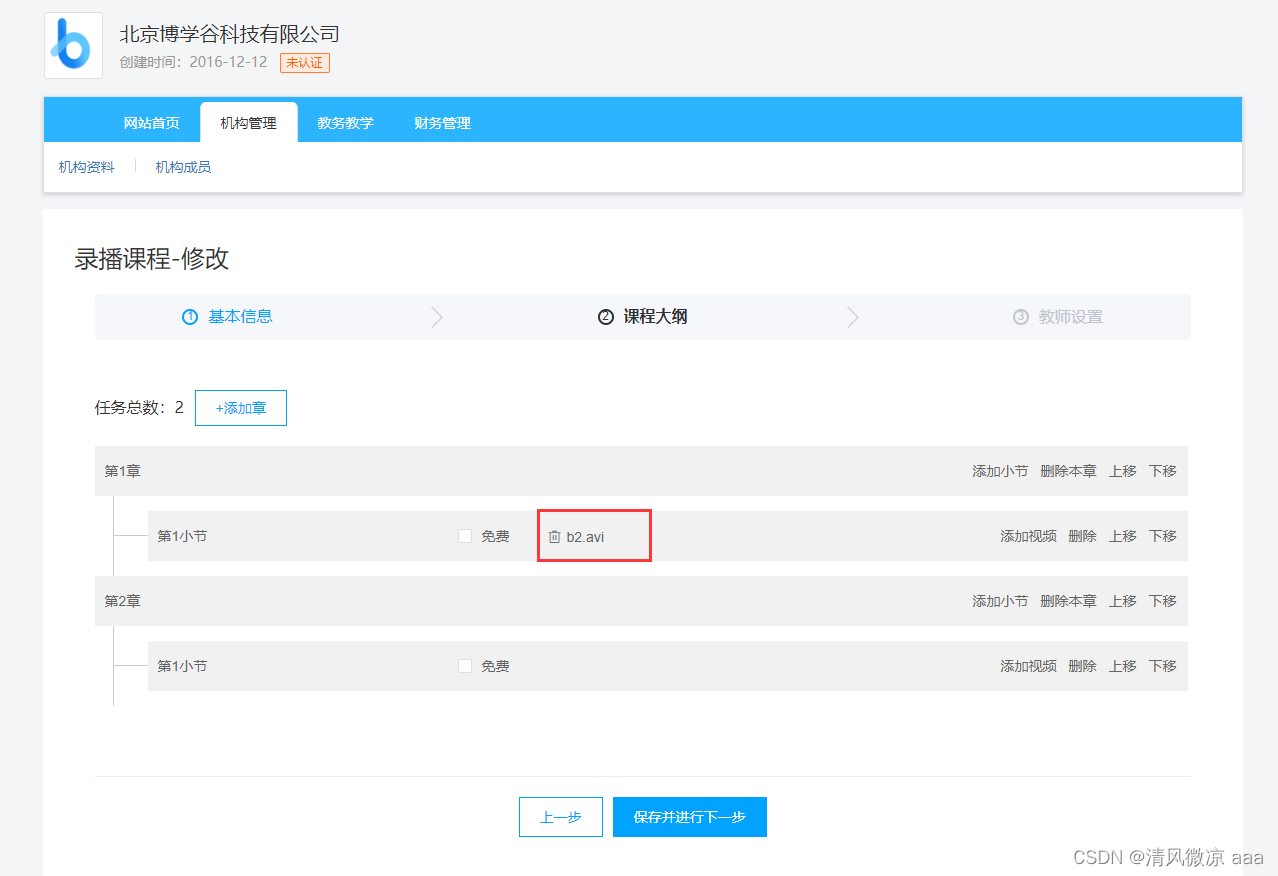

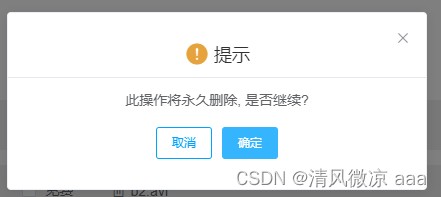

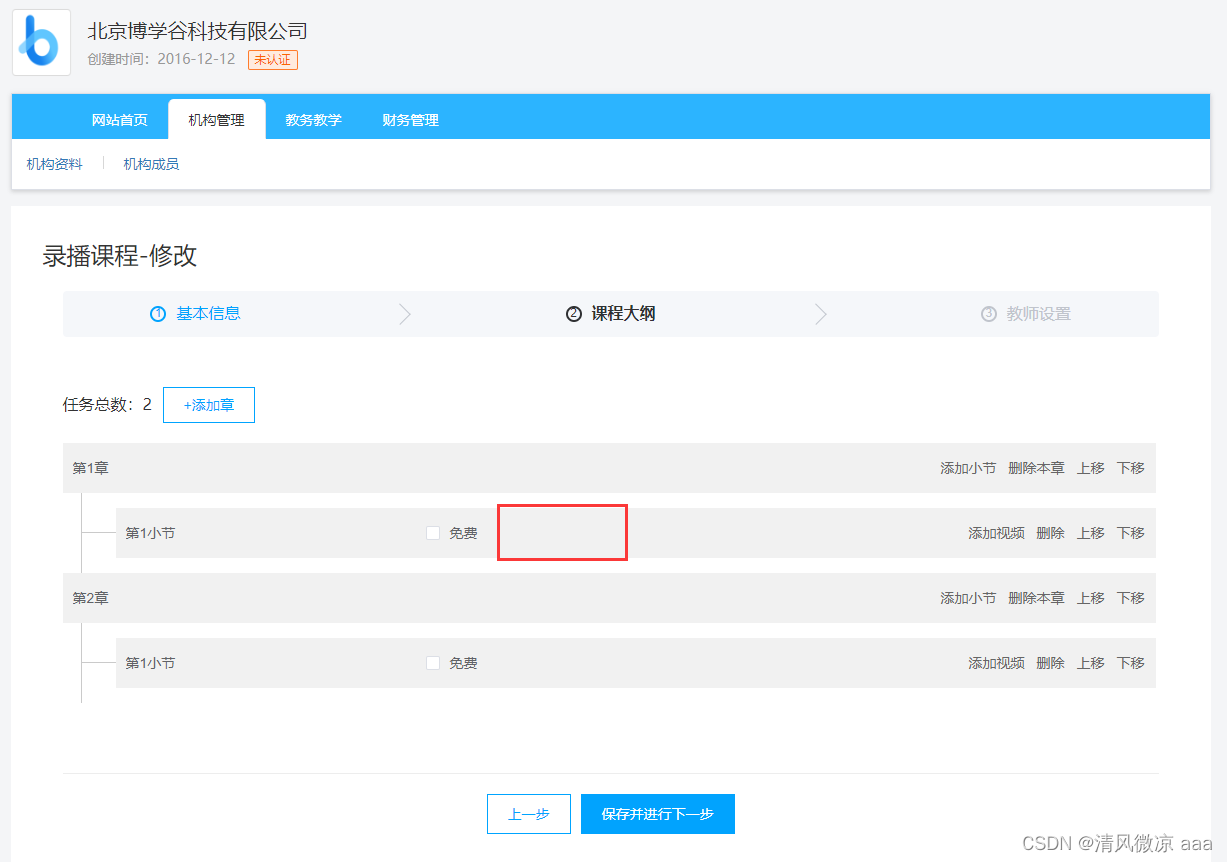

1.教育机构用户进入课程管理页面并编辑某一个课程,在"课程大纲"标签页的某一小节后可点击”添加视频“。

2.弹出添加视频对话框,可通过视频关键字搜索已审核通过的视频媒资。

3.选择视频媒资,点击提交按钮,完成课程计划绑定媒资流程。

课程计划关联视频后如下图:

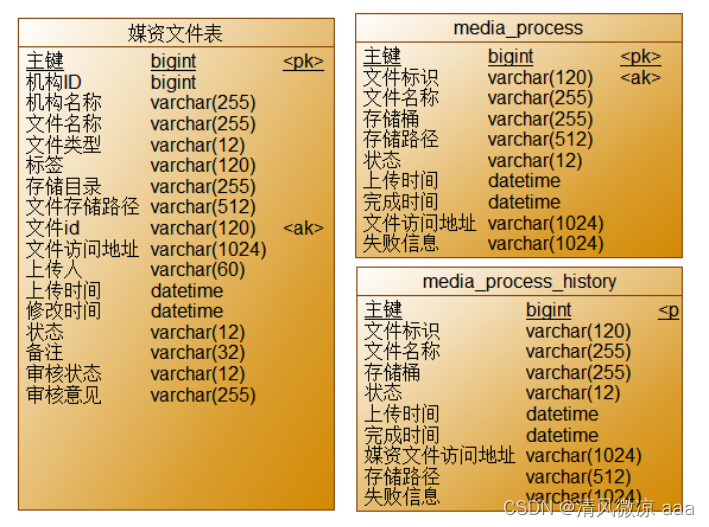

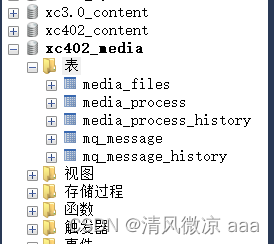

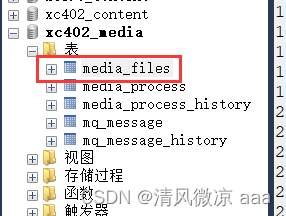

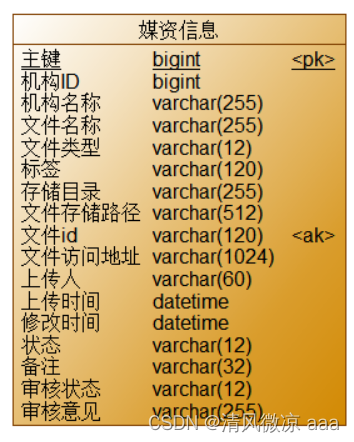

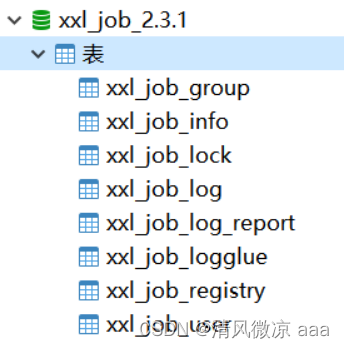

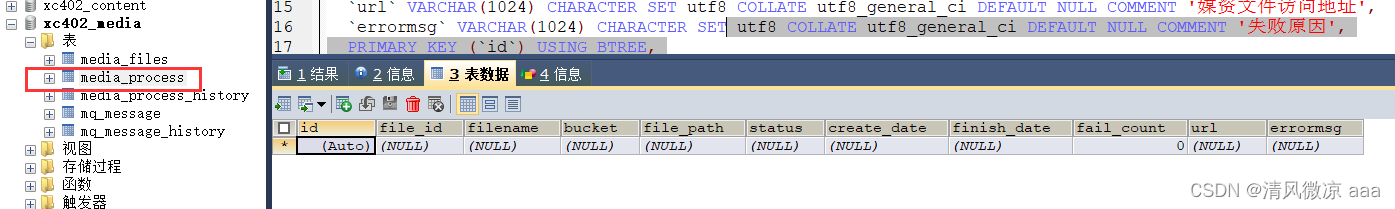

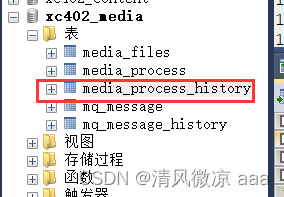

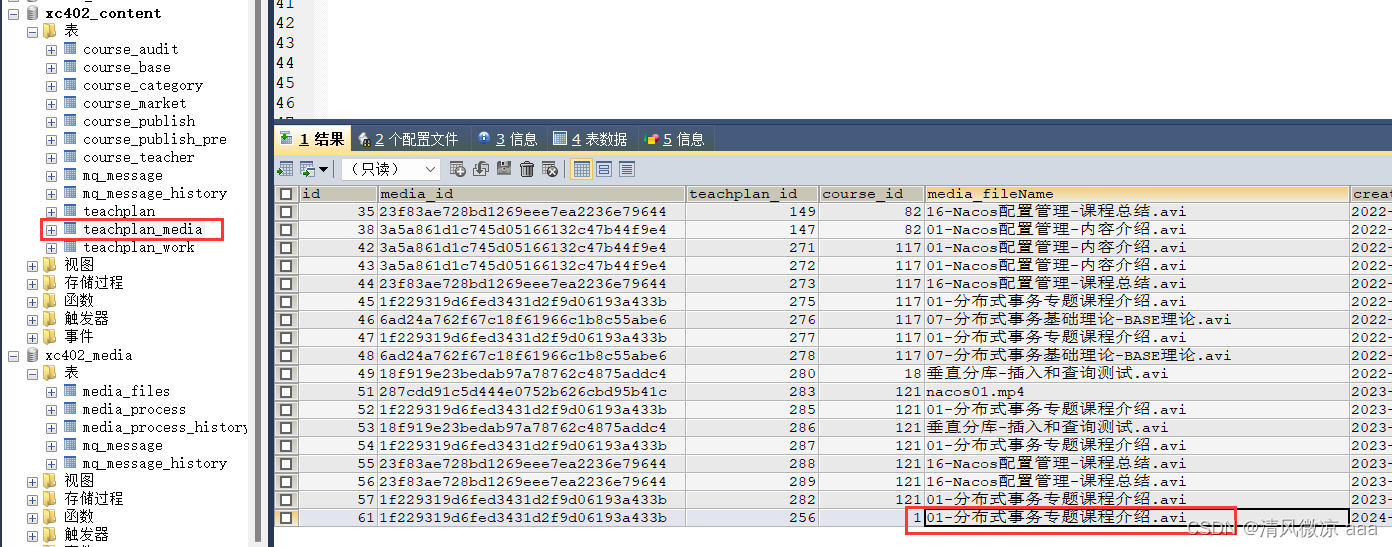

1.3 数据模型

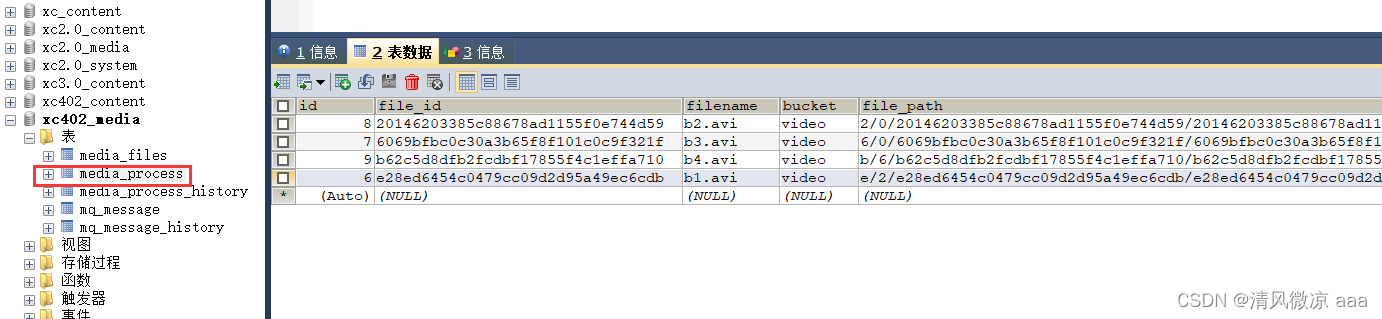

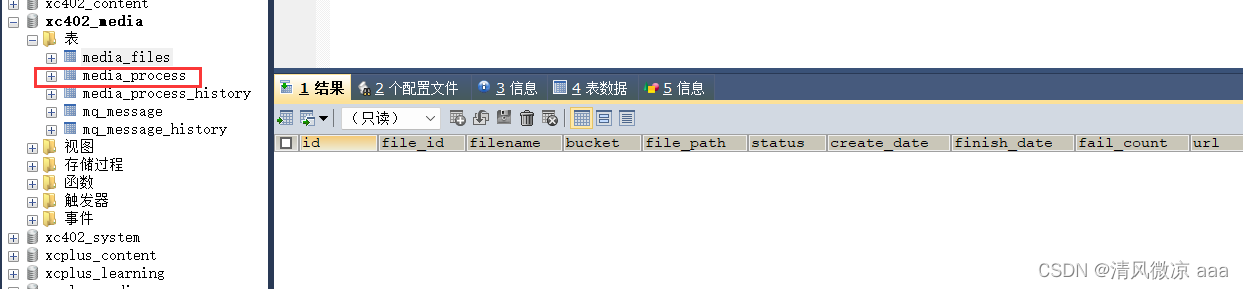

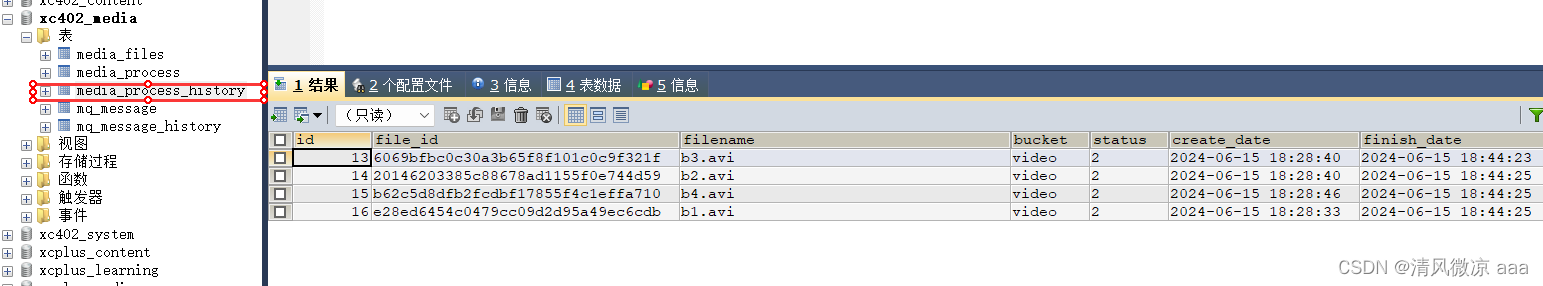

本模块媒资文件相关的数据表如下:

-

媒资文件表:存储文件信息,包括图片、视频、文档等。

-

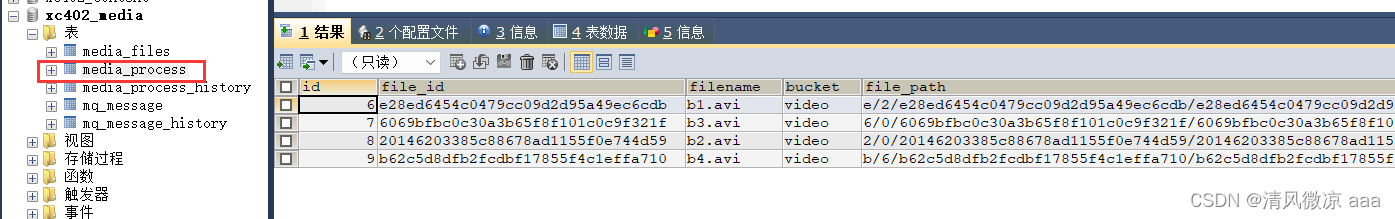

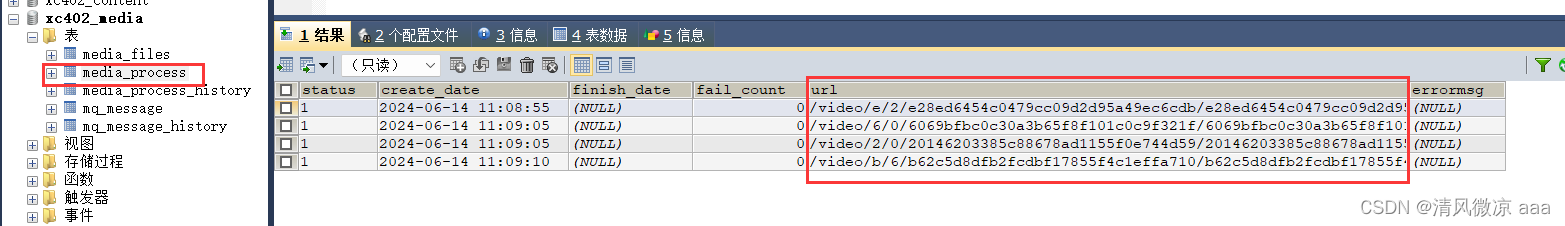

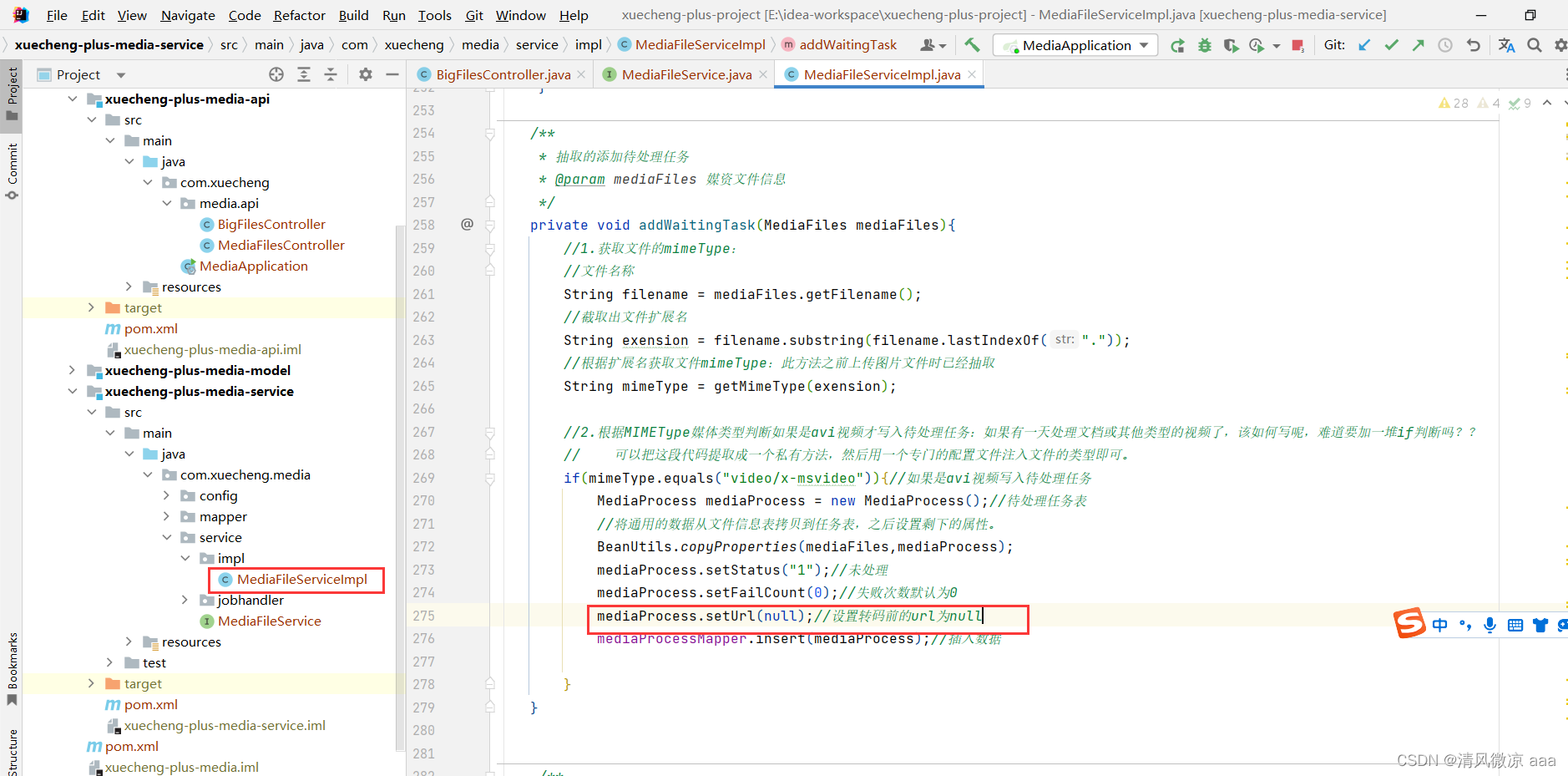

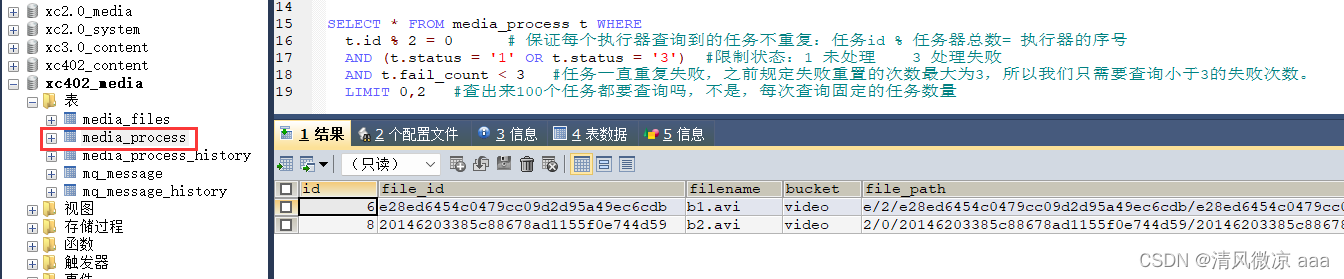

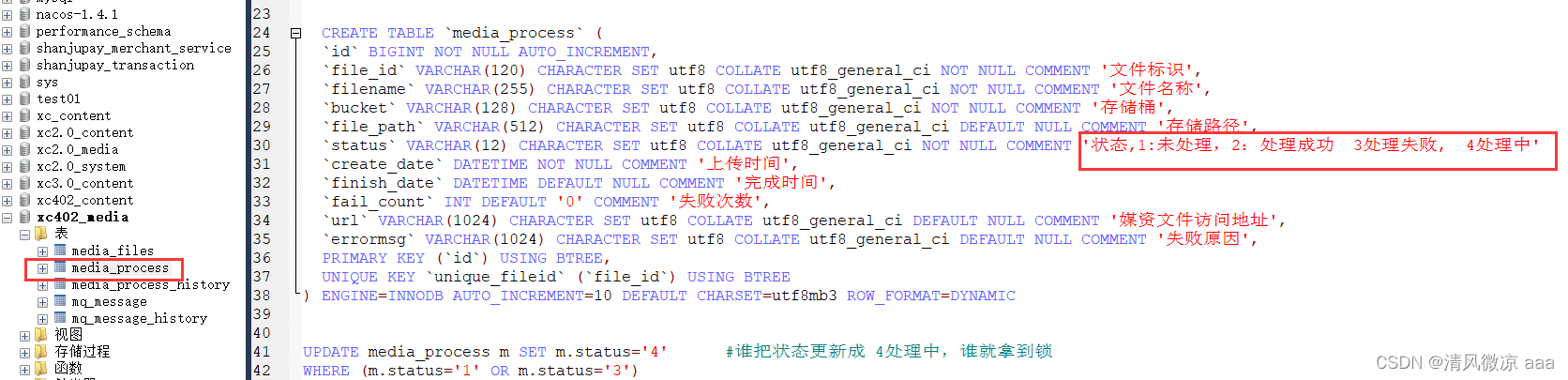

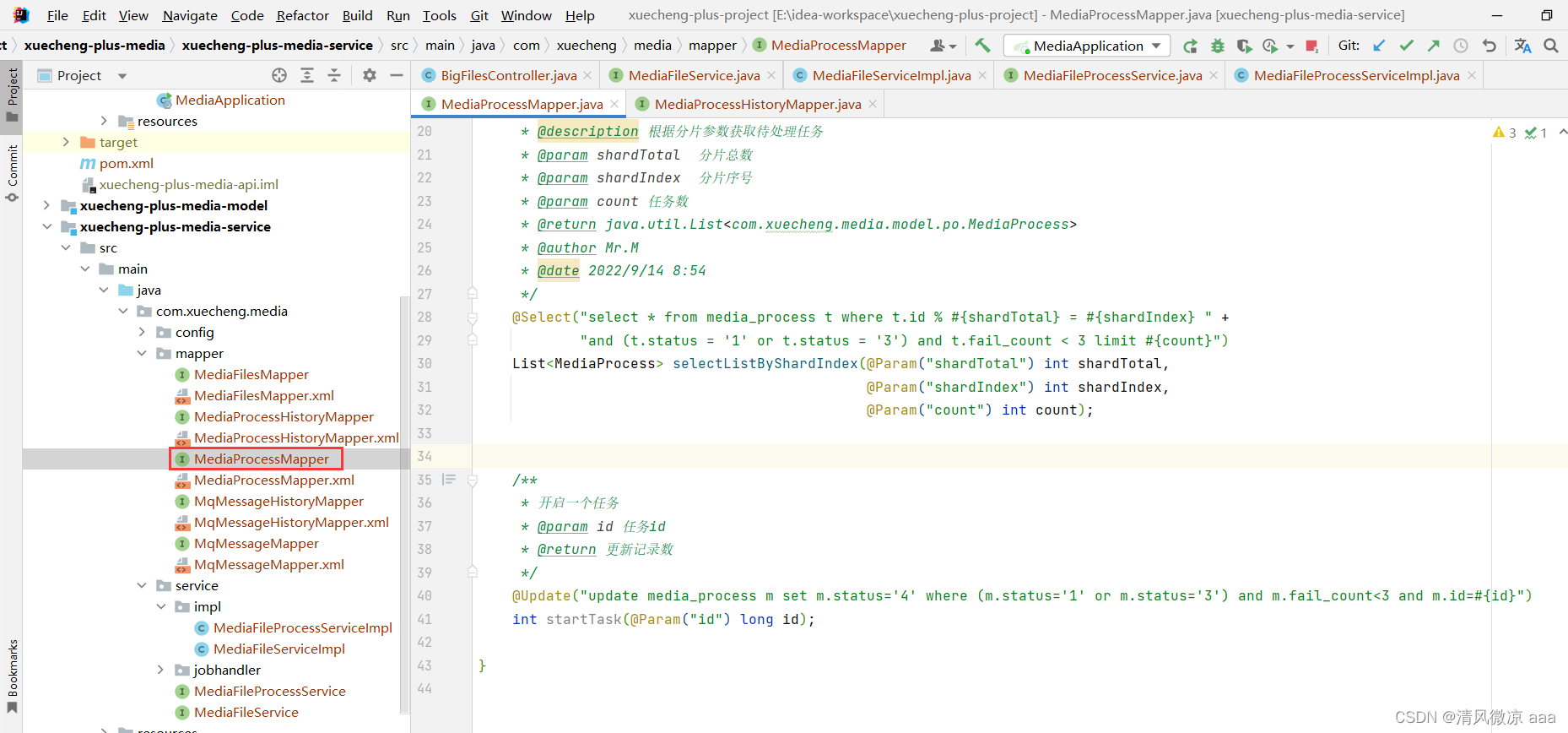

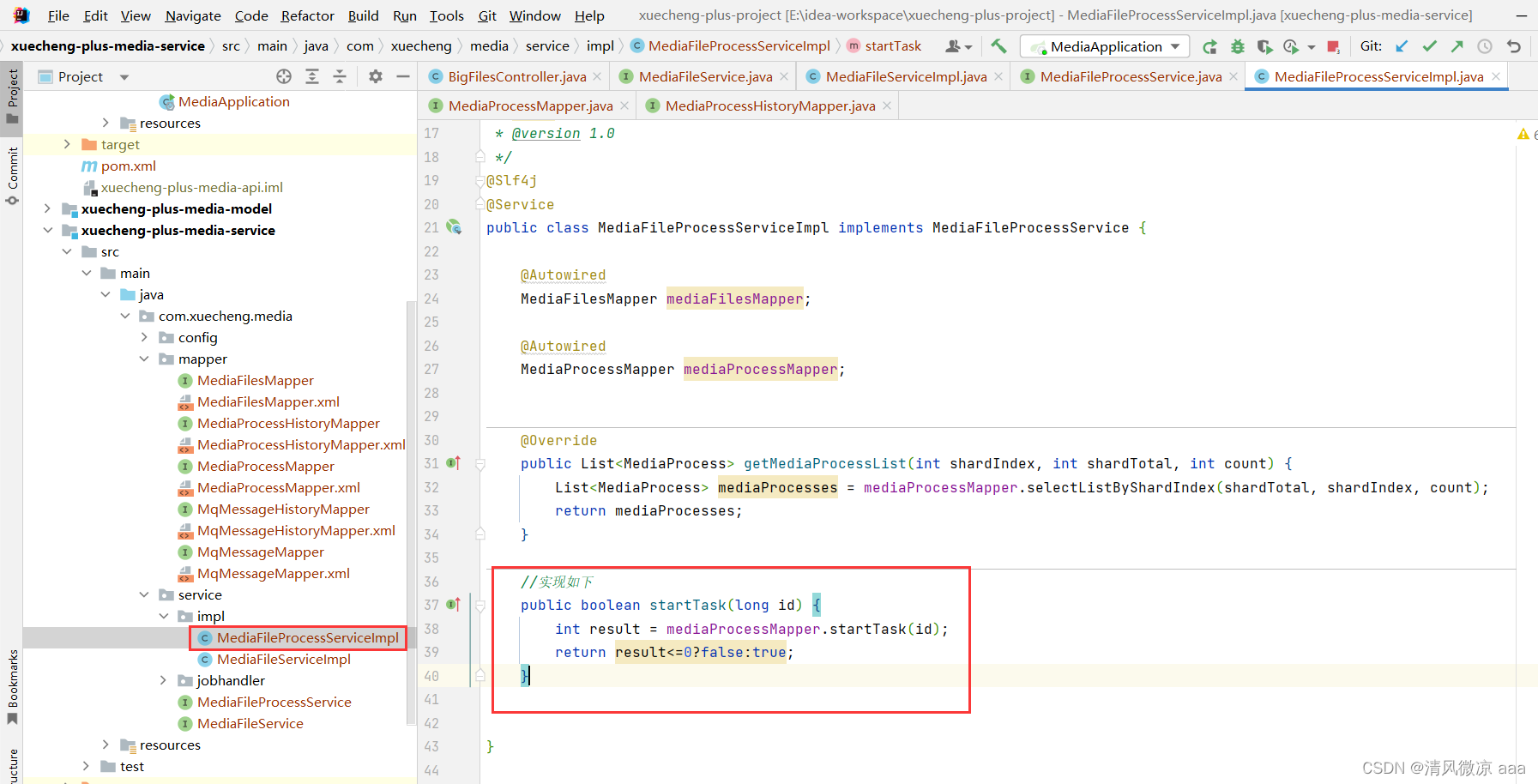

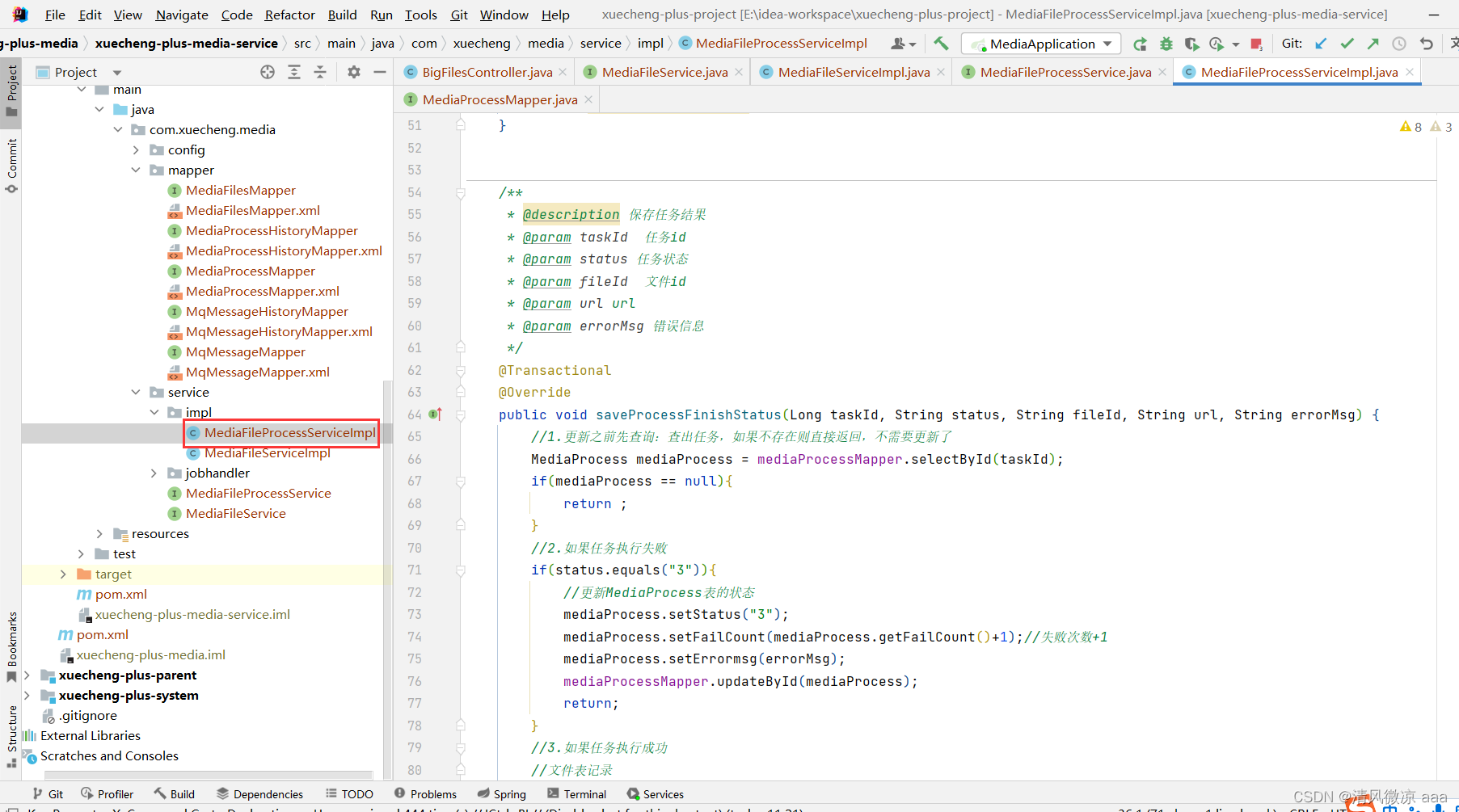

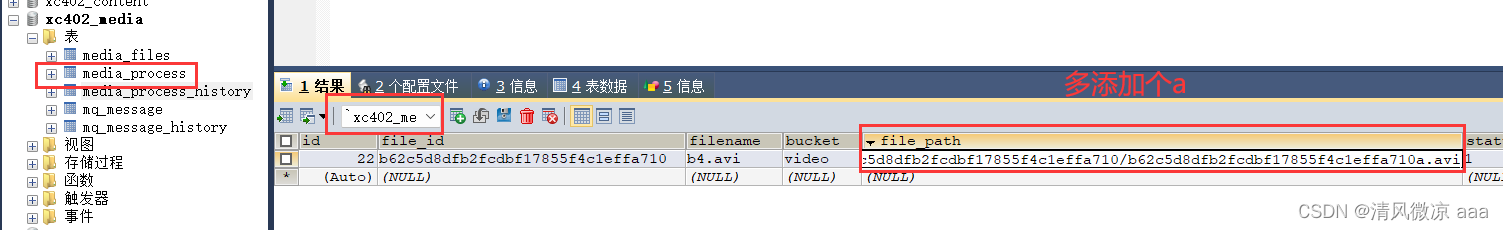

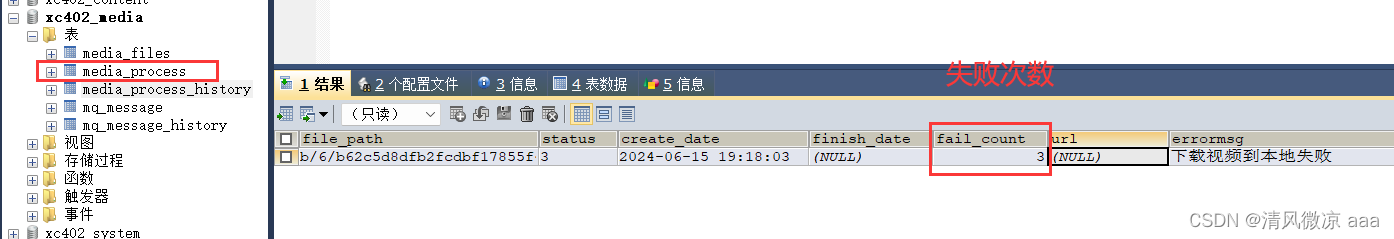

media_process: 待处理视频表。

-

media_process_history: 视频处理历史表,记录已经处理成功的视频信息。

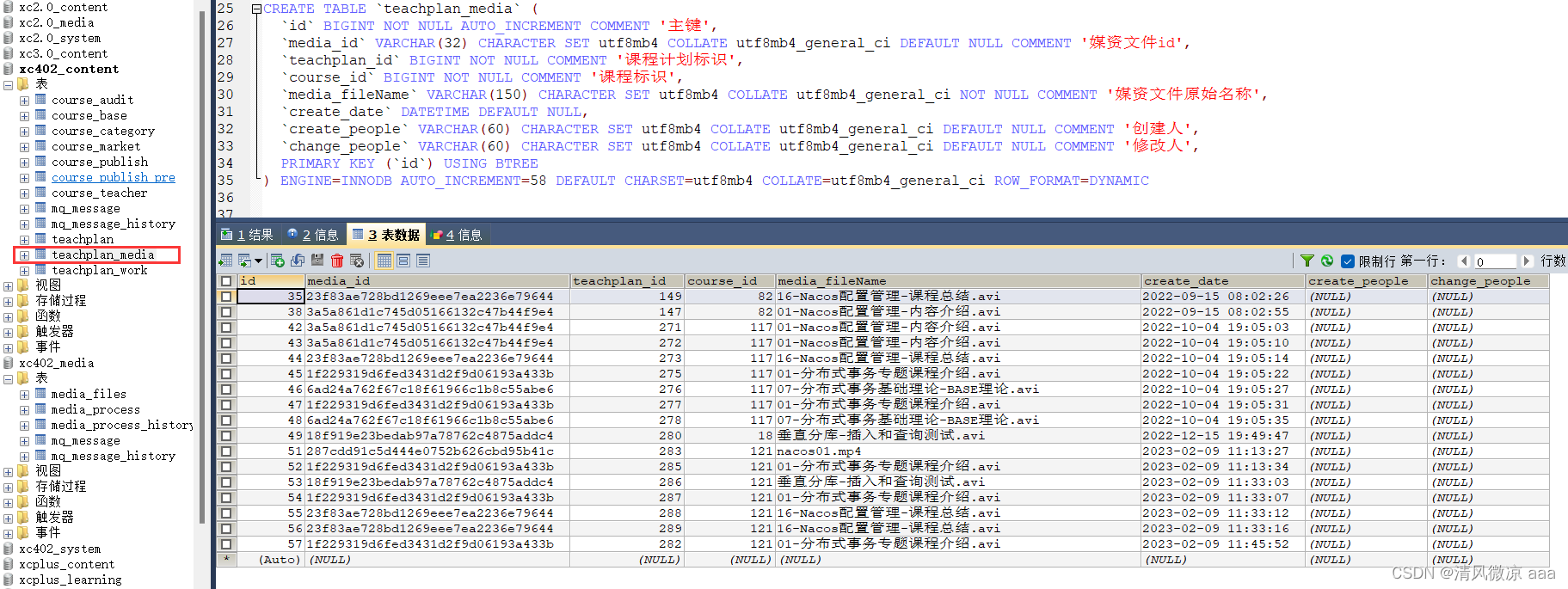

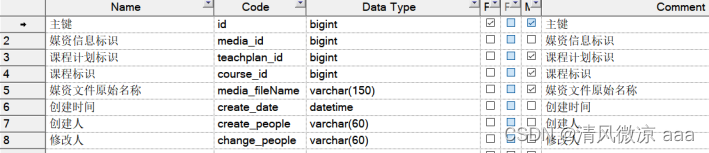

媒资文件与课程计划绑定关系表如下:

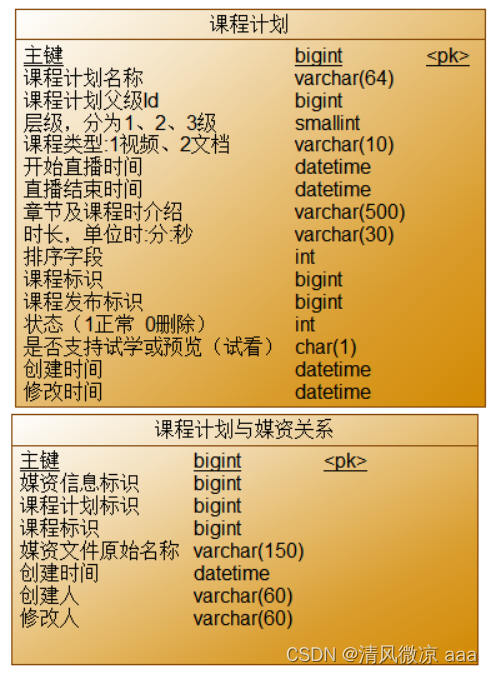

2 搭建模块环境

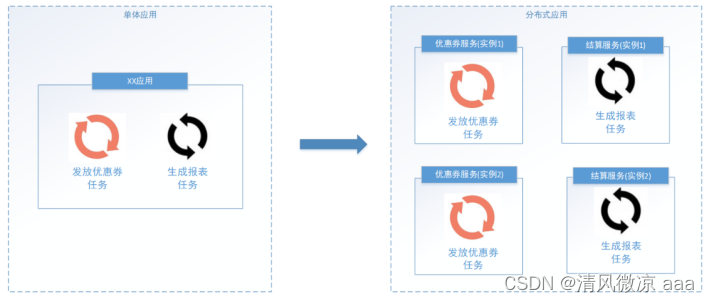

2.1 架构的问题分析

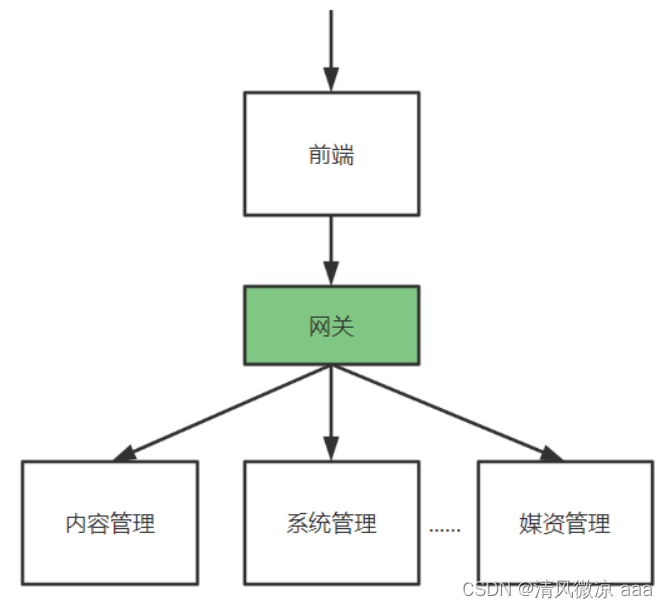

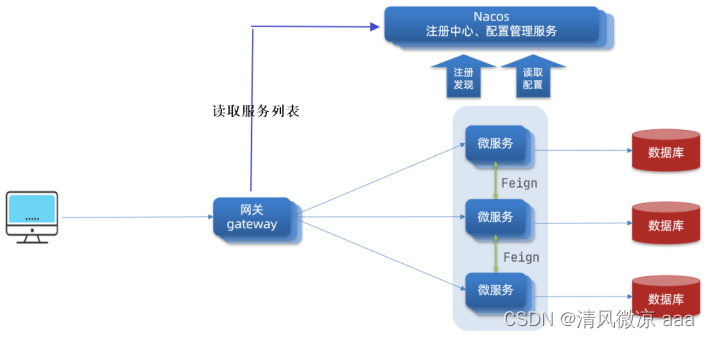

当前要开发的是媒资管理服务,目前为止共三个微服务:内容管理、系统管理、媒资管理,如下图:

后期还会添加更多的微服务,当前这种由前端直接请求微服务的方式存在弊端:

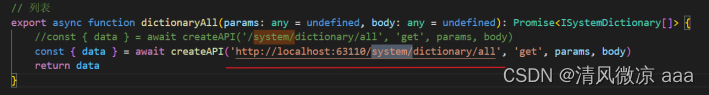

如果在前端对每个请求地址都配置绝对路径,非常不利于系统维护,比如下边代码中请求系统管理服务的地址使用的是localhost

当系统上线后这里需要改成公网的域名,如果这种地址非常多则非常麻烦。

基于这个问题可以采用网关来解决,如下图:

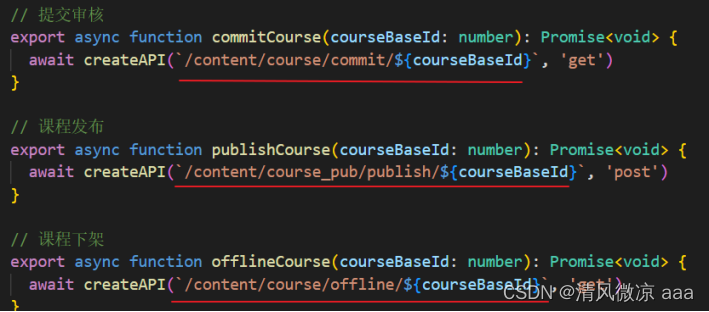

这样在前端的代码中只需要指定每个接口的相对路径,如下所示:

在前端代码的一个固定的地方在接口地址前统一加网关的地址,每个请求统一到网关,由网关将请求转发到具体的微服务。

为什么所有的请求先到网关呢?

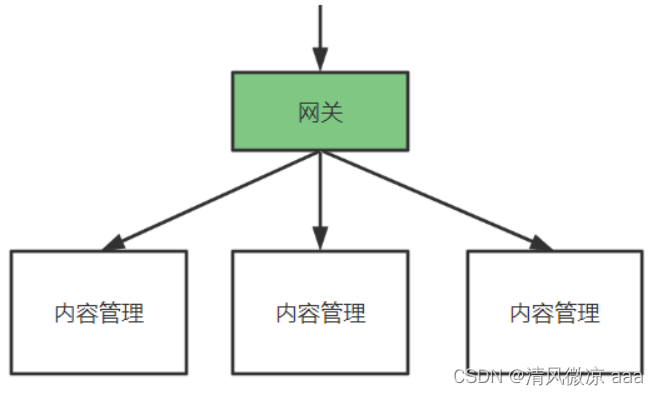

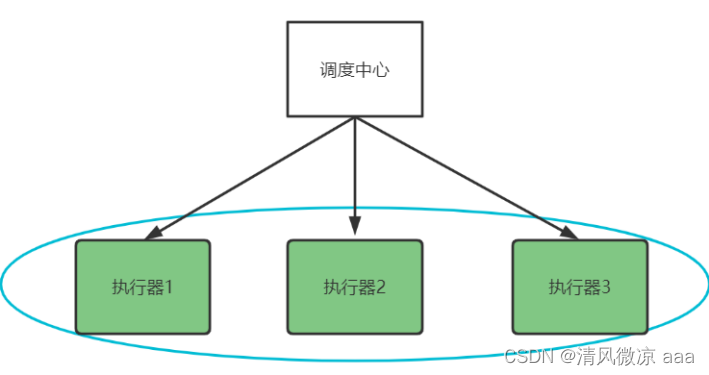

有了网关就可以对请求进行路由,路由到具体的微服务,减少外界对接微服务的成本,比如:400电话,路由的试可以根据请求路径进行路由、根据host地址进行路由等, 当微服务有多个实例时可以通过负载均衡算法进行路由,如下:

另外,网关还可以实现权限控制、限流等功能。

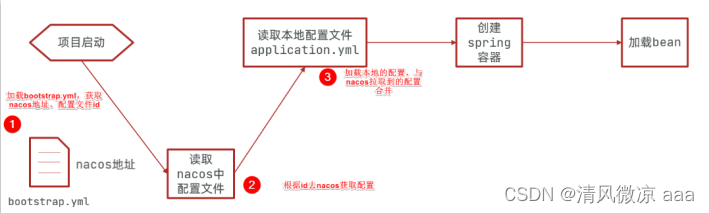

项目采用Spring Cloud Gateway作为网关,网关在请求路由时需要知道每个微服务实例的地址,项目使用Nacos作用服务发现中心和配置中心,整体的架构图如下:

流程如下:

- 微服务启动,将自己注册到Nacos,Nacos记录了各微服务实例的地址。

- 网关从Nacos读取服务列表,包括服务名称、服务地址等。

- 请求到达网关,网关将请求路由到具体的微服务。

要使用网关首先搭建Nacos,Nacos有两个作用:

- 服务发现中心。

微服务将自身注册至Nacos,网关从Nacos获取微服务列表。 - 配置中心。

微服务众多,它们的配置信息也非常复杂,为了提供系统的可维护性,微服务的配置信息统一在Nacos配置。

2.2 搭建Nacos

2.2.1 服务发现中心

- Spring Cloud :一套规范

- Spring Cloud alibaba: nacos服务注册中心,配置中心

- 根据上节讲解的网关的架构图,要使用网关首先搭建Nacos。

- 首先搭建Nacos服务发现中心。

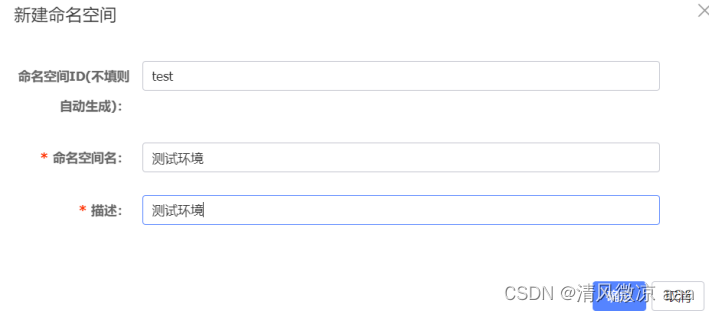

- 在搭建Nacos服务发现中心之前需要搞清楚两个概念:namespace和group

- namespace:用于区分环境、比如:开发环境、测试环境、生产环境。

- group:用于区分项目,比如:xuecheng-plus项目、xuecheng2.0项目

- 首先在nacos配置namespace:

- 登录Centos,启动Naocs,使用sh /data/soft/restart.sh将自动启动Nacos。

- 访问:

http://192.168.101.65:8848/nacos/ - 账号密码:nacos/nacos

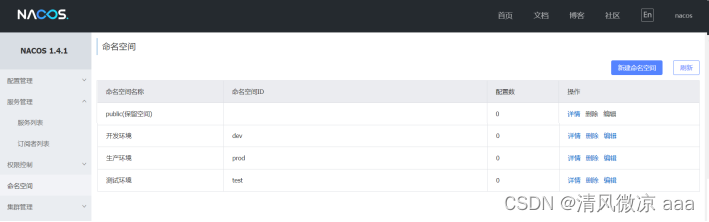

- 登录成功,点击左侧菜单“命名空间”进入命名空间管理界面,

点击“新建命名空间”,填写命名空间的相关信息。如下图:

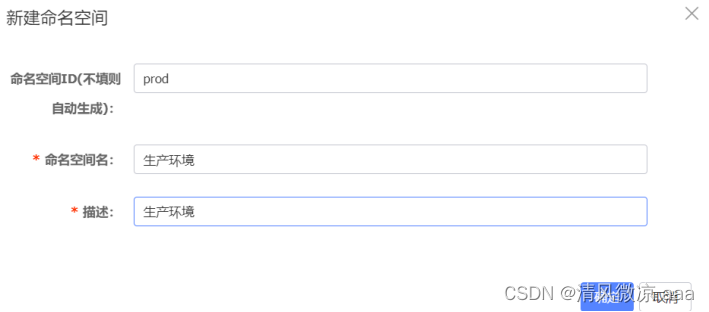

使用相同的方法再创建“测试环境”、"生产环境"的命名空间。

创建成功,如下图:

在教学中可以创建具体班级的命名空间,假如创建1010班级的命名空间,如下:

注意:如果使用dev1010命名空间,在下边的配置中对namespace配置为dev1010。

首先完成各服务注册到Naocs,下边将内容管理服务注册到nacos中。

- 在xuecheng-plus-parent中添加依赖管理

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-alibaba-dependencies</artifactId>

<version>${spring-cloud-alibaba.version}</version>

<type>pom</type>

<scope>import</scope>

</dependency>

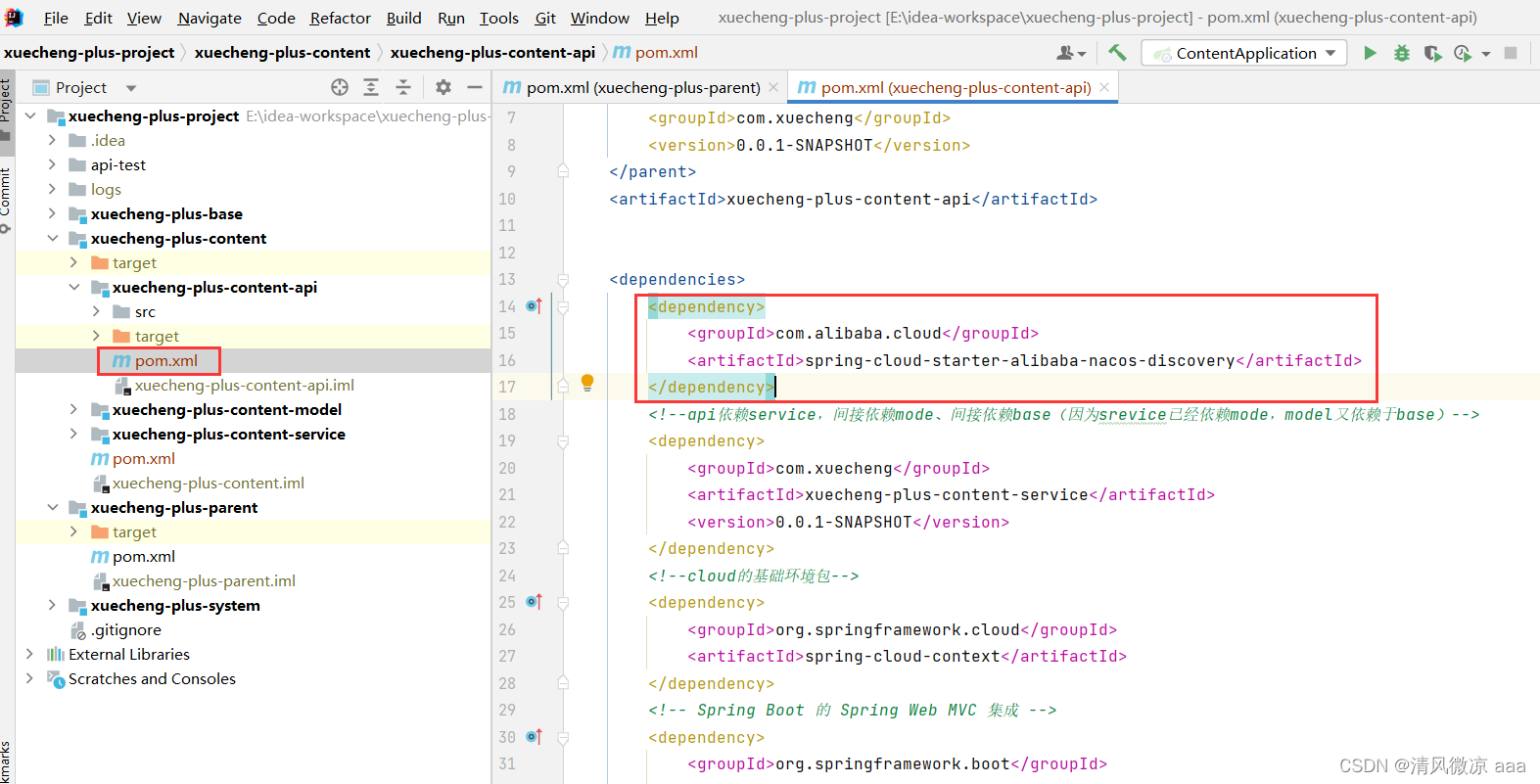

2)在内容管理模块的接口工程中添加如下依赖

- 如果要上报你的服务信息到nacos就要添加这个依赖,内容管理下面有3个工程,那么那么那个服务需要上报呢???

- 那个启动服务就上报那个------api服务

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-starter-alibaba-nacos-discovery</artifactId>

</dependency>

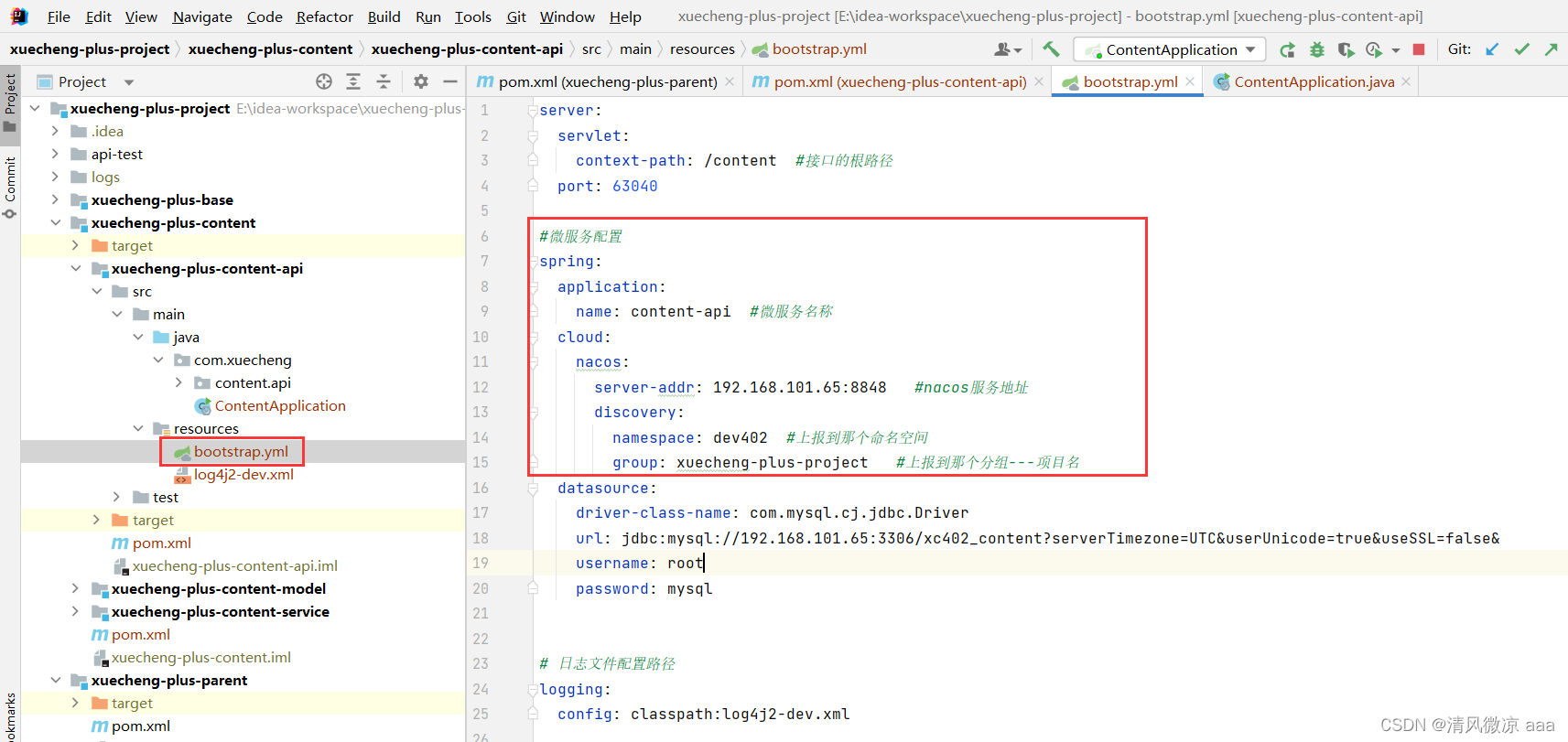

3)配置nacos的地址

在内容管理的接口工程的配置文件中配置如下信息:

#微服务配置

spring:

application:

name: content-api #微服务名称

cloud:

nacos:

server-addr: 192.168.101.65:8848 #nacos服务地址

discovery:

namespace: dev402 #上报到那个命名空间

group: xuecheng-plus-project #上报到那个分组---项目名

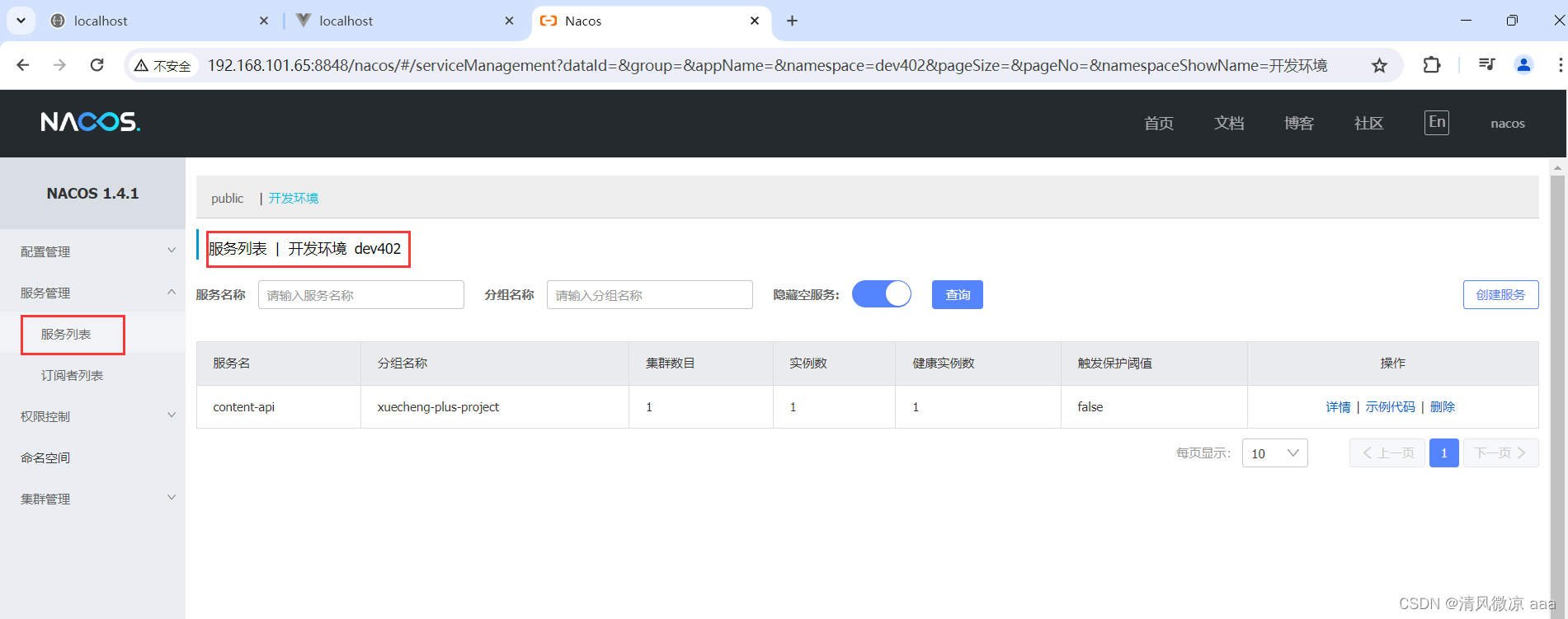

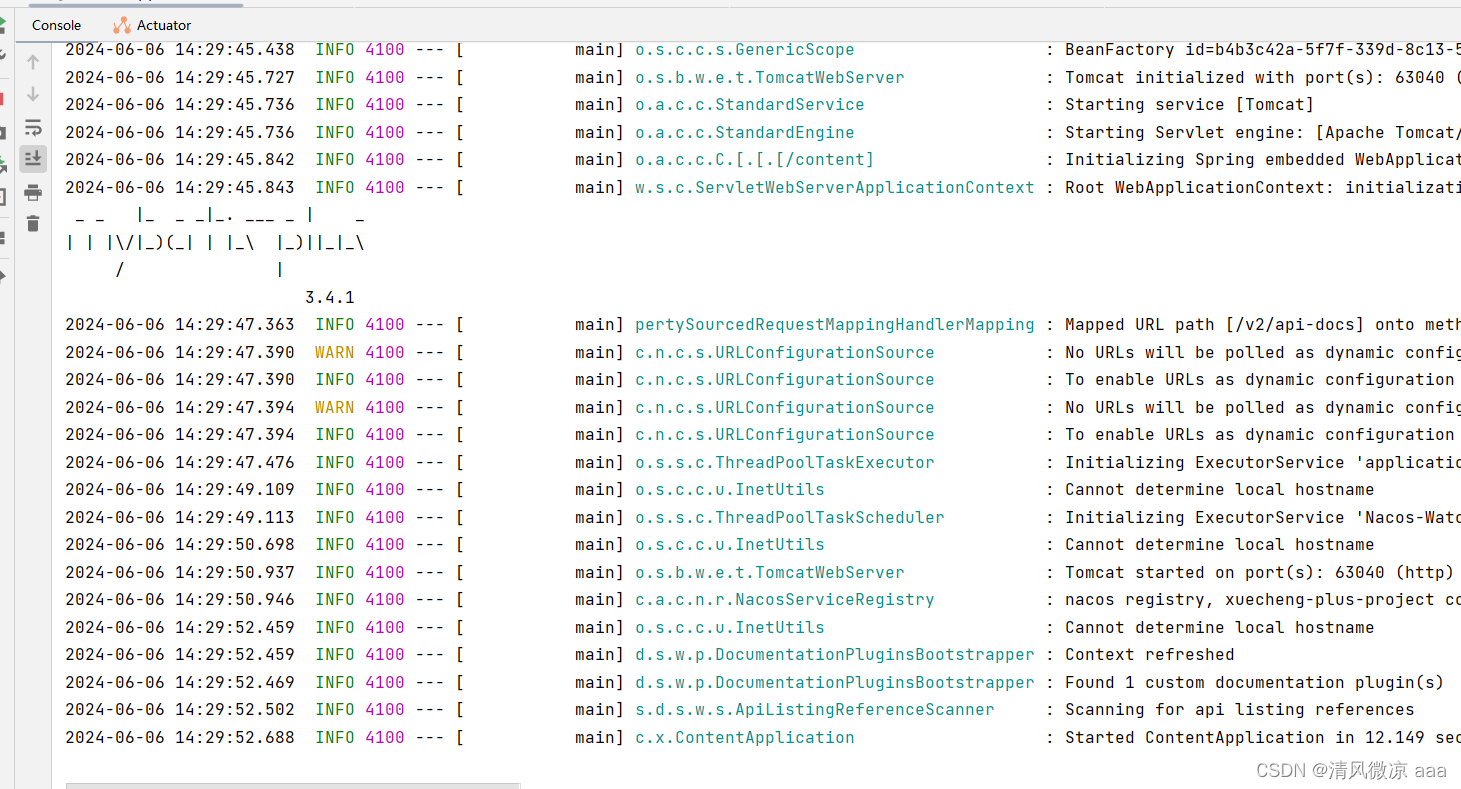

4)重启内容管理服务

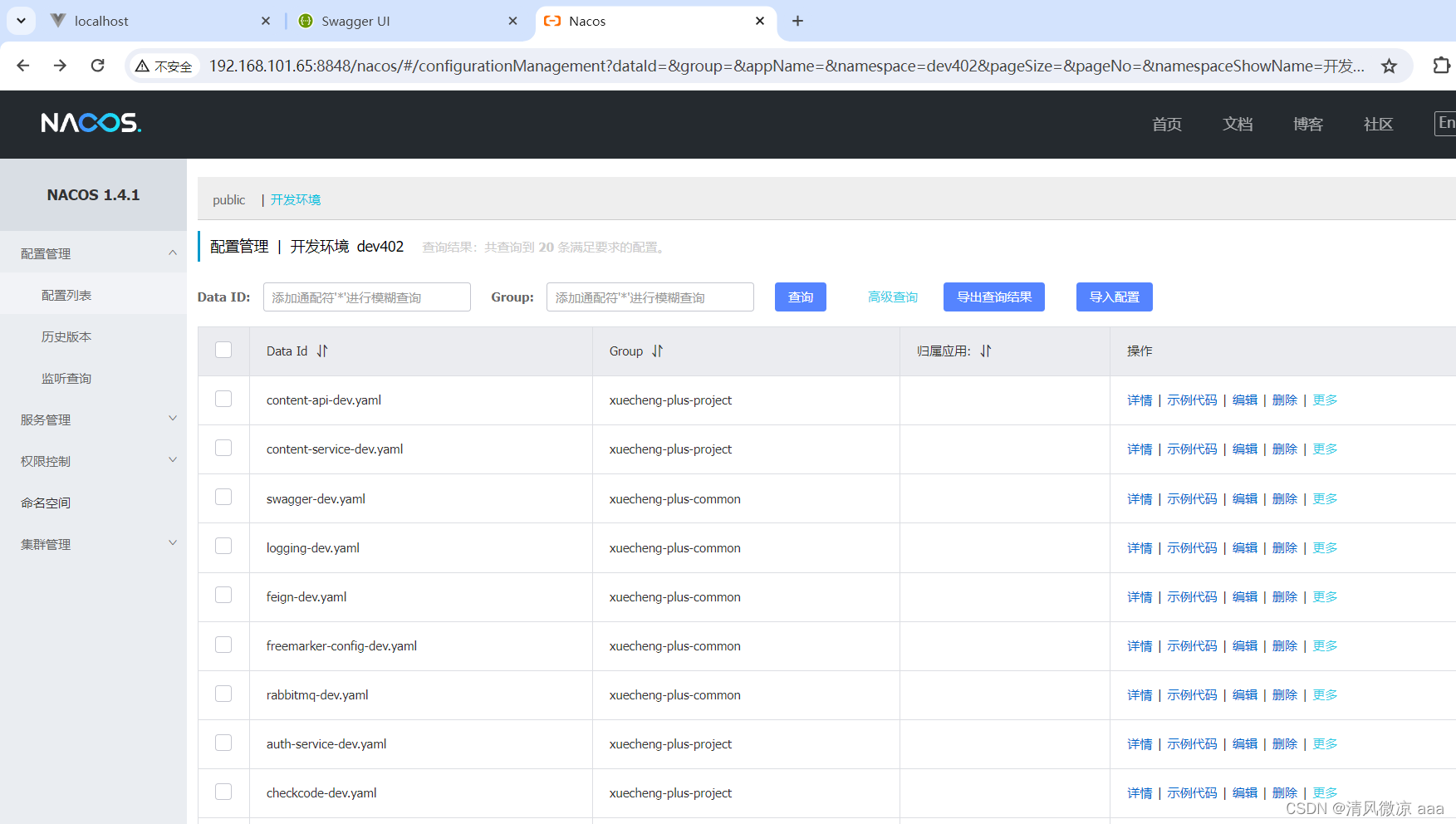

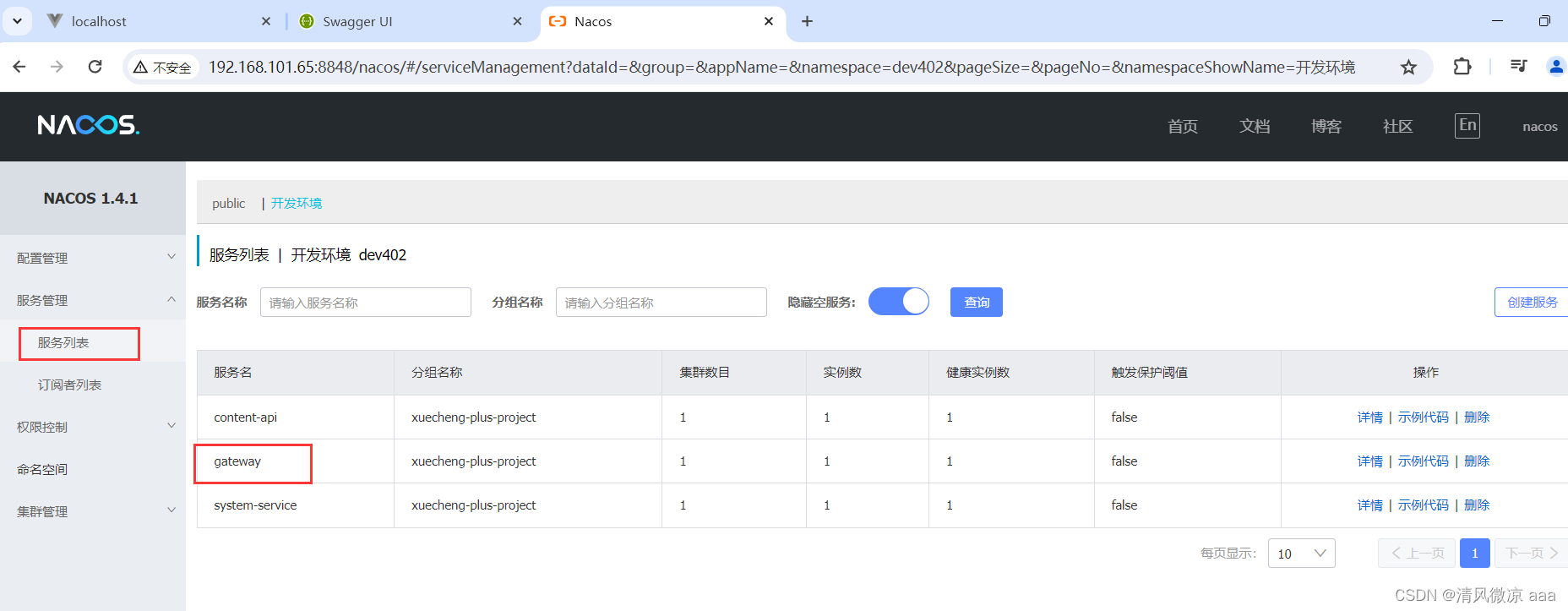

待微服务启动成功,进入Nacos服务查看服务列表

在 “开发环境” 命名空间下有这个服务这说明内容管理微服务在Nacos注册成功。

点击其它一个微服务的“详情”

通过上图可以查看微服务实例的地址。

2.2.2 配置中心

2.2.2.1 配置三要素

搭建完成Nacos服务发现中心,下边搭建Nacos为配置中心,其目的就是通过Nacos去管理项目的所有配置。

先将项目中的配置文件分分类:

1、每个项目特有的配置

是指该配置只在有些项目中需要配置,或者该配置在每个项目中配置的值不同。

比如:spring.application.name每个项目都需要配置但值不一样,以及有些项目需要连接数据库而有些项目不需要,有些项目需要配置消息队列而有些项目不需要。

2、项目所公用的配置

是指在若干项目中配置内容相同的配置。比如:redis的配置,很多项目用的同一套redis服务所以配置也一样。

另外还需要知道nacos如何去定位一个具体的配置文件,即:namespace、group、dataid.

- 通过namespace、group找到具体的环境和具体的项目。

- 通过dataid找到具体的配置文件,dataid有三部分组成

比如:content-service-dev.yaml配置文件 由(content-service)-(dev). (yaml)三部分组成

-

content-service:第一部分,它是在application.yaml中配置的应用名,即spring.application.name的值。

-

dev:第二部分,它是环境名,通过spring.profiles.active指定,

-

Yaml: 第三部分,它是配置文件 的后缀,目前nacos支持properties、yaml等格式类型,本项目选择yaml格式类型。

所以,如果我们要配置content-service工程的配置文件:

- 在开发环境中配置content-service-dev.yaml

- 在测试环境中配置content-service-test.yaml

- 在生产环境中配置content-service-prod.yaml

我们启动项目中传入spring.profiles.active的参数决定引用哪个环境的配置文件,例如:传入spring.profiles.active=dev表示使用dev环境的配置文件即content-service-dev.yaml。

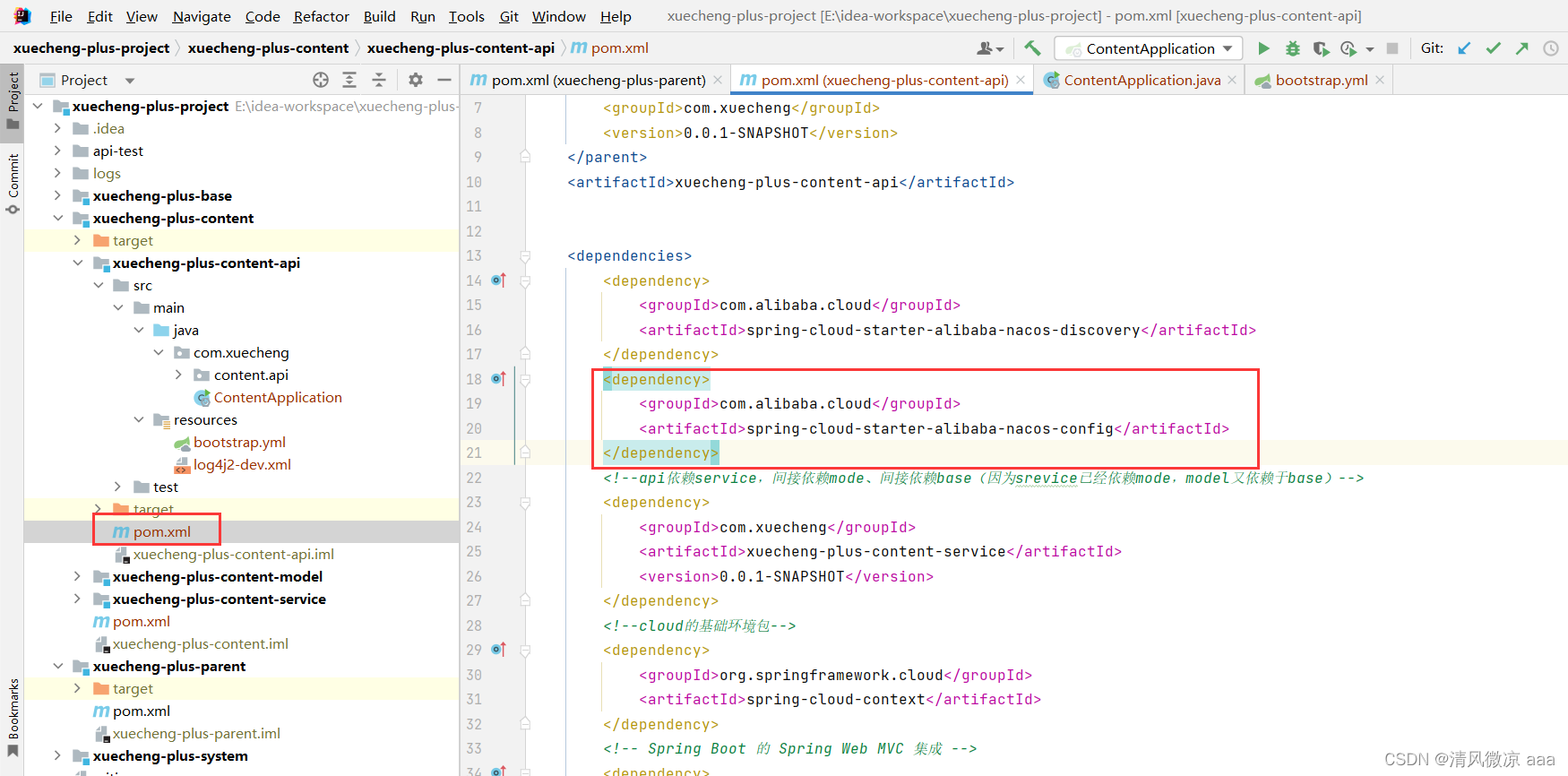

2.2.2.2 配置content-api

在内容管理模块的接口工程配置依赖:

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-starter-alibaba-nacos-config</artifactId>

</dependency>

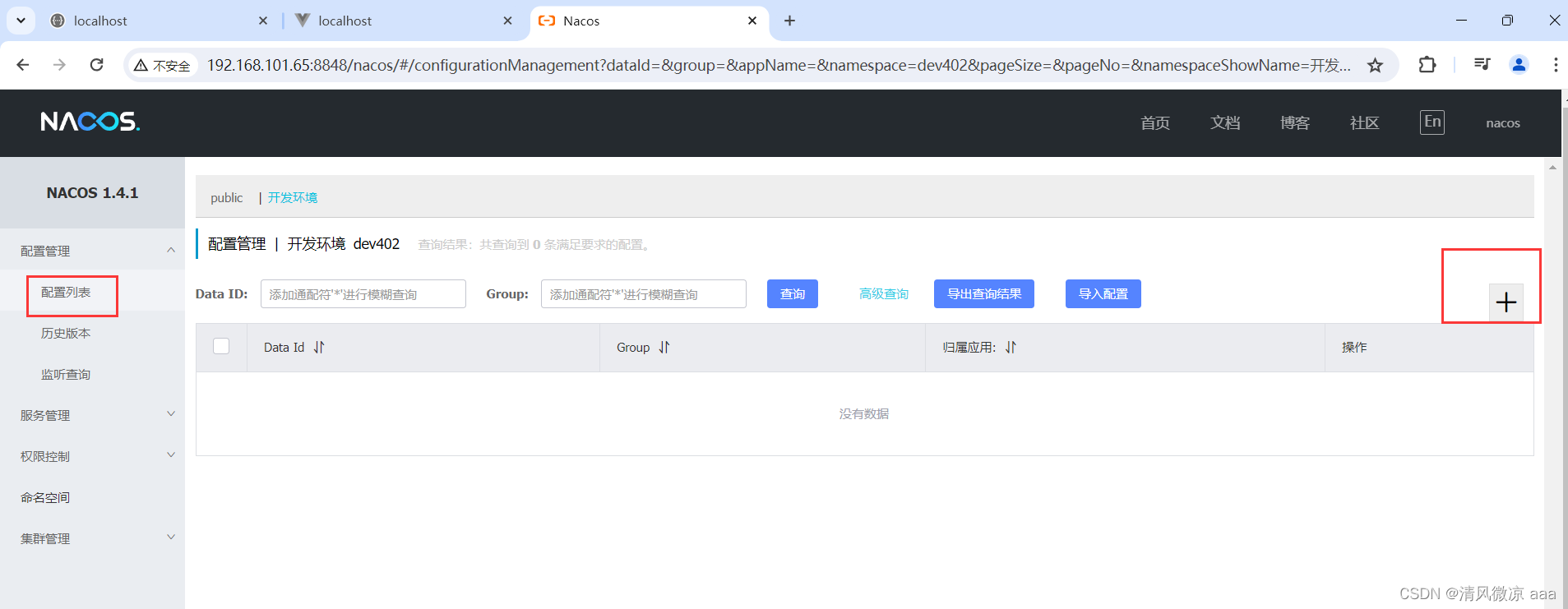

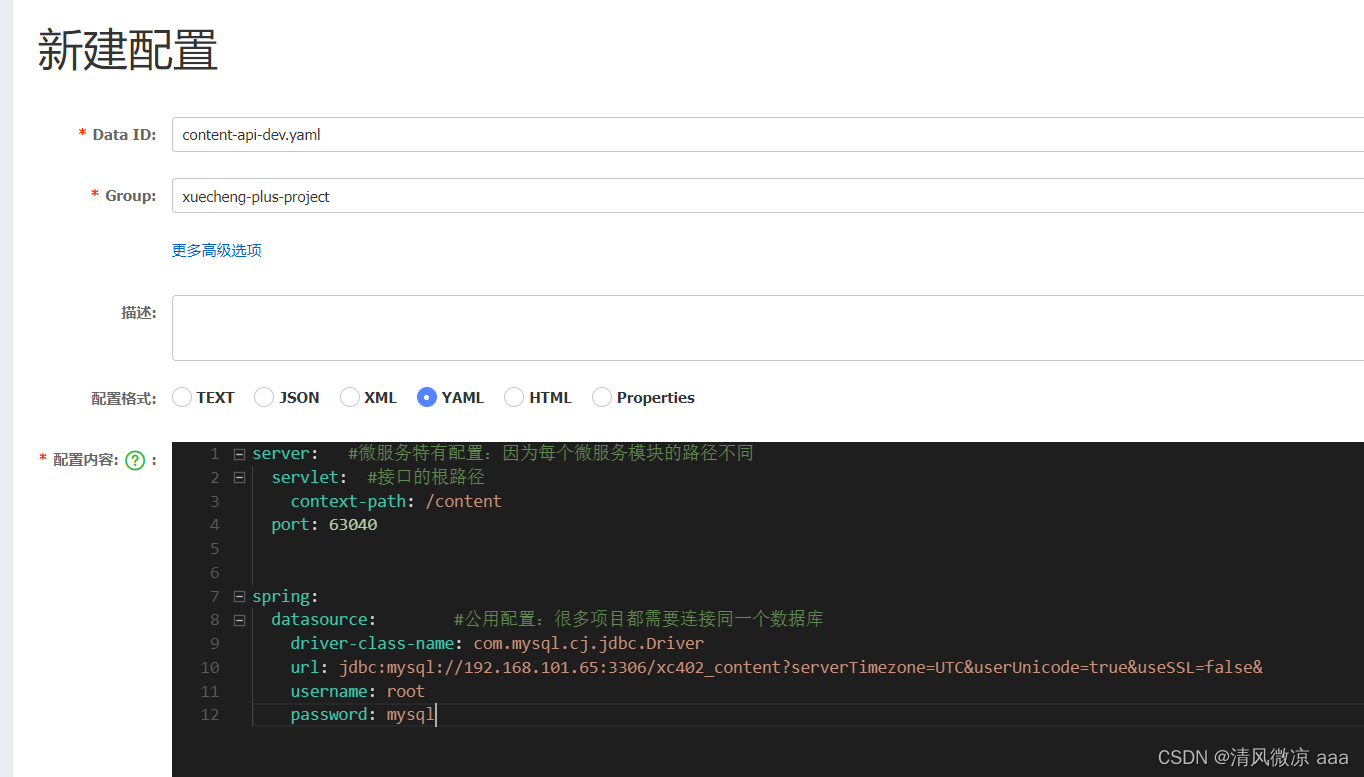

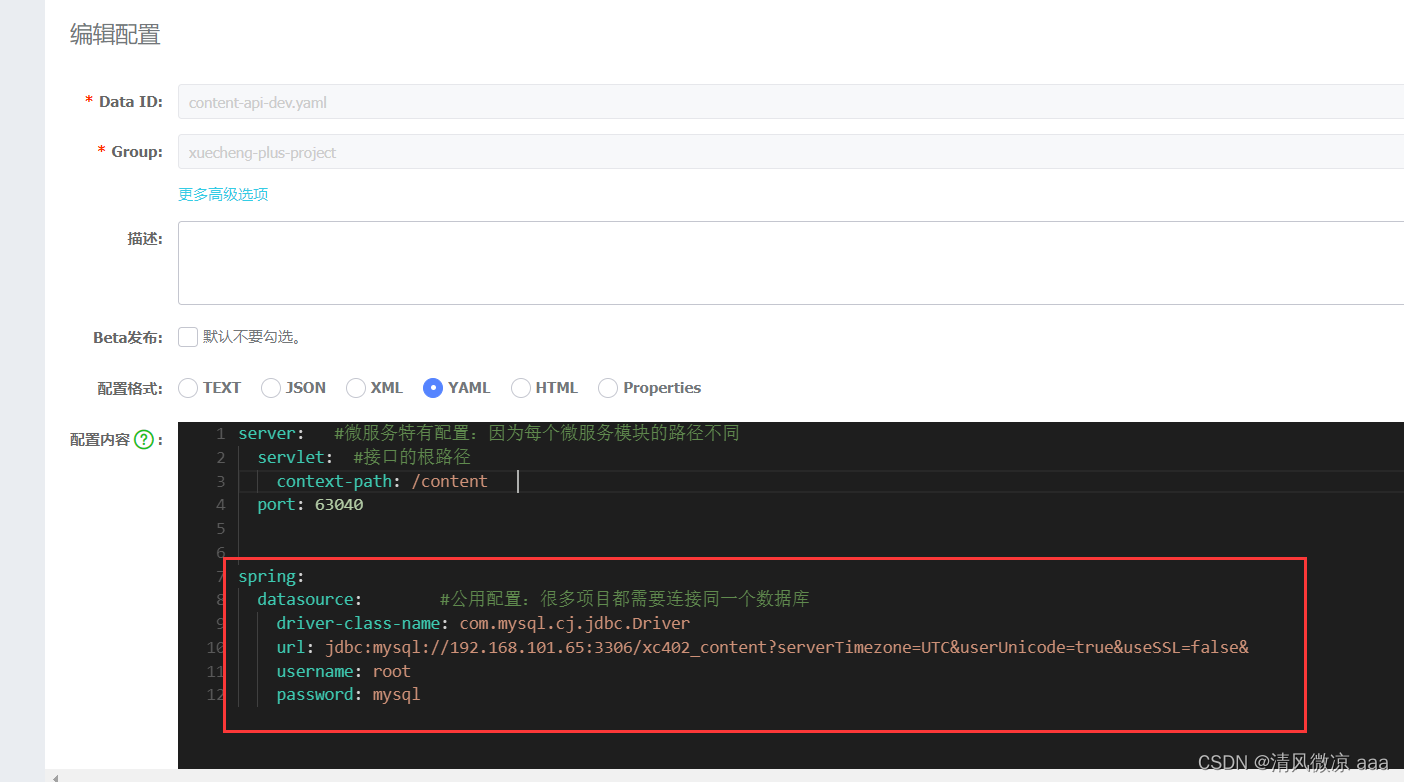

下边以开发环境为例对content-api工程的配置文件进行配置,进入nacos,进入开发环境。

点击加号,添加一个配置

输入data id、group以及配置文件内容。

server:

servlet: #接口的根路径

context-path: /content

port: 63040

spring:

datasource:

driver-class-name: com.mysql.cj.jdbc.Driver

url: jdbc:mysql://192.168.101.65:3306/xc402_content?serverTimezone=UTC&userUnicode=true&useSSL=false&

username: root

password: mysql

为什么没在nacos中配置以下这些微服务的配置,而是放在bootstrap.yaml文件中?

spring:

application:

name: content-api

...

因为刚才说了dataid第一部分就是spring.application.name,nacos 客户端要根据此值确定配置文件 名称,所以spring.application.name不在nacos中配置,而是要在工程的本地进行配置。

因此:与nacos地址和配置文件有关的所有信息都应该放到bootstrap.yaml文件中。

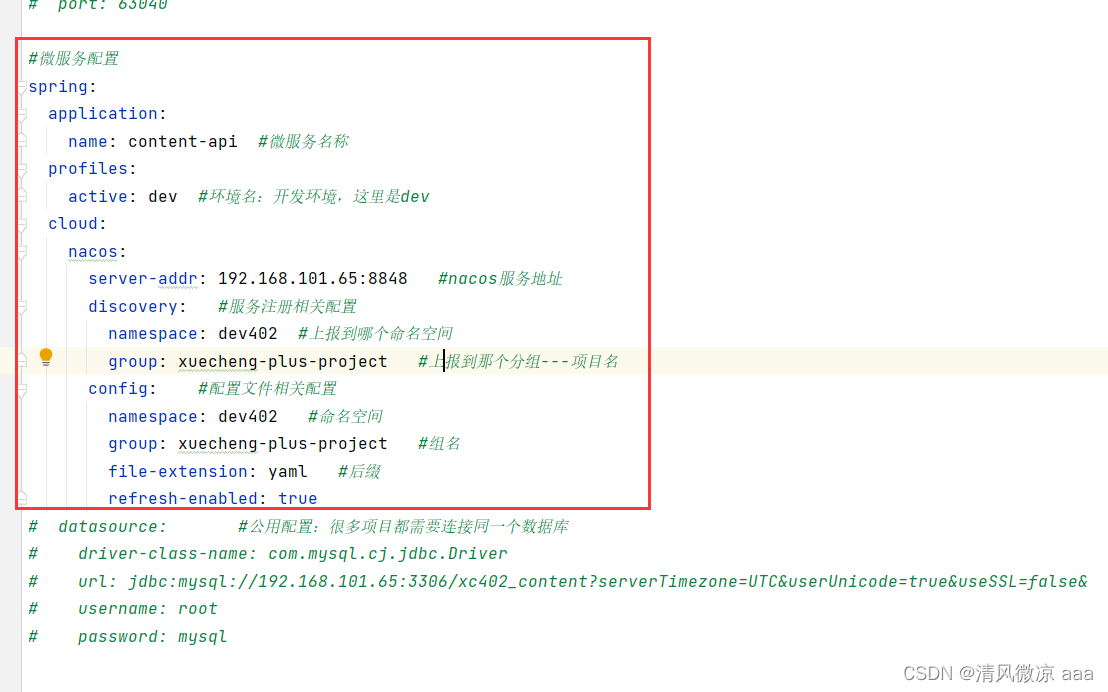

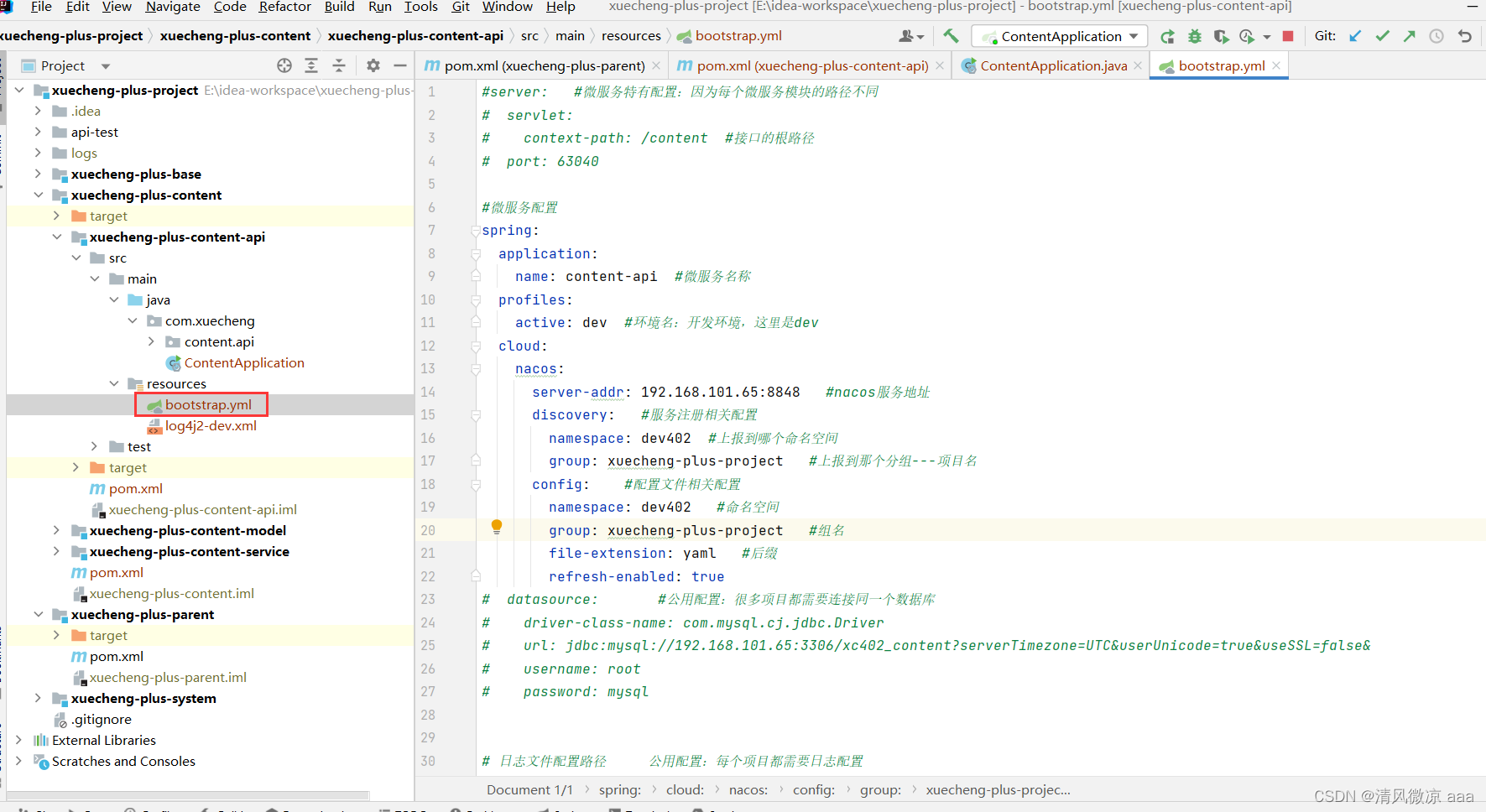

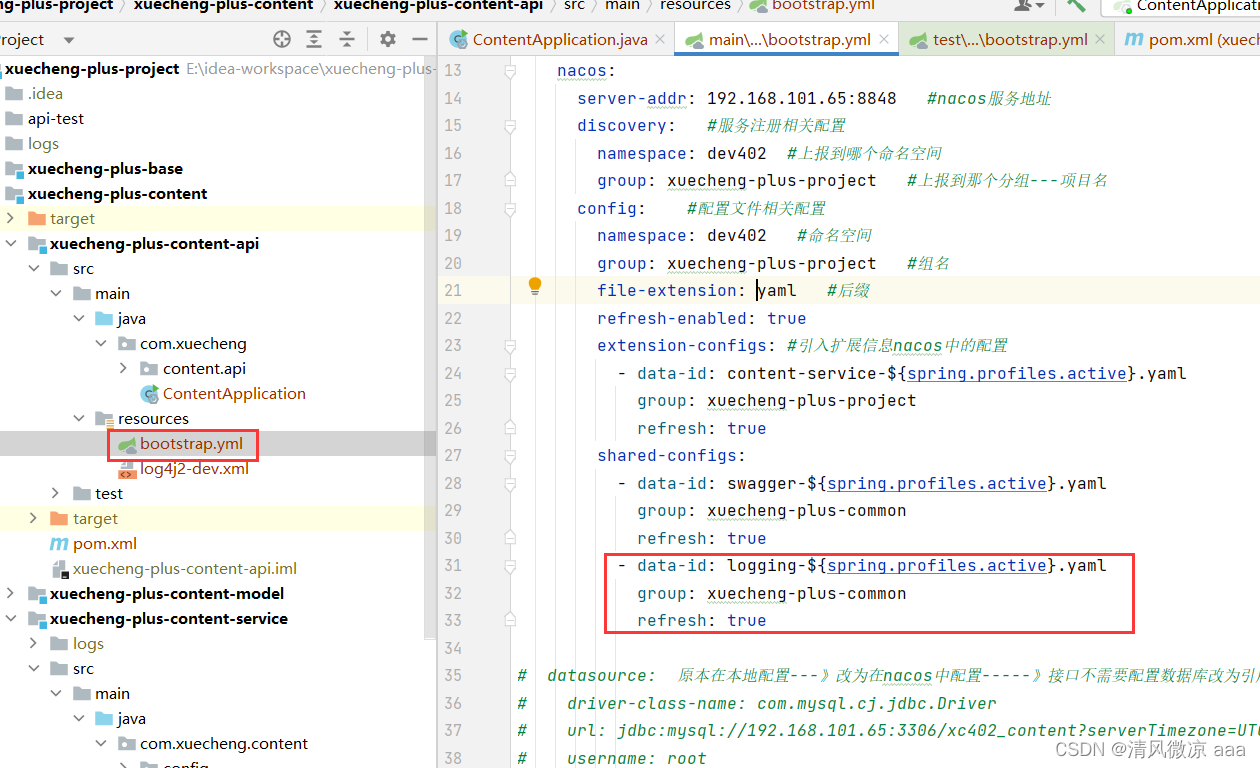

在content-api工程 的本地配置bootstrap.yaml,内容如下:

#server: 改为在nacos中配置

# servlet:

# context-path: /content #接口的根路径

# port: 63040

#微服务配置

spring:

application:

name: content-api #微服务名称

profiles:

active: dev #环境名:开发环境,这里是dev

cloud:

nacos:

server-addr: 192.168.101.65:8848 #nacos服务地址

discovery: #服务注册相关配置

namespace: dev402 #上报到哪个命名空间

group: xuecheng-plus-project #上报到那个分组---项目名

config: #配置文件相关配置

namespace: dev402 #命名空间

group: xuecheng-plus-project #组名

file-extension: yaml #后缀

refresh-enabled: true

# datasource: 原本在本地配置---》改为在nacos中配置-----》接口不需要配置数据库改为引用servce模块配置

# driver-class-name: com.mysql.cj.jdbc.Driver

# url: jdbc:mysql://192.168.101.65:3306/xc402_content?serverTimezone=UTC&userUnicode=true&useSSL=false&

# username: root

# password: mysql

# 日志文件配置路径

logging:

config: classpath:log4j2-dev.xml

swagger:

title: "学成在线内容管理系统"

description: "内容系统管理系统对课程相关信息进行管理"

base-package: com.xuecheng.content

enabled: true

version: 1.0.0

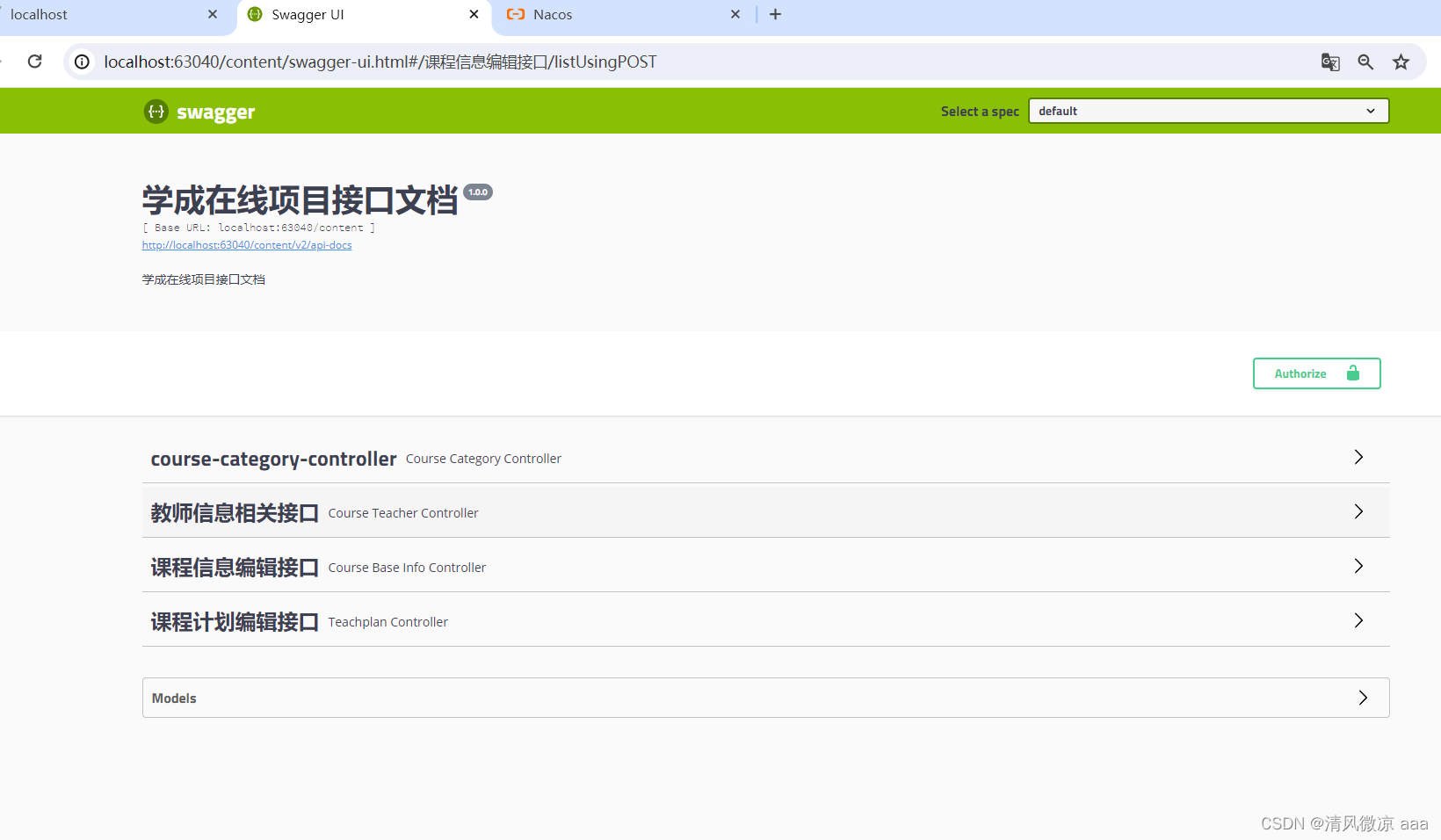

重启content-api服务,并使用Httpclient测试课程查询接口是否可以正常查询。

swagger地址:http://localhost:63040/

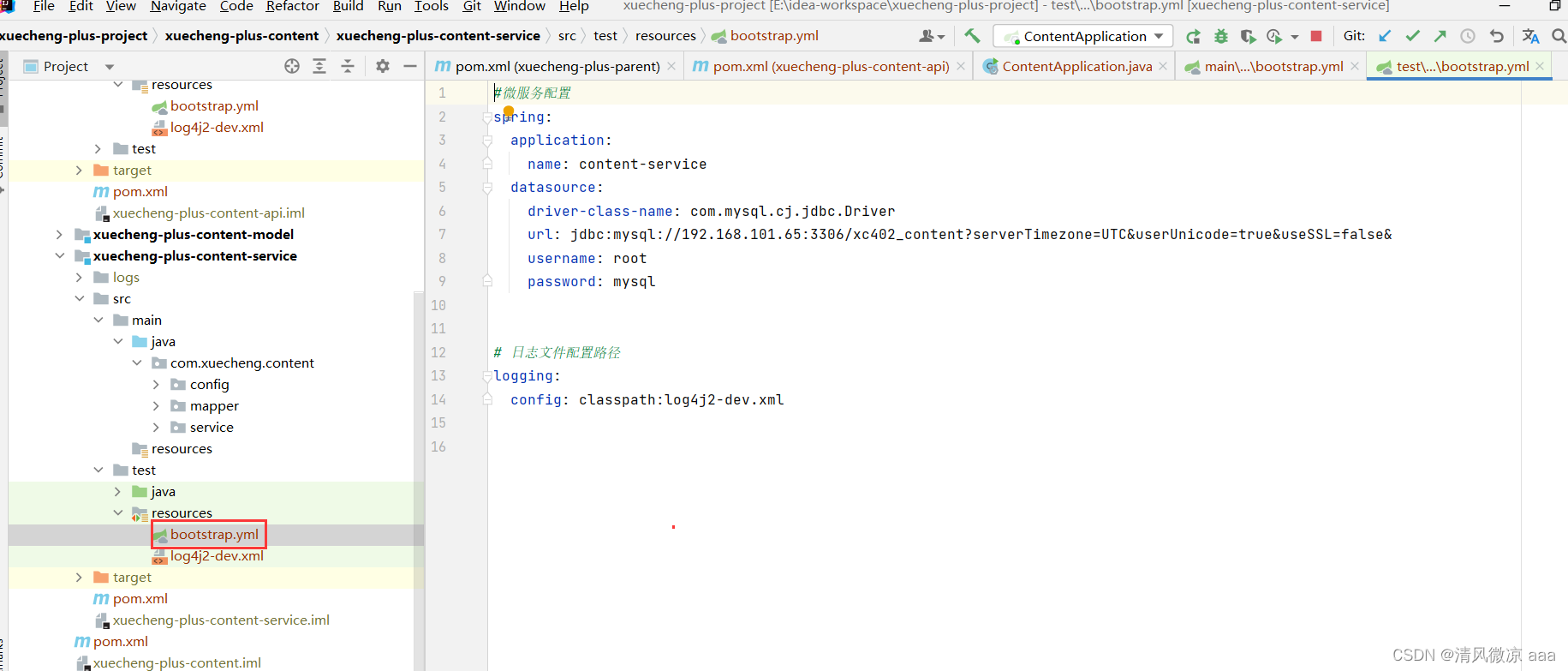

2.2.2.3 配置content-service

当前配置存在的问题:

-

service工程主程序里是没有配置文件的,它的配置文件在test里面,其实这种情况是不用配置的,那为什么这里还要配置呢???

-

content-api接口层本身是不需要连接数据库的,但是我们确实在nacos配置文件中配置了数据库信息。

-

因为接口层依赖了service层代码,当一打包启动的时候他就把service层的mapper、service代码全部依赖到了content-api模块,service模块需要数据库连接所以在api模块配置了数据库连接。但实际上接口层本身就是一个控制层方法不需要配置数据库连接的。

正确的配置方式:

- service该在nacos中该配置的文件仍然配置,然后api工程去引用service的配置,这样在api工程就不需要配置数据库连接了。

- 因为nacos中的配置是项目特有的配置,接口特有的配置是不需要数据库连接的。

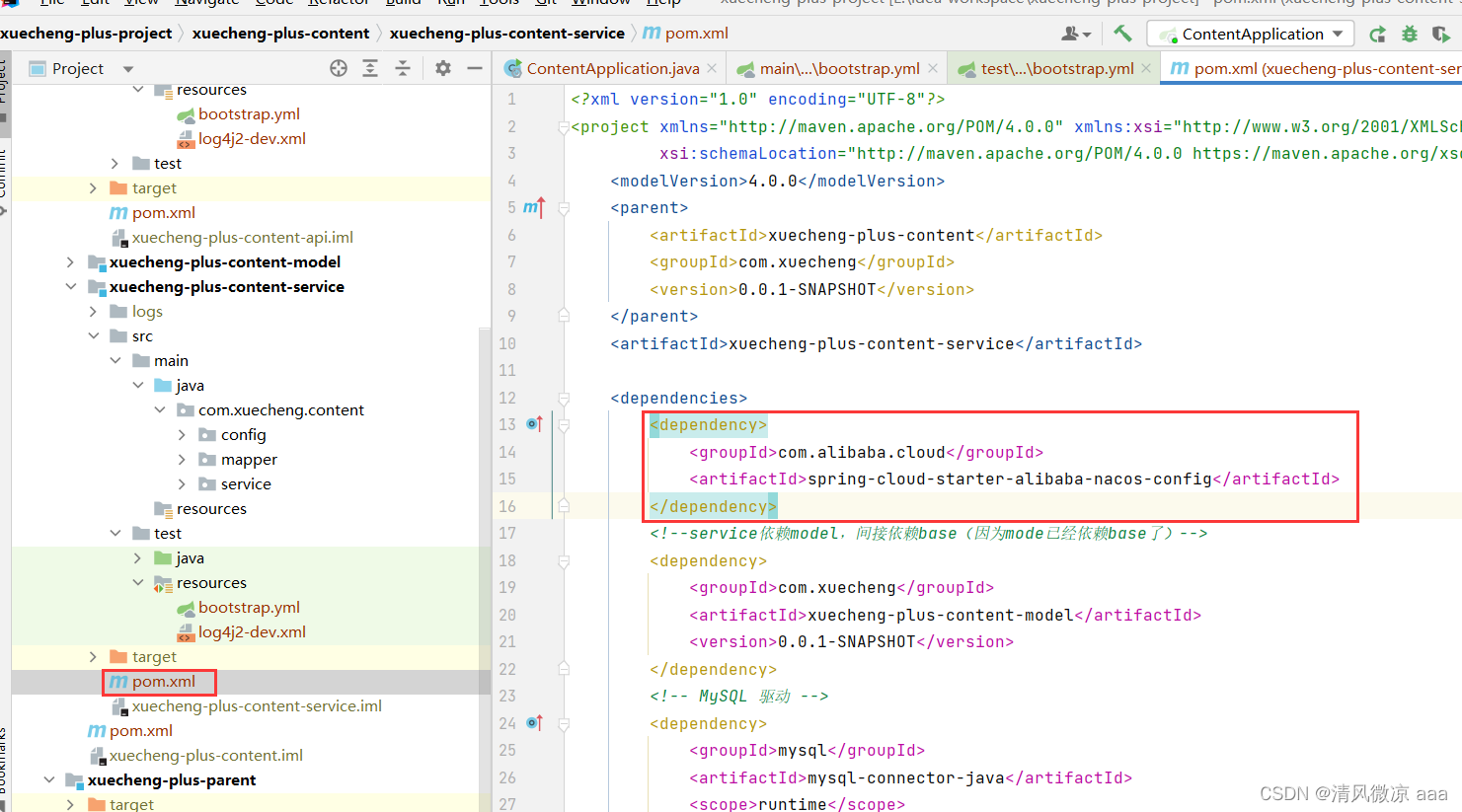

步骤:

第一步:添加依赖(service模块不需要注册到注册中心,所以不需要添加注册依赖和注册的配置)

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-starter-alibaba-nacos-config</artifactId>

</dependency>

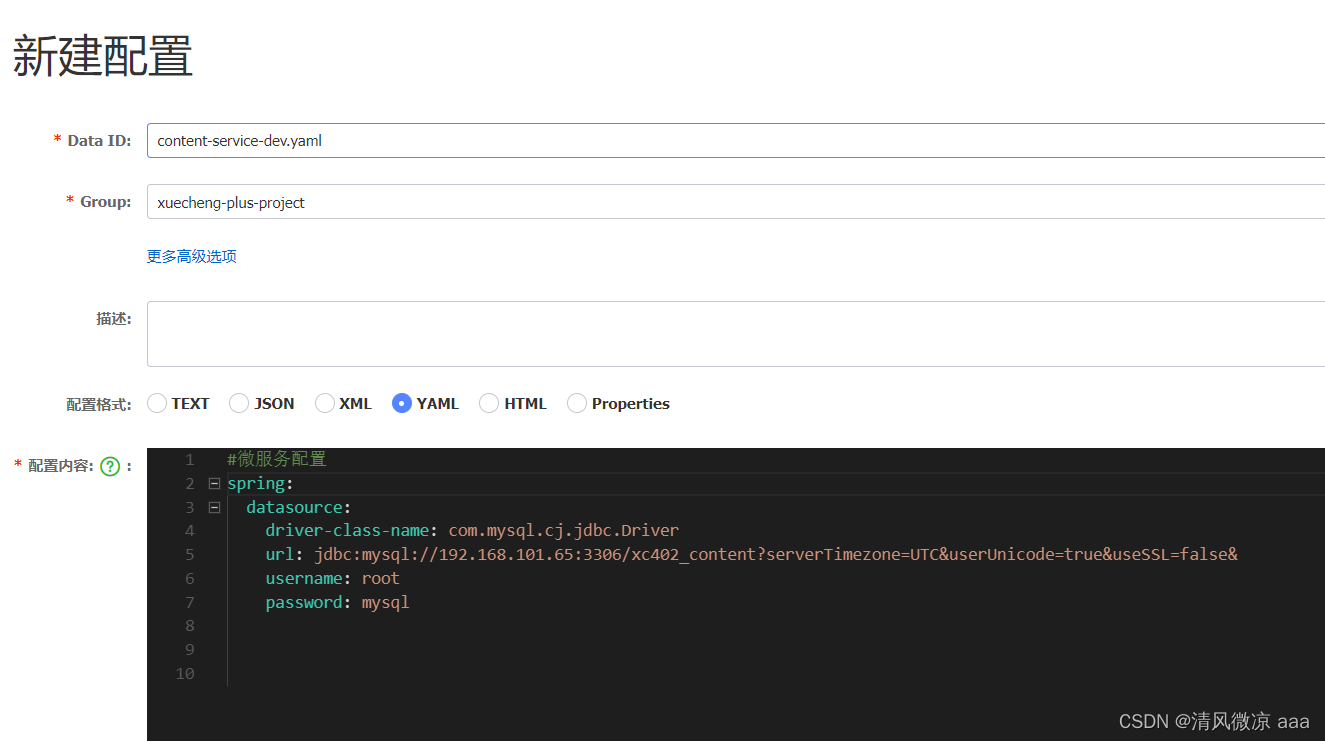

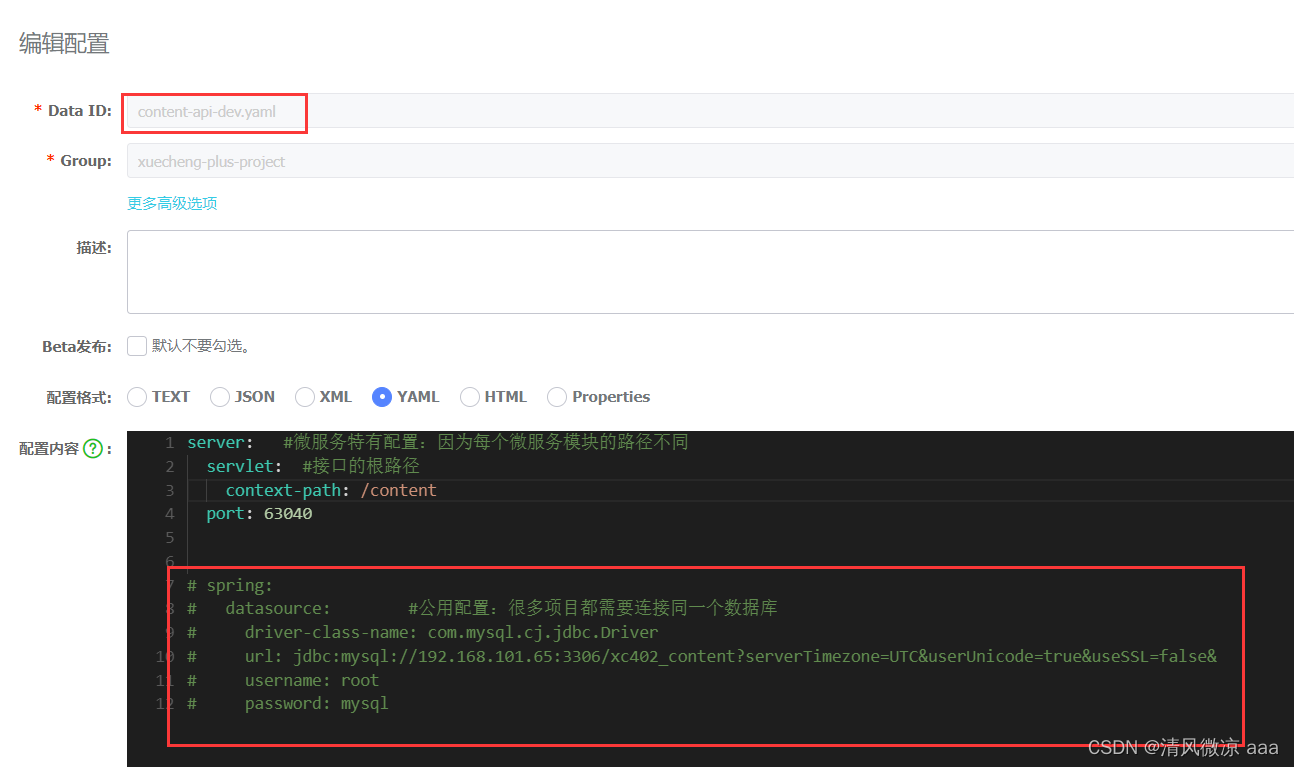

第二步:在nacos中编辑配置文件

#微服务配置

spring:

datasource:

driver-class-name: com.mysql.cj.jdbc.Driver

url: jdbc:mysql://192.168.101.65:3306/xc402_content?serverTimezone=UTC&userUnicode=true&useSSL=false&

username: root

password: mysql

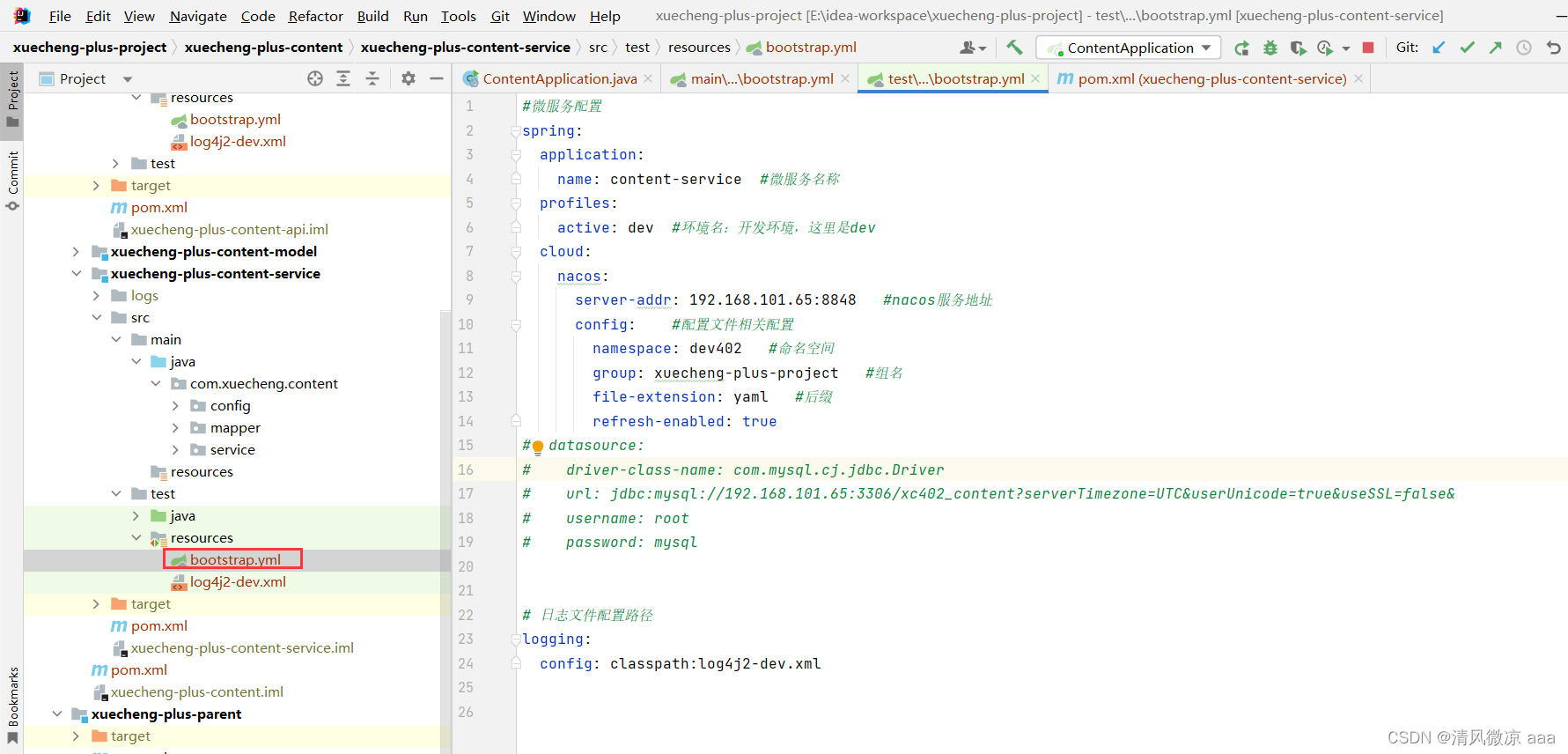

第三步:编辑bootstrap.yaml文件

#微服务配置

spring:

application:

name: content-service #微服务名称

profiles:

active: dev #环境名:开发环境,这里是dev

cloud:

nacos:

server-addr: 192.168.101.65:8848 #nacos服务地址

config: #配置文件相关配置

namespace: dev402 #命名空间

group: xuecheng-plus-project #组名

file-extension: yaml #后缀

refresh-enabled: true

# datasource: 改为在nacos配置了

# driver-class-name: com.mysql.cj.jdbc.Driver

# url: jdbc:mysql://192.168.101.65:3306/xc402_content?serverTimezone=UTC&userUnicode=true&useSSL=false&

# username: root

# password: mysql

# 日志文件配置路径

logging:

config: classpath:log4j2-dev.xml

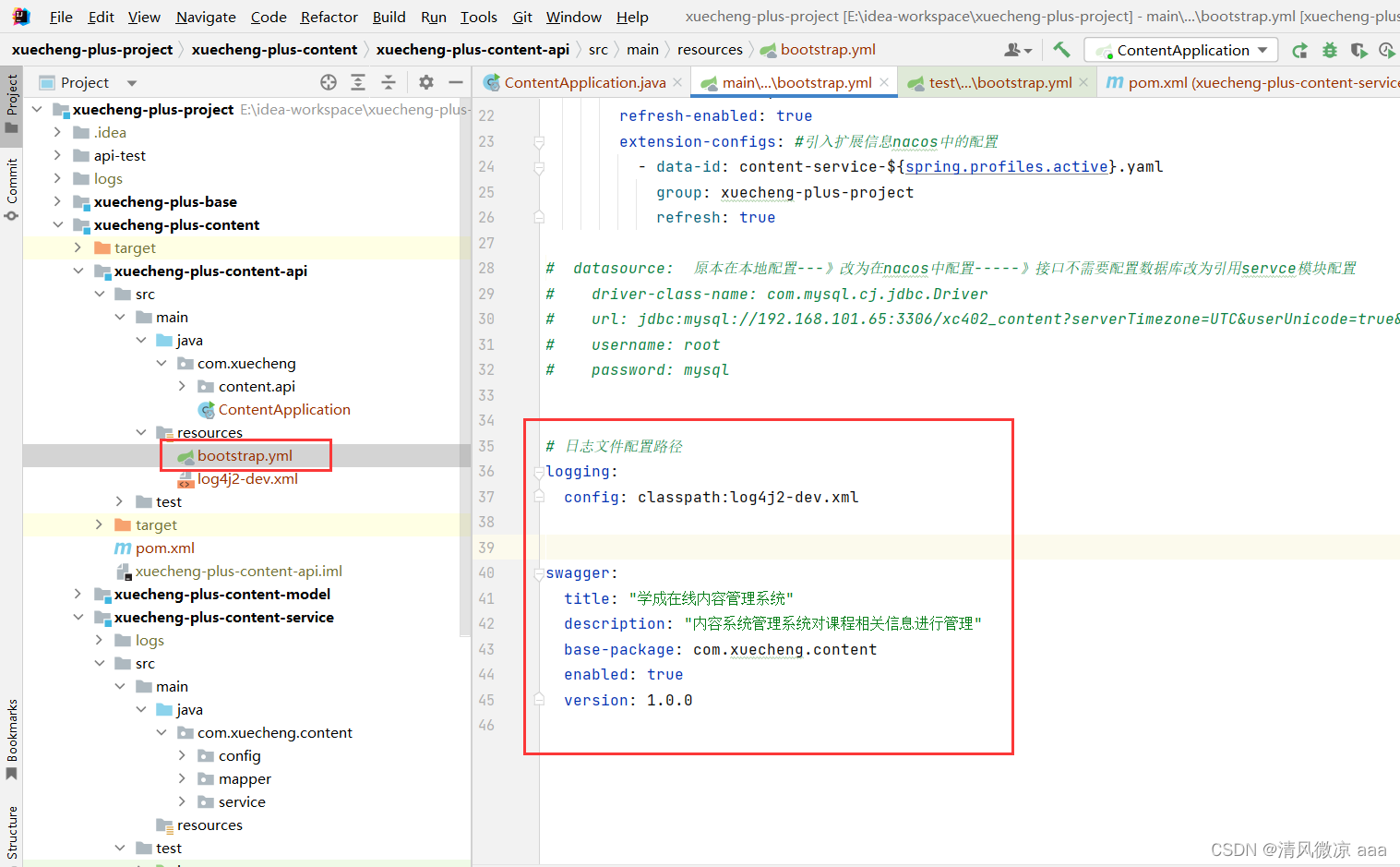

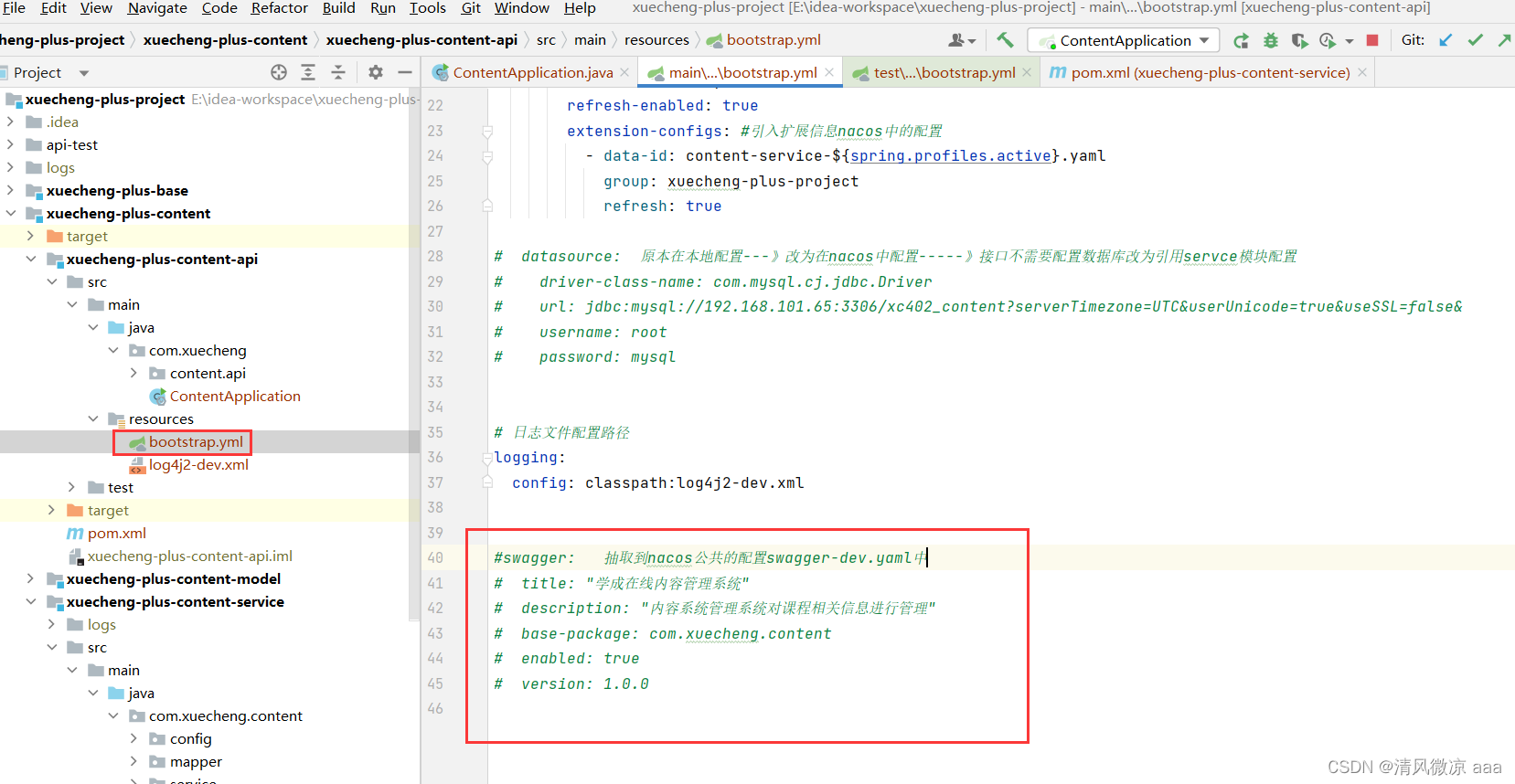

第四步:api接口工程引用service的配置文件

先注释掉api接口的数据库连接信息

注意:因为api接口工程依赖了service工程 的jar,所以这里使用extension-configs扩展配置文件 的方式引用service工程所用到的配置文件。

extension-configs: #引入扩展信息nacos中的配置

- data-id: content-service-${spring.profiles.active}.yaml

group: xuecheng-plus-project

refresh: true

如果添加多个扩展文件,继续在下添加即可,如下:

extension-configs:

- data-id: content-service-${spring.profiles.active}.yaml

group: xuecheng-plus-project

refresh: true

- data-id: 填写文件 dataid

group: xuecheng-plus-project

refresh: true

重启content-api服务,并使用Httpclient测试课程查询接口是否可以正常查询。

swagger地址:http://localhost:63040/

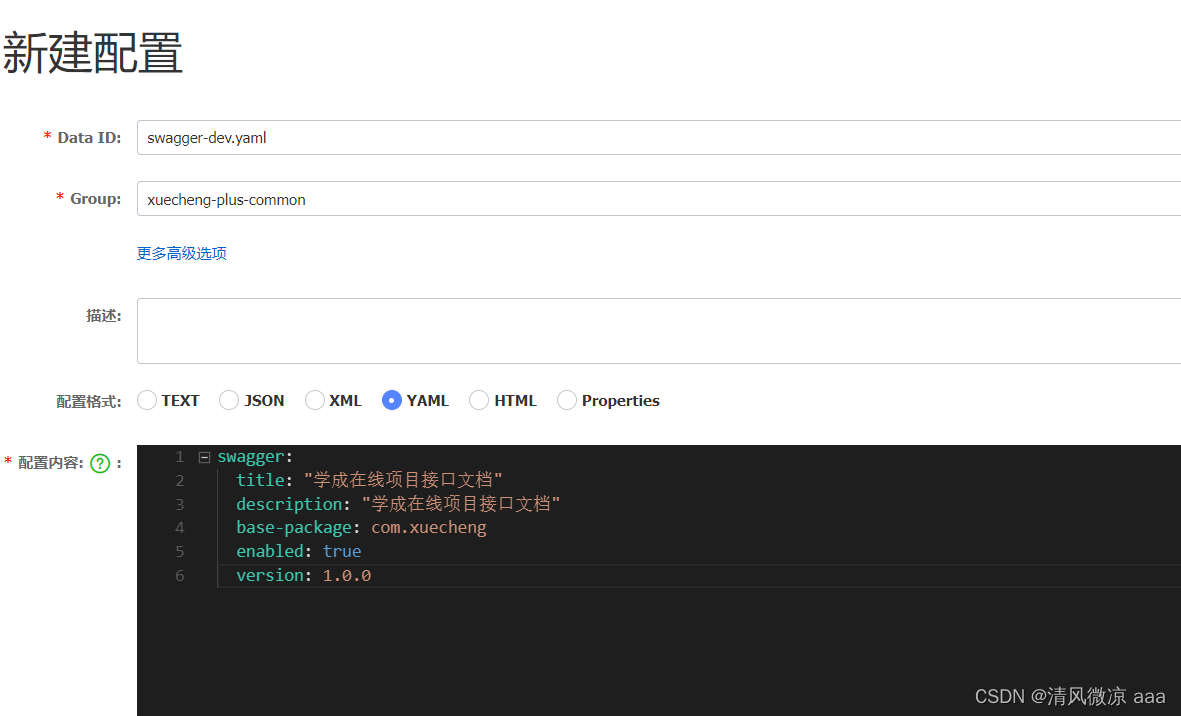

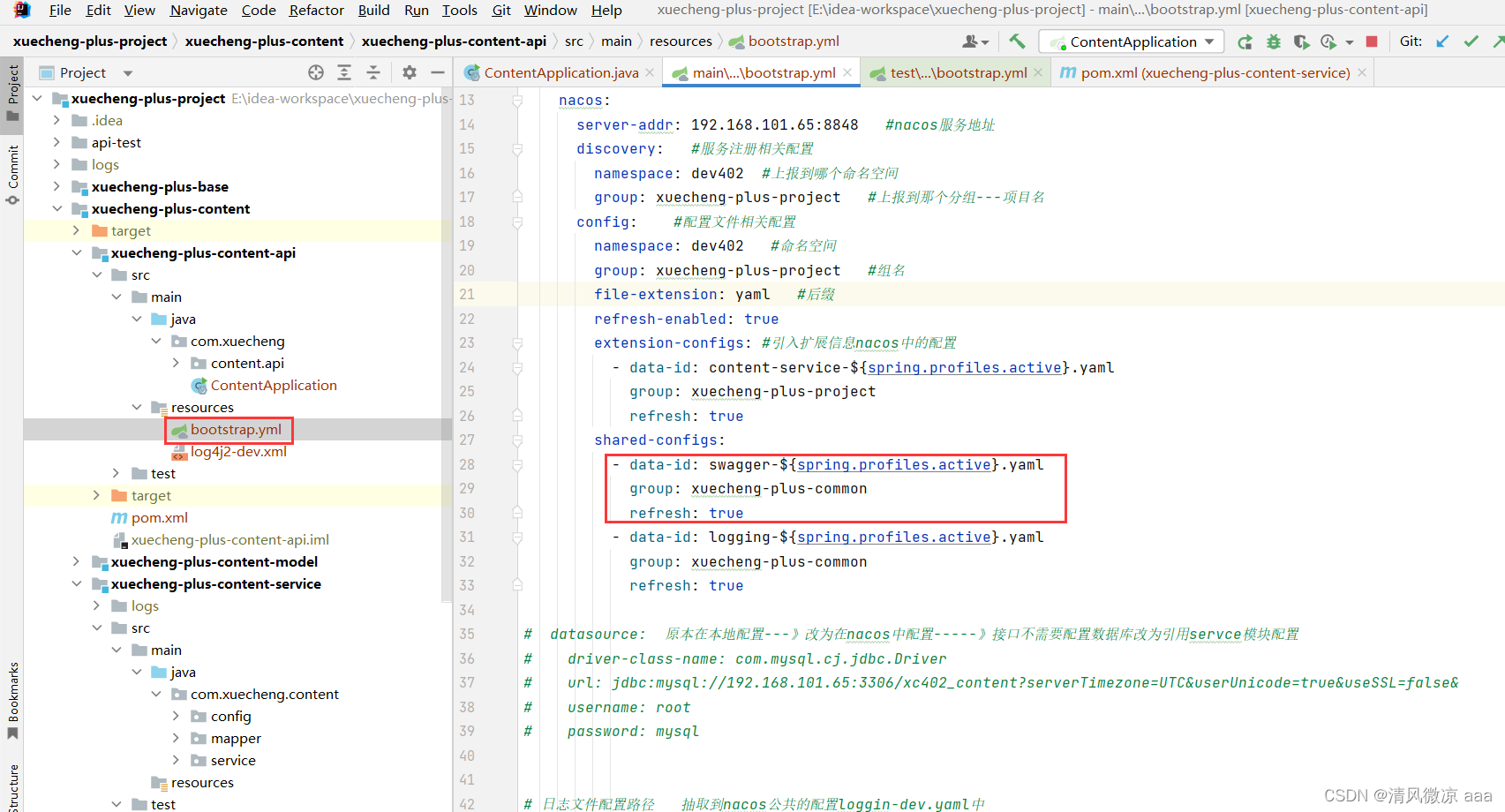

2.2.3 公用配置

还有一个优化的点是如何在nacos中配置项目的公用配置呢?

nacos提供了shared-configs可以引入公用配置。

在content-api中配置了swagger,所有的接口工程 都需要配置swagger,这里就可以将swagger的配置定义为一个公用配置,哪个项目用引入即可。

单独在xuecheng-plus-common分组下创建xuecheng-plus的公用配置,进入nacos的开发环境,添加swagger-dev.yaml公用配置

#注意是通用的,所以把数据改一下

swagger:

title: "学成在线项目接口文档"

description: "学成在线项目接口文档"

base-package: com.xuecheng

enabled: true

version: 1.0.0

删除接口工程中对swagger的配置。

项目使用shared-configs可以引入公用配置。在接口工程的本地配置文件 中引入公用配置,如下:

#server: 抽取到nacos-api配置中

# servlet:

# context-path: /content #接口的根路径

# port: 63040

#微服务配置

spring:

application:

name: content-api #微服务名称

profiles:

active: dev #环境名:开发环境,这里是dev

cloud:

nacos:

server-addr: 192.168.101.65:8848 #nacos服务地址

discovery: #服务注册相关配置

namespace: dev402 #上报到哪个命名空间

group: xuecheng-plus-project #上报到那个分组---项目名

config: #配置文件相关配置

namespace: dev402 #命名空间

group: xuecheng-plus-project #组名

file-extension: yaml #后缀

refresh-enabled: true

extension-configs: #引入扩展信息nacos中的配置

- data-id: content-service-${spring.profiles.active}.yaml

group: xuecheng-plus-project

refresh: true

shared-configs: #引入nacos公有文件中的配置

- data-id: swagger-${spring.profiles.active}.yaml

group: xuecheng-plus-common

refresh: true

- data-id: logging-${spring.profiles.active}.yaml

group: xuecheng-plus-common

refresh: true

# datasource: 原本在本地配置---》改为在nacos中配置-----》接口不需要配置数据库改为引用servce模块配置

# driver-class-name: com.mysql.cj.jdbc.Driver

# url: jdbc:mysql://192.168.101.65:3306/xc402_content?serverTimezone=UTC&userUnicode=true&useSSL=false&

# username: root

# password: mysql

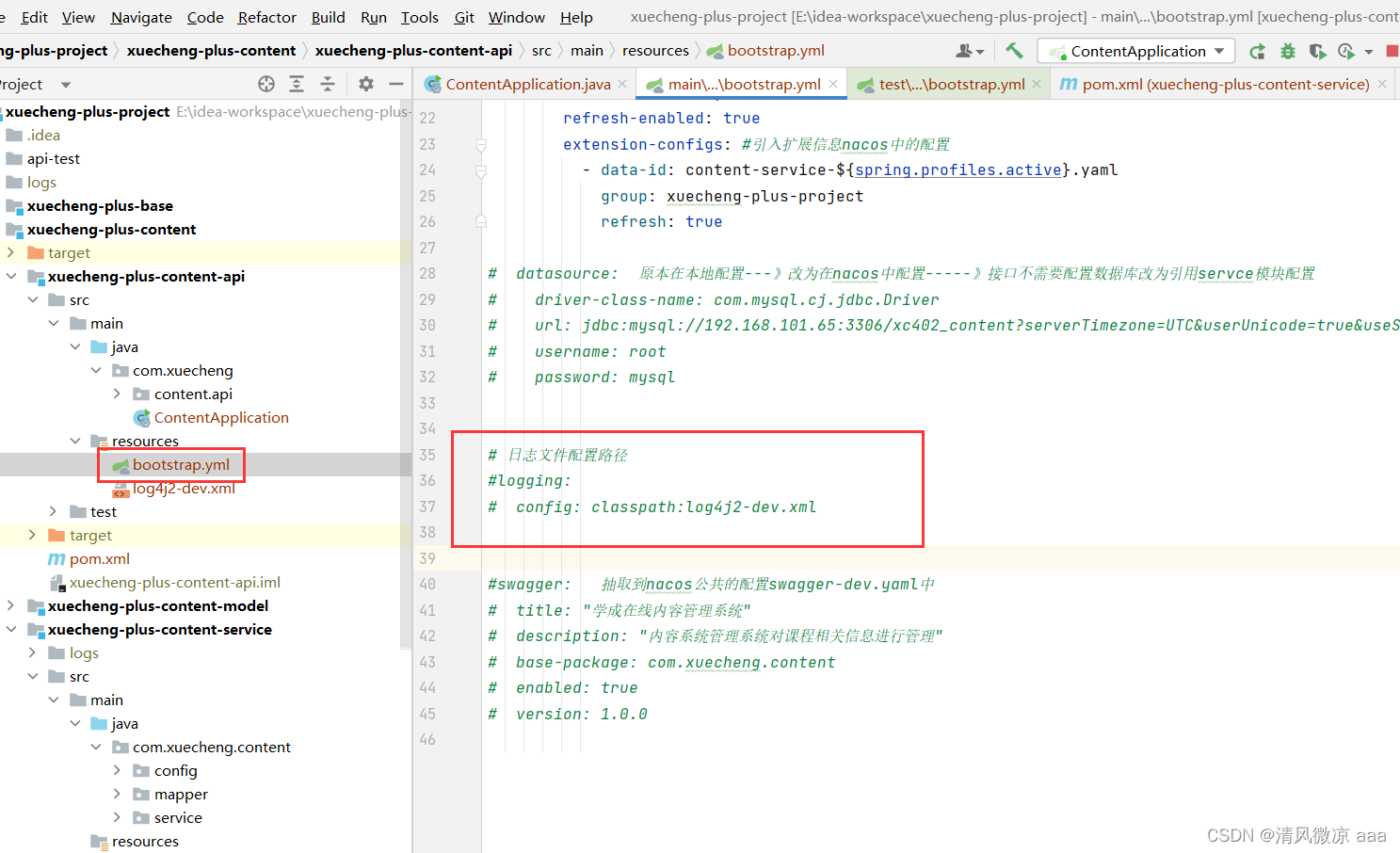

# 日志文件配置路径 抽取到nacos公共的配置loggin-dev.yaml中

#logging:

# config: classpath:log4j2-dev.xml

#swagger: 抽取到nacos公共的配置swagger-dev.yaml中

# title: "学成在线内容管理系统"

# description: "内容系统管理系统对课程相关信息进行管理"

# base-package: com.xuecheng.content

# enabled: true

# version: 1.0.0

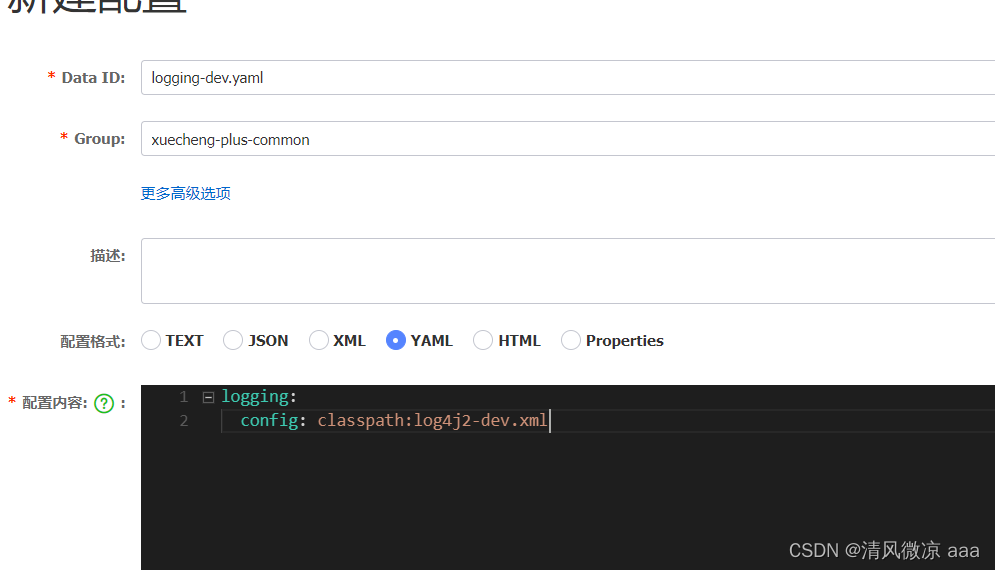

再以相同 的方法配置日志的公用配置。

注释掉原来的日志配置

在接口工程和业务工程,引入logging-dev.yaml公用配置文件

配置完成,重启content-api接口工程,访问http://localhost:63040/content/swagger-ui.html 查看swagger接口文档是否可以正常访问,查看控制台log4j2日志输出是否正常。

2.2.4 配置优先级

到目前为止已将所有微服务的配置统一在nacos进行配置,用到的配置文件有本地的配置文件 bootstrap.yaml和nacos上的配置文件,SpringBoot读取配置文件 的顺序如下:

引入配置文件的形式有:以api模块为例

1、以项目应用名方式引入:api

2、以扩展配置文件方式引入:api 引用 service(数据库配置)

3、以共享配置文件 方式引入:swagger,log

4、本地配置文件:api的本地bootstrap.yml文件

各配置文件 的优先级:项目应用名配置文件 > 扩展配置文件 > 共享配置文件 > 本地配置文件。

有时候我们在测试程序时直接在本地加一个配置进行测试,比如下边的例子:

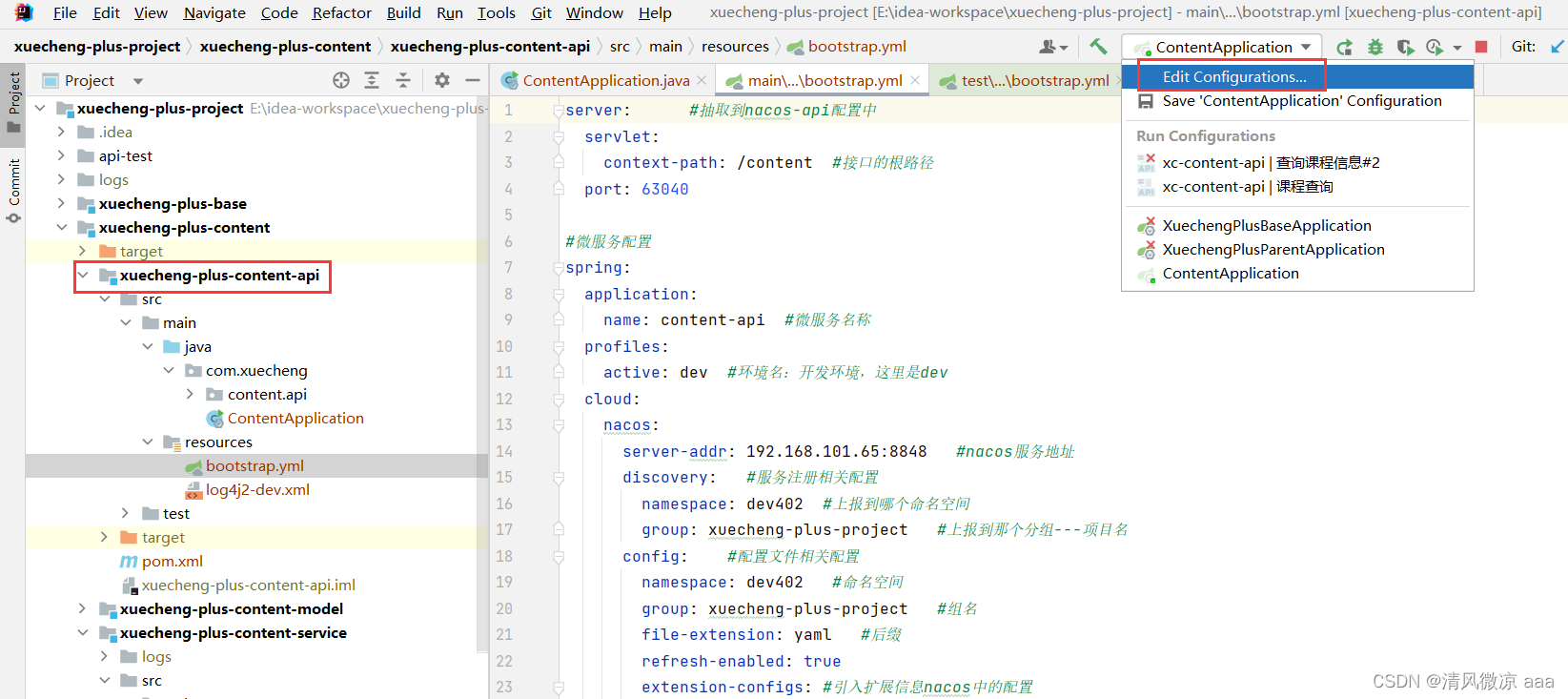

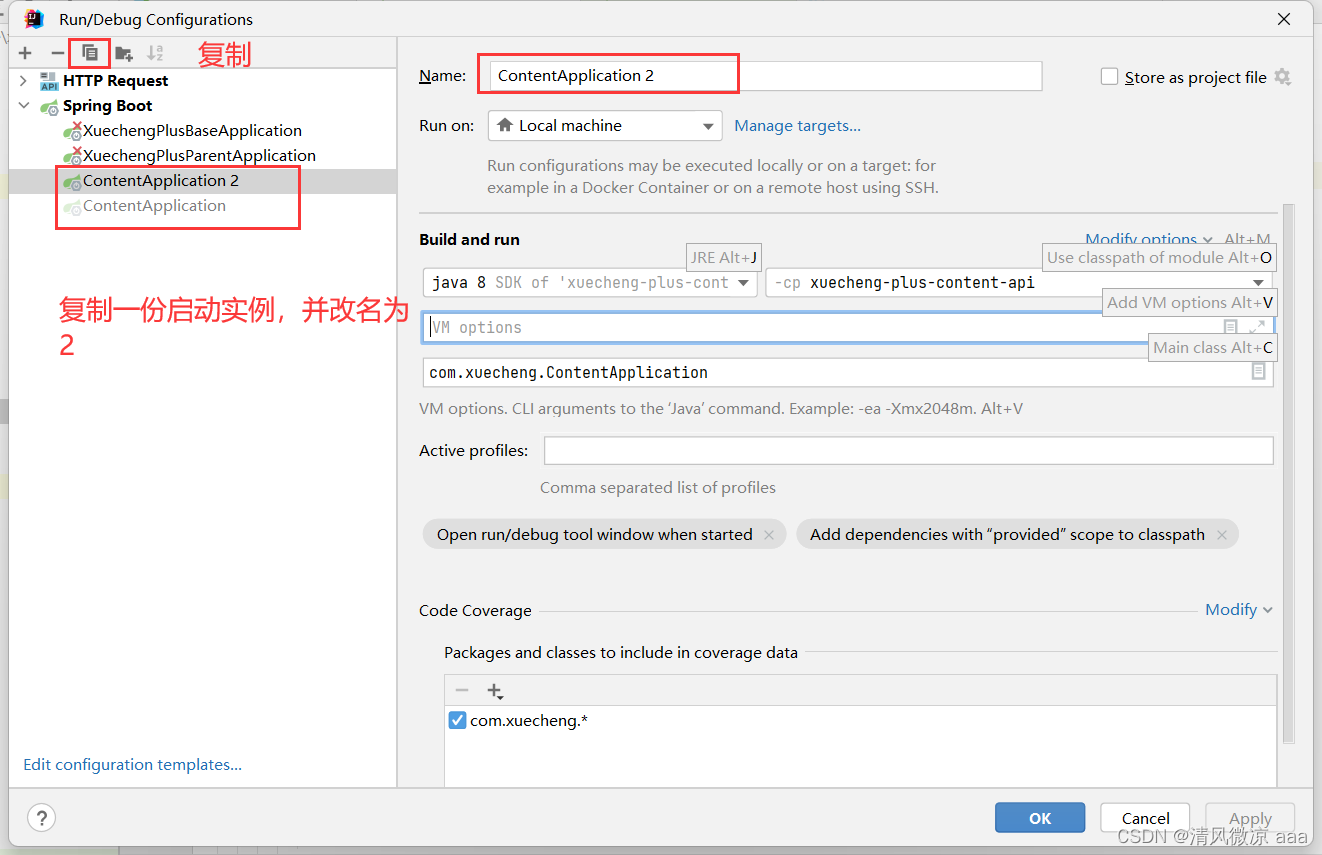

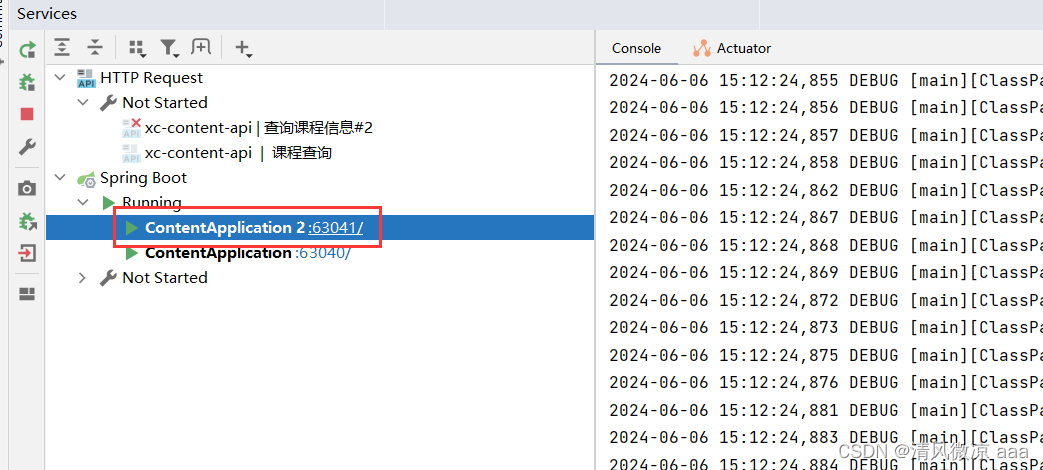

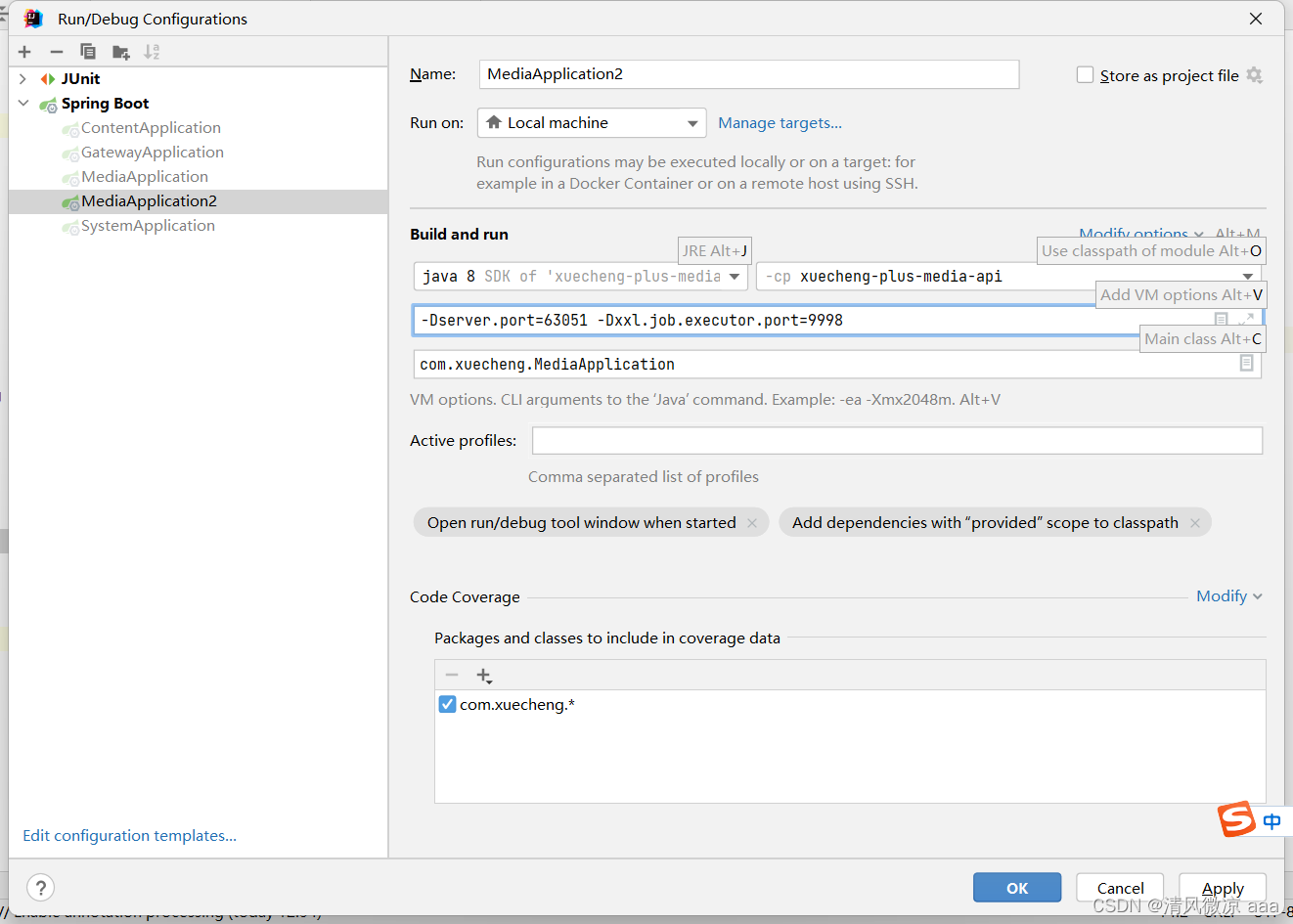

我们想启动两个内容管理微服务,此时需要在本地指定不同的端口,通过VM Options参数,在IDEA配置启动参数

调出VM Options参数选项:

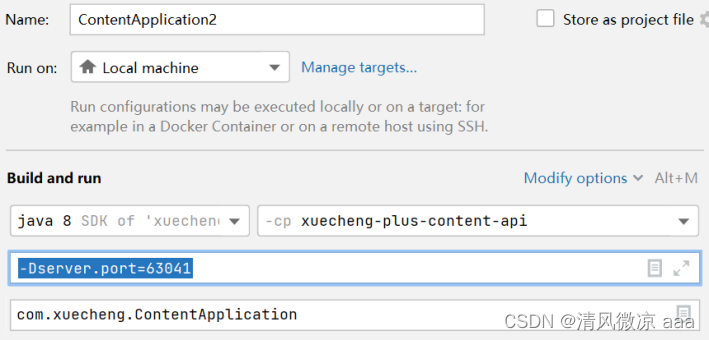

通过-D指定参数名和参数值,参数名即在bootstrap.yml中配置的server.port。

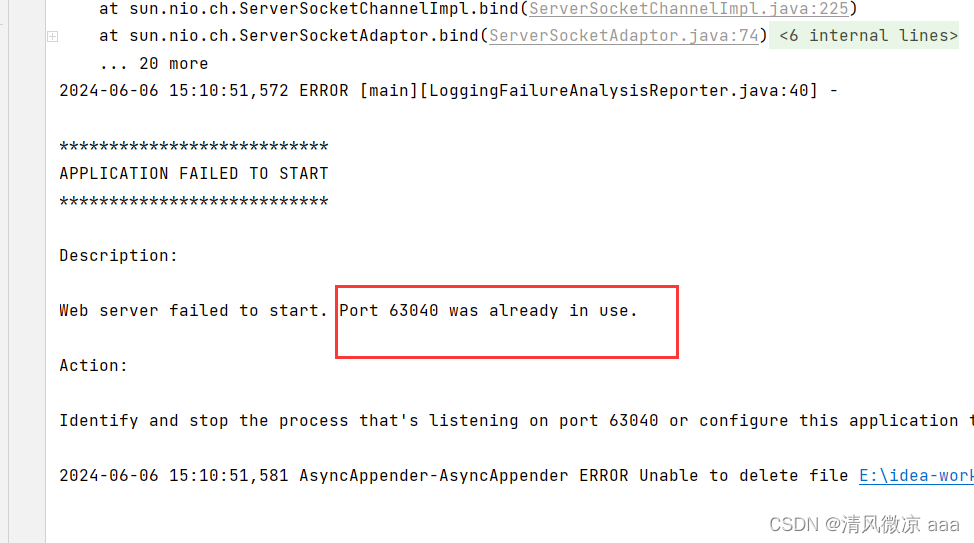

启动ContentApplication2,发现端口仍然是63040,这说明本地的配置没有生效。

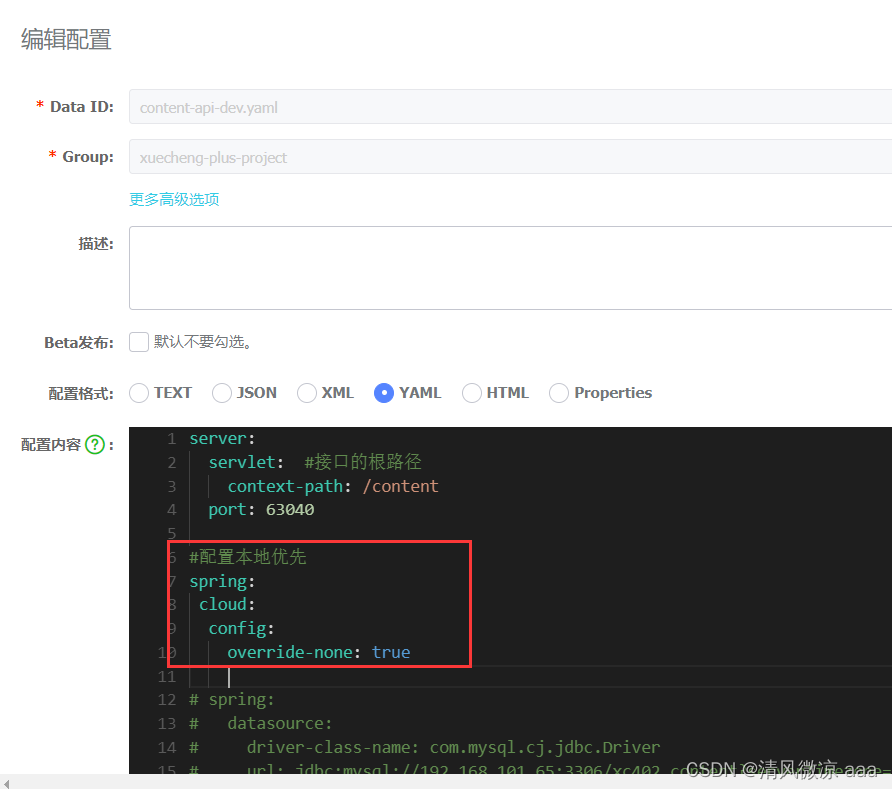

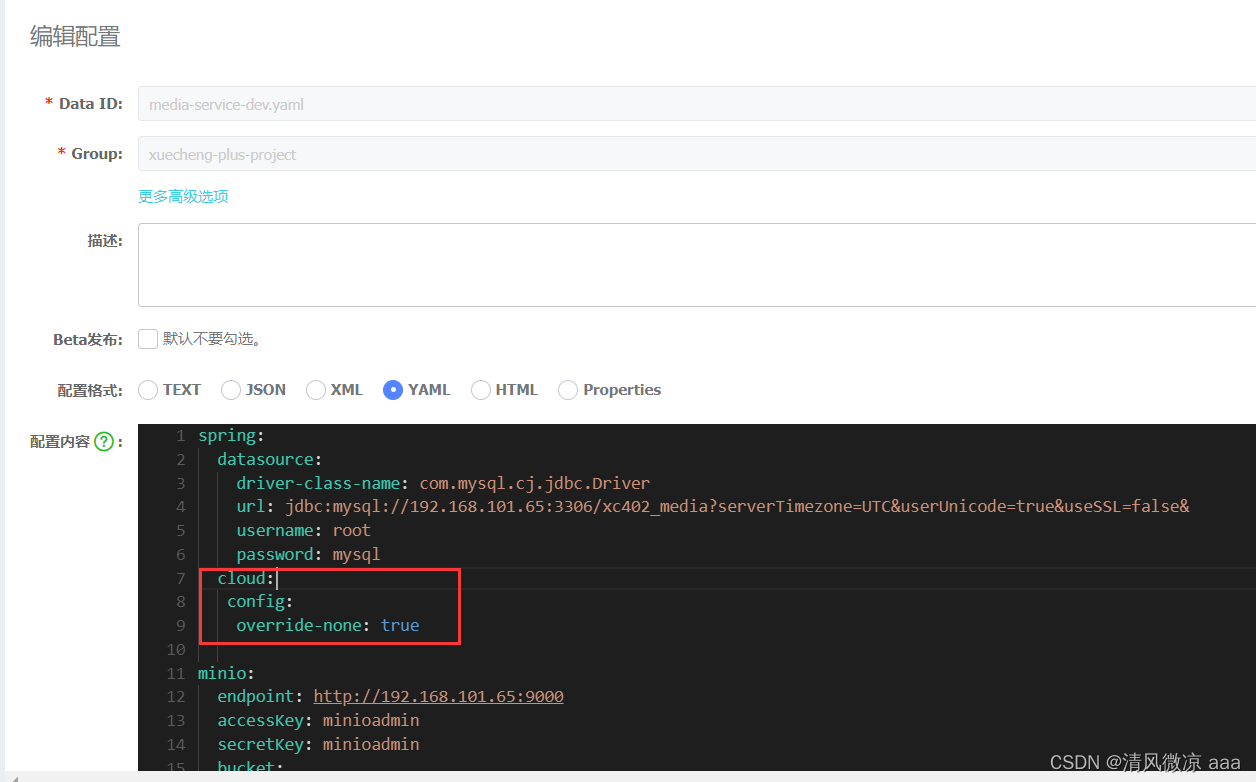

这时我们想让本地最优先,可以在nacos配置文件 中配置如下即可实现:

#配置本地优先

spring:

cloud:

config:

override-none: true

再次启动ContentApplication2,端口为63041。

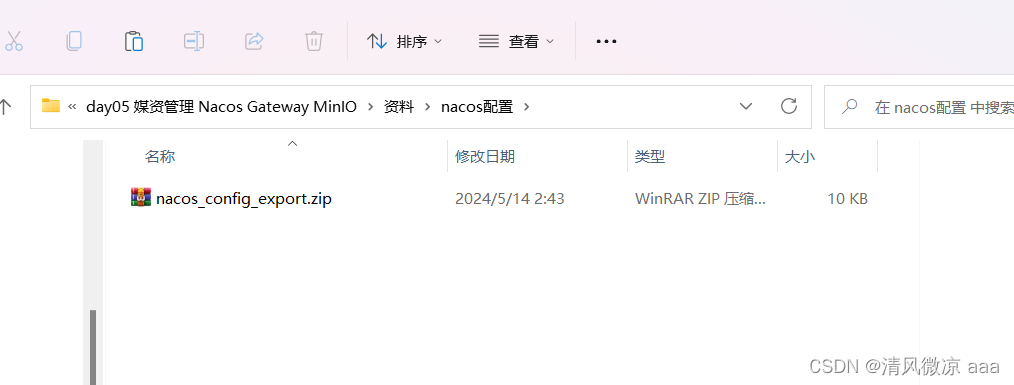

2.2.5 导入配置文件

课程资料中提供了系统用的所有配置文件nacos_config_export.zip,下边将nacos_config_export.zip导入nacos。 (不用解压)

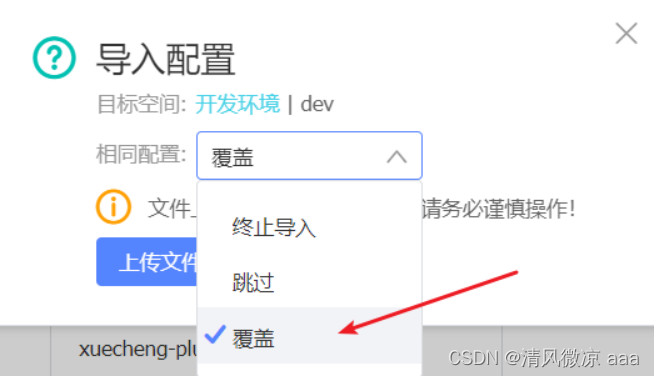

进入具体的命名空间,点击“导入配置”

打开导入窗口

如果导入的配置和现在nacos里面的配置有重复:

- 选择跳过,因为nacos里面的配置信息之前调试已经通过了,所以选择跳过。

点击“上传文件”选择资料中的nacos_config_export.zip开始导入。

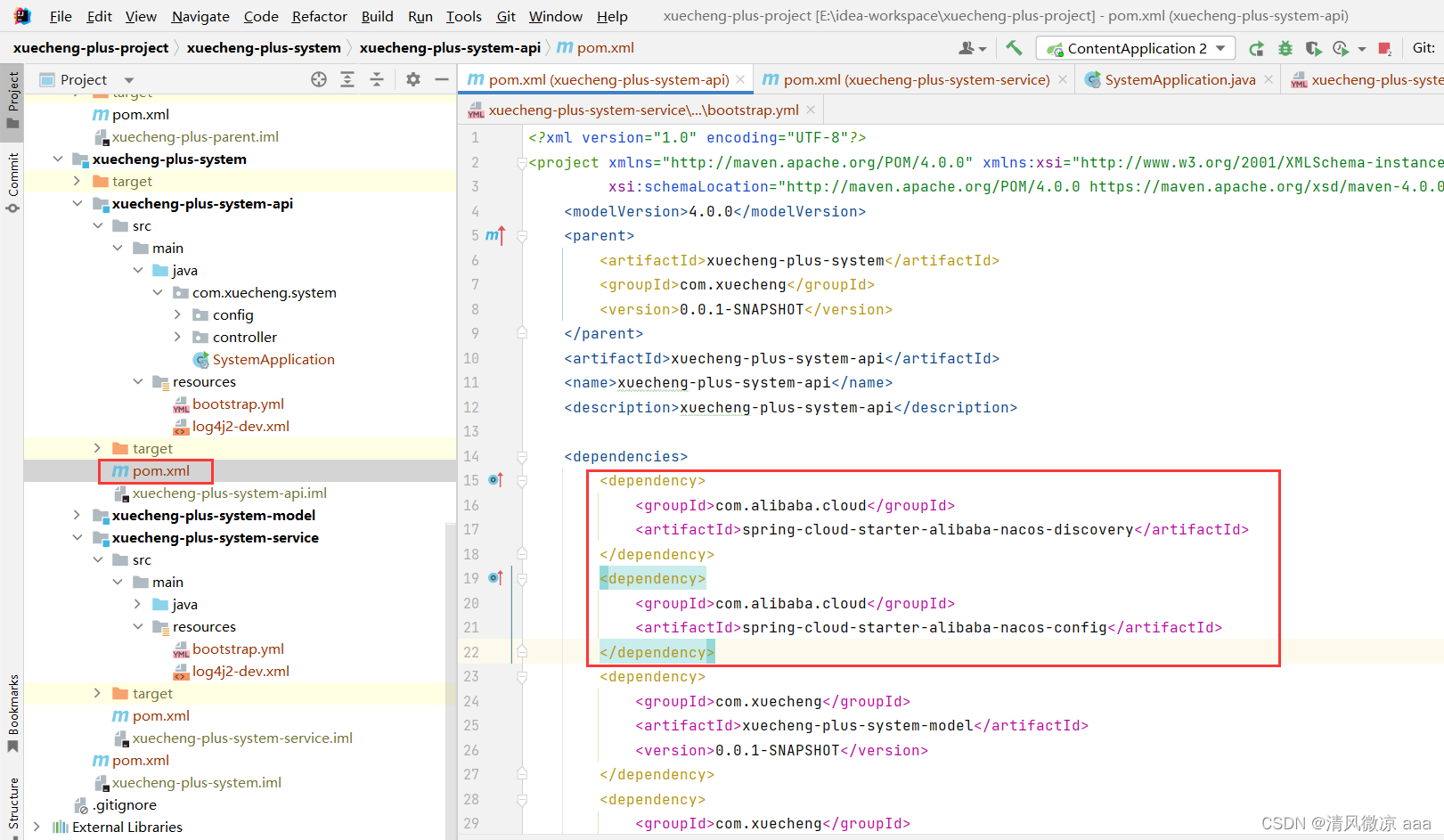

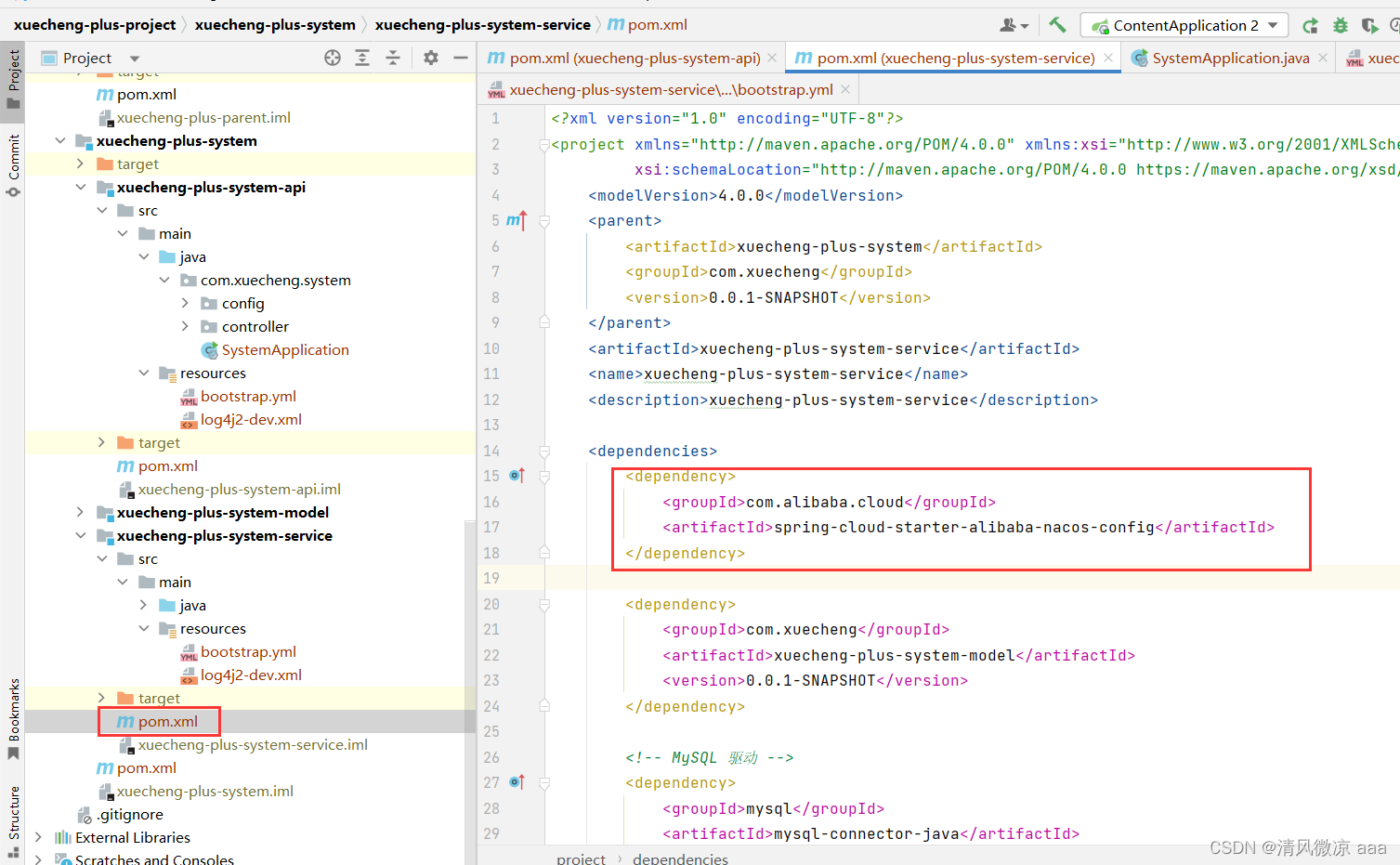

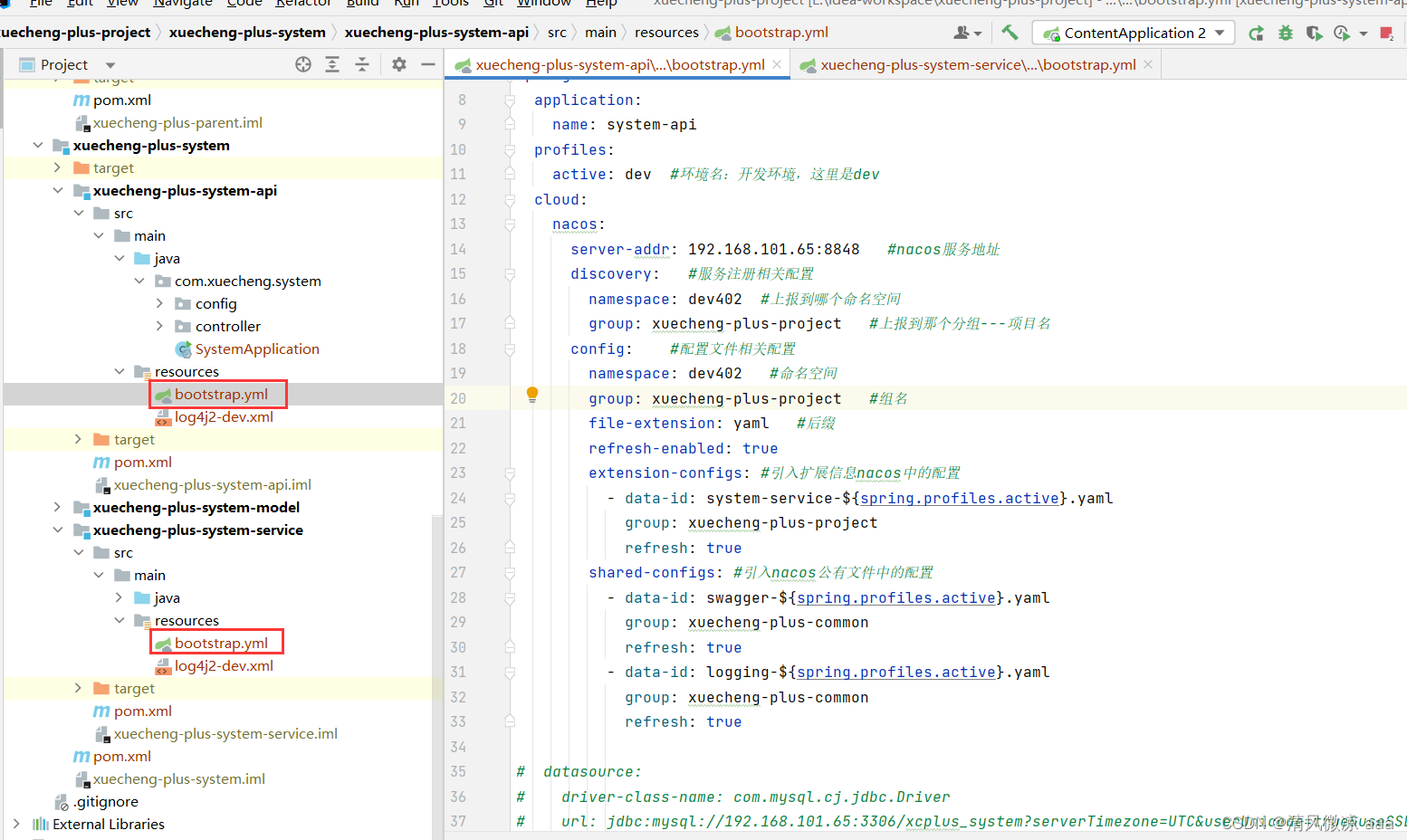

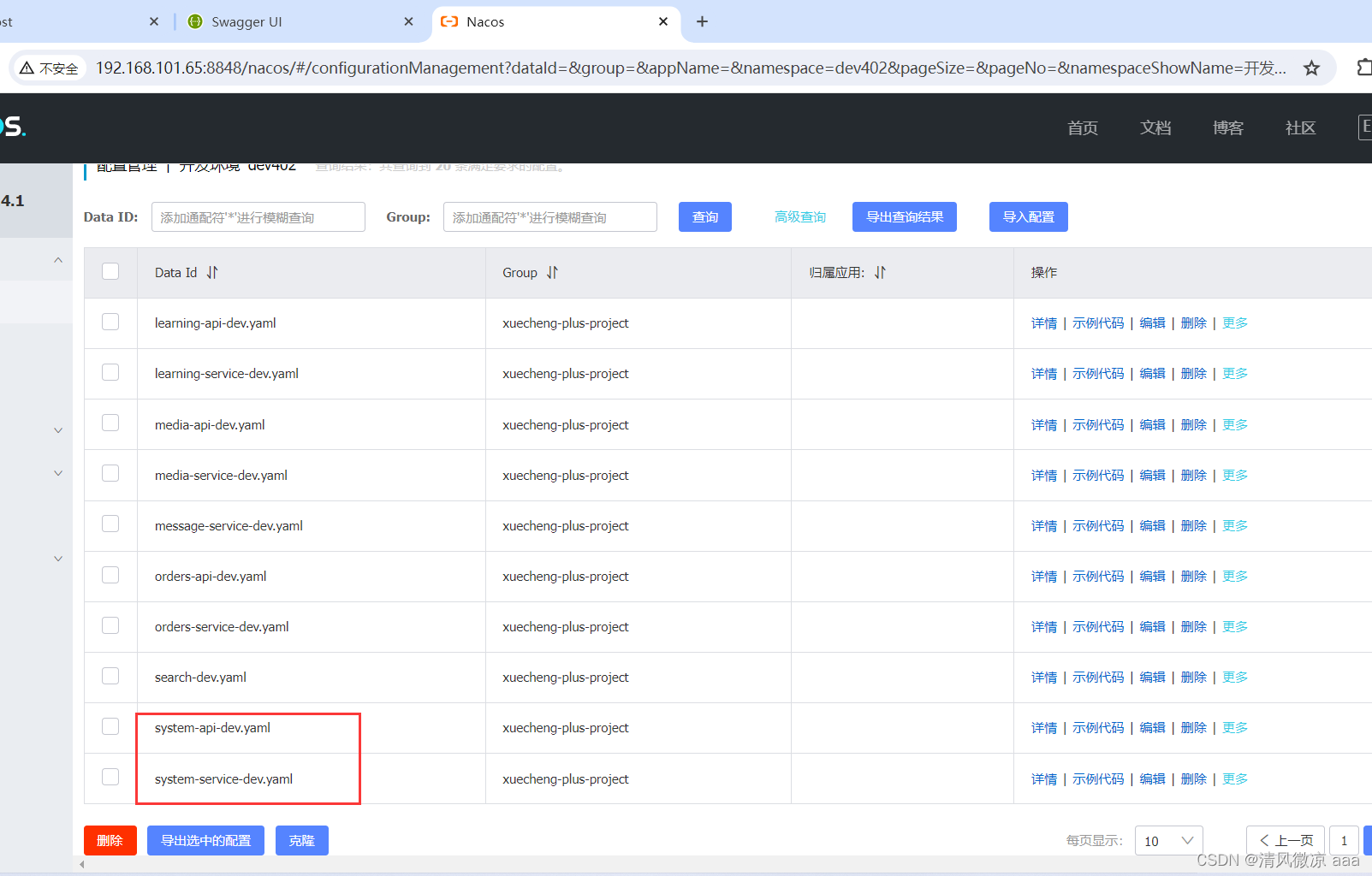

2.2.6 作业:配置系统管理服务

按照上边的方法 自行将系统管理服务的配置信息在nacos上进行配置。

1、添加对应的依赖

系统管理模块的api接口工程中添加nacos注册依赖,配置中心依赖

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-starter-alibaba-nacos-discovery</artifactId>

</dependency>

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-starter-alibaba-nacos-config</artifactId>

</dependency>

系统管理模块的service工程中添加n配置中心依赖

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-starter-alibaba-nacos-config</artifactId>

</dependency>

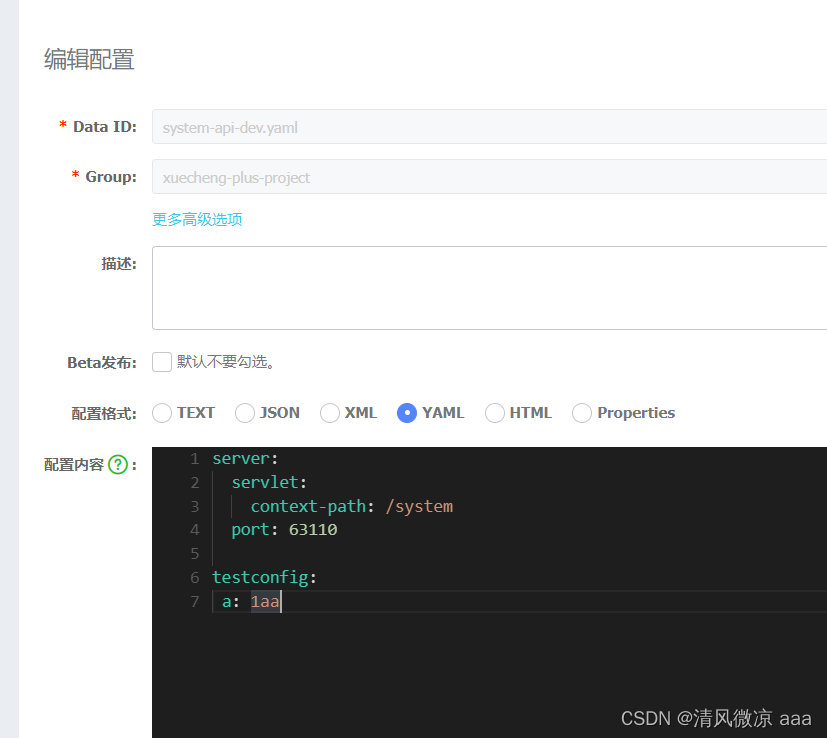

2、编辑api模块的配置文件、编辑service模块的配置文件

#server:

# servlet:

# context-path: /system

# port: 63110

#微服务配置

spring:

application:

name: system-api

profiles:

active: dev #环境名:开发环境,这里是dev

cloud:

nacos:

server-addr: 192.168.101.65:8848 #nacos服务地址

discovery: #服务注册相关配置

namespace: dev402 #上报到哪个命名空间

group: xuecheng-plus-project #上报到那个分组---项目名

config: #配置文件相关配置

namespace: dev402 #命名空间

group: xuecheng-plus-project #组名

file-extension: yaml #后缀

refresh-enabled: true

extension-configs: #引入扩展信息nacos中的配置

- data-id: system-service-${spring.profiles.active}.yaml

group: xuecheng-plus-project

refresh: true

shared-configs: #引入nacos公有文件中的配置

- data-id: swagger-${spring.profiles.active}.yaml

group: xuecheng-plus-common

refresh: true

- data-id: logging-${spring.profiles.active}.yaml

group: xuecheng-plus-common

refresh: true

# datasource:

# driver-class-name: com.mysql.cj.jdbc.Driver

# url: jdbc:mysql://192.168.101.65:3306/xcplus_system?serverTimezone=UTC&userUnicode=true&useSSL=false&

# username: root

# password: mysql

# 日志文件配置路径

#logging:

# config: classpath:log4j2-dev.xml

# swagger 文档配置

#swagger:

# title: "学成在线系统管理"

# description: "系统管理接口"

# base-package: com.xuecheng.system

# enabled: true

# version: 1.0.0

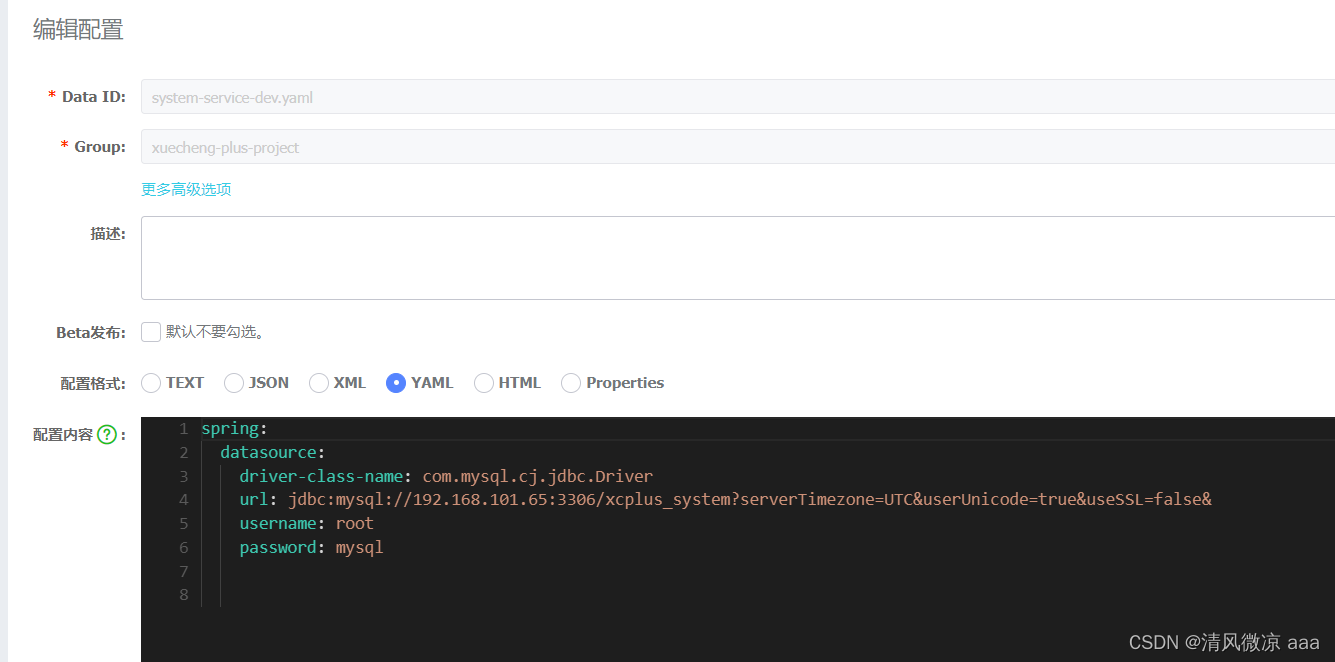

#微服务配置

spring:

application:

name: system-service

profiles:

active: dev #环境名:开发环境,这里是dev

cloud:

nacos:

server-addr: 192.168.101.65:8848 #nacos服务地址

config: #配置文件相关配置

namespace: dev402 #命名空间

group: xuecheng-plus-project #组名

file-extension: yaml #后缀

refresh-enabled: true

shared-configs: #引入nacos公有日志文件中的配置

- data-id: logging-${spring.profiles.active}.yaml

group: xuecheng-plus-common

refresh: true

# datasource:

# driver-class-name: com.mysql.cj.jdbc.Driver

# url: jdbc:mysql://192.168.101.65:3306/xc402_system?serverTimezone=UTC&userUnicode=true&useSSL=false&

# username: root

# password: mysql

# 日志文件配置路径

#logging:

# config: classpath:log4j2-dev.xml

3、nacos配置中心的配置文件:在2.2.5中已经导入。

2.3 搭建Gateway

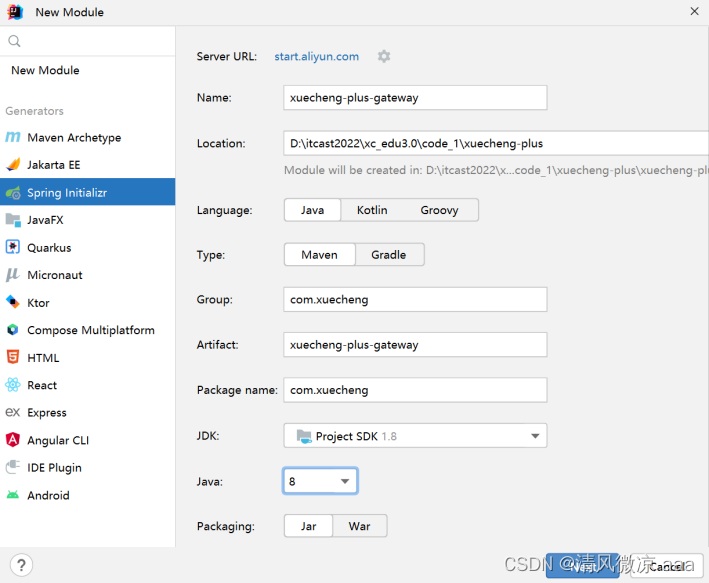

本项目使用Spring Cloud Gateway作为网关,下边创建网关工程。

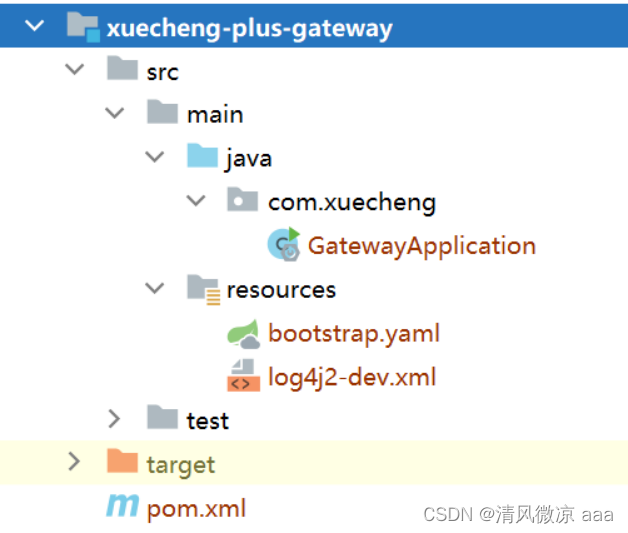

新建一个网关工程:xuecheng-plus-gateway

工程结构

添加依赖:

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0" xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 https://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<!--指定父工程为xuecheng-plus-parent-->

<parent>

<groupId>com.xuecheng</groupId>

<artifactId>xuecheng-plus-parent</artifactId>

<version>0.0.1-SNAPSHOT</version>

<relativePath>../xuecheng-plus-parent</relativePath>

</parent>

<artifactId>xuecheng-plus-gateway</artifactId>

<version>0.0.1-SNAPSHOT</version>

<name>xuecheng-plus-gateway</name>

<description>xuecheng-plus-gateway</description>

<properties>

<java.version>1.8</java.version>

</properties>

<dependencies>

<!--网关-->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-gateway</artifactId>

</dependency>

<!--服务发现中心-->

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-starter-alibaba-nacos-discovery</artifactId>

</dependency>

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-starter-alibaba-nacos-config</artifactId>

</dependency>

<!-- 排除 Spring Boot 依赖的日志包冲突 -->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter</artifactId>

<exclusions>

<exclusion>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-logging</artifactId>

</exclusion>

</exclusions>

</dependency>

<!-- Spring Boot 集成 log4j2 -->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-log4j2</artifactId>

</dependency>

</dependencies>

</project>

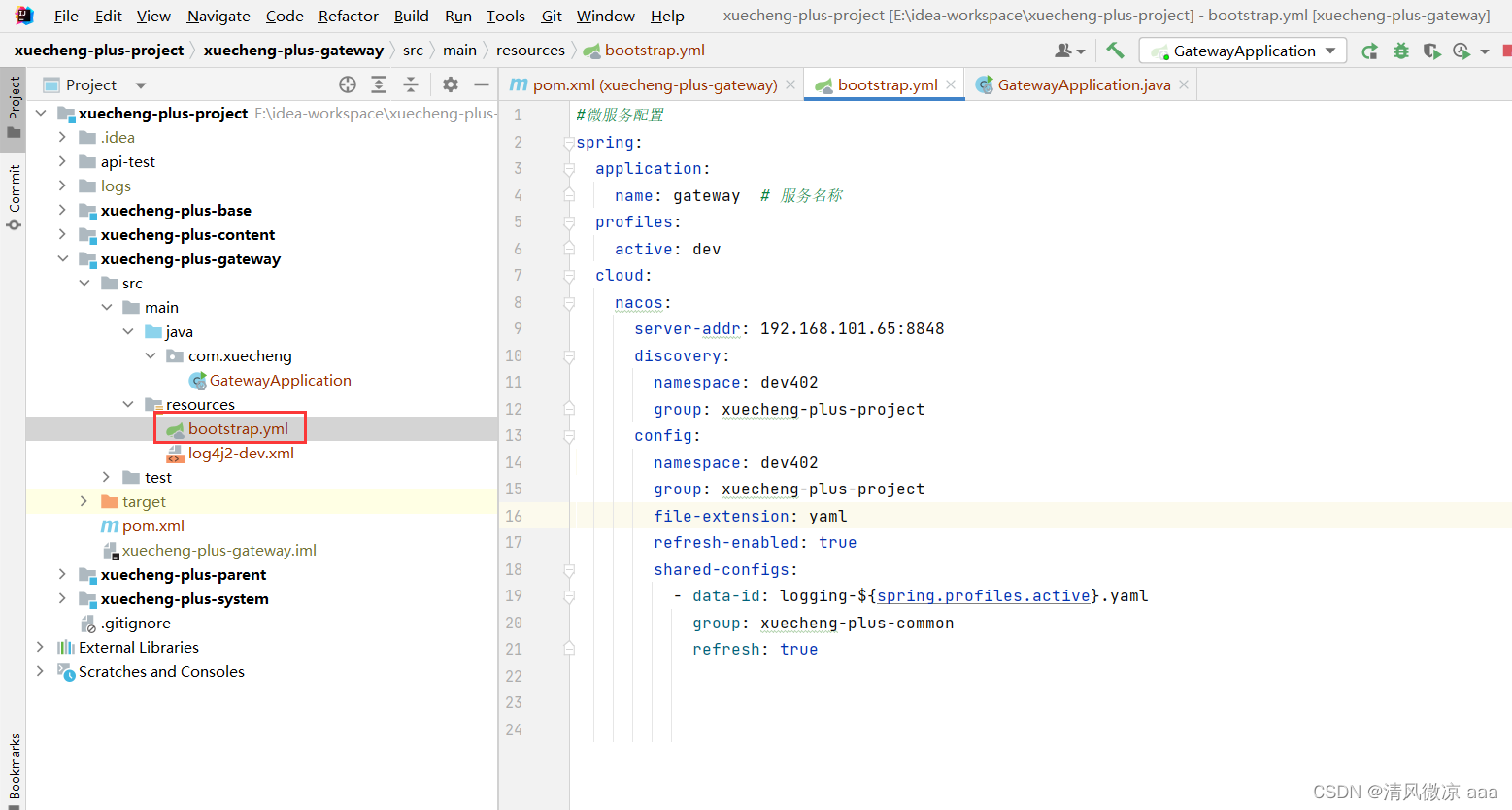

配置网关的bootstrap.yaml配置文件

#微服务配置

spring:

application:

name: gateway # 服务名称

profiles:

active: dev

cloud:

nacos:

server-addr: 192.168.101.65:8848

discovery:

namespace: dev402

group: xuecheng-plus-project

config:

namespace: dev402

group: xuecheng-plus-project

file-extension: yaml

refresh-enabled: true

shared-configs:

- data-id: logging-${spring.profiles.active}.yaml

group: xuecheng-plus-common

refresh: true

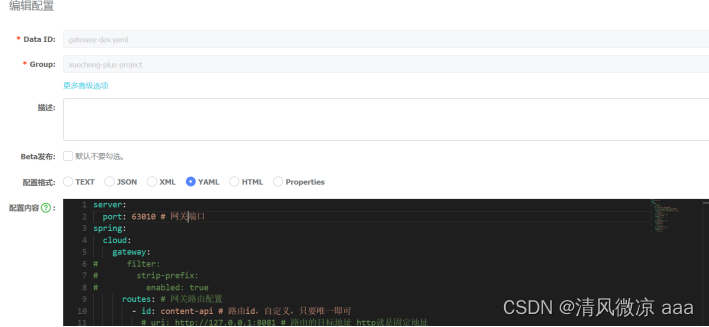

在nacos上配置网关路由策略:

详细配置如下:

server:

port: 63010 # 网关端口

spring:

cloud:

gateway:

# filter:

# strip-prefix:

# enabled: true

routes: # 网关路由配置

- id: content-api # 路由id,自定义,只要唯一即可

# uri: http://127.0.0.1:8081 # 路由的目标地址 http就是固定地址

uri: lb://content-api # 路由的目标地址 lb就是负载均衡,后面跟服务名称

predicates: # 路由断言,也就是判断请求是否符合路由规则的条件

- Path=/content/** # 这个是按照路径匹配,只要以/content/开头就符合要求

# filters:

# - StripPrefix=1

- id: system-api

# uri: http://127.0.0.1:8081

uri: lb://system-api

predicates:

- Path=/system/**

# filters:

# - StripPrefix=1

- id: media-api

# uri: http://127.0.0.1:8081

uri: lb://media-api

predicates:

- Path=/media/**

# filters:

# - StripPrefix=1

启动网关工程,通过网关工程访问微服务进行测试。

网关服务在nacos注册成功:

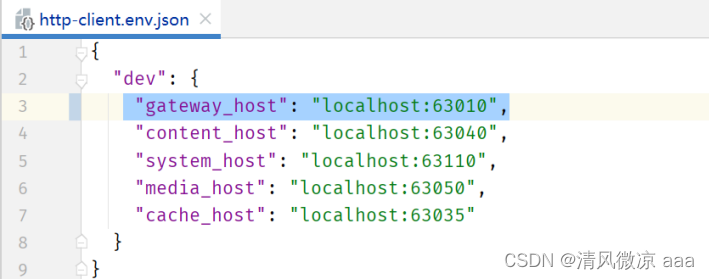

在http-client-env.json中配置网关的地址

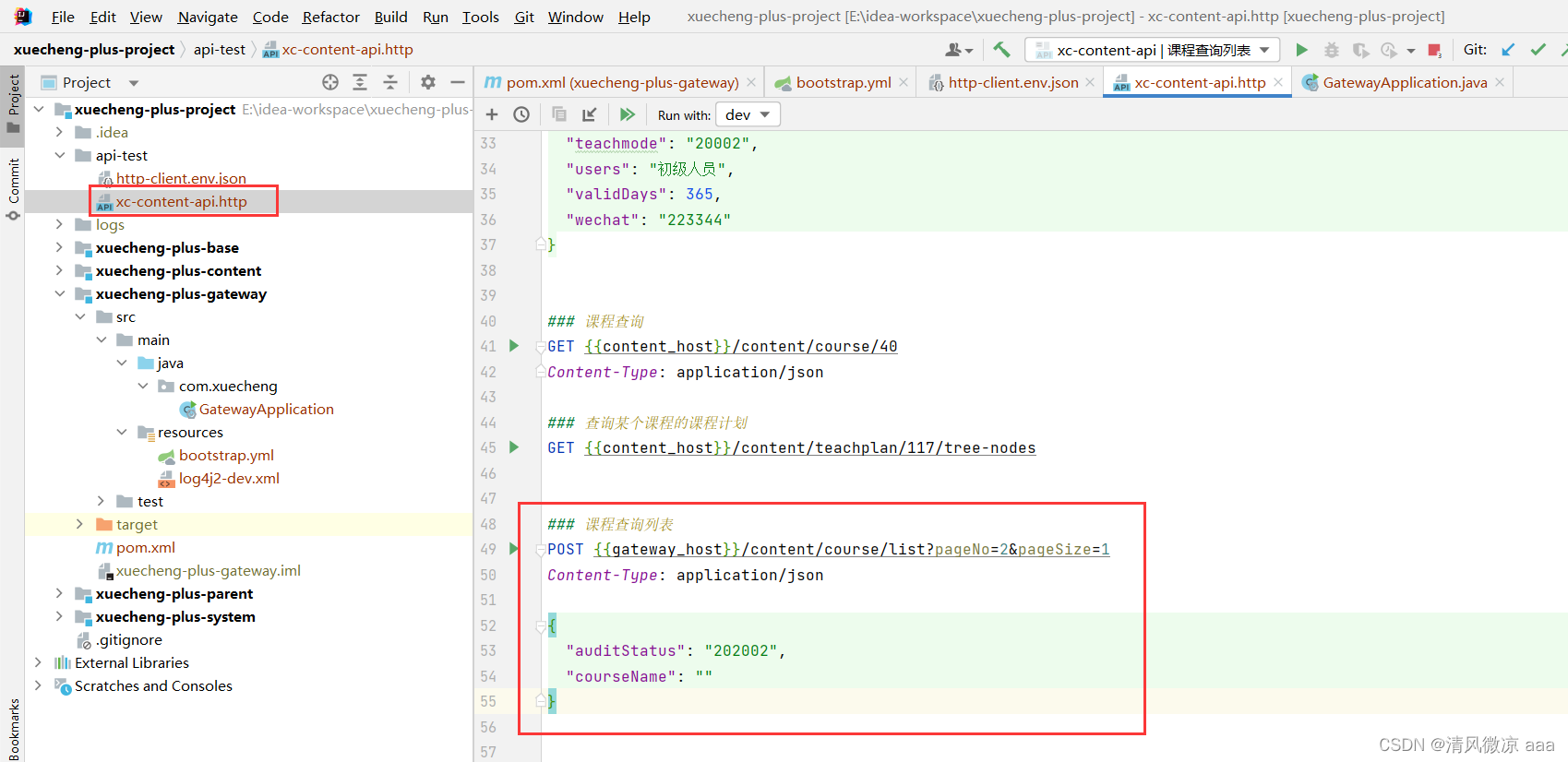

使用httpclient测试课程查询 接口,如下:

### 课程查询列表

POST {{gateway_host}}/content/course/list?pageNo=2&pageSize=1

Content-Type: application/json

{

"auditStatus": "202002",

"courseName": ""

}

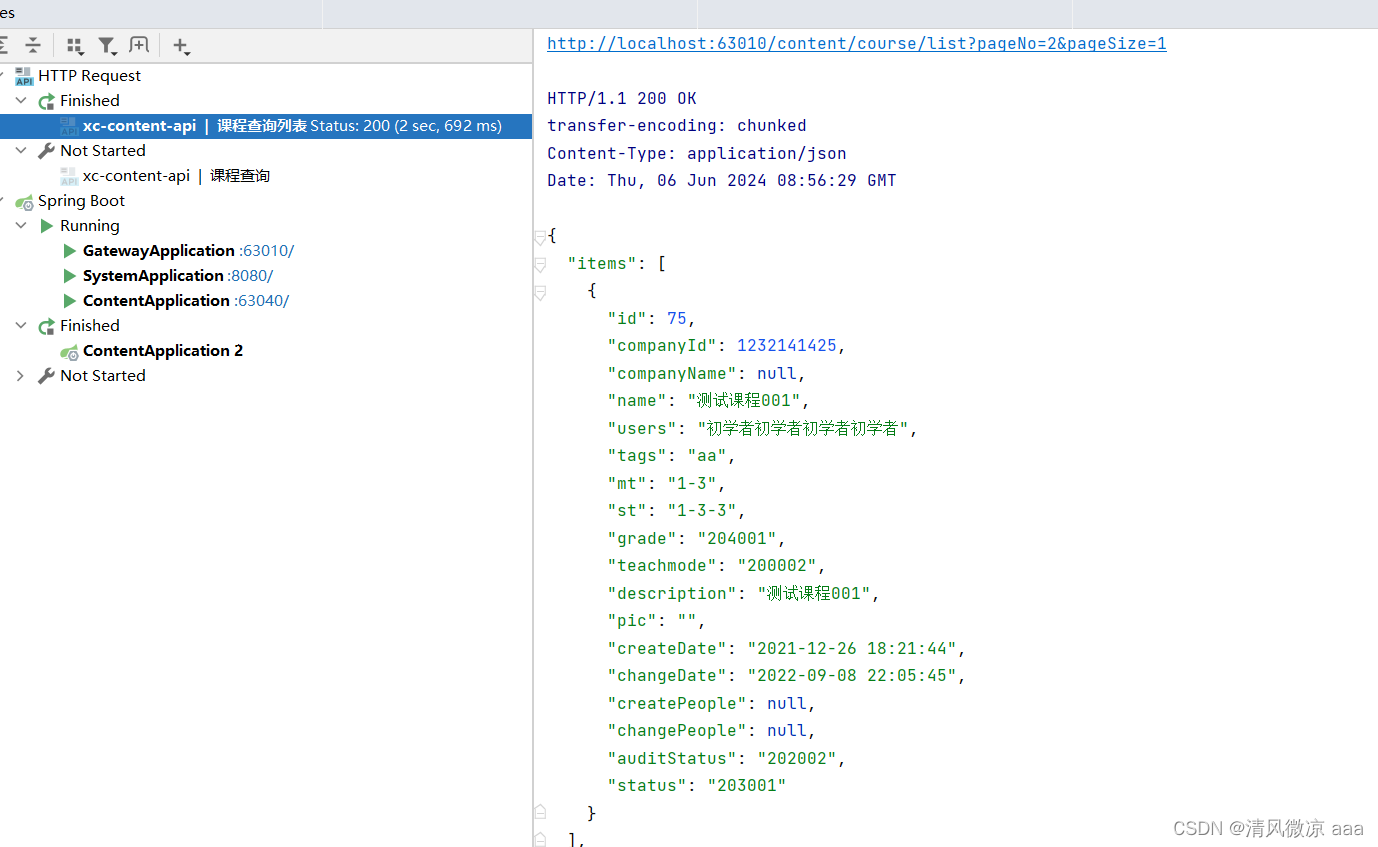

运行,观察是否可以正常访问接口 ,如下所示可以正常请求接口。

http://localhost:63010/content/course/list?pageNo=2&pageSize=1

HTTP/1.1 200 OK

transfer-encoding: chunked

Content-Type: application/json

Date: Sun, 11 Sep 2022 09:54:32 GMT

{

"items": [

{

"id": 26,

"companyId": 1232141425,

"companyName": null,

"name": "spring cloud实战",

"users": "所有人",

"tags": null,

"mt": "1-3",

"mtName": null,

"st": "1-3-2",

"stName": null,

"grade": "200003",

"teachmode": "201001",

"description": "本课程主要从四个章节进行讲解: 1.微服务架构入门 2.spring cloud 基础入门 3.实战Spring Boot 4.注册中心eureka。",

"pic": "https://cdn.educba.com/academy/wp-content/uploads/2018/08/Spring-BOOT-Interview-questions.jpg",

"createDate": "2019-09-04 09:56:19",

"changeDate": "2021-12-26 22:10:38",

"createPeople": null,

"changePeople": null,

"auditStatus": "202002",

"status": "203001",

"coursePubId": null,

"coursePubDate": null

}

],

"counts": 29,

"page": 2,

"pageSize": 1

}

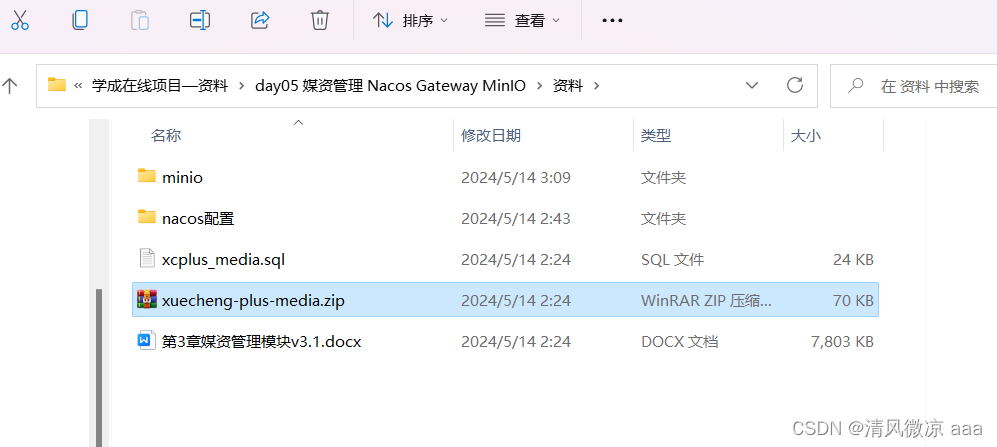

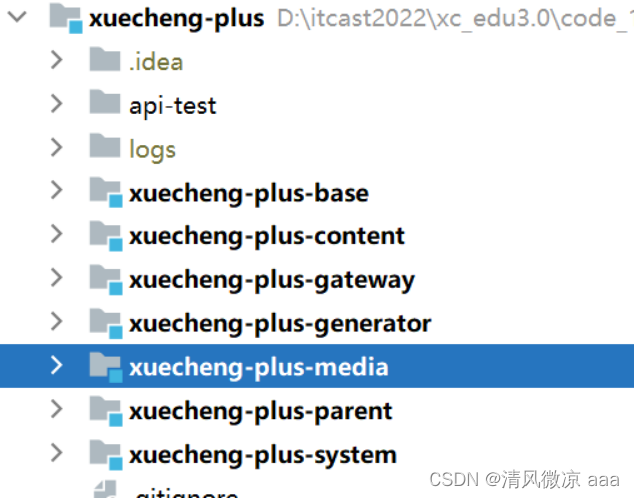

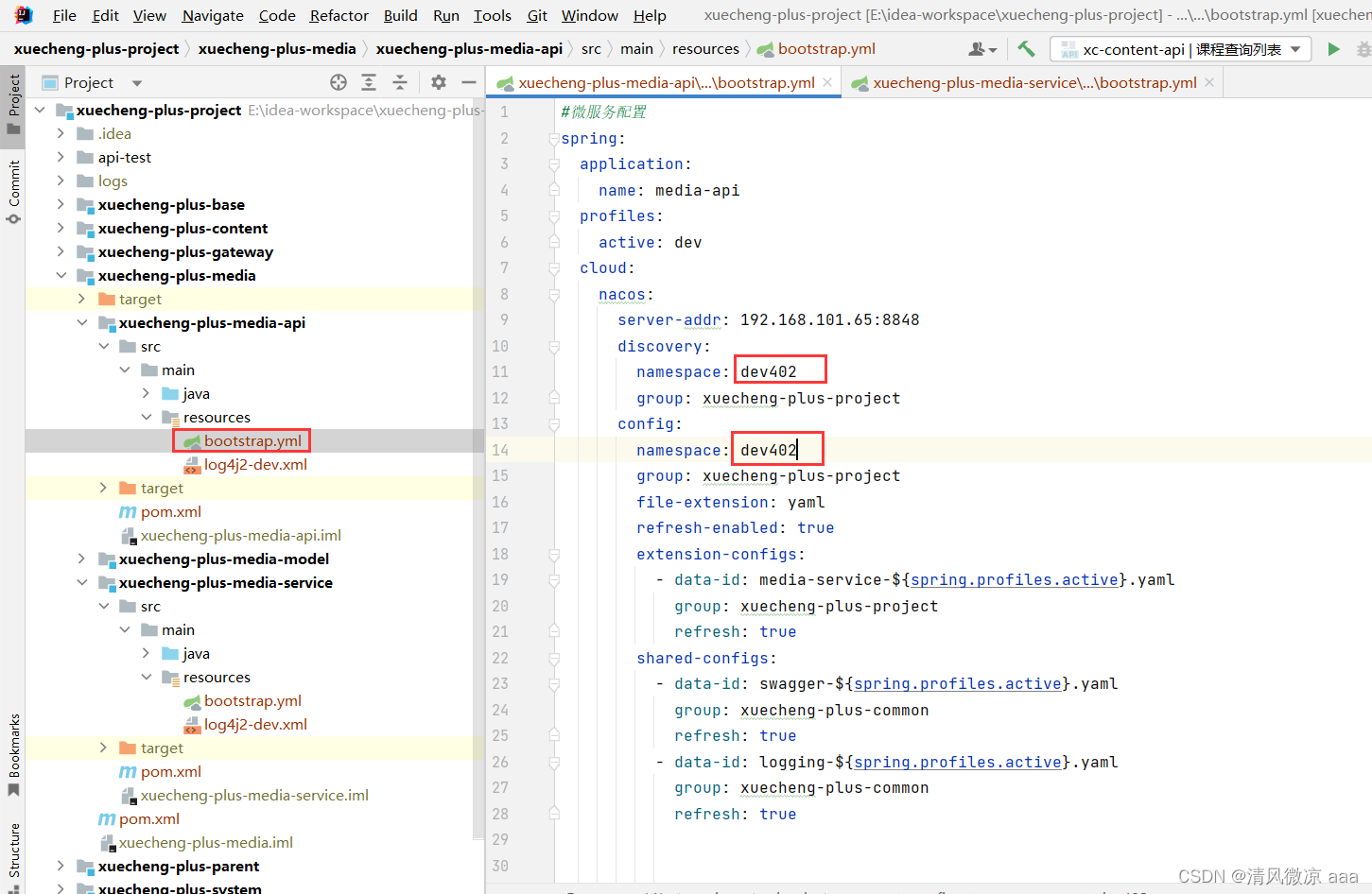

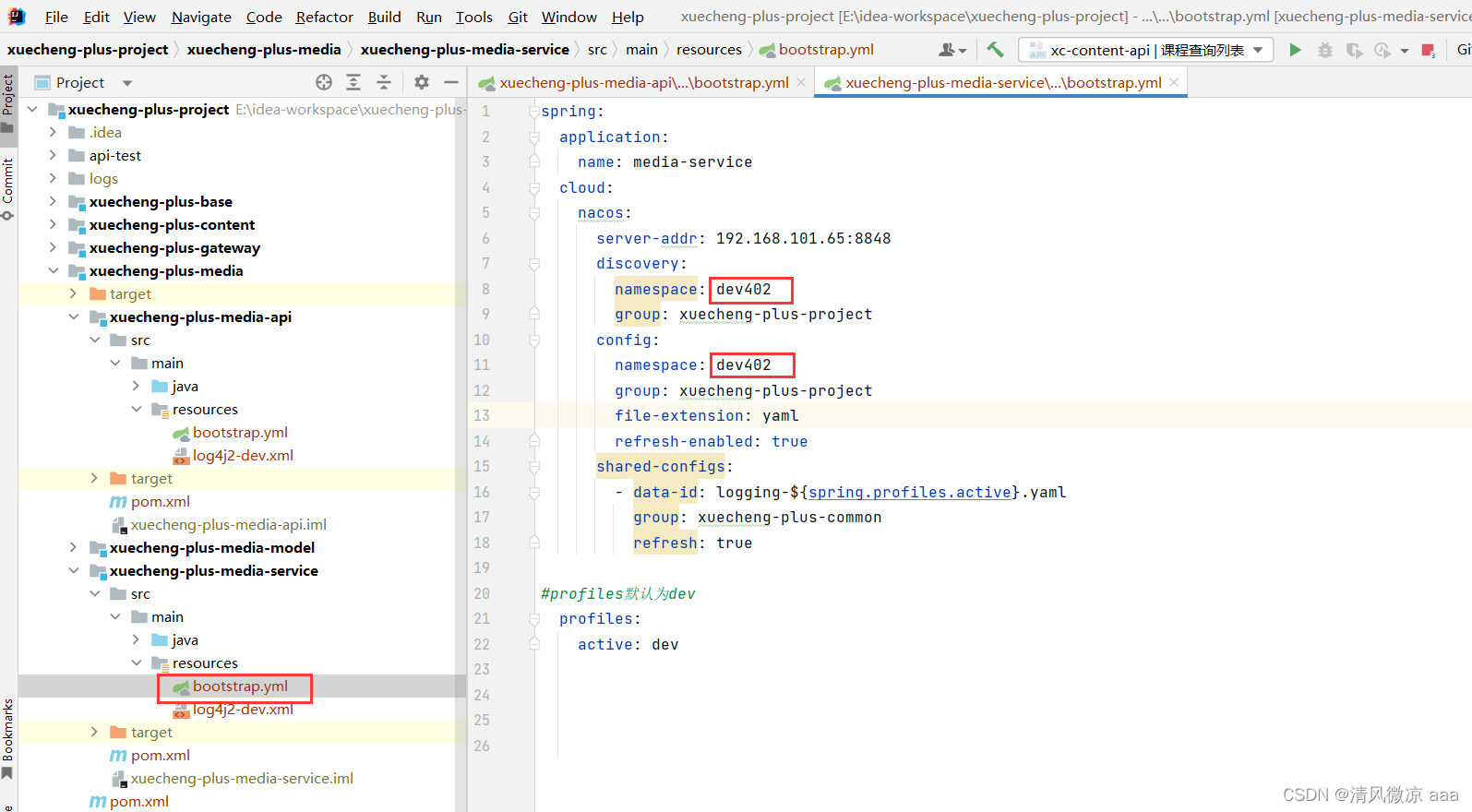

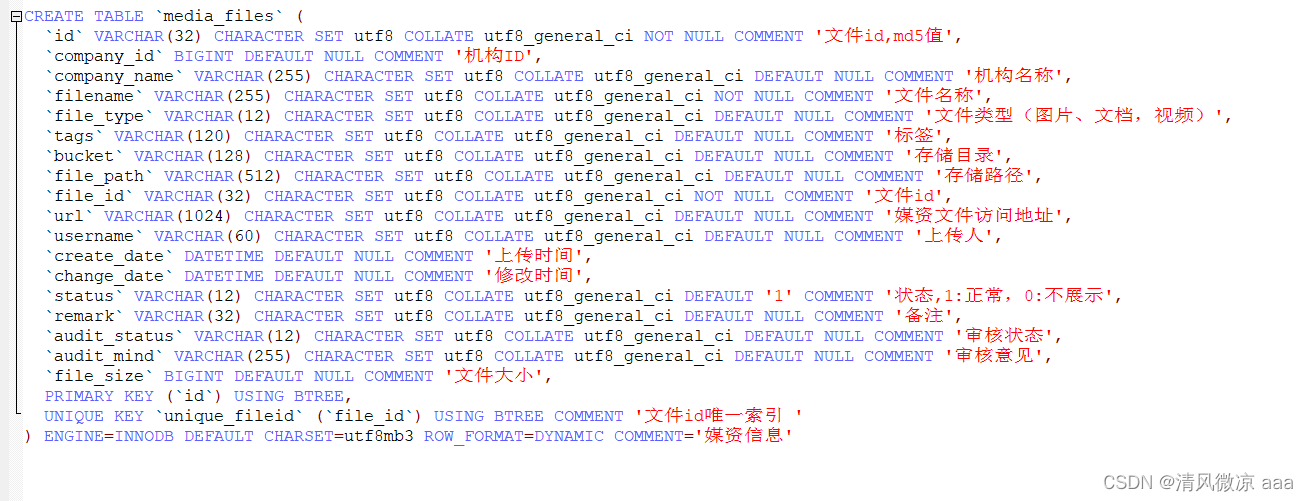

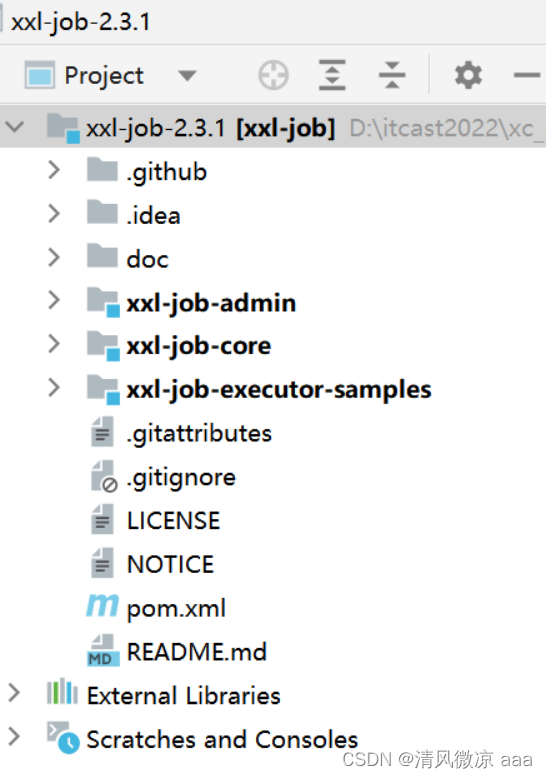

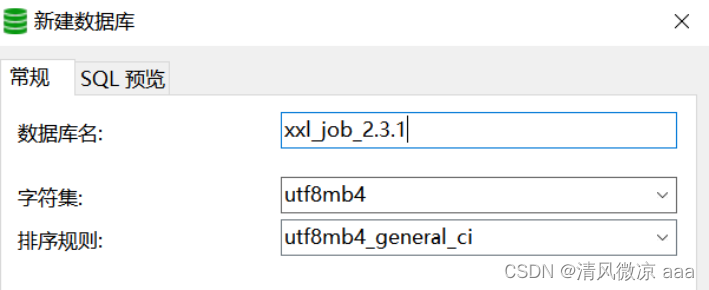

2.4 搭建媒资工程

至此Nacos、网关已经搭建完成,下边将媒资工程导入项目(和内容管理模块的结构相同,所以不在手动搭建了)。

从课程资料中获取媒资工程 xuecheng-plus-media,拷贝到项目工程根目录。

右键pom.xml转为maven工程。

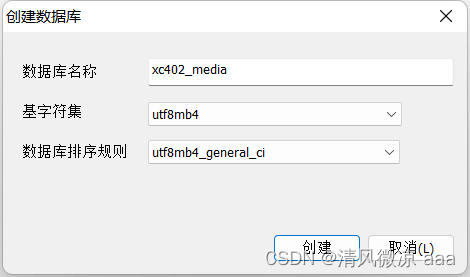

下边做如下配置:

-

创建媒资数据库xc402_media,并导入资料目录中的xcplus_media.sql

-

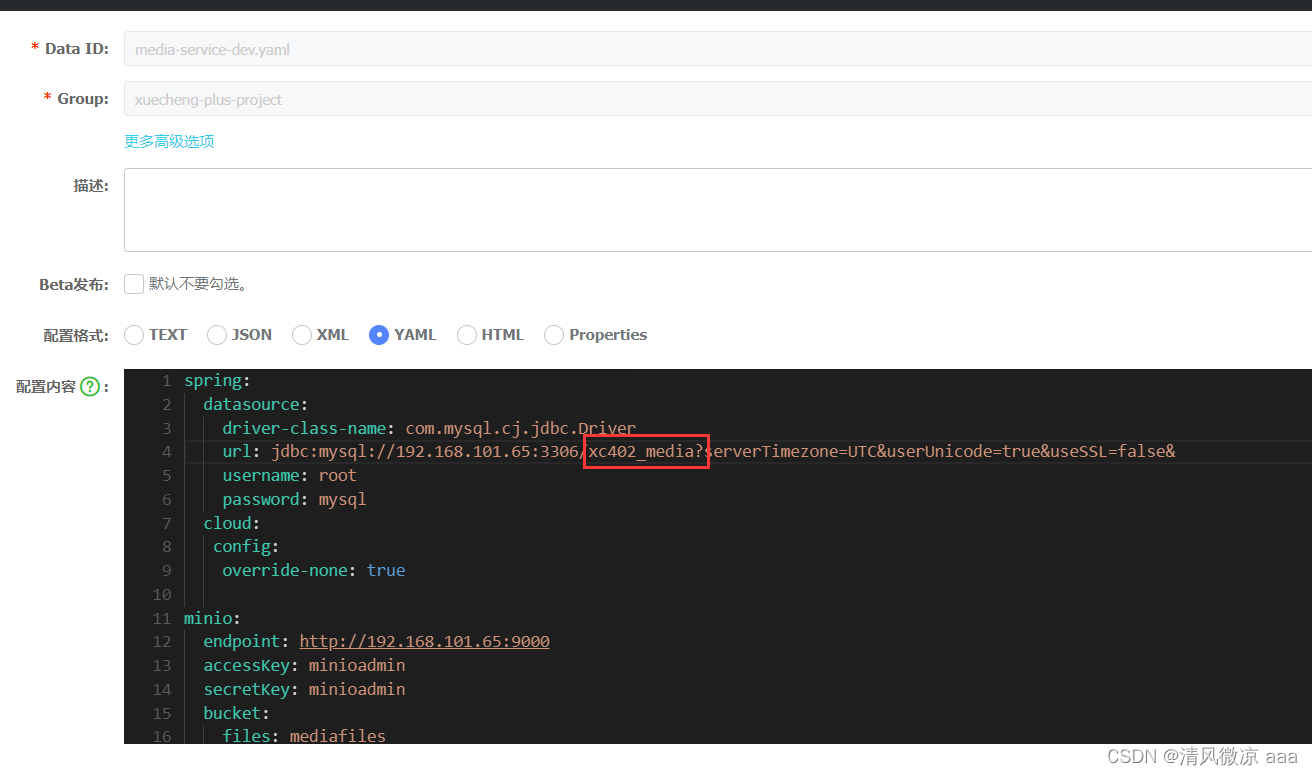

修改nacos上的media-service-dev.yaml配置文件中的数据库链接信息:xc402_media

-

修改本地配置文件:

重启media-api工程只要能正常启动成功即可,稍后根据需求写接口。

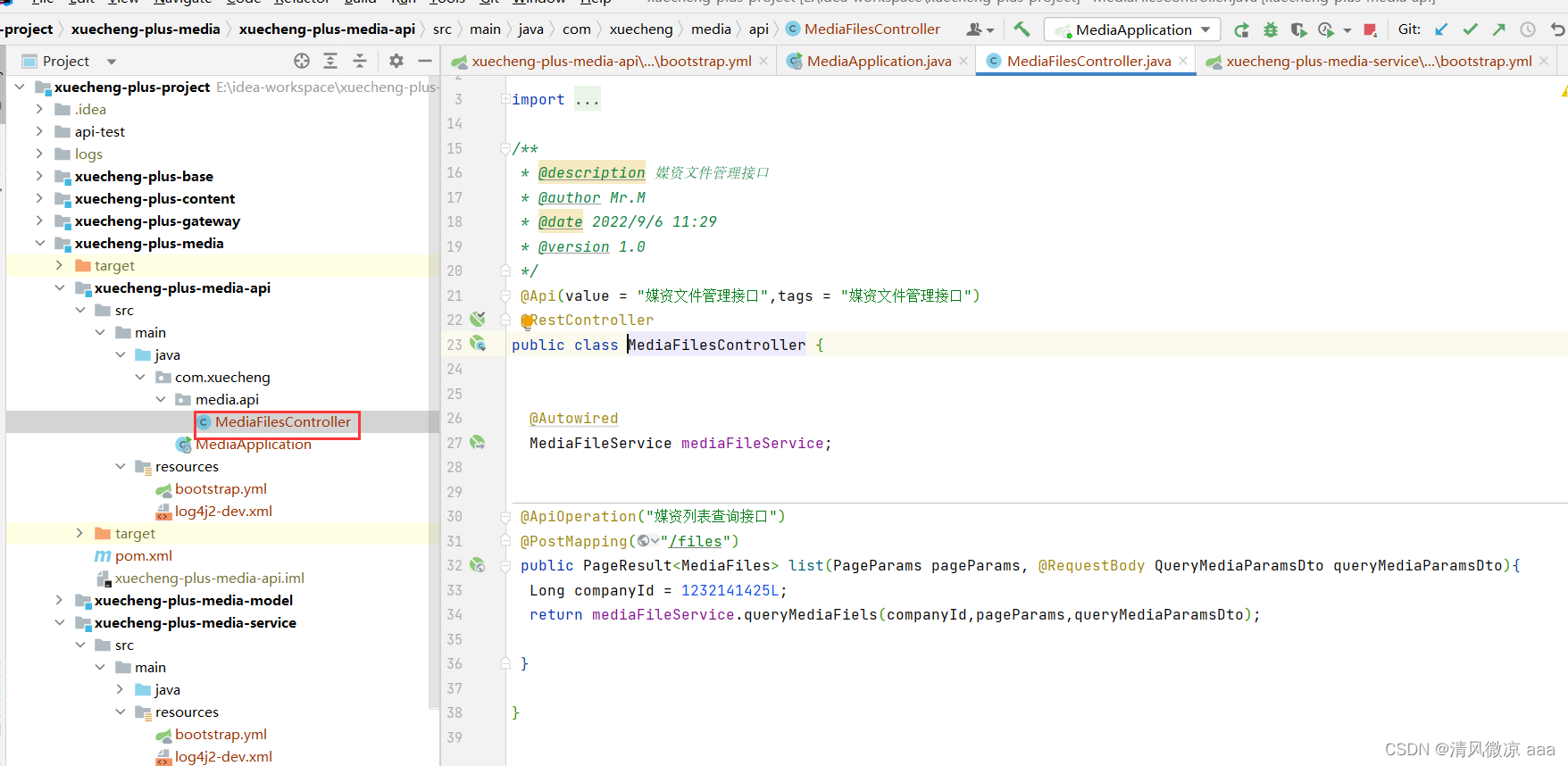

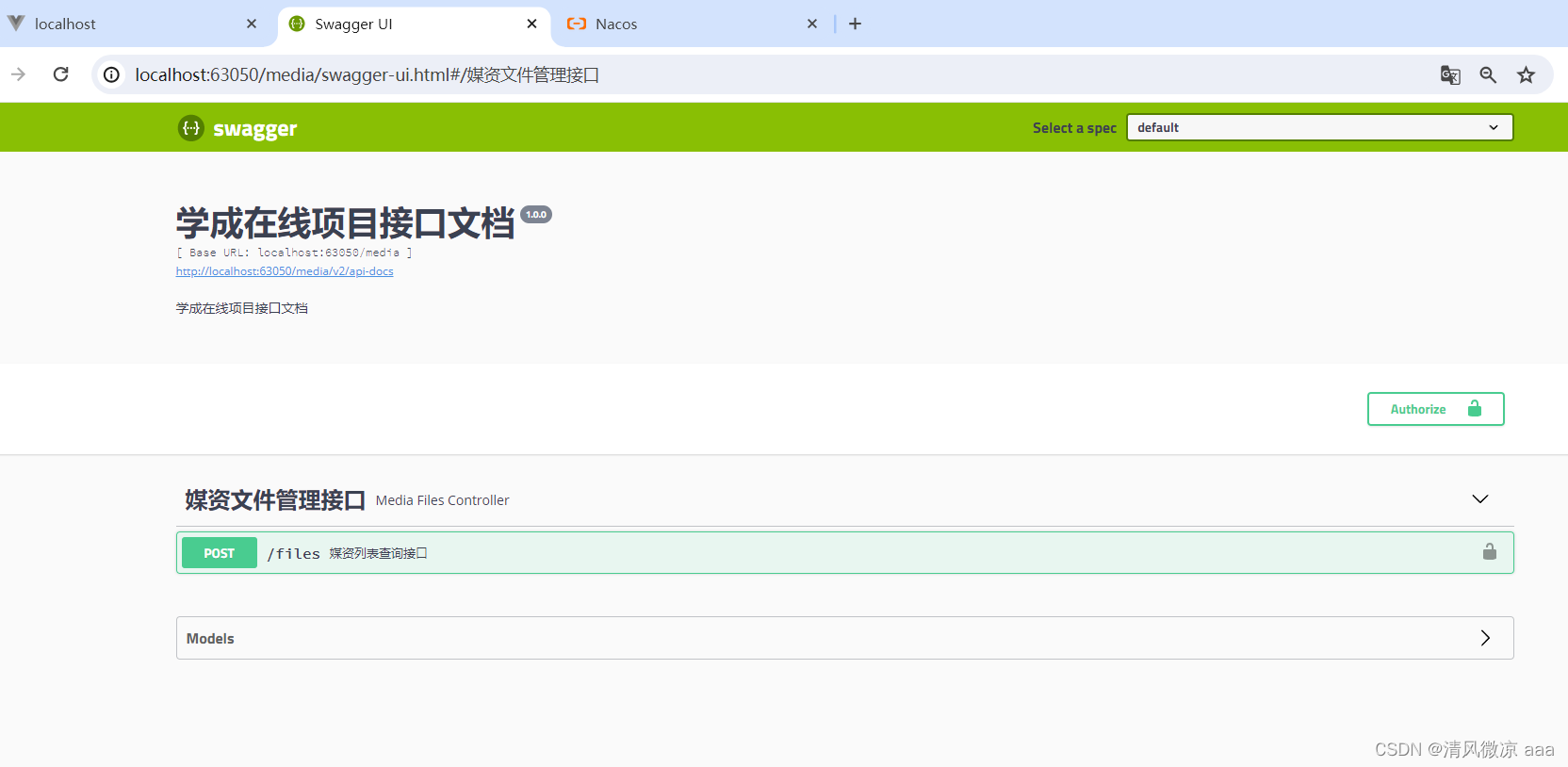

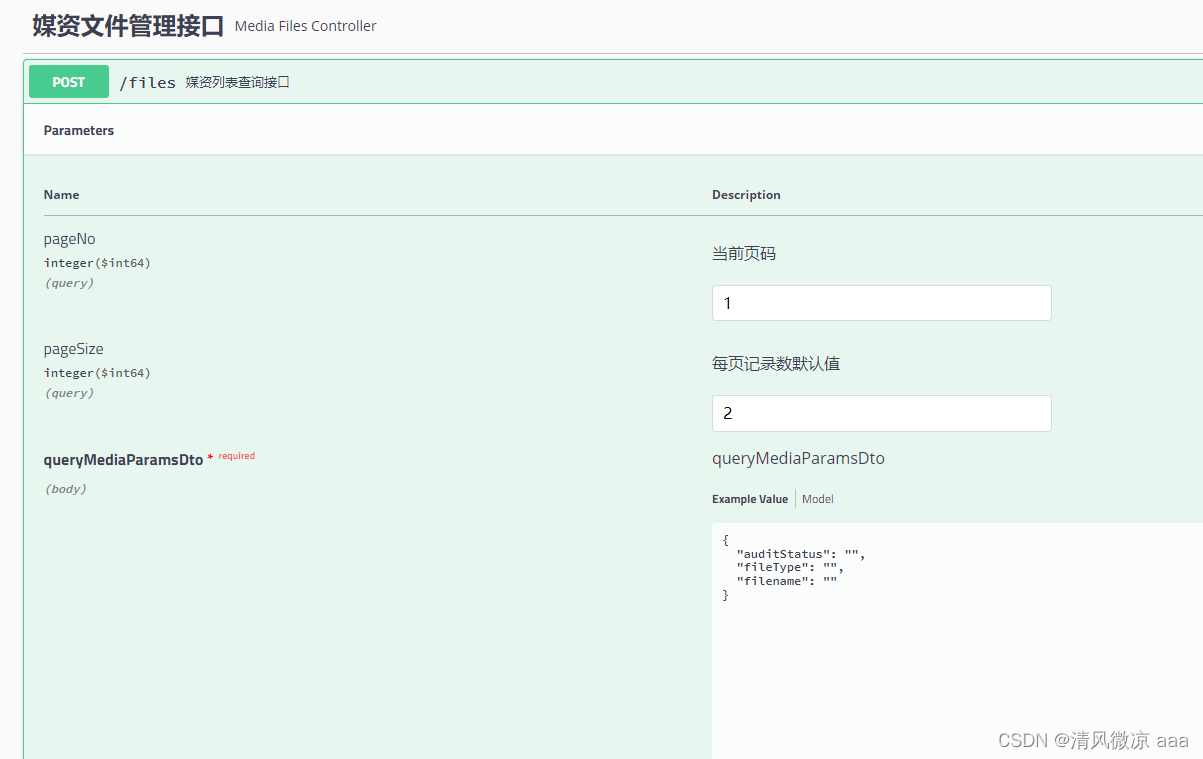

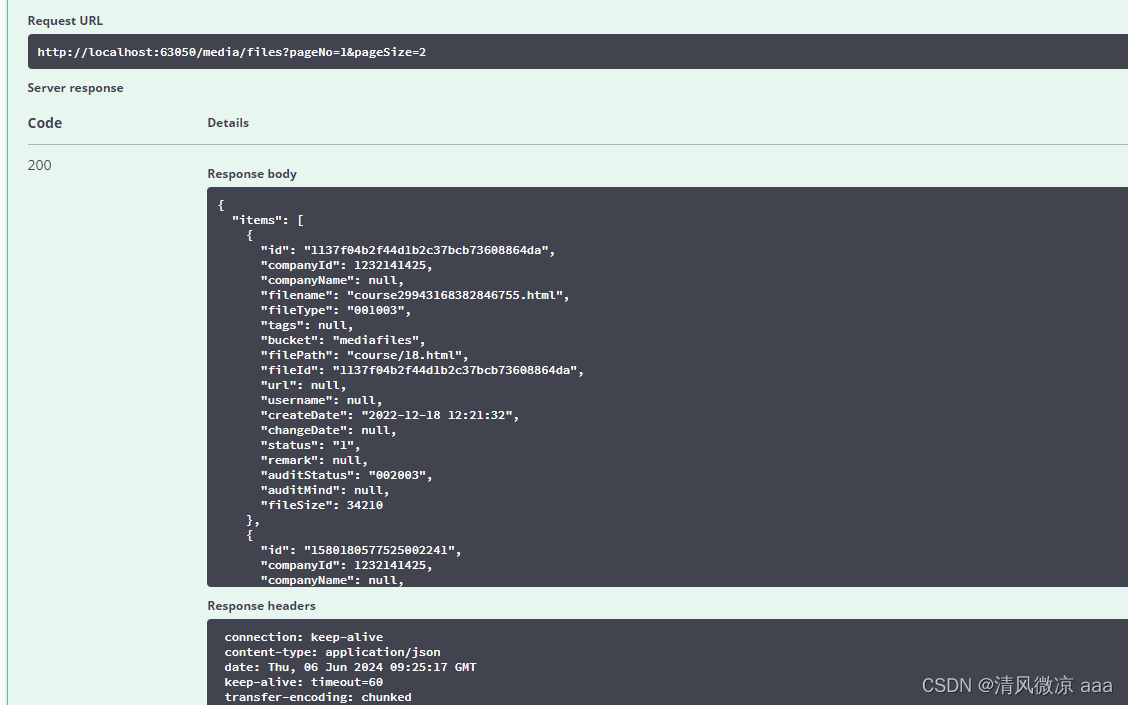

测试:导入的文件有一个接口

访问swagger:http://localhost:63050/media/swagger-ui.html

查询成功,说明搭建成功。

3 分布式文件系统

3.1 什么是分布式文件系统

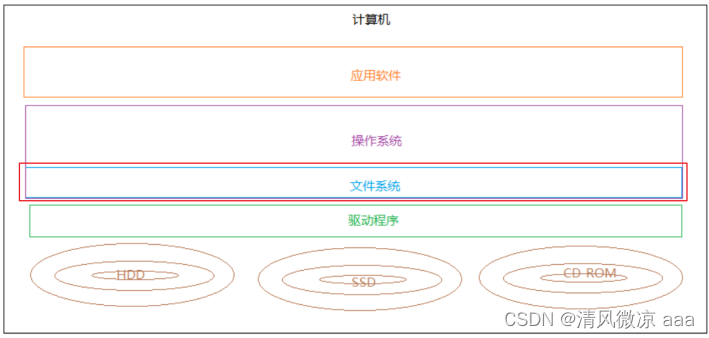

要理解分布式文件系统首先了解什么是文件系统。

查阅百度百科:

文件系统是负责管理和存储文件的系统软件,操作系统通过文件系统提供的接口去存取文件,用户通过操作系统访问磁盘上的文件。

下图指示了文件系统所处的位置:

常见的文件系统:FAT16/FAT32、NTFS、HFS、UFS、APFS、XFS、Ext4等 。

现在有个问题,一此短视频平台拥有大量的视频、图片,这些视频文件、图片文件该如何存储呢?如何存储可以满足互联网上海量用户的浏览。

今天讲的分布式文件系统就是海量用户查阅海量文件的方案。

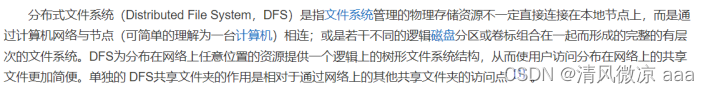

我们阅读百度百科去理解分布式文件系统的定义:

通过概念可以简单理解为:一个计算机无法存储海量的文件,通过网络将若干计算机组织起来共同去存储海量的文件,去接收海量用户的请求,这些组织起来的计算机通过网络进行通信,如下图:

好处:

- 一台计算机的文件系统处理能力扩充到多台计算机同时处理。

- 一台计算机挂了还有另外副本计算机提供数据。

- 每台计算机可以放在不同的地域,这样用户就可以就近访问,提高访问速度。

市面上有哪些分布式文件系统的产品呢?

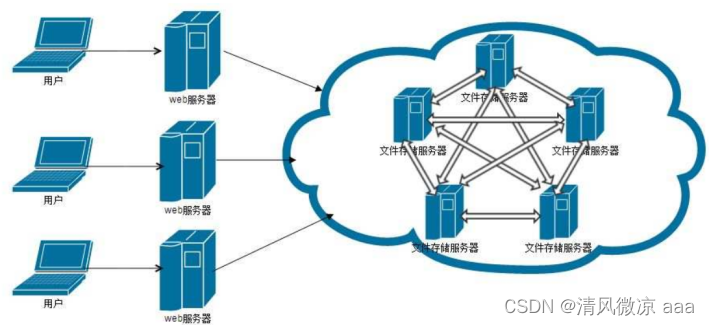

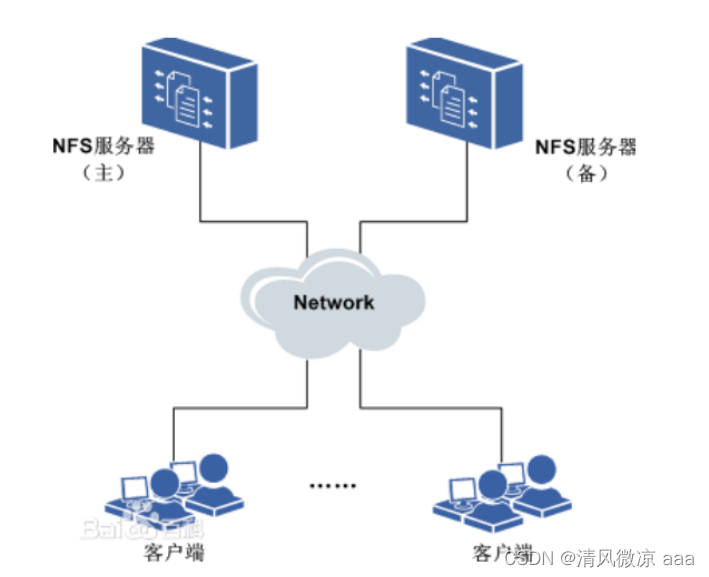

1、NFS

阅读百度百科:

特点:

- 在客户端上映射NFS服务器的驱动器。

- 客户端通过网络访问NFS服务器的硬盘完全透明。

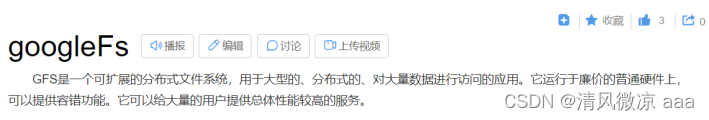

2、GFS

- GFS采用主从结构,一个GFS集群由一个master和大量的chunkserver组成。

- master存储了数据文件的元数据,一个文件被分成了若干块存储在多个chunkserver中。

- 用户从master中获取数据元信息,向chunkserver存储数据。

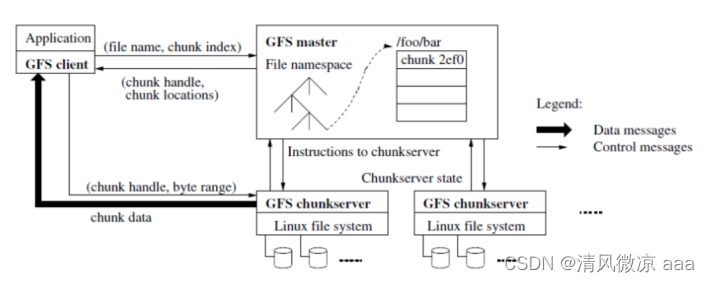

3、HDFS

HDFS,是Hadoop Distributed File System的简称,是Hadoop抽象文件系统的一种实现。HDFS是一个高度容错性的系统,适合部署在廉价的机器上。HDFS能提供高吞吐量的数据访问,非常适合大规模数据集上的应用。 HDFS的文件分布在集群机器上,同时提供副本进行容错及可靠性保证。例如客户端写入读取文件的直接操作都是分布在集群各个机器上的,没有单点性能压力。

下图是HDFS的架构图:

- HDFS采用主从结构,一个HDFS集群由一个名称结点和若干数据结点组成。

- 名称结点存储数据的元信息,一个完整的数据文件分成若干块存储在数据结点。

- 客户端从名称结点获取数据的元信息及数据分块的信息,得到信息客户端即可从数据块来存取数据。

4、云计算厂家

阿里云对象存储服务(Object Storage Service,简称 OSS),是阿里云提供的海量、安全、低成本、高可靠的云存储服务。其数据设计持久性不低于 99.9999999999%(12 个 9),服务设计可用性(或业务连续性)不低于 99.995%。

官方网站:https://www.aliyun.com/product/oss

百度对象存储BOS提供稳定、安全、高效、高可扩展的云存储服务。您可以将任意数量和形式的非结构化数据存入BOS,并对数据进行管理和处理。BOS支持标准、低频、冷和归档存储等多种存储类型,满足多场景的存储需求。

官方网站:https://cloud.baidu.com/product/bos.html

3.2 MinIO

3.2.1 介绍

本项目采用MinIO构建分布式文件系统,MinIO 是一个非常轻量的服务,可以很简单的和其他应用的结合使用,它兼容亚马逊 S3 云存储服务接口,非常适合于存储大容量非结构化的数据,例如图片、视频、日志文件、备份数据和容器/虚拟机镜像等。

它一大特点就是轻量,开源免费,使用简单,功能强大,支持各种平台,单个文件最大5TB,兼容 Amazon S3接口,提供了 Java、Python、GO等多版本SDK支持。

官网:https://min.io

中文:https://www.minio.org.cn/,http://docs.minio.org.cn/docs/

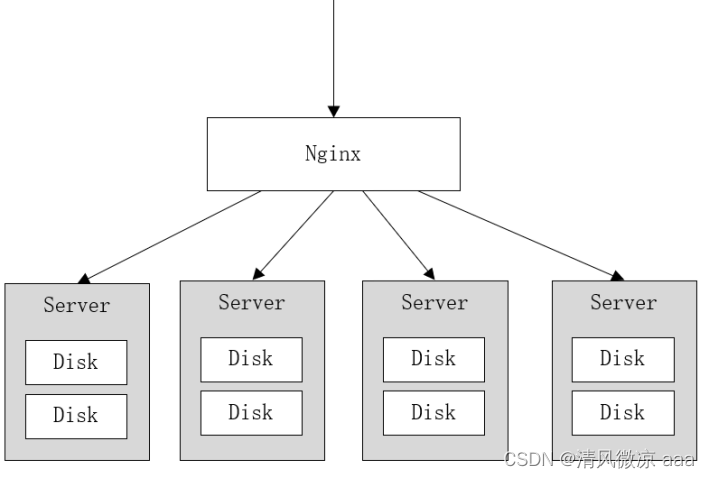

MinIO集群采用去中心化共享架构,每个结点是对等关系,通过Nginx可对MinIO进行负载均衡访问。

去中心化有什么好处?

在大数据领域,通常的设计理念都是无中心和分布式。Minio分布式模式可以帮助你搭建一个高可用的对象存储服务,你可以使用这些存储设备,而不用考虑其真实物理位置。

它将分布在不同服务器上的多块硬盘组成一个对象存储服务。由于硬盘分布在不同的节点上,分布式Minio避免了单点故障。如下图:

Minio使用纠删码技术来保护数据,它是一种恢复丢失和损坏数据的数学算法,它将数据分块冗余的分散存储在各各节点的磁盘上,所有的可用磁盘组成一个集合,上图由8块硬盘组成一个集合,当上传一个文件时会通过纠删码算法计算对文件进行分块存储,除了将文件本身分成4个数据块,还会生成4个校验块,数据块和校验块会分散的存储在这8块硬盘上。

使用纠删码的好处是即便丢失一半数量(N/2)的硬盘,仍然可以恢复数据。 比如上边集合中有4个以内的硬盘损害仍可保证数据恢复,不影响上传和下载,如果多于一半的硬盘坏了则无法恢复。

3.2.2 数据恢复演示

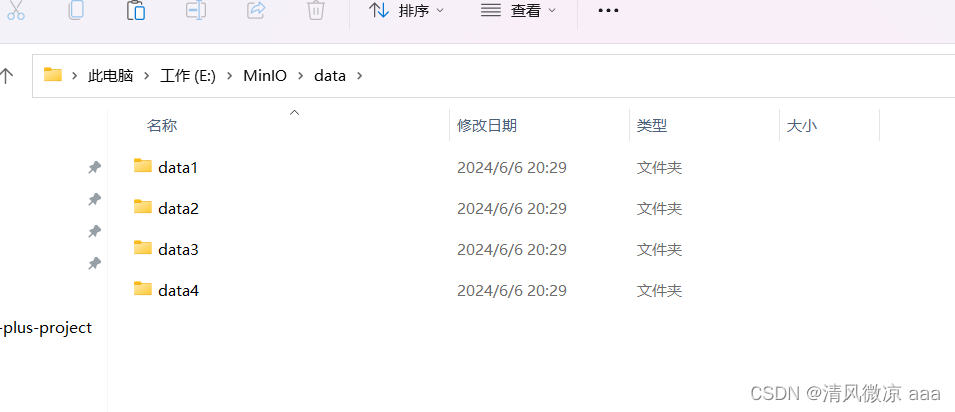

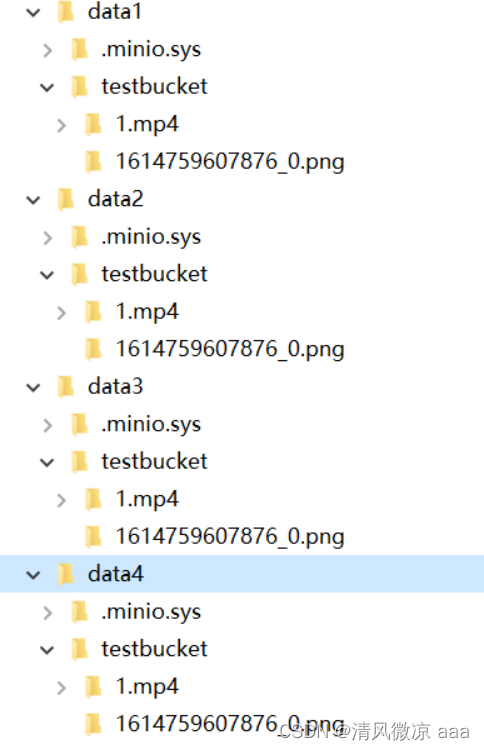

下边在本机演示MinIO恢复数据的过程,在本地创建4个目录表示4个硬盘。

正常情况下应该启动4台虚拟机,但是太耗费性能所以用一个目录代表一个节点。

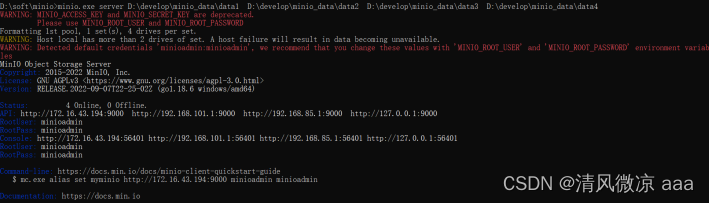

下载minio,下载地址在https://dl.min.io/server/minio/release/,可从课程资料找到MinIO的安装文件minio.zip解压即可使用,CMD进入有minio.exe的目录,运行下边的命令:

minio.exe server E:\MinIO\data\data1 E:\MinIO\data\data2 E:\MinIO\data\data3 E:\MinIO\data\data4

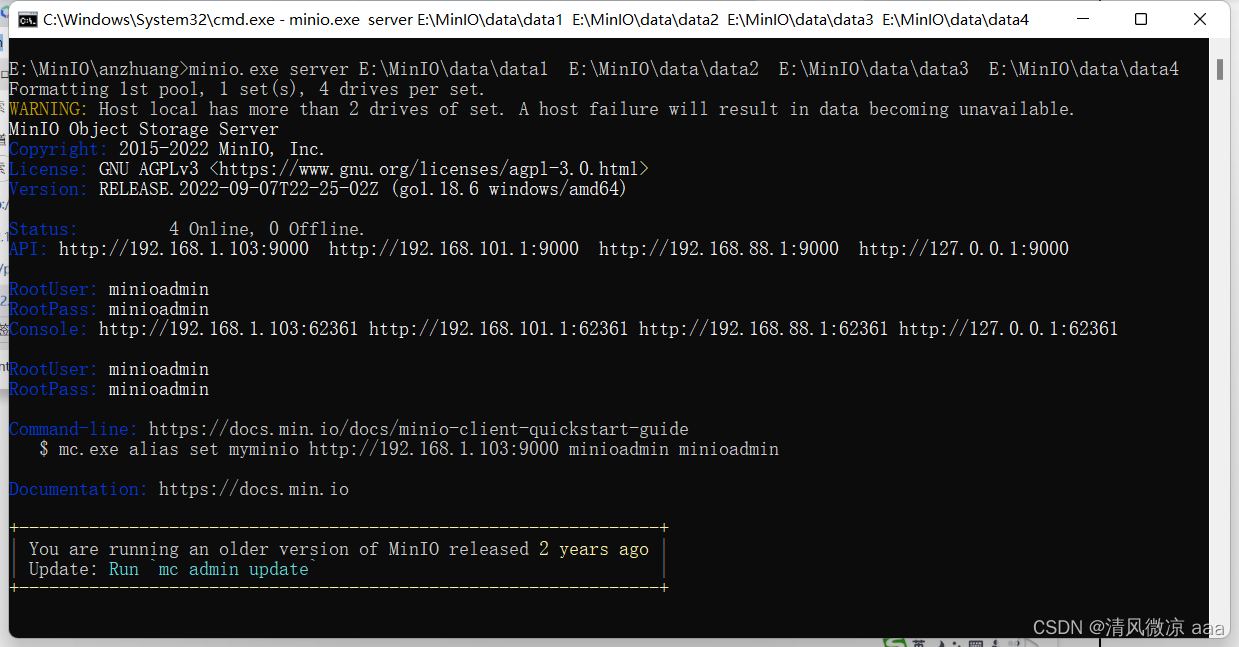

启动结果如下:

说明如下:

WARNING: MINIO_ACCESS_KEY and MINIO_SECRET_KEY are deprecated.

Please use MINIO_ROOT_USER and MINIO_ROOT_PASSWORD

Formatting 1st pool, 1 set(s), 4 drives per set.

WARNING: Host local has more than 2 drives of set. A host failure will result in data becoming unavailable.

WARNING: Detected default credentials 'minioadmin:minioadmin', we recommend that you change these values with 'MINIO_ROOT_USER' and 'MINIO_ROOT_PASSWORD' environment variables

- 老版本使用的MINIO_ACCESS_KEY 和 MINIO_SECRET_KEY不推荐使用,推荐使用MINIO_ROOT_USER 和MINIO_ROOT_PASSWORD设置账号和密码。

- pool即minio节点组成的池子,当前有一个pool和4个硬盘组成的set集合

- 因为集合是4个硬盘,大于2的硬盘损坏数据将无法恢复。

- 账号和密码默认为minioadmin、minioadmin,可以在环境变量中设置通过’MINIO_ROOT_USER’ and ‘MINIO_ROOT_PASSWORD’ 进行设置。

下边输入http://localhost:9000进行登录,账号和密码为:minioadmin/minioadmin

登录成功:

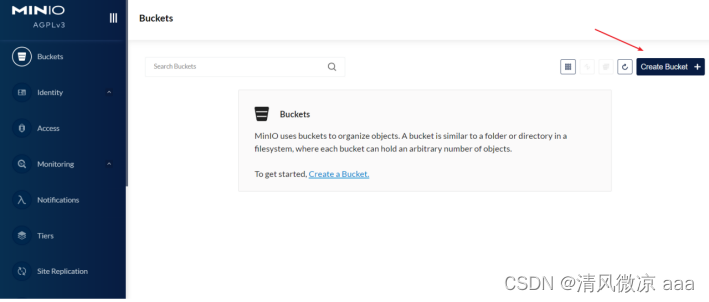

下一步创建bucket,桶,它相当于存储文件的目录,可以创建若干的桶。

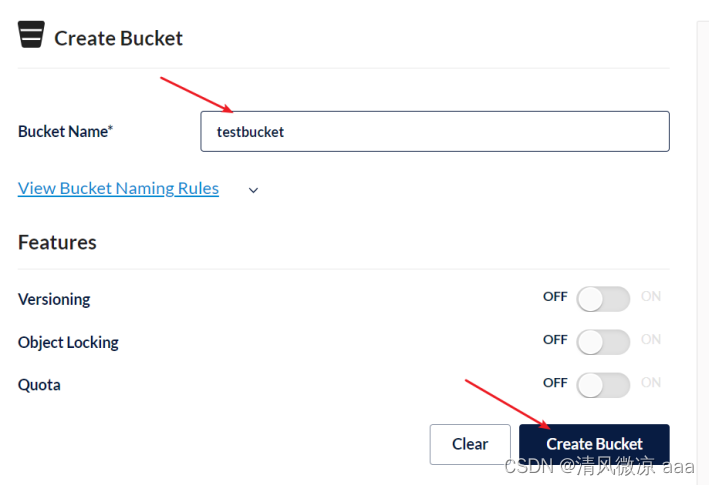

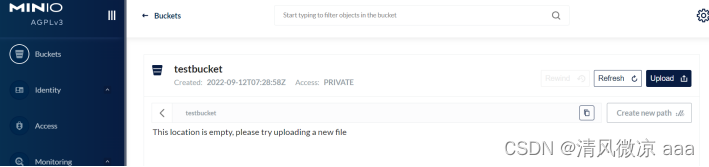

输入bucket的名称,点击“CreateBucket”,创建成功

点击“upload”上传文件。

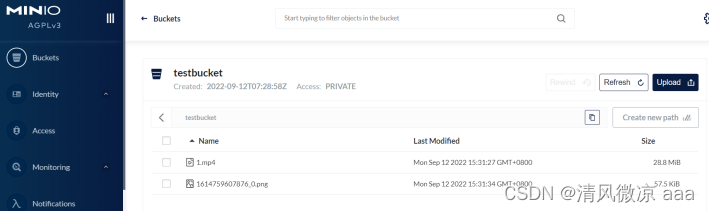

下边上传几个文件

下边去四个目录观察文件的存储情况

我们发现上传的1.mp4文件存储在了四个目录,即四个硬盘上。

下边测试minio的数据恢复过程:

- 首先删除一个目录。

- 删除目录后仍然可以在web控制台上传文件和下载文件。

- 稍等片刻删除的目录自动恢复。

- 删除两个目录。

- 删除两个目录也会自动恢复。

- 删除三个目录 。

- 由于 集合中共有4块硬盘,有大于一半的硬盘损坏数据无法恢复。

- 此时报错:We encountered an internal error, please try again. (Read failed. Insufficient number of drives online)在线驱动器数量不足。

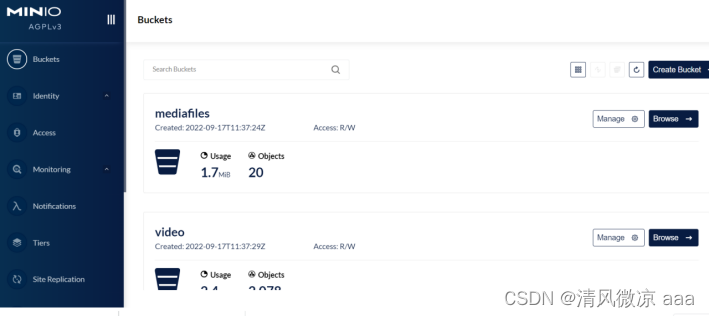

3.2.3 测试Docker环境

开发阶段和生产阶段统一使用Docker下的MINIO。

在下发的虚拟机中已安装了MinIO的镜像和容器,执行sh /data/soft /restart.sh启动Docker下的MinIO

启动完成登录MinIO查看是否正常。

访问http://192.168.101.65:9000

账号和密码为:minioadmin/minioadmin

本项目创建两个buckets:

- mediafiles: 普通文件

- video:视频文件

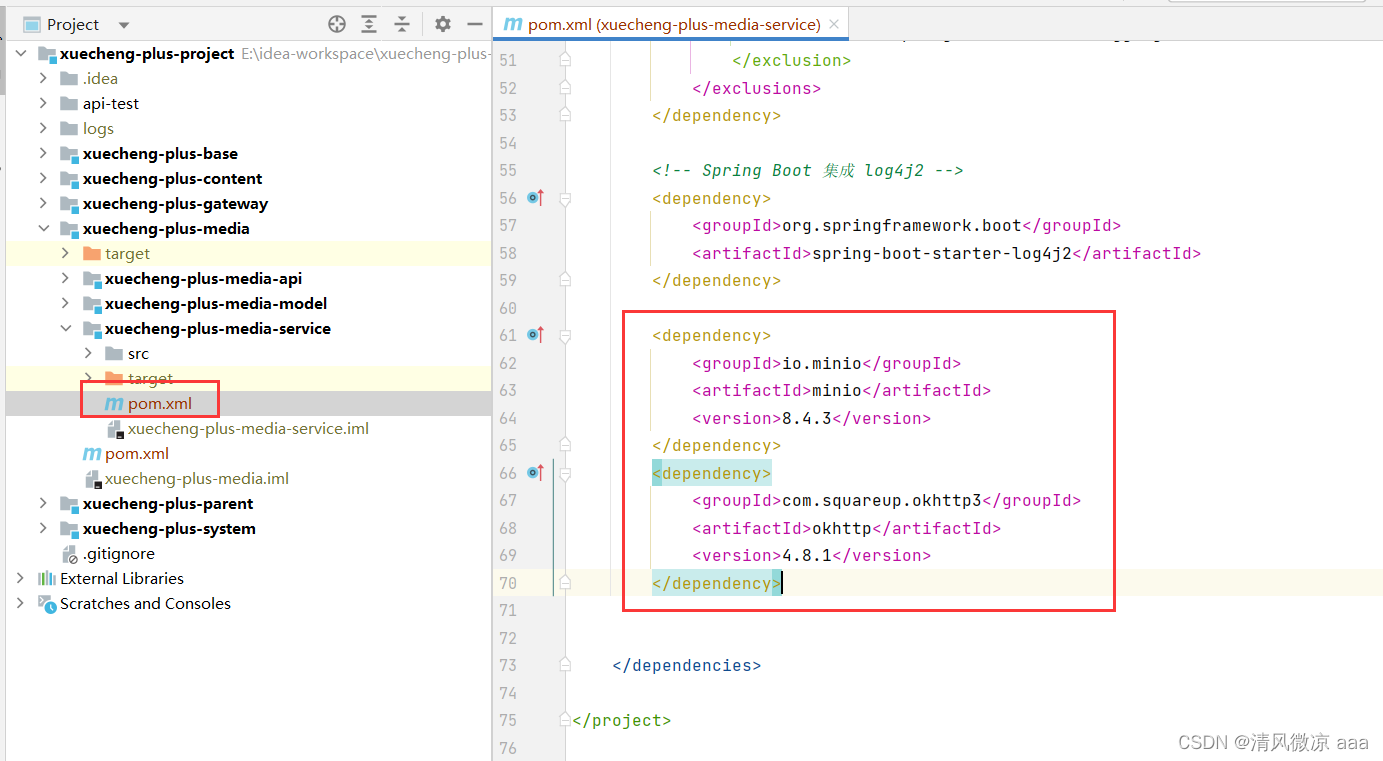

3.2.4 SDK

3.2.4.1上传文件

说明:上面是在浏览器访问页面,之后上传图片的,开发中一定是使用java代码的方式来操作。

MinIO提供多个语言版本SDK的支持,下边找到java版本的文档:

地址:https://docs.min.io/docs/java-client-quickstart-guide.html

最低需求Java 1.8或更高版本:

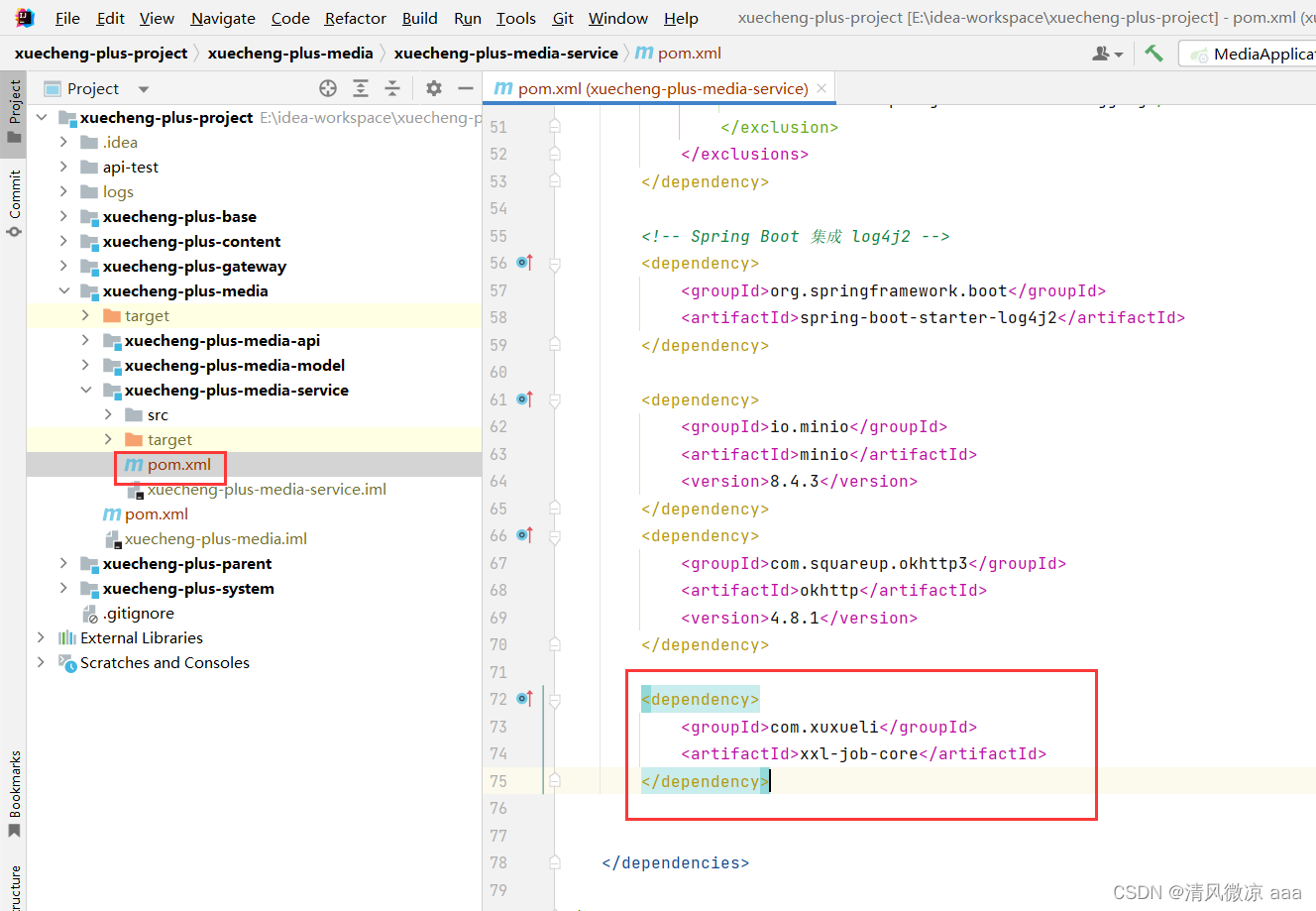

在media-service工程中添加依赖,maven依赖如下:

<dependency>

<groupId>io.minio</groupId>

<artifactId>minio</artifactId>

<version>8.4.3</version>

</dependency>

<dependency>

<groupId>com.squareup.okhttp3</groupId>

<artifactId>okhttp</artifactId>

<version>4.8.1</version>

</dependency>

参数说明:

需要三个参数才能连接到minio服务。

| 参数 | 说明 |

|---|---|

| Endpoint | 对象存储服务的URL |

| Access Key | Access key就像用户ID,可以唯一标识你的账户。 |

| Secret Key | Secret key是你账户的密码。 |

官方的示例代码如下:

import io.minio.BucketExistsArgs;

import io.minio.MakeBucketArgs;

import io.minio.MinioClient;

import io.minio.UploadObjectArgs;

import io.minio.errors.MinioException;

import java.io.IOException;

import java.security.InvalidKeyException;

import java.security.NoSuchAlgorithmException;

public class FileUploader {

public static void main(String[] args)throws IOException, NoSuchAlgorithmException, InvalidKeyException {

try {

// Create a minioClient with the MinIO server playground, its access key and secret key.

MinioClient minioClient =

MinioClient.builder()

.endpoint("https://play.min.io")

.credentials("Q3AM3UQ867SPQQA43P2F", "zuf+tfteSlswRu7BJ86wekitnifILbZam1KYY3TG")

.build();

// Make 'asiatrip' bucket if not exist.

boolean found =

minioClient.bucketExists(BucketExistsArgs.builder().bucket("asiatrip").build());

if (!found) {

// Make a new bucket called 'asiatrip'.

minioClient.makeBucket(MakeBucketArgs.builder().bucket("asiatrip").build());

} else {

System.out.println("Bucket 'asiatrip' already exists.");

}

// Upload '/home/user/Photos/asiaphotos.zip' as object name 'asiaphotos-2015.zip' to bucket

// 'asiatrip'.

minioClient.uploadObject(

UploadObjectArgs.builder()

.bucket("asiatrip")

.object("asiaphotos-2015.zip")

.filename("/home/user/Photos/asiaphotos.zip")

.build());

System.out.println(

"'/home/user/Photos/asiaphotos.zip' is successfully uploaded as "

+ "object 'asiaphotos-2015.zip' to bucket 'asiatrip'.");

} catch (MinioException e) {

System.out.println("Error occurred: " + e);

System.out.println("HTTP trace: " + e.httpTrace());

}

}

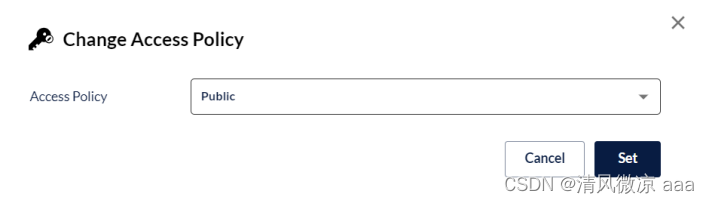

}

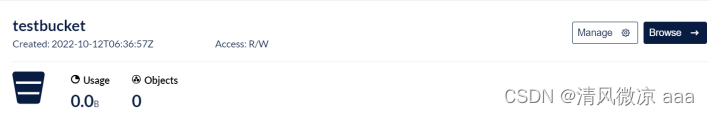

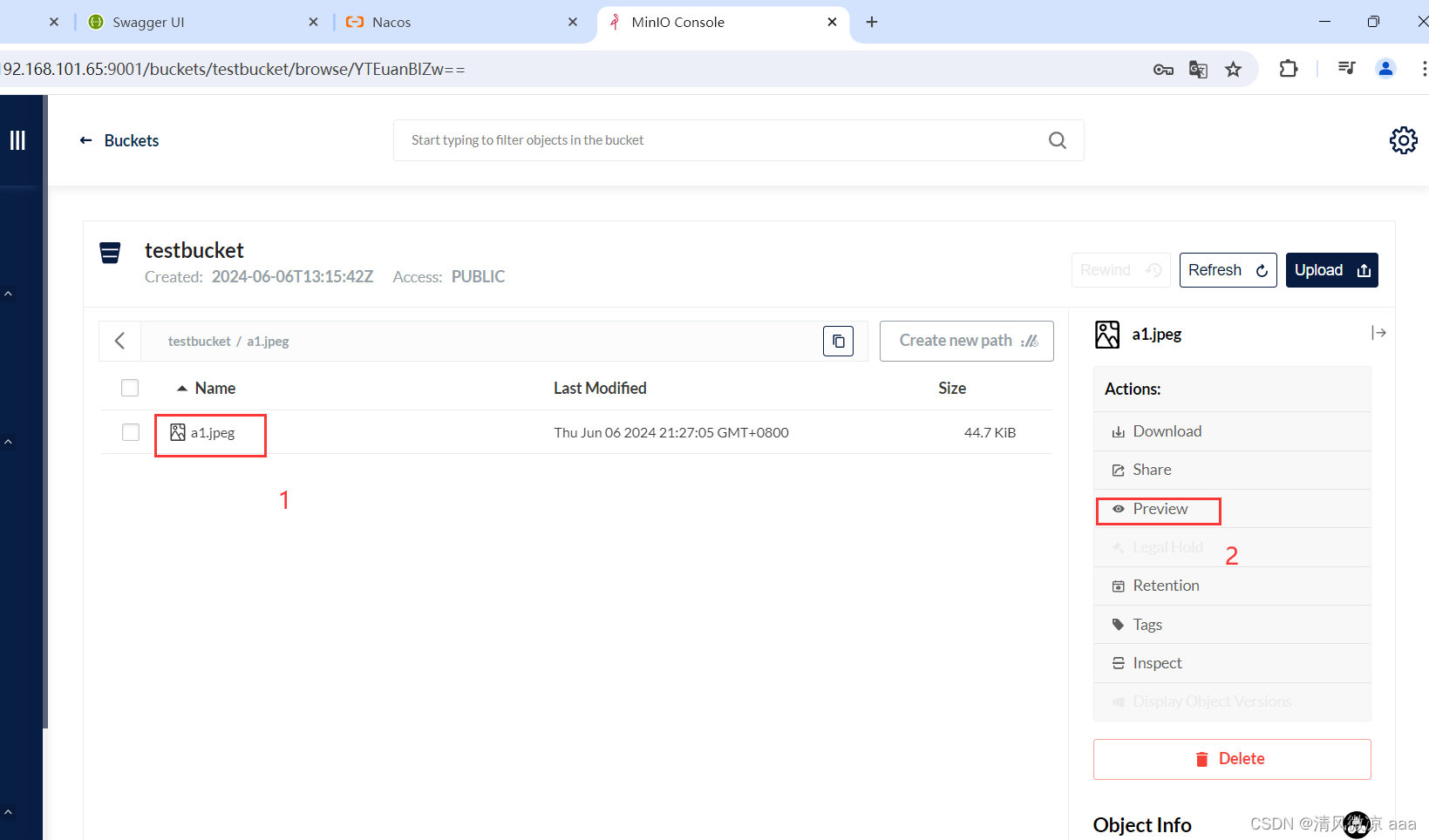

参考示例在media-service工程中 测试上传文件功能,

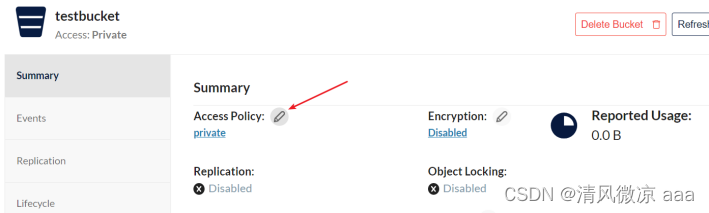

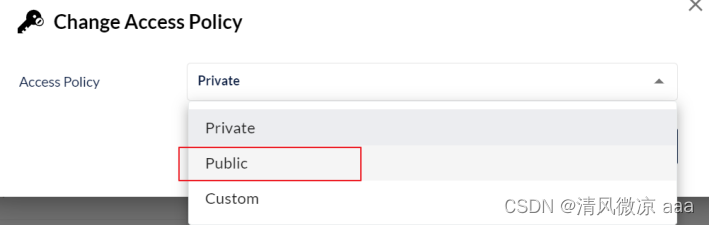

首先创建一个用于测试的bucket:testbucket

点击“Manage”修改bucket的访问权限

选择public权限:如果不改,接口中是拿不到下载里面的文件的。

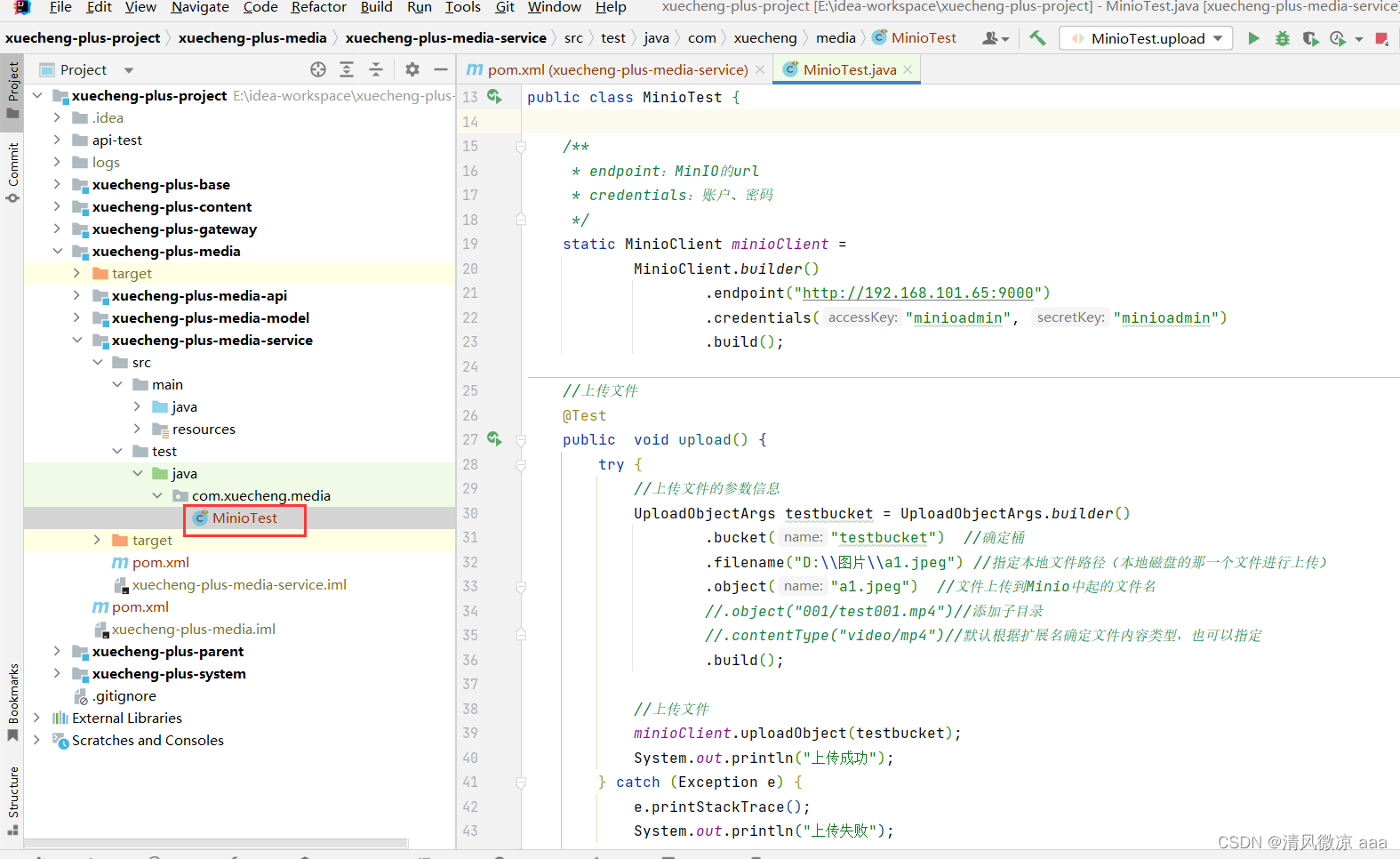

在xuecheng-plus-media-service工程 的test下编写测试代码如下:

package com.xuecheng.media;

import io.minio.MinioClient;

import io.minio.UploadObjectArgs;

import org.junit.jupiter.api.Test;

/**

* @description 测试MinIO

* @author Mr.M

* @date 2022/9/11 21:24

* @version 1.0

*/

public class MinioTest {

/**

* endpoint:MinIO的url

* credentials:账户、密码

*/

static MinioClient minioClient =

MinioClient.builder()

.endpoint("http://192.168.101.65:9000")

.credentials("minioadmin", "minioadmin")

.build();

//上传文件

@Test

public void upload() {

try {

//上传文件的参数信息

UploadObjectArgs testbucket = UploadObjectArgs.builder()

.bucket("testbucket") //确定桶

.filename("D:\\图片\\a1.jpeg") //指定本地文件路径(本地磁盘的那一个文件进行上传)

.object("a1.jpeg") //文件上传到Minio中起的文件名

//.object("001/test001.mp4")//添加子目录

//.contentType("video/mp4")//默认根据扩展名确定文件内容类型,也可以指定

.build();

//上传文件

minioClient.uploadObject(testbucket);

System.out.println("上传成功");

} catch (Exception e) {

e.printStackTrace();

System.out.println("上传失败");

}

}

}

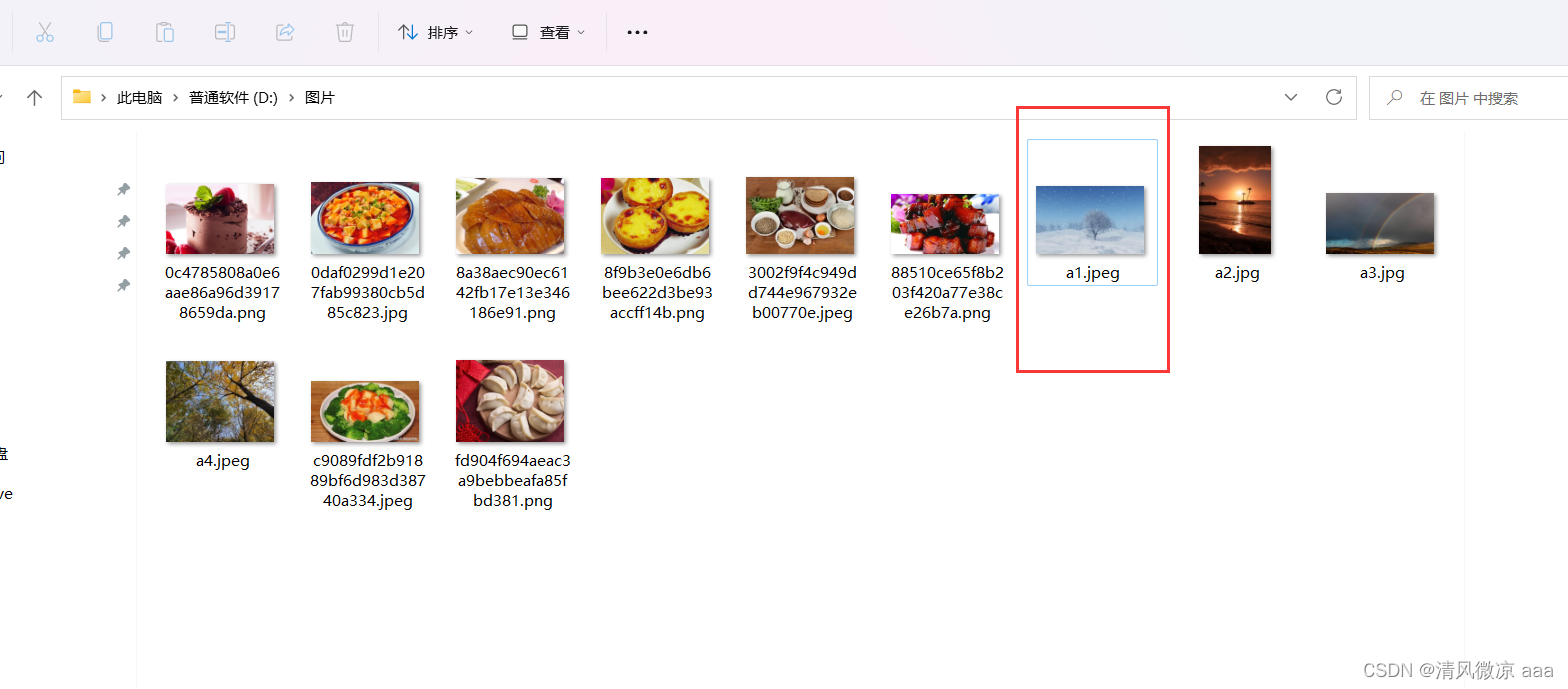

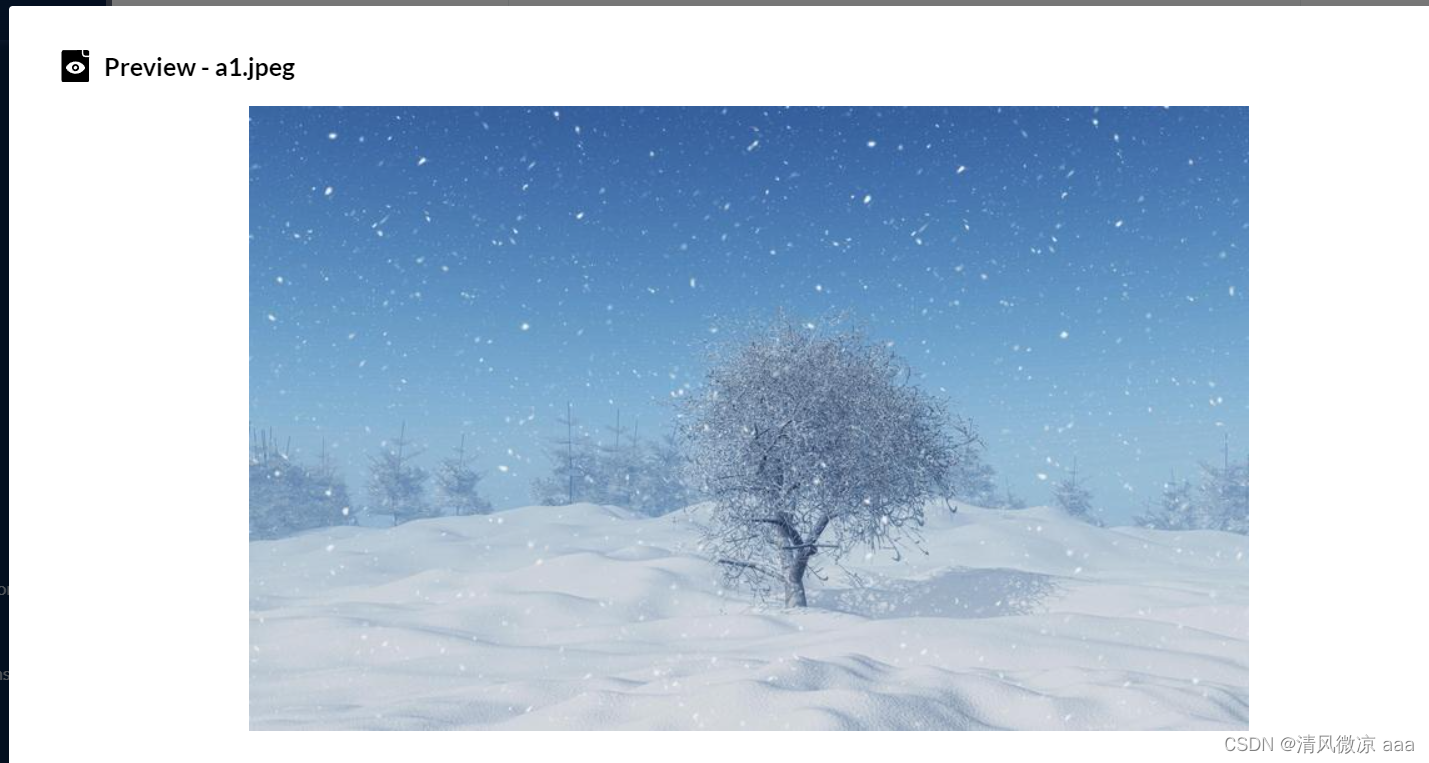

上传用到的图片:

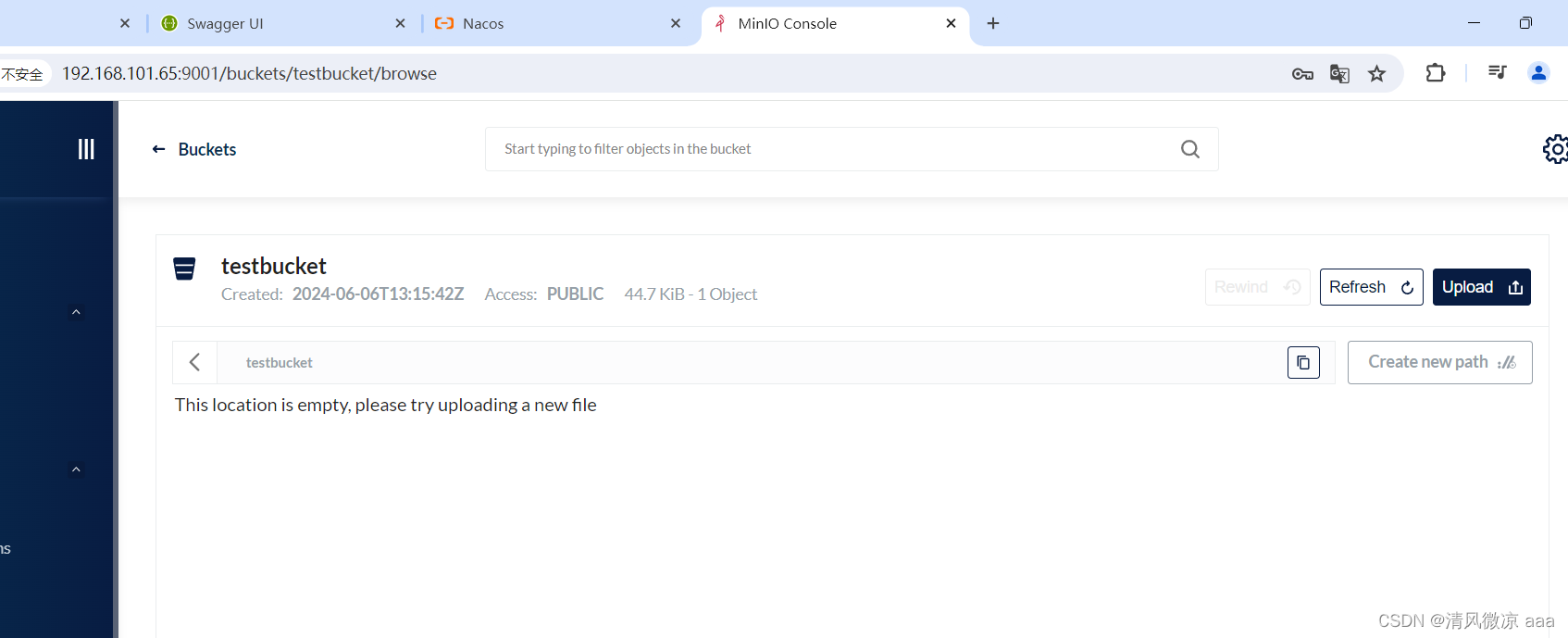

执行upload方法,分别测试向桶的根目录上传文件以及子目录上传文件。

上传成功,通过web控制台查看文件,并预览文件。

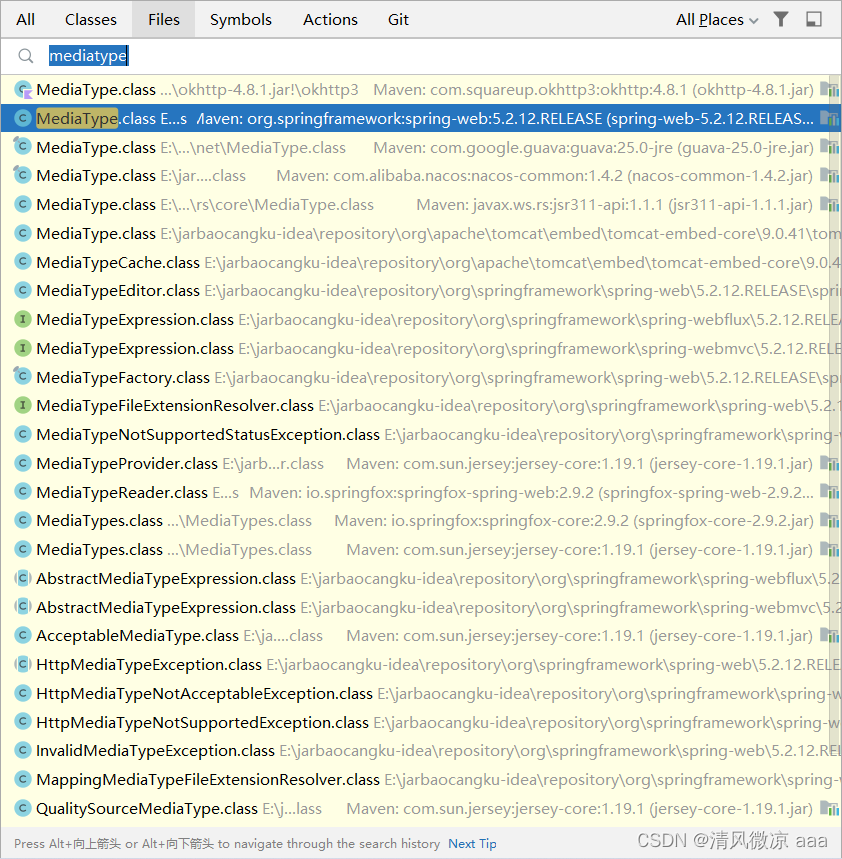

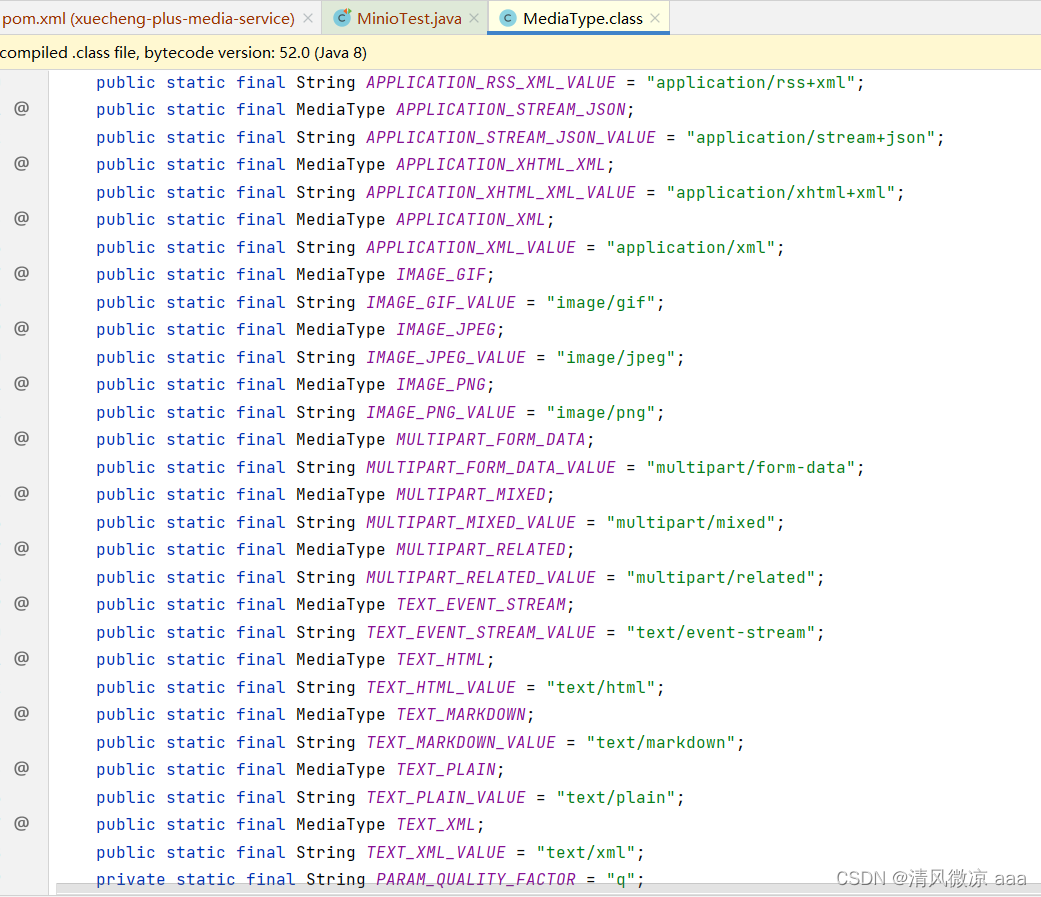

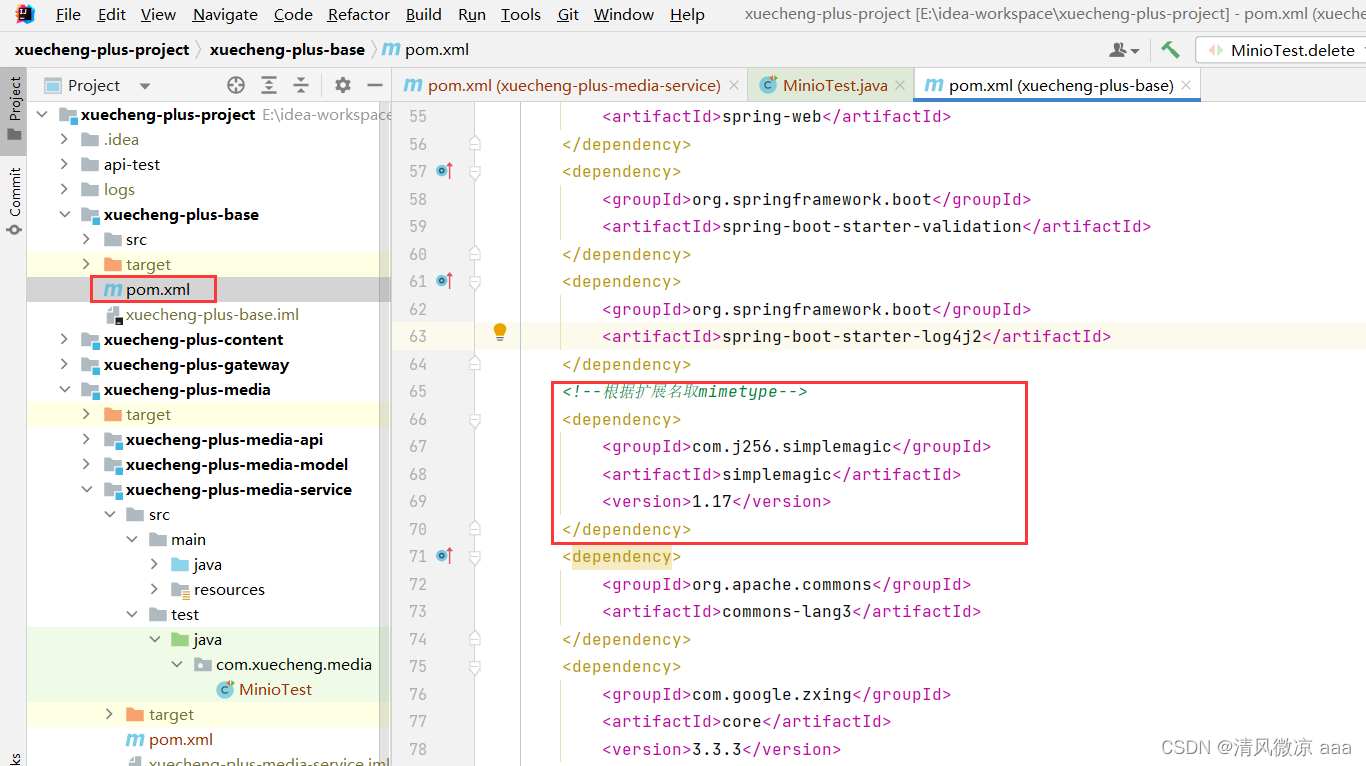

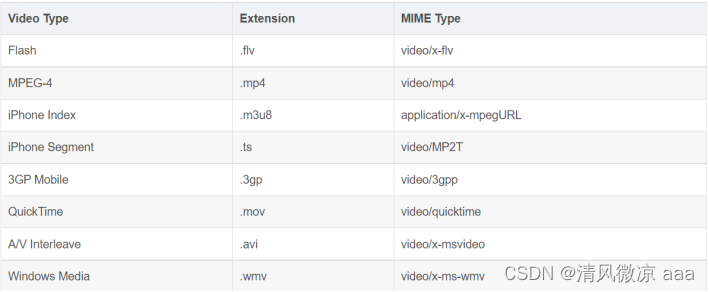

说明:最好通过一个第三方的工具类指定文件扩展名,虽然默认可以识别扩展名,但前提是你上传的文件有扩展名,如果上传的文件没有扩展名就无法识别了。

-

设置contentType可以通过com.j256.simplemagic.ContentType枚举类查看常用的mimeType(媒体类型)ctrl+shift+n

-

需要引入第三方的依赖

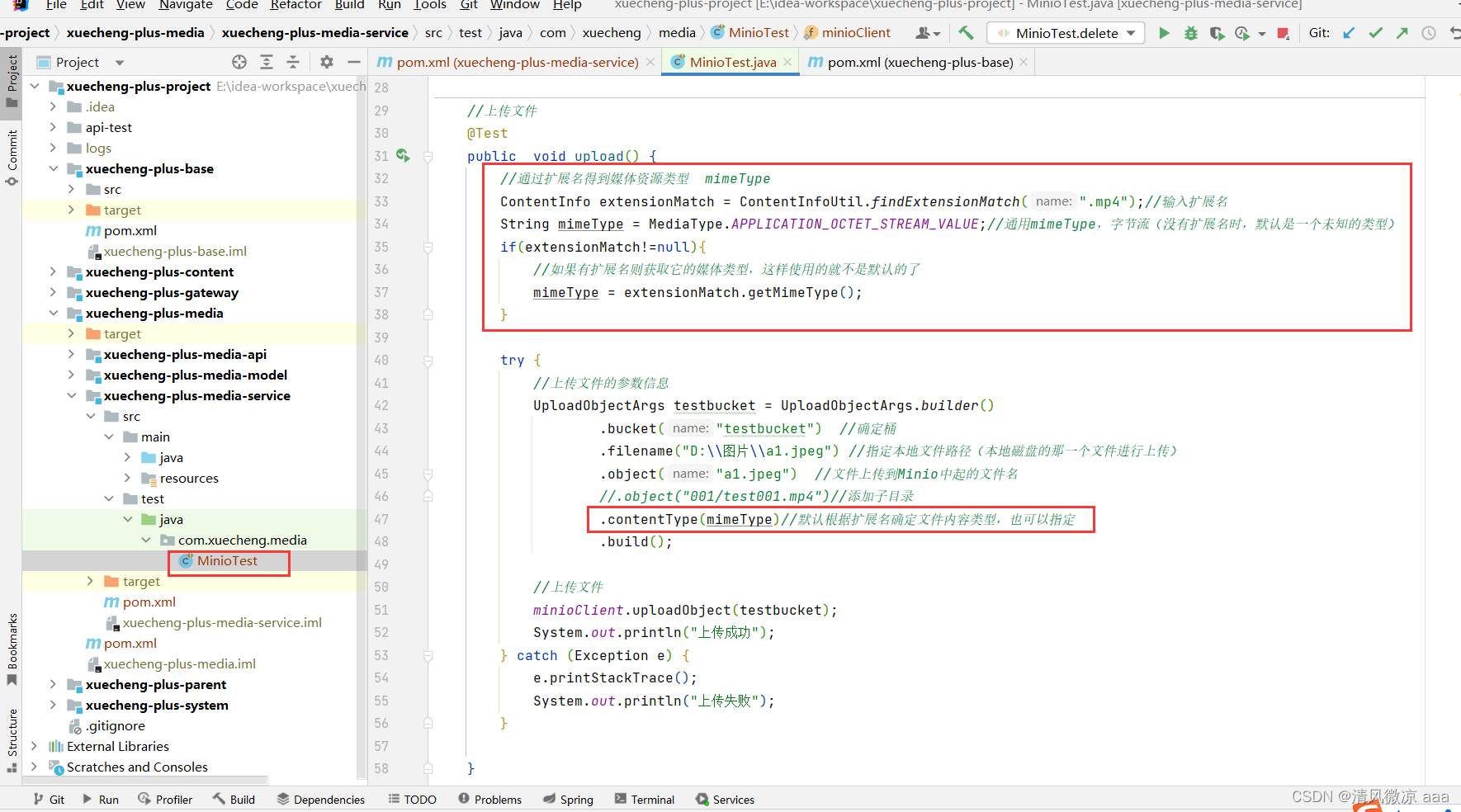

通过扩展名得到mimeType,代码如下:

//根据扩展名取出mimeType

ContentInfo extensionMatch = ContentInfoUtil.findExtensionMatch(".mp4");

String mimeType = MediaType.APPLICATION_OCTET_STREAM_VALUE;//通用mimeType,字节流

完善上边的代码 如下:

/**

* endpoint:MinIO的url

* credentials:账户、密码

*/

static MinioClient minioClient =

MinioClient.builder()

.endpoint("http://192.168.101.65:9000")

.credentials("minioadmin", "minioadmin")

.build();

//上传文件

@Test

public void upload() {

//通过扩展名得到媒体资源类型 mimeType

ContentInfo extensionMatch = ContentInfoUtil.findExtensionMatch(".mp4");//输入扩展名

String mimeType = MediaType.APPLICATION_OCTET_STREAM_VALUE;//通用mimeType,字节流(没有扩展名时,默认是一个未知的类型)

if(extensionMatch!=null){

//如果有扩展名则获取它的媒体类型,这样使用的就不是默认的了

mimeType = extensionMatch.getMimeType();

}

try {

//上传文件的参数信息

UploadObjectArgs testbucket = UploadObjectArgs.builder()

.bucket("testbucket") //确定桶

.filename("D:\\图片\\a1.jpeg") //指定本地文件路径(本地磁盘的那一个文件进行上传)

.object("a1.jpeg") //文件上传到Minio中起的文件名

//.object("001/test001.mp4")//添加子目录

.contentType(mimeType)//默认根据扩展名确定文件内容类型,也可以指定

.build();

//上传文件

minioClient.uploadObject(testbucket);

System.out.println("上传成功");

} catch (Exception e) {

e.printStackTrace();

System.out.println("上传失败");

}

}

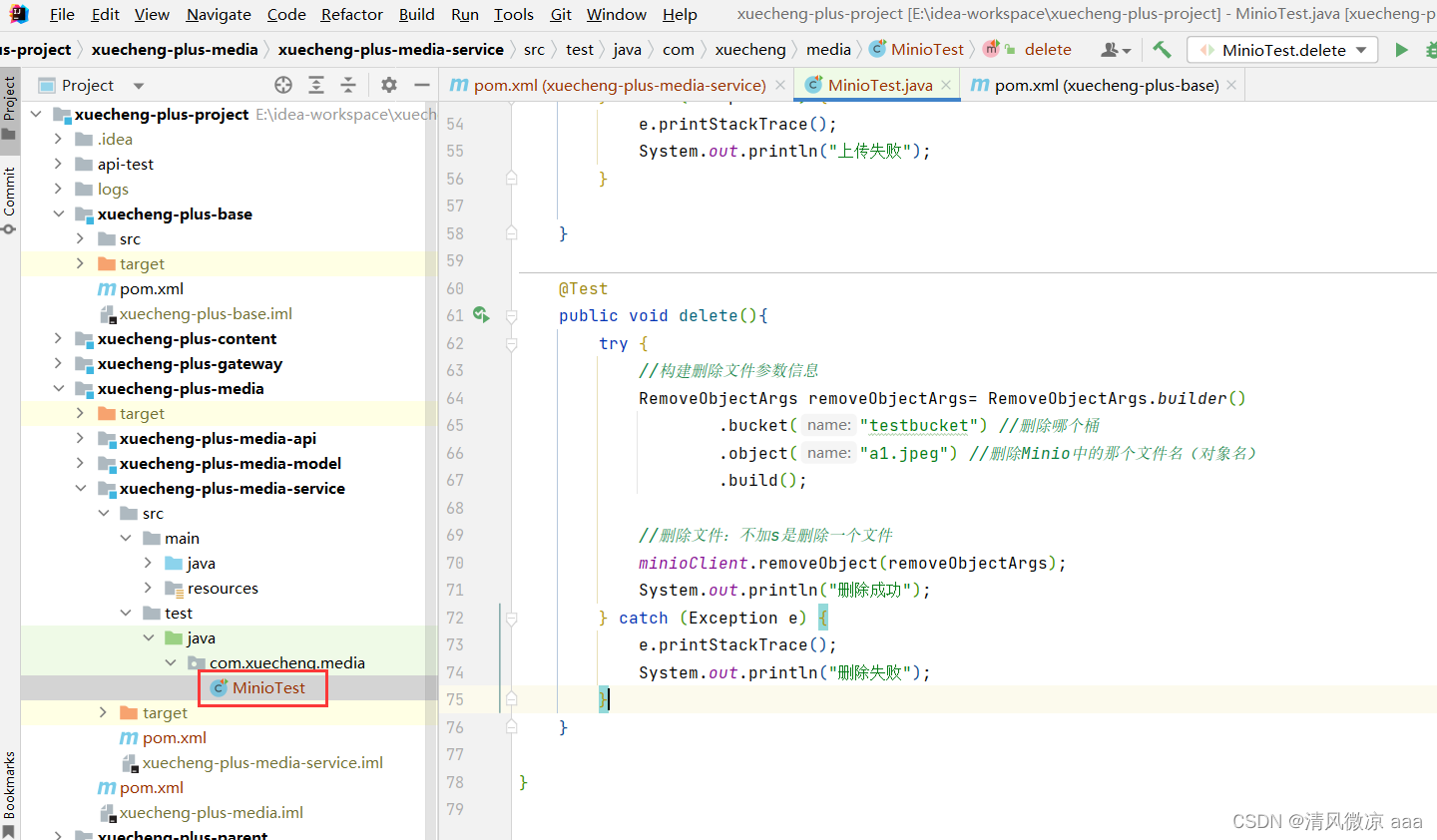

3.2.4.2 删除文件

下边测试删除文件

参考:https://docs.min.io/docs/java-client-api-reference#removeObject

//删除

@Test

public void delete(){

try {

//构建删除文件参数信息

RemoveObjectArgs removeObjectArgs= RemoveObjectArgs.builder()

.bucket("testbucket") //删除哪个桶

.object("a1.jpeg") //删除Minio中的那个文件名(对象名)

//.object("001/test001.mp4") 删除带子目录的文件

.build();

//删除文件:不加s是删除一个文件

minioClient.removeObject(removeObjectArgs);

System.out.println("删除成功");

} catch (Exception e) {

e.printStackTrace();

System.out.println("删除失败");

}

}

3.2.4.3 查询文件

通过查询文件查看文件是否存在minio中。

参考:https://docs.min.io/docs/java-client-api-reference#getObject

//查询文件 从minio中下载

@Test

public void test_getFile() throws Exception{

//1.构建参数

GetObjectArgs getObjectArgs = GetObjectArgs.builder()

.bucket("testbucket") //桶

.object("a1.jpeg") //minio中下载的文件名

.build();

//2.下载文件

//输入流获取文件

FilterInputStream inputStream = minioClient.getObject(getObjectArgs);

//指定输出流:下载的位置 注意:这是查询远程服务获取的一个流对象,远程流计算md5可能会不稳定有问题,所以需要用本地流

FileOutputStream outputStream = new FileOutputStream(new File("D:\\图片\\a12222.jpeg"));

//流拷贝:把输入流的内容拷贝到输出流中

IOUtils.copy(inputStream,outputStream);

//3.校验文件的完整性:如何知道文件下载完成后是完整的,没有丢失呢??? (这个地方讲的不太好,参考一下即可)

//思路:将原始文件的md5加密后的值和下载后的文件md5值进行比较即可 远程流网络有问题不稳定---改为本地流

//String source_md5 = DigestUtils.md5Hex(inputStream); //原始文件:minio中文件的md5

//最终:通过本地上传之前的文件和下载到本地后的文件进行比较

FileInputStream fileInputStream1 = new FileInputStream(new File("D:\\图片\\a1.jpeg"));

String source_md5 = DigestUtils.md5Hex(fileInputStream1);

String local_md5 = DigestUtils.md5Hex(new FileInputStream(new File("D:\\图片\\a12222.jpeg")));//本地文件md5

if(source_md5.equals(local_md5)){

System.out.println("下载成功");

}

}

4 上传图片

4.1 需求分析

4.1.1 业务流程

课程图片是宣传课程非常重要的信息,在新增课程界面上传课程图片,也可以修改课程图片。

如下图:

上传课程图片总体上包括两部分:

- 上传课程图片前端请求媒资管理服务将文件上传至分布式文件系统,并且在媒资管理数据库保存文件信息。

- 上传图片成功保存图片地址到课程基本信息表中。

详细流程如下:

- 前端进入上传图片界面

- 上传图片,请求媒资管理服务。

- 媒资管理服务将图片文件存储在MinIO。

- 媒资管理记录文件信息到数据库。

- 为什么存储文件信息:类似于云盘,第一次上传4个G的视频第二次再次上传一个相同的4个G的视频,他不会在重新传一遍了而是立即上传上去了,因为它已经校验这个视频在云盘上已经存在了,所以我们要对文件的信息进行存储,用来校验你重复上传时这个文件是否已经上传过,如果存在就不用上传了。

- 前端请求内容管理服务保存课程信息,在内容管理数据库保存图片地址。

- 保存在前面内容管理模块已经做过了

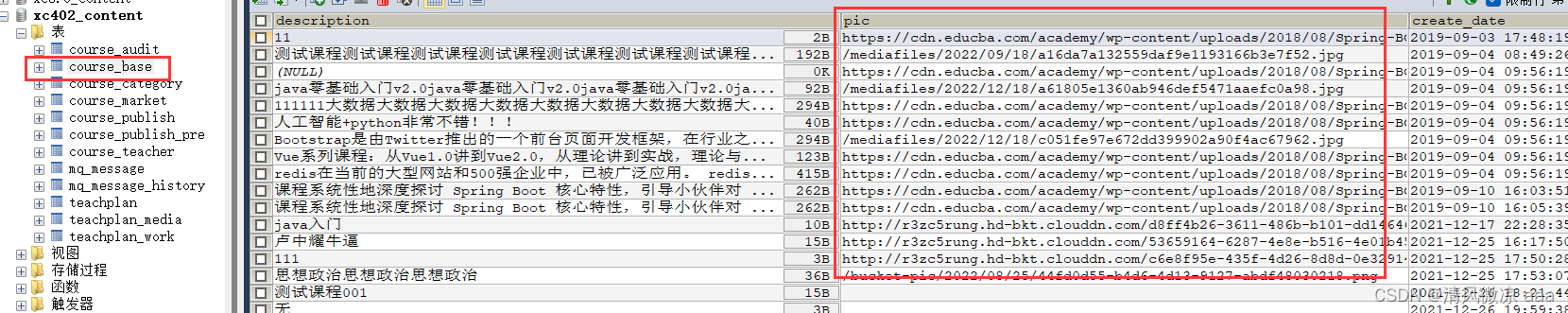

4.1.2 数据模型

涉及到的数据表有:课程信息表中的图片字段、媒资数据库的文件表,下边主要看媒资数据库的文件表。

各字段描述如下:

- id:前端上传的时候会传递md5值作为id,根据这个md5值来区分文件是否上传。

- 同一个文件的md5值是一样的,前端在上传的时候会把这个文件的md5值传到后台,后台如果有这个md5值说明文件上传成功。

- bucket:桶

- file_path:存储路径

- 文件访问地址就是bucket+file_path

- url:最终访问的文件地址,bucket+file_path不就是访问地址吗,为什么还要设计一个url呢???

- 如果是图片的话file_path和url是相等的,但是如果是视频的话比如在file_path存的是一个avi的视频地址,但是avi的视频是不能播放的,需要把avi视频转码为MP4视频,而这个url存的就是MP4的视频地址。

4.2 准备环境

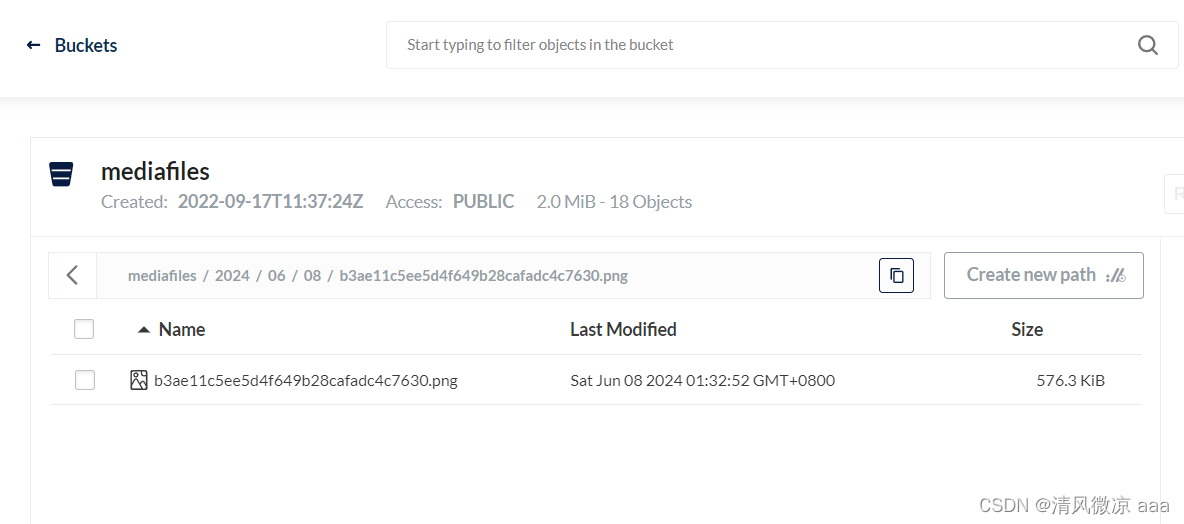

首先在minio配置bucket,bucket名称为:mediafiles,并设置bucket的权限为公开。

- mediafiles:这个桶存放非视频文件

- video:存放视频文件的桶

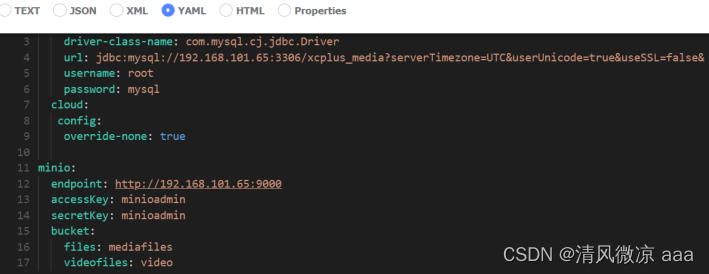

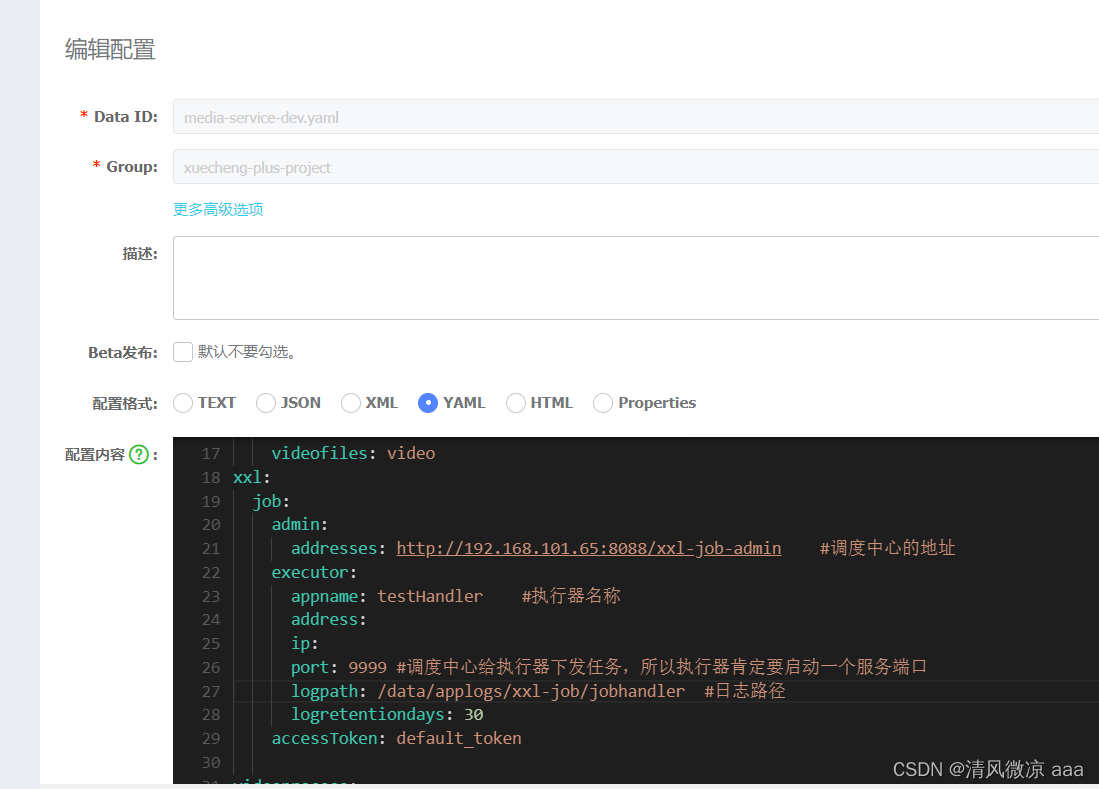

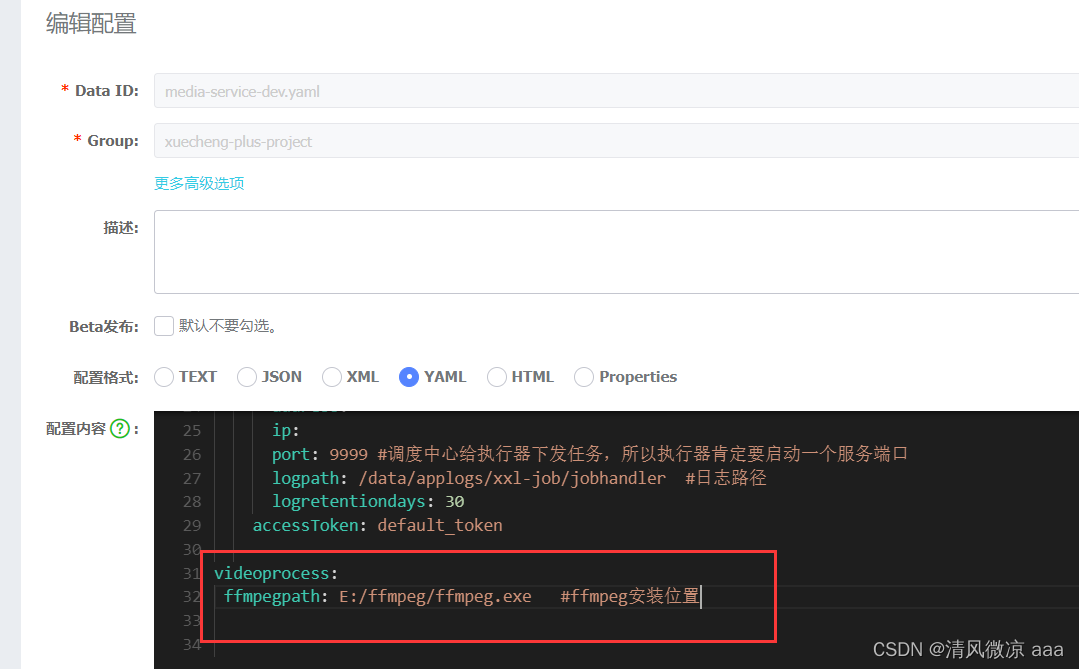

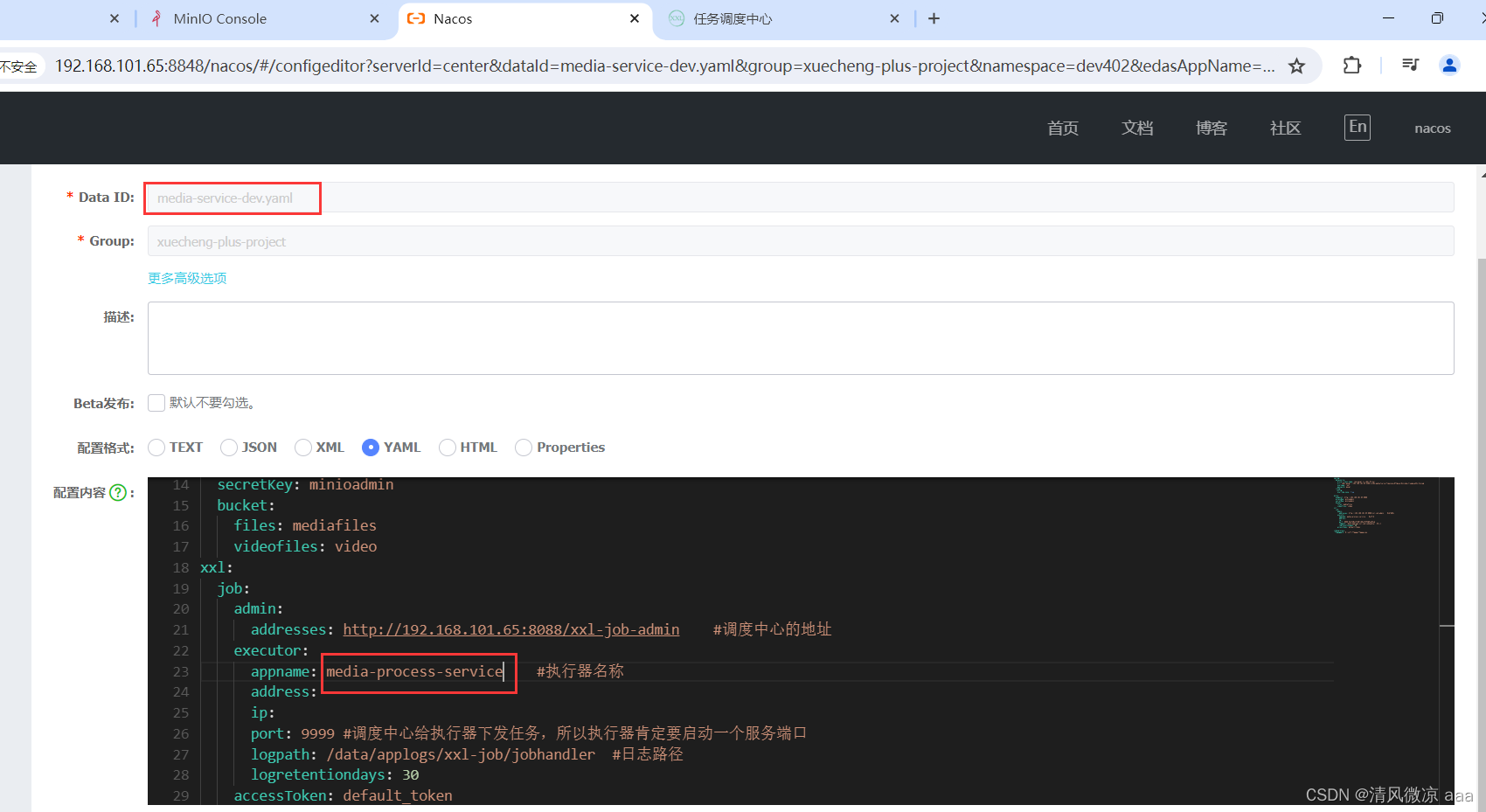

在nacos配置中minio的相关信息,进入media-service-dev.yaml:

- 之前测试代码是写死的,正式工程连接信息是放在配置文件中的。

配置信息如下:

minio:

endpoint: http://192.168.101.65:9000 #minio地址

accessKey: minioadmin #账号

secretKey: minioadmin #密码

bucket:

files: mediafiles #桶

videofiles: video #桶

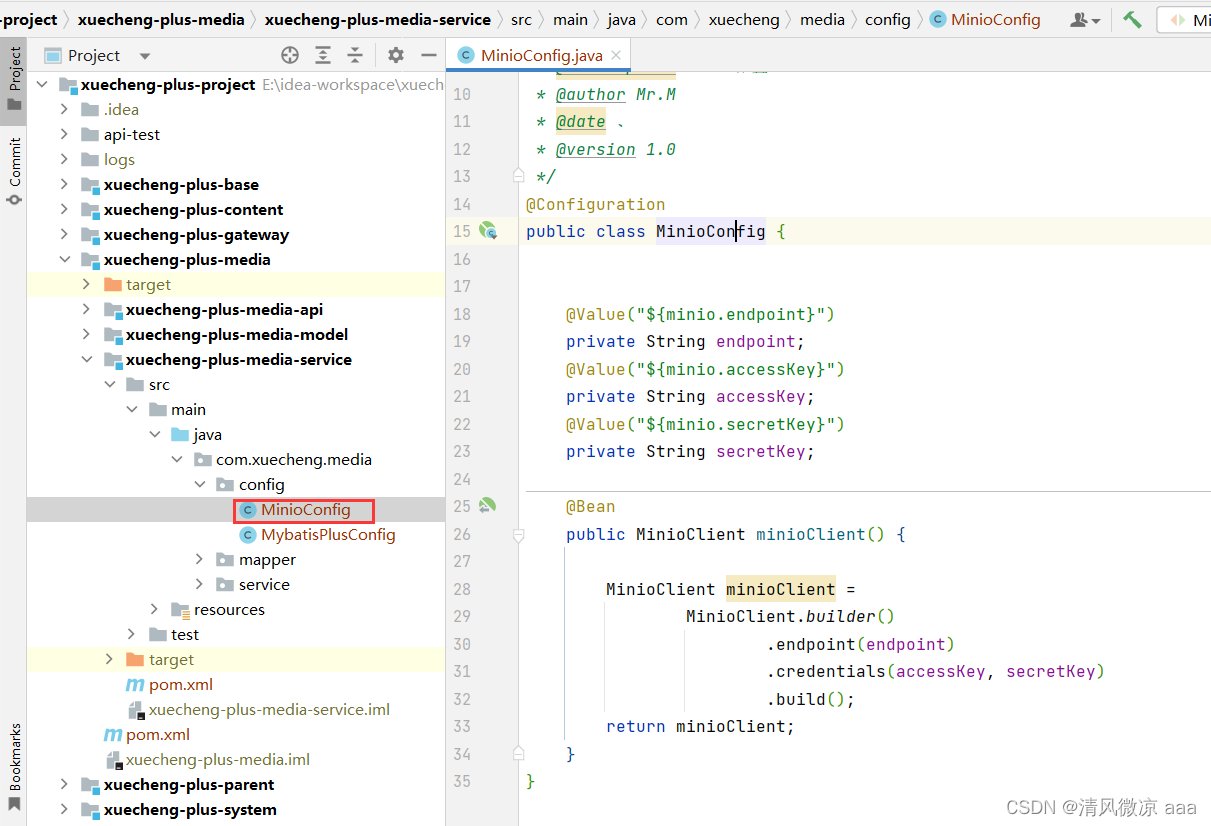

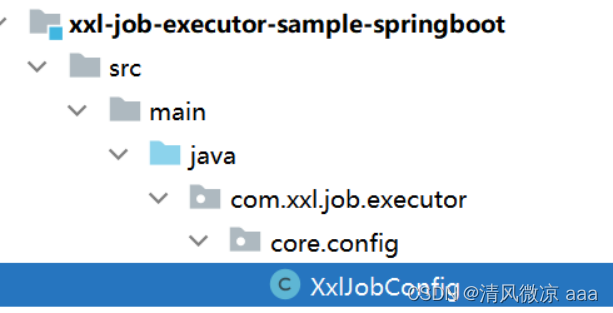

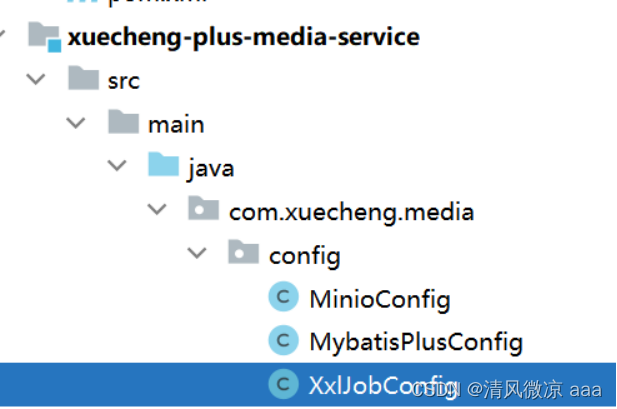

在media-service工程编写minio的配置类:

package com.xuecheng.media.config;

import io.minio.MinioClient;

import org.springframework.beans.factory.annotation.Value;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

/**

* @description minio配置

* @author Mr.M

* @date 2022/9/12 19:32

* @version 1.0

*/

@Configuration

public class MinioConfig {

@Value("${minio.endpoint}")

private String endpoint;

@Value("${minio.accessKey}")

private String accessKey;

@Value("${minio.secretKey}")

private String secretKey;

@Bean

public MinioClient minioClient() {

MinioClient minioClient =

MinioClient.builder()

.endpoint(endpoint)

.credentials(accessKey, secretKey)

.build();

return minioClient;

}

}

4.3 接口定义

根据需求分析,下边进行接口定义,此接口定义为一个通用的上传文件接口,可以上传图片或其它文件。

首先分析接口:

-

请求地址:/media/upload/coursefile

-

请求内容:Content-Type: multipart/form-data;

-

form-data; name=“filedata”; filename=“具体的文件名称”

-

响应参数:文件信息,如下

{

"id": "a16da7a132559daf9e1193166b3e7f52",

"companyId": 1232141425,

"companyName": null,

"filename": "1.jpg",

"fileType": "001001",

"tags": "",

"bucket": "/testbucket/2022/09/12/a16da7a132559daf9e1193166b3e7f52.jpg",

"fileId": "a16da7a132559daf9e1193166b3e7f52",

"url": "/testbucket/2022/09/12/a16da7a132559daf9e1193166b3e7f52.jpg",

"timelength": null,

"username": null,

"createDate": "2022-09-12T21:57:18",

"changeDate": null,

"status": "1",

"remark": "",

"auditStatus": null,

"auditMind": null,

"fileSize": 248329

}

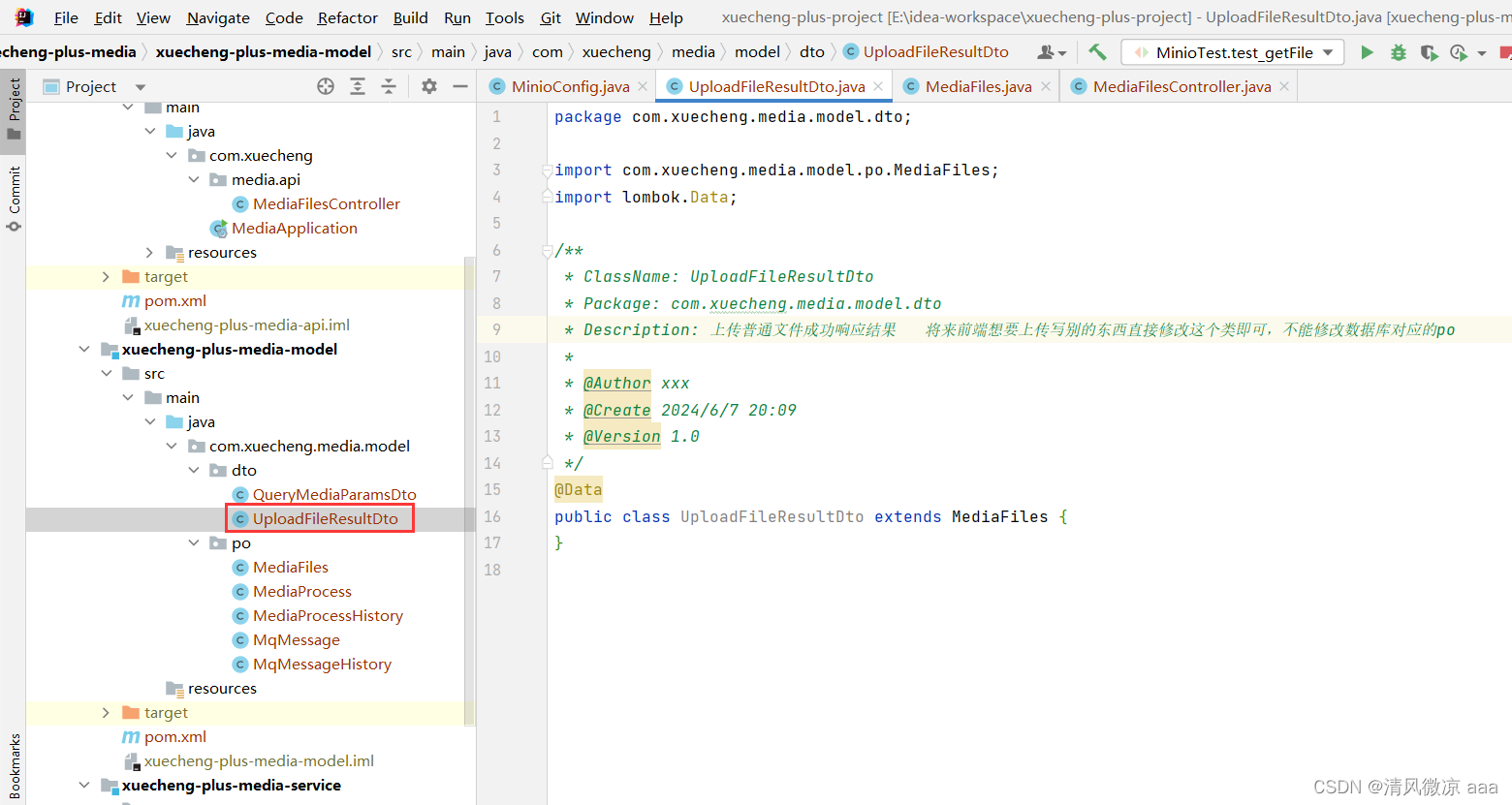

定义上传响应模型类:

package com.xuecheng.media.model.dto;

import com.xuecheng.media.model.po.MediaFiles;

import lombok.Data;

/**

* ClassName: UploadFileResultDto 类似于vo

* Package: com.xuecheng.media.model.dto

* Description: 上传普通文件成功响应结果 将来前端想要上传写别的东西直接修改这个类即可,不能修改数据库对应的po

*

* @Author xxx

* @Create 2024/6/7 20:09

* @Version 1.0

*/

@Data

public class UploadFileResultDto extends MediaFiles {

}

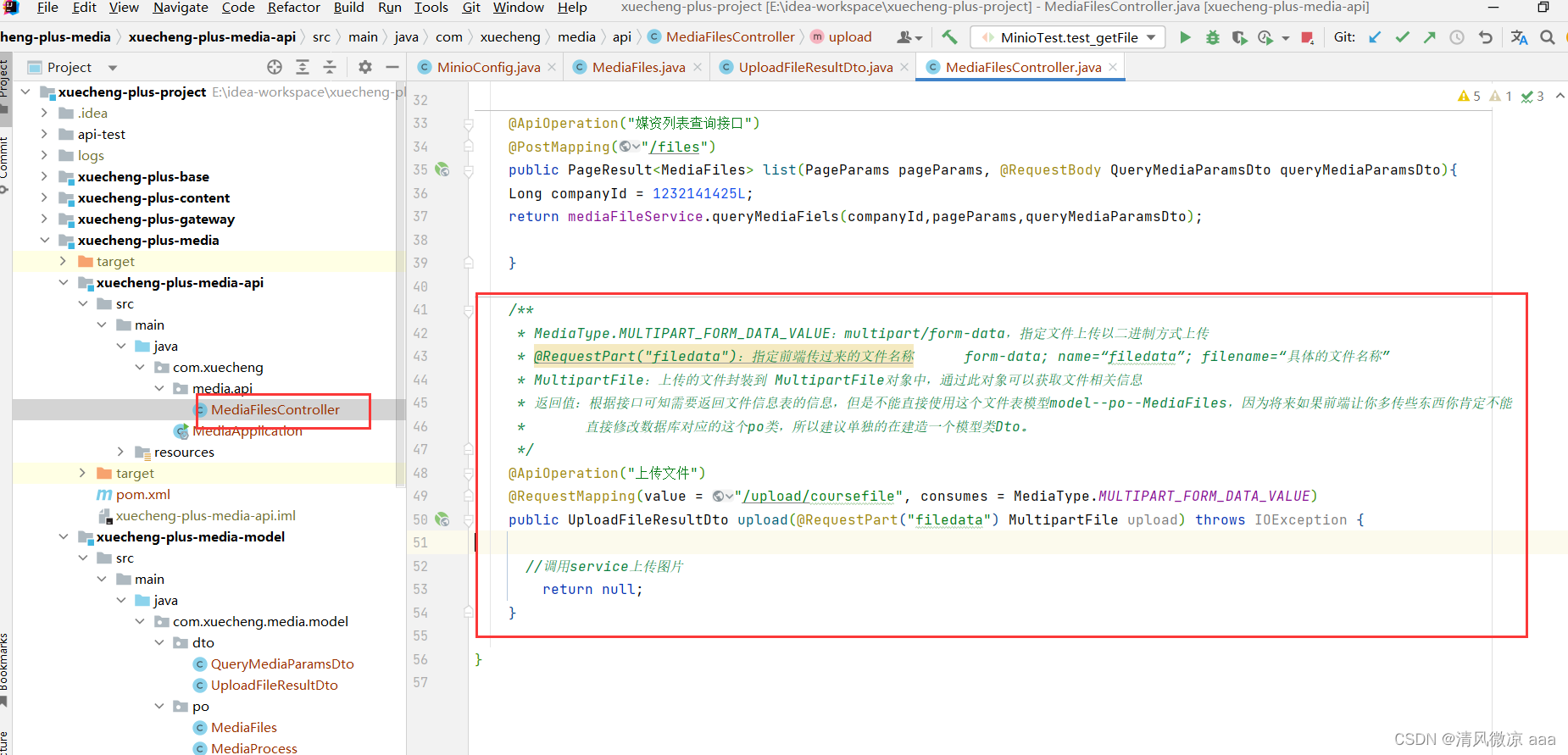

定义接口如下:

/**

* MediaType.MULTIPART_FORM_DATA_VALUE:multipart/form-data,指定文件上传以二进制方式上传

* @RequestPart("filedata"):指定前端传过来的文件名称 form-data; name=“filedata”; filename=“具体的文件名称”

* MultipartFile:上传的文件封装到 MultipartFile对象中,通过此对象可以获取文件相关信息

* 返回值:根据接口可知需要返回文件信息表的信息,但是不能直接使用这个文件表模型model--po--MediaFiles,因为将来如果前端让你多传些东西你肯定不能

* 直接修改数据库对应的这个po类,所以建议单独的在建造一个模型类Dto。

*/

@ApiOperation("上传文件")

@RequestMapping(value = "/upload/coursefile", consumes = MediaType.MULTIPART_FORM_DATA_VALUE)

public UploadFileResultDto upload(@RequestPart("filedata") MultipartFile filedata) throws IOException {

//调用service上传图片

return null;

}

接口定义好后可以用httpclient工具测试一下

使用httpclient测试

### 上传文件

POST {{media_host}}/media/upload/coursefile

Content-Type: multipart/form-data; boundary=WebAppBoundary

--WebAppBoundary

Content-Disposition: form-data; name="filedata"; filename="1.jpg"

Content-Type: application/octet-stream

< d:/develop/upload/1.jpg

4.4 接口开发

4.4.1 DAO开发

根据需求分析DAO层实现向media_files表插入一条记录,使用media_files表生成的mapper即可。

4.4.2 Service开发

Service方法需要提供一个更加通用的保存文件的方法。

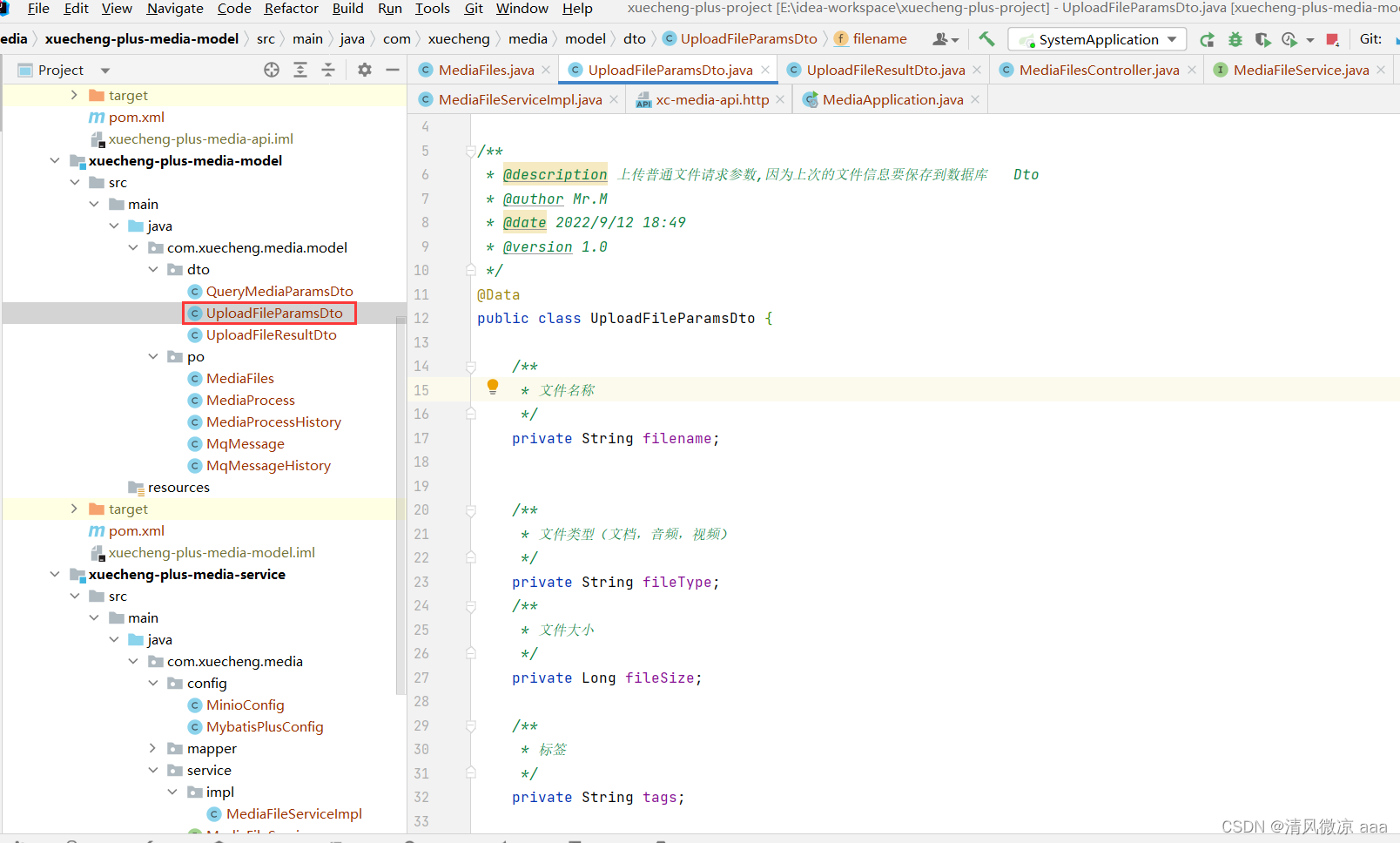

定义请求参数类:

package com.xuecheng.media.model.dto;

import lombok.Data;

/**

* @description 上传普通文件请求参数,因为上次的文件信息要保存到数据库 Dto

* @author Mr.M

* @date 2022/9/12 18:49

* @version 1.0

*/

@Data

public class UploadFileParamsDto {

/**

* 文件名称

*/

private String filename;

/**

* 文件类型(文档,音频,视频)

*/

private String fileType;

/**

* 文件大小

*/

private Long fileSize;

/**

* 标签

*/

private String tags;

/**

* 上传人

*/

private String username;

/**

* 备注

*/

private String remark;

}

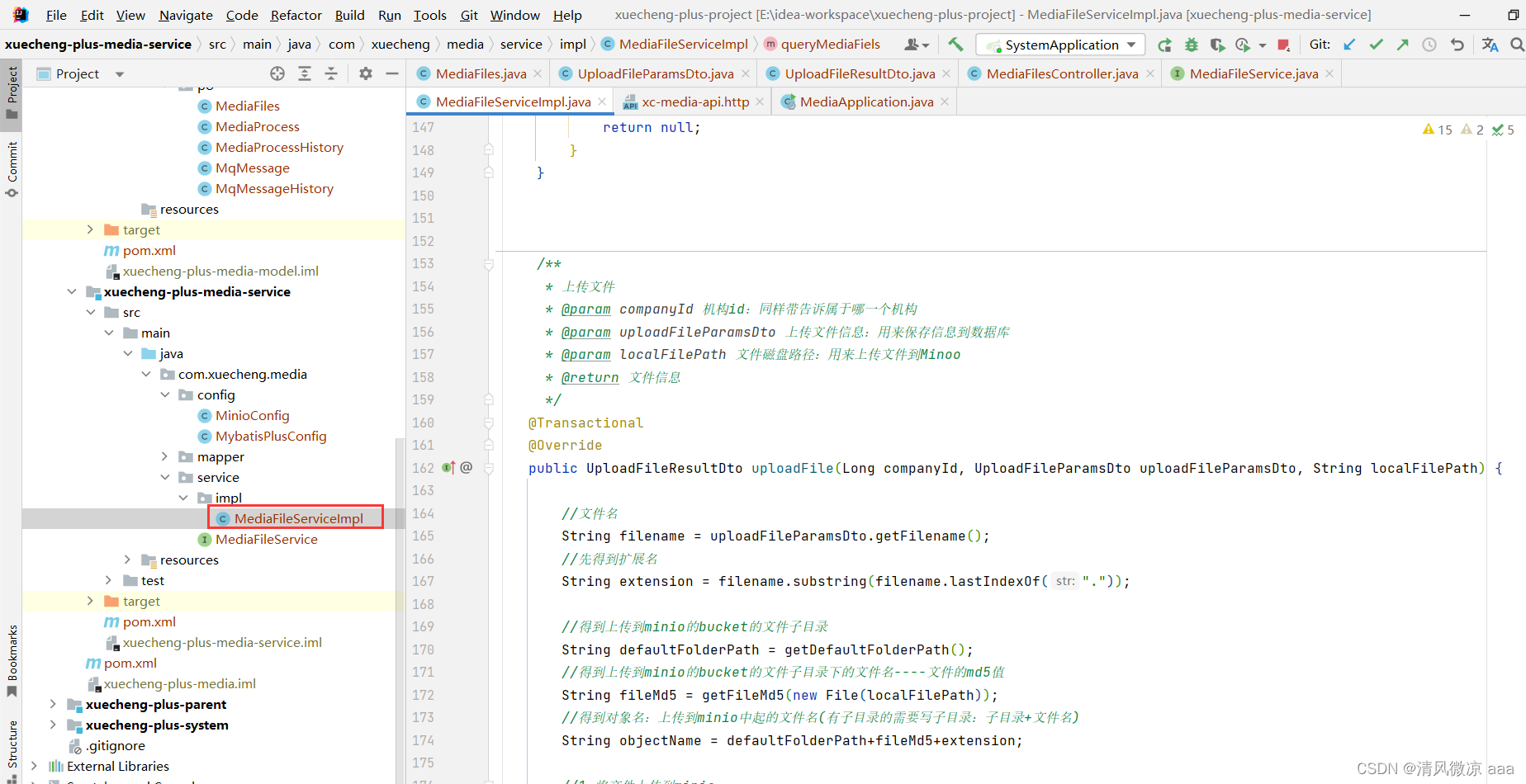

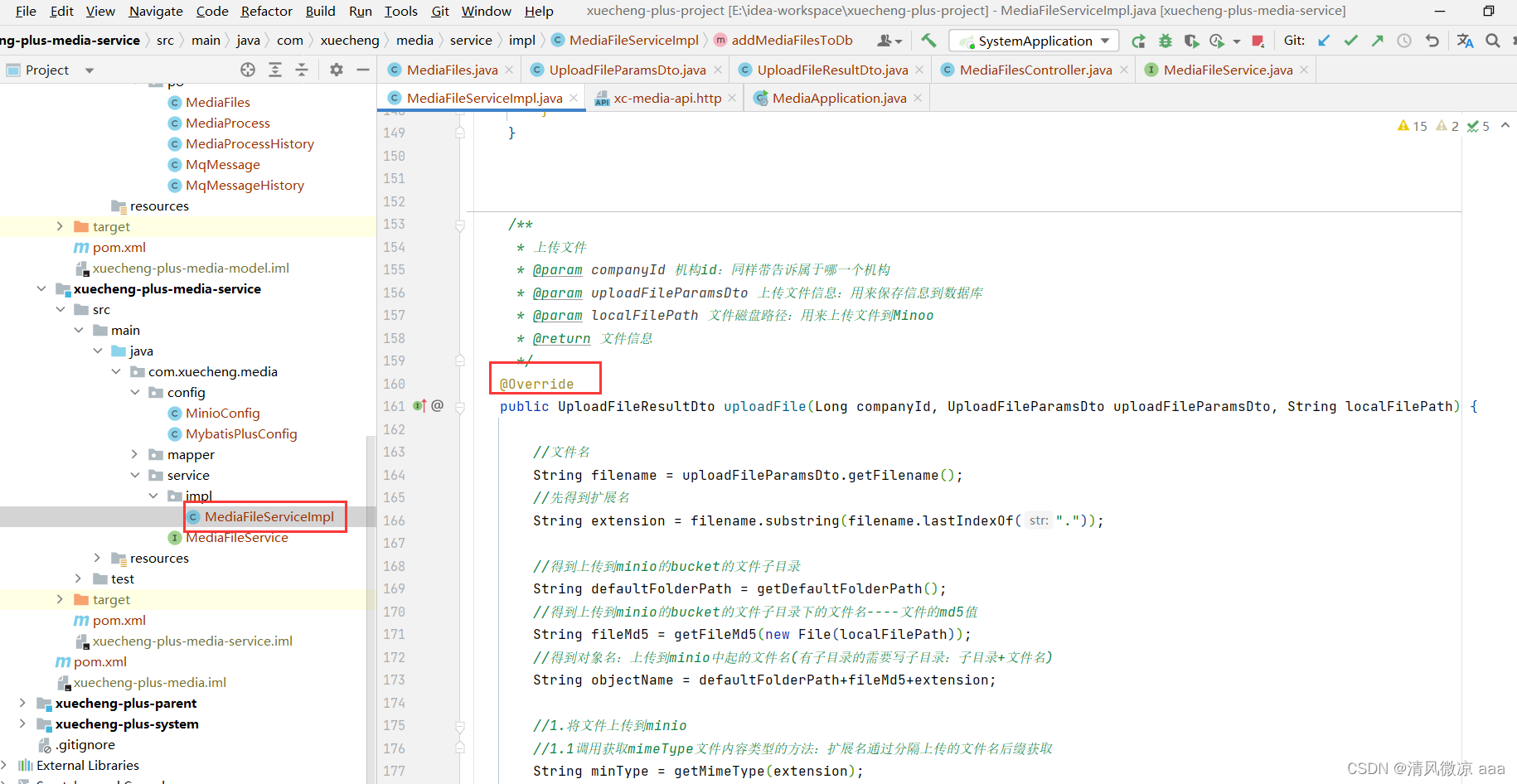

定义service方法:

/**

* 上传文件

* @param companyId 机构id:同样带告诉属于哪一个机构

* @param uploadFileParamsDto 上传文件信息:用来保存信息到数据库

* @param localFilePath 文件磁盘路径:用来上传文件到Minoo

* @return 文件信息

*/

public UploadFileResultDto uploadFile(Long companyId, UploadFileParamsDto uploadFileParamsDto, String localFilePath);

实现方法如下:

@Autowired

MediaFilesMapper mediaFilesMapper;

@Autowired

MinioClient minioClient;

//存储普通文件:获取nacos中配置的桶

@Value("${minio.bucket.files}")

private String bucket_mediafiles;

//存储视频

@Value("${minio.bucket.videofiles}")

private String bucket_video;

/**

* 抽取1:根据扩展名来获取mimeType文件内容类型

* @param extension:扩展名

* @return

*/

private String getMimeType(String extension){

if(extension==null){//如果扩展名为空下面这个findExtensionMatch()方法会报空指针异常,所以为空时设置一个空字符串。

extension="";

}

//根据扩展名取出mimeType

ContentInfo extensionMatch = ContentInfoUtil.findExtensionMatch(extension);

String mimeType = MediaType.APPLICATION_OCTET_STREAM_VALUE;//通用mimeType,字节流

if(extensionMatch != null){

mimeType = extensionMatch.getMimeType();

}

return mimeType;

}

/**

* 抽取2:构建上传文件到minio中:只要是上传都调用这个方法

* @param localFilePath 文件本地路径

* @param mimeType 媒体类型

* @param bucket 桶

* @param objectName 对象名:上传到minio中起的文件名(有子目录的需要写子目录)

* @return

*/

public boolean addMediaFilesToMinIO(String localFilePath,String mimeType,String bucket,String objectName) {

try {

UploadObjectArgs uploadObjectArgs = UploadObjectArgs.builder()

.bucket(bucket) //桶

.filename(localFilePath) //指定本地文件路径

.object(objectName) //对象名 放在子目录下

.contentType(mimeType) //设置媒体文件类型

.build();//对象名

//上传文件

minioClient.uploadObject(uploadObjectArgs);

log.debug("上传文件到minio成功,bucket:{},objectName;{},错误信息:{}",bucket,objectName);

return true;

} catch (Exception e) {

e.printStackTrace();

log.error("上传文件出错,bucket:{},objectName:{},错误信息:{}",bucket,objectName,e.getMessage());

return false;

}

}

/**

* 抽取3:获取文件默认存储目录路径 年/月/日

* 即:对象名/上传到minio中的文件名是放在子目录中,没有直接放在bucket的根目录下。

* @return

*/

private String getDefaultFolderPath() {

SimpleDateFormat sdf = new SimpleDateFormat("yyyy-MM-dd");

//2022-02-17---->2022/01/17/

String folder = sdf.format(new Date()).replace("-", "/")+"/";

return folder;

}

//抽取4:获取文件的md5

private String getFileMd5(File file) {

try (FileInputStream fileInputStream = new FileInputStream(file)) {

String fileMd5 = DigestUtils.md5Hex(fileInputStream);

return fileMd5;

} catch (Exception e) {

e.printStackTrace();

return null;

}

}

/**

* 上传文件

* @param companyId 机构id:同样带告诉属于哪一个机构

* @param uploadFileParamsDto 上传文件信息:用来保存信息到数据库

* @param localFilePath 文件磁盘路径:用来上传文件到Minoo

* @return 文件信息

*/

@Transactional

@Override

public UploadFileResultDto uploadFile(Long companyId, UploadFileParamsDto uploadFileParamsDto, String localFilePath) {

//文件名

String filename = uploadFileParamsDto.getFilename();

//先得到扩展名

String extension = filename.substring(filename.lastIndexOf("."));

//得到上传到minio的bucket的文件子目录

String defaultFolderPath = getDefaultFolderPath();

//得到上传到minio的bucket的文件子目录下的文件名----文件的md5值

String fileMd5 = getFileMd5(new File(localFilePath));

//得到对象名:上传到minio中起的文件名(有子目录的需要写子目录:子目录+文件名)

String objectName = defaultFolderPath+fileMd5+extension;

//1.将文件上传到minio

//1.1调用获取mimeType文件内容类型的方法:扩展名通过分隔上传的文件名后缀获取

String minType = getMimeType(extension);

//1.2调用文件上传到minio的方法:本地文件路径、媒体类型、桶、对象名:上传到minio中起的文件名(有子目录的需要写子目录)

boolean result = addMediaFilesToMinIO(localFilePath,minType,bucket_mediafiles,objectName);

if(!result) {

XueChengPlusException.cast("上传文件失败");

}

//2.将文件信息写入media_file表中:机构id 文件md5值 上传文件的信息 桶 对象名称

MediaFiles mediaFiles = addMediaFilesToDb(companyId, fileMd5, uploadFileParamsDto, bucket_mediafiles, objectName);

//准备返回的对象:来前端想要上传写别的东西直接修改这个类即可,不能修改数据库对应的po

UploadFileResultDto uploadFileResultDto = new UploadFileResultDto();

BeanUtils.copyProperties(mediaFiles,uploadFileResultDto);

return uploadFileResultDto;

}

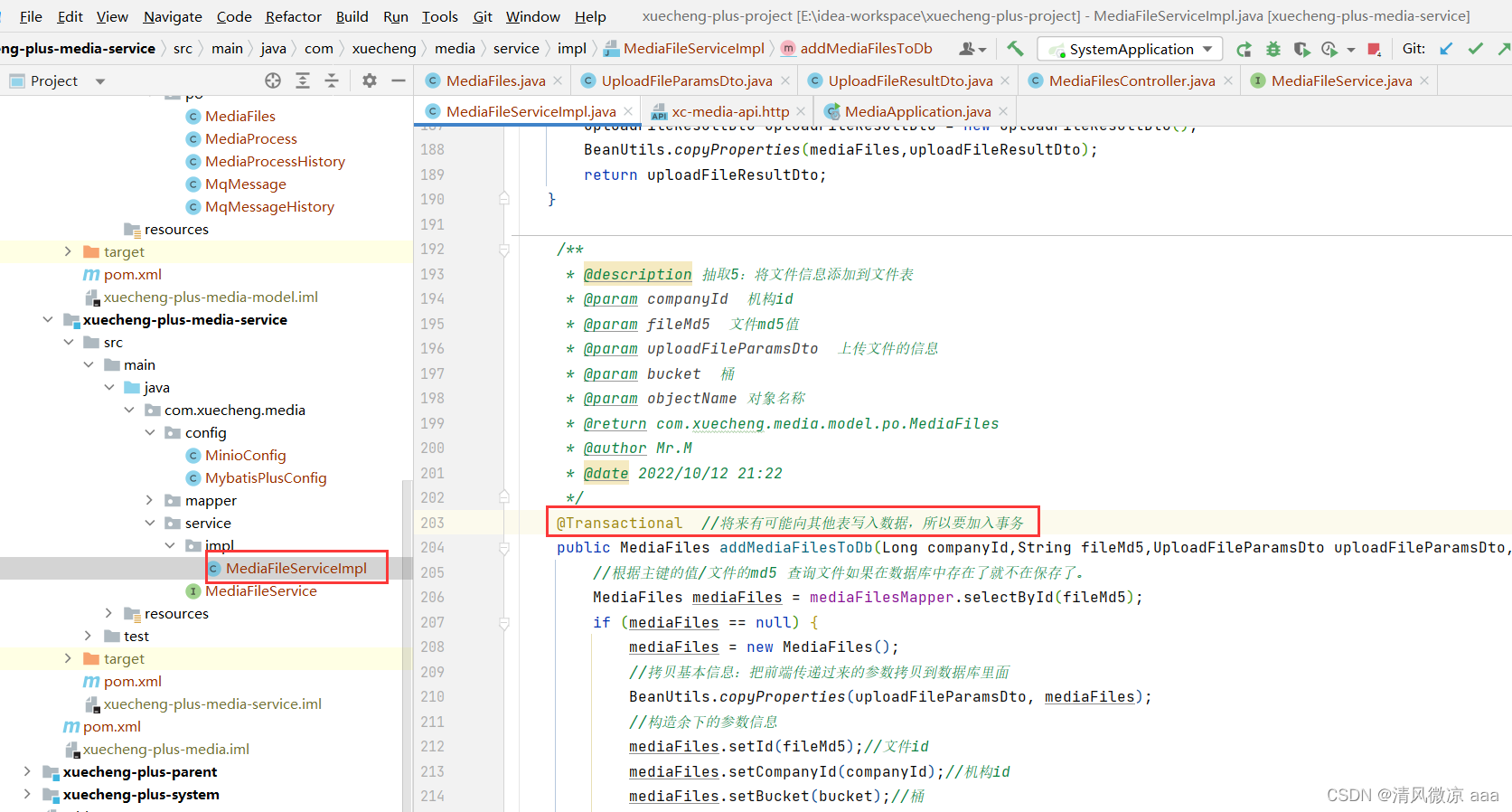

/**

* @description 抽取5:将文件信息添加到文件表

* @param companyId 机构id

* @param fileMd5 文件md5值

* @param uploadFileParamsDto 上传文件的信息

* @param bucket 桶

* @param objectName 对象名称

* @return com.xuecheng.media.model.po.MediaFiles

* @author Mr.M

* @date 2022/10/12 21:22

*/

public MediaFiles addMediaFilesToDb(Long companyId,String fileMd5,UploadFileParamsDto uploadFileParamsDto,String bucket,String objectName){

//根据主键的值/文件的md5 查询文件如果在数据库中存在了就不在保存了。

MediaFiles mediaFiles = mediaFilesMapper.selectById(fileMd5);

if (mediaFiles == null) {

mediaFiles = new MediaFiles();

//拷贝基本信息:把前端传递过来的参数拷贝到数据库里面

BeanUtils.copyProperties(uploadFileParamsDto, mediaFiles);

//构造余下的参数信息

mediaFiles.setId(fileMd5);//文件id

mediaFiles.setCompanyId(companyId);//机构id

mediaFiles.setBucket(bucket);//桶

mediaFiles.setFilePath(objectName);//file_path 对象名

mediaFiles.setFileId(fileMd5);//file_id 文件id

mediaFiles.setUrl("/"+bucket+"/"+objectName);//url:文件上传地址

mediaFiles.setCreateDate(LocalDateTime.now());//上传时间

mediaFiles.setStatus("1");//状态 1:正常,0:不展示

mediaFiles.setAuditStatus("002003");//审核状态:202001审核未通过、202002未提交、202003已提交、202004审核通过

//保存文件信息到文件表

int insert = mediaFilesMapper.insert(mediaFiles);

if (insert < 0) {

log.debug("向数据库保存文件失败,bucket:{},objectName",bucket,objectName);

XueChengPlusException.cast("保存文件信息失败");

}

log.debug("保存文件信息到数据库成功,{}",mediaFiles.toString());

}

return mediaFiles;

}

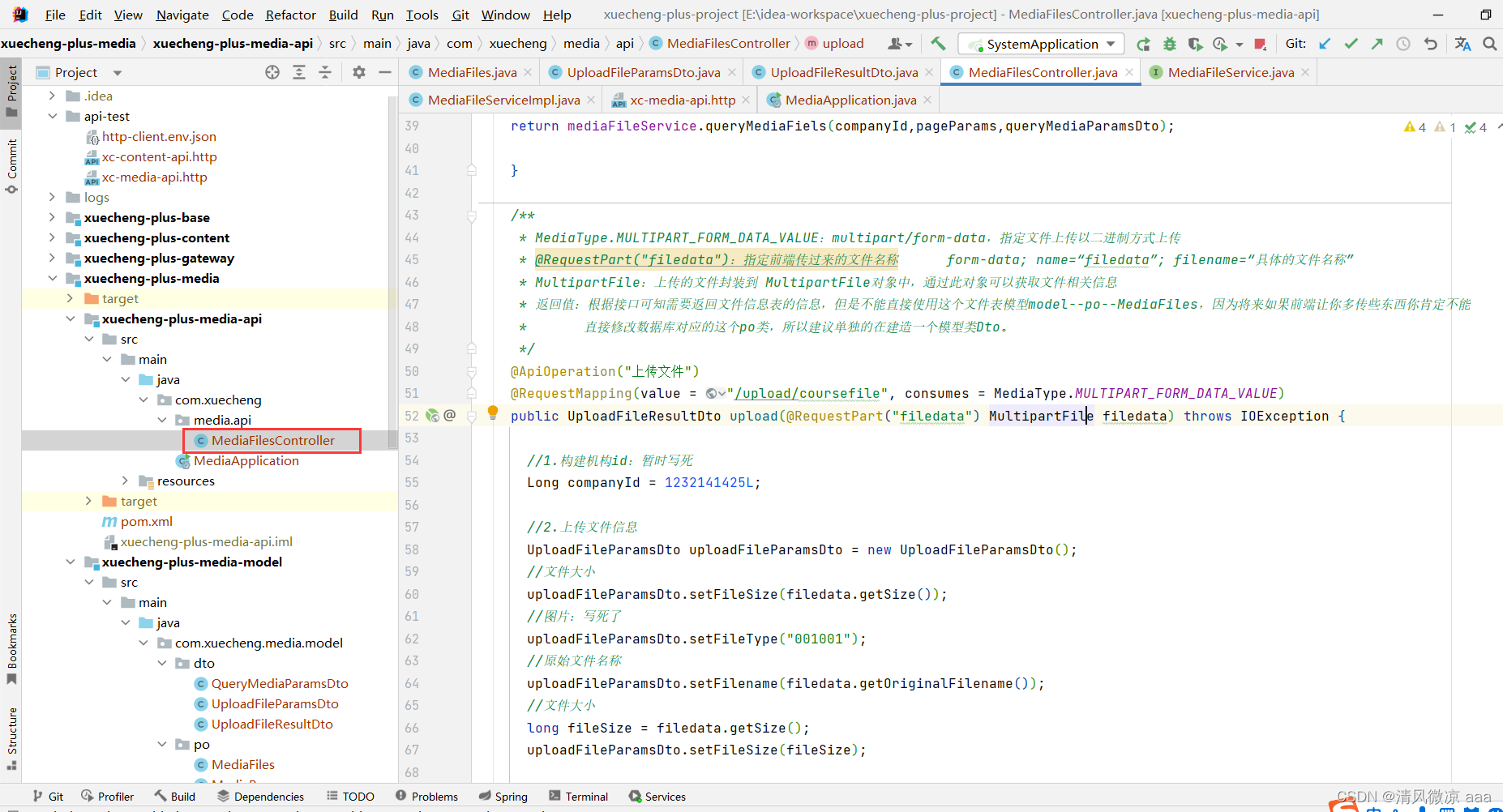

4.4.3 完善接口层

完善接口层代码 :

/**

* MediaType.MULTIPART_FORM_DATA_VALUE:multipart/form-data,指定文件上传以二进制方式上传

* @RequestPart("filedata"):指定前端传过来的文件名称 form-data; name=“filedata”; filename=“具体的文件名称”

* MultipartFile:上传的文件封装到 MultipartFile对象中,通过此对象可以获取文件相关信息

* 返回值:根据接口可知需要返回文件信息表的信息,但是不能直接使用这个文件表模型model--po--MediaFiles,因为将来如果前端让你多传些东西你肯定不能

* 直接修改数据库对应的这个po类,所以建议单独的在建造一个模型类Dto。

*/

@ApiOperation("上传文件")

@RequestMapping(value = "/upload/coursefile", consumes = MediaType.MULTIPART_FORM_DATA_VALUE)

public UploadFileResultDto upload(@RequestPart("filedata") MultipartFile filedata) throws IOException {

//1.构建机构id:暂时写死

Long companyId = 1232141425L;

//2.上传文件信息

UploadFileParamsDto uploadFileParamsDto = new UploadFileParamsDto();

//文件大小

uploadFileParamsDto.setFileSize(filedata.getSize());

//图片:写死了

uploadFileParamsDto.setFileType("001001");

//原始文件名称

uploadFileParamsDto.setFilename(filedata.getOriginalFilename());

//文件大小

long fileSize = filedata.getSize();

uploadFileParamsDto.setFileSize(fileSize);

//3.文件磁盘路径

//创建临时文件:前缀 后缀 随便写

File tempFile = File.createTempFile("minio", "temp");

//上传的文件拷贝到临时文件

filedata.transferTo(tempFile);

//文件路径

String absolutePath = tempFile.getAbsolutePath();

//4.调用service上传文件:机构id 上传文件信息 文件磁盘路径

UploadFileResultDto uploadFileResultDto = mediaFileService.uploadFile(companyId, uploadFileParamsDto, absolutePath);

return uploadFileResultDto;

}

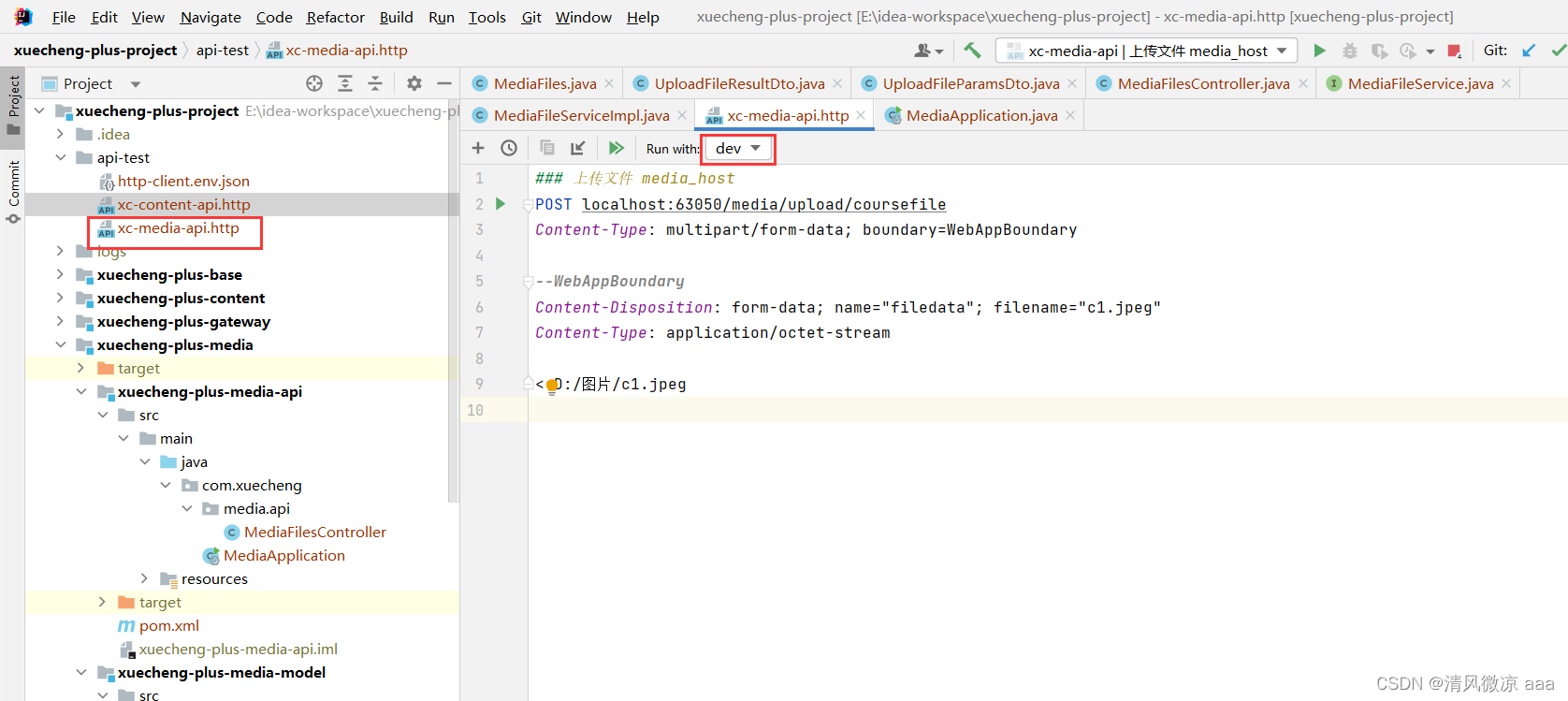

4.4.4 接口测试

1、首先使用httpclient测试

### 上传文件 media_host

POST localhost:63050/media/upload/coursefile

Content-Type: multipart/form-data; boundary=WebAppBoundary

--WebAppBoundary

Content-Disposition: form-data; name="filedata"; filename="c1.jpeg"

Content-Type: application/octet-stream

< D:/图片/c1.jpeg

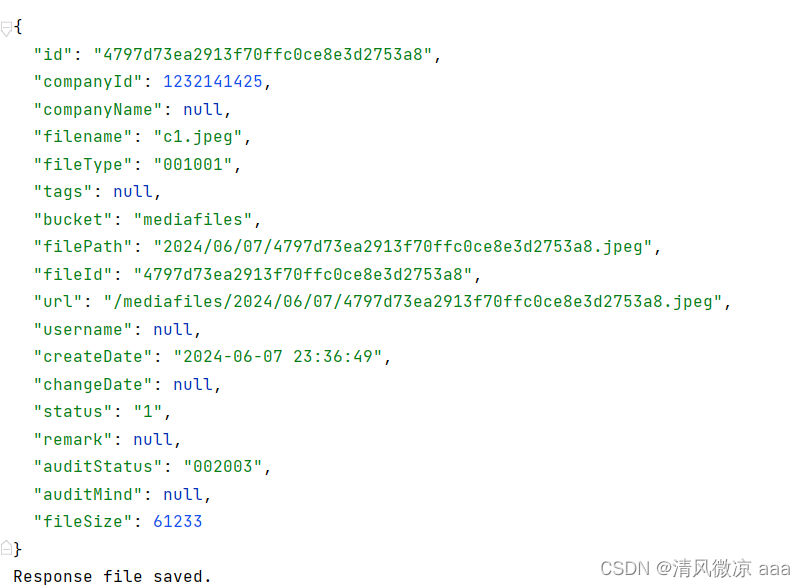

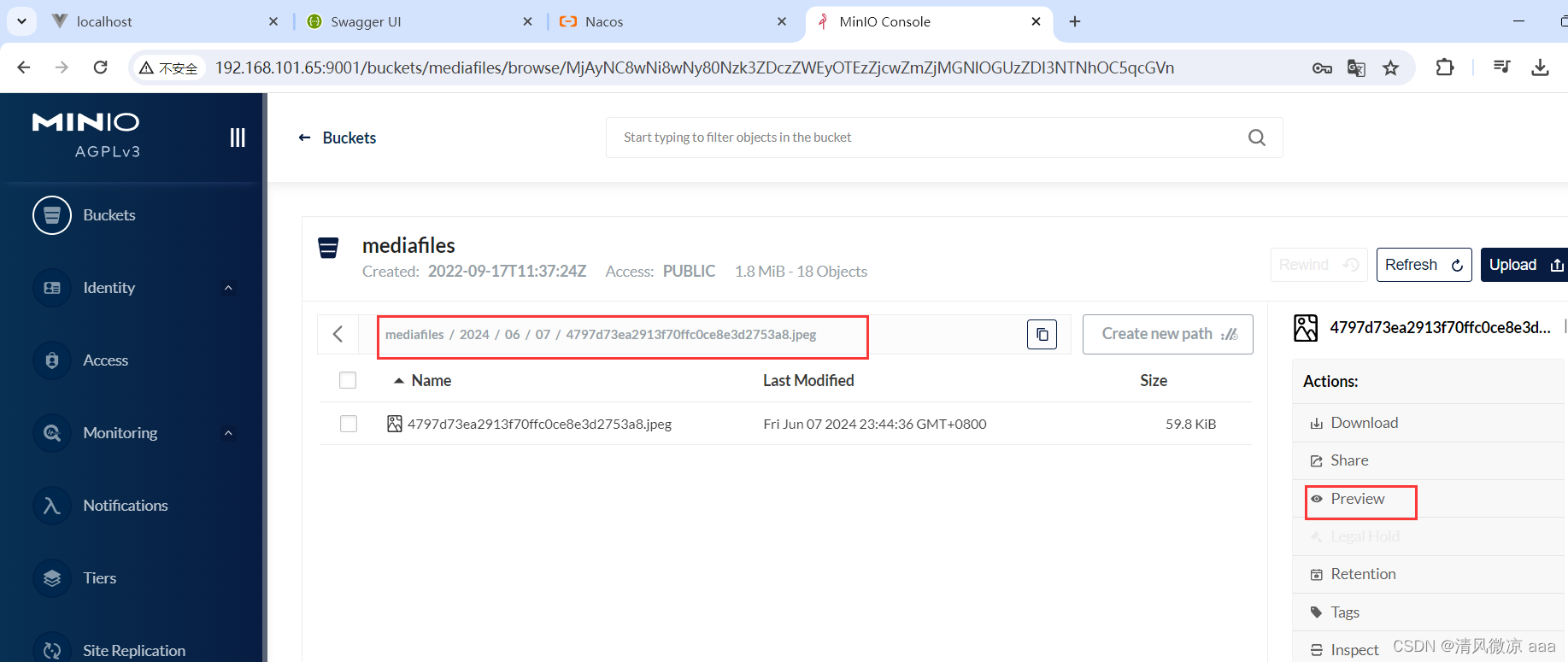

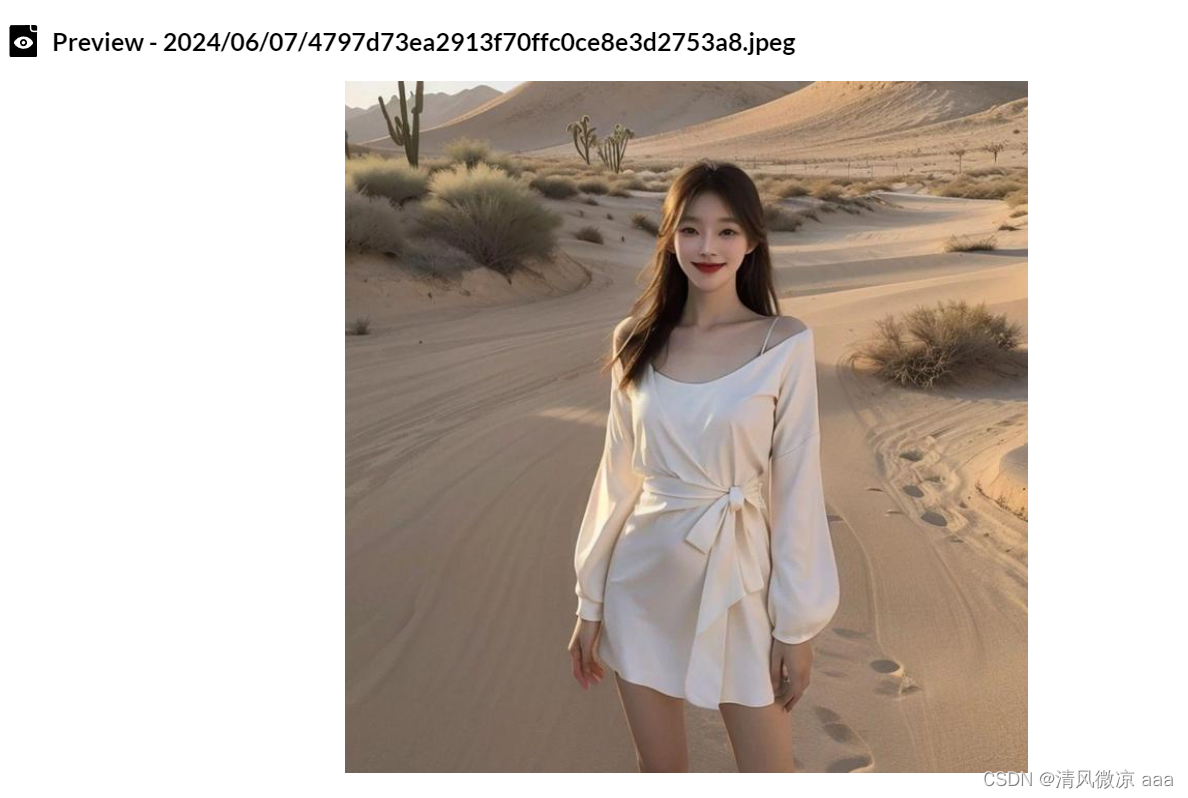

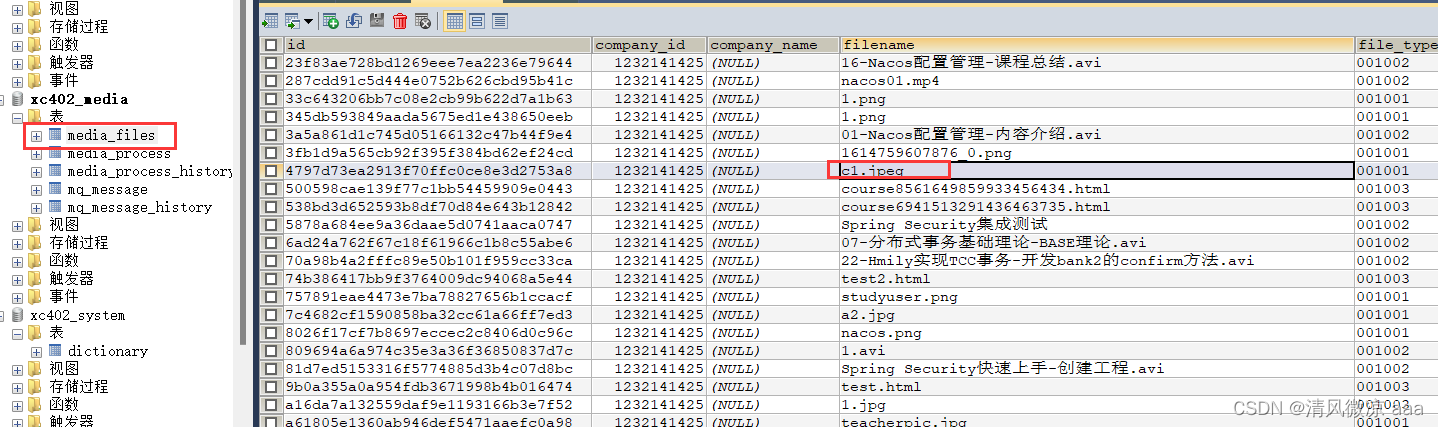

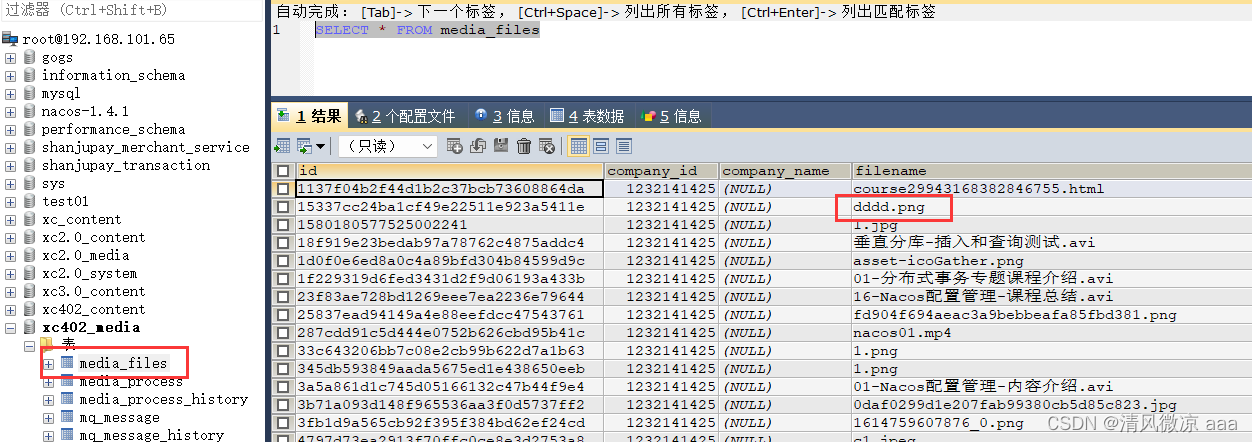

文件上传到minio成功:

文件信息成功保存到数据库

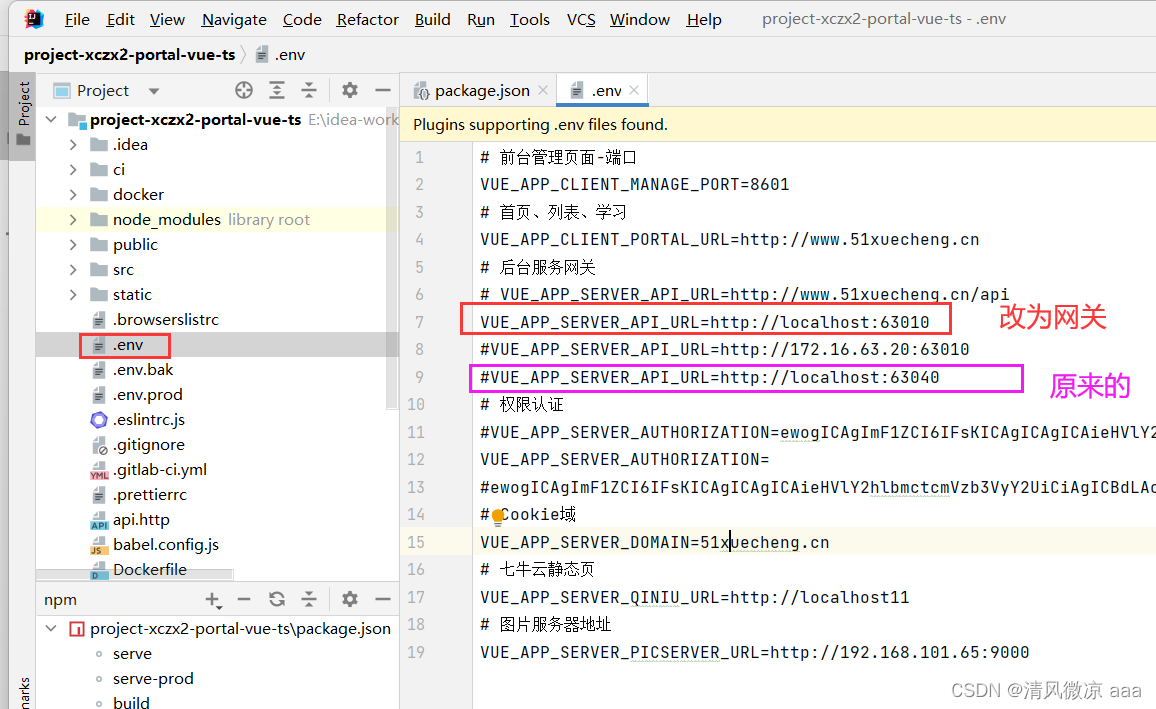

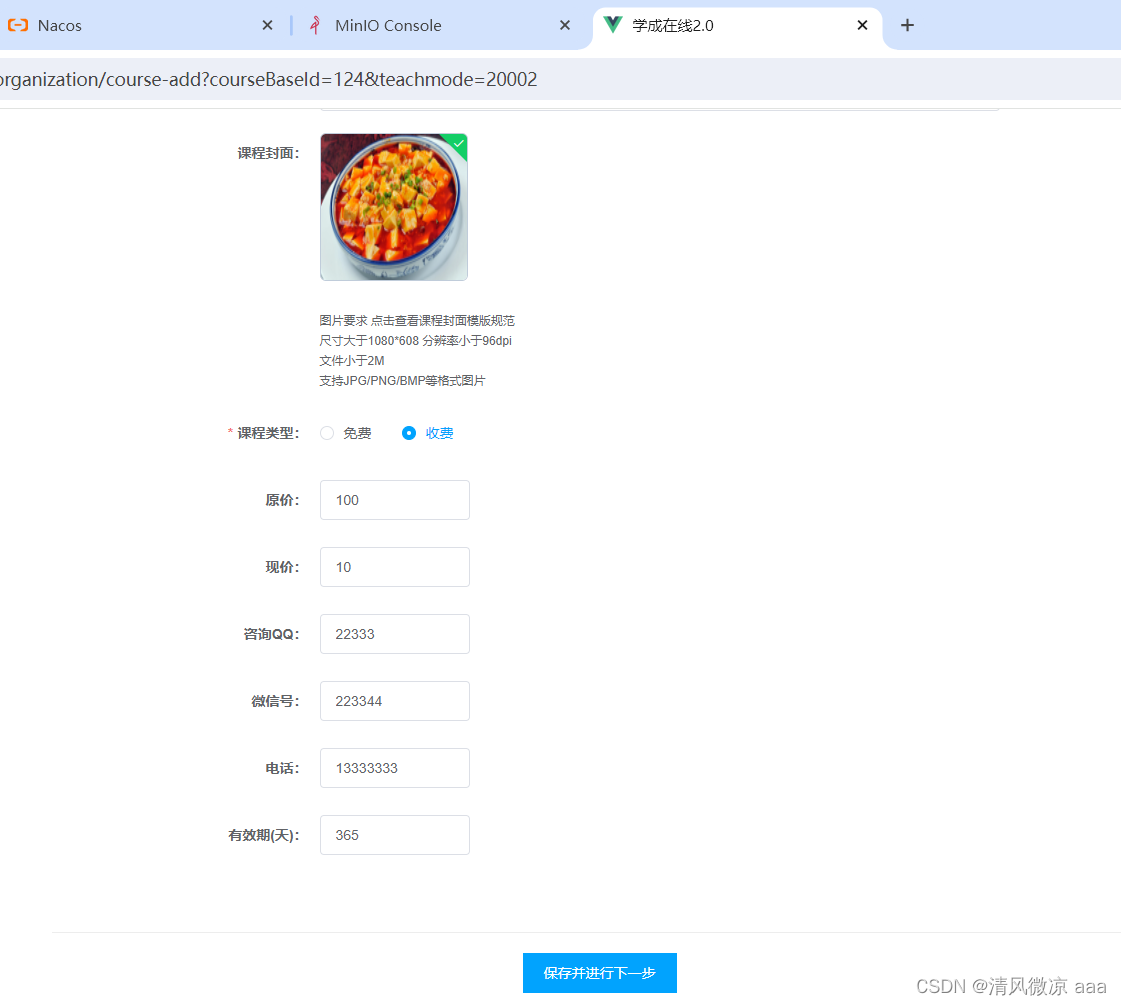

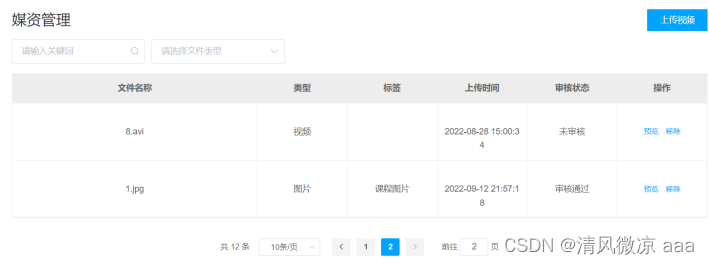

2、再进行前后端联调测试

网关工程搭建完成即可将前端工程中的接口地址改为网关的地址

启动:前端,后端(网关,内容管理,系统服务,媒资)

在新增课程、编辑课程界面上传图,保存课程信息后再次进入编辑课程界面,查看是否可以正常保存课程图片信息。

前端页面访问空白的:如果system启动的端口号是8080而不是63110.

把system模块下的target目录删除后,重新启动项目生成即可。

上图图片完成后,进入媒资管理,查看文件列表中是否有刚刚上传的图片信息。

查看minio、查看数据库

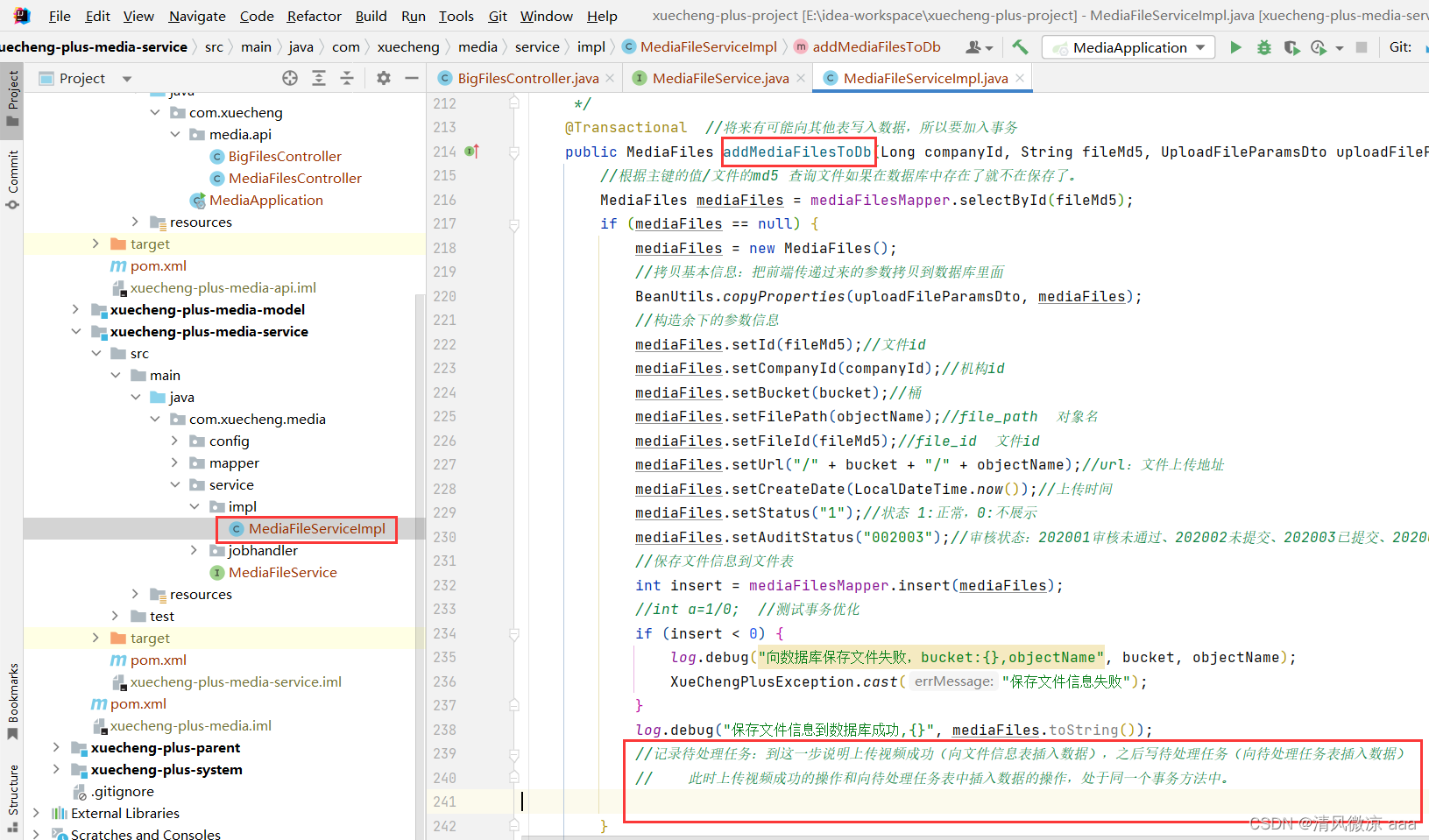

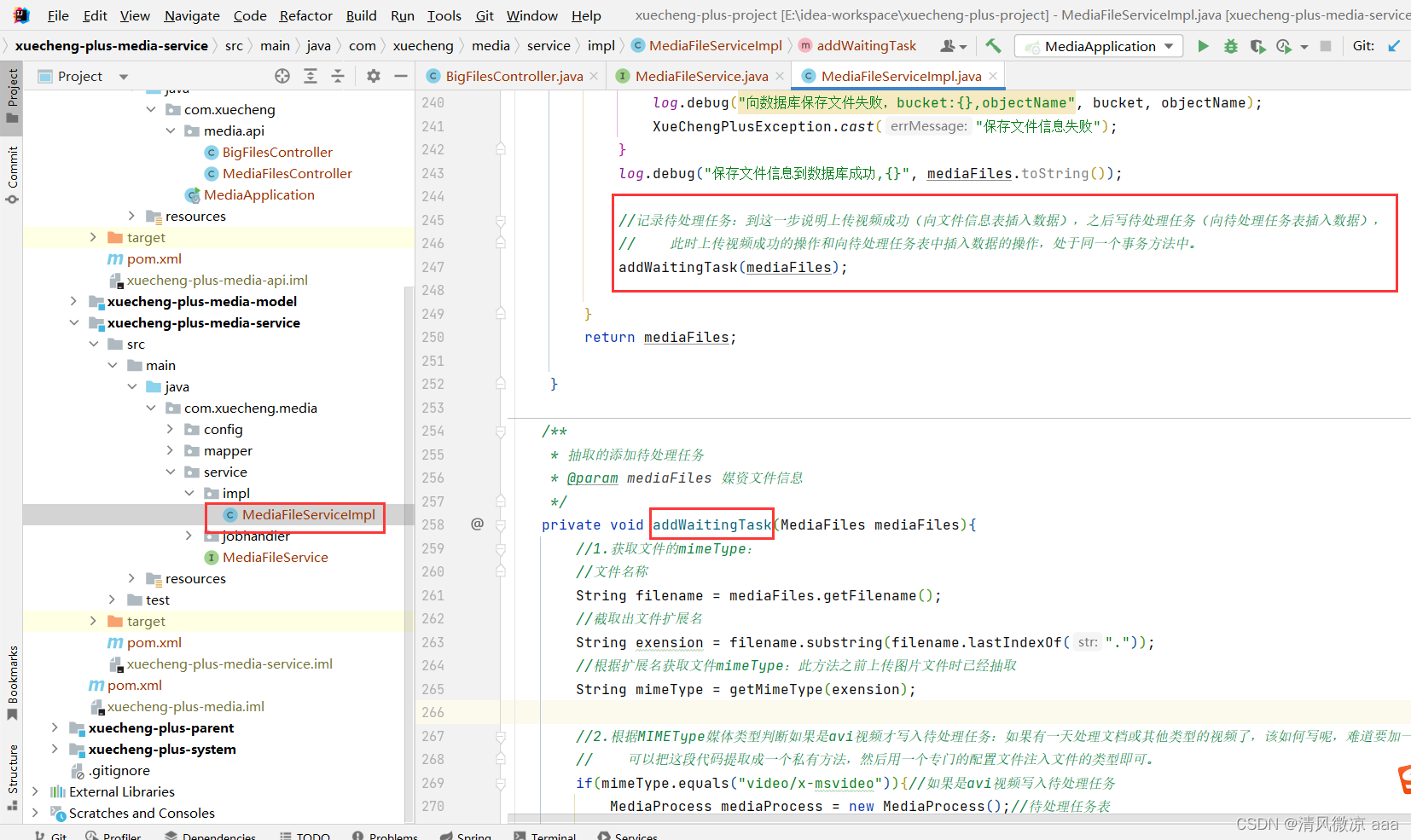

4.4.5 Service事务优化

上边的service方法优化后并测试通过,现在思考关于uploadFile方法的是否应该开启事务。

目前是在uploadFile方法上添加@Transactional,当调用uploadFile方法前会开启数据库事务,如果上传文件过程时间较长那么数据库的事务持续时间就会变长,这样数据库链接释放就慢,最终导致数据库链接不够用。

我们只将addMediaFilesToDb方法添加事务控制即可,uploadFile方法上的@Transactional注解去掉。

优化后如下:

/**

* @description 抽取5:将文件信息添加到文件表

* @param companyId 机构id

* @param fileMd5 文件md5值

* @param uploadFileParamsDto 上传文件的信息

* @param bucket 桶

* @param objectName 对象名称

* @return com.xuecheng.media.model.po.MediaFiles

* @author Mr.M

* @date 2022/10/12 21:22

*/

@Transactional //将来有可能向其他表写入数据,所以要加入事务

public MediaFiles addMediaFilesToDb(Long companyId,String fileMd5,UploadFileParamsDto uploadFileParamsDto,String bucket,String objectName){

//根据主键的值/文件的md5 查询文件如果在数据库中存在了就不在保存了。

MediaFiles mediaFiles = mediaFilesMapper.selectById(fileMd5);

if (mediaFiles == null) {

mediaFiles = new MediaFiles();

//拷贝基本信息:把前端传递过来的参数拷贝到数据库里面

BeanUtils.copyProperties(uploadFileParamsDto, mediaFiles);

//构造余下的参数信息

mediaFiles.setId(fileMd5);//文件id

mediaFiles.setCompanyId(companyId);//机构id

mediaFiles.setBucket(bucket);//桶

mediaFiles.setFilePath(objectName);//file_path 对象名

mediaFiles.setFileId(fileMd5);//file_id 文件id

mediaFiles.setUrl("/"+bucket+"/"+objectName);//url:文件上传地址

mediaFiles.setCreateDate(LocalDateTime.now());//上传时间

mediaFiles.setStatus("1");//状态 1:正常,0:不展示

mediaFiles.setAuditStatus("002003");//审核状态:202001审核未通过、202002未提交、202003已提交、202004审核通过

//保存文件信息到文件表

int insert = mediaFilesMapper.insert(mediaFiles);

if (insert < 0) {

log.debug("向数据库保存文件失败,bucket:{},objectName",bucket,objectName);

XueChengPlusException.cast("保存文件信息失败");

}

log.debug("保存文件信息到数据库成功,{}",mediaFiles.toString());

}

return mediaFiles;

}

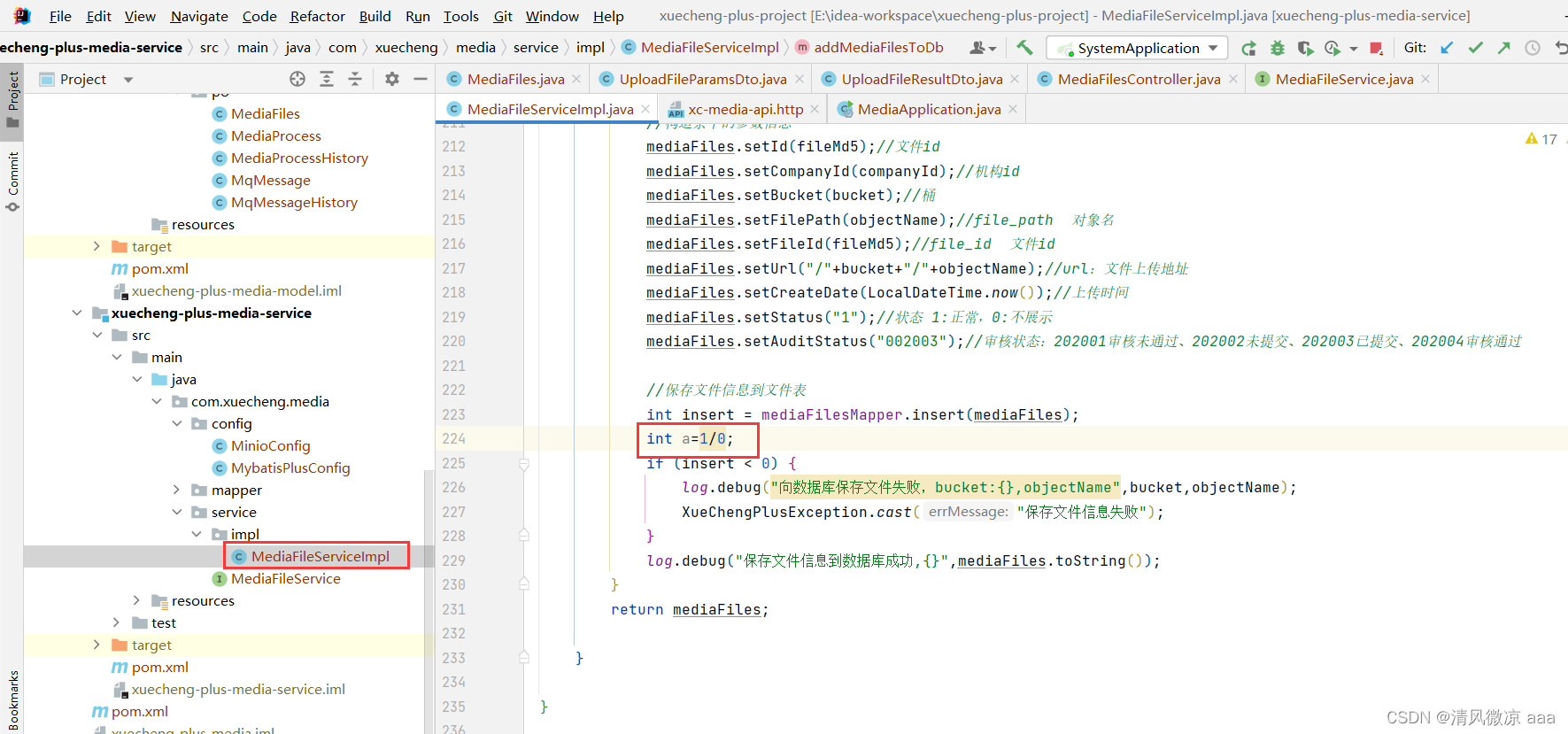

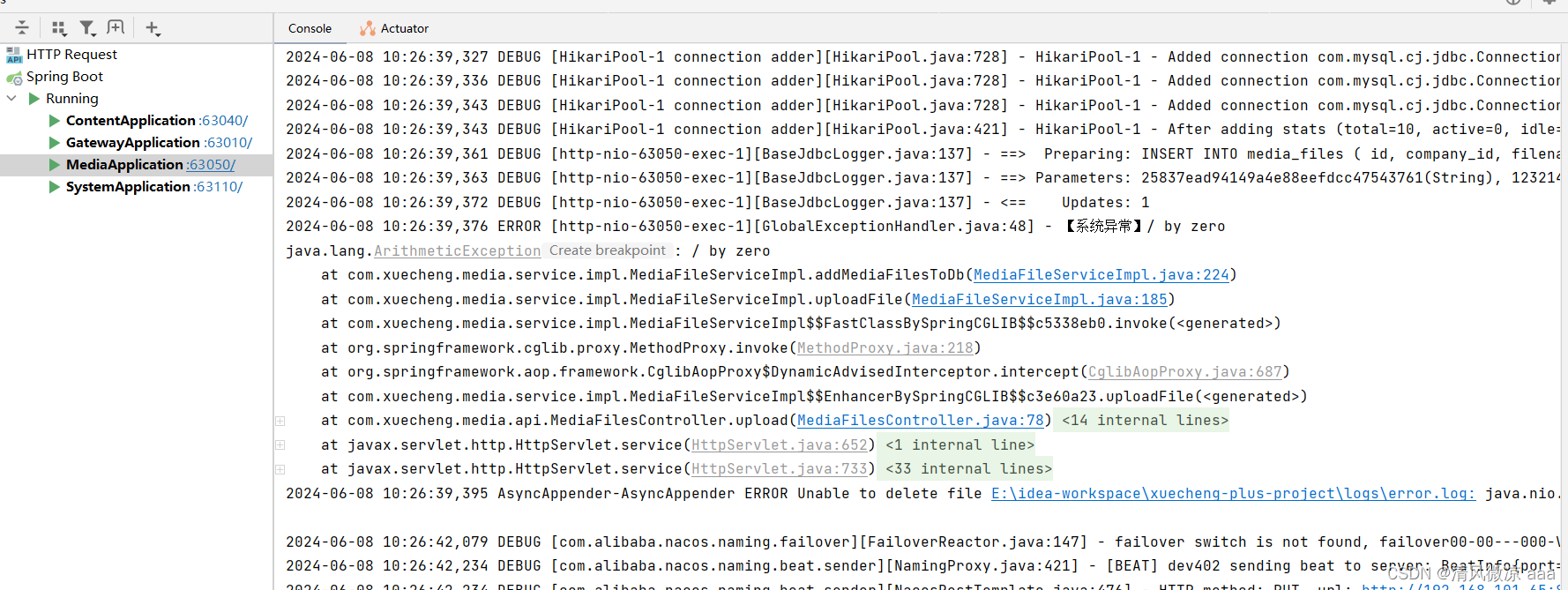

我们人为在int insert = mediaFilesMapper.insert(mediaFiles);下边添加一个异常代码int a=1/0;

测试是否事务控制。很遗憾,事务控制失败。

抛出异常应该回滚,但是数据却入库成功了。

方法上已经添加了@Transactional注解为什么该方法不能被事务控制呢?

如果是在uploadFile方法上添加@Transactional注解就可以控制事务,去掉则不行。

现在的问题其实是一个非事务方法调同类一个事务方法,事务无法控制,这是为什么?

下边分析原因:

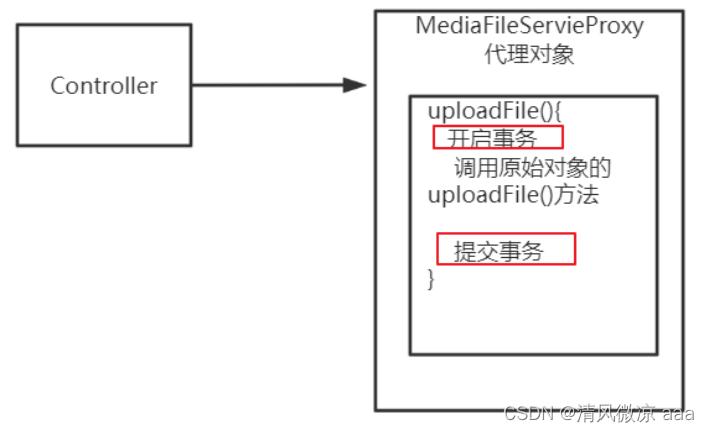

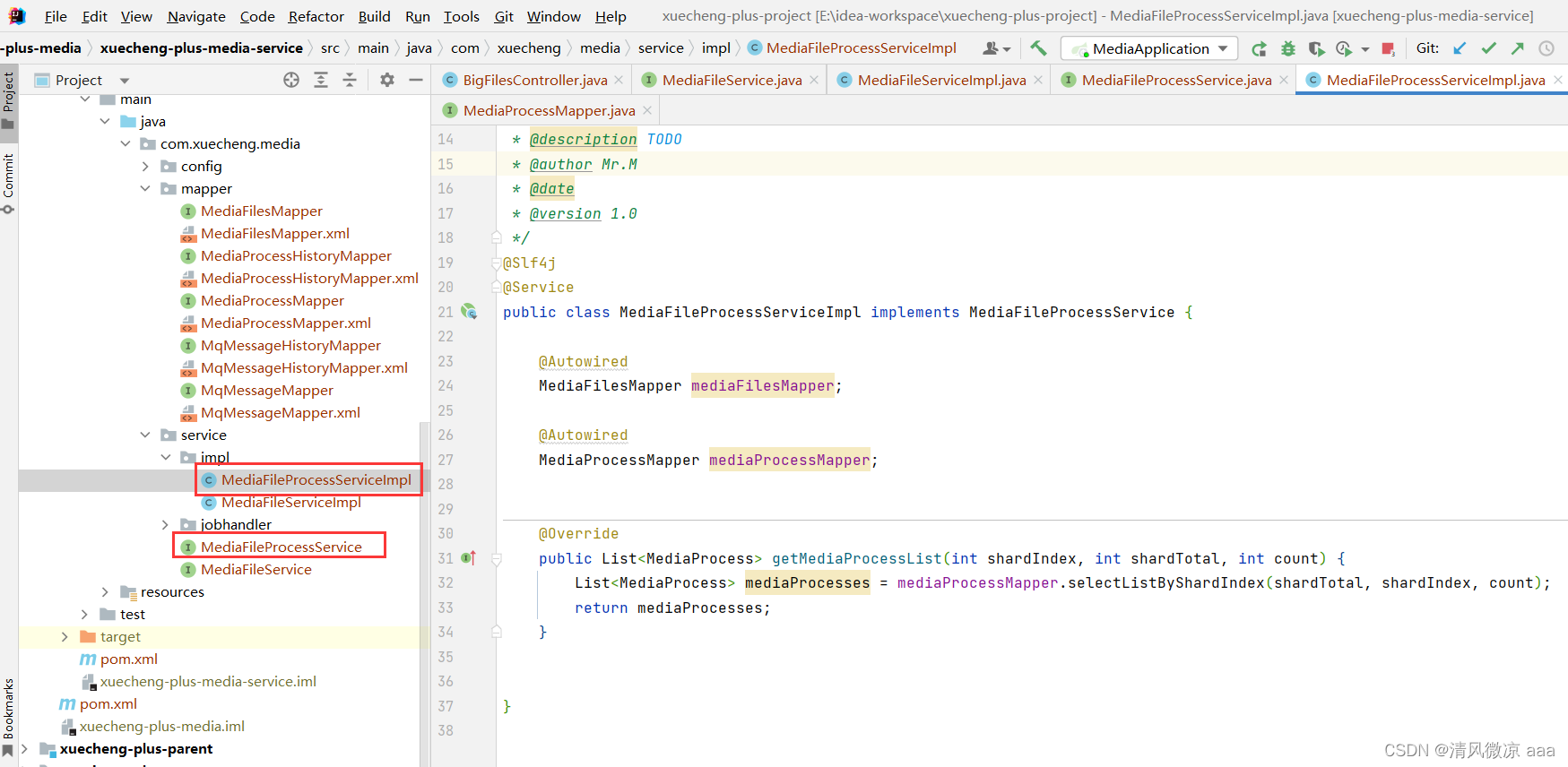

如果在uploadFile方法上添加@Transactional注解,代理对象执行此方法前会开启事务,如下图:

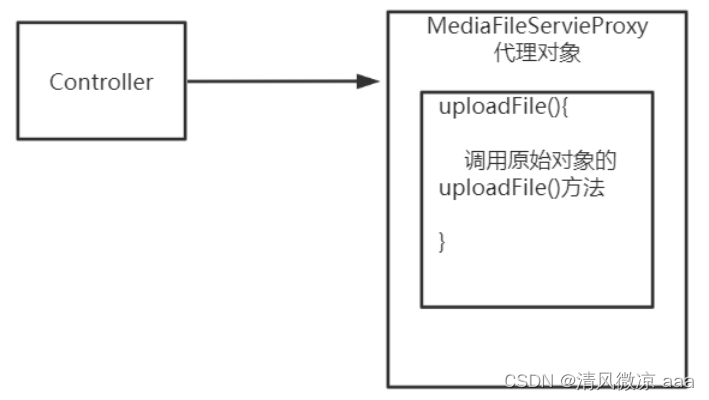

如果在uploadFile方法上没有@Transactional注解,代理对象执行此方法前不进行事务控制,如下图:

所以判断该方法是否可以事务控制必须保证是通过代理对象调用此方法,且此方法上添加了@Transactional注解。

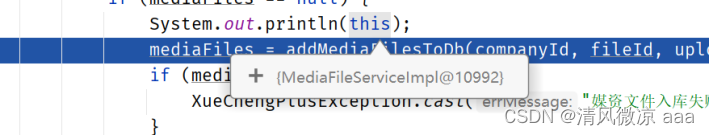

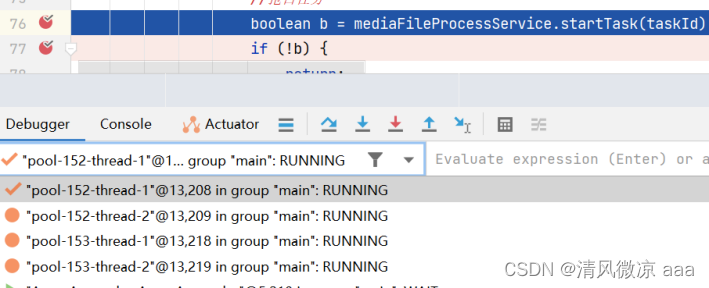

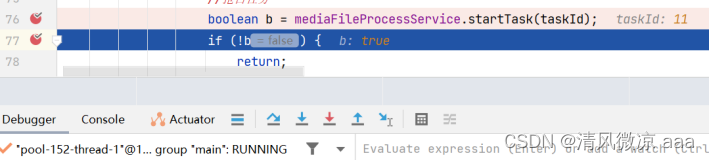

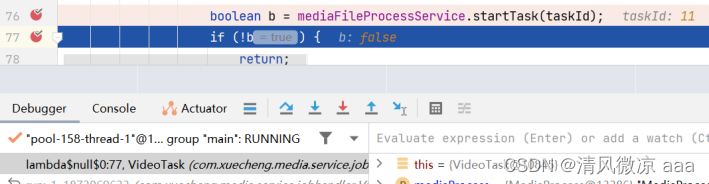

现在在addMediaFilesToDb方法上添加@Transactional注解,也不会进行事务控制是因为并不是通过代理对象执行的addMediaFilesToDb方法。为了判断在uploadFile方法中去调用addMediaFilesToDb方法是否是通过代理对象去调用,我们可以打断点跟踪。

我们发现在uploadFile方法中去调用addMediaFilesToDb方法不是通过代理对象去调用。

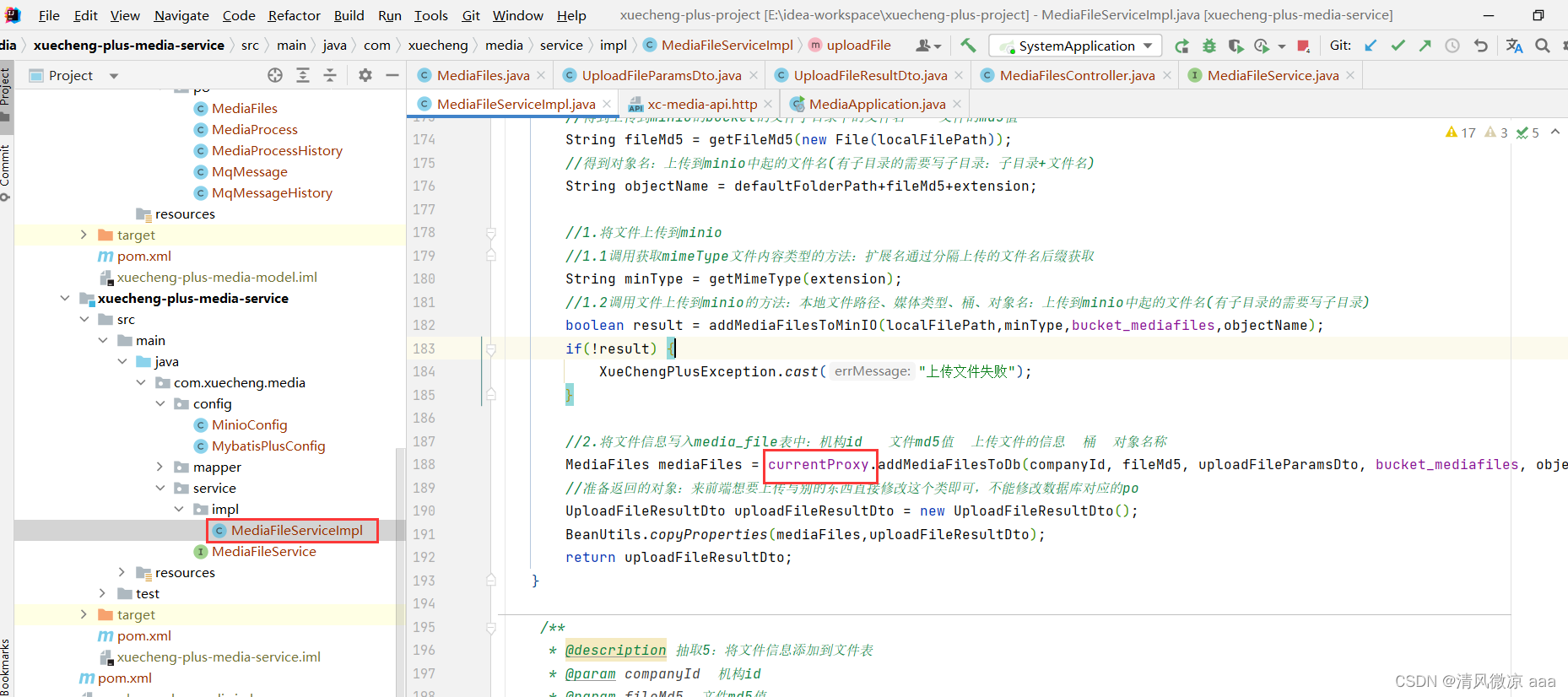

如何解决呢?通过代理对象去调用addMediaFilesToDb方法即可解决。

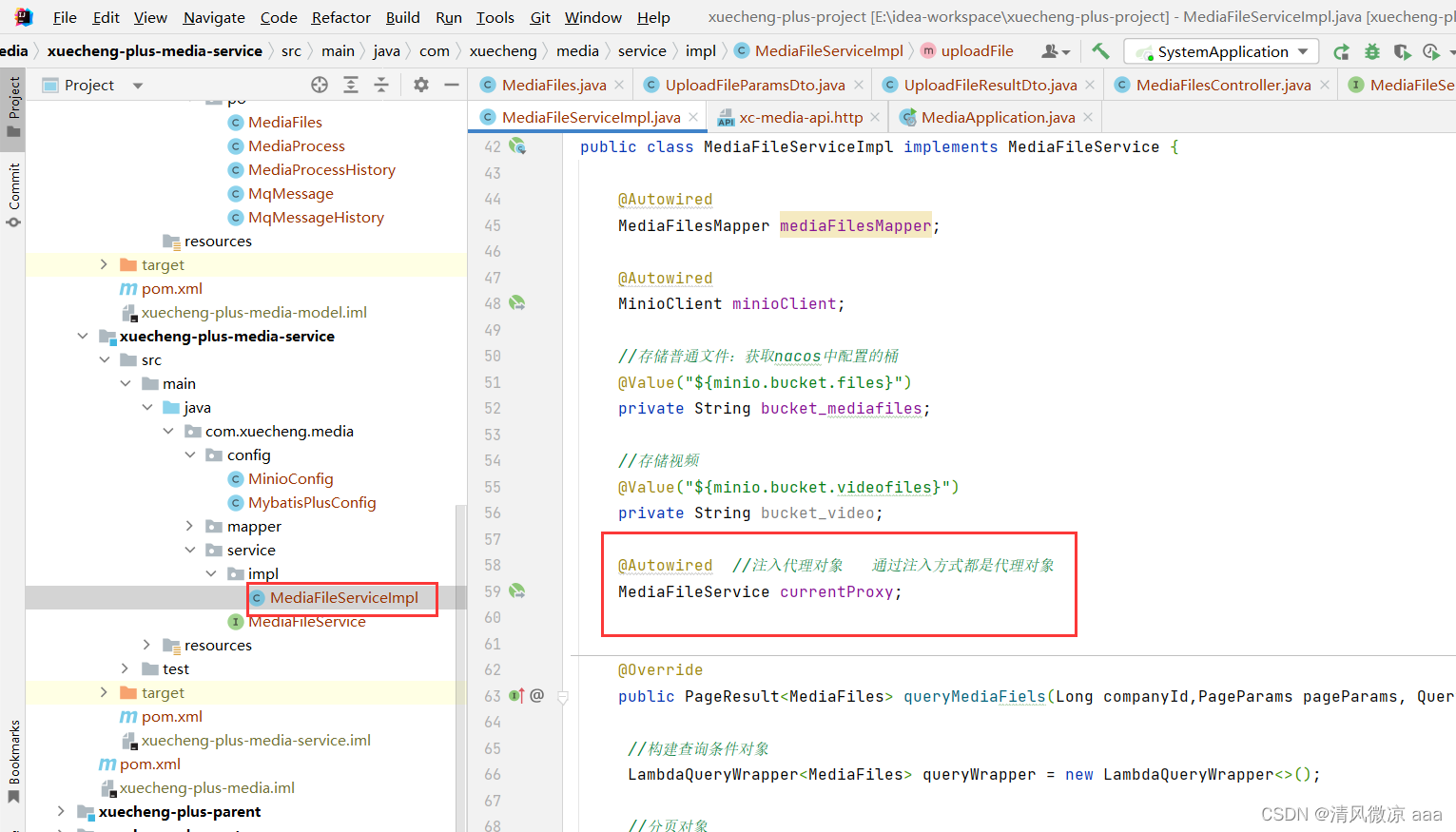

在MediaFileService的实现类中注入MediaFileService的代理对象,如下:

@Autowired

MediaFileService currentProxy;

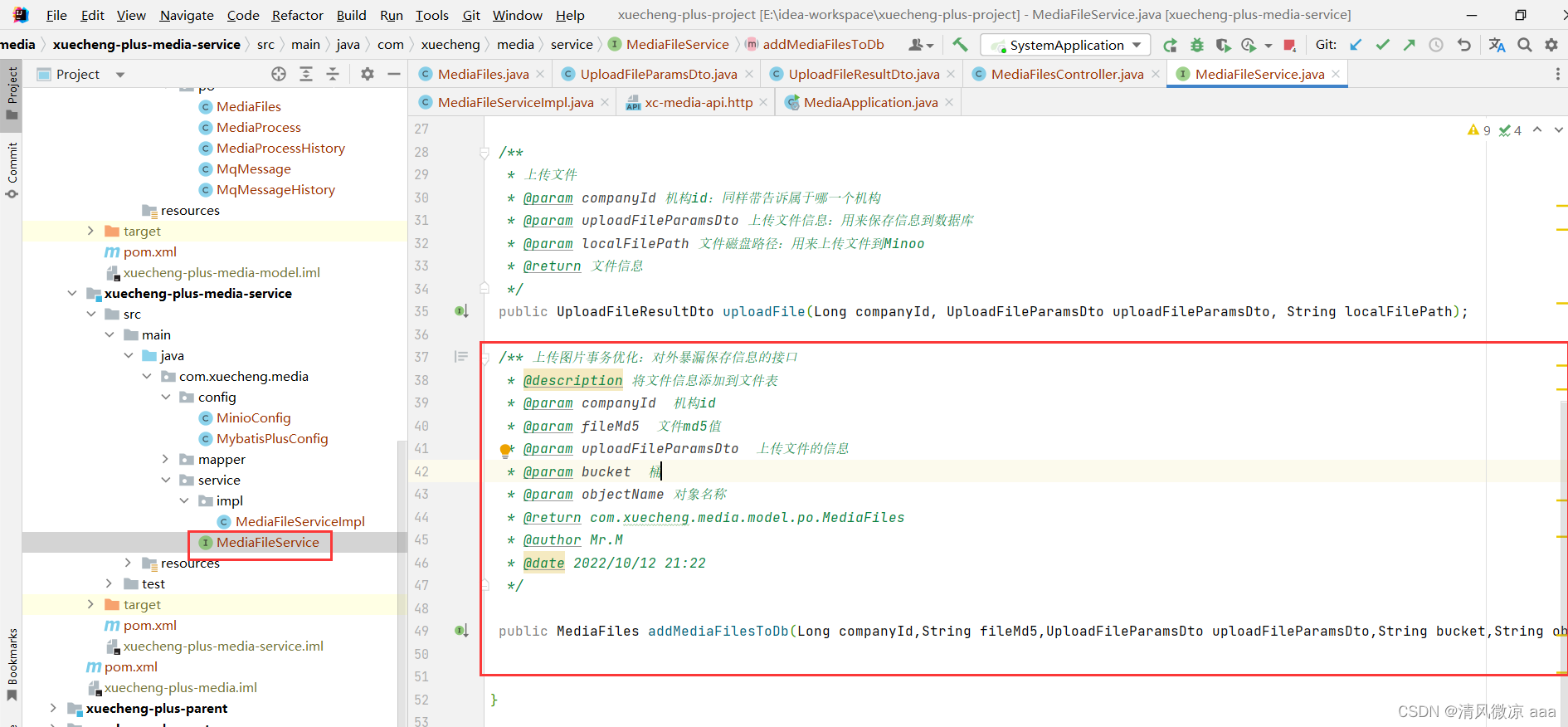

将addMediaFilesToDb方法提成接口:因为这个方法没有暴漏成接口你没办法调用

/** 上传图片事务优化:对外暴漏保存信息的接口

* @description 将文件信息添加到文件表

* @param companyId 机构id

* @param fileMd5 文件md5值

* @param uploadFileParamsDto 上传文件的信息

* @param bucket 桶

* @param objectName 对象名称

* @return com.xuecheng.media.model.po.MediaFiles

* @author Mr.M

* @date 2022/10/12 21:22

*/

public MediaFiles addMediaFilesToDb(Long companyId,String fileMd5,UploadFileParamsDto uploadFileParamsDto,String bucket,String objectName);

调用addMediaFilesToDb方法的代码处改为如下:

.....

//写入文件表

MediaFiles mediaFiles = currentProxy.addMediaFilesToDb(companyId, fileMd5, uploadFileParamsDto, bucket_files, objectName);

....

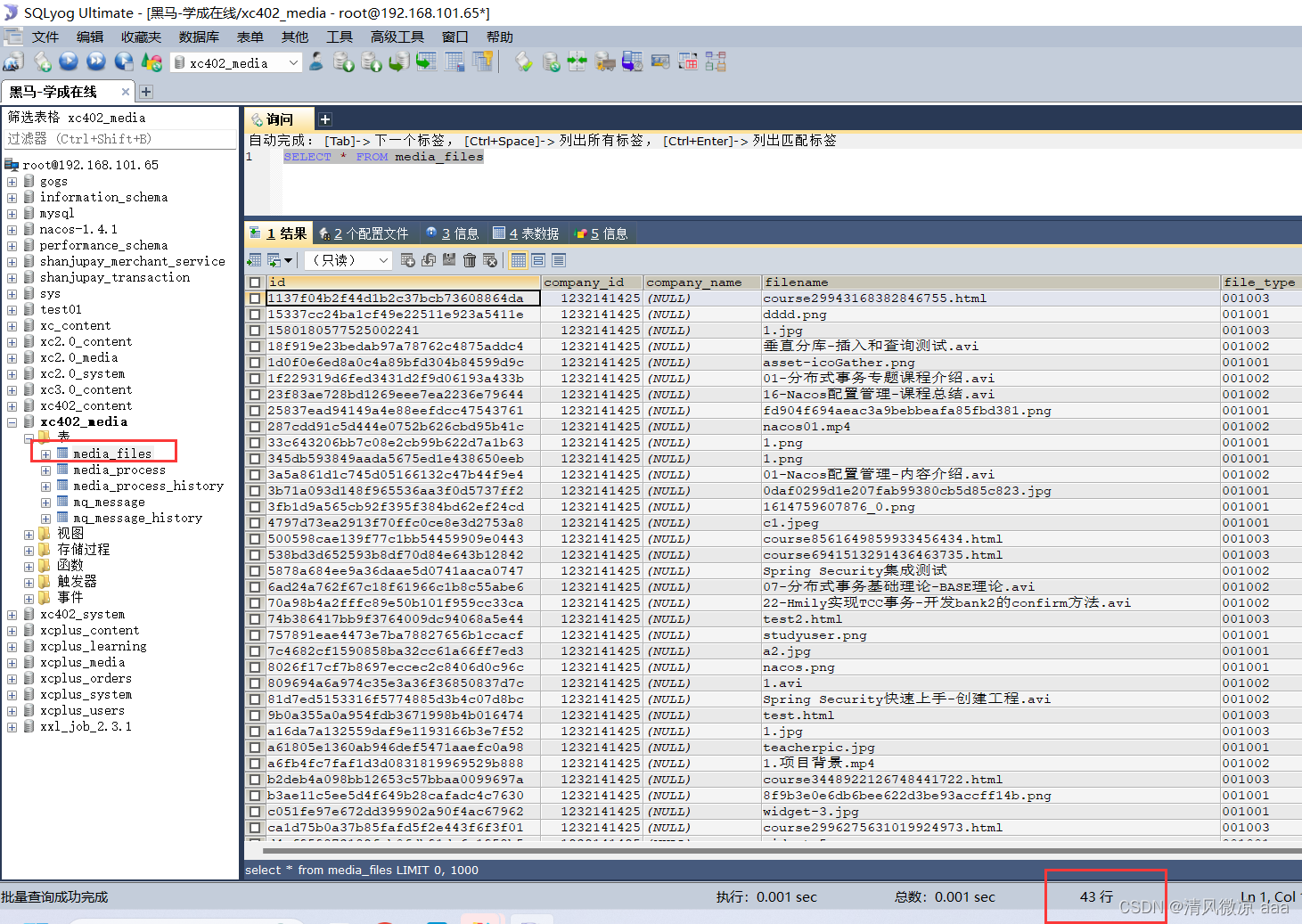

再次测试事务是否可以正常控制。

文件信息表之前是43行现在还是43行,说明事务回滚没有保存成功。

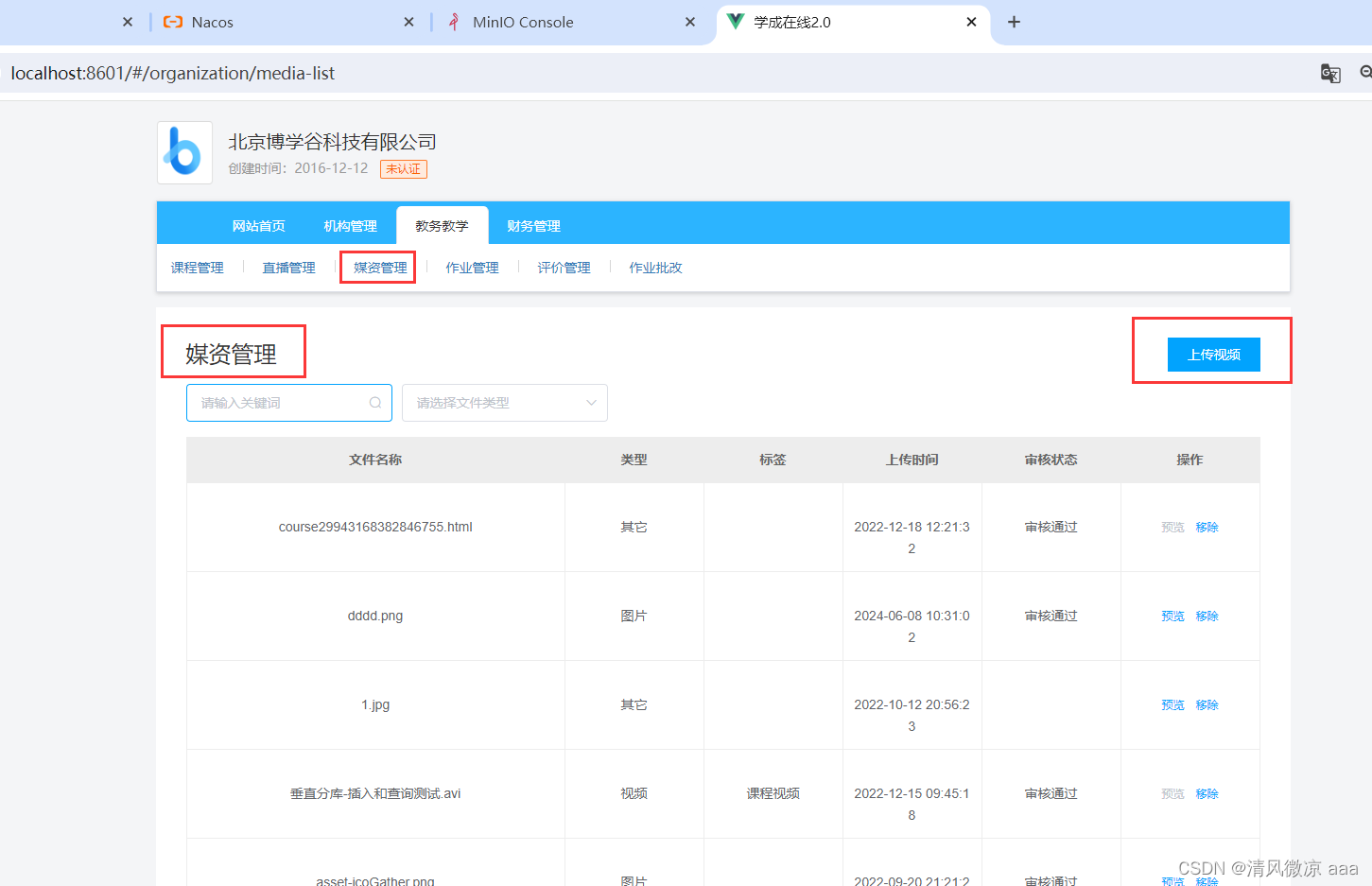

5 上传视频

5.1 需求分析

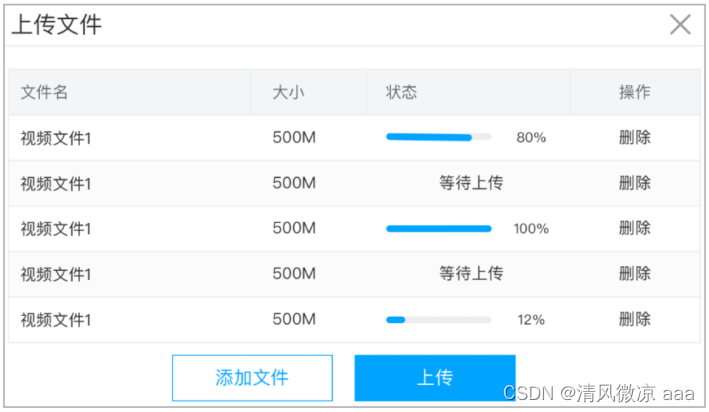

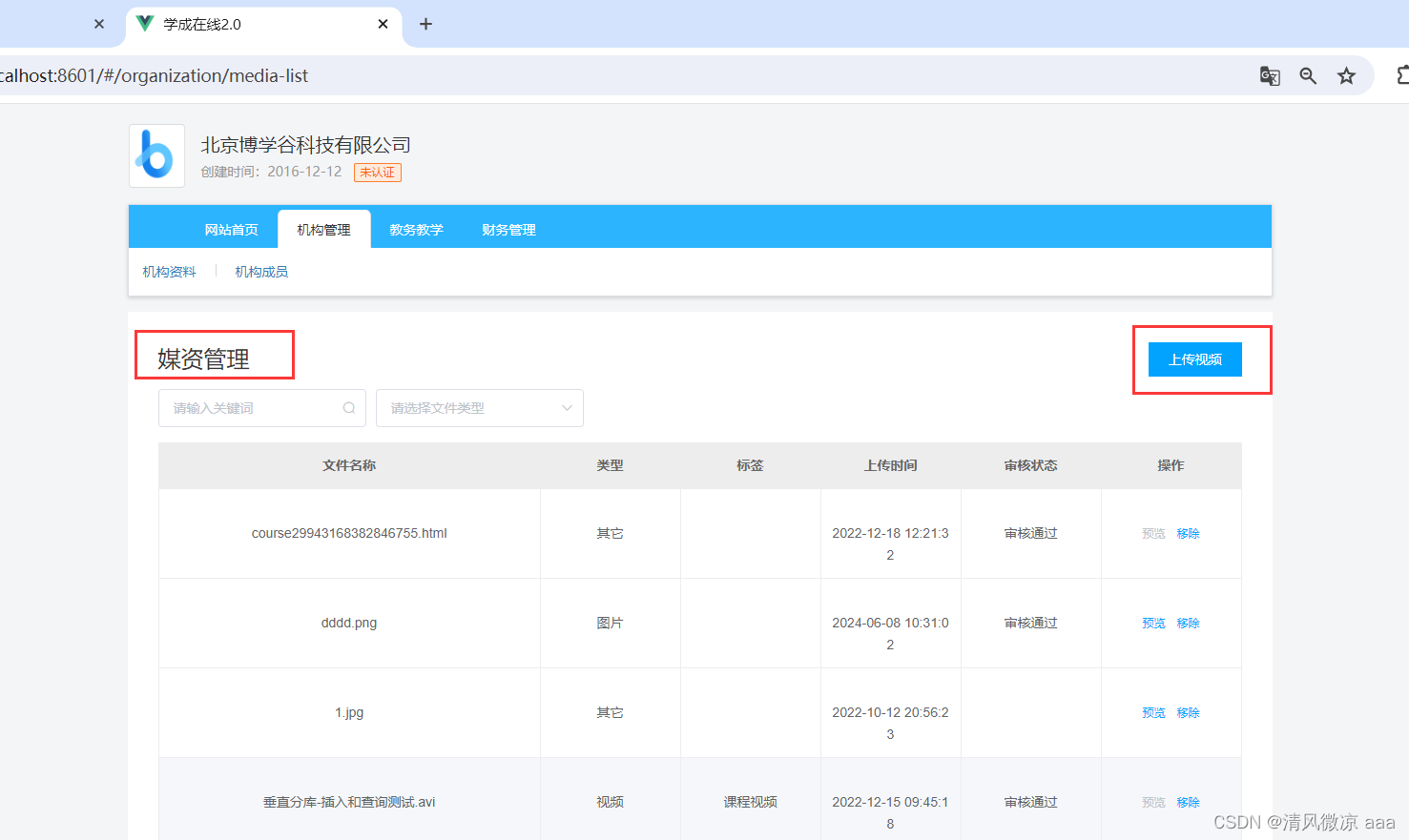

1、教学机构人员进入媒资管理列表查询自己上传的媒资文件。

点击“媒资管理”

进入媒资管理列表页面查询本机构上传的媒资文件。

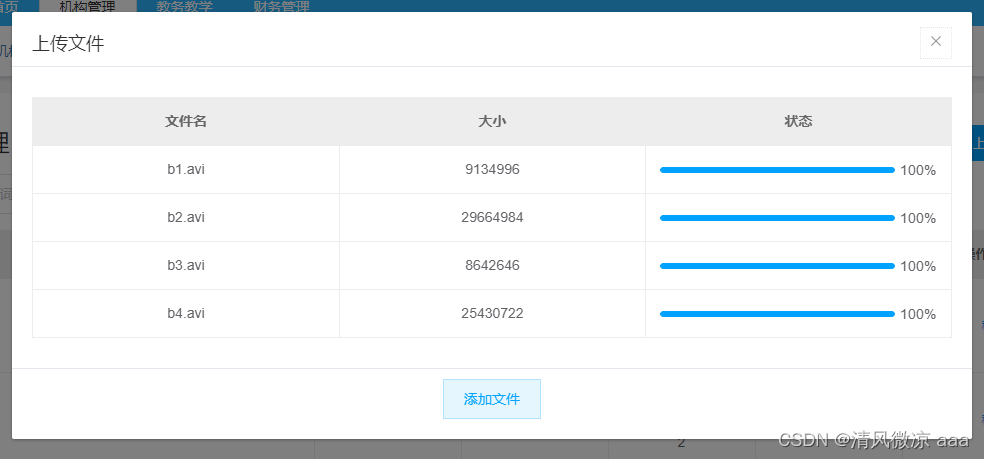

2、教育机构用户在"媒资管理"页面中点击 “上传视频” 按钮。

点击“上传视频”打开上传页面

3、选择要上传的文件,自动执行文件上传。

4、视频上传成功会自动处理,处理完成可以预览视频。

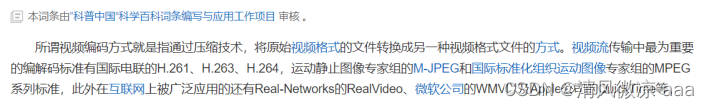

5.2 断点续传技术

5.2.1 什么是断点续传

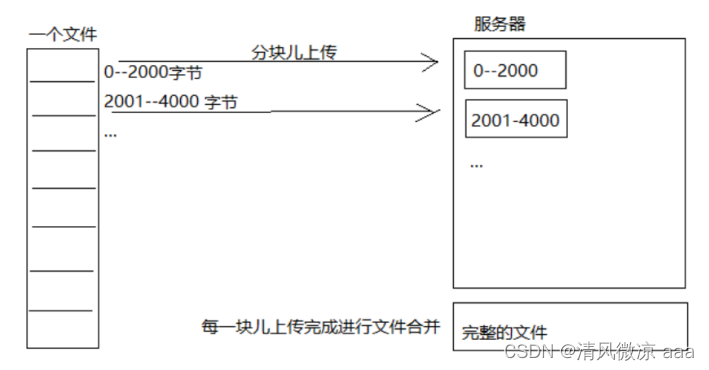

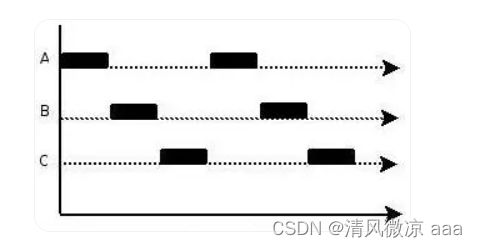

通常视频文件都比较大,所以对于媒资系统上传文件的需求要满足大文件的上传要求。http协议本身对上传文件大小没有限制,但是客户的网络环境质量、电脑硬件环境等参差不齐,如果一个大文件快上传完了网断了没有上传完成,需要客户重新上传,用户体验非常差,所以对于大文件上传的要求最基本的是断点续传。

什么是断点续传:

引用百度百科:断点续传指的是在下载或上传时,将下载或上传任务(一个文件或一个压缩包)人为的划分为几个部分,每一个部分采用一个线程进行上传或下载,如果碰到网络故障,可以从已经上传或下载的部分开始继续上传下载未完成的部分,而没有必要从头开始上传下载,断点续传可以提高节省操作时间,提高用户体验性。

断点续传流程如下图:

流程如下:

1、前端上传前先把文件分成块

2、一块一块的上传,上传中断后重新上传,已上传的分块则不用再上传

3、各分块上传完成最后在服务端合并文件

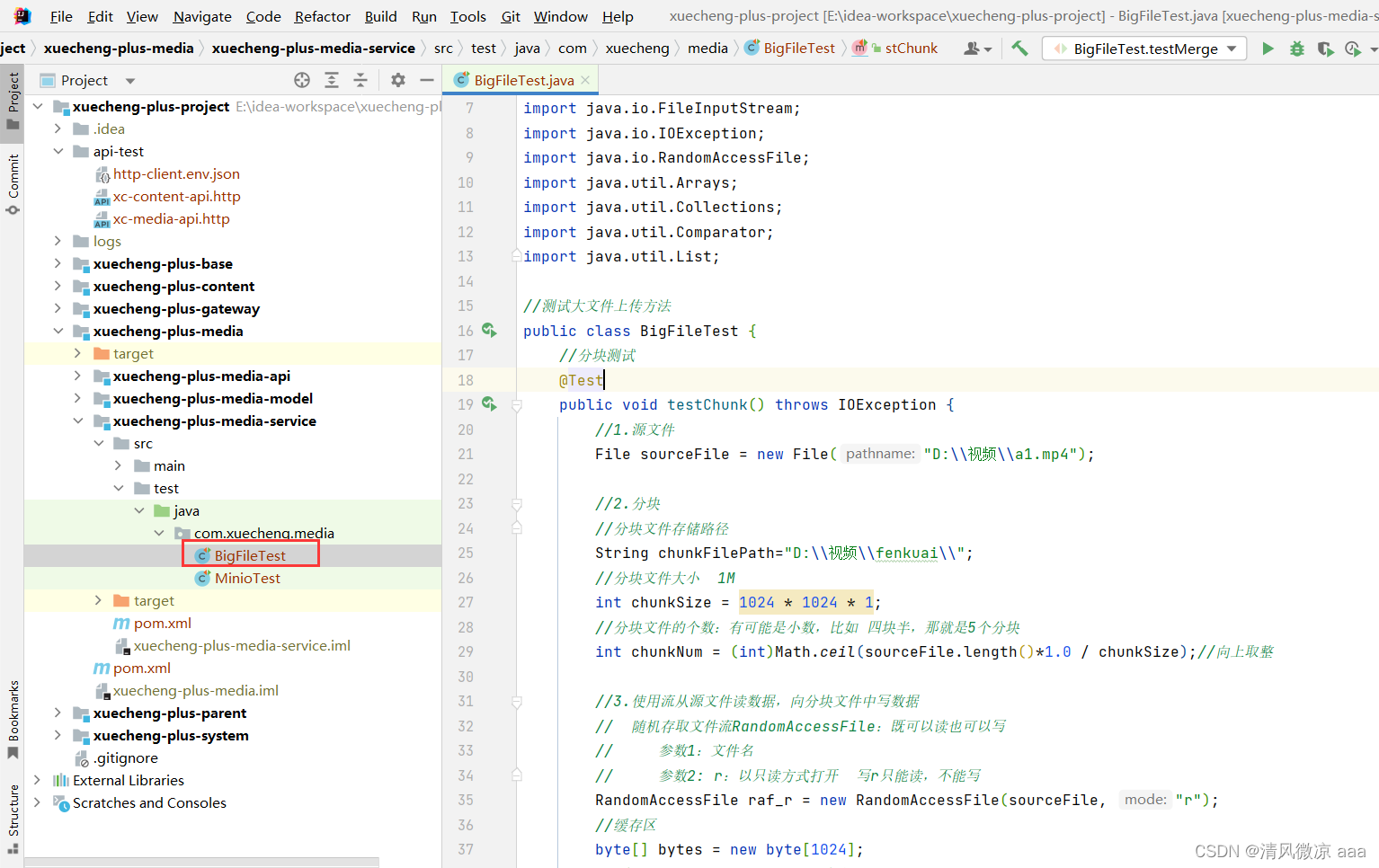

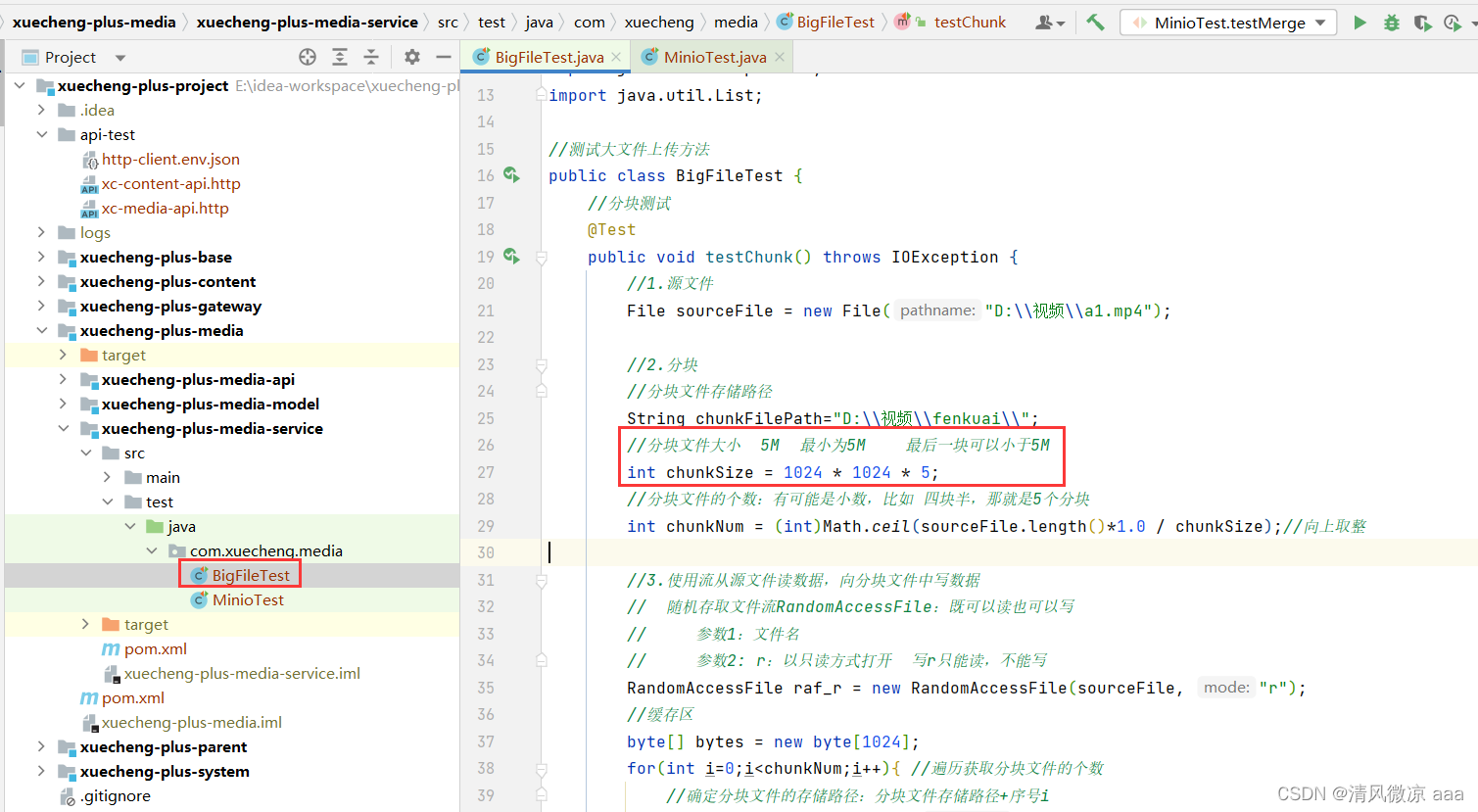

5.2.2 分块与合并测试

为了更好的理解文件分块上传的原理,下边用java代码测试文件的分块与合并。

文件分块的流程如下:

1、获取源文件长度

2、根据设定的分块文件的大小计算出块数

3、从源文件读数据依次向每一个块文件写数据。

测试代码如下:

//分块测试

@Test

public void testChunk() throws IOException {

//1.源文件

File sourceFile = new File("D:\\视频\\a1.mp4");

//2.分块

//分块文件存储路径

String chunkFilePath="D:\\视频\\fenkuai\\";

//分块文件大小 5M 最小为5M 最后一块可以小于5M

int chunkSize = 1024 * 1024 * 5;

//分块文件的个数:有可能是小数,比如 四块半,那就是5个分块

int chunkNum = (int)Math.ceil(sourceFile.length()*1.0 / chunkSize);//向上取整

//3.使用流从源文件读数据,向分块文件中写数据

// 随机存取文件流RandomAccessFile:既可以读也可以写

// 参数1:文件名

// 参数2: r:以只读方式打开 写r只能读,不能写

RandomAccessFile raf_r = new RandomAccessFile(sourceFile, "r");

//缓存区

byte[] bytes = new byte[1024];

for(int i=0;i<chunkNum;i++){ //遍历获取分块文件的个数

//确定分块文件的存储路径:分块文件存储路径+序号i

File chunkFile = new File(chunkFilePath + i);

//分块文件写入流 :rw,读取和写入

RandomAccessFile raf_rw = new RandomAccessFile(chunkFile, "rw");

int len = -1;

while((len=raf_r.read(bytes))!=-1){//当文件读完了,len的长度=-1,也就是说len的长度!=-1时文件还没有读完让它继续读。

//从缓冲区里把数据往分块文件中写

raf_rw.write(bytes,0,len);

//一个分块文件的大小是有限的:当这个分块文件的大小>=当时设置的文件大小时,就不让它在写了

if(chunkFile.length()>=chunkSize){

break;

}

}

raf_rw.close();

}

raf_r.close();

}

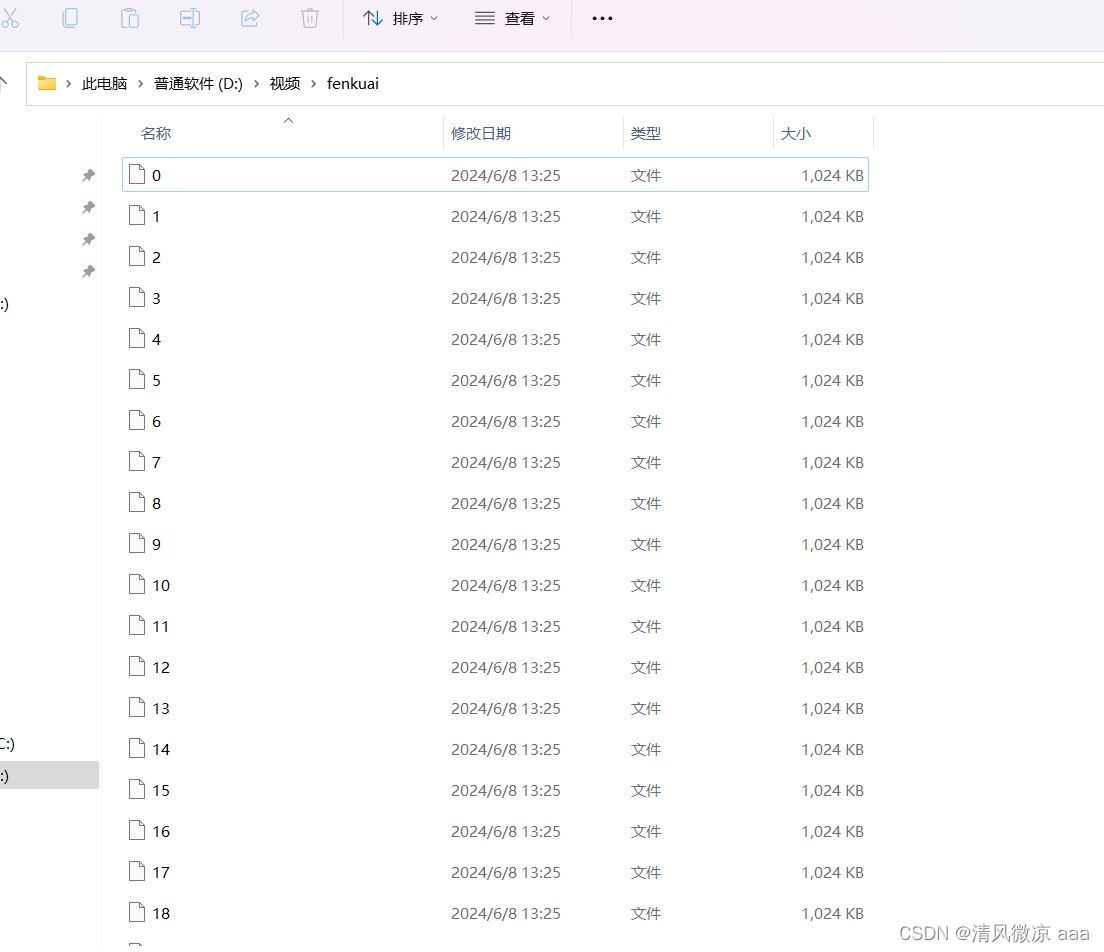

分块成功:

文件合并流程:

1、找到要合并的文件并按文件合并的先后进行排序。

2、创建合并文件

3、依次从合并的文件中读取数据向合并文件写入数

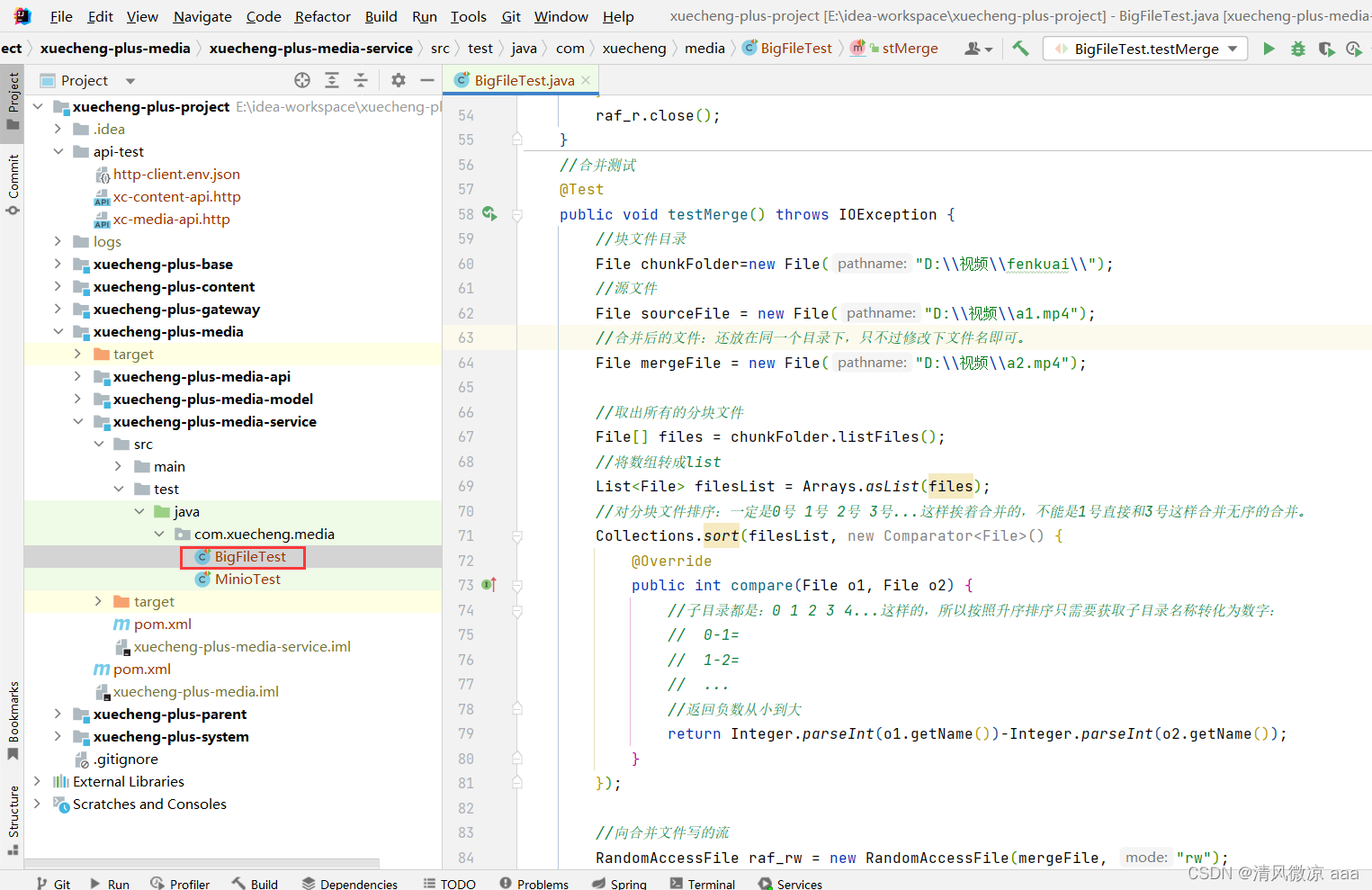

文件合并的测试代码 :

//合并测试

@Test

public void testMerge() throws IOException {

//块文件目录

File chunkFolder=new File("D:\\视频\\fenkuai\\");

//源文件

File sourceFile = new File("D:\\视频\\a1.mp4");

//合并后的文件:还放在同一个目录下,只不过修改下文件名即可。

File mergeFile = new File("D:\\视频\\a2.mp4");

//取出所有的分块文件

File[] files = chunkFolder.listFiles();

//将数组转成list

List<File> filesList = Arrays.asList(files);

//对分块文件排序:一定是0号 1号 2号 3号...这样挨着合并的,不能是1号直接和3号这样合并无序的合并。

Collections.sort(filesList, new Comparator<File>() {

@Override

public int compare(File o1, File o2) {

//子目录都是:0 1 2 3 4...这样的,所以按照升序排序只需要获取子目录名称转化为数字:

// 0-1=

// 1-2=

// ...

//返回负数从小到大

return Integer.parseInt(o1.getName())-Integer.parseInt(o2.getName());

}

});

//向合并文件写的流

RandomAccessFile raf_rw = new RandomAccessFile(mergeFile, "rw");

//缓存区

byte[] bytes = new byte[1024];

//遍历分块文件,向合并的文件写

for(File file: filesList){

//读分块的流

RandomAccessFile raf_r = new RandomAccessFile(file, "r");

int len = -1;

while((len=raf_r.read(bytes))!=-1){

raf_rw.write(bytes,0,len);

}

raf_r.close();

}

raf_rw.close();

//合并文件完成后对合并的文件md5值校验

FileInputStream fileInputStream_merge = new FileInputStream(mergeFile);

FileInputStream fileInputStream_source = new FileInputStream(sourceFile);

String md5_merge = DigestUtils.md5Hex(fileInputStream_merge); //源文件

String md5_source = DigestUtils.md5Hex(fileInputStream_source);//合并后的文件

if(md5_merge.equals(md5_source)){

System.out.println("文件合并成功");

}

}

文件合并成功:

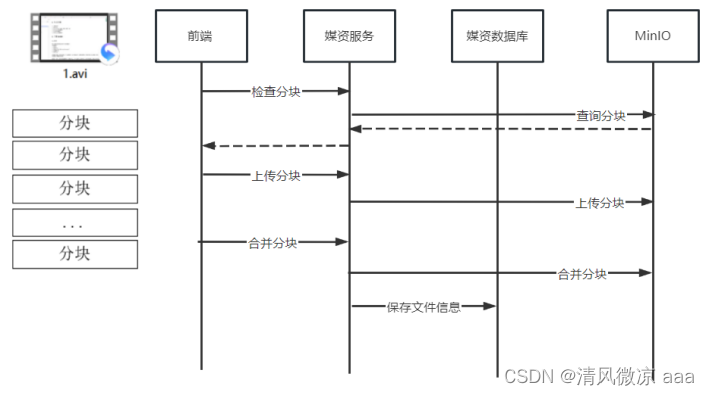

5.2.3 视频上传流程

下图是上传视频的整体流程:

1、前端对文件进行分块。

2、前端上传分块文件前请求媒资服务检查文件是否存在,如果已经存在则不再上传。

3、如果分块文件不存在则前端开始上传

4、前端请求媒资服务上传分块。

5、媒资服务将分块上传至MinIO。

6、前端将分块上传完毕请求媒资服务合并分块。

7、媒资服务判断分块上传完成则请求MinIO合并文件。

8、合并完成校验合并后的文件是否完整,如果不完整则删除文件。

总结:

- 接口1:查询分块

- 接口2:上传分块

- 接口3:合并分块

5.2.4 minio合并文件测试

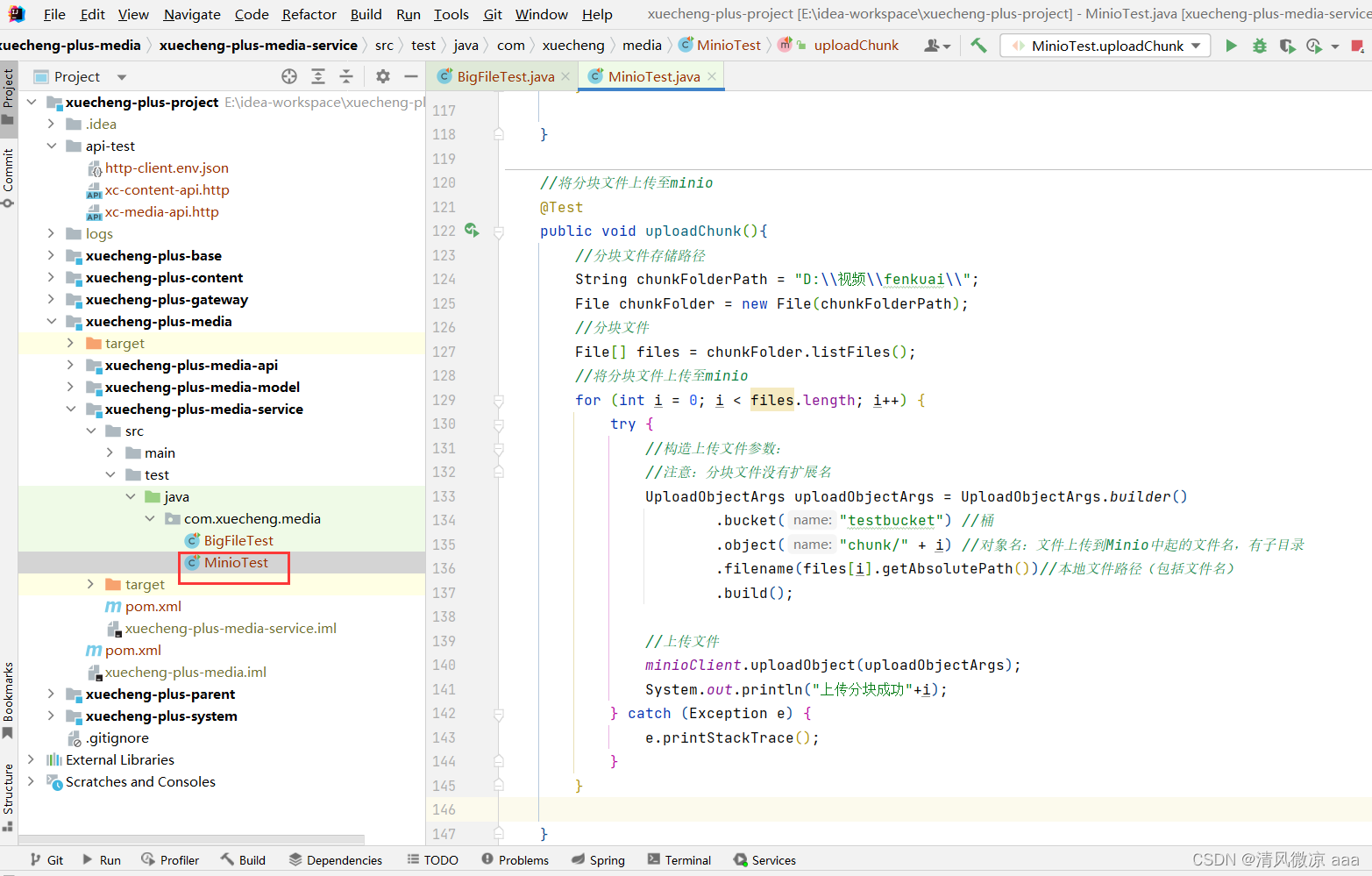

说明:查询分块、上传分块都测试过(3.2.4中),现在测试minio合并分块

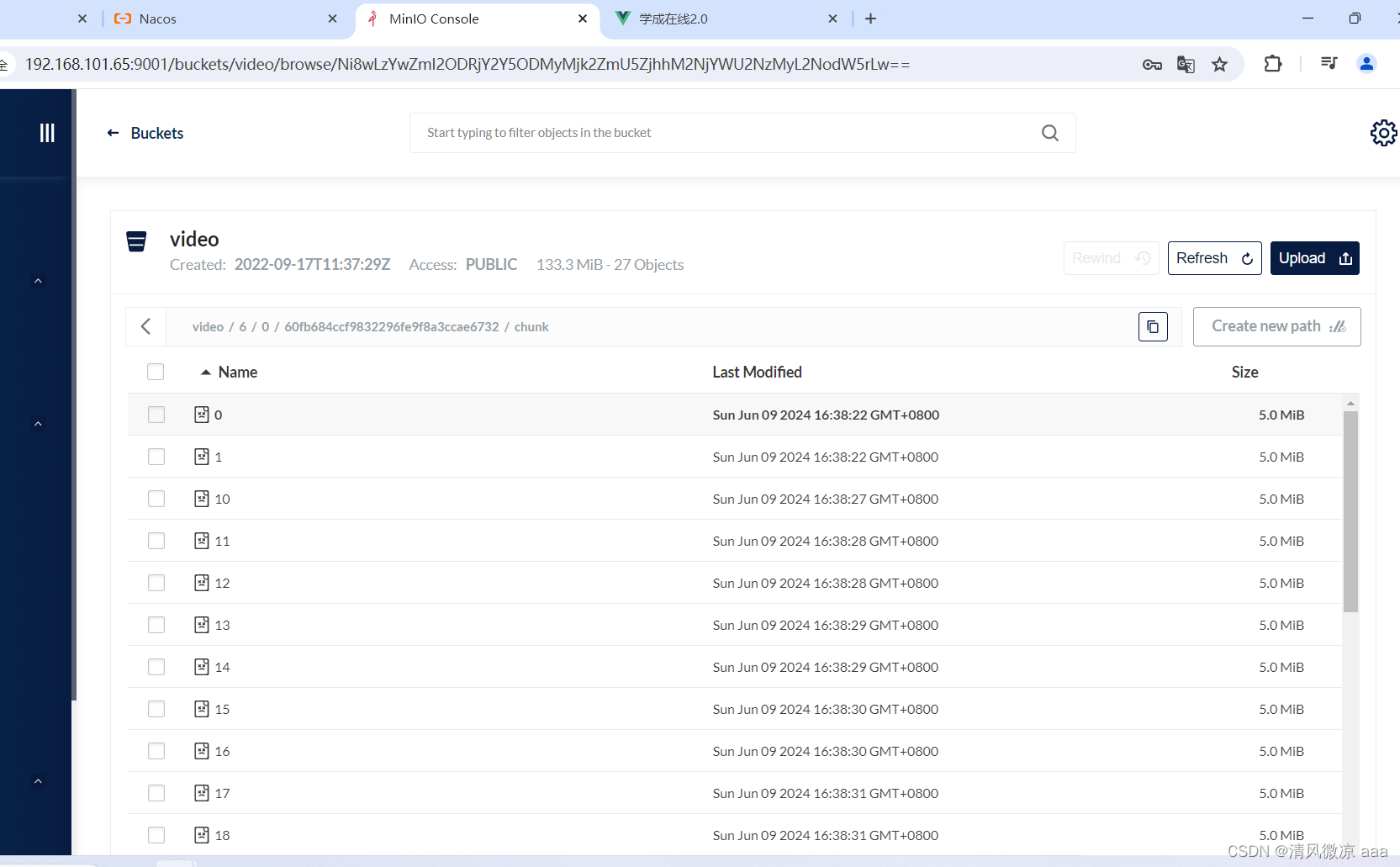

1、将分块文件上传至minio

//将分块文件上传至minio

@Test

public void uploadChunk(){

//分块文件存储路径

String chunkFolderPath = "D:\\视频\\fenkuai\\";

File chunkFolder = new File(chunkFolderPath);

//分块文件

File[] files = chunkFolder.listFiles();

//将分块文件上传至minio

for (int i = 0; i < files.length; i++) {

try {

//构造上传文件参数:

//注意:分块文件没有扩展名

UploadObjectArgs uploadObjectArgs = UploadObjectArgs.builder()

.bucket("testbucket") //桶

.object("chunk/" + i) //对象名:文件上传到Minio中起的文件名,有子目录

.filename(chunkFolderPath+i)//本地文件路径(包括文件名)

.build();

//上传文件

minioClient.uploadObject(uploadObjectArgs);

System.out.println("上传分块成功"+i);

} catch (Exception e) {

e.printStackTrace();

}

}

}

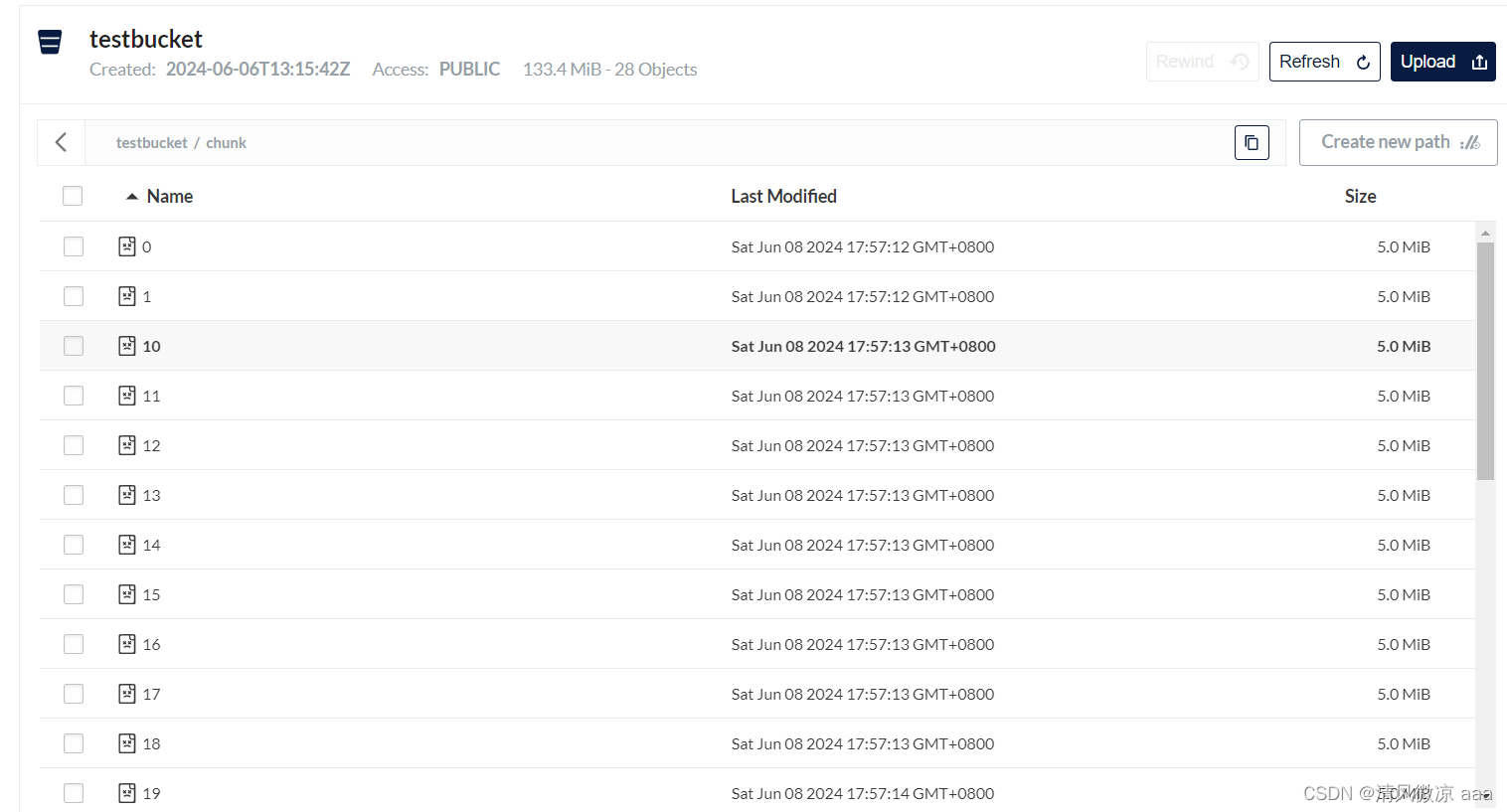

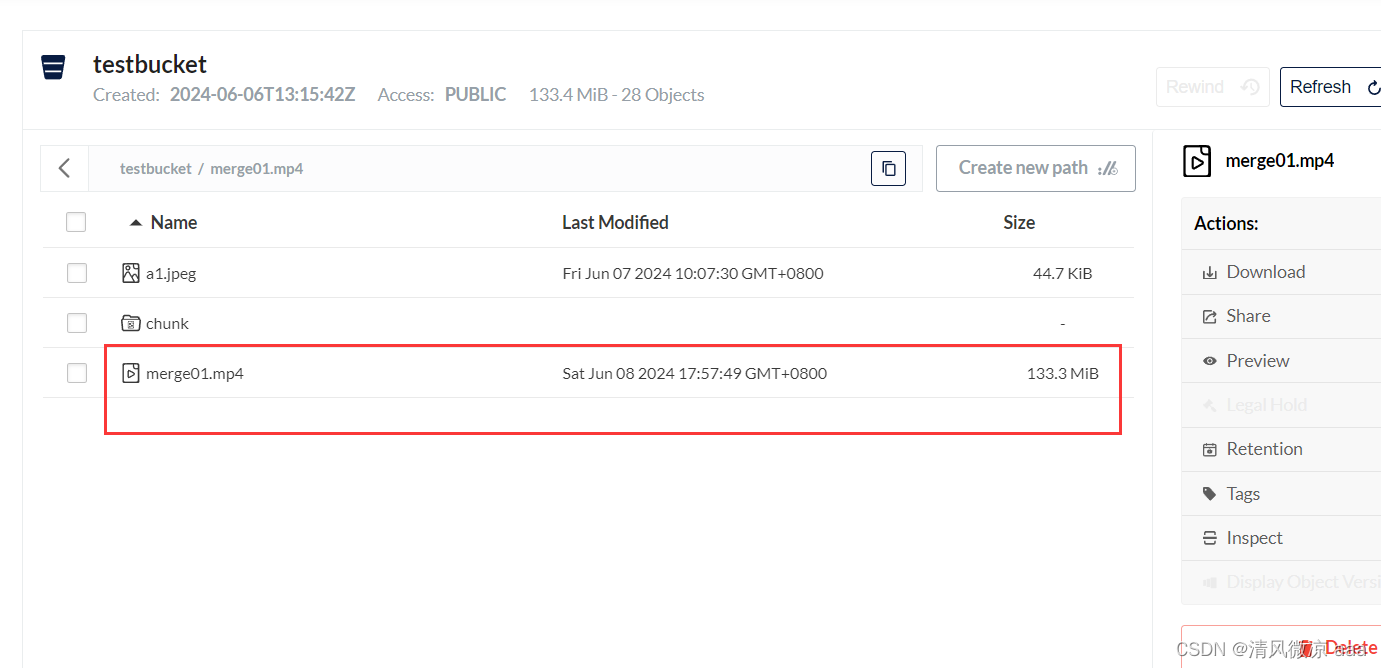

2、通过minio的合并文件

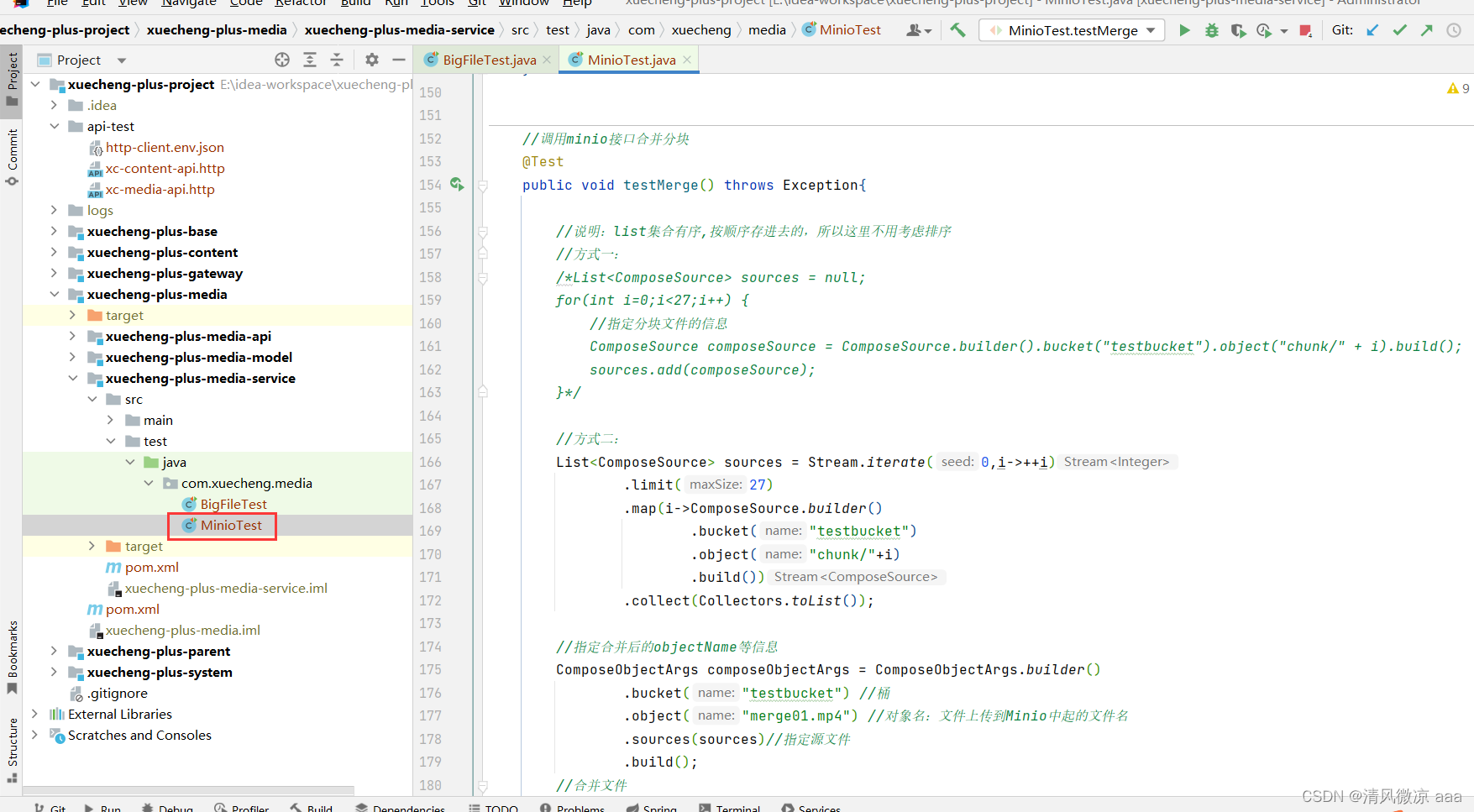

//调用minio接口合并分块

@Test

public void testMerge() throws Exception{

//说明:list集合有序,按顺序存进去的,所以这里不用考虑排序

//方式一:

/*List<ComposeSource> sources = null;

for(int i=0;i<27;i++) {

//指定分块文件的信息

ComposeSource composeSource = ComposeSource.builder().bucket("testbucket").object("chunk/" + i).build();

sources.add(composeSource);

}*/

//方式二:

List<ComposeSource> sources = Stream.iterate(0,i->++i)

.limit(27)

.map(i->ComposeSource.builder()

.bucket("testbucket")

.object("chunk/"+i)

.build())

.collect(Collectors.toList());

//指定合并后的objectName等信息

ComposeObjectArgs composeObjectArgs = ComposeObjectArgs.builder()

.bucket("testbucket") //桶

.object("merge01.mp4") //对象名:文件上传到Minio中起的文件名

.sources(sources)//指定源文件

.build();

//合并文件

//报错size 1048576 must be greater than 5242880 minio 默认的分块文件大小最小为5M 最后一块可以小于5M

minioClient.composeObject(composeObjectArgs);

}

//清除分块文件:分块是上传过程中需要的东西,上传完成后清理掉

@Test

public void test_removeObjects(){

//合并分块完成将分块文件清除

List<DeleteObject> deleteObjects = Stream.iterate(0, i -> ++i)

.limit(6)

.map(i -> new DeleteObject("chunk/".concat(Integer.toString(i))))

.collect(Collectors.toList());

RemoveObjectsArgs removeObjectsArgs = RemoveObjectsArgs.builder()

.bucket("testbucket")

.objects(deleteObjects)

.build();

Iterable<Result<DeleteError>> results = minioClient.removeObjects(removeObjectsArgs);

results.forEach(r->{

DeleteError deleteError = null;

try {

deleteError = r.get();

} catch (Exception e) {

e.printStackTrace();

}

});

}

使用minio合并文件报错:java.lang.IllegalArgumentException: source testbucket/chunk/0: size 1048576 must be greater than 5242880

minio合并文件默认分块最小5M,我们将分块改为5M再次测试。

5.3 接口定义

根据上传视频流程,定义接口,与前端的约定是

- 操作成功返回

{

code: 0

}

- 否则返回

{

code: -1

}

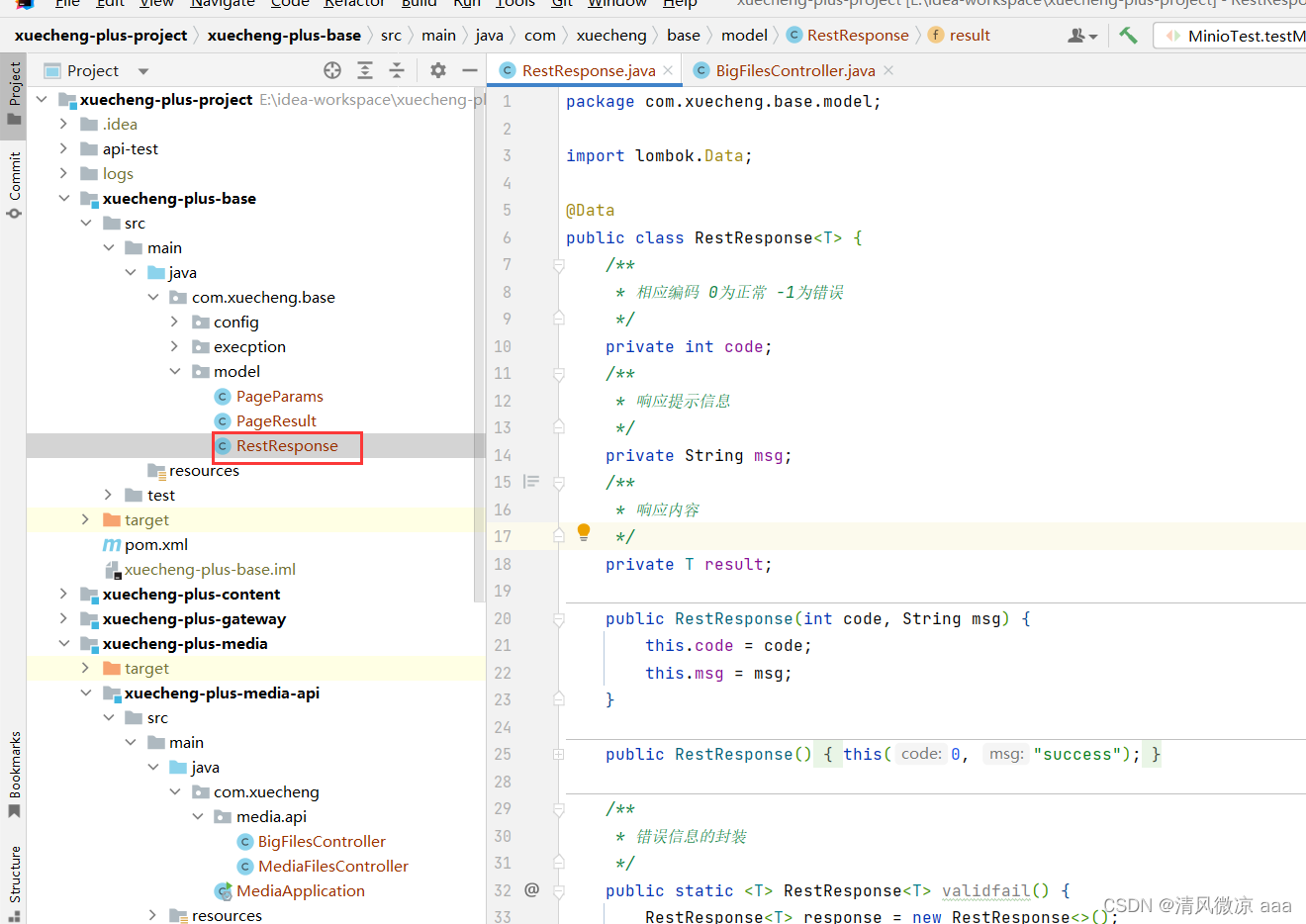

从课程资料中拷贝RestResponse.java类到base工程下的model包下。

在base工程的model包下新建RestResponse类:统一返回结果

package com.xuecheng.base.model;

import lombok.Data;

@Data

public class RestResponse<T> {

/**

* 相应编码 0为正常 -1为错误

*/

private int code;

/**

* 响应提示信息

*/

private String msg;

/**

* 响应内容

*/

private T result;

public RestResponse(int code, String msg) {

this.code = code;

this.msg = msg;

}

public RestResponse() {

this(0, "success");

}

/**

* 错误信息的封装

*/

public static <T> RestResponse<T> validfail() {

RestResponse<T> response = new RestResponse<>();

response.setCode(-1);

return response;

}

public static <T> RestResponse<T> validfail(String msg) {

RestResponse<T> response = new RestResponse<>();

response.setCode(-1);

response.setMsg(msg);

return response;

}

public static <T> RestResponse<T> validfail(String msg, T result) {

RestResponse<T> response = new RestResponse<>();

response.setCode(-1);

response.setMsg(msg);

response.setResult(result);

return response;

}

/**

* 正常信息的封装

*/

public static <T> RestResponse<T> success() {

return new RestResponse<>();

}

public static <T> RestResponse<T> success(T result) {

RestResponse<T> response = new RestResponse<>();

response.setResult(result);

return response;

}

public static <T> RestResponse<T> success(String msg, T result) {

RestResponse<T> response = new RestResponse<>();

response.setMsg(msg);

response.setResult(result);

return response;

}

}

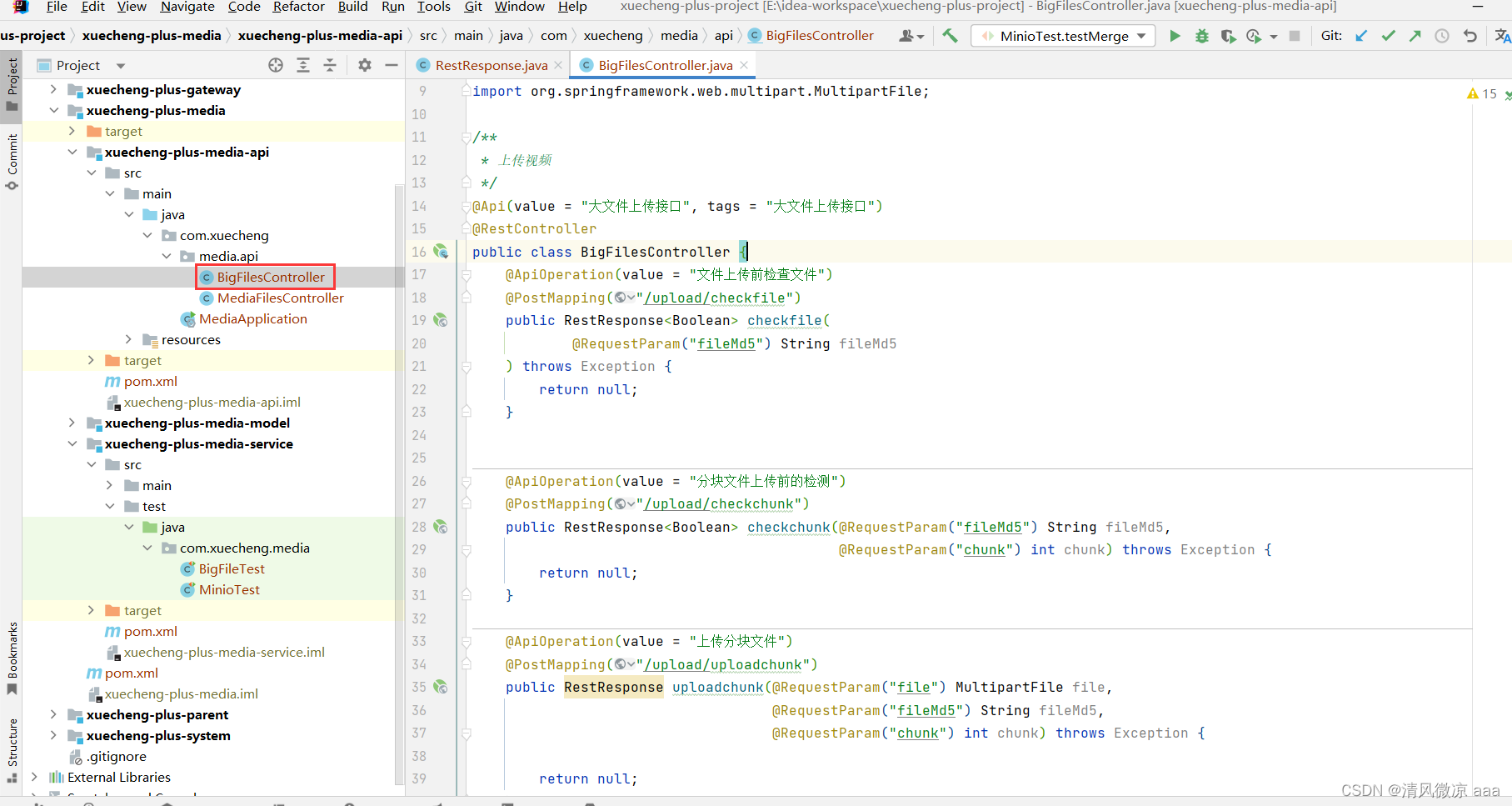

定义接口如下:

package com.xuecheng.media.api;

import com.j256.simplemagic.ContentInfo;

import com.j256.simplemagic.ContentInfoUtil;

import com.xuecheng.base.model.RestResponse;

import com.xuecheng.media.model.dto.UploadFileParamsDto;

import com.xuecheng.media.service.MediaFileService;

import io.swagger.annotations.Api;

import io.swagger.annotations.ApiOperation;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.web.bind.annotation.*;

import org.springframework.web.multipart.MultipartFile;

/**

* @author Mr.M

* @version 1.0

* @description 大文件上传接口

* @date 2022/9/6 11:29

*/

@Api(value = "大文件上传接口", tags = "大文件上传接口")

@RestController

public class BigFilesController {

@ApiOperation(value = "文件上传前检查文件")

@PostMapping("/upload/checkfile")

public RestResponse<Boolean> checkfile(

@RequestParam("fileMd5") String fileMd5

) throws Exception {

return null;

}

@ApiOperation(value = "分块文件上传前的检测")

@PostMapping("/upload/checkchunk")

public RestResponse<Boolean> checkchunk(@RequestParam("fileMd5") String fileMd5,

@RequestParam("chunk") int chunk) throws Exception {

return null;

}

@ApiOperation(value = "上传分块文件")

@PostMapping("/upload/uploadchunk")

public RestResponse uploadchunk(@RequestParam("file") MultipartFile file,

@RequestParam("fileMd5") String fileMd5,

@RequestParam("chunk") int chunk) throws Exception {

return null;

}

/**

* 合并视频分块文件

* @param fileMd5 通过md5值拿到分块文件的地址

* @param fileName 文件名:上传文件到minio时有一个原始文件名,在文件合并时需要把这个文件名放到数据库

* @param chunkTotal 分块的个数

* @return

* @throws Exception

*/

@ApiOperation(value = "合并文件")

@PostMapping("/upload/mergechunks")

public RestResponse mergechunks(@RequestParam("fileMd5") String fileMd5,

@RequestParam("fileName") String fileName,

@RequestParam("chunkTotal") int chunkTotal) throws Exception {

return null;

}

}

5.4 上传分块开发

5.4.1 DAO开发

向媒资数据库的文件表插入记录,使用自动生成的Mapper接口即可满足要求。

5.4.2 Service开发

5.4.2.1 检查文件和分块

接口完成进行接口实现,首先实现检查文件方法和检查分块方法。

在MediaFileService中定义service接口如下:

/**

* @description 检查文件是否存在

* @param fileMd5 文件的md5

* @return com.xuecheng.base.model.RestResponse<java.lang.Boolean> false不存在,true存在

* @author Mr.M

* @date 2022/9/13 15:38

*/

public RestResponse<Boolean> checkFile(String fileMd5);

/**

* @description 检查分块是否存在

* @param fileMd5 文件的md5

* @param chunkIndex 分块序号

* @return com.xuecheng.base.model.RestResponse<java.lang.Boolean> false不存在,true存在

* @author Mr.M

* @date 2022/9/13 15:39

*/

public RestResponse<Boolean> checkChunk(String fileMd5, int chunkIndex);

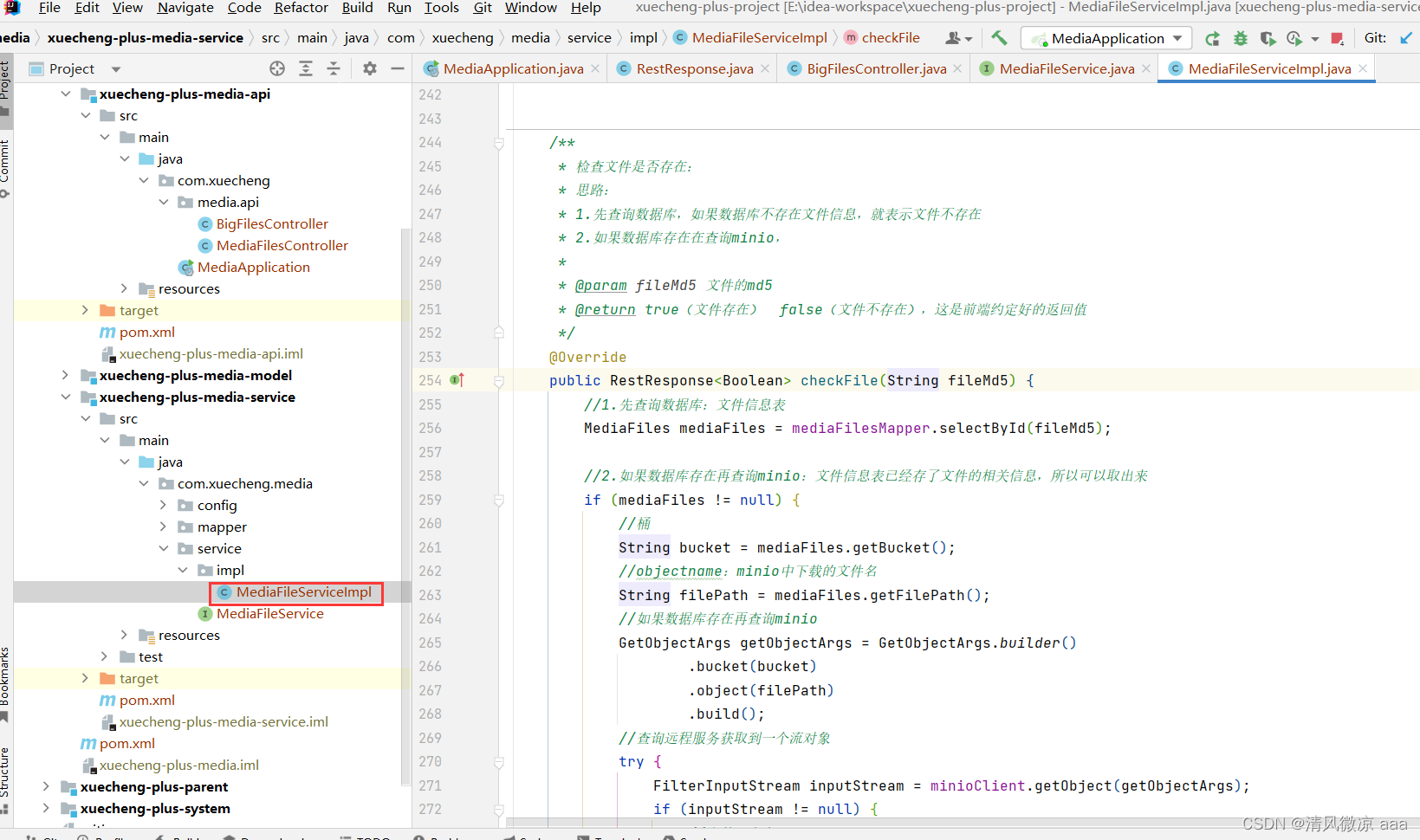

service接口实现方法:

/**

* 检查文件是否存在:

* 思路:

* 1.先查询数据库,如果数据库不存在文件信息,就表示文件不存在

* 2.如果数据库存在在查询minio,

*

* @param fileMd5 文件的md5

* @return true(文件存在) false(文件不存在),这是前端约定好的返回值

*/

@Override

public RestResponse<Boolean> checkFile(String fileMd5) {

//1.先查询数据库:文件信息表

MediaFiles mediaFiles = mediaFilesMapper.selectById(fileMd5);

//2.如果数据库存在再查询minio:文件信息表已经存了文件的相关信息,所以可以取出来

if (mediaFiles != null) {

//桶

String bucket = mediaFiles.getBucket();

//objectname:minio中下载的文件名

String filePath = mediaFiles.getFilePath();

//如果数据库存在再查询minio

GetObjectArgs getObjectArgs = GetObjectArgs.builder()

.bucket(bucket)

.object(filePath)

.build();

//查询远程服务获取到一个流对象

try {

FilterInputStream inputStream = minioClient.getObject(getObjectArgs);

if (inputStream != null) {

//文件已存在

return RestResponse.success(true);

}

} catch (Exception e) {

e.printStackTrace();

}

}

//文件不存在

return RestResponse.success(false);

}

/**

* 检查分块是否存在:

* 思路:分块信息在数据库中就不会存在,所以只需要查询分块信息是否在minio即可

*

* @param fileMd5 文件的md5

* @param chunkIndex 分块序号:分块文件名

* @return

*/

@Override

public RestResponse<Boolean> checkChunk(String fileMd5, int chunkIndex) {

//分块存储路径是:md5前2位为2个目录+MD5值目录+chunk目录+分块文件名

//根据md5得到分块文件所在目录的路径

String chunkFileFolderPath = getChunkFileFolderPath(fileMd5);

//如果数据库存在再查询minio

GetObjectArgs getObjectArgs = GetObjectArgs.builder()

.bucket(bucket_video) //配置文件注入的

.object(chunkFileFolderPath + chunkIndex) //对象名:子目录+minio中的文件名

.build();

//查询远程服务获取到一个流对象

try {

FilterInputStream inputStream = minioClient.getObject(getObjectArgs);

if (inputStream != null) {

//分块文件已存在

return RestResponse.success(true);

}

} catch (Exception e) {

e.printStackTrace();

}

//分块文件不存在

return RestResponse.success(false);

}

//得到分块文件的目录

private String getChunkFileFolderPath(String fileMd5) {

//截取md5的前两位,拼接位子目录

return fileMd5.substring(0, 1) + "/" + fileMd5.substring(1, 2) + "/" + fileMd5 + "/" + "chunk" + "/";

}

5.4.2.2 上传分块

定义service接口

/**

* 上传分块:

* @param fileMd5 文件的md5

* @param chunk 分块序号

* @param localChunkFilePath 分块文件本地路径

* @return

*/

public RestResponse uploadChunk(String fileMd5,int chunk,String localChunkFilePath);

接口实现:

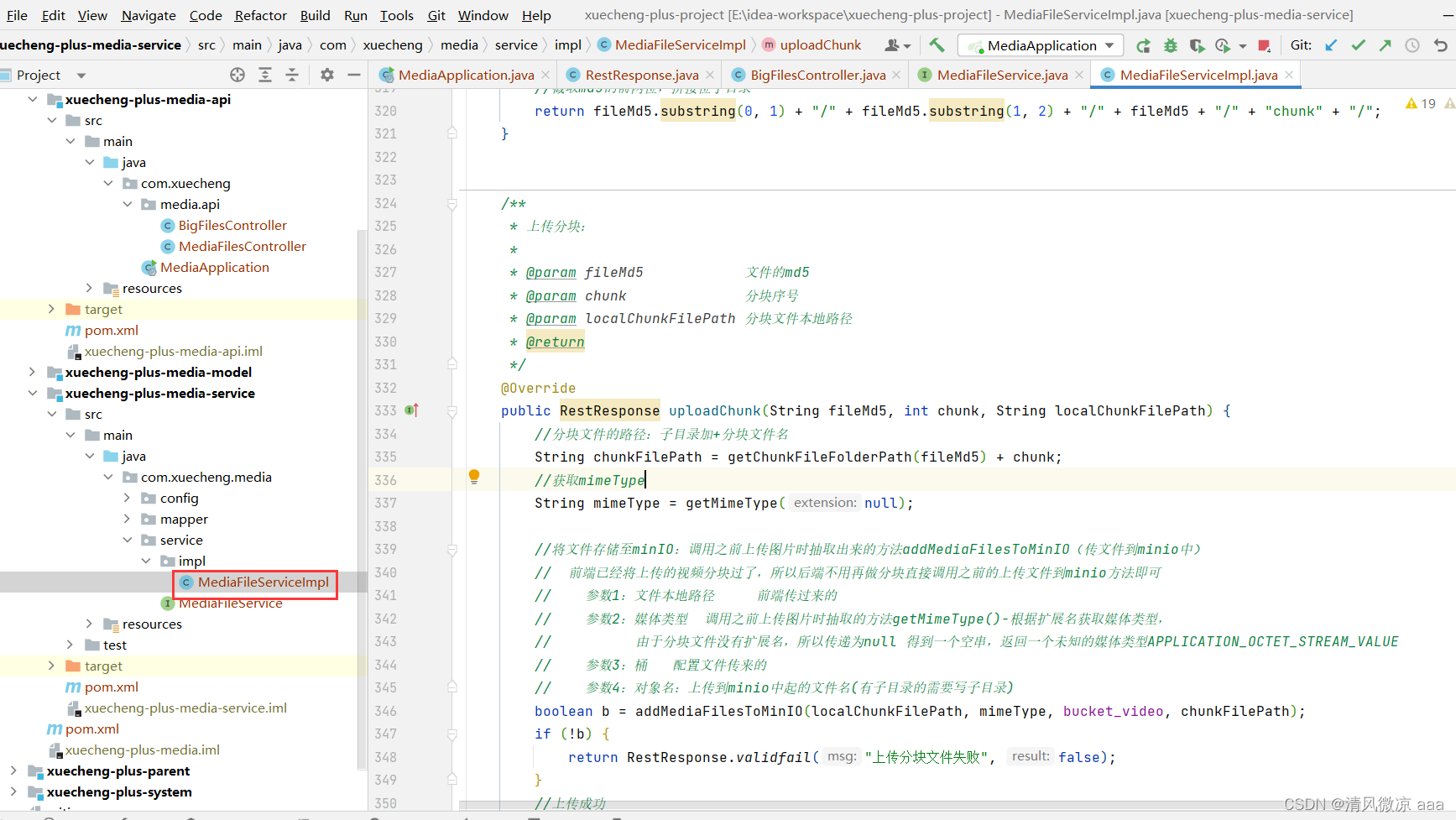

/**

* 上传分块:

*

* @param fileMd5 文件的md5

* @param chunk 分块序号

* @param localChunkFilePath 分块文件本地路径

* @return

*/

@Override

public RestResponse uploadChunk(String fileMd5, int chunk, String localChunkFilePath) {

//分块文件的路径:子目录加+分块文件名

String chunkFilePath = getChunkFileFolderPath(fileMd5) + chunk;

//获取mimeType

String mimeType = getMimeType(null);

//将文件存储至minIO:调用之前上传图片时抽取出来的方法addMediaFilesToMinIO(传文件到minio中)

// 前端已经将上传的视频分块过了,所以后端不用再做分块直接调用之前的上传文件到minio方法即可

// 参数1:文件本地路径 前端传过来的

// 参数2:媒体类型 调用之前上传图片时抽取的方法getMimeType()-根据扩展名获取媒体类型,

// 由于分块文件没有扩展名,所以传递为null 得到一个空串,返回一个未知的媒体类型APPLICATION_OCTET_STREAM_VALUE

// 参数3:桶 配置文件传来的

// 参数4:对象名:上传到minio中起的文件名(有子目录的需要写子目录)

boolean b = addMediaFilesToMinIO(localChunkFilePath, mimeType, bucket_video, chunkFilePath);

if (!b) {

return RestResponse.validfail("上传分块文件失败", false);

}

//上传成功

return RestResponse.success(true);

}

5.4.2.3 完善接口层

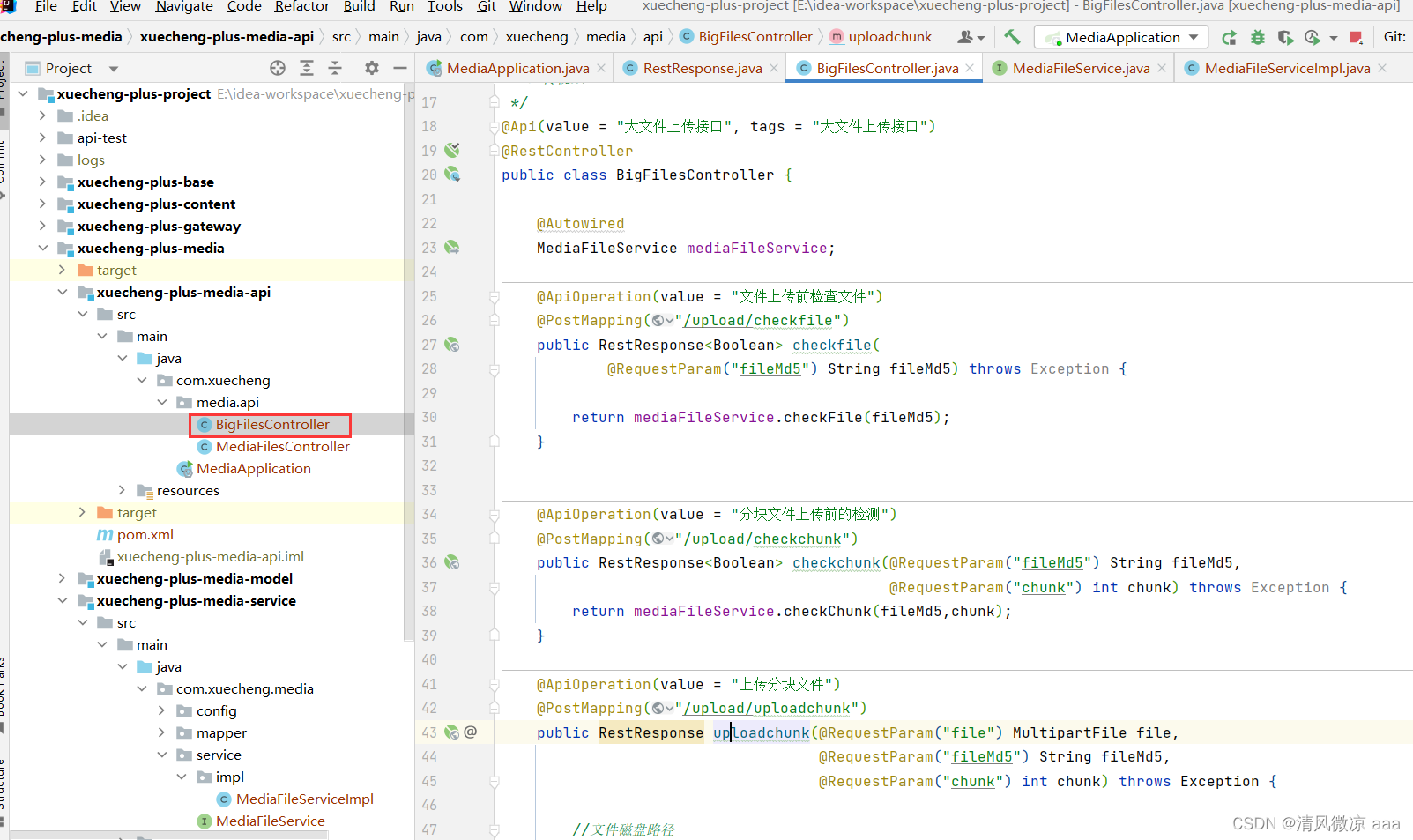

/**

* 上传视频

*/

@Api(value = "大文件上传接口", tags = "大文件上传接口")

@RestController

public class BigFilesController {

@Autowired

MediaFileService mediaFileService;

@ApiOperation(value = "文件上传前检查文件")

@PostMapping("/upload/checkfile")

public RestResponse<Boolean> checkfile(

@RequestParam("fileMd5") String fileMd5) throws Exception {

return mediaFileService.checkFile(fileMd5);

}

@ApiOperation(value = "分块文件上传前的检测")

@PostMapping("/upload/checkchunk")

public RestResponse<Boolean> checkchunk(@RequestParam("fileMd5") String fileMd5,

@RequestParam("chunk") int chunk) throws Exception {

return mediaFileService.checkChunk(fileMd5,chunk);

}

@ApiOperation(value = "上传分块文件")

@PostMapping("/upload/uploadchunk")

public RestResponse uploadchunk(@RequestParam("file") MultipartFile file,

@RequestParam("fileMd5") String fileMd5,

@RequestParam("chunk") int chunk) throws Exception {

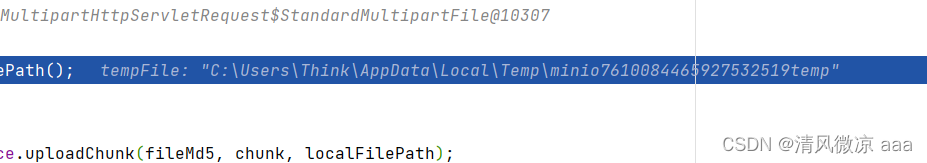

//文件磁盘路径

//创建临时文件:前缀 后缀 随便写

File tempFile = File.createTempFile("minio", "temp");

//上传的文件拷贝到临时文件

file.transferTo(tempFile);

//文件路径

String localFilePath = tempFile.getAbsolutePath();

//文件的md5 分块序号 分块文件本地路径

RestResponse restResponse = mediaFileService.uploadChunk(fileMd5, chunk, localFilePath);

return restResponse;

}

}

5.4.2.4 上传分块测试

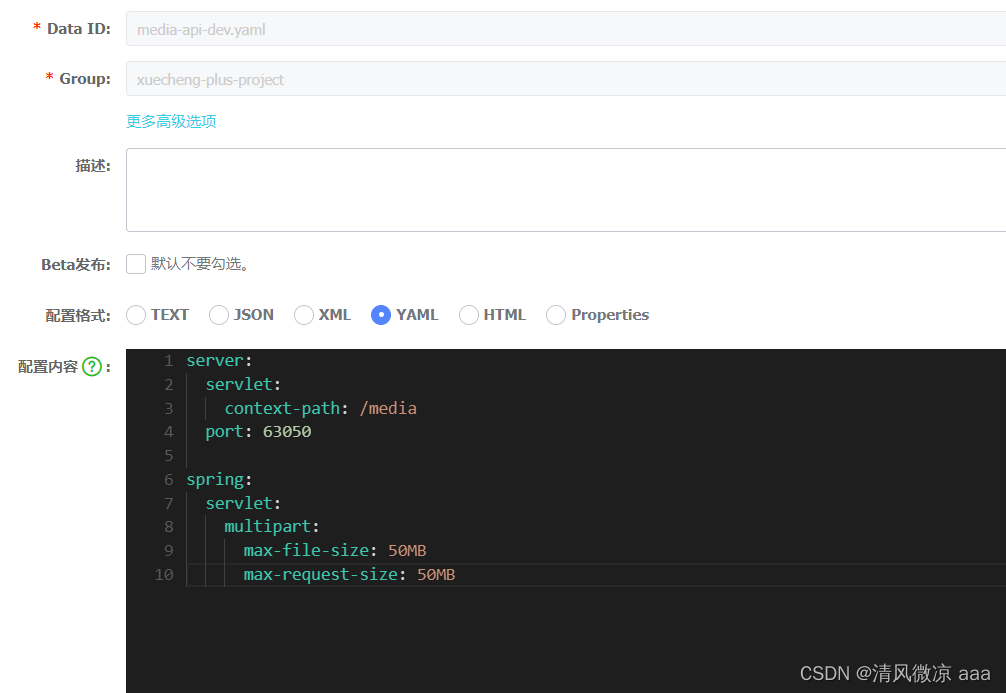

启动前端工程,进入上传视频界面进行前后端联调测试。

前端对文件分块的大小为5MB,SpringBoot web默认上传文件的大小限制为1MB,这里需要在media-api工程修改配置如下:

spring:

servlet:

multipart:

max-file-size: 50MB

max-request-size: 50MB

-

max-file-size:单个文件的大小限制

-

Max-request-size: 单次请求的大小限制

5.5 合并分块开发

5.5.1 service开发

定义service接口:

/**

* @description 合并分块

* @param companyId 机构id:需要知道那个机构传的

* @param fileMd5 文件md5:通过md5值拿到分块文件的地址

* @param chunkTotal 分块的个数

* @param uploadFileParamsDto 文件信息:用来入库

* @return com.xuecheng.base.model.RestResponse

* @author Mr.M

* @date 2022/9/13 15:56

*/

public RestResponse mergechunks(Long companyId,String fileMd5,int chunkTotal,UploadFileParamsDto uploadFileParamsDto);

service实现:

/**

* 合并分块:

* @param companyId 机构id:需要知道那个机构传的

* @param fileMd5 文件md5:通过md5值拿到分块文件的地址

* @param chunkTotal 分块的个数

* @param uploadFileParamsDto 文件信息:用来入库

* @return

*/

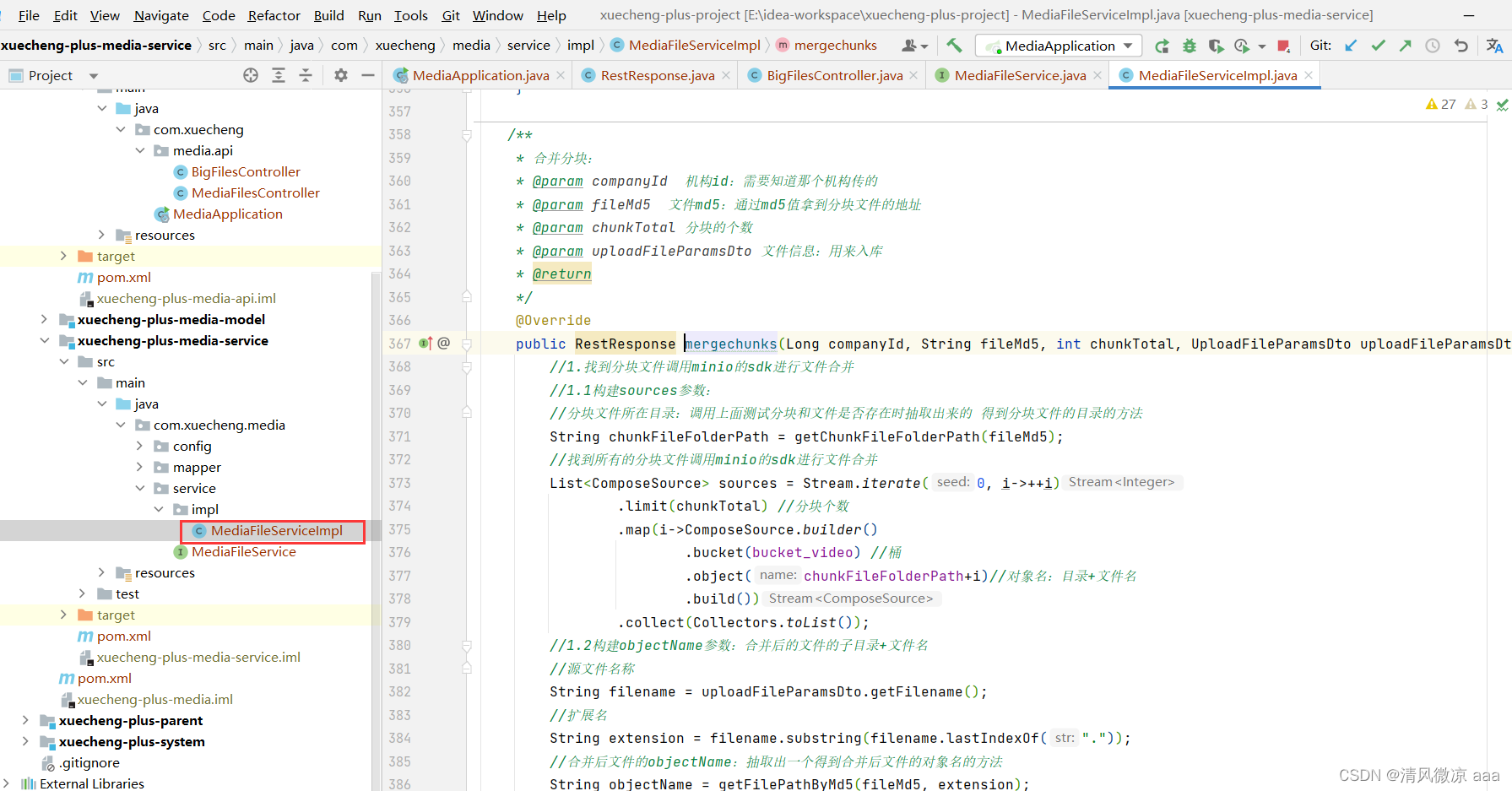

@Override

public RestResponse mergechunks(Long companyId, String fileMd5, int chunkTotal, UploadFileParamsDto uploadFileParamsDto) {

//1.找到分块文件调用minio的sdk进行文件合并

//1.1构建sources参数:

//分块文件所在目录:调用上面测试分块和文件是否存在时抽取出来的 得到分块文件的目录的方法

String chunkFileFolderPath = getChunkFileFolderPath(fileMd5);

//找到所有的分块文件调用minio的sdk进行文件合并

List<ComposeSource> sources = Stream.iterate(0, i->++i)

.limit(chunkTotal) //分块个数

.map(i->ComposeSource.builder()

.bucket(bucket_video) //桶

.object(chunkFileFolderPath+i)//对象名:目录+文件名

.build())

.collect(Collectors.toList());

//1.2构建objectName参数:合并后的文件的子目录+文件名

//源文件名称

String filename = uploadFileParamsDto.getFilename();

//扩展名

String extension = filename.substring(filename.lastIndexOf("."));

//合并后文件的objectName:抽取出一个得到合并后文件的对象名的方法

String objectName = getFilePathByMd5(fileMd5, extension);

//1.3指定合并后的objectName等信息:

ComposeObjectArgs composeObjectArgs = ComposeObjectArgs.builder()

.bucket(bucket_video) //桶

.object(objectName) //对象名:最终合并后的文件的objectName(子目录+文件名)

.sources(sources)//指定源文件

.build();

//1.4合并文件

//报错size 1048576 must be greater than 5242880 minio 默认的分块文件大小为5M

try {

minioClient.composeObject(composeObjectArgs);

} catch (Exception e) {

e.printStackTrace();

log.error("合并文件出错,bucket:{},objectName:{},错误信息:{}",bucket_video,objectName,e.getMessage());

return RestResponse.validfail("合并文件异常",false);

}

//2.校验合并后的和源文件是否一致,视频上传才成功

// 思路:比较原始文件的md5和下载到本地后文件的md5值是否一致

File file = downloadFileFromMinIO(bucket_video, objectName);

try(FileInputStream fileInputStream = new FileInputStream(file)){//流放到()里用完自动关,不用再加finally

//计算合并后文件的md5

String mergeFile_md5 = DigestUtils.md5Hex(fileInputStream);

//比较原始的md5和合并后的md5

if(!fileMd5.equals(mergeFile_md5)){

log.error("校验合并文件md5值不一致,原始文件:{},合并文件:{}",fileMd5,mergeFile_md5);

return RestResponse.validfail("文件校验失败",false);

}

//文件大小

uploadFileParamsDto.setFileSize(file.length());

} catch (Exception e) {

return RestResponse.validfail("文件校验失败",false);

}

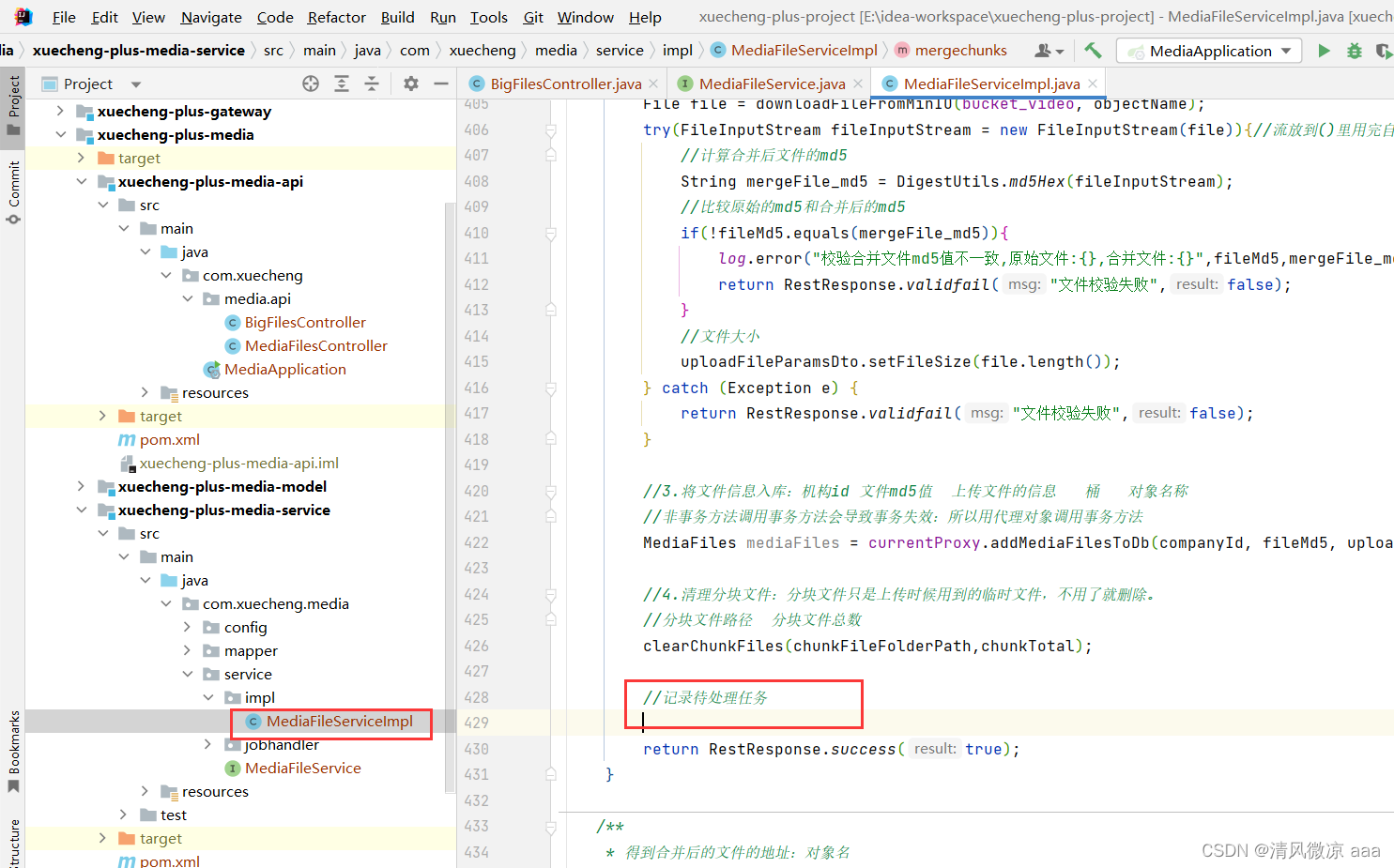

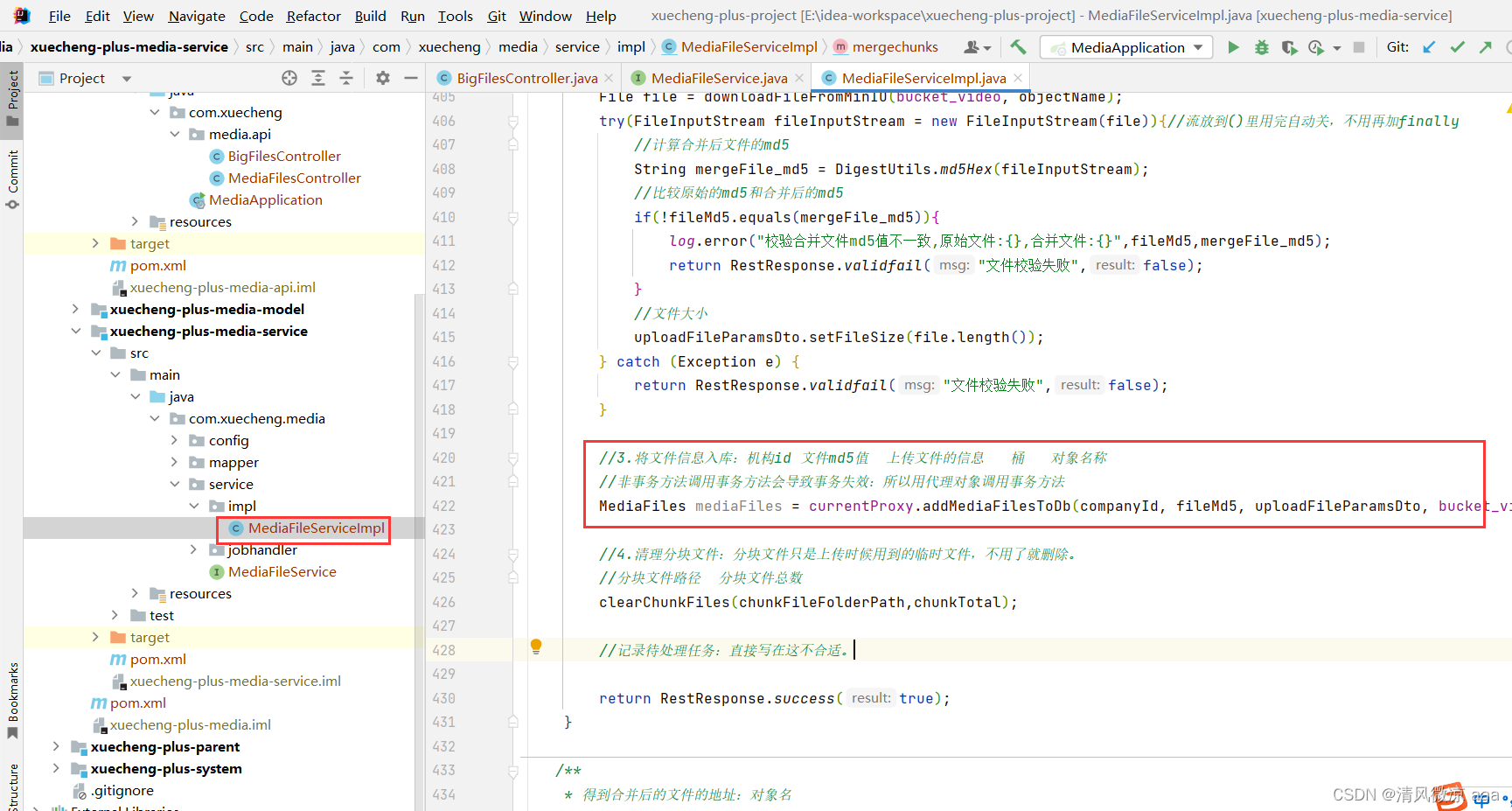

//3.将文件信息入库:机构id 文件md5值 上传文件的信息 桶 对象名称

//非事务方法调用事务方法会导致事务失效:所以用代理对象调用事务方法

MediaFiles mediaFiles = currentProxy.addMediaFilesToDb(companyId, fileMd5, uploadFileParamsDto, bucket_video, objectName);

//4.清理分块文件:分块文件只是上传时候用到的临时文件,不用了就删除。

//分块文件路径 分块文件总数

clearChunkFiles(chunkFileFolderPath,chunkTotal);

return RestResponse.success(true);

}

合并分块所调用抽取出来的方法:

//得到分块文件的目录

private String getChunkFileFolderPath(String fileMd5) {

//截取md5的前两位,拼接位子目录

return fileMd5.substring(0, 1) + "/" + fileMd5.substring(1, 2) + "/" + fileMd5 + "/" + "chunk" + "/";

}

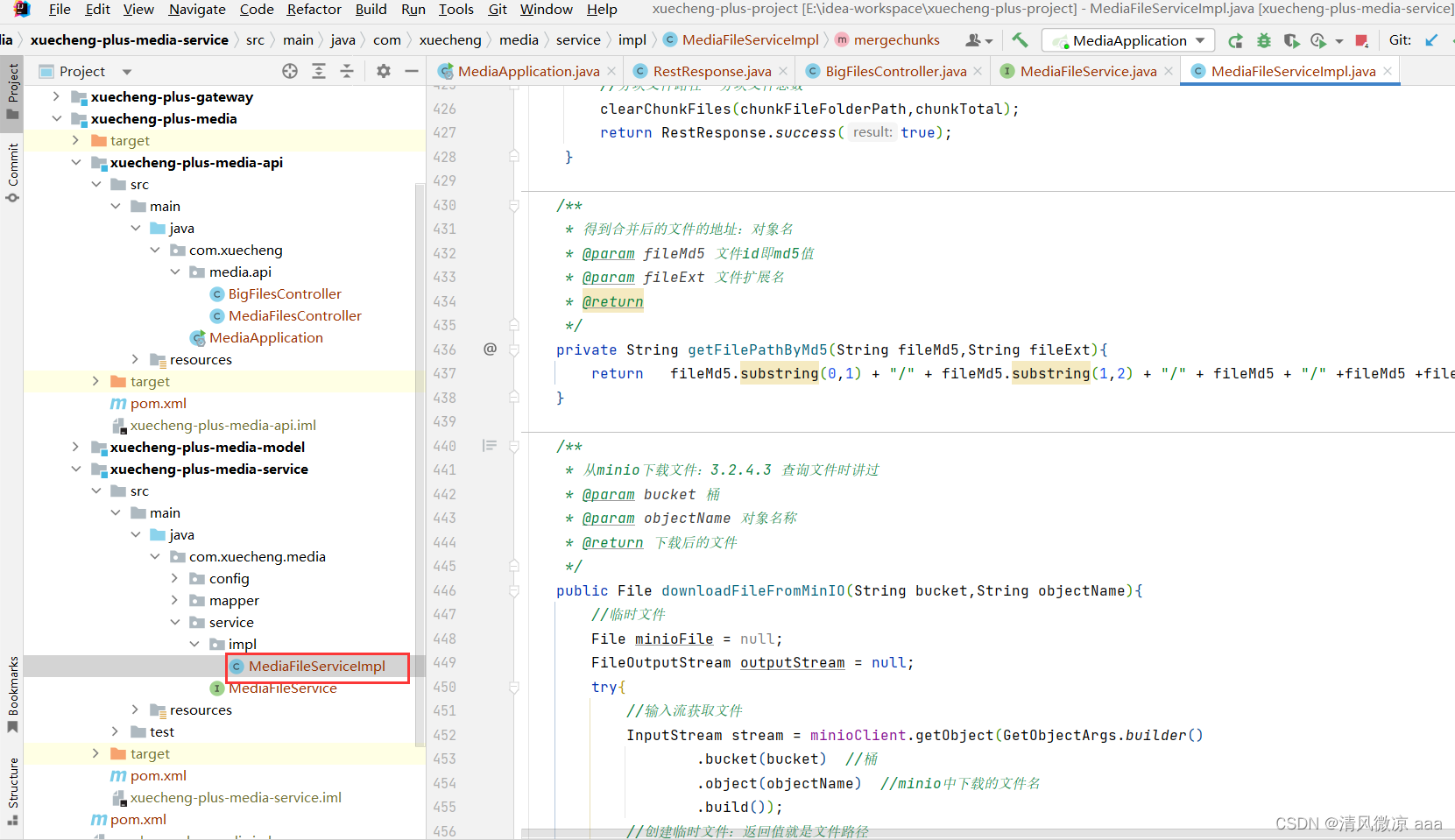

/**

* 得到合并后的文件的地址:对象名

* @param fileMd5 文件id即md5值

* @param fileExt 文件扩展名

* @return

*/

private String getFilePathByMd5(String fileMd5,String fileExt){

return fileMd5.substring(0,1) + "/" + fileMd5.substring(1,2) + "/" + fileMd5 + "/" +fileMd5 +fileExt;

}

/**

* 从minio下载文件:3.2.4.3 查询文件时讲过

* @param bucket 桶

* @param objectName 对象名称

* @return 下载后的文件

*/

public File downloadFileFromMinIO(String bucket,String objectName){

//临时文件

File minioFile = null;

FileOutputStream outputStream = null;

try{

//输入流获取文件

InputStream stream = minioClient.getObject(GetObjectArgs.builder()

.bucket(bucket) //桶

.object(objectName) //minio中下载的文件名

.build());

//创建临时文件:返回值就是文件路径

minioFile=File.createTempFile("minio", ".merge");

//指定输出流:下载的位置 注意:这是查询远程服务获取的一个流对象,远程流计算md5可能会不稳定有问题,所以需要用本地流

outputStream = new FileOutputStream(minioFile);

//流拷贝:把输入流的内容拷贝到输出流中

IOUtils.copy(stream,outputStream);

return minioFile;

} catch (Exception e) {

e.printStackTrace();

}finally {

if(outputStream!=null){

try {

outputStream.close();

} catch (IOException e) {

e.printStackTrace();

}

}

}

return null;

}

/**

* 清除minio中的分块文件

* @param chunkFileFolderPath 分块文件路径

* @param chunkTotal 分块文件总数

*/

private void clearChunkFiles(String chunkFileFolderPath,int chunkTotal) {

Iterable<DeleteObject> objects = Stream.iterate(0, i -> ++i)

.limit(chunkTotal) //分块个数

.map(i -> new DeleteObject(chunkFileFolderPath.concat(Integer.toString(i))))

.collect(Collectors.toList());

//构建参数对象

RemoveObjectsArgs removeObjectArgs = RemoveObjectsArgs.builder()

.bucket(bucket_video)

.objects(objects) //需要清理的分块文件地址

.build();

//清理文件:

Iterable<Result<DeleteError>> results = minioClient.removeObjects(removeObjectArgs);

//真正删除加下列语句

results.forEach(f -> {

try {

DeleteError deleteError = f.get();

} catch (Exception e) {

e.printStackTrace();

}

});

}

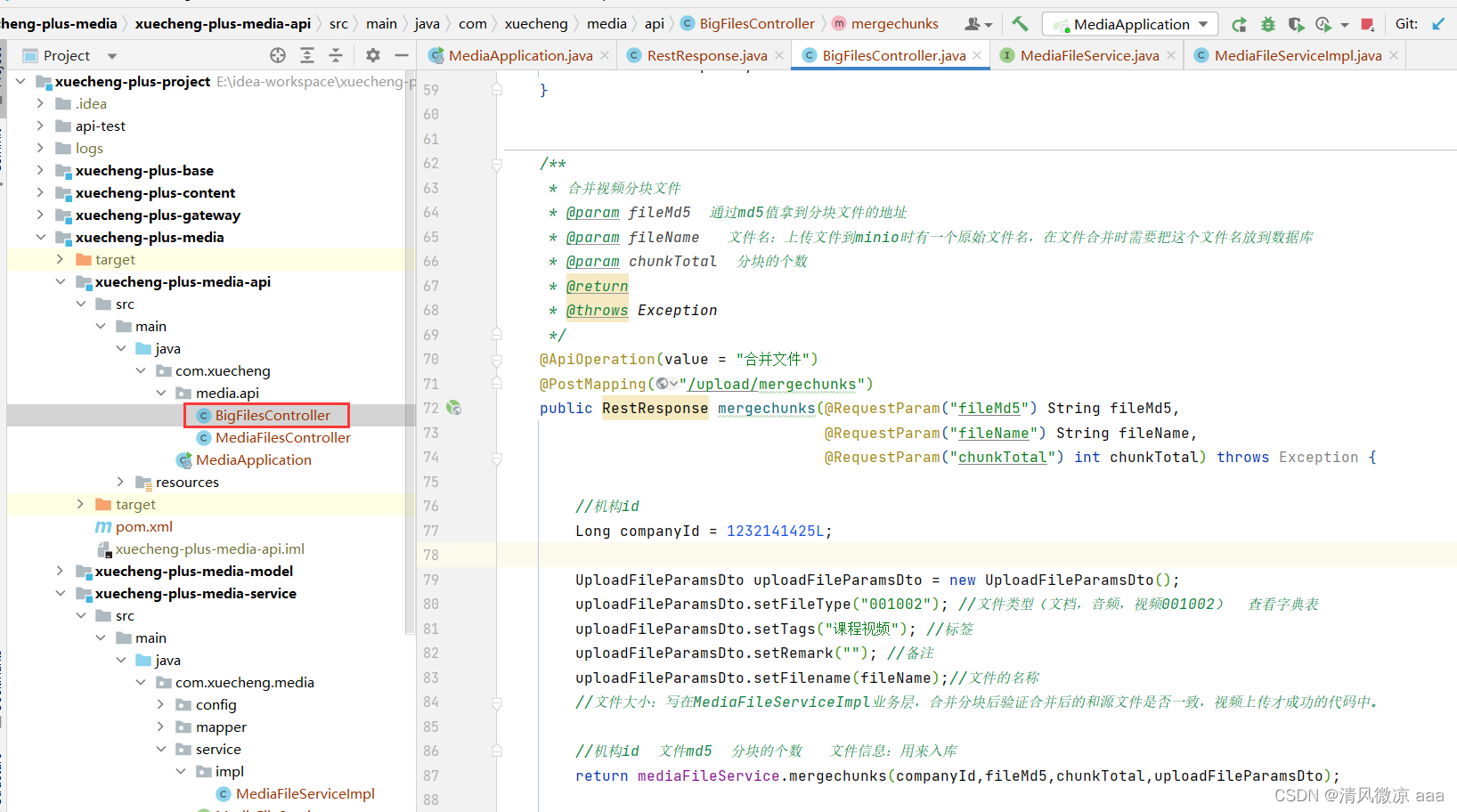

5.5.2 接口层完善

下边完善接口层

/**

* 合并视频分块文件

* @param fileMd5 通过md5值拿到分块文件的地址

* @param fileName 文件名:上传文件到minio时有一个原始文件名,在文件合并时需要把这个文件名放到数据库

* @param chunkTotal 分块的个数

* @return

* @throws Exception

*/

@ApiOperation(value = "合并文件")

@PostMapping("/upload/mergechunks")

public RestResponse mergechunks(@RequestParam("fileMd5") String fileMd5,

@RequestParam("fileName") String fileName,

@RequestParam("chunkTotal") int chunkTotal) throws Exception {

//机构id

Long companyId = 1232141425L;

UploadFileParamsDto uploadFileParamsDto = new UploadFileParamsDto();

uploadFileParamsDto.setFileType("001002"); //文件类型(文档,音频,视频001002) 查看字典表

uploadFileParamsDto.setTags("课程视频"); //标签

uploadFileParamsDto.setRemark(""); //备注

uploadFileParamsDto.setFilename(fileName);//文件的名称

//文件大小:写在MediaFileServiceImpl业务层,合并分块后验证合并后的和源文件是否一致,视频上传才成功的代码中。

//机构id 文件md5 分块的个数 文件信息:用来入库

return mediaFileService.mergechunks(companyId,fileMd5,chunkTotal,uploadFileParamsDto);

}

5.5.3 合并分块测试

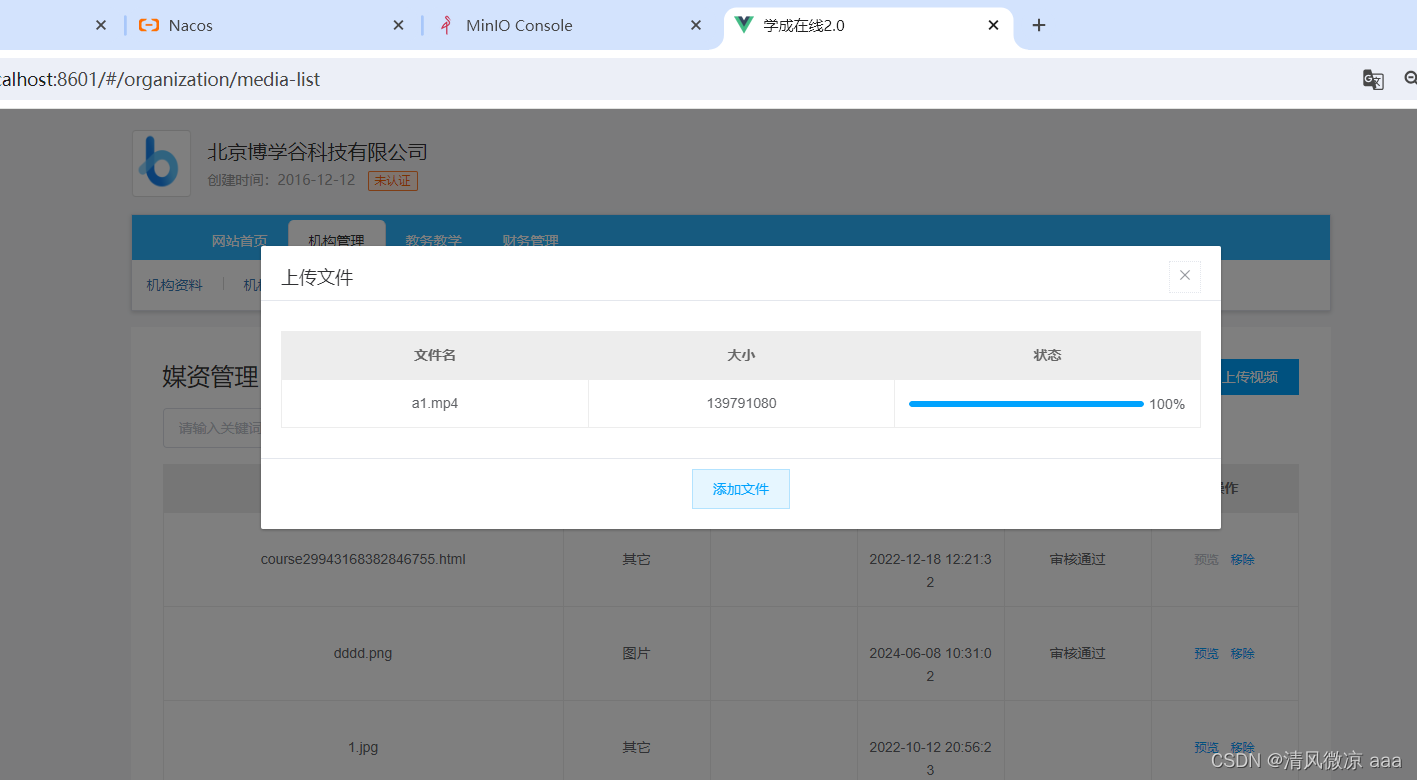

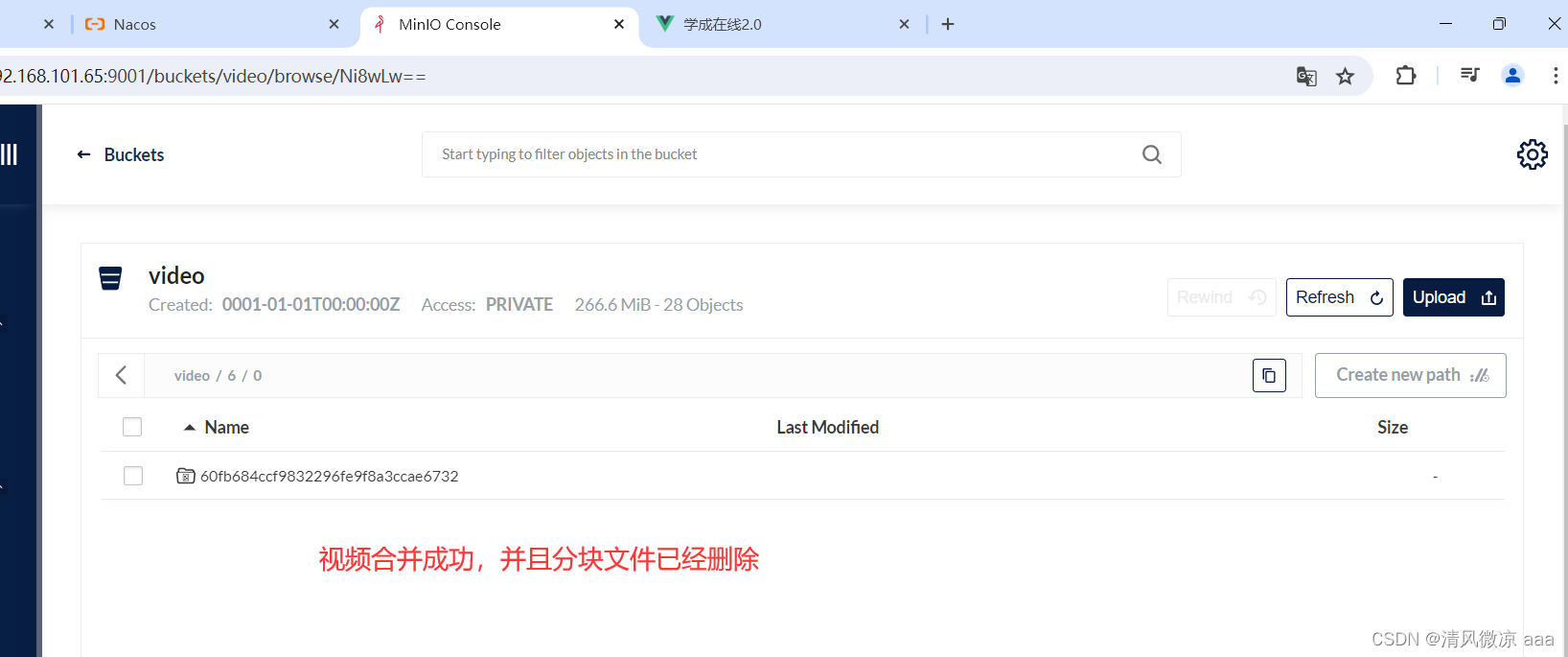

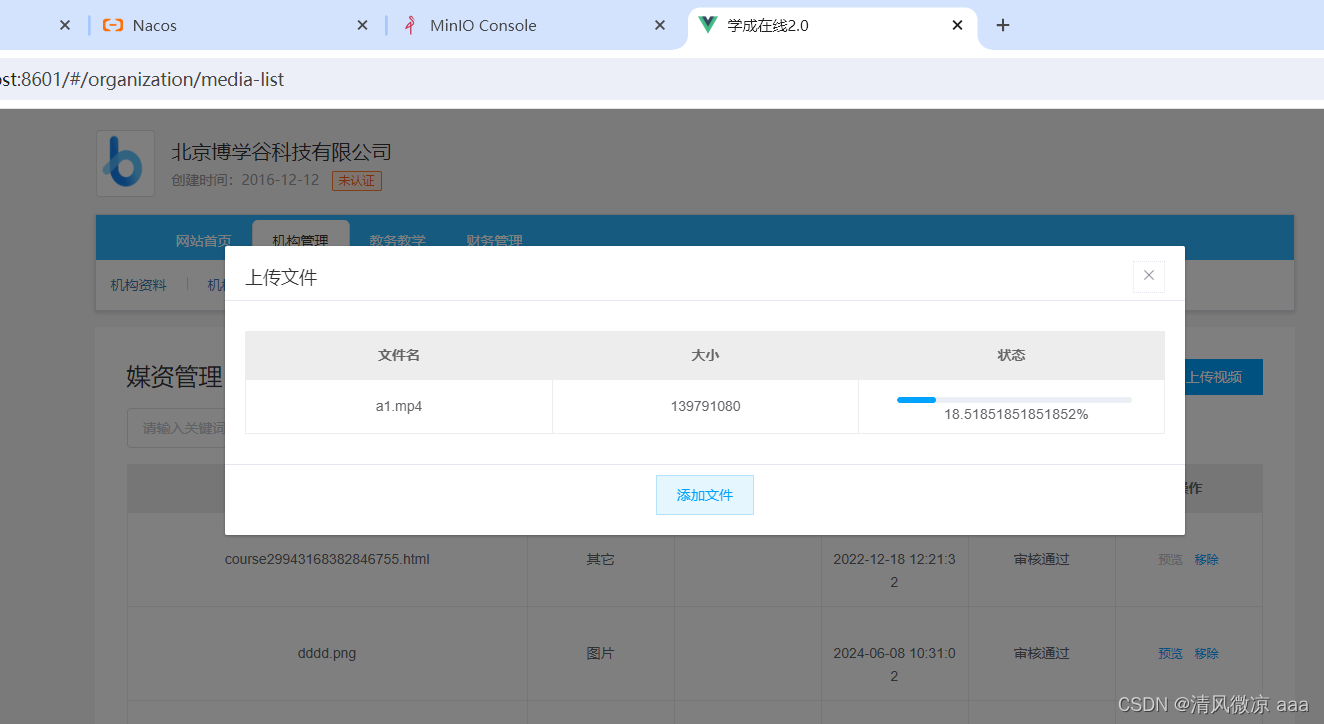

下边进行前后端联调:

1、上传一个视频测试合并分块的执行逻辑

进入service方法逐行跟踪。

2、断点续传测试

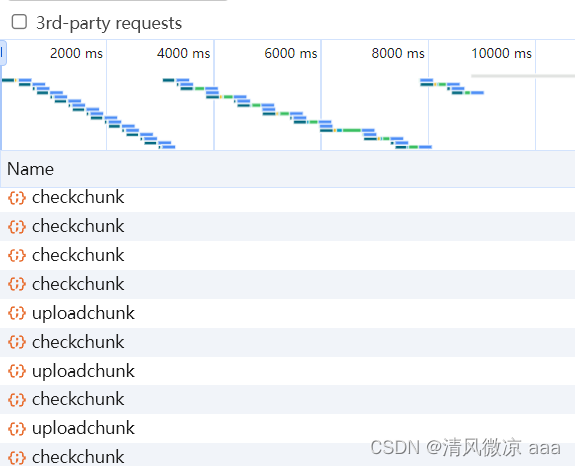

上传一部分后,停止刷新浏览器再重新上传,通过浏览器日志发现已经上传过的分块不再重新上传

上传一部分后,停止刷新浏览器

重新上传:先调用校验接口后面才调用上传接口,说明已经上传的部分不在上传。

5.6 其它问题(自己做)

5.6.1 临时文件没有删除

5.6.2 分块文件清理问题

上传一个文件进行分块上传,上传一半不传了,之前上传到minio的分块文件要清理吗?怎么做的?

1、在数据库中有一张文件表记录minio中存储的文件信息。

2、文件开始上传时会写入文件表,状态为上传中,上传完成会更新状态为上传完成。

3、当一个文件传了一半不再上传了说明该文件没有上传完成,会有定时任务去查询文件表中的记录,如果文件未上传完成则删除minio中没有上传成功的文件目录。

5.7 面试

5.7.1 什么情况事务失效

- 在方法中捕获异常没有抛出去

- 非事务方法调用事务方法

- 事务方法内部调用事务方法

- @Transactional标记的方法不是public

- 抛出的异常与rollbackFor指定的异常不匹配,默认rollbackFor指定的异常为RuntimeException

- 数据库表不支持事务,比如MySQL的MyISAM

- Spring的传播行为导致事务失效,比如:

PROPAGATION_NEVER、 PROPAGATION_ NOT_SUPPORTED- PROPAGATION_ _REQUIRED --支持当前事务,如果当前没有事务,就新建一个事务。 这是最常见的选择。

- PROPAGATION_ SUPPORTS --支持当前事务,如果当前没有事务,就以非事务方式执行。

- PROPAGATION_ MANDATORY --支持当前事务,如果当前没有事务,就抛出异常。

- PROPAGATION_ REQUIRES_ NEW --新建事务,如果当前存在事务,把当前事务挂起。

- PROPAGATION_ NOT SUPPORTED --以非事务方式执行操作,如果当前存在事务,就把当前事务挂起。

- PROPAGATION_ _NEVER --以非事务方式执行,如果当前存在事务,则抛出异常。

- PROPAGATION_ NESTED --如果当前存在事务,则在嵌套事务内执行。如果当前没有事务,则与

- PROPAGATION_ REQUIRED类似的操作。

5.7.2 断点续传怎么实现

我们是基于分块上传的模式实现断点续传的需求,当文件上传一部分断网后前边已经 上传过的不再上传。

- 前端对文件分块。

- 前端使用多线程一块一块上传,上传前给服务 端发一个消息校验该分块是否上传,如果已上传则不再上传。

- 等所有分块上传完毕,服务端合并所有分块,校验文件的完整性。

- 因为分块全部上传到了服务器,服务器将所有分块按顺序进行合并,就是写每个分块文件内容按顺序依次写入一个文件中。使用字节流去读写文件。

- 前端给服务传了一个md5值,服务端合并文件后计算合并后文件的md5是否和前端传的一样,如果一样则说文件完整,如果不一样说明可能由于网络丢包导致文件不完整,这时上传失败需要重新上传。

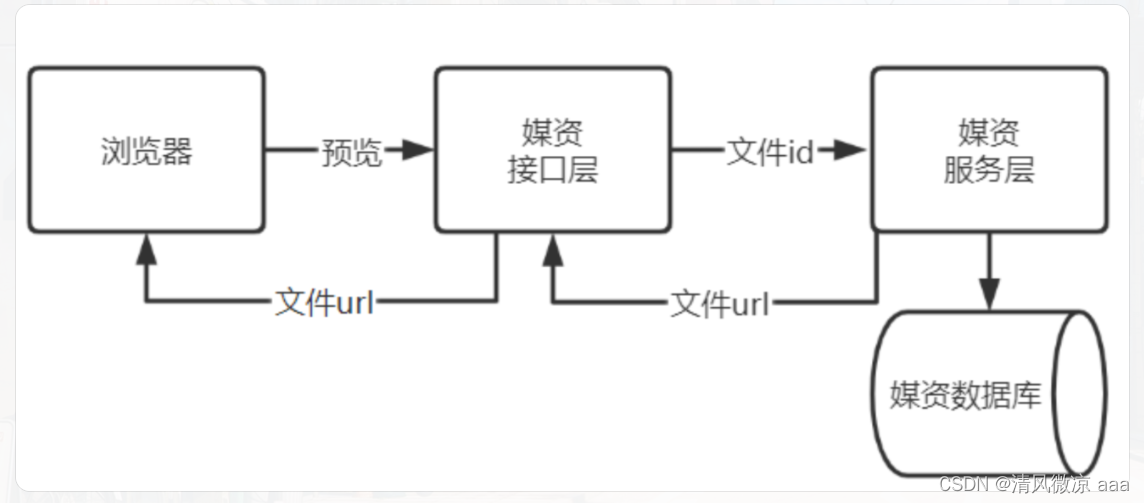

6 文件预览(待定)

6.1 需求分析

- 图片上传成功、视频上传成功后,可以通过预览按钮查看文件内容

- 预览的方式是通过浏览器直接打开文件,对于图片和浏览器支持的视频格式可以直接浏览

说明

- 前端请求接口层预览文件

- 接口层将文件id传递给服务层

- 服务层使用文件id查询媒资数据库文件表,获取文件的URL

- 接口层将文件url返回给前端,通过浏览器打开URL

6.2 接口定义

根据需求分析,定义的接口如下

@ApiOperation(value = "预览文件")

@GetMapping("/preview/{mediaId}")

public RestResponse<String> getPlayUrlByMediaId(@PathVariable String mediaId) {

return null;

}

6.3 接口开发

6.3.1 设置URL

- 有一些浏览器不支持的视频格式,不能在浏览器中直接浏览,所以我们要修改保存媒资信息到数据库的方法

- 当文件是图片时,设置URL字段

- 当视频是MP4格式时,设置URL字段

- 其他情况暂不设置URL,需要文件处理后再设置URL字段

- 修改保存媒资信息的方法

/**

* 将文件信息添加到文件表

*

* @param companyId 机构id

* @param uploadFileParamsDto 上传文件的信息

* @param objectName 对象名称

* @param fileMD5 文件的md5码

* @param bucket 桶

*/

@Transactional

public MediaFiles addMediaFilesToDB(Long companyId, UploadFileParamsDto uploadFileParamsDto, String objectName, String fileMD5, String bucket) {

// 保存到数据库

MediaFiles mediaFiles = mediaFilesMapper.selectById(fileMD5);

if (mediaFiles == null) {

mediaFiles = new MediaFiles();

BeanUtils.copyProperties(uploadFileParamsDto, mediaFiles);

mediaFiles.setId(fileMD5);

mediaFiles.setFileId(fileMD5);

mediaFiles.setCompanyId(companyId);

mediaFiles.setBucket(bucket);

mediaFiles.setCreateDate(LocalDateTime.now());

mediaFiles.setStatus("1");

mediaFiles.setFilePath(objectName);

+ // 获取源文件名的contentType

+ String contentType = getContentType(objectName);

+ // 如果是图片格式或者mp4格式,则设置URL属性,否则不设置

+ if (contentType.contains("image") || contentType.contains("mp4")) {

+ mediaFiles.setUrl("/" + bucket + "/" + objectName);

+ }

// 查阅数据字典,002003表示审核通过

mediaFiles.setAuditStatus("002003");

}

int insert = mediaFilesMapper.insert(mediaFiles);

if (insert <= 0) {

XueChengPlusException.cast("保存文件信息失败");

}

return mediaFiles;

}

6.3.2 DAO开发

使用自动生成的Mapper接口即可

6.3.3 Service开发

定义根据id查询媒资文件接口

MediaFiles getFileById(String mediaId);

方法实现

@Override

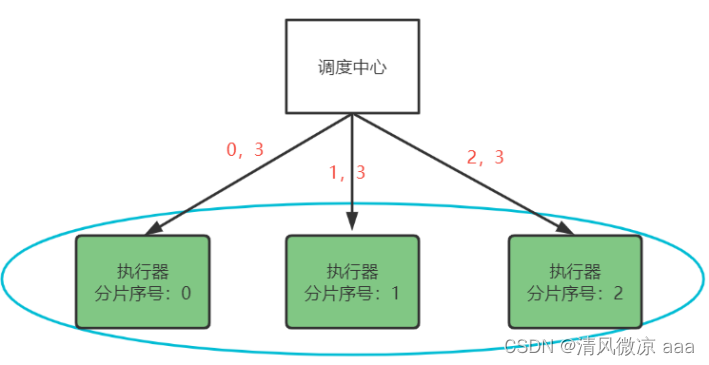

public MediaFiles getFileById(String id) {