1、回顾

VGG小卷积核:2个3 x 3的卷积核堆叠等价于1个5 x 5 感受野相同,减少训练参数, 提升特征提取的能力

2、ICS(Internal Covariate Shift)内部协变量偏移

特点:数据分布变化导致训练困难

举例:x_i=i,i = 1,2,3,Mean =2 ,Std =0.81649658,经过变换后, x_1=−1.22474487,x_2=0,x_3=1.22474487,此时Mean=0 , Std = 1

白 化:去除冗余信息,使得数据特征之间相关性较低,所有特征具有相同方差。

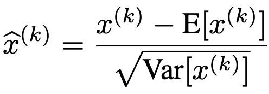

依概率论: ![]()

使X变为0均值,1标准差

3、BN层

实现缩放和平移

实现缩放和平移

![]() 恒等变换

恒等变换

削弱了网络表达能力

以FC层为例:

优点:可以用更大学习率加速模型收敛

可以不用精心设计权值初始化

可以不用dropout

可以不用正则化

可以不用LRN

4、指数滑动平均值

因为如果想要计算所有图像的均值与方差,显然不太现实,所以每次计算每个batch的方差与均值,为了使得每个batch的方差与均值尽可能的接近整体分布方差与均值的估计值,这里采用指数滑动平均值

![]()

![]()

5、 网络结构

GoogleNet-V1

GoogleNet-V2

6、结果分析

6、结果分析

关于Batchsize:

大的batch size梯度的计算更加稳定,因为模型训练曲线会更加平滑。在微调的时候,大的batch size可能会取得更好的结果。

batchsize在变得很大(超过一个临界点)时,会降低模型的泛化能力。在此临界点之下,模型的性能变换随batch size通常没有学习率敏感。

研究表明,大的batchsize性能下降是因为训练时间不够长,本质上并不少batchsize的问题,在同样的epochs下的参数更新变少了,因此需要更长的迭代次数

1398

1398

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?