吴恩达机器学习笔记(二)

标签: 机器学习

一.逻辑回归(logistic regression)

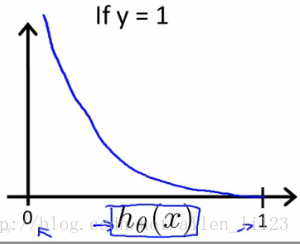

1.逻辑函数&&S型函数(logistic function and sigmoid function)

线性回归的假设表达式不试用于仅有0,1两种结果的分类表达,将表达式简单修改为逻辑函数也叫S型函数如下:

hθ(x)=g(θTx)z=θTxg(z)=11+e−z

该函数的函数图像如下

在预测时输入x变量所得的g(z)即结果为1的概率值

2.决策边界(decision boundary)

hθ(x)≥0.5→y=1hθ(x)<0.5→y=0

在S型函数中若y大于0.5边界则x必定大于0,于是:

hθ(x)=g(θTx)≥0.5whenθTx≥0

所以可以推出以下 结论!

θTx≥0⇒y=1θTx<0⇒y=0

3.代价函数(cost function)

分类问题的代价函数与回归问题的代价函数有一定的区别如下:

J(θ)=1m∑i=1mCost(hθ(x(i)),y(i))Cost(hθ(x),y)=−log(hθ(x))Cost(hθ(x),y)=−log(1−hθ(x))if y = 1if y = 0

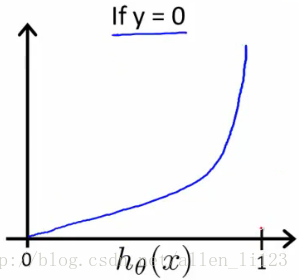

当y=1时函数图像如下

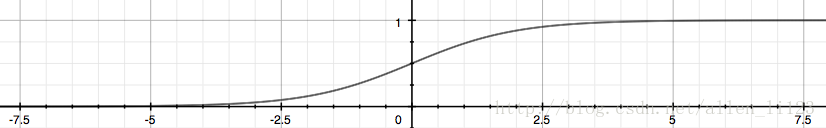

当y=0时函数图像如下

4.代价函数的简化(Simplified Cost Function)

Cost(hθ(x),y) 可以写作:

Cost(hθ(x

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?