**

第一步:下载安装Eclipse

**

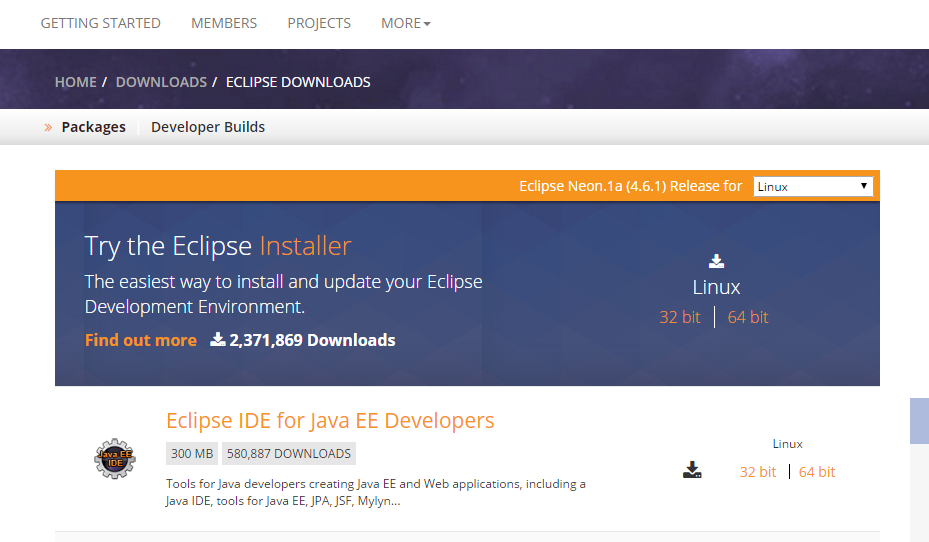

在Eclipse官网下载linux版本的eclipse。

eclipse官网下载地址:https://www.eclipse.org/downloads/eclipse-packages/?osType=linux&release=undefined

将下载的eclipse解压放到linux系统中,点击eclipse目录下的执行文件eclipse,图标如下所示:

第二部:安装hadoop-eclipse-plugin插件

下载hadoop-eclipse-plugin-2.6.0.jar插件,网址:

http://download.csdn.net/download/tondayong1981/8280995

下载后放到eclipse/plugins目录即可。

然后重启eclipse。

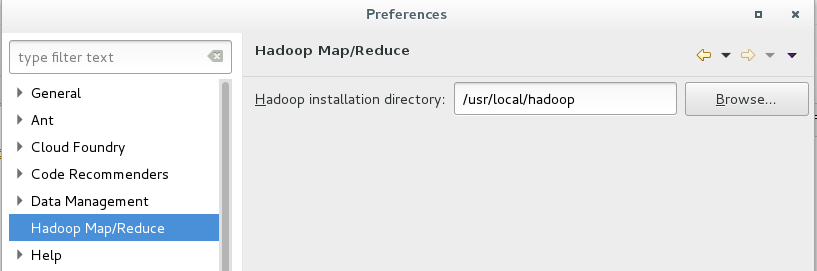

如果安装插件成功,打开eclipse的Window–>Preferens,就可以看到Hadoop Map/Reduce选项,在这个选项里你需要配置Hadoop installation directory,选择自己的hadoop安装目录。如我的hadoop安装目录是/usr/local/hadoop。配置完成后退出。 如图所示:

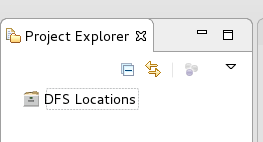

如果你在eclipse的左侧“Project Explorer”下面发现“DFS Locations”,说明Eclipse已经识别刚才放入的Hadoop Eclipse插件了。如图所示:

第三步: 配置Map/Reduce Locations

打开Windows->Perspective->Open Perspective->Other中的Map/Reduce,点击ok

在右下方看到如下图所示

点击Map/Reduce Location选项卡,点击右边小象图标(蓝色小象),打开Hadoop Location配置窗口:然后在弹出的窗口中填入Hadoop集群相关的参数,注意这里的参数必须和Hadoop的配置文件中的保持一致。

Location name和Host填写localhost;

Map/Reduce Master的端口必须和maped-site.xml的参数保持一致,这里填写9001;

DFS Master填写HDFS的NameNode端口号,必须和core-site.xml中的HDFS配置端口号保持一致,这里填写9000;

用户名为Hadoop的所有者用户名,即安装Hadoop的linux用户。

点击”Finish”按钮,关闭窗口。会看到所配置的Hadoop,点击左侧的DFS Locations,可以浏览HDFS中的文件

至此,开发Hadoop应用程序的MapReduce eclipse IDE环境搭建成功

注意:需要启动hadoop

cd /usr/local/hadoop

./sbin/start-all.sh

hadoop启动后才可以连接DFS Locations

参考:Eclipse下搭建Hadoop2.4.0开发环境

http://www.cnblogs.com/kinglau/p/3802705.html

5133

5133

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?