1、信息熵

首先我们来介绍一下信息熵(entropy)的概念,它表示了信息的不确定度。

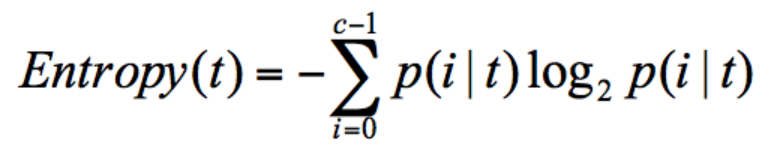

在信息论中,随机离散时间出现的概率存在着不确定性,为了衡量这种信息的不确定性,信息学之父香农引入了信息熵的概念,并给出了计算信息熵的数学公式:

p(i|t) 代表了节点 t 为分类 i 的概率,其中 log2 为取以 2 为底的对数。这里我们不是来介绍公式的,而是说存在一种度量,它能帮我们反映出来这个信息的不确定度。当不确定性越大时,它所包含的信息量也就越大,信息熵也就越高。

举个简单的例子,假设有2个集合:

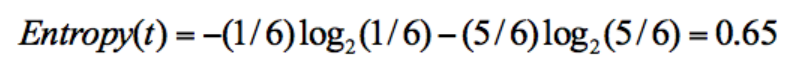

集合1:5次去打篮球,1次不去打篮球

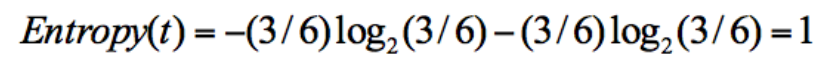

集合2:3次去打篮球,3次不去打篮球。

集合1计算信息熵为:

集合2也同理可得:

从上面的计算结果中可以看出,信息熵越大,纯度越低。当集合中的所有样本均匀混合时,信息熵最大,纯度最低。

2、ID3算法

ID3 算法计算的是信息增益,信息增益

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5893

5893

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?