k近邻学习是一种常用的监督学习方法,也是很常用的分类器

工作机制:给定测试样本,基于某种距离度量找出训练集中与其最靠近的k个训练样本,然后基于这k个最靠近的信息来进行预测

(1)KNN算法用于分类:

图中绿色的点是我们要预测的

设k=3,那么KNN算法就会找到与它距离最近的三个点,就是第一个圆圈圈起来的3个,看看哪种类型的多一些,图中被算法选中的3个点中,有两个是红色三角形,一个蓝色正方形,所以绿色的点就归类到红色三角形了

设k=5,那么离绿色待测点最近的5个点就是被虚线圈住的5个点(3个蓝色正方形和2个红色三角形)所以蓝色占的比例为3/5,因此绿色的待分类点属于正方形类别

算法实现代码如下:

需求:输入一个二维坐标,根据已有的坐标以及对应的类型,对输入值进行分类

from numpy import * # 科学计算包

import operator # 运算符模块

def classify0(in_x, data_set, labels, k):

# shape函数是numpy中的函数,它的功能是读取矩阵的长度,如shape[0]就是读取矩阵的第一维度

data_set_size = data_set.shape[0] # 得到数据集(矩阵)的行数目

diff_mat = tile(in_x, (data_set_size, 1)) - data_set

# tile()会生成关于in_x的data_set_size大小的array

# 如in_x=[1,0.3],data_set_size=4,则原式等于tile([1,0.3],(4,1)) 结果:([[1,0.3],[1,0.3],[1,0.3],[1,0.3]])

# 将上诉数组与data_set:[[1.0, 1.1], [1.0, 1.0], [0, 0], [0, 0.1]]相减

# 得:diff_mat=[[0,-0.8],[0,-0.7],[1,0.3],[1,0.2]]

sq_diff_mat = diff_mat**2 # 对数组进行平方运算 结果:[[0,0.64],[0,0.49],[1,0.09],[1,0.04]]

sq_distance = sq_diff_mat.sum(axis=1)

# axis=1,是对array每个二维数组成员进行求和(行求和),如果是sxis=0,就是列求和

# 求和结果: [0.641 0.49 1.09 1.04]

distance = sq_distance**0.5 # 对距离的开根号 结果:[0.8 0.7 1.04403065 1.0198039 ]

sorted_dist_in_dic = distance.argsort() # 函数argsort()返回数组从小到大的索引值 结果:[1 0 3 2]

class_count = {}

# 定义字典,存放类型 A和B,它们的值是在前k个距离最小的数据集中的个数,本例最后class_count={'A':1,'B':2}

for i in range(k):

vote_i_label = labels[sorted_dist_in_dic[i]]

class_count[vote_i_label] = class_count.get(vote_i_label, 0)+1

# get函数返回字典的键值,由于后面加了1,所以每次出现键值就加1,就可以算出键值出现的次数

sorted_class_count = sorted(class_count.items(), key=operator.itemgetter(1), reverse=True)

# 通过sorted函数将class_count字典分解为列表,sorted函数的第二个参数导入了运算符模块的itemgetter方法,按照第

# 二个元素的次序(即数字)进行排序,由于此处reverse=true,是逆序,所以按照从大到小的次序排列

return sorted_class_count[0][0]

group = array([[1.0, 1.1], [1.0, 1.0], [0, 0], [0, 0.1]])

labels = ['A', 'A', 'B', 'B']

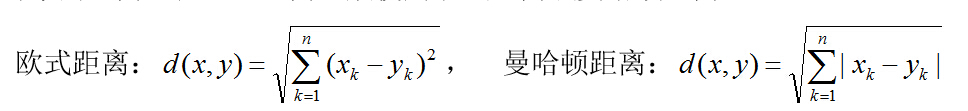

print(classify0([1.0, 0.3], group, labels, 3))上面代码中,使用欧式距离公式来求两坐标点之间的距离

运行结果:

(2) KNN算法用于回归

KNN算法不仅可以用于分类,也可以用于回归。

分类模型和回归模型本质一样,分类模型是将回归模型的输出离散化。

一般来说,回归问题通常是用来预测一个值,如预测房价、未来的天气情况等,如:一个产品的实际价格为500元,通过回归分析预测值为499元,我们认为这是一个比较好的回归分析。回归是对真实值的一种逼近预测。

通过找出一个样本的k个最近邻居,将这些邻居的某个属性的平均值赋给该样本,就可以得到该样本对应属性的值。

下面分享一下回归预测的代码实现(没有调用sklearn库)

555

555

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?