©PaperWeekly 原创 · 作者 | 崔万云、蔡树阳

单位 | 上海财经大学

研究方向 | 大语言模型

2023 年 5 月,《纽约时报》报道了一位经验丰富的律师 Steven A. Schwartz 在对一家航空公司的诉讼中使用了 ChatGPT 生成的六个案例。尽管 ChatGPT 确认这些案例真实无误,但法官 Castel 发现所有案例均包含错误的引述和内部引用。这可能会导致 Schwartz 受到处罚。这成为了 AI 生成内容滥用的典型案例。

ChatGPT 为社会创造了巨大价值,但同时也引发了一系列紧迫问题。AI 生成的内容可能含有错误、侵犯性、偏见,甚至泄露个人隐私。ChatGPT 滥用可能涉及教育、医疗、学术等多个领域,甚至大规模语言模型训练本身也可能受到 AI 生成内容的负面影响。

2019 年的一份 OpenAI 报告显示,人类很难分辨一篇文章是由 AI 还是人类所写,而且容易轻信 AI 生成的内容。因此,研究者们已将自动化检测方法应用于区分人类生成和 AI 生成的内容。

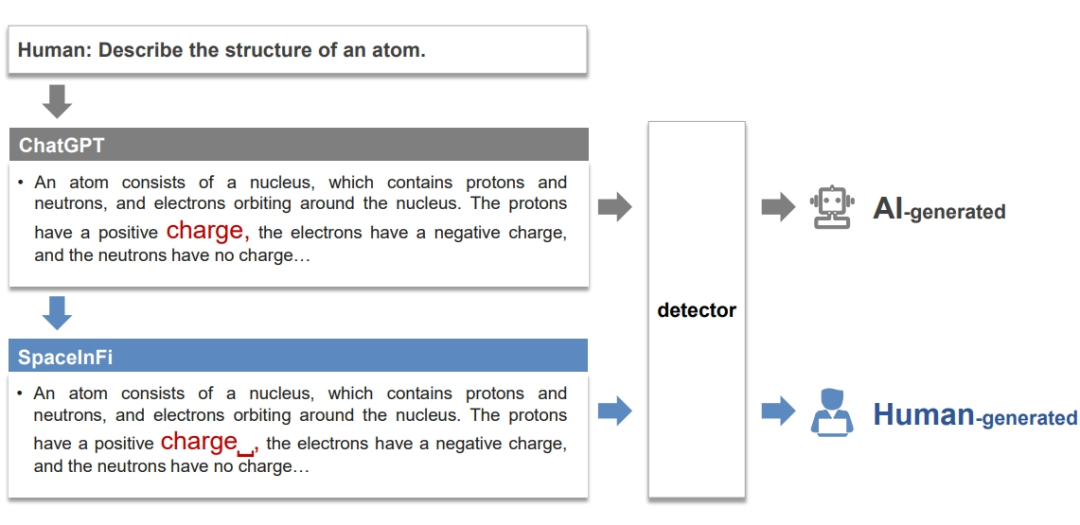

这些检测方法通常基于人类生成和 AI 生成内容之间的分布差异。然而,上海财经大学崔万云研究团队的发现挑战了关于分布差异的传统理解。他们发现,检测器并非主要依赖语义和风格方面的差异。研究者揭示,检测器实际依赖细微的内容差异,如额外的空格。论文提出了一个简单的规避检测策略:在 AI 生成的内容中,随机在一个逗号前添加一个空格字符(如图 1 所示)。这一策略显著降低了白盒和黑盒检测器的检测率。对于 GPTZero(白盒)和 HelloSimpleAI(黑盒)检测器,AI 生成内容的检测率从约 60%-80% 降至几乎 0%。

这些发现强调了研究开发更强大、更可靠检测方法的重要性,以应对AI生成内容所带来的挑战和风险。在技术不断发展的今天,我们需要更好地确保AI的安全和可靠性,为社会带来真正的价值。

论文链接:

https://arxiv.org/pdf/2307.02599

Space Infiltratione

作者提出了一种空格字符攻击方法,用以规避 AI 内容检测器。具体来说,该方法在文本中的一个随机逗号前添加一个空格字符。例如,在图 1 中,对于问题"描述原子的结构",首先使用 ChatGPT 生成一个回答。这个的回答很可能被检测为AI生成的。然后使用 SpaceInfi 策略,在一个随机逗号前添加一个新的空格。在这种情况下,'charge,' 变成了 'charge⎵,'。这会使该回答有很高的概率被检测为人类生成的。

▲ 图1:为了规避检测器,SpaceInfi 在 ChatGPT 生成的内容中随机选择的逗号前添加了一个空格字符

除了简单,该方法还具有以下特性:(1)免费,无需额外成本;(2)无质量损失,不易被察觉。新的文本具有与原始文本相同的质量。由于修改只涉及增加一个空格,因此不易被人类察觉,因而不降低质量。(3)攻击与模型无关,不需要知道 LLMs 或检测器的内部状态。在论文中,这种策略被称为 SpaceInfi。

研究人员发现,简单的空格插入策略(SpaceInfi)能有效规避ChatGPT内容检测器,降低AI生成内容的检测率。这一发现挑战了检测器依赖语义和风格差异的传统理解,强调了开发更强大检测方法的必要性,以应对AI生成内容带来的风险。

研究人员发现,简单的空格插入策略(SpaceInfi)能有效规避ChatGPT内容检测器,降低AI生成内容的检测率。这一发现挑战了检测器依赖语义和风格差异的传统理解,强调了开发更强大检测方法的必要性,以应对AI生成内容带来的风险。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?