©PaperWeekly 原创 · 作者 | 周峰

单位 | 中国人民大学统计学院

本文介绍了中国人民大学统计学院的一篇关于贝叶斯小样本分类加速收敛的文章“Accelerating Convergence in Bayesian Few-Shot Classification”,本文被 ICML 2024 接收,代码已经开源。

论文标题:

Accelerating Convergence in Bayesian Few-Shot Classification

论文链接:

https://arxiv.org/abs/2405.01507

代码链接:

https://github.com/keanson/MD-BSFC

背景

小样本分类(Few-shot classification, FSC)关注于在仅有少量带有类标签的训练样本的情况下对新数据进行分类。当收集训练样本具有挑战性或对数据进行标注成本高昂时,这种方法尤其有用。

在这种情况下,标签数据的稀缺性引入了模型参数的不确定性,通常称为认知不确定性。有效管理认知不确定性有助于对模型进行正则化,降低过拟合的风险。此外,在风险规避型应用如医疗诊断和自动驾驶中,这种不确定性在评估信心度方面起着关键作用。

贝叶斯框架通过对模型参数引入先验分布并基于观测数据使用贝叶斯定理计算后验分布,提供了一种捕捉认知不确定性的自然方法。近年来,将贝叶斯方法应用于小样本学习的研究显著增加。利用贝叶斯框架的优势,一些最新研究在小样本分类(FSC)中采用高斯过程(GPs),在准确性和不确定性量化方面表现出竞争力。

方法

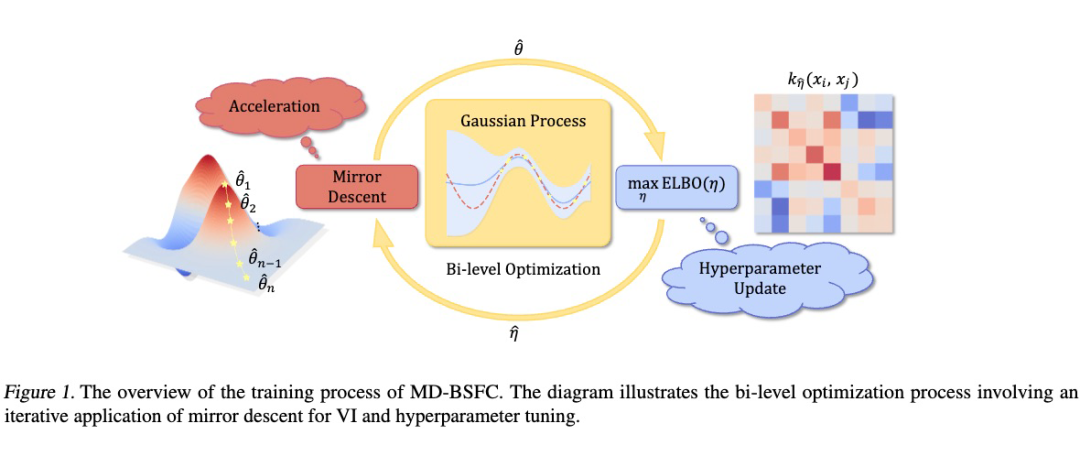

对于高斯过程分类,贝叶斯推断由于非高斯似然与高斯过程先验非共轭,导致精确的后验计算不可行,提出了挑战。为了解决这个问题,本文将基于镜像下降的变分推断应用于基于 GP 的 FSC 中,而无需引入任何辅助变量。因此,该方法被命名为基于镜像下降的贝叶斯小样本分类(MD-BFSC)。

在该方法中,变分推断的优化通过共轭计算实现。特别地,镜像下降利用非欧几里得几何,提供沿相应流形的最速下降方向,从而提高收敛速度。它还表现出关于变分分布的参数化不变性。

具体来说,本文引入基于镜像下降的变分推断到基于 GP 的 FSC 中,从而将非共轭推断转化为具有共轭计算的优化问题。MD-BFSC 提供了沿相应非欧几里得流形的最速下降方向,增强了收敛速度,并保持了对变分分布参数化的不变性。该方法在标准 FSC 基准上实现了具有竞争力的分类准确性和不确定性量化,并与小样本基线模型相比展示了更快的收敛速度。

实验

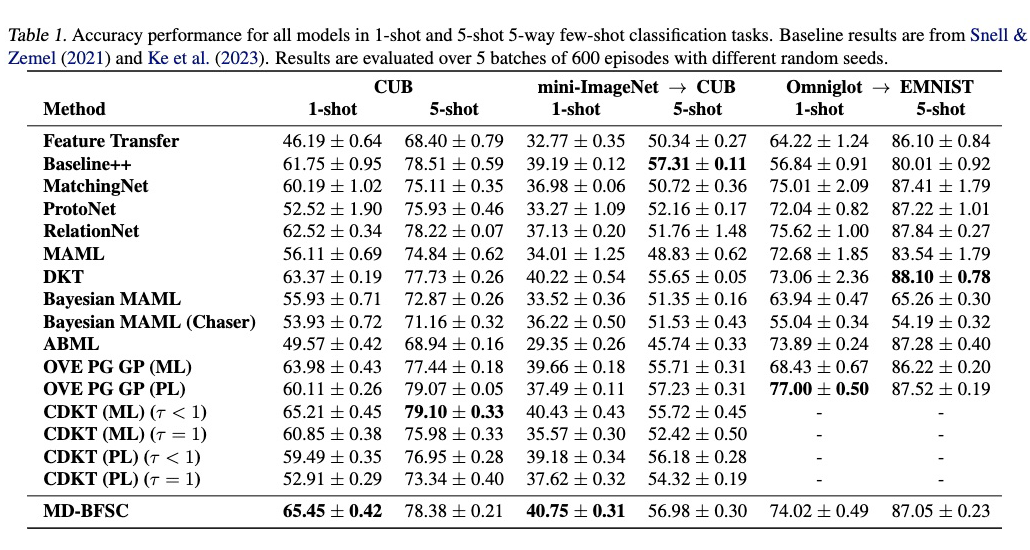

(1)准确性

下表报告了使用不同随机种子在实验中评估模型的平均准确率和标准差。作者提出的模型在 CUB 数据集(域内)和 CUB mini-ImageNet 数据集(跨域)的 1-shot 实验中取得了最高的准确率,分别为 65.45% 和 40.75%。对于其他数据集和设置,作者提出的模型也达到了接近最优或可比的结果。该方法的主要优势在于理论上的快速收敛,但是实验中也发现其分类准确率与最先进的模型是相当的,这表明其在快速学习之外的实用性。

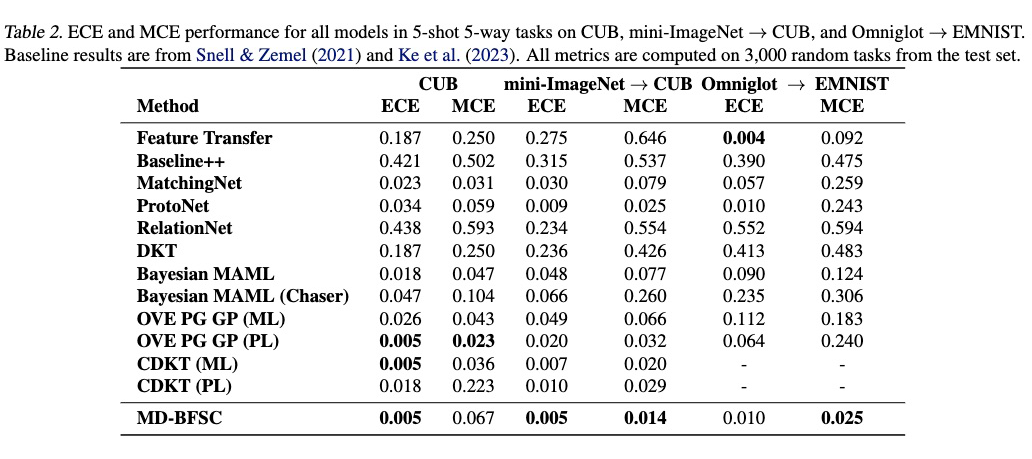

(2)不确定性

不确定性的量化采用了两种广泛使用的指标:期望校准误差(ECE)和最大校准误差(MCE)。测试集上的 ECE 和 MCE 在 5-shot 实验中的汇总结果见下表。

具体来说,在 CUB 数据集(域内)和 mini-ImageNet CUB 数据集(跨域)上取得了最低的 ECE 值(均为 0.005),以及在 mini-ImageNet CUB 数据集(跨域)和 Omniglot EMNIST 数据集(跨域)上取得了最低的 MCE 值(分别为 0.014 和 0.024)。总体结果突显了其在不确定性校准方面的显著可靠性,从而展示了在小样本场景中的良好鲁棒性。

(3)收敛速度

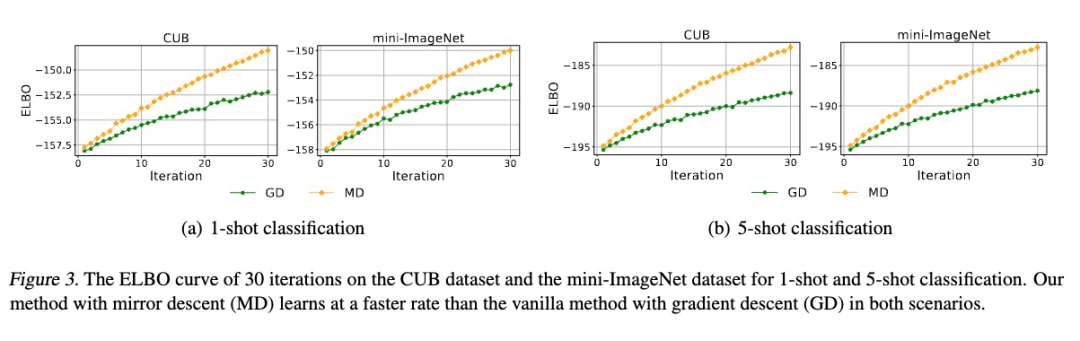

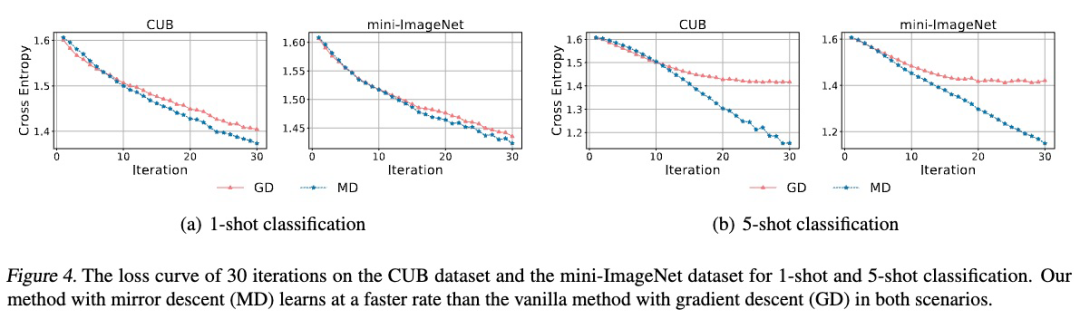

作者将 MD-BSFC 与采用完全相同变分分布但其内循环变分推断通过普通梯度下降实现的方法进行比较。作者将双层优化解耦为两部分:固定核和神经网络的超参数以检查内循环收敛情况,以及通过完整的双层优化检查外循环收敛情况。

内循环收敛:所有的变分参数采用相同的初始化方案,内循环固定学习率 0.005,并运行每种方法 30 步。收敛结果见下图。经验观察结果与理论分析一致:在 1-shot 和 5-shot 情境下,MD-BSFC 的 ELBO 增长速度均快于普通方法。这归因于 MD-BSFC 在内循环中采用了二阶优化,而普通方法使用了一阶优化。

外循环收敛:对于完整的双层收敛实验,作者使用较大的学习率(1-shot 为 0.1,5-shot 为 0.02),内循环运行 2 步。外循环使用 Adam 优化器,学习率为 0.001。同样运行每种方法 30 次外循环更新,并绘制交叉熵损失。结果见下图。在 5-shot 分类情境下,MD-BSFC 取得了显著领先,在 1-shot 分类中也具有略高的收敛速度。

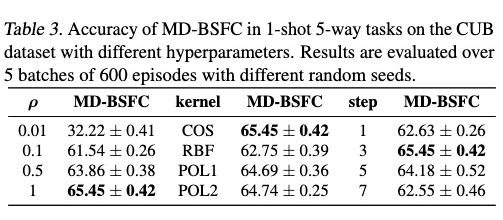

(4)超参数

作者研究了方法在不同超参数设置下的鲁棒性,包括不同的内循环步长 、各种核函数和内循环的不同步数。结果如下表所示。内循环步长 控制单个自然梯度步的更新速度,较大的 导致更好的性能,而对于极小的 ,模型性能欠佳。

这种现象可能是由于较大的步长有助于逃离非凸损失函数的鞍点。各种基核的性能相近,对于较平滑的核(例如 RBF 核),性能有下降的趋势。同时作者探讨了不同内循环更新步数的影响,作者发现 3 步内循环是更优的,这一现象背后的原因是过少的内循环步数无法有效更新模型参数,而较大的步数可能会影响梯度流令模型更容易陷入局部最优点。

结论

MD-BSFC 通过解决高斯过程分类中非共轭推断的挑战,为贝叶斯少样本分类做出了贡献。此外,通过镜像下降引入的非欧几里得几何在理论上和经验上都证明了对提高收敛速度的有效性。实验结果强有力地支持了作者提出方法的有效性,在多个基准数据集上实现了与基线模型相比具有竞争力的分类准确率和不确定性量化。此外,作者对模型内各种超参数和组件的系统探索提供了见解,有助于了解它们对性能的影响。

更多阅读

#投 稿 通 道#

让你的文字被更多人看到

如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢?答案就是:你不认识的人。

总有一些你不认识的人,知道你想知道的东西。PaperWeekly 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。

PaperWeekly 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是最新论文解读,也可以是学术热点剖析、科研心得或竞赛经验讲解等。我们的目的只有一个,让知识真正流动起来。

📝 稿件基本要求:

• 文章确系个人原创作品,未曾在公开渠道发表,如为其他平台已发表或待发表的文章,请明确标注

• 稿件建议以 markdown 格式撰写,文中配图以附件形式发送,要求图片清晰,无版权问题

• PaperWeekly 尊重原作者署名权,并将为每篇被采纳的原创首发稿件,提供业内具有竞争力稿酬,具体依据文章阅读量和文章质量阶梯制结算

📬 投稿通道:

• 投稿邮箱:hr@paperweekly.site

• 来稿请备注即时联系方式(微信),以便我们在稿件选用的第一时间联系作者

• 您也可以直接添加小编微信(pwbot02)快速投稿,备注:姓名-投稿

△长按添加PaperWeekly小编

🔍

现在,在「知乎」也能找到我们了

进入知乎首页搜索「PaperWeekly」

点击「关注」订阅我们的专栏吧

·

·

·

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?