1、机器规划:

机器1:(hadoop-senior01.test.com)机器2:(hadoop-senior02.test.com)机器3:(hadoop-senior.test.com)

NameNode DataNode DataNode

DataNode ResourceManager(RM) SecondarNameNode

NodeManager(NM) NodeManager(NM) NodeManager(NM)

2、克隆服务器

vmware克隆/复制虚拟机目录

注:机器2/3的MAC地址重新生成(设置->网络适配器->高级->生成)

3、修改网卡并配置

1>修改网卡

vim /etc/udev/rules.d/70-persistent-net.rules

将之前的eth-0删除,将新的mac地址对应的eth1编程eth0

2>静态ip

3>设置主机名

4>配置主机与ip的映射关系

4、ntp时间服务器同步

/etc/sysconfig/ntpd文件添加SYNC_HWCLOCK=yes

/etc/ntp.conf文件配置

取消注释:

1>作用

同步三个服务器时间,让服务器时间一直

注:机器1当成时间服务器,机器2/3同步机器1时间

2>机器1上配置ntp时间

vim /etc/syscconfig/ntpd

SYNC_HWCLOCK=yes

vim /etc/ntp.conf

#server xxx

server 127.127.1.0

fudge 127.127.1.0 xxx

restrict 192.168.160.0 xxxx

3>机器1重启ntp服务器

service ntpd restart

4>机器1设置时间

date -s yyyy-MM-dd

date -s HH:mm:ss

5>机器2/3同步时间

手动同步:

/usr/sbin/ntpdate<主机名>

定时同步:

定时任务(crontab -e):0-59/10****/usr/sbin/ntpdate<主机名>

6、hadoop配置文件

1>core-site.xml

namenode访问地址

2>hdfs-site.xml

secondarynamenode访问地址

3>yarn-site.xml

resourcenamenode访问地址

4>slaves文件

从节点的主机名

分布式环境搭建

配置core-site.xml文件

<property>

<name>fs.default.name</name>

<value>hdfs://master:9000</value>

</property>

配置hdfs-site文件

<property>

<name>dfs.namenode.secondary.http-address</name>

<value><主机名>:9001</value>

</property>

配置yarn-site.xml文件

<property>

<name>yarn.resourcemanager.hostname</name>

<value><主机名></value>

</property>

配置$HADOOP_HOME/etc/hadoop/slaves文件

hadoop-senior01.test.com

hadoop-senior01.test.com

hadoop-senior03.test.com

注:拷贝scp -r etc/hadoop root@hadoop-senior.test.com:opt/module/hadoop-2.6.0

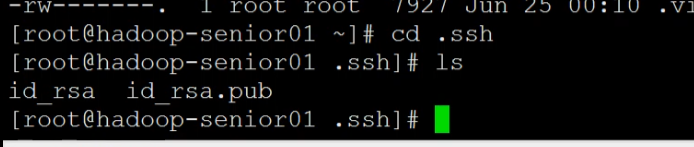

7、SSH免密码登录(因为每次启动都要输入密码)

输入cd ~

/root目录下游一个.ssh文件,没有需要自己输入

生成公钥/私钥对

ssh-keygen -t rsa

拷贝公钥至远程主机或本机authorized_keys文件

ssh-copy-id<主机名>

重复格式化会产生不一致,如何查看是否被格式化了

hadoop-2.6.0/tmp//hadoop-root/dfs/name/current/Version

查看集群ID是否一致

3808

3808

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?