1.准备一台CentOs机器,安装好jdk环境;

2.做节点的免秘钥登录:

1.ssh登录当前节点: ssh localhost ,默认会提示输入节点的密码,输入密码登录即可;

登录后 ll -a 可以看到 .ssh目录。执行如下命令:

ssh-keygen -t dsa -P '' -f ~/.ssh/id_dsa

cat ~/.ssh/id_dsa.pub >> ~/.ssh/authorized_keys

ssh localhost 可直接登录当前节点。

3. xftp上传hadoop压缩包,并解压到/opt 目录下,并配置hadoop环境变量;

4.继续配置 /hadoop-2.6.5/etc/hadoop 下的 hadoop-env.sh,mapred-env.sh,yarn-env.sh文件中的JAVA_HOME 目录;

将默认的JAVA_HOME路径修改为本机 JAVA_HOME目录;

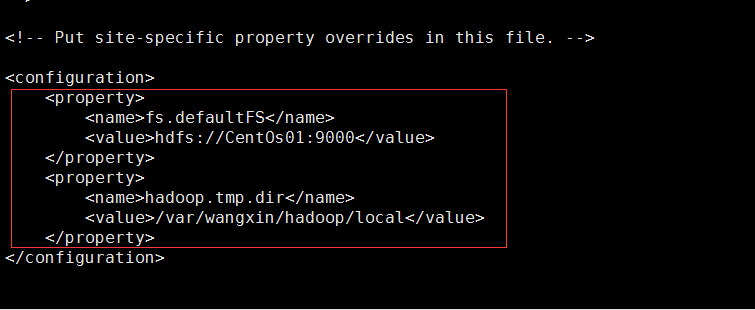

5.修改core-site.xml文件;

6.修改hdfs-site.xml

7.修改slaves文件

slaves文件配置hadoop集群的节点信息,伪分布式要求为单节点,配置为本节点别名即可;

8.格式化namenode

hdfs namenode -format

9.启动集群;

start-dfs.sh

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?