一、提出任务

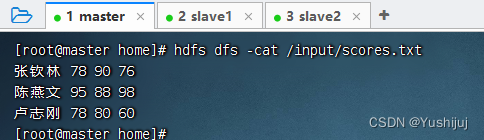

- 成绩表,包含四个字段(姓名,语文,数学,英语),只有三条记录

二、完成任务

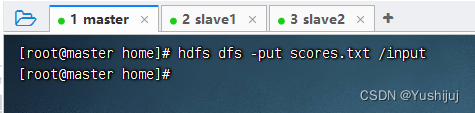

(一)将成绩文件上传到HDFS

- 执行命令: hdfs dfs -put scores.txt /input

- 查看成绩文件内容

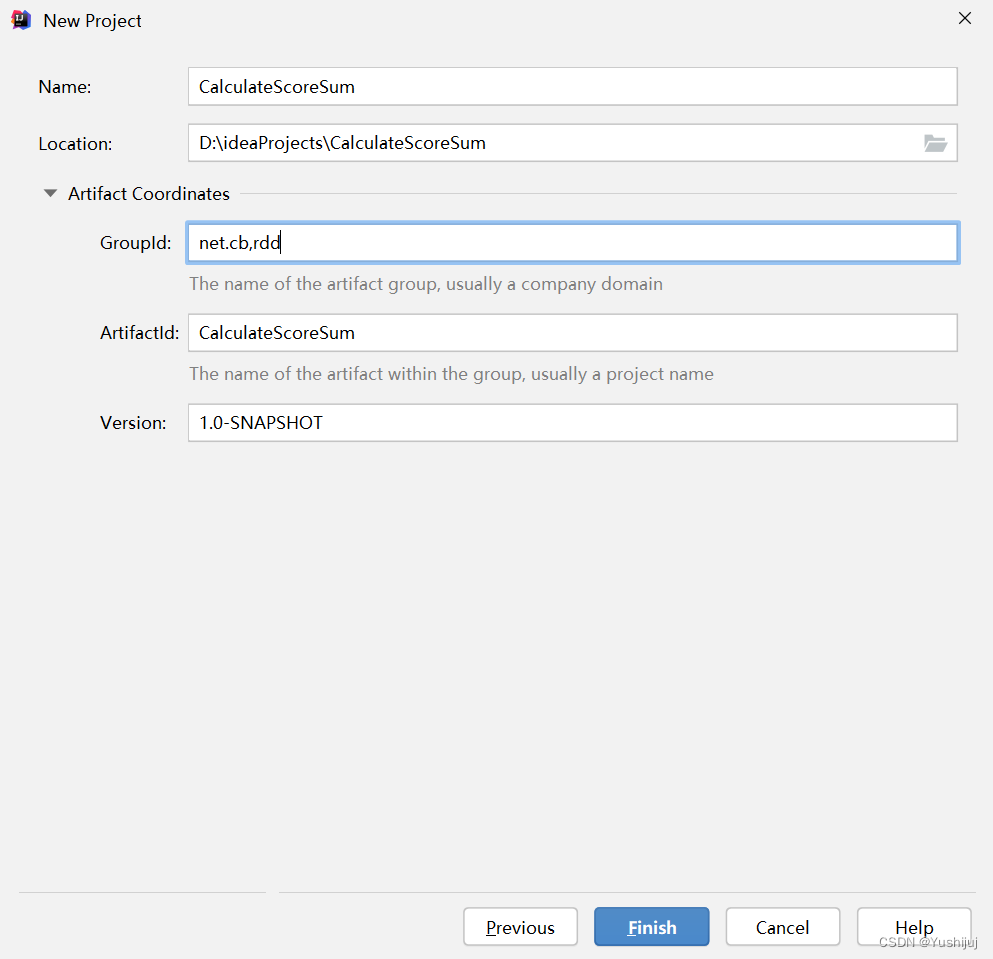

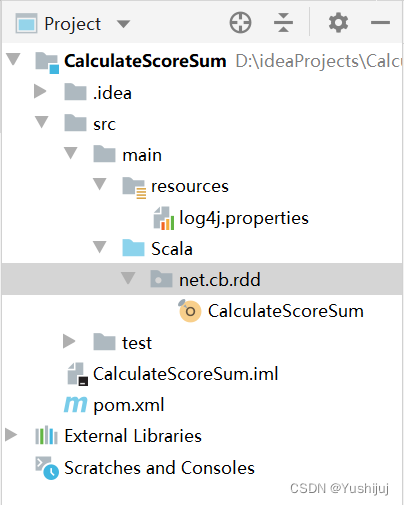

(二)创建Maven项目

- 创建Maven项目 - CalculateScoreSum

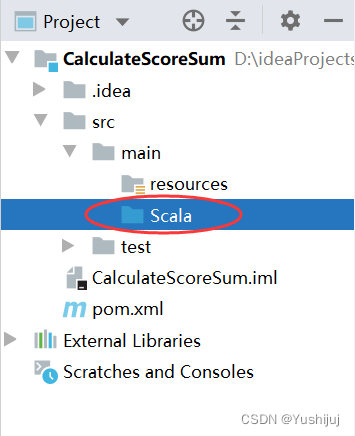

- 将JAVA 目录改成Scala目录

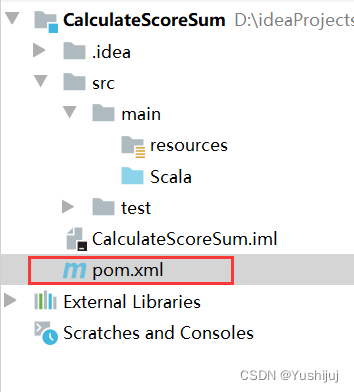

(三)添加依赖和构建插件

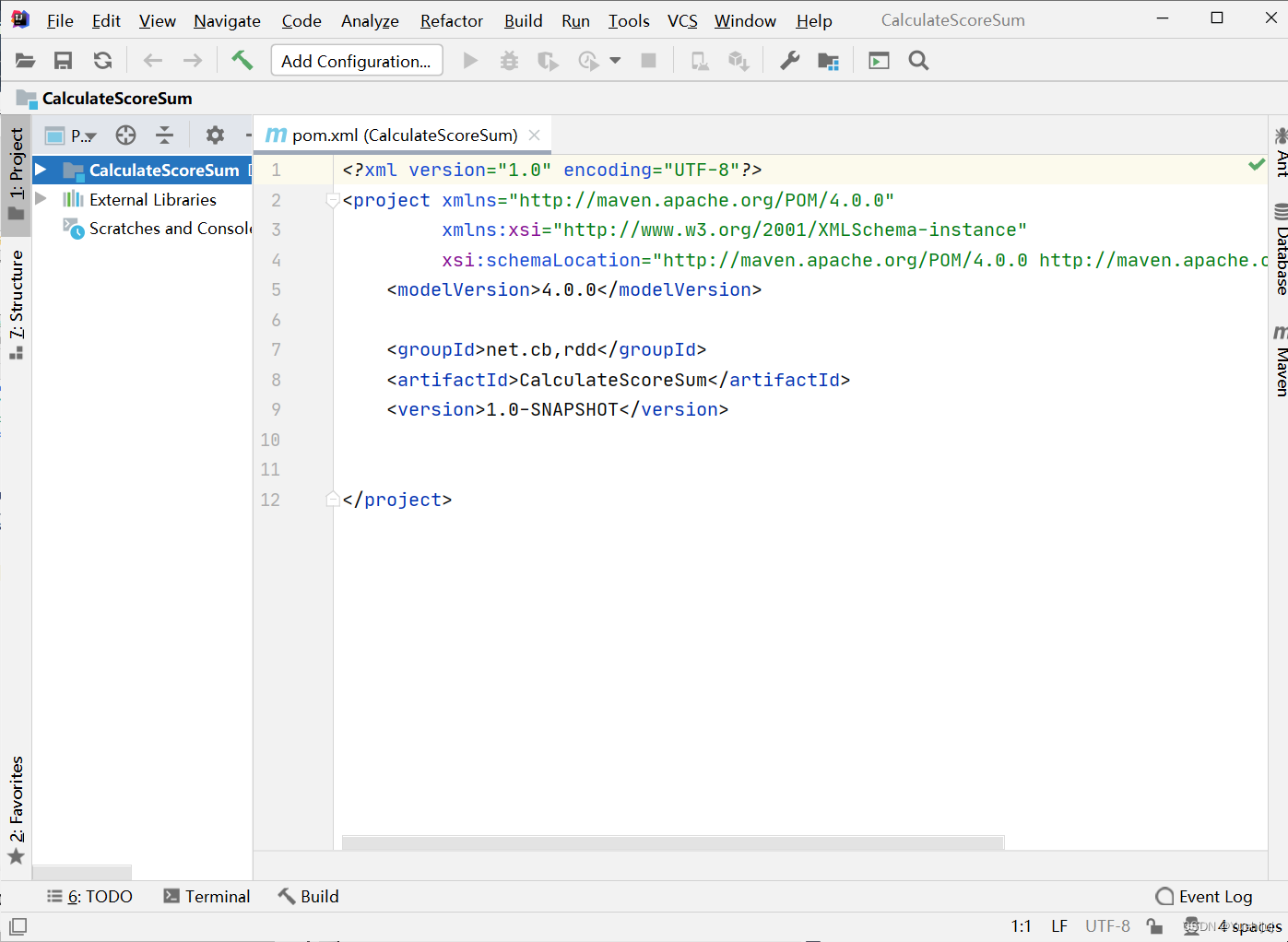

- 在 pom.xml 文件里添加依赖和构建插件

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0

http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>net.cb.rdd</groupId>

<artifactId>CalculateScoreSum</artifactId>

<version>1.0-SNAPSHOT</version>

<dependencies>

<dependency>

<groupId>org.scala-lang</groupId>

<artifactId>scala-library</artifactId>

<version>2.12.15</version>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-core_2.12</artifactId>

<version>2.4.4</version>

</dependency>

</dependencies>

<build>

<sourceDirectory>src/main/scala</sourceDirectory>

<plugins>

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-assembly-plugin</artifactId>

<version>3.3.0</version>

<configuration>

<descriptorRefs>

<descriptorRef>jar-with-dependencies</descriptorRef>

</descriptorRefs>

</configuration>

<executions>

<execution>

<id>make-assembly</id>

<phase>package</phase>

<goals>

<goal>single</goal>

</goals>

</execution>

</executions>

</plugin>

<plugin>

<groupId>net.alchim31.maven</groupId>

<artifactId>scala-maven-plugin</artifactId>

<version>3.3.2</version>

<executions>

<execution>

<id>scala-compile-first</id>

<phase>process-resources</phase>

<goals>

<goal>add-source</goal>

<goal>compile</goal>

</goals>

</execution>

<execution>

<id>scala-test-compile</id>

<phase>process-test-resources</phase>

<goals>

<goal>testCompile</goal>

</goals>

</execution>

</executions>

</plugin>

</plugins>

</build>

</project>

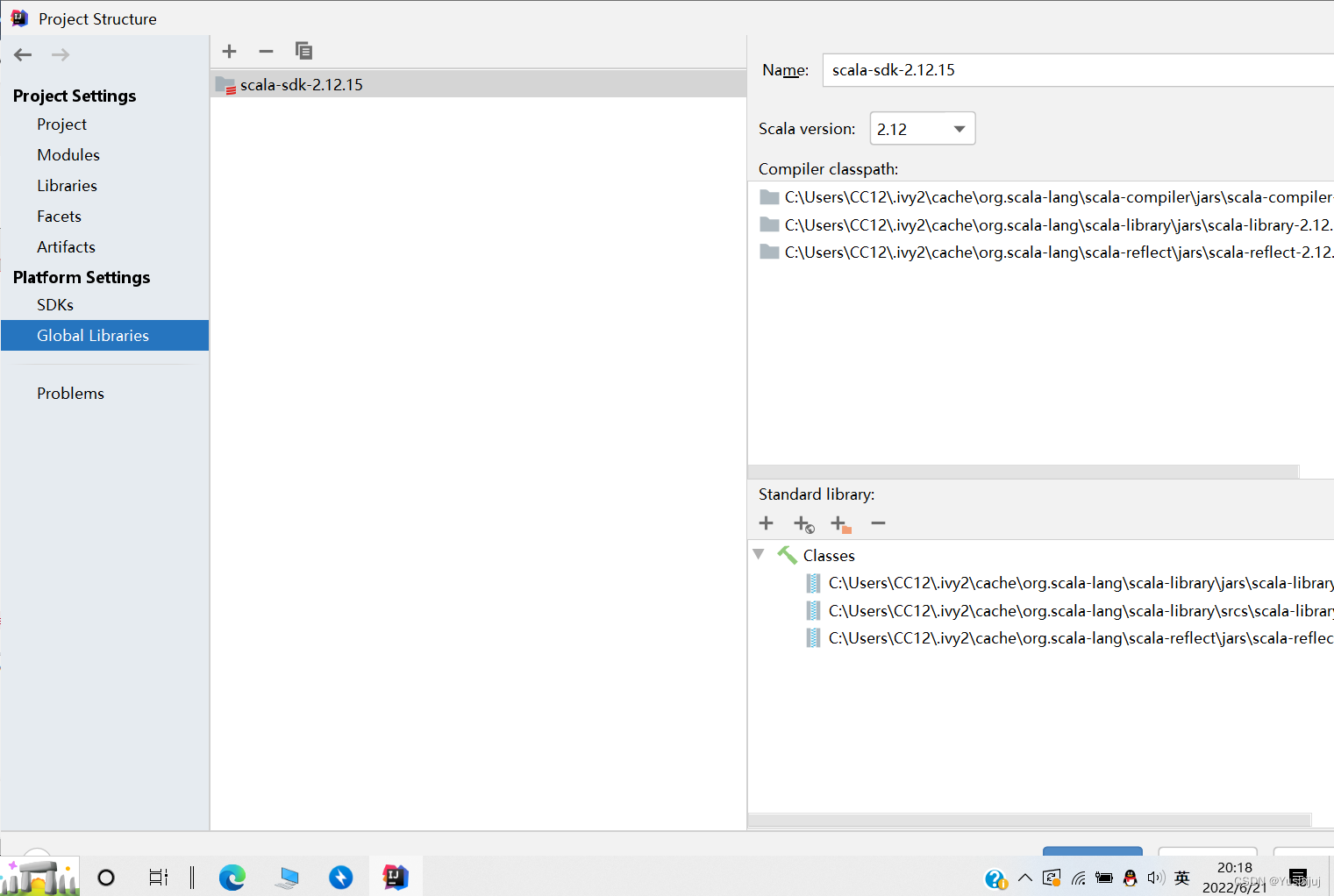

- 注意项目使用的Scala SDK版本

(四)创建日志属性文件

- 在resources 文件里创建log4j.properties文件

log4j.rootLogger=ERROR, stdout, logfile

log4j.appender.stdout=org.apache.log4j.ConsoleAppender

log4j.appender.stdout.layout=org.apache.log4j.PatternLayout

log4j.appender.stdout.layout.ConversionPattern=%d %p [%c] - %m%n

log4j.appender.logfile=org.apache.log4j.FileAppender

log4j.appender.logfile.File=target/spark.log

log4j.appender.logfile.layout=org.apache.log4j.PatternLayout

log4j.appender.logfile.layout.ConversionPattern=%d %p [%c] - %m%n

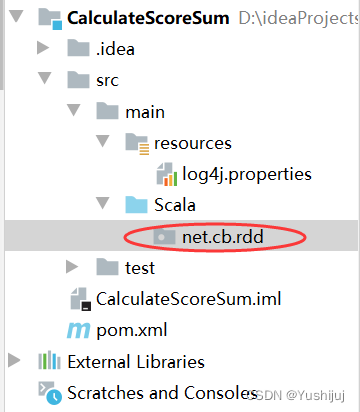

(五)创建包与计算总成绩单例单例对象

- 创建net.cb.rdd包

- 在net.cb.rdd包里创建CalculateScoreSum单例对象

package net.cb.rdd

import org.apache.spark.{SparkConf, SparkContext}

import scala.collection.mutable.ListBuffer

/**

* 功能:计算总分

* 作者:cb

* 日期:2022年05月24日

*/

object CalculateScoreSum {

def main(args: Array[String]): Unit = {

// 设置HADOOP用户名属性,否则写HDFS文件会被拒绝

System.setProperty("HADOOP_USER_NAME", "root")

// 创建Spark配置对象

val conf = new SparkConf()

.setAppName("CalculateScoreSum")

.setMaster("local[*]")

// 基于配置创建Spark上下文

val sc = new SparkContext(conf)

// 读取HDFS文件

val lines = sc.textFile("hdfs://master:9000/input/scores.txt")

// 创建成绩列表

val scores = new ListBuffer[(String, Int)]()

lines.collect.foreach(

line => {

val rec = line.split(" ")

scores += Tuple2(rec(0), rec(1).toInt)

scores += Tuple2(rec(0), rec(2).toInt)

scores += Tuple2(rec(0), rec(3).toInt)

})

// 基于成绩列表创建RDD

val rdd1 = sc.makeRDD(scores)

// 对成绩RDD进行按键归约处理

val rdd2 = rdd1.reduceByKey((x, y) => x + y)

// 输出归约处理结果

rdd2.collect.foreach(println)

// 将归约处理结果写入HDFS文件

rdd2.saveAsTextFile("hdfs://master:9000/scoresum")

}

}

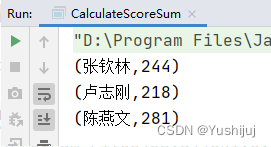

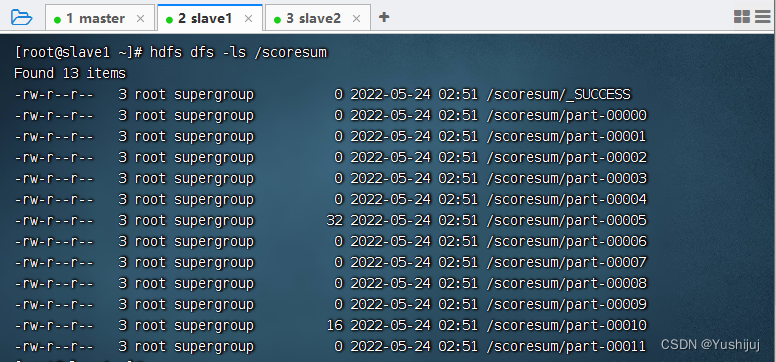

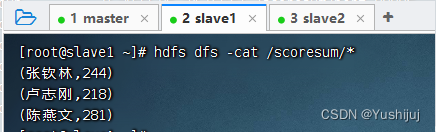

(六)运行程序,查看结果

- 查看控制台输出结果

- 查看HDFS 上生成的结果文件

- 查看结果文件内容

2071

2071

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?