目录:

- 《剑指offer》面试题-topk算法

- 搜索热词关联算法

- 代码实现以及java学习

写在前面

每次写博客都爱先扯点乱七八糟的东西,这是工作准备写的第2篇博客,之前写过一篇hadoop入门,那里还留下了一个搜索引擎的demo没有去完成,这次学习热词关联刚好也是和搜索引擎相关,所以借此机会把这篇记录下来,一方面花了3天来学习了这个内容,确实学到了不少东西,二来下次写搜索引擎的hadoop的demo时候可以把这个整合到一起,如果有空把关于搜索的东西整合到一起,添加一些爬虫相关的只是内容,就可以简单的搭建一个搜索引擎了,想想还是挺不错的。好啦,我们来开始学习吧!

topK算法

这个题目实现不难,在没有什么限制的情况下我们很快能得到答案。

解法1 排序

对数组排序,然后找到最小的k个数字,这个思路和粗暴,实际上我们把问题转化成了排序算法,那么合理的想法就是去找排序中时间复杂度最小的快排(O(nlgn)),这里对于此方法有一个问题就是在于需要改变原数组,如果题目中存在此种限制,自然是需要考虑其他算法。

解法2 partition算法

parition算法,说起这个算法可能对于算法不太熟悉的同学真没什么印象,但是如果说快排大家肯定都知道了。我先贴一段java实现的代码给大家看一看。

//快速排序 虽然快排思想比较简单,但是有些=还是需要注意一下勒,网上不少博客的代码都有点小问题,所以自己写了跑了下才贴出来。

public static void qsort(int[] arr,int begin,int end) {

int index = partition(arr, begin,end);

if(begin >= end -1) {

return;

}

qsort(arr,begin,index-1);

qsort(arr,index+1,end);

}

//用一个哨兵来分割大于小于的两部分

private static int partition(int[] arr,int begin,int end) {

if(begin >= end) {

return -1;

}

int pos = arr[begin];

while(begin < end) {

while(arr[end] >= pos && begin < end) {

end --;

}

if(begin < end) {

arr[begin] = arr[end];

}

while(arr[begin] <= pos && begin < end) {

begin ++;

}

if(begin < end) {

arr[end] = arr[begin];

}

}

arr[begin] = pos;

return begin;

}以上代码中有很重要的一块就是partition,很多快排的写法里面没有将其作为单独的一个函数,他的思想就是取出一个哨兵,然后把大于他的放到一边,小于他的放到另一边。这样如果我们按着这个思路,先找到一个数partition一次,判断这个树的最终位置是不是在k处,如果大于则找前面的部分(假设左小右大),如此直到我们找到第k个值的位置,此时k之前的都比k小,就得到了题解。下面我大概举个例子,给大家一个形象的表示。

arr = 4,3,5,9,2,4,6 找到最小的3个值

partition1 2 3 4 9 5 4 6 index = 3 分了一次刚好index返回3,所以最小的是2 3 4,对没毛病!

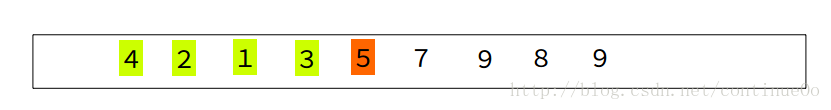

那我们现在来看一看这个算法的时间复杂度,逆序的时候复杂度最高为O(n^2),如果是随机的话,T(N) = T(T/2) + N,时间复杂度为O(N)。那么我们可以在O(N)的时间复杂度把这个问题给解决了。这比上述排序好多了,因为针对上述排序中,我们每次都要把序列找到一个哨兵然后左右都要去排序,这个时候,我们只处理我们需要处理的部分,时间复杂度就降低了下来。虽然简单,还是画个图表示一下下。如下图,如果我们想要去找前3小的数字时,如果哨兵是5,那么我们就可以不用管后面部分,只需要考虑前面绿色填充的数字,这样节约了很多时间。

但是这个算法仍然有点问题,同解法1,这个算法会调整数据,当数据量不断增加时,我们有时候希望能增量式的去处理,而不是每次有数据进来都乾坤大挪移,那么我们需要考虑外部存储来辅助这个算法保证这个原数组不会改变。

解法3 外部存储-小(大)根堆

我们日常也会遇到这样的算法例子,偶尔我们会用一个外部数组来存储,每次进来一个数字就判断。比如我们想找一个数组里面最大的3个数字,我开一个3空间的数组,那么我们遍历一次原数组,找到最大的3个依次放入,每次放入时和外部数组比较一下,这样也可以在O(N)时间内完成,且不改变原数组,好啦。貌似我们对这个算法已经了解的很深入了。

且慢,各位看客想一想,如果这个N非常非常大时候,如果我们要在几百万的数据中找前10,那会有什么不同么。对于算法复杂度来说,O(N)应该是不可避免了,至少每个数字都要遍历到,但是对于大数据处理来说,复杂度中隐藏的时间常熟因子也是十分关键的。我们现在来分析一波,对于外部数组,如果我们是找最大的K个数,那么我们每次需要找到数组中最小的,如果最小我们就要替换,所以会有替换操作。那么对于一个无顺序数组的话,大概O(K)可以完成,然后我们算法整体就是O(K*N),如果我们来维护一个有序数组的话,开销没什么区别。如果熟悉数据结构的同学,现在一定看出问题了,我们需要用堆来完成这些操作,取最小堆可以O(1),来完成,而插入堆也可以在O(lgN)完成(平均),OK,数据量一大时候,这个差异是非常大的,先给大家看一个感性的认识,我没有具体去算时间,只是进行了一下对比,heap为我自己实现的小根堆,orderarr是网上借鉴的别人实现的有序数组。下面应该十分明显了,k小时没有啥区别,k的变大,这个差距会越来越大。

int n = 3000000;

int k = 100;

orderarr程序运行时间: 16ms

heap程序运行时间: 13ms

int n = 3000000;

int k = 100000;

orderarr程序运行时间: 5137ms

heap程序运行时间: 59ms

算法不难,此处介绍一下思路即可,晚上有很多介绍堆思路的ÿ

本文介绍了搜索热词关联的TopK算法,包括排序、partition算法和使用小根堆的解法。详细讲解了如何通过HashMap统计热词,构建Trie树以及在Java中实现相关算法。最后提到了在大数据场景下的优化和应用。

本文介绍了搜索热词关联的TopK算法,包括排序、partition算法和使用小根堆的解法。详细讲解了如何通过HashMap统计热词,构建Trie树以及在Java中实现相关算法。最后提到了在大数据场景下的优化和应用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

8895

8895

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?