第五天 – Kafka基础

文章目录

一、Kafka简介

Kafka是一个分布式消息队列:生产者和消费者的功能。该框架的目标是为处理实时数据提供一个统一、高吞吐量、低等待的平台。它提供了类似于JMS的特性,但是在设计实现上完全不同,此外它并不是JMS规范的实现。

Kafka对消息保存时根据Topic进行归类,发送消息者称为Producer,消息接收者称为Consumer,此外Kafka集群由多个kafka实例组成,每个实例(server)称为broker。

无论是Kafka集群,还是producer和consumer都依赖于zookeeper集群保存一些meta信息,来保证系统的可用性。

二、JMS相关

JMS简介

JMS是Java提供的一套技术规范,用来异构系统,集成通信,缓解系统瓶颈,提高系统的伸缩性增强系统用户体验,使得系统模块化和组件化变得可行并更加灵活。使用生产消费者模式(生产者、服务器、消费者)

JMS消息传输模型

-

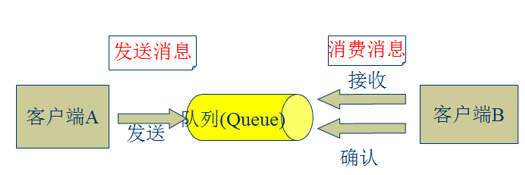

点对点模式(一对一,消费者主动拉取数据,消息收到后消息清除)

点对点模型通常是一个基于拉取或者轮询的消息传送模型,这种模型从队列中请求信息,而不是将消息推送到客户端,这个模型的特点是发送队列的消息被一个且只有一个接收者接收处理,即使有多个消息监听者也是如此。

-

发布/订阅模式(一对多,数据产生后,推送给所有订阅者)

发布订阅模型则是一个基于推送的消息传送模型。发布订阅模型可以有多种不同的订阅者,临时订阅者只在主动监听主题时才能接收消息,而持久订阅者则监听主题的所有消息。

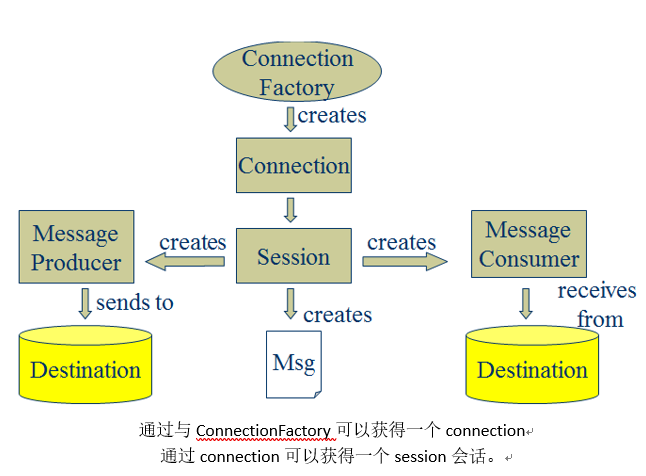

JMS核心组件

-

Destination:消息发送的目的地,也就是前面说的Queue和Topic

-

Message:被发送的消息

-

Producer:消息生产者,要发送一个消息,必须通过这个生产者来发送

-

MessageConsumer:与生产者相对应,这是消息接收者,通过它来接收一个消息

三、消息队列的重要性

消息系统的核心作用就是三点:解耦、异步和并行。

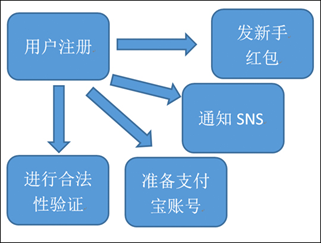

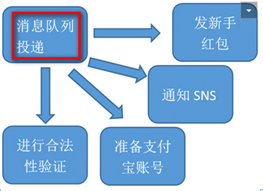

下面通过用户注册的案例来说明消息系统的作用。

用户注册的一般流程

问题:随着后端流程越来越多,每步流程都需要额外的耗费时间,导致用户更长的等待延迟

用户注册的并行执行

问题:系统并行发起了4个请求,4个请求中,如果某一个环节执行1分钟,其他环节再快,用户也需要等待1分钟,并且如果其中一个环节出现异常后,整个服务也就挂掉了。

用户注册的最终一致

-

保证主流程的正常执行、执行成功后,发送MQ(消息队列)出去

-

需要这个destination的其他系统通过消费数据再执行,最终一致

四、Kafka核心组件

Kafka整体结构图

Kafka相关名词解释

-

Producer:消息生产者,就是向kafka broker发送消息的客户端。

-

Consumer:消息消费者,向kafka broker取消息的客户端。

-

Topic:一个队列,消息根据topic进行归类。

-

Consumer Group(CG):这是kafka用来实现一个topic消息的广播(发送给所有的consumer)和单播(发送给任意一个consumer)的手段。一个topic可以有多个CG。topic的消息会复制(不是真正的物理复制,只是概念上的)到所有的CG,但每个partition只会把消息发给该CG中的一个consumer。如果需要实现广播,需要每个consumer有一个独立的CG。用CG还可以将consumer进行自由分组而不需要多次发送消息到不同的topic。

-

Broker:一台kafka服务器就是一个broker。一个集群由多个broker组成。一个broker可以容纳多个topic。

-

Partition:为了实现扩展性,一个非常大的topic可以分布到多个broker上,一个topic可以分为多个partition,每个partition是一个有序的队列。partition中的每条消息都会被分配一个有序的id(offset)。kafka只保证按一个partition中的顺序将消息发送给consumer,不保证一个topic的整体(多个partition间)的顺序。

-

Offset:kafka的存储文件都是按照offset.kafka来命名,用offset做名字的好处是方便查找。例如如果想找位于2018的位置,只要找到2017.kafka的文件即可。当然the first offset就是00000000000.kafka。

Consumer与Topic的关系

本质上kafka只支持topic

- 每个group中可以有多个consumer,每个consumer都有一个cg;通常情况下,一个cg会包含多个consumer,这样不仅可以提高topic中消息的并发消费能力,而且还能提高"故障容错"性,如果group中某个consumer失效,那么其消费的partition将会有其他consumer自动接管。

- 对于topic中的一条特定的消息,只会被订阅此topic的每个group中的其中一个consumer消费,此消息不会发送给一个cg中的多个consumer;那么一个group中所有的consumer将会交错地消费整个topic,每个group中consumer消息消费互相独立我们可以认为一个group是一个订阅者。

- 在kafka中,一个partition中的消息在同一时刻只会被group中的consumer消费;一个topic中的每个partition,只会被一个订阅者中的一个consumer消费,不过一个consumer可以同时消费多个partition中的消息。

- kafka的设计原理决定,对于一个topic,同一个group中不能有多于partition个数的consumer同时消费,否则意味着某些consumer无法得到消息。

- kafka只能保证一个partition中的消息被某个consumer消费时是有序的,从topic角度来说,当有多个partition时,消息并不会是全局有序的

Kafka消息的分发

Producer客户端负责消息的分发

- kafka集群中的任何一个broker都可以向Producer提供metadata信息,这些metadata中包含"集群中存活的servers列表"/"partitions leader"等信息。

- 当Producer获取到metadata信息之后,producer将会和topic下所有partition leader保持socket连接。

- 消息由producer直接通过socket发送到broker,中间不会经过任何"路由层",事实上,消息被路由到哪个partition由producer客户端决定。比如可以采用"random"“key-hash”"轮询"等,如果一个topic中有多个partitions,那么在producer端实现"消息均衡分发"是必要的。

- 在producer端的配置文件中,开发者可以指定partition路由的方式

Producer消息发送的应答机制

设置发送数据是否需要服务端的反馈,有三个值0,1,-1:

0:producer不会等待broker发送ack

1:当leader接收到消息之后发送ack

-1:当所有的follower都同步消息成功后发送ack

ack:确认字符

request.required.acks=0

Consumer的负载均衡

当一个group中,有consumer加入或者离开时,会触发partitions负载均衡,负载均衡的最终目的是提升topic的并发消费能力,步骤如下:

- 假如topic1,具有如下partitions:P0, P1, P2, P3

- 假如group中,有如下consumer:C0, C1

- 首先根据partition索引号对partitions排序:P0, P1, P2, P3

- 根据consumer.id排序:C0, C1

- 计算倍数:M = [P0, P1, P2, P3].size / [C0, C1].size,向上取整

- 然后依次分配partitions: C1 = [P0, P1], C2 = [P2,P3], 即Ci = [P(i * M),P((i + 1) * M - 1)]

五、Kafka集群部署

下载安装

安装的Kafka版本是kafka_2.11-0.9.0.1,下载后上传至Linux服务器中。

解压安装包

tar -zxvf kafka_2.11-0.9.0.1.tgz -C /home/bigdata/installsoft/

修改配置文件

进入kafka的配置文件目录

cd /home/bigdata/installsoft/kafka_2.11-0.9.0.1/config

需要修改三个文件:server.properties、producer.properties、consumer.properties

server.properties

#broker的全局唯一编号,不能重复

broker.id=0

#用来监听链接的端口,producer或consumer将在此端口建立连接

port=9092

#处理网络请求的线程数量

num.network.threads=3

#用来处理磁盘IO的线程数量

num.io.threads=8

#发送套接字的缓冲区大小

socket.send.buffer.bytes=102400

#接受套接字的缓冲区大小

socket.receive.buffer.bytes=102400

#请求套接字的缓冲区大小

socket.request.max.bytes=104857600

#kafka消息存放的路径

log.dirs=/home/bigdata/logs/kafka

#topic在当前broker上的分片个数

num.partitions=2

#用来恢复和清理data下数据的线程数量

num.recovery.threads.per.data.dir=1

#segment文件保留的最长时间,超时将被删除

log.retention.hours=168

#滚动生成新的segment文件的最大时间

log.roll.hours=168

#日志文件中每个segment的大小,默认为1G

log.segment.bytes=1073741824

#周期性检查文件大小的时间

log.retention.check.interval.ms=300000

#日志清理是否打开

log.cleaner.enable=true

#broker需要使用zookeeper保存meta数据

zookeeper.connect=cdhnocms01:2181,cdhnocms02:2181,cdhnocms03:2181

#zookeeper链接超时时间

zookeeper.connection.timeout.ms=6000

#partion buffer中,消息的条数达到阈值,将触发flush到磁盘

log.flush.interval.messages=10000

#消息buffer的时间,达到阈值,将触发flush到磁盘

log.flush.interval.ms=3000

#删除topic需要server.properties中设置delete.topic.enable=true否则只是标记删除

delete.topic.enable=true

#此处的host.name为本机IP(重要),如果不改,则客户端会抛出:Producer connection to localhost:9092 unsuccessful 错误!

host.name=cdhnocms01

producer.properties

#指定kafka节点列表,用于获取metadata,不必全部指定

metadata.broker.list=cdhnocms01:9092,cdhnocms02:9092

# 指定分区处理类。默认kafka.producer.DefaultPartitioner,表通过key哈希到对应分区

# partitioner.class=kafka.producer.DefaultPartitioner

# 是否压缩,默认0表示不压缩,1表示用gzip压缩,2表示用snappy压缩。压缩后消息中会有头来指明消息压缩类型,故在消费者端消息解压是透明的无需指定。

compression.codec=none

# 指定序列化处理类

serializer.class=kafka.serializer.DefaultEncoder

# 如果要压缩消息,这里指定哪些topic要压缩消息,默认empty,表示不压缩。

#compressed.topics=

# 设置发送数据是否需要服务端的反馈,有三个值0,1,-1

# 0: producer不会等待broker发送ack

# 1: 当leader接收到消息之后发送ack

# -1: 当所有的follower都同步消息成功后发送ack.

request.required.acks=0

# 在向producer发送ack之前,broker允许等待的最大时间 ,如果超时,broker将会向producer发送一个error ACK.意味着上一次消息因为某种原因未能成功(比如follower未能同步成功)

request.timeout.ms=10000

# 同步还是异步发送消息,默认“sync”表同步,"async"表异步。异步可以提高发送吞吐量,

# 也意味着消息将会在本地buffer中,并适时批量发送,但是也可能导致丢失未发送过去的消息

producer.type=sync

# 在async模式下,当message被缓存的时间超过此值后,将会批量发送给broker,默认为5000ms

# 此值和batch.num.messages协同工作.

queue.buffering.max.ms = 5000

# 在async模式下,producer端允许buffer的最大消息量

# 无论如何,producer都无法尽快的将消息发送给broker,从而导致消息在producer端大量沉积

# 此时,如果消息的条数达到阀值,将会导致producer端阻塞或者消息被抛弃,默认为10000

queue.buffering.max.messages=20000

# 如果是异步,指定每次批量发送数据量,默认为200

batch.num.messages=500

# 当消息在producer端沉积的条数达到"queue.buffering.max.meesages"后

# 阻塞一定时间后,队列仍然没有enqueue(producer仍然没有发送出任何消息)

# 此时producer可以继续阻塞或者将消息抛弃,此timeout值用于控制"阻塞"的时间

# -1: 无阻塞超时限制,消息不会被抛弃

# 0:立即清空队列,消息被抛弃

queue.enqueue.timeout.ms=-1

# 当producer接收到error ACK,或者没有接收到ACK时,允许消息重发的次数

# 因为broker并没有完整的机制来避免消息重复,所以当网络异常时(比如ACK丢失)

# 有可能导致broker接收到重复的消息,默认值为3.

message.send.max.retries=3

# producer刷新topic metada的时间间隔,producer需要知道partition leader的位置,以及当前topic的情况

# 因此producer需要一个机制来获取最新的metadata,当producer遇到特定错误时,将会立即刷新

# (比如topic失效,partition丢失,leader失效等),此外也可以通过此参数来配置额外的刷新机制,默认值600000

topic.metadata.refresh.interval.ms=60000

consumer.properties

# zookeeper连接服务器地址

zookeeper.connect=cdhnocms01:2181,cdhnocms02:2181,cdhnocms03:2181

# zookeeper的session过期时间,默认5000ms,用于检测消费者是否挂掉

zookeeper.session.timeout.ms=5000

#当消费者挂掉,其他消费者要等该指定时间才能检查到并且触发重新负载均衡

zookeeper.connection.timeout.ms=10000

# 指定多久消费者更新offset到zookeeper中。注意offset更新时基于time而不是每次获得的消息。一旦在更新zookeeper发生异常并重启,将可能拿到已拿到过的消息

zookeeper.sync.time.ms=2000

#指定消费组

group.id=xxx

# 当consumer消费一定量的消息之后,将会自动向zookeeper提交offset信息

# 注意offset信息并不是每消费一次消息就向zk提交一次,而是先在本地保存(内存),并定期提交,默认为true

auto.commit.enable=true

# 自动更新时间。默认60 * 1000

auto.commit.interval.ms=1000

# 当前consumer的标识,可以设定,也可以由系统生成,主要用来跟踪消息消费情况,便于观察

conusmer.id=xxx

# 消费者客户端编号,用于区分不同客户端,默认客户端程序自动产生

client.id=xxxx

# 最大取多少块缓存到消费者(默认10)

queued.max.message.chunks=50

# 当有新的consumer加入到group时,将会reblance,此后将会有partitions的消费端迁移到新的consumer上,如果一个consumer获得了某个partition的消费权限,那么它将会向zk注册 "Partition Owner registry"节点信息,但是有可能此时旧的consumer尚没有释放此节点, 此值用于控制,注册节点的重试次数.

rebalance.max.retries=5

# 获取消息的最大尺寸,broker不会像consumer输出大于此值的消息chunk 每次feth将得到多条消息,此值为总大小,提升此值,将会消耗更多的consumer端内存

fetch.min.bytes=6553600

# 当消息的尺寸不足时,server阻塞的时间,如果超时,消息将立即发送给consumer

fetch.wait.max.ms=5000

socket.receive.buffer.bytes=655360

# 如果zookeeper没有offset值或offset值超出范围。那么就给个初始的offset。有smallest、largest、anything可选,分别表示给当前最小的offset、当前最大的offset、抛异常。默认largest

auto.offset.reset=smallest

# 指定序列化处理类

derializer.class=kafka.serializer.DefaultDecoder

分发安装包

scp -r /home/bigdata/installsoft/kafka_2.11-0.9.0.1/ cdhnocms02:/home/bigdata/installsoft/

scp -r /home/bigdata/installsoft/kafka_2.11-0.9.0.1/ cdhnocms03:/home/bigdata/installsoft/

分发安装包后需要对server.properties再次配置

- broker.id三台分别是0,1,2

- 修改host.name

kafka集群启动

依次在各个节点上启动kafka

nohup bin/kafka-server-start.sh config/server.properties &

启动完成后,使用jps命令能看到Kafka进程

六、Kafka常用操作命令

-

创建topic

bin/kafka-topics.sh --create --zookeeper cdhnocms01:2181 --replication-factor 1 --partitions 1 --topic test

-

查看当前服务器中的所有topic

bin/kafka-topics.sh --list --zookeeper cdhnocms01:2181

-

删除topic

bin/kafka-topics.sh --delete --zookeeper cdhnocms01:2181 --topic test

-

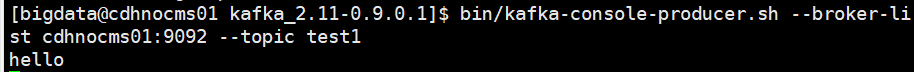

通过shell命令发送消息

bin/kafka-console-producer.sh --broker-list cdhnocms01:9092 --topic test1

-

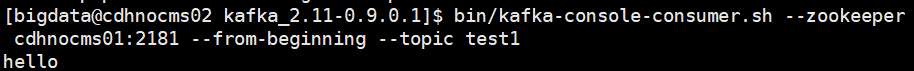

通过shell命令消费消息

bin/kafka-console-consumer.sh --zookeeper cdhnocms01:2181 --from-beginning --topic test1

以上两个命令在不同的窗口使用,可以实现生产者发送消息-消费者接收消息的效果

-

查看消费位置

bin/kafka-run-class.sh kafka.tools.ConsumerOffsetChecker --zookeeper cdhnocms01:2181 --group testGroup

-

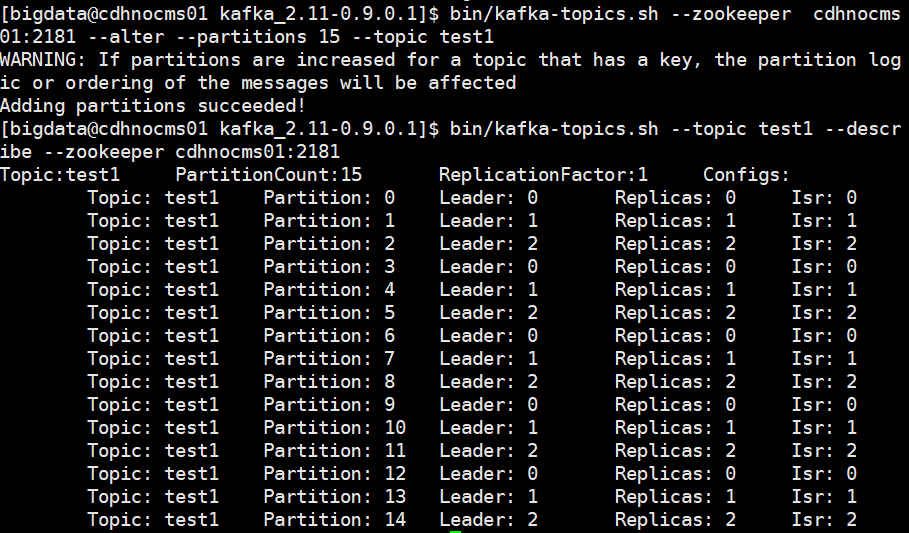

查看某个topic的详情

bin/kafka-topics.sh --topic test1 --describe --zookeeper cdhnocms01:2181

-

对分区数进行修改

bin/kafka-topics.sh --zookeeper cdhnocms01:2181 --alter --partitions 15 --topic test1

181

181

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?