点击下方卡片,关注“具身智能之心”公众号

更多干货,欢迎加入国内首个具身智能全栈学习社区:具身智能之心知识星球(戳我),这里包含所有你想要的。

近年来,国内机器人训练场建设蓬勃发展,今日具身智能之心为大家介绍几个具有代表性的训练场,一起看看吧~

一、国内主要机器人训练场概况

上海张江异构人形机器人训练场

上海张江异构人形机器人训练场(国家地方共建人形机器人创新中心)是全国首个大规模异构人形机器人训练基地,位于浦东张江模力社区,面积超5000平方米。该训练场首期部署了来自10余家企业的100余台异构人形机器人,包括全尺寸开源公版机“青龙”等国产机型,聚焦智能制造、民生服务和特种应用三大类场景。通过遥操作、动作捕捉等多元数据采集方式,单台机器人每日可采集500条以上轨迹数据,并打通了从数据采集到模型部署的全流程闭环。训练场首创“异构群智”训练模式,通过异构机器人协同训练生成规模化数据集,计划2025年底建成5000万条数据的具身智能语料库,并推动数据开源共享。作为国家级创新平台,该中心已发布首批人形机器人团体标准,联合华为、清华大学等构建具身智能操作系统,助力国产人形机器人技术突破和产业生态发展。

视频来源:新华社 https://www.xinhuanet.com/tech/20250316/fa60bf24798342ad8c33251493d45c81/c.html

国家地方共建具身智能机器人创新中心

中心位于北京经济技术开发区,是国内首个聚焦具身智能机器人核心技术研发与产业化的国家级平台,由优必选、小米机器人等10家领军企业联合组建,2024年10月升级为“国地共建”创新中心。其核心成果包括全球首个纯电驱全尺寸人形机器人“天工”(最高时速12公里,可适应复杂地形)和具身智能服务机器人“天轶”。中心构建了“数据采集-模型训练-真机验证”闭环,计划建成百万量级高密度数据集,并牵头制定《人形机器人智能化分级》等多项行业标准。目前正联合清华、北大等高校攻关灵巧手、一体化关节等关键技术,并在京东、奥迪一汽等企业场景中试点应用。

视频来源:央视新闻 https://baike.baidu.com/item/%E5%9B%BD%E5%AE%B6%E5%9C%B0%E6%96%B9%E5%85%B1%E5%BB%BA%E5%85%B7%E8%BA%AB%E6%99%BA%E8%83%BD%E6%9C%BA%E5%99%A8%E4%BA%BA%E5%88%9B%E6%96%B0%E4%B8%AD%E5%BF%83/64987322

北京人形机器人数据训练中心(石景山首钢园)

该中心于2025年3月落地首钢园,是北京市首个专注人形机器人多模态数据采集的公共训练平台,由石景山区政府与睿尔曼机器人合作共建。部署了100台高自由度人形机器人、100套遥操作及动捕设备,搭建家庭康养、工业制造等10大实景场景,年产出超百万条真实数据。其特色是通过“穿戴设备操控机器人”的方式采集操作数据(如抓取瓶子成功率超90%),并构建“数据标注-模型迭代-场景反馈”闭环,目标降低企业研发成本30%。未来三年计划形成50亿元规模的数据服务市场,吸引30家上下游企业落户。

来源:https://wap.bjd.com.cn/news/2025/03/28/11112473.shtml

北建大科技园通用智能机器人训练测试平台

北建大科技园通用智能机器人训练测试平台是由华远集团与北京建筑大学科技园联合打造的具身智能机器人实训基地,位于北京西城区华远·企业中心内。该平台由机器人本体、数据采集系统、场景库、数据中心和算力中心构成,聚焦AI+建筑、智能家居、智能医疗、智慧教育等多元化场景,支持人形、四足+臂、轮式+臂等异构机器人的自主导航、越障巡检及行业技能训练。平台通过改造原企业演播厅,构建了高安全性、高空间适应性的训练环境,并采用光学动捕、VR遥操作等技术,实现高通量、低成本的机器人数据采集,年产出超百万条多模态训练数据,有效解决机器人工程化验证中的数据稀缺问题。作为北京市数字经济标杆城市建设的重要载体,该平台通过“需求牵引-场景验证-技术迭代”闭环生态,为企业提供定制化训练服务,推动西城区数据要素市场化改革。

视频来源:工业机器人视频库 https://mp.weixin.qq.com/s/p1D_9gCjEb3fWITr9wZQBA

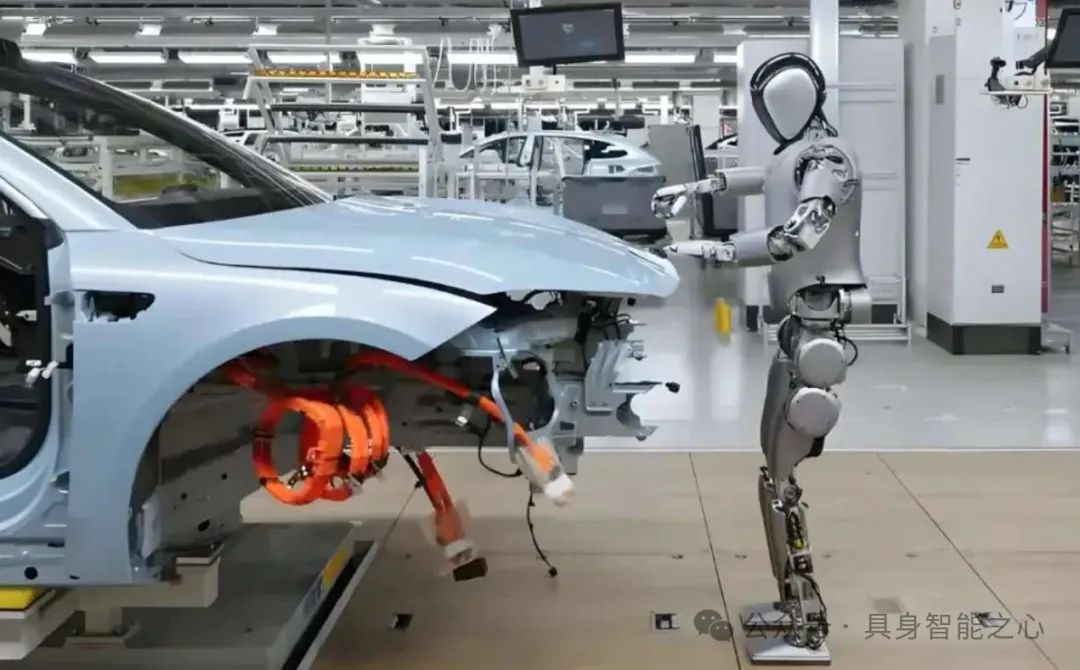

特斯拉上海超级工厂及研发中心

特斯拉上海超级工厂及研发中心(2021年启用)承担了部分Optimus人形机器人的研发测试任务,复用电动车产线的感知算法和电驱技术,并计划2025年试生产5000台Optimus,2026年扩产至5万台。其机器人训练数据主要来源于工厂实际生产场景,通过Optimus执行分拣电池、搬运零件、产线巡检等实操任务,积累真实环境下的运动控制与决策数据。工厂高度自动化的生产环境为机器人提供了丰富的训练场景,同时依托中国完善的供应链体系,为机器人核心部件的研发测试提供了有力支持。

图片来源:https://www.sohu.com/a/888884176_100153408

紫东太初(佛山)具身智能创新中心(顺德)

紫东太初(佛山)具身智能创新中心于2025年5月7日在顺德南方智谷揭牌成立,由中科紫东太初(中国科学院自动化研究所多模态大模型商业化载体)联合佛山市工信局、顺德区政府共建。该中心以紫东太初多模态大模型为核心,投资2亿元建设华南首个多模态大模型全品类机器人训练场,聚焦机器人本体、元器件及终端智能化研发,以紫东太初多模态大模型为核心打造自主可控的跨模态大模型通用人工智能平台。中心依托顺德雄厚的制造业基础(装备制造、家电两大超4000亿产业集群),组建50人专业团队,推动具身智能技术在家电、陶瓷、金属加工等传统产业的AI赋能,助力佛山打造全国领先的具身智能机器人产业集聚高地。

图注:佛山市具身智能机器人创新中心揭牌。

优必选多机器人协同实训场(浙江极氪智能工厂)

优必选多机器人协同实训场位于浙江极氪5G智慧工厂,是全球首个实现多台、多场景、多任务人形机器人协同作业的工业实训基地。该实训场部署了数十台优必选Walker S1人形机器人,分布在总装车间、SPS仪表区、质检区及车门装配区等复杂场景,成功完成协同分拣、大负载搬运及精密装配等任务。其核心技术为优必选创新的“群脑网络(BrainNet)”架构以及人形智能网联中枢 Internet of Humanoids (IoH),通过云端“超级大脑”(基于多模态推理大模型)与端侧“智能小脑”(基于Transformer模型)协同,实现跨场域感知、多机运动规划及自适应控制。实训场还依托DeepSeek-R1深度推理技术,赋予机器人类人常识决策能力,推动智能制造从“半柔性”向“全柔性”进化。目前,该模式已与吉利、比亚迪等车企合作,为人形机器人规模化应用提供范本。

来源:https://m.thepaper.cn/newsDetail_forward_30291582

二、国内机器人训练场支持政策

国内机器人训练场支持政策已形成国家与地方联动的多层次体系。在国家层面,工信部等十七部门发布的《"机器人+"应用行动实施方案》重点推动制造业、农业等十大领域的机器人深度应用;《"十四五"机器人产业发展规划》提出增加高端产品供给,目标到2025年制造业机器人密度较2020年翻番;而《人形机器人创新发展指导意见》则专门针对人形机器人,明确2025年实现批量生产、2027年形成国际竞争力产业生态的目标。

地方层面,上海通过《人工智能"模塑申城"实施方案》构建智能算力集群等四大基础底座,浦东新区更推出三年行动计划,以张江机器人谷为载体建设"1+N"虚实融合训练场体系;广东佛山则发布智能机器人产业发展行动方案,投资2亿元建设多模态大模型训练场,重点突破具身智能技术。标准化方面,浦东率先发布《人形机器人分类分级应用指南》(L1-L4级)和《具身智能智能化发展阶段分级指南》(G1-G5级),为行业提供技术评估框架。这些政策共同推动机器人训练场在技术研发、场景落地和产业生态建设方面快速发展。

重点城市政策:

1. 上海:打造具身智能训练场标杆

政策文件:

《人工智能"模塑申城"实施方案》:建设智能算力集群、语料供给体系、虚实融合训练场等四大基础底座。

浦东新区"人形机器人产业三年行动计划":以张江机器人谷为核心,建设"1+N"训练场体系(1个市级通用场+N个企业特色场)。

支持措施:

对国家级创新平台给予1000万元支持,市级中试平台最高补贴1000万元。

设立人形机器人产业子基金,投资孵化优质企业。

典型案例:张江异构人形机器人训练场(全国首个),计划2025年建成5000万条数据的语料库,单台机器人日采数据500+条。

2. 北京:科研资源驱动

政策亮点:

重点支持5G机器人场景应用,开放医疗、教育等标杆场景。

对机器人企业技改项目最高补贴1000万元。

训练场布局:依托中关村科技园,推动极智嘉、小米机器人等企业共建测试场,聚焦特种作业和医疗场景。

政策:《北京市促进机器人产业创新发展若干措施》

设立100亿元机器人产业基金,对关键技术攻关最高支持3000万元;推动京津冀协同,建设机器人产业协同示范园。

鼓励“首试首用”,对未定型创新产品在京津冀首次试用给予单台最高50万元奖励。

标准化与数据生态

发布《人形机器人分类分级应用指南》等标准,划分技术等级(L1-L4)和智能化阶段(G1-G5)

推动数据开源共享,如国地中心计划2025年开放5000万条具身智能语料库

3. 深圳:资本与供应链优势

专项政策:

2025年设立人形机器人专项资金,目标形成全球领先产业集群。

开放50+应用场景,推动全域AI示范,对中小企业算力费用补贴50%。

企业参与:优必选联合极氪工厂开展多机器人协同实训,探索工业场景落地。

4. 杭州:创新生态与场景激励

政策文件:

《加快智能机器人产业发展行动方案》:对示范应用场景最高奖励200万元。

扩大创新券使用范围,覆盖长三角26市高校及科研机构技术服务。

典型案例:

宇树科技、云深处等企业依托余杭AI小镇,开展机器狗等高动态训练。

紫东太初(佛山)创新中心投资2亿元建设多模态大模型训练场。

5. 广州:产业转型发力

政策方向:

南沙自贸区聚焦金融资源整合,但机器人产业规模落后于杭深。

黄埔区推动"AI+制造"转型,对机器人采购按金额30%补贴场景方。

6. 江苏/浙江:区域协同

浙江政策:

《人形机器人产业创新发展方案》:支持杭州搭建"公版"通用整机平台,宁波聚焦核心零部件。

衢州龙游县对产学研合作项目最高奖励500万元。

江苏政策:

无锡联合上海、香港成立灵巧智能研究院,主攻机器人"小脑"技术。

苏州吴中区对"机器人+AI"企业提供用地优先保障。

三、机器人训练场的软硬件配置要求

机器人训练场的软硬件配置是一个完整的系统化工程,主要包括五大核心模块:

(1)机器人本体:异构集群与性能要求

机器人训练场的本体需配置多品牌、多构型的异构集群,以覆盖不同应用场景的技术验证需求。例如,上海张江异构人形机器人训练场汇集了优必选Walker S、小米CyberOne、傅利叶GR-1等11家企业的全尺寸/类人形机器人,其中国地中心自研的“青龙”V2.5机器人已实现批量部署,具备43个自由度,峰值扭矩达396Nm,支持高速奔跑(10-11.88km/h)和精细化作业。性能上,机器人需满足持续1小时稳定运动、任务成功率超90%的工业级标准,并通过开源硬件设计(如“青龙”公版机)降低行业研发门槛。

(2)数据采集系统:多模态与高效采集

数据采集系统需支持遥操作外骨骼、动作捕捉、便携式末端和仿真合成4种方式,单台机器人每日可采集500+条轨迹数据。例如,上海训练场采用穹彻轻量化设备,实现跨构型机械臂的数据复用,打破传统采集方案中数据与硬件绑定的限制,提升数据利用率30%以上。此外,通过头戴式视觉系统采集毫米级手部动作,结合人体运动数据映射算法,加速灵巧操作技能的模型训练。

(3)场景库:虚实融合与多领域覆盖

场景库需构建10类以上虚实融合环境,涵盖智能制造(如汽车焊接、3C装配)、民生服务(医疗护理、家居整理)及特种应用(高危作业)等领域。上海训练场通过“异构群智”模式,搭建100+异构机器人的模拟产线,并采用数字孪生技术实现物理实体与仿真场景的联动,支持快速切换训练环境。例如,医疗训练场通过沉浸式虚拟环境模拟手术操作,解决复杂场景适应性问题。

(4)数据中心:规模化语料库与自动化处理

数据中心需实现海量数据的高效管理与标注,如上海训练场计划2025年建成5000万条具身智能语料库,目前已开源百万级真机数据集。通过华为、交大等合作的仿真平台,实现数据自动化标注、轨迹生成及并行合成,并利用AI清洗失败数据单元,提升模型训练效率。此外,数据生态建设通过《共建具身智能语料数据生态》倡议,推动行业共享。

(5)算力中心:国产化与云网融合

算力中心需依托国家“东数西算”工程布局,采用昇腾等国产芯片(国产化率85%+),构建分布式算力网络。例如,上海训练场联合华为鸿蒙、清华大学建立具身智能操作系统,通过云网融合架构支持大模型训练,仿真训练效率可达真实环境的180倍。国产智算中心(如中国移动呼和浩特中心)已实现千P级算力规模,为机器人训练提供低成本、高能效的算力支持。

总结

五大模块协同构成机器人训练场的完整技术闭环:异构机器人提供多样化本体,数据采集系统生成高质量样本,场景库覆盖全领域需求,数据中心实现数据资产化,算力中心支撑高效训练。这一配置体系正推动我国人形机器人技术快速迭代,加速产业化落地。

往期 · 推荐

机械臂操作

UC伯克利&NVIDIA最新!AutoEval:真实世界中通用机器人操作策略评估系统

港大最新!RoboTwin:结合现实与合成数据的双臂机器人基准

伯克利最新!CrossFormer:一个模型同时控制单臂/双臂/轮式/四足等多类机器人

四足或人形机器人

Fourier ActionNet:傅利叶开源全尺寸人形机器人数据集&发布全球首个全流程工具链

斯坦福大学 | ToddlerBot:到真实世界的零样本迁移,低成本、开源的人形机器人平台

TeleAI&港科大最新!离线学习+在线对齐,扩散模型驱动的四足机器人运动

Robust Robot Walker:跨越微小陷阱,行动更加稳健!

斯坦福大学最新!Helpful DoggyBot:四足机器人和VLM在开放世界中取回任意物体

机器人学习

强化学习迁移到视觉定位!Vision-R1将图文大模型性能提升50%

视觉强化微调!DeepSeek R1技术成功迁移到多模态领域,全面开源

UC伯克利最新!Beyond Sight: 零样本微调异构传感器的通用机器人策略

CoRL 2024 | 通过语言优化实现策略适应:实现少样本模仿学习

NeurIPS 2024 | BAKU:一种高效的多任务Policy学习Transformer

人形机器人专场!有LLM加持能有多厉害?看HYPERmotion显身手

NeurIPS 2024 | 大规模无动作视频学习可执行的离散扩散策略

波士顿动力最新!可泛化的扩散策略:能有效操控不同几何形状、尺寸和物理特性的物体

RSS 2024 | OK-Robot:在机器人领域集成开放知识模型时,真正重要的是什么?

MIT最新!还在用URDF?URDF+:一种针对机器人的具有运动环路的增强型URDF

VisionPAD:3DGS预训练新范式!三大感知任务全部暴力涨点

NeurIPS 2024 | VLMimic:5个人类视频,无需额外学习就能提升泛化性?

纽约大学最新!SeeDo:通过视觉语言模型将人类演示视频转化为机器人行动计划

CMU最新!SplatSim: 基于3DGS的RGB操作策略零样本Sim2Real迁移

LLM最大能力密度100天翻一倍!清华刘知远团队提出Densing Law

机器人干活总有意外?Code-as-Monitor 轻松在开放世界实时精确检测错误,确保没意外

斯坦福大学最新!具身智能接口:具身决策中语言大模型的基准测试

机器人控制

RoboMatrix:一种以技能为中心的机器人任务规划与执行的可扩展层级框架

港大DexDiffuser揭秘!机器人能拥有像人类一样灵巧的手吗?

TPAMI 2024 | OoD-Control:泛化未见环境中的鲁棒控制(一览无人机上的效果)

VLA

CVPR2025 | MoManipVLA:通用移动操作VLA策略迁移,显著提升效率与泛化

上海AI Lab最新!Dita:扩展Diffusion Transformer以实现通用视觉-语言-动作策略

北大最新 | RoboMamba:端到端VLA模型!推理速度提升3倍,仅需调整0.1%的参数

英伟达最新!NaVILA: 用于导航的足式机器人视觉-语言-动作模型

优于现有SOTA!PointVLA:如何将3D数据融入VLA模型?

北京大学最新!HybridVLA:打通协同训练,各种任务中均SOTA~

北京大学最新 | 成功率极高!DexGraspVLA:首个用于灵巧抓取的分层VLA框架

ICLR'25 | VLAS:将语音集成到模型中,新颖的端到端VLA模型(西湖大学&浙大)

清华大学最新!UniAct:消除异质性,跨域跨具身泛化,性能超越14倍参数量的OpenVLA

简单灵活,便于部署 | Diffusion-VLA:通过统一扩散与自回归方法扩展机器人基础模型

其他(抓取,VLN等)

ICLR 2025 | TeleAI提出过程引导的大模型具身推理框架

铰链物体的通用世界模型,超越扩散方法,入选CVPR 2025

中山大学&鹏城实验室 | 面向主动探索的可信具身问答:数据基准,方法与指标

Uni-3DAR:统一3D世界,性能超扩散模型256%,推理快21.8倍

TPAMI2025 | NavCoT:中山大学具身导航参数高效训练!

CVPR2025 | 长程VLN平台与数据集:迈向复杂环境中的智能机器人

CVPR2025满分作文!TSP3D:高效3D视觉定位,性能和推理速度均SOTA(清华大学)

模拟和真实环境SOTA!MapNav:基于VLM的端到端VLN模型,赋能端到端智能体决策

场面混乱听不清指令怎么执行任务?实体灵巧抓取系统EDGS指出了一条明路

北京大学与智元机器人联合实验室发布OmniManip:显著提升机器人3D操作能力

动态 3D 场景理解要理解什么?Embodied VideoAgent来揭秘!

NeurIPS 2024 | HA-VLN:具备人类感知能力的具身导航智能体

博世最新!Depth Any Camera:任意相机的零样本度量深度估计

真机数据白采了?银河通用具身大模型已充分泛化,基于仿真数据!

港科大最新!GaussianProperty:无需训练,VLM+3DGS完成零样本物体材质重建与抓取

VinT-6D:用于机器人手部操作的大规模多模态6D姿态估计数据集

机器人有触觉吗?中科大《NSR》柔性光栅结构色触觉感知揭秘!

波士顿动力最新SOTA!ThinkGrasp:通过GPT-4o完成杂乱环境中的抓取工作

LLM+Zero-shot!基于场景图的零样本物体目标导航(清华大学博士分享)

PoliFormer: 使用Transformer扩展On-Policy强化学习,卓越的导航器

具身硬核梳理

一文贯通Diffusion原理:DDPM、DDIM和Flow Matching

Diffusion Policy在机器人操作任务上有哪些主流的方法?

强化学习中 Sim-to-Real 方法综述:基础模型的进展、前景和挑战

墨尔本&湖南大学 | 具身智能在三维理解中的应用:三维场景问答最新综述

十五校联合出品!人形机器人运动与操控:控制、规划与学习的最新突破与挑战

扩散模型也能推理时Scaling,谢赛宁团队研究可能带来文生图新范式

全面梳理视觉语言模型对齐方法:对比学习、自回归、注意力机制、强化学习等

基础模型如何更好应用在具身智能中?美的集团最新研究成果揭秘!

关于具身智能Vision-Language-Action的一些思考

具身仿真×自动驾驶

视频模型For具身智能:Video Prediction Policy论文思考分析

性能爆拉30%!DreamDrive:时空一致下的生成重建大一统

真机数据白采了?银河通用具身大模型已充分泛化,基于仿真数据!

高度逼真3D场景!UNREALZOO:扩展具身智能的高真实感虚拟世界

MMLab最新FreeSim:一种用于自动驾驶的相机仿真方法

麻省理工学院!GENSIM: 通过大型语言模型生成机器人仿真任务

EmbodiedCity:清华发布首个真实开放环境具身智能平台与测试集!

华盛顿大学 | Manipulate-Anything:操控一切! 使用VLM实现真实世界机器人自动化

东京大学最新!CoVLA:用于自动驾驶的综合视觉-语言-动作数据集

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?