卷积神经网络

卷积神经网络的两个主要特征。局部连接是CNN通过卷积操作对局部数据进行学习,然后将在更深层将局部学习到的特征组合起来得到数据的全局信息。权值共享可以用较少的参数,训练出更加好的模型。CNN主要包括卷积层、激活层、池化层和全连接层。

卷积层:

卷积是CNN的核心操心,主要用于提取数据的局部特征,在卷积层中,上一层学习到的特征信息与卷积核相互作用,形成卷积层的输出特征矩阵,每个输出特征矩阵可以包含具有多个输入特征矩阵的卷积,一维卷积的运算步骤如图所示。

激活层:

根据RELU函数的收敛快,求梯度简单的特点,卷积神经网络的激活函数通常为RELU函数,如公式所示。

池化层:

池化就是为了使模型可以学习更深层的特征。通过池化操作将会忽略一些不重要的局部特征信息,可以让模型学习到更为重要的深层特征信息。常见的池化操作是平均池化和最大池化。

全连接层:

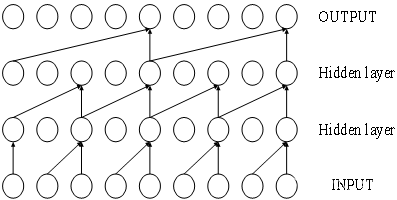

全连接就是把经过卷积提取的局部特征重新通过权值矩阵整合成完整的特征数据,用到了卷积提取的所有局部特征。

扩展因果卷积

扩展因果卷积(Dilated Causal Convolutional,DCC)是2016年被Oord A V D提出,因果卷积是卷积在时间序列数据的特殊应用,可以保证卷积神经网络的卷积核能够使卷积运算完全符合时间序列,卷积核只能读取当前信息和历史信息。

因果卷积:

因果卷积如图所示。对于因果卷积,存在的一个问题是需要很多层或者很大的卷积核来增加卷积的感受野。增加感受野可以通过扩展卷积来实现,扩展卷积主要是通过有规律的跳过部分输入来使卷积核可以应用于大于卷积核本身长度的区域。

扩展卷积:

利用扩展卷积可以系统的聚合多尺度的上下文信息,减少了由于下采样操作而导致的分辨率或覆盖率损失,扩展因果卷积如图2-4所示,卷积感受野扩大了1,2,4倍,扩展卷积可以使模型在层数不大的情况下有非常大的感受野。扩展卷积的使用,可以使模型学习数据不同时间间隔的特征,提取数据的空间特征。

20万+

20万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?