获取一个网页最简单的方法就是:构造一个向服务器请求资源的Request对象,返回一个Response对象即r,其包含从服务器返回的所有的相关资源

r = requests.get(url)requests.get()完整的使用方法有三个参数

requests.get(url,params=None,**kwargs)

url:获取页面的url链接

params:url中的额外参数,字典或字节流格式,可选

**kwargs:12个控制访问的参数,可选Response对象

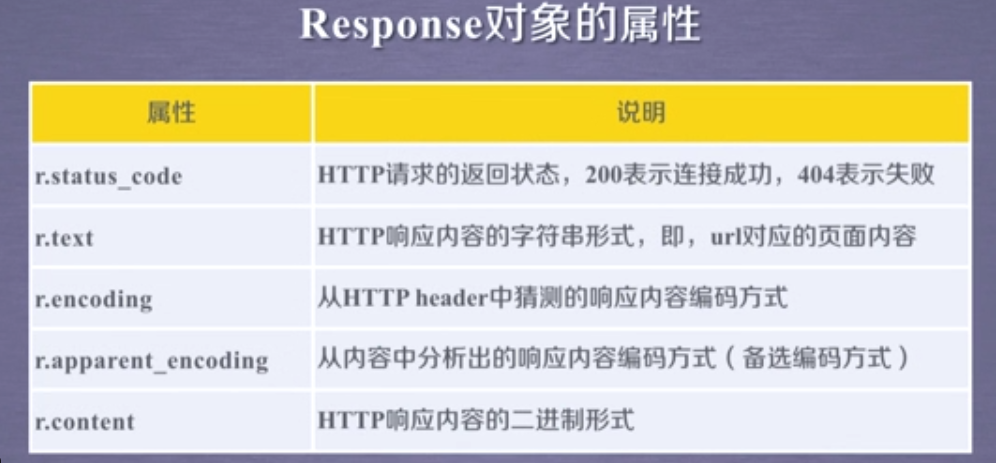

Response对象包含了爬虫返回的全部内容

Response对象最常用和最必要的属性

使用get方法获取网络资源的基本流程

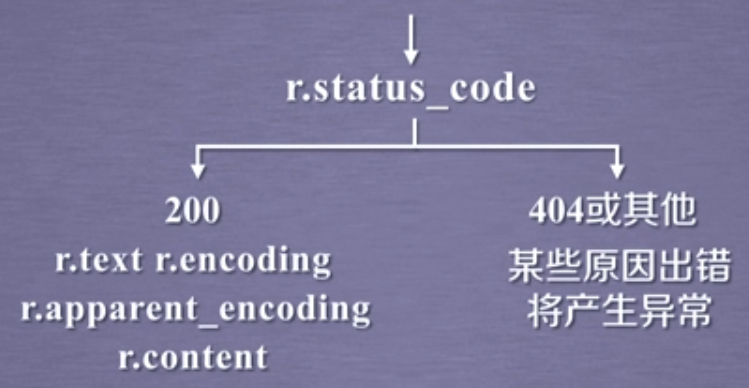

首先用r.status_code来检查返回的Response对象的状态,如果状态是200,就可以用r.text、r.encoding、r.apparent_encoding和r.content等解析返回的内容;如果返回的状态码是404或者其他,那就说明我们这次url的访问因为某种原因出错或产生异常了

实例:

#coding:utf-8

import requests

# 调用request库

r = requests.get("http://www.baidu.com")

# 用get方法去访问百度的主页

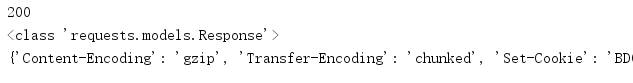

print(r.status_code)

# 用r.status_code来检测这个请求的状态码,如果状态码是200,说明访问成功;如果不是200,访问失败

print type(r)

# 用type检测r的类型,可以看到返回的是一个类,这个类的名是Response

print (r.headers)

# 用r.headers获取页面的头部信息

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?