本博客用于个人复习使用。有不对的地方希望看到的各位请不吝指出。

一。 几乎每个关于Scrapy的框架介绍都会来这么一个图 我也跟个风。。。

没必要直接看这第一步。。个人也是有点蒙 正在努力。。。第二步开始看就好。

英文解释的各个步骤就不贴上去了,各位想看直接搜就可以了。中文模板

https://scrapy-chs.readthedocs.io/zh_CN/1.0/topics/architecture.html

组件

Scrapy Engine

引擎负责控制数据流在系统中所有组件中流动,并在相应动作发生时触发事件。 详细内容查看下面的数据流(Data Flow)部分。

调度器(Scheduler)

调度器从引擎接受request并将他们入队,以便之后引擎请求他们时提供给引擎。

下载器(Downloader)

下载器负责获取页面数据并提供给引擎,而后提供给spider。

Spiders

Spider是Scrapy用户编写用于分析response并提取item(即获取到的item)或额外跟进的URL的类。 每个spider负责处理一个特定(或一些)网站。 更多内容请看 Spiders 。

Item Pipeline

Item Pipeline负责处理被spider提取出来的item。典型的处理有清理、 验证及持久化(例如存取到数据库中)。 更多内容查看 Item Pipeline 。

下载器中间件(Downloader middlewares)

下载器中间件是在引擎及下载器之间的特定钩子(specific hook),处理Downloader传递给引擎的response。 其提供了一个简便的机制,通过插入自定义代码来扩展Scrapy功能。更多内容请看 下载器中间件(Downloader Middleware) 。

Spider中间件(Spider middlewares)

Spider中间件是在引擎及Spider之间的特定钩子(specific hook),处理spider的输入(response)和输出(items及requests)。 其提供了一个简便的机制,通过插入自定义代码来扩展Scrapy功能。更多内容请看 Spider中间件(Middleware) 。

数据流(Data flow)

Scrapy中的数据流由执行引擎控制,其过程如下:

1。引擎打开一个网站(open a domain),找到处理该网站的Spider并向该spider请求第一个要爬取的URL(s)。

2。引擎从Spider中获取到第一个要爬取的URL并在调度器(Scheduler)以Request调度。

3。引擎向调度器请求下一个要爬取的URL。

4。调度器返回下一个要爬取的URL给引擎,引擎将URL通过下载中间件(请求(request)方向)转发给下载器(Downloader)。

5。一旦页面下载完毕,下载器生成一个该页面的Response,并将其通过下载中间件(返回(response)方向)发送给引擎。

6。引擎从下载器中接收到Response并通过Spider中间件(输入方向)发送给Spider处理。

7。Spider处理Response并返回爬取到的Item及(跟进的)新的Request给引擎。

8。引擎将(Spider返回的)爬取到的Item给Item Pipeline,将(Spider返回的)Request给调度器。

9。(从第二步)重复直到调度器中没有更多地request,引擎关闭该网站。

二、这里正式开始。创建一个项目

我们尝试爬取豆瓣电影排行榜250

爬取内容简单一点 电影名 排名 导演 简介 四个信息

https://movie.douban.com/top250

准备好开发环境后命令行执行。

scrapy startproject 项目名

比如 DouBanMovie 这个无所谓了

scrapy startproject DouBanMovie

然后进入该目录创建一个爬虫文件。

scrapy genspider 爬虫名 爬取网址

cd DouBanMovie

scrapy genspider douban movie.douban.com/top250

项目已经创建 完成

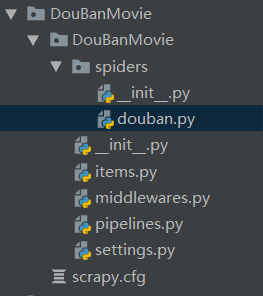

目录结构

.

├── DoubanMovie – 项目根目录

│ ├── init.py

│ ├── pycache --python运行临时文件 pyc

│ │ ├── init.cpython-36.pyc

│ │ └── settings.cpython-36.pyc

│ ├── items.py – 用来定义爬取哪些内容 (类似Django中的models)

│ ├── middlewares.py --中间件

│ ├── pipelines.py --管道,用来处理爬取的数据

│ ├── settings.py --配置文件

│ └── spiders --自定义爬虫包

│ ├── init.py

│ ├── pycache

│ │ └── init.cpython-36.pyc

│ └── douban.py --一个爬虫文件 一般来说我们在这里写的多

└── scrapy.cfg – 部署时候用的配置文件

三、完成爬虫文件。

1。修改settings.py中文件

ROBOTSTXT_OBEY = True改为

ROBOTSTXT_OBEY = False # 不遵守网站的ROBOTSTXT文件规则

将这一行注释去掉。主要是 防止网页访问过快,被封。。。

DOWNLOAD_DELAY = 3

2。在douban.py 文件下修改完成 初步工作。

class DoubanSpider(scrapy.Spider):

name = 'douban'

allowed_domains = ['movie.douban.com']

start_urls = ['http://movie.douban.com/top250']

def start_requests(self):

for url in self.start_urls:

request = scrapy.Request(url)

request.headers["User-Agent"] = 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.26 Safari/537.36 Core/1.63.6788.400 QQBrowser/10.3.2843.400'

yield request

def parse(self, response):

next_page = response.xpath("//span[@class='next']/a/@href")[0]

print(next_page)

if next_page:

print(response.urljoin(next_page.get()))

request = response.follow(next_page)

request.headers["User-Agent"] = 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.26 Safari/537.36 Core/1.63.6788.400 QQBrowser/10.3.2843.400'

yield request

注:

-

1 start_requests

方法如果没有重写。效果与此差不多。重写该方法是为了添加Headers中的User_Agent信息。不然下载豆瓣相关网页时,会被当成爬虫程序封掉。 -

2 yield 如果yield的是一个网络请求,表示继续放入网络请求队列,等待获取。可以用以下两个方法获取scrapy.Request对象。

scrapy.Request(url) # 该方法中url必须是完整的网址

response.follow(url) # 该方法,中url不仅可以是绝对地址,还可以是相对地址甚至一个链接对象。会自动拼接出一个完成的地址

- 3 还有一个方法用于拼接出完成地址

response.urljoin(url) # 会根据response响应的原地址与url进行拼接得出完整地址,比较智能

通过该方法可以获取所有页,详情信息等一下获取。

scrapy crawl douban --nolog

douban是我们的爬虫名。我们可以再spider目录下创建多个爬虫文件,每个文件类属性name 就代表了我们的爬虫名。

3。 解析爬虫爬取的response文件。

2步骤也有使用通过response解析出下一页的链接。 parse 函数接受的response参数就是爬虫获取的相应结果,它进行了一定的封装。 from scrapy.http.re

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1217

1217

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?