本文来自《老饼讲解-BP神经网络》https://www.bbbdata.com/

交叉熵、信息熵概念基本贯穿了机器学习、深度学习中的类别识别模型,例如KL分布、softmax等等都是基于交叉熵与信息熵的理论进行定义的,本文不妨形象梳理一下什么是交叉熵、信息熵,以此一通百通。

一、信息量

1.1.什么是信息量

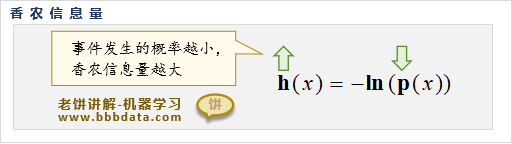

信息量是对信息的一种量化指标,用于衡量信息的大小,最常用的是香农信息量,香农信息量的定义与计算公式如下:

h ( x ) = − ln ( p ( x ) ) h(x)=−\ln(p(x)) h(x)=−ln(p(x))

其中,p是事件x发生的概率,h则为事件x所包含的香农信息量。

从式中可以看到,事件的香农信息量与事件的概率成反比,

即一件事发生的概率越小,则包含的信息量越大

二、什么是信息熵

2.1.什么是信息熵

信息熵通俗来说就是信息量的期望,香农信息熵则是香农信息量的期望

如果已知 x 有 n 种取值,且知道每种取值的概率,则 x 的香农信息熵如下:

H ( x ) = − ∑ i n p ( x i ) ln p (

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?