iOS系统中H264硬解码及显示详解

苹果在iOS 8.0系统之前,没有开放系统的硬件编码解码功能,不过Mac OS系统一直有,被称为

VideoToolBox的框架来处理硬件的编码和解码,终于在iOS 8.0后,苹果将该框架引入iOS系统。

一、VideoToolbox基本数据结构:

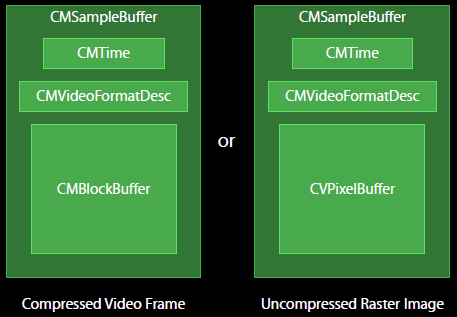

1、CVPixelBuffer:编码前和解码后的图像数据结构;

2、CMTime、CMClock和CMTimebase:时间戳相关。时间以64-bit/32-bit的形式出现;

3、CMBlockBuffer:编码后,结果图像的数据结构;

4、CMVideoFormatDescription:图像存储方式,编解码器等格式描述;

5、CMSampleBuffer:存放编解码前后的视频图像的容器数据结构。

下图为H264解码前后数据结构示意图:

二、硬解使用方法:

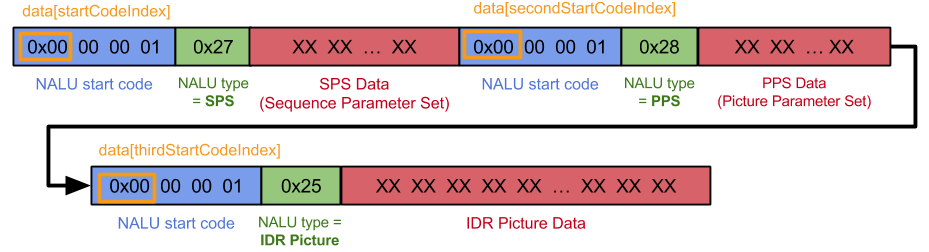

H264的码流由NALU单元组成,NALU单元包含视频图像数据和H264的参数信息。其中视频图像数据就是

CMBlockBuffer,而H264的参数信息则可以组合成FormatDesc。具体来说参数信息包含SPS(Sequence Parameter Set)和PPS(Picture Parameter Set)。下图显示一个H264码流的结构:

解码方式一:(通过系统提供的AVSampleBufferDisplayLayer来解码并显示)

-

1、初始化H2

本文详细介绍了iOS系统中H264硬解码的两种方法,包括通过AVSampleBufferDisplayLayer显示和使用CoreMedia框架解码到CVPixelBufferRef。解码方式一简单高效,但不便于图像处理;方式二允许获取图像数据,但效率较低。

本文详细介绍了iOS系统中H264硬解码的两种方法,包括通过AVSampleBufferDisplayLayer显示和使用CoreMedia框架解码到CVPixelBufferRef。解码方式一简单高效,但不便于图像处理;方式二允许获取图像数据,但效率较低。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

7506

7506

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?