1. PG介绍

这次主要来分享Ceph中的PG各种状态详解,PG是最复杂和难于理解的概念之一,PG的复杂如下:

- 在架构层次上,PG位于RADOS层的中间。

a. 往上负责接收和处理来自客户端的请求。

b. 往下负责将这些数据请求翻译为能够被本地对象存储所能理解的事务。 - 是组成存储池的基本单位,存储池中的很多特性,都是直接依托于PG实现的。

- 面向容灾域的备份策略使得一般而言的PG需要执行跨节点的分布式写,因此数据在不同节点之间的同步、恢复时的数据修复也都是依赖PG完成。

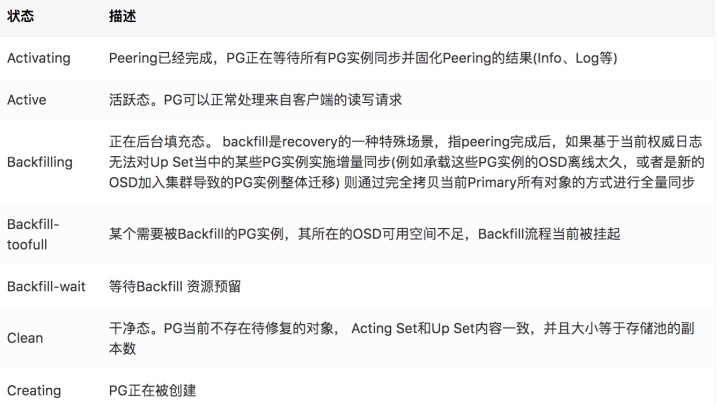

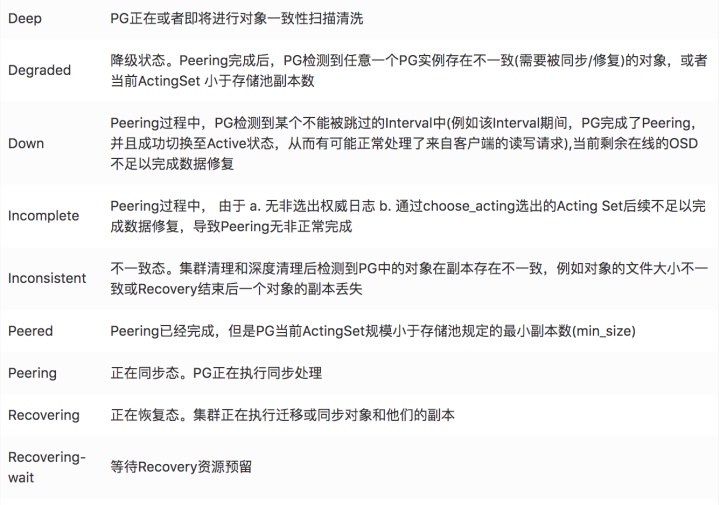

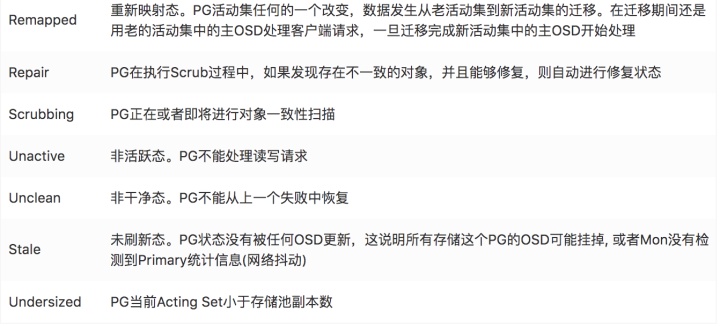

2. PG状态表

正常的PG状态是 100%的active + clean, 这表示所有的PG是可访问的,所有副本都对全部PG都可用。

如果Ceph也报告PG的其他的警告或者错误状态。PG状态表:

3.1 Degraded

3.1.1 说明

- 降级:由上文可以得知,每个PG有三个副本,分别保存在不同的OSD中,在非故障情况下,这个PG是active+clean 状态,那么,如果PG 的 副本osd.4 挂掉了,这个 PG 是降级状态。

3.1.2 故障模拟

a. 停止osd.1

$ systemctl stop ceph-osd@1

b. 查看PG状态

$ bin/ceph pg stat 20 pgs: 20 active+undersized+degraded; 14512 kB data, 302 GB used, 6388 GB / 6691 GB avail; 12/36 objects degraded (33.333%)

c. 查看集群监控状态

$ bin/ceph health detail

HEALTH_WARN 1 osds down; Degraded data redundancy: 12/36 objects degraded (33.333%), 20 pgs unclean, 20 pgs degraded; application not enabled on 1 pool(s)

OSD_DOWN 1 osds down

osd.1 (root=default,host=ceph-xx-cc00) is down

PG_DEGRADED Degraded data redundancy: 12/36 objects degraded (33.333%), 20 pgs unclean, 20 pgs degraded

pg 1.0 is active+undersized+degraded, acting [0,2]

pg 1.1 is active+undersized+degraded, acting [2,0]

d. 客户端IO操作

#写入对象

$ bin/rados -p test_pool put myobject ceph.conf

#读取对象到文件

$ bin/rados -p test_pool get myobject.old

#查看文件

$ ll ceph.conf*

-rw-r--r-- 1 root root 6211 Jun 25 14:01 ceph.conf

-rw-r--r-- 1 root root 6211 Jul 3 19:57 ceph.conf.old

故障总结:

为了模拟故障,(size = 3, min_size = 2) 我们手动停止了 osd.1,然后查看PG状态,可见,它此刻的状态是active+undersized+degraded,当一个 PG 所在的 OSD 挂掉之后,这个 PG 就会进入undersized+degraded 状态,而后面的[0,2]的意义就是还有两个副本存活在 osd.0 和 osd.2 上, 并且这个时候客户端可以正常读写IO。

3.1.3 总结

- 降级就是在发生了一些故障比如OSD挂掉之后,Ceph 将这个 OSD 上的所有 PG 标记为 Degraded。

- 降级的集群可以正常读写数据,降级的 PG 只是相当于小毛病而已,并不是严重的问题。

- Undersized的意思就是当前存活的PG 副本数为 2,小于副本数3,将其做此标记,表明存货副本数不足,也不是严重的问题。

3.2 Peered

3.2.1 说明

- Peering已经完成,但是PG当前Acting Set规模小于存储池规定的最小副本数(min_size)。

3.2.2 故障模拟

a. 停掉两个副本osd.1,osd.0

$ systemctl stop ceph-osd@1

$ systemctl stop ceph-osd@0

b. 查看集群健康状态

$ bin/ceph health detail

HEALTH_WARN 1 osds down; Reduced data availability: 4 pgs inactive; Degraded data redundancy: 26/39 objects degraded (66.667%), 20 pgs unclean, 20 pgs degraded; application not enabled on 1 pool(s)

OSD_DOWN 1 osds down

osd.0 (root=default,host=ceph-xx-cc00) is down

PG_AVAILABILITY Reduced data availability: 4 pgs inactive

pg 1.6 is stuck inactive for 516.741081, current state undersized+degraded+peered, last acting [2]

pg 1.10 is stuck inactive for 516.737888, current state undersized+degraded+peered, last acting [2]

pg 1.11 is stuck inactive for 516.737408, current state undersized+degraded+peered, last acting [2]

pg 1.12 is stuck inactive for 516.736955, current state undersized+degraded+peered, last acting [2]

PG_DEGRADED Degraded data redundancy: 26/39 objects degraded (66.667%), 20 pgs unclean, 20 pgs degraded

pg 1.0 is undersized+degraded+peered, acting [2]

pg 1.1 is undersized+degraded+peered, acting [2]

c. 客户端IO操作(夯住)

#读取对象到文件,夯住IO

$ bin/rados -p test_pool get myobject ceph.conf.old

故障总结:

- 现在pg 只剩下osd.2上存活,并且 pg 还多了一个状态:peered,英文的意思是仔细看,这里我们可以理解成协商、搜索。

- 这时候读取文件,会发现指令会卡在那个地方一直不动,为什么就不能读取内容了,因为我们设置的 min_size=2 ,如果存活数少于2,比如这里的 1 ,那么就不会响应外部的IO请求。

d. 调整min_size=1可以解决IO夯住问题

#设置min_size = 1

$ bin/ceph osd pool set test_pool min_size 1

set pool 1 min_size to 1

e. 查看集群监控状态

$ bin/ceph health detail

HEALTH_WARN 1 osds down; Degraded data redundancy: 26/39 objects degraded (66.667%), 20 pgs unclean, 20 pgs degraded, 20 pgs undersized; application not enabled on 1 po

本文详细介绍了Ceph中的PG状态,包括 Degraded, Peered, Remapped, Recovery, Backfill, Stale, Inconsistent, Down 和 Incomplete。每个状态的说明、故障模拟及总结,帮助理解在不同情况下如何处理PG状态问题,确保集群正常运行和数据安全性。"

51849250,5660339,MySQL中的NULL值处理技巧,"['数据库', 'MySQL', 'SQL查询', 'PHP开发', '数据处理']

本文详细介绍了Ceph中的PG状态,包括 Degraded, Peered, Remapped, Recovery, Backfill, Stale, Inconsistent, Down 和 Incomplete。每个状态的说明、故障模拟及总结,帮助理解在不同情况下如何处理PG状态问题,确保集群正常运行和数据安全性。"

51849250,5660339,MySQL中的NULL值处理技巧,"['数据库', 'MySQL', 'SQL查询', 'PHP开发', '数据处理']

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?