前言:

本人为完成利用 spring-ai-openai-spring-boot-starterspring整合deepseek的任务(因为还可以用本地部署的方式),在博客和AI工具中来回跳动,然而最终还是在官网找到了答案,完成过程中犯错无数,因此挥毫书就本文,希望能给大家带来帮助。

一:环境准备

以下是本人的环境,或许不是最优,但确保无误

1.jdk版本:17(最好是17+)

2.maven:3.9.9

3.springboot:3.3.9(注意:springboot版本要求为3.2.x和3.3.x)

4.idea用的是2024版的,大家用新版本的

二:依赖配置

依赖勾选:

Web -> Spring Web

Al -> OpenAI

(其实我们是将deepseek伪装成 OpenAI,DeepSeek 提供了 OpenAI 兼容模式。)

三:核心配置

在application.properties文件中,必须配置如下环境变量:前提是你已经创建了api key(api-key只有创建时才能复制,也要注意不能让别人看到,不然他可能会花你的key)

# DeepSeek的OpenAI式端点

spring.ai.openai.base-url=https://api.deepseek.com

# DeepSeek API KEY

spring.ai.openai.api-key=#你的api-key

# 配置AI大模型

spring.ai.openai.chat.options.model=#你选择的模型

# 具体选择如图所示

API文档地址:https://api-docs.deepseek.com/zh-cn/

四:实战测试

在controller包下新建ChatController:

@RestController

public class ChatController {

private final OpenAiChatModel chatModel;

@Autowired

public ChatController(OpenAiChatModel chatModel) {

this.chatModel = chatModel;

}

@GetMapping("/ai/generate")

public Map generate(@RequestParam(value = "message", defaultValue = "who is the first emperor of China?") String message) {

return Map.of("generation", this.chatModel.call(message));

}

@GetMapping("/ai/generateStream")

public Flux<ChatResponse> generateStream(@RequestParam(value = "message", defaultValue = "Tell me a joke") String message) {

Prompt prompt = new Prompt(new UserMessage(message));

return this.chatModel.stream(prompt);

}

//default value可以自己取

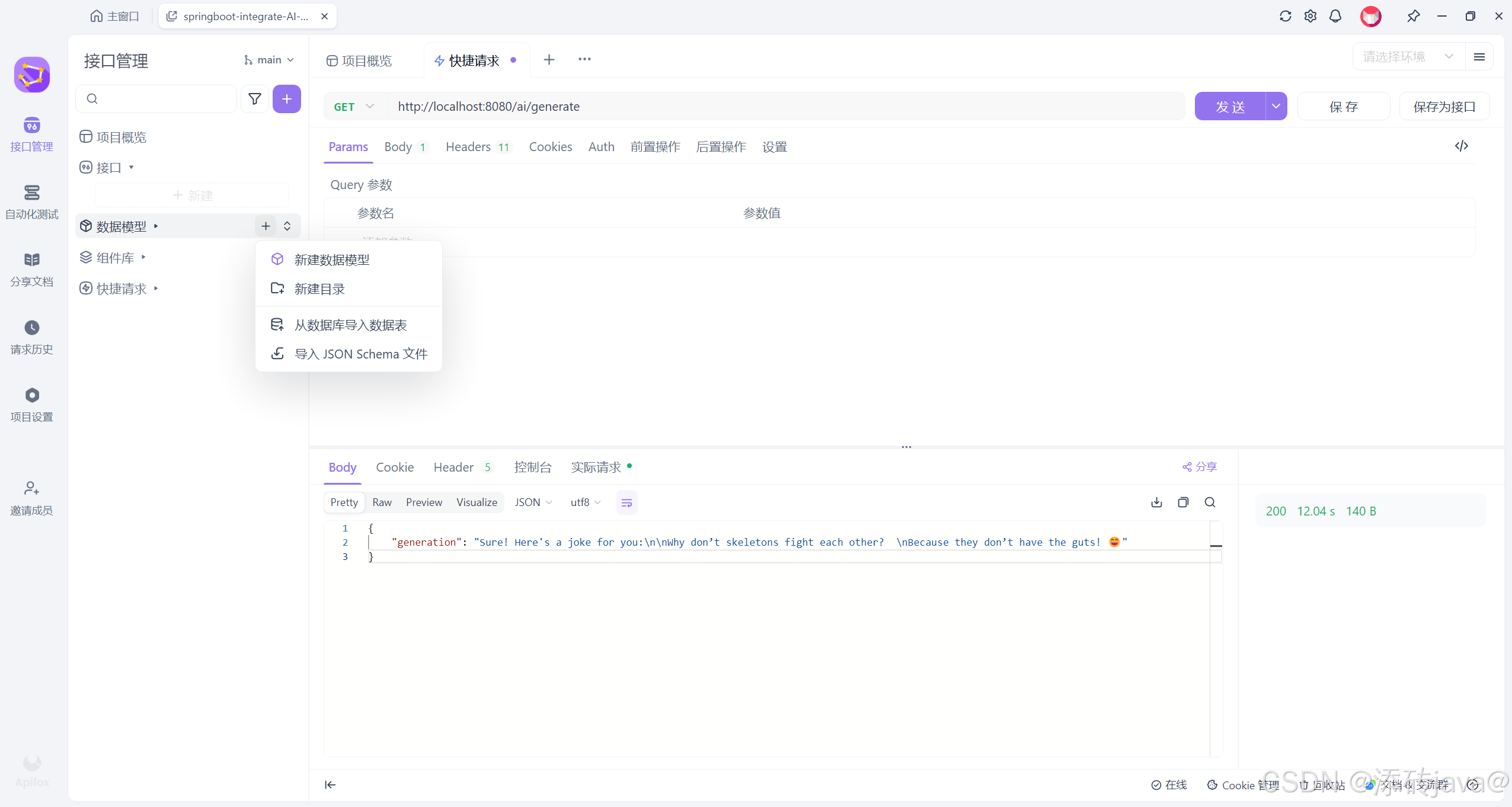

}之后,启动项目(注意:要购买token,不需要很贵,花1块钱就行了,可以在00:30~08:30购买,有优惠哦。),在apifox或者postman(这里推荐apifox,有简体中文,而且好像是中国人开发的),新建快捷请求,输入对应的路径即可,这里,也给大家演示一下:

总结:

落笔至此,本篇完结。其实这并不算难,只是细节需要注意,pom文件的依赖,包括版本问题,以及properties配置写错一个字都可能导致项目的运行失败。所以推荐大家多去看官网,多看官网,多看官网(可以安装插件方便阅读)。本篇spring的官网地址:DeepSeek Chat :: Spring AI Reference![]() https://docs.spring.io/spring-ai/reference/api/chat/deepseek-chat.html

https://docs.spring.io/spring-ai/reference/api/chat/deepseek-chat.html

创作不易,希望可以帮到大家,有什么问题也可以在评论中指出,看到了就会回。

743

743

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?