1、集成学习

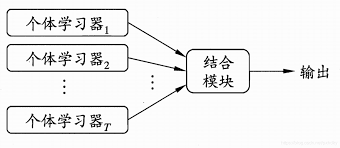

集成学习通过构建并结合多个学习器来完成学习任务。 一般先产生一组“个体学习器”,再用某种策略讲它们结合起来,结合起来的结果进行整合会获得比单个学习器更好的学习效果。

也就是说,集成学习有两个主要的问题需要解决,第一是如何得到若干个个体学习器,第二是如何选择一种结合策略,将这些个体学习器集合成一个强学习器。

对于如何得到若干个个体学习器。这里我们有两种选择。

第一种就是所有的个体学习器都是一个种类的,或者说是同质的。比如都是决策树个体学习器,或者都是神经网络个体学习器。第二种是所有的个体学习器不全是一个种类的,或者说是异质的。比如我们有一个分类问题,对训练集采用支持向量机个体学习器,逻辑回归个体学习器和朴素贝叶斯个体学习器来学习,再通过某种结合策略来确定最终的分类强学习器。

目前来说,同质个体学习器的应用是最广泛的,一般我们常说的集成学习的方法都是指的同质个体学习器。而同质个体学习器使用最多的模型是CART决策树和神经网络。同质个体学习器按照个体学习器之间是否存在依赖关系可以分为两类,第一个是个体学习器之间存在强依赖关系,一系列个体学习器基本都需要串行生成,代表算法是boosting系列算法,第二个是个体学习器之间不存在强依赖关系,一系列个体学习器可以并行生成,代表算法是bagging和随机森林(Random Forest)系列算法。

2、Boosting Bagging

用于减少偏差的Boosting:Boosting是一类可将弱学习器提升为强学习器的算法。

先从训练集中训练出一个基学习器,再根据基学习器的表现对训练样本分布进行调整,使得先前基学习器做错的训练样本在后续得到更多的关注,然后基于调整后的样本分布来训练下一个基学习器;如此重复进行,知道基学习器数目达到预先设定的值T,最终将T个基学习器进行加权结合。

用于减少方差的Bagging:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

582

582

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?