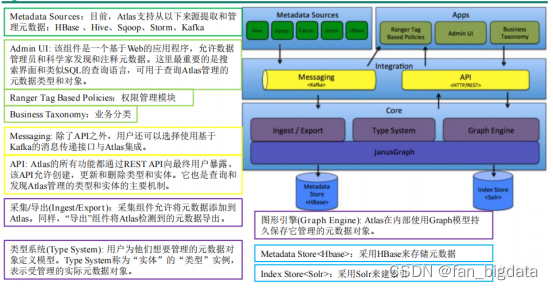

1.Atlas 架构原理

2.atlas安装

1)Atlas 官网地址:https://atlas.apache.org/

2)文档查看地址:https://atlas.apache.org/2.1.0/index.html

3)下载地址:https://www.apache.org/dyn/closer.cgi/atlas/2.1.0/apache-atlas-2.1.0-sources.tar.gz

2.1 安装环境准备

Atlas 安装分为:集成自带的 HBase + Solr;集成外部的 HBase + Solr。通常企业开发中

选择集成外部的 HBase + Solr,方便项目整体进行集成操作。

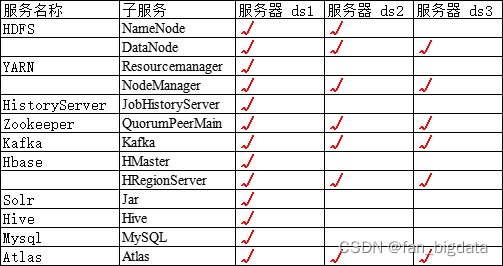

以下是 Atlas 所以依赖的环境及集群规划。

2.2 其他组件安装

hadoop、zookeeper、mysql、hbase、hive、kafka的安装参考之前的安装文档

2.3 安装solr

- 在ds1 节点上传 solr 安装包 solr-7.7.3.tgz,并解压到/opt目录,重命名为 solr

tar -zxvf solr-7.7.3.tgz -C /opt

mv solr-7.7.3/ solr

- 修改 solr 配置文件

cd /opt/solr/bin

vim solr.in.sh

- 找到 ZK_HOST 参数,删掉注释,然后修改

ZK_HOST="ds1:2181,ds2:2181,ds3:2181"

- 分发solr到ds2,ds3

scp -r /opt/solr ds2:/opt

scp -r /opt/solr ds3:/opt

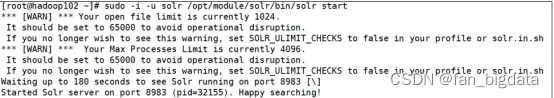

- 在ds1,ds2,ds3上启动solr集群

/opt/solr/bin/solr start

出现 Happy Searching! 字样表明启动成功

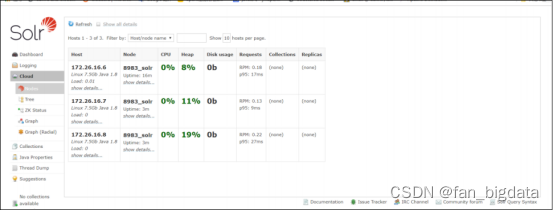

6. 访问web页面

默认端口为 8983,可指定三台节点中的任意一台 IP,http://ds1:8983

提示:UI 界面出现 Cloud 菜单栏时,Solr 的 Cloud 模式才算部署成功

2.4 安装atlas 2.1.0

2.4.1 上传与解压

1.把 apache-atlas-2.1.0-server.tar.gz 上传到 ds1 的/opt 目录下

2.解压 apache-atlas-2.1.0-server.tar.gz 到/opt目录下面

tar -zxvf apache-atlas-2.1.0-server.tar.gz -C /opt

3.修改 apache-atlas-2.1.0 的名称为 atlas

mv apache-atlas-2.1.0 atlas

2.4.2 修改Atlas 配置

2.4.2.1 Atlas 集成 Hbase

- 修改/opt/atlas/conf/atlas-application.properties 配置文件中的以下参数

atlas.graph.storage.hostname=ds1:2181,ds2:2181,ds3:2181

2.修改/opt/atlas/conf/atlas-env.sh 配置文件,增加以下内容

export HBASE_CONF_DIR=/opt/hbase-2.4.0/conf

2.4.2.2 Atlas 集成 Solr

1.修改/opt/atlas/conf/atlas-application.properties 配置文件中的以下参数

atlas.graph.index.search.backend=solr

atlas.graph.index.search.solr.mode=cloud

atlas.graph.index.search.solr.zookeeper.url=ds1:2181,ds2:2181,ds3:2181

2.创建 solr collection

/opt/solr/bin/solr create -c vertex_index -d /opt/atlas/conf/solr-shards 3 -replicationFactor 2

/opt/solr/bin/solr create -c edge_index -d /opt/atlas/conf/solr -shards 3 - replicationFactor 2

/opt/solr/bin/solr create -c fulltext_index -d /opt/atlas/conf/solr -shards 3 -replicationFactor 2

2.4.2.3 Atlas 集成 Kafka

修改/opt/atlas/conf/atlas-application.properties 配置文件中的以下参数

atlas.notification.embedded=false

atlas.kafka.data=/bigdata/kafka

atlas.kafka.zookeeper.connect=ds1:2181,ds2:2181,ds3:2181/kafka

atlas.kafka.bootstrap.servers=ds1:9092,ds2:9092,ds3:9092

2.4.2.4 修改Atlas Server 配置

1.修改/opt/atlas/conf/atlas-application.properties 配置文件中的以下参数

######### Server Properties #########

atlas.rest.address=http://ds1:21000

# If enabled and set to true, this will run setup steps when the server starts

atlas.server.run.setup.on.start=false

######### Entity Audit Configs #########

atlas.audit.hbase.tablename=apache_atlas_entity_audit

atlas.audit.zookeeper.session.timeout.ms=1000

atlas.audit.hbase.zookeeper.quorum=ds1:2181,ds2:2181,ds3:2181

2.记录性能指标,进入/opt/atlas/conf/路径,修改当前目录下的atlas-log4j.xml

vim atlas-log4j.xml

去掉如下代码的注释

<appender name="perf_appender"

class="org.apache.log4j.DailyRollingFileAppender">

<param name="file" value="${atlas.log.dir}/atlas_perf.log" />

<param name="datePattern" value="'.'yyyy-MM-dd" />

<param name="append" value="true" />

<layout class="org.apache.log4j.PatternLayout">

<param name="ConversionPattern" value="%d|%t|%m%n" />

</layout>

</appender>

<logger name="org.apache.atlas.perf" additivity="false">

<level value="debug" />

<appender-ref ref="perf_appender" />

</logger>

2.4.2.5 Atlas 启动

1.启动 Atlas 所依赖的环境

1)启动 Hadoop 集群

(1)在 NameNode 节点执行以下命令,启动 HDFS

start-dfs.sh

(2)在 ResourceManager 节点执行以下命令,启动 Yarn

start-yarn.sh

2)启动 Zookeeper 集群

zk.sh start

3)启动 Kafka 集群

kf.sh start

4)启动 Hbase 集群

在 HMaster 节点执行以下命令,启动 HBase

start-hbase.sh

5)启动 Solr 集群

在所有节点执行以下命令,使用 solr 用户启动 Solr

/opt/solr/bin/solr start

6)进入/opt/atlas 路径,启动 Atlas 服务

bin/atlas_start.py

提示:

(1)错误信息查看路径:/opt/atlas/logs/*.out 和 application.log

(2)停止 Atlas 服务命令为 atlas_stop.py

7)访问 Atlas 的 WebUI

访问地址:http://ds1:21000

注意:等待时间大概 2 分钟。

账户:admin

密码:admin

1569

1569

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?