目录

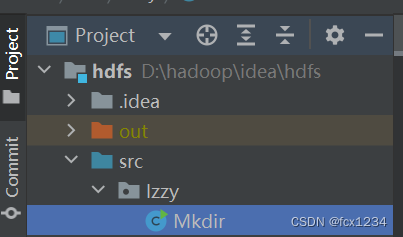

2.在hdfs项目的src->main->java路径下创建一个包,然后在包下创建一个java类实现hdfs的文件操作

1.右击项目名称,选择Open Module Settings

2.选择Artifacts,点击中间绿色的+号,选择JAR,再选择第二个选项

3.点击Main Class右边的小方块选择主类,下一个选项如果要打成一个压缩包选择第一个,如果其他依赖包要分开放也就是最后是多个jar包选择第二个选项。我选第一个,然后点击OK

4.勾选include in project build,点击+和-号添加最后jar包内的其他jar包,主要是将项目依赖的jar包导入,如果一开始配置好了,直接点OK就行。

5.然后点击Build按钮,选择Build Artifacts...

6.出现以下选择框,第一次使用选择Build,非第一次选Rebuild

7.Build完之后多出了out目录与target目录,接着就可以去本地out目录下找已经完成的jar包

5.3修改之前写的myhdfs脚本(我之前的myhdfs脚本是有内容的),脚本内部调用java命令运行能创建文件夹的jar包,从而实现在HDFS上创建文件夹

一、前期准备

1、Hadoop集群已配置完毕

2、Linux系统安装jdk

3、安装并破解IntelliJ IDEA

二、通过JAVA API操纵HDFS

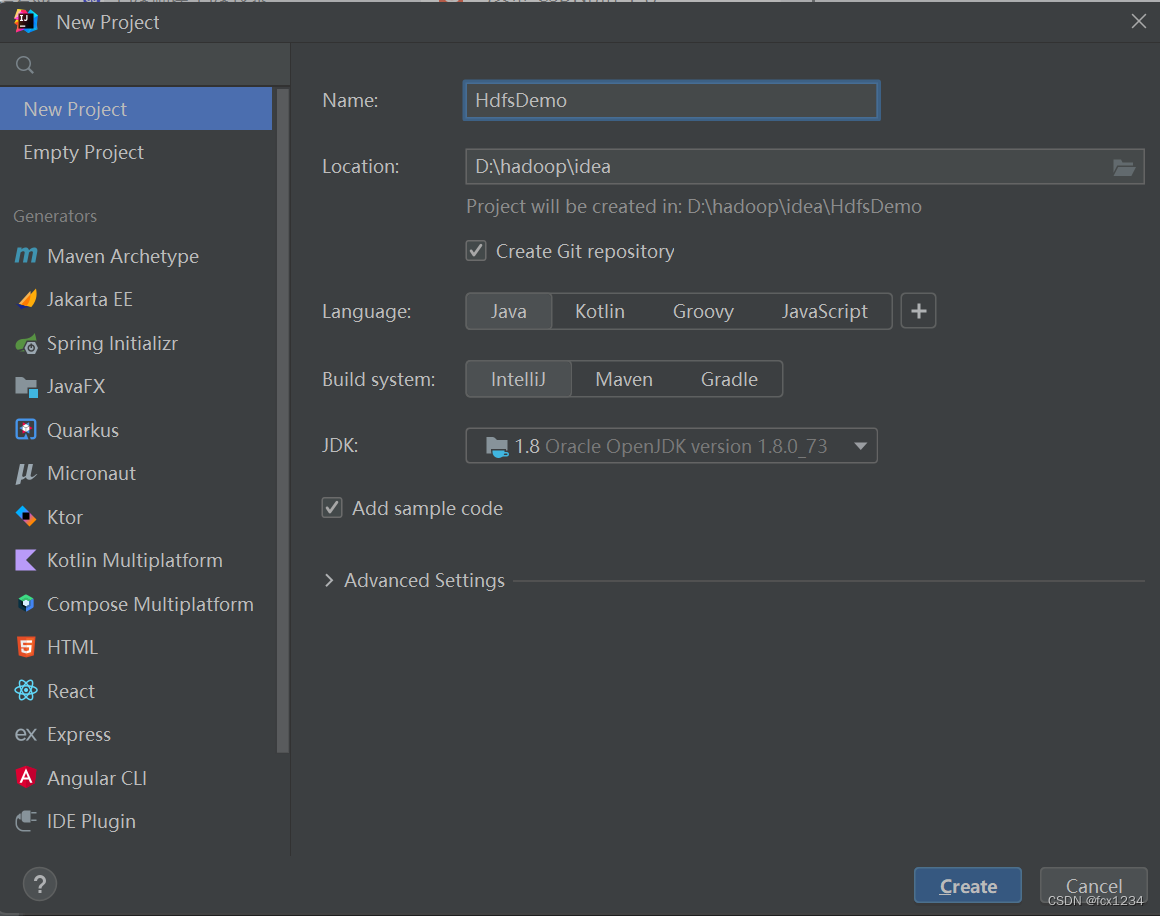

1.在IDEA中创建项目

2.在hdfs项目的src->main->java路径下创建一个包,然后在包下创建一个java类实现hdfs的文件操作

3.java类的代码

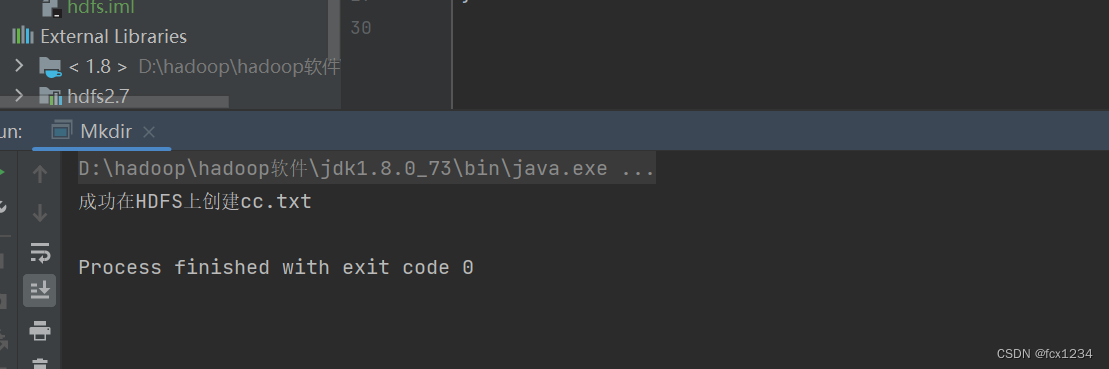

在代码中fs.mkdirs(new Path(targetDir));该方法的作用是请求在HDFS上创建指定的文件夹

public static void main(String[] args) throws IOException {

System.setProperty("HADOOP_USER_NAME","root");

if(args.length==0){

System.out.println("ERR!创建文件夹失败!请传入一个路径参数作为将要创建的文件夹");

return;

}

String targetDir=args[0];

//创建一个配置对象

Configuration conf = new Configuration() ;

//2设置fs.defaultFS 属性,目的是创建一个DistributedFileSystem对象

conf.set("fs.defaultFS","hdfs://192.168.58.3:9000");

//获取一个FileSystem对象(文件系统对象)

FileSystem fs=FileSystem.get(conf);

boolean mkdirs= fs.mkdirs(new Path(targetDir));

if(mkdirs){

System.out.println("成功在HDFS上创建"+targetDir);

}

fs.close();

}4.对JAVA程序传入参数后运行程序

5.将项目打包成可运行的jar包,并上传到服务器

5.1、IDEA开发hadoop项目打包

1.右击项目名称,选择Open Module Settings

2.选择Artifacts,点击中间绿色的+号,选择JAR,再选择第二个选项

3.点击Main Class右边的小方块选择主类,下一个选项如果要打成一个压缩包选择第一个,如果其他依赖包要分开放也就是最后是多个jar包选择第二个选项。我选第一个,然后点击OK

4.勾选include in project build,点击+和-号添加最后jar包内的其他jar包,主要是将项目依赖的jar包导入,如果一

本文详细介绍了如何在IntelliJIDEA中创建项目,使用JavaAPI来操纵Hadoop的HDFS,包括创建文件夹的操作。在打包和运行jar包时,可能会遇到权限问题,文中提供了具体的解决办法,即设置HADOOP_USER_NAME环境变量为root。

本文详细介绍了如何在IntelliJIDEA中创建项目,使用JavaAPI来操纵Hadoop的HDFS,包括创建文件夹的操作。在打包和运行jar包时,可能会遇到权限问题,文中提供了具体的解决办法,即设置HADOOP_USER_NAME环境变量为root。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?